Note de l'auteur : Analyse approfondie de la cause fondamentale de l'erreur content should be a valid list lors de l'appel du modèle Claude Opus 4.6 Thinking via un service proxy API, expliquant les différences de format entre les deux points de terminaison /v1/messages et /v1/chat/completions et les solutions de compatibilité.

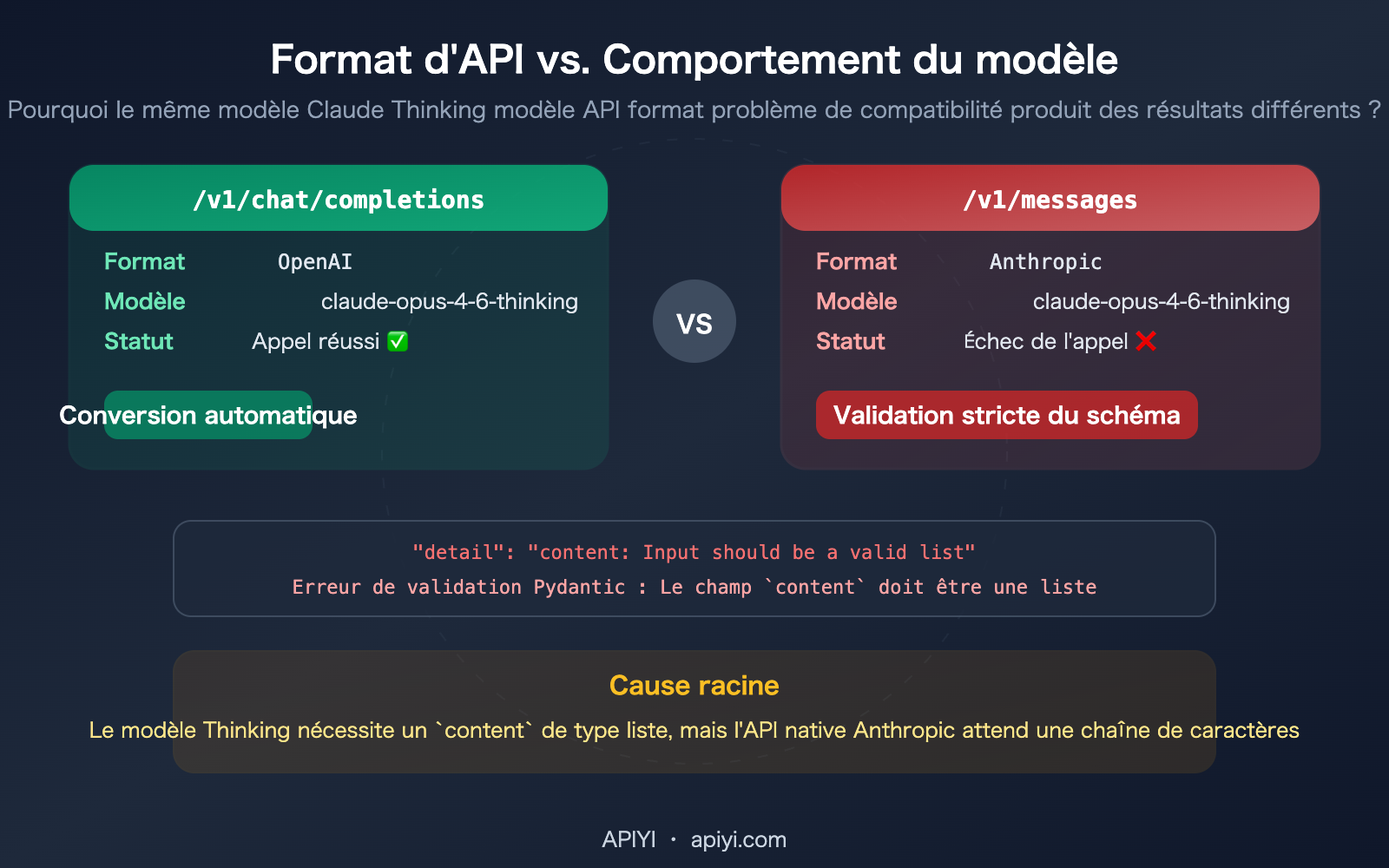

Avez-vous déjà rencontré ce scénario ? Avec le modèle claude-opus-4-6-thinking, tout fonctionne normalement via /v1/chat/completions (format OpenAI), mais lorsque vous passez à /v1/messages (format natif Anthropic), vous obtenez l'erreur content: Input should be a valid list ? Ce phénomène contre-intuitif révèle en réalité un problème profond de compatibilité du modèle Thinking entre les deux formats d'API. Cet article partira de la structure fondamentale de l'API pour expliquer clairement la cause de l'erreur et la méthode d'appel correcte.

Valeur clé : Après avoir lu cet article, vous comprendrez les différences de comportement du modèle Thinking dans les deux formats d'API, vous résoudrez l'erreur content should be a valid list, et vous maîtriserez la gestion correcte des blocs de réflexion (thinking blocks) dans les conversations multi-tours.

Points clés de compatibilité de l'API du modèle Claude Thinking

Commençons par répondre directement à l'essence de ce phénomène "contre-intuitif".

| Point clé | Explication | Impact |

|---|---|---|

| Cause racine de l'erreur | Le service proxy API transmet content: "string" à /v1/messages qui attend content: [list] |

Incompatibilité de format → erreur 400 |

| Pourquoi le format OpenAI fonctionne | /v1/chat/completions permet à content d'être une chaîne, il extrait automatiquement les blocs thinking |

Format simple, bonne compatibilité |

| Pourquoi le format Anthropic échoue | /v1/messages exige strictement que content soit une liste de blocs, avec thinking en première position |

La conversion de format par le proxy est incomplète |

| Différence de nom de modèle | claude-opus-4-6-thinking est un alias de la plateforme proxy, le nom officiel est claude-opus-4-6 |

thinking est activé via un paramètre, pas via le nom du modèle |

| Approche correcte | Utiliser le format OpenAI pour l'appel, ou s'assurer que le proxy traite correctement la conversion du format content | Choisir le bon endpoint + transmettre les bons paramètres |

L'essence technique de l'erreur de l'API du modèle Claude Thinking

Le message d'erreur content: Input should be a valid list révèle une différence de format cruciale :

L'API native d'Anthropic (/v1/messages) exige que le champ content soit un tableau de blocs de contenu (list) :

{

"role": "assistant",

"content": [

{"type": "thinking", "thinking": "Analysons ce problème...", "signature": "CpcH..."},

{"type": "text", "text": "Voici ma réponse..."}

]

}

Le format compatible OpenAI (/v1/chat/completions) permet à content d'être une chaîne de caractères pure :

{

"role": "assistant",

"content": "Voici ma réponse..."

}

Lorsque la configuration du canal d'une plateforme de service proxy API (comme le backend d'APIYI) est au format /v1/messages, si le client en amont envoie un content au format OpenAI (chaîne), le proxy doit convertir "string" en [{"type": "text", "text": "string"}]. Si cette conversion est incomplète – en particulier lorsque la réponse du modèle Thinking est retransmise au tour de dialogue suivant – cela déclenche l'erreur Input should be a valid list.

Comparaison détaillée des deux formats d'endpoint de l'API du modèle Claude Thinking

C'est la clé pour comprendre ce problème : les deux endpoints ont des exigences fondamentalement différentes pour le champ content.

Différences de format de l'API du modèle Claude Thinking

| Dimension de comparaison | /v1/chat/completions (OpenAI) |

/v1/messages (Anthropic) |

|---|---|---|

| Type de content | string ou array |

Doit être un array (liste de blocs de contenu) |

| Retour du thinking | Ne renvoie pas le processus de réflexion détaillé | Renvoie un bloc de contenu de type thinking |

| Transmission du signature | Placé dans provider_specific_fields |

Directement dans le champ signature du bloc thinking |

| Dialogue multi-tours | Transmission en texte pur, pas besoin de s'occuper de l'ordre du thinking | Le message assistant doit commencer par un bloc thinking |

| Méthode d'activation du thinking | Suffixe du nom du modèle ou paramètre | Paramètre thinking: {"type": "adaptive"} |

| prompt caching | Non supporté | Supporté |

| Processus de réflexion visible | Non visible | Visible (summarized thinking) |

Comparaison des formats de requête de l'API du modèle Claude Thinking

Appel au format OpenAI (recommandé pour les scénarios proxy) :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-opus-4-6-thinking", # Alias de la plateforme proxy

messages=[

{"role": "user", "content": "Analysez les perspectives commerciales de l'informatique quantique"}

],

max_tokens=16000

)

print(response.choices[0].message.content)

Voir le code d’appel au format natif Anthropic

import anthropic

client = anthropic.Anthropic(api_key="VOTRE_CLÉ_API")

response = client.messages.create(

model="claude-opus-4-6", # Nom officiel du modèle, sans -thinking

max_tokens=16000,

thinking={

"type": "adaptive" # Activation du thinking via paramètre

},

messages=[

{"role": "user", "content": "Analysez les perspectives commerciales de l'informatique quantique"}

]

)

# La réponse content est une liste de blocs, contenant des blocs thinking et text

for block in response.content:

if block.type == "thinking":

print(f"[Processus de réflexion] {block.thinking[:100]}...")

elif block.type == "text":

print(f"[Réponse] {block.text}")

Différences clés :

- Le nom du modèle est

claude-opus-4-6(sans le suffixe-thinking) - Le thinking est activé via le paramètre

thinking={"type": "adaptive"} - Le content de la réponse est une liste de blocs de contenu, pas une chaîne

- Dans un dialogue multi-tours, la liste complète du content (incluant les blocs thinking) doit être retransmise

🎯 Recommandation d'appel : Si vous appelez le modèle Claude Thinking via une plateforme proxy, privilégiez

/v1/chat/completions(format OpenAI), c'est le plus compatible.

L'endpoint compatible OpenAI de la plateforme APIYI apiyi.com est déjà adapté au format du modèle Thinking, il gère automatiquement la conversion des blocs thinking.

Pourquoi le format OpenAI fonctionne avec l'API du modèle Claude Thinking

C'est la partie la plus contre-intuitive : utiliser le format "non natif" d'OpenAI pour appeler le modèle Claude Thinking offre en réalité une meilleure compatibilité. Il y a trois raisons à cela :

Raison n°1 : Tolérance différente du format content

Le format OpenAI permet que content soit une chaîne de caractères simple "bonjour", ou bien un tableau de blocs de contenu [{"type":"text","text":"bonjour"}]. Le format natif d'Anthropic n'accepte que le tableau de blocs de contenu ; le format chaîne de caractères provoque directement une erreur.

Lorsque le code client transmet le content sous forme de chaîne (comportement par défaut du SDK OpenAI), si le proxy utilise le canal au format OpenAI, le format est cohérent entre le client et le point d'accès en amont, sans problème de conversion. Mais s'il passe par le canal au format Anthropic, la chaîne de caractères n'est tout simplement pas acceptée.

Raison n°2 : Suppression automatique des blocs de réflexion (thinking blocks)

Le mode compatible OpenAI supprime automatiquement les blocs de réflexion (thinking blocks) de la réponse de Claude, ne renvoyant que le texte final. Cela signifie :

- Le client ne reçoit pas les blocs de réflexion

- Il n'est pas nécessaire de les renvoyer lors du prochain tour de conversation

- Il n'y a pas de problème d'ordre des blocs de réflexion

Le format natif d'Anthropic, quant à lui, exige de conserver intégralement les blocs de réflexion dans les conversations multi-tours, et le message de l'assistant doit commencer par un bloc de réflexion. Si le proxy ne gère pas correctement cette exigence d'ordre, une erreur se produit.

Raison n°3 : Problème de transmission de thoughtSignature

Comme mentionné précédemment, les blocs de réflexion au format Anthropic contiennent une signature cryptographique (signature) qui doit être renvoyée telle quelle. Le format OpenAI contourne complètement cette étape : il ne renvoie pas de signature et n'en nécessite pas la retransmission.

🎯 Recommandation de choix : Pour appeler le modèle Claude Thinking via un proxy API, privilégiez le format

/v1/chat/completionspour éviter les problèmes de compatibilité du format des blocs de réflexion.

Le point d'accès compatible OpenAI d'APIYI (apiyi.com) est déjà entièrement adapté pour les modèles Thinking.

Comparatif des solutions d'appel à l'API du modèle Claude Thinking

Trois solutions d'appel à l'API du modèle Claude Thinking

| Solution | Point d'accès | Compatibilité du format | thinking visible | Mise en cache des invites |

|---|---|---|---|---|

| Proxy au format OpenAI | /v1/chat/completions |

Meilleure (content en string) | Non visible | Non supporté |

| Connexion directe native Anthropic | /v1/messages |

Nécessite un strict respect du format | Visible | Supporté |

| Proxy au format Anthropic | /v1/messages (proxy) |

Dépend de l'implémentation du proxy | Dépend du proxy | Partiellement supporté |

Différences de noms de modèles pour l'API Claude Thinking

Les différentes plateformes utilisent des conventions de nommage différentes pour les modèles Thinking, ce qui est aussi une source fréquente de confusion :

| Plateforme | Nom du modèle | Méthode d'activation de thinking |

|---|---|---|

| Anthropic officiel | claude-opus-4-6 |

Paramètre thinking: {"type": "adaptive"} |

| Proxy API (ex: APIYI) | claude-opus-4-6-thinking |

Activation implicite par suffixe dans le nom du modèle |

| OpenRouter | anthropic/claude-opus-4.6 |

Activation par paramètre |

| AWS Bedrock | anthropic.claude-opus-4-6-v1 |

Activation par paramètre |

Dans l'API officielle d'Anthropic, le nom de modèle claude-opus-4-6-thinking n'existe pas. Le suffixe -thinking est une convention de nommage des plateformes proxy, permettant aux utilisateurs d'activer directement la fonctionnalité thinking via le nom du modèle, sans avoir à configurer manuellement de paramètre.

Astuce : Si vous utilisez le nom de modèle

claude-opus-4-6-thinkingsur APIYI (apiyi.com), la plateforme ajoute automatiquement le paramètrethinking: {"type": "adaptive"}à la requête. Ainsi, vous obtenez directement la capacité thinking avec le SDK OpenAI, sans modifier votre code.

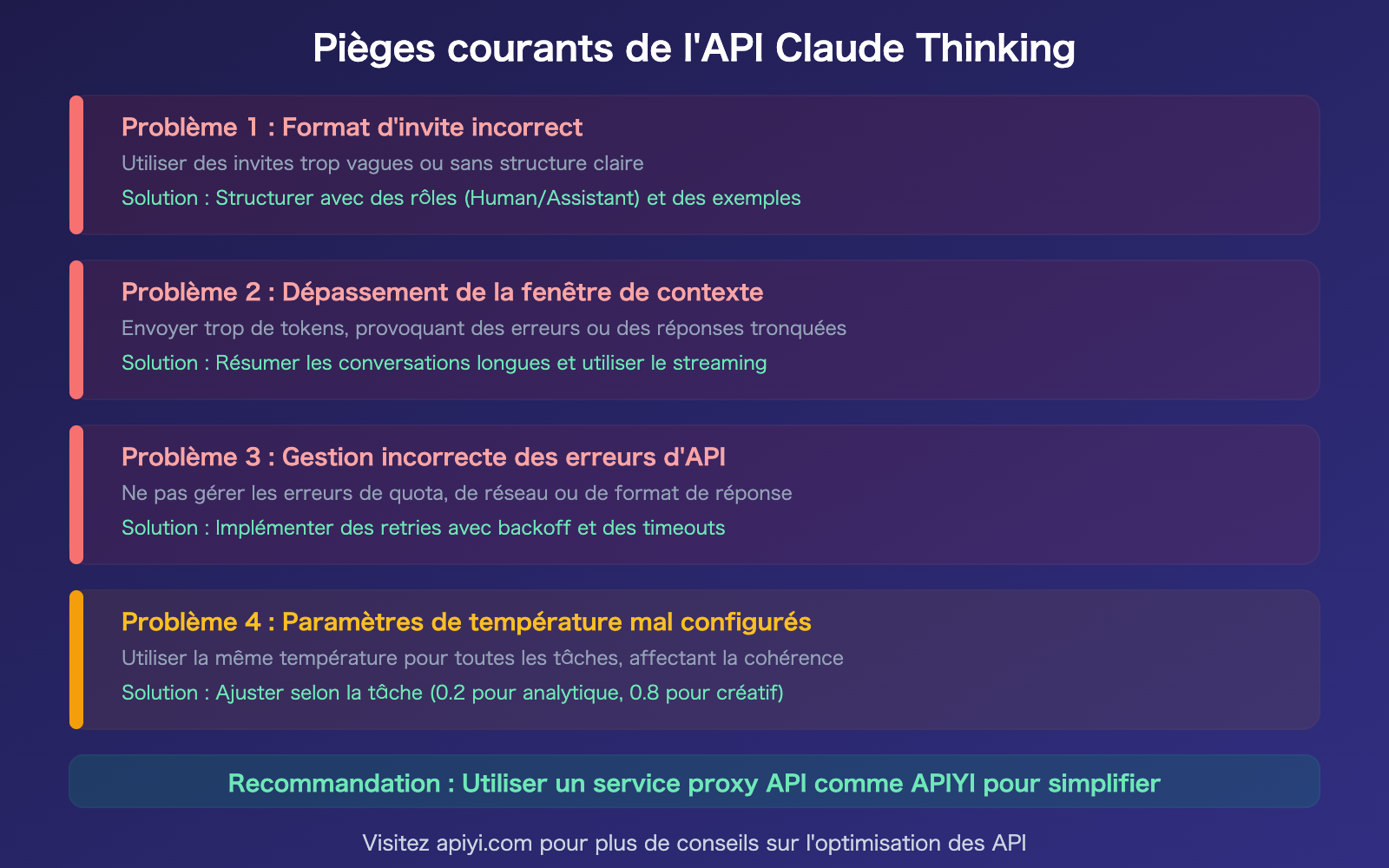

Pièges courants et solutions pour l'API du modèle Claude Thinking

Questions fréquentes

Q1 : Utiliser le format OpenAI pour appeler un modèle Thinking fait-il perdre sa capacité de réflexion ?

Non. Le processus de réflexion (thinking) du modèle se produit côté serveur Anthropic et est indépendant du format de l'endpoint d'appel. Lorsque vous utilisez le format OpenAI, le modèle effectue toujours un raisonnement complet. Seul le résumé textuel du processus de pensée n'est pas renvoyé au client. La qualité et la profondeur de la réponse finale sont identiques : vous obtenez une "réponse mûrement réfléchie", mais sans le "journal textuel du processus de réflexion".

Q2 : Dans quels scénarios faut-il absolument utiliser le format natif /v1/messages ?

Deux scénarios nécessitent le format natif : 1) Vous avez besoin de voir le processus de réflexion du modèle (summarized thinking), pour du débogage, de l'éducation ou pour montrer une chaîne de raisonnement ; 2) Vous avez besoin d'utiliser la mise en cache des invites (prompt caching) pour réduire les coûts — cette fonctionnalité n'est disponible que sur l'endpoint /v1/messages. Si vous n'avez aucun de ces besoins, le format OpenAI est plus simple. L'appel via l'endpoint compatible OpenAI d'APIYI (apiyi.com) est la solution la plus simple.

Q3 : Comment résoudre les problèmes de compatibilité lorsque le canal dans le backend APIYI est configuré pour /v1/messages ?

Deux solutions : 1) Basculez le canal vers le type OpenAI (/v1/chat/completions), ce qui évite fondamentalement les problèmes de conversion de format ; 2) Si vous devez absolument utiliser le canal /v1/messages, assurez-vous que la couche proxy convertit correctement le contenu string du client en format list, et qu'elle gère correctement le tri des blocs de réflexion (thinking blocks) et la transmission des signatures dans les conversations multi-tours. La solution 1 est plus simple et fiable.

Q4 : Quelle est la différence entre adaptive thinking et l’ancien extended thinking ?

Opus 4.6 recommande d'utiliser thinking: {"type": "adaptive"} (réflexion adaptative), où le modèle décide automatiquement s'il doit réfléchir et à quelle profondeur en fonction de la complexité du problème. L'ancienne version thinking: {"type": "enabled", "budget_tokens": N} est dépréciée sur Opus 4.6 et Sonnet 4.6. La nouvelle version ajoute également le paramètre effort (low/medium/high/max) pour contrôler la profondeur de la réflexion, avec high comme valeur par défaut.

Résumé

Points clés concernant les problèmes de compatibilité de l'API des modèles Claude Thinking :

- La cause principale des erreurs est l'incompatibilité du format content : L'API native d'Anthropic exige strictement que le contenu soit une liste (list), tandis que le format OpenAI autorise une chaîne de caractères — si un canal proxy utilise

/v1/messagesmais que le client envoie une chaîne, l'erreurInput should be a valid listse produit. - Le format OpenAI offre une meilleure compatibilité : Il supprime automatiquement les blocs de réflexion, ne nécessite pas de renvoyer de signature, et le contenu peut être une chaîne de caractères — c'est le choix à privilégier dans les scénarios proxy.

- Le suffixe -thinking est une convention des services proxy, pas un nom de modèle officiel : Le nom de modèle officiel est

claude-opus-4-6, la réflexion est activée via des paramètres.

Pour appeler les modèles Claude Thinking via un service proxy API, la solution la plus simple est d'utiliser uniformément le format compatible OpenAI.

Nous recommandons d'utiliser APIYI (apiyi.com) pour les appels. La plateforme a optimisé la compatibilité des formats pour les modèles Thinking et propose des crédits gratuits ainsi qu'une interface unifiée pour plusieurs modèles.

📚 Références

-

Documentation Claude API Extended Thinking : Référence API complète du mode de réflexion

- Lien :

platform.claude.com/docs/en/build-with-claude/extended-thinking - Description : Contient des explications détaillées sur le adaptive thinking, le paramètre effort et le format des blocs de contenu.

- Lien :

-

Documentation de compatibilité Claude API OpenAI SDK : Guide officiel pour appeler Claude au format OpenAI

- Lien :

platform.claude.com/docs/en/api/openai-sdk - Description : Inclut la liste des limitations de compatibilité et des fonctionnalités non prises en charge.

- Lien :

-

Référence des codes d'erreur Claude API : Explication de tous les types d'erreurs d'API

- Lien :

platform.claude.com/docs/en/api/errors - Description : Inclut des méthodes de dépannage spécifiques pour l'erreur

invalid_request_error.

- Lien :

-

Centre de documentation APIYI : Appeler les modèles Claude Thinking via l'interface compatible OpenAI

- Lien :

docs.apiyi.com - Description : Adapté au format des modèles Thinking, gère automatiquement la conversion des thinking blocks.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : Bienvenue dans les commentaires pour discuter. Plus de ressources disponibles sur le centre de documentation APIYI docs.apiyi.com.