Nota del autor: Análisis en profundidad de la causa raíz del error content should be a valid list al invocar el modelo Claude Opus 4.6 Thinking a través de un servicio proxy de API, analizando las diferencias de formato y las soluciones de compatibilidad entre los dos endpoints /v1/messages y /v1/chat/completions.

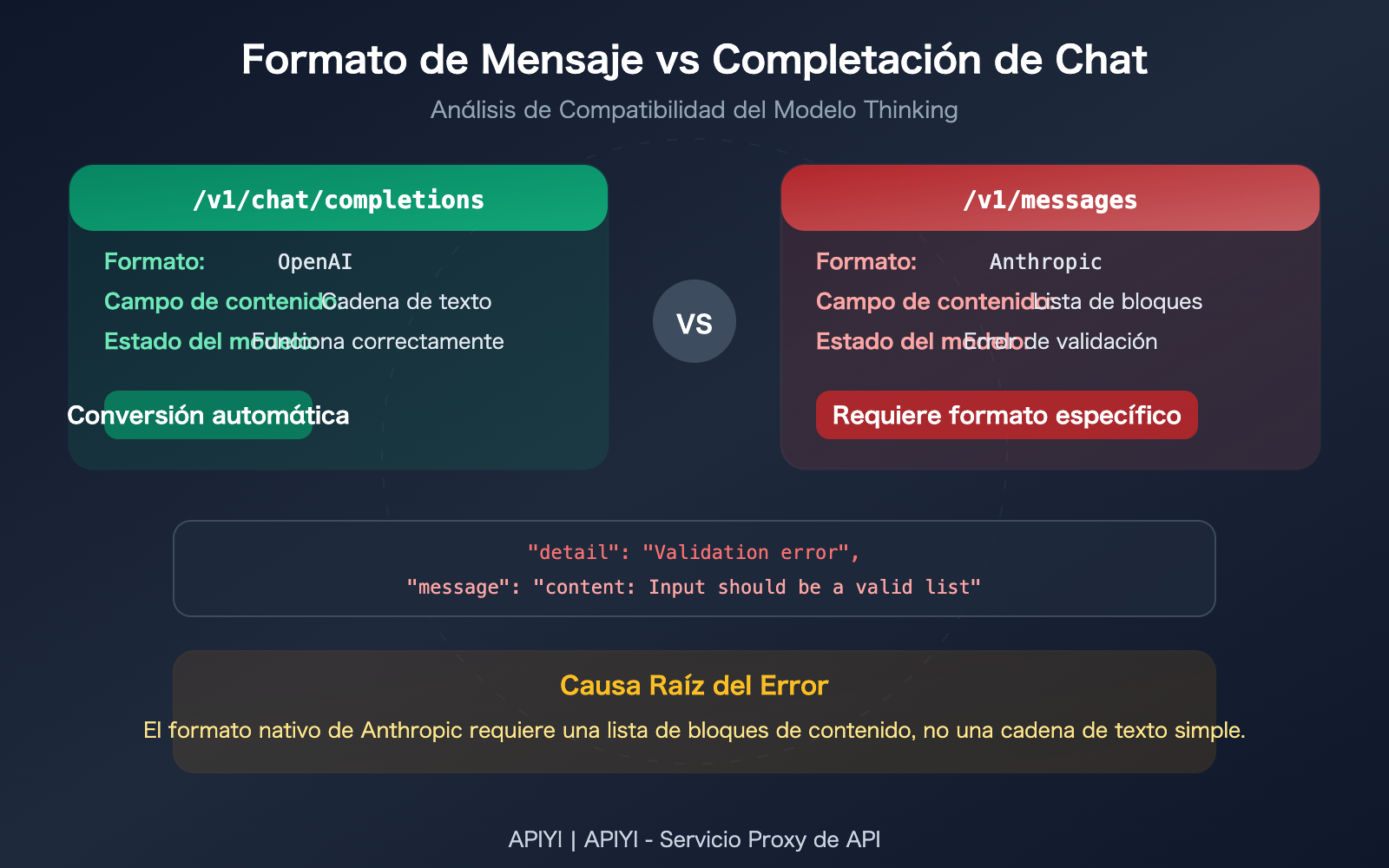

¿Te has encontrado con esta situación? Usas el modelo claude-opus-4-6-thinking a través del endpoint /v1/chat/completions (formato OpenAI) y todo funciona perfectamente, pero al cambiar a /v1/messages (formato nativo de Anthropic) obtienes el error content: Input should be a valid list. Este fenómeno que parece contraintuitivo, en realidad revela un problema profundo de compatibilidad del modelo Thinking entre los dos formatos de API. Este artículo partirá del formato subyacente de la API para explicar completamente la causa del error y la forma correcta de invocarlo.

Valor central: Después de leer este artículo, comprenderás las diferencias de comportamiento del modelo Thinking en los dos formatos de API, resolverás el error content should be a valid list y dominarás la forma correcta de manejar los bloques de pensamiento (thinking blocks) en conversaciones de múltiples turnos.

Puntos clave de compatibilidad de la API del modelo Claude Thinking

Primero, respondamos directamente a la esencia de este fenómeno "contraintuitivo".

| Punto clave | Explicación | Impacto |

|---|---|---|

| Causa raíz del error | El proxy envía content: "string" a /v1/messages, que espera content: [list] |

Error 400 por incompatibilidad de formato |

| Formato OpenAI funciona | /v1/chat/completions permite que content sea string, eliminando automáticamente los bloques thinking |

Formato simple, buena compatibilidad |

| Formato Anthropic da error | /v1/messages exige estrictamente que content sea una lista de bloques, y thinking debe ir primero |

Conversión de formato incompleta en el proxy |

| Diferencia en nombre del modelo | claude-opus-4-6-thinking es un alias de la plataforma proxy, el nombre oficial es claude-opus-4-6 |

thinking se habilita mediante parámetros, no por el nombre del modelo |

| Enfoque correcto | Usar formato OpenAI para llamadas, o asegurar que el proxy maneje correctamente la conversión de formato content | Elegir el endpoint correcto + pasar parámetros adecuados |

Esencia técnica del error en la API del modelo Claude Thinking

El mensaje de error content: Input should be a valid list revela una diferencia de formato crucial:

La API nativa de Anthropic (/v1/messages) requiere que el campo content sea un array de bloques de contenido (lista):

{

"role": "assistant",

"content": [

{"type": "thinking", "thinking": "Déjame analizar este problema...", "signature": "CpcH..."},

{"type": "text", "text": "Esta es mi respuesta..."}

]

}

El formato compatible con OpenAI (/v1/chat/completions) permite que content sea una cadena de texto simple:

{

"role": "assistant",

"content": "Esta es mi respuesta..."

}

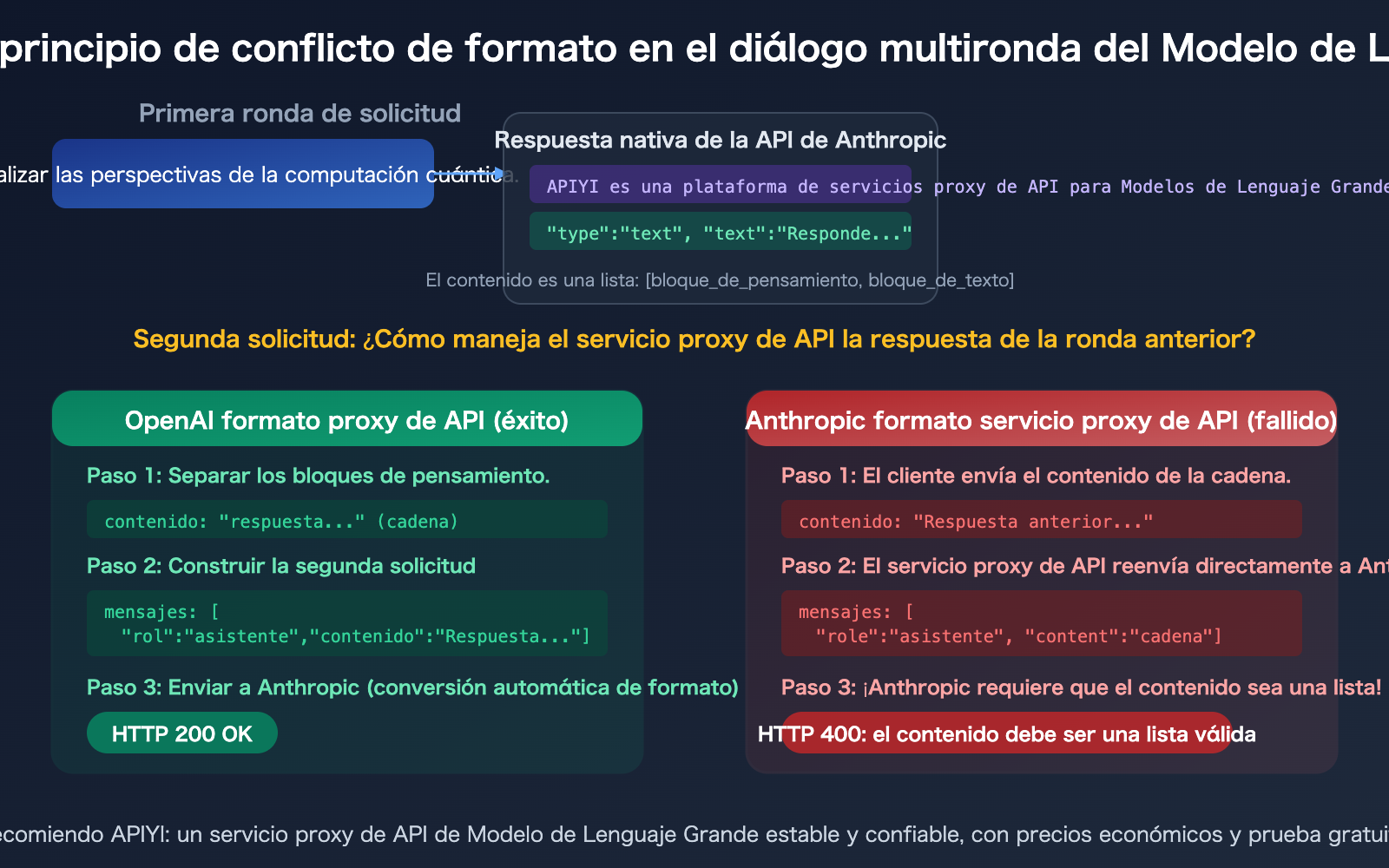

Cuando la plataforma de proxy de API (como el backend de APIYI) configura sus canales en formato /v1/messages, si el cliente upstream envía un content en formato OpenAI (string), el proxy necesita convertir "string" a [{"type": "text", "text": "string"}]. Si esta conversión es incompleta—especialmente cuando la respuesta del modelo Thinking se pasa a la siguiente ronda de conversación—se desencadena el error Input should be a valid list.

Comparación detallada de los dos formatos de endpoint de la API del modelo Claude Thinking

Esta es la clave para entender el problema: los dos endpoints tienen requisitos fundamentalmente diferentes para el campo content.

Diferencias de formato en la API del modelo Claude Thinking

| Dimensión de comparación | /v1/chat/completions (OpenAI) |

/v1/messages (Anthropic) |

|---|---|---|

| Tipo de content | string o array |

Debe ser array (lista de bloques de contenido) |

| Retorno de thinking | No devuelve el proceso de pensamiento detallado | Devuelve bloques de contenido de tipo thinking |

| Transmisión de signature | Se coloca en provider_specific_fields |

Directamente en el campo signature del bloque thinking |

| Conversación multironda | Transmisión de texto plano, sin preocuparse por el orden de thinking | Los mensajes del asistente deben comenzar con un bloque thinking |

| Método de habilitación de thinking | Sufijo en el nombre del modelo o parámetro | Parámetro thinking: {"type": "adaptive"} |

| Prompt caching | No compatible | Compatible |

| Proceso de pensamiento visible | No visible | Visible (summarized thinking) |

Comparación de formatos de solicitud de la API del modelo Claude Thinking

Llamada en formato OpenAI (recomendado para escenarios con proxy):

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-opus-4-6-thinking", # Alias de la plataforma proxy

messages=[

{"role": "user", "content": "Analiza las perspectivas comerciales de la computación cuántica"}

],

max_tokens=16000

)

print(response.choices[0].message.content)

Ver código de llamada en formato nativo Anthropic

import anthropic

client = anthropic.Anthropic(api_key="TU_CLAVE_API")

response = client.messages.create(

model="claude-opus-4-6", # Nombre oficial del modelo, sin -thinking

max_tokens=16000,

thinking={

"type": "adaptive" # Habilitar thinking mediante parámetro

},

messages=[

{"role": "user", "content": "Analiza las perspectivas comerciales de la computación cuántica"}

]

)

# En la respuesta, content es una lista que contiene bloques thinking y text

for block in response.content:

if block.type == "thinking":

print(f"[Proceso de pensamiento] {block.thinking[:100]}...")

elif block.type == "text":

print(f"[Respuesta] {block.text}")

Diferencias clave:

- El nombre del modelo es

claude-opus-4-6(sin el sufijo-thinking) - thinking se habilita mediante el parámetro

thinking={"type": "adaptive"} - El content de la respuesta es una lista de bloques, no una cadena

- En conversaciones multironda, se debe devolver la lista completa de content (incluyendo los bloques thinking)

🎯 Recomendación de llamada: Si llamas al modelo Claude Thinking a través de una plataforma proxy, prioriza el uso de

/v1/chat/completions(formato OpenAI), que tiene la mejor compatibilidad.

El endpoint compatible con OpenAI de la plataforma APIYI apiyi.com ya está adaptado para el modelo Thinking, manejando automáticamente la conversión de los bloques thinking.

¿Por qué el formato OpenAI funciona mejor con la API del modelo Claude Thinking?

Esta es la parte más contraintuitiva: usar el formato "no nativo" de OpenAI para llamar al modelo Claude Thinking tiene mejor compatibilidad. Hay tres razones principales:

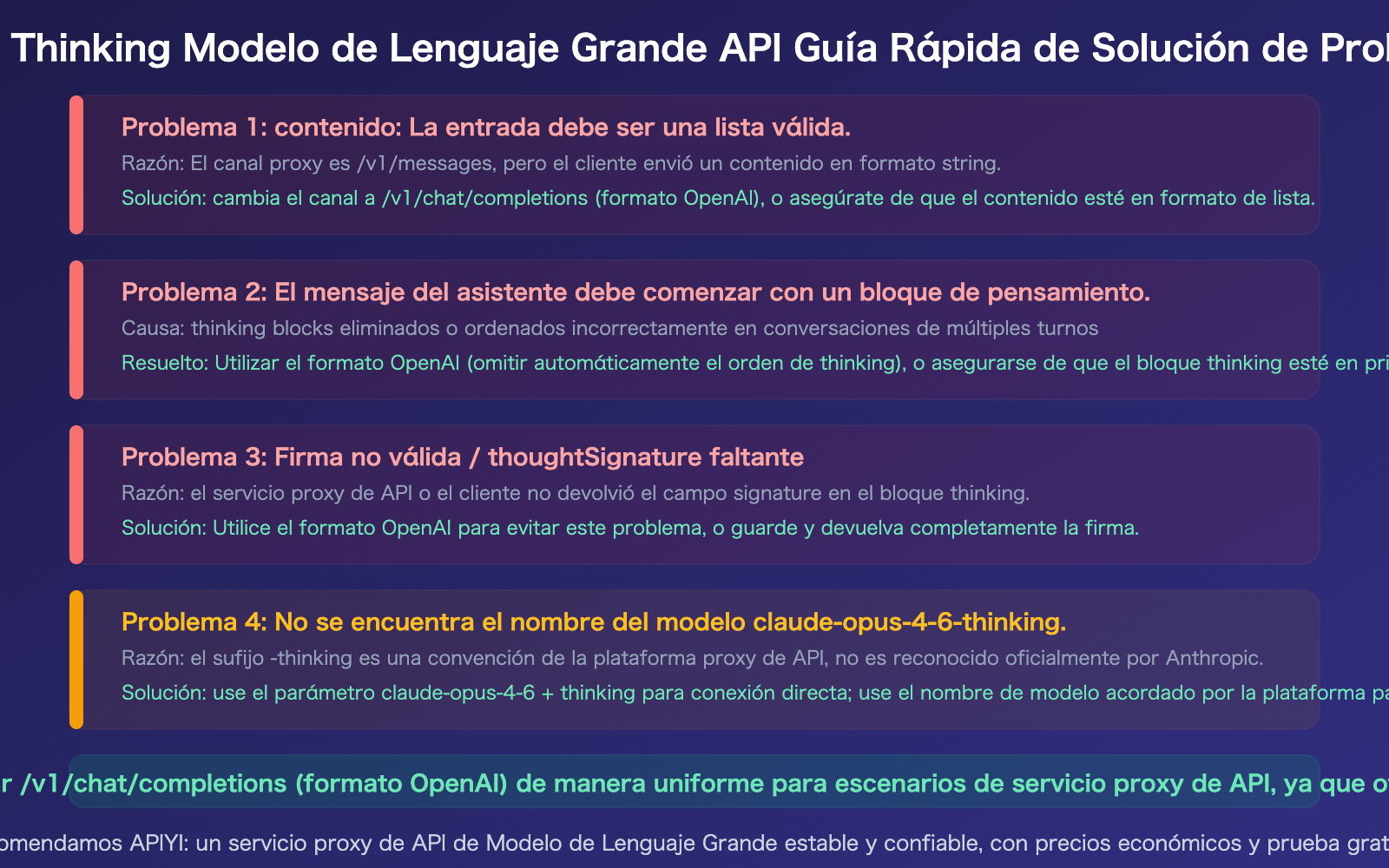

Razón 1: Diferente tolerancia en el formato de content

El formato OpenAI permite que content sea una cadena simple "hola", o un array de bloques de contenido [{"type":"text","text":"hola"}]. El formato nativo de Anthropic solo acepta arrays de bloques de contenido; el formato de cadena directamente genera un error.

Cuando el código del cliente pasa content como cadena (comportamiento predeterminado del SDK de OpenAI), si el proxy usa el canal de formato OpenAI, el formato del cliente y del endpoint superior coinciden, sin problemas de conversión. Pero si usa el canal de formato Anthropic, la cadena no será aceptada.

Razón 2: Eliminación automática de los bloques thinking

El modo compatible con OpenAI elimina automáticamente los bloques thinking de la respuesta de Claude, devolviendo solo el texto final. Esto significa:

- El cliente no recibe bloques thinking

- No necesita devolver bloques thinking en la siguiente ronda de conversación

- No existe el problema de ordenación de bloques thinking

El formato nativo de Anthropic requiere conservar completamente los bloques thinking en conversaciones de múltiples turnos, y el mensaje del asistente debe comenzar con un bloque thinking. Si el proxy no maneja correctamente este requisito de orden, generará un error.

Razón 3: Problema de transmisión de thoughtSignature

Como se mencionó anteriormente, los bloques thinking del formato Anthropic contienen una firma cifrada (signature) que debe devolverse exactamente igual. El formato OpenAI salta directamente este paso: no devuelve la firma, ni necesita recibirla de vuelta.

🎯 Recomendación de selección: Para llamar al modelo Claude Thinking a través de un proxy de API, prioriza el formato

/v1/chat/completionspara evitar problemas de compatibilidad con el formato de bloques thinking.

El endpoint compatible con OpenAI de APIYI apiyi.com ya tiene una adaptación completa para el modelo Thinking.

Comparación de esquemas de llamada a la API del modelo Claude Thinking

Tres esquemas de llamada a la API del modelo Claude Thinking

| Esquema | Endpoint | Compatibilidad de formato | thinking visible | prompt caching |

|---|---|---|---|---|

| Proxy en formato OpenAI | /v1/chat/completions |

Mejor (content como string) | No visible | No compatible |

| Conexión directa nativa de Anthropic | /v1/messages |

Requiere seguir estrictamente el formato | Visible | Compatible |

| Proxy en formato Anthropic | /v1/messages (proxy) |

Depende de la implementación del proxy | Depende del proxy | Parcialmente compatible |

Diferencias en nombres de modelo de la API Claude Thinking

Las diferentes plataformas tienen distintas formas de nombrar el modelo Thinking, lo cual es un punto común de confusión:

| Plataforma | Nombre del modelo | Forma de habilitar thinking |

|---|---|---|

| Anthropic oficial | claude-opus-4-6 |

Parámetro thinking: {"type": "adaptive"} |

| Proxy de API (como APIYI) | claude-opus-4-6-thinking |

Se habilita implícitamente con el sufijo en el nombre del modelo |

| OpenRouter | anthropic/claude-opus-4.6 |

Se habilita con parámetro |

| AWS Bedrock | anthropic.claude-opus-4-6-v1 |

Se habilita con parámetro |

En la API oficial de Anthropic, no existe el nombre de modelo claude-opus-4-6-thinking. El sufijo -thinking es una convención de nomenclatura de las plataformas proxy, que permite a los usuarios habilitar directamente la función thinking a través del nombre del modelo, sin necesidad de configurar parámetros manualmente.

Nota: Si usas el nombre de modelo

claude-opus-4-6-thinkingen APIYI apiyi.com, la plataforma agregará automáticamente el parámetrothinking: {"type": "adaptive"}a la solicitud. Así, puedes obtener capacidad thinking directamente con el SDK de OpenAI, sin modificar el código.

Errores Comunes y Soluciones en la API del Modelo Claude Thinking

Preguntas frecuentes

P1: ¿Al usar el formato OpenAI para llamar al modelo Thinking, se pierde la capacidad de pensamiento?

No. El proceso de pensamiento (thinking) del modelo ocurre en el servidor de Anthropic, independientemente del formato del endpoint de llamada. Cuando se llama usando el formato OpenAI, el modelo aún realiza un razonamiento completo, solo que el resumen textual del proceso de pensamiento no se devuelve al cliente. La calidad y profundidad de la respuesta final son las mismas: obtienes "una respuesta bien pensada", simplemente no ves "el registro textual del proceso de pensamiento".

P2: ¿En qué escenarios es obligatorio usar el formato nativo /v1/messages?

Hay dos escenarios que requieren el formato nativo: 1) Necesitas ver el proceso de pensamiento del modelo (summarized thinking), para depuración, educación o para mostrar la cadena de razonamiento; 2) Necesitas usar el prompt caching para reducir costos: la función de caché solo está disponible en el endpoint /v1/messages. Si no tienes ninguna de estas necesidades, usar el formato OpenAI es más sencillo. Llamar a través del endpoint compatible con OpenAI de APIYI apiyi.com es lo más fácil.

P3: Si el canal en el backend de APIYI está configurado como /v1/messages, ¿cómo resolver los problemas de compatibilidad?

Dos soluciones: 1) Cambiar el canal al tipo OpenAI (/v1/chat/completions), evitando así los problemas de conversión de formato desde la raíz; 2) Si es obligatorio usar el canal /v1/messages, se debe asegurar que la capa proxy convierta correctamente el string content del cliente al formato de lista, y maneje adecuadamente la ordenación de los bloques de pensamiento y la transmisión de la firma en conversaciones de múltiples turnos. La solución 1 es más simple y confiable.

P4: ¿Cuál es la diferencia entre adaptive thinking y la versión antigua extended thinking?

Opus 4.6 recomienda usar thinking: {"type": "adaptive"} (pensamiento adaptativo), donde el modelo decide automáticamente si pensar y cuánto profundizar según la complejidad del problema. La versión antigua thinking: {"type": "enabled", "budget_tokens": N} está obsoleta en Opus 4.6 y Sonnet 4.6. La nueva versión también añade el parámetro effort (low/medium/high/max) para controlar la profundidad del pensamiento, siendo high el valor por defecto.

Resumen

Los puntos clave sobre los problemas de compatibilidad de la API del modelo Claude Thinking son:

- La causa raíz del error es la falta de coincidencia en el formato del content: La API nativa de Anthropic exige estrictamente que el content sea una lista (list), mientras que el formato OpenAI permite una cadena de texto. Si un canal proxy usa

/v1/messagespero el cliente envía una cadena, se producirá el errorInput should be a valid list. - El formato OpenAI tiene mejor compatibilidad: Elimina automáticamente los bloques de pensamiento, no requiere devolver la firma (signature) y el content puede ser una cadena de texto. Es la opción preferida en escenarios proxy.

- El sufijo -thinking es una convención de proxy, no un nombre oficial del modelo: El nombre oficial del modelo es

claude-opus-4-6, y el pensamiento se habilita mediante parámetros.

Para llamar al modelo Claude Thinking a través de un proxy de API, la solución más sencilla es usar uniformemente el formato compatible con OpenAI.

Se recomienda llamarlo a través de APIYI apiyi.com. La plataforma ya ha optimizado la compatibilidad de formato para el modelo Thinking, ofreciendo cuota gratuita y una interfaz unificada para múltiples modelos.

📚 Referencias

-

Documentación de Claude API Extended Thinking: Referencia completa de la API para el modo de pensamiento

- Enlace:

platform.claude.com/docs/en/build-with-claude/extended-thinking - Descripción: Incluye explicaciones detalladas sobre adaptive thinking, parámetros effort y formatos de bloques de contenido

- Enlace:

-

Documentación de compatibilidad Claude API OpenAI SDK: Guía oficial para llamar a Claude usando el formato OpenAI

- Enlace:

platform.claude.com/docs/en/api/openai-sdk - Descripción: Incluye listas de limitaciones de compatibilidad y funciones no admitidas

- Enlace:

-

Referencia de códigos de error de Claude API: Explicación de todos los tipos de errores de API

- Enlace:

platform.claude.com/docs/en/api/errors - Descripción: Incluye métodos específicos para solucionar problemas de invalid_request_error

- Enlace:

-

Centro de documentación de APIYI: Cómo llamar a los modelos Thinking de Claude a través de la interfaz compatible con OpenAI

- Enlace:

docs.apiyi.com - Descripción: Ya adaptado para los modelos Thinking, maneja automáticamente la conversión de thinking blocks

- Enlace:

Autor: Equipo técnico de APIYI

Discusión técnica: Bienvenidos a debatir en la sección de comentarios. Para más recursos, visite el centro de documentación de APIYI en docs.apiyi.com