Le 21 avril 2026, Google a lancé deux agents de recherche autonomes de nouvelle génération dans l'aperçu public de l'API Gemini : Deep Research et Deep Research Max. Tous deux sont basés sur le modèle Gemini 3.1 Pro, sorti en février dernier. Il s'agit d'une étape clé pour Google, qui fait passer la "recherche autonome à long terme" des produits grand public vers une API destinée aux développeurs. Le modèle Deep Research Max a atteint un score de 93,3 % sur DeepSearchQA et a hérité des capacités de raisonnement fondamentales du Gemini 3.1 Pro, avec 77,1 % sur ARC-AGI-2, soit plus du double des performances du Gemini 3 Pro.

Plus important encore, cette génération de Deep Research introduit trois nouvelles fonctionnalités de niveau ingénierie : l'accès à des sources de données privées via le protocole MCP (Model Context Protocol), la sortie visuelle native (tableaux HTML / graphiques SVG / infographies), et la fusion inter-sources entre le Web et les données privées. Cela signifie que, pour la première fois, les développeurs peuvent, via un seul appel API, permettre à un agent de rechercher simultanément sur le Web public, sur l'intranet d'une entreprise et dans des bases de données professionnelles tierces, tout en générant directement des rapports visuels intégrables dans des tableaux de bord.

Cet article s'appuie sur les publications officielles de Google et la documentation de l'API Gemini pour clarifier les 4 percées majeures de Deep Research Max, les différences avec la version standard, la signification réelle du score de 77,1 % sur ARC-AGI-2, et la manière dont les développeurs peuvent accéder à ces capacités.

I. Qu'est-ce que Deep Research Max : un agent de recherche autonome propulsé par Gemini 3.1 Pro

Deep Research n'est pas un concept nouveau ; Google l'a ouvert aux consommateurs dans l'application Gemini dès fin 2024, permettant à l'IA d'effectuer des recherches sur le Web et de rédiger un rapport avec citations. Cependant, la version grand public était limitée, l'API n'était pas ouverte et il était impossible d'y connecter des données privées, ce qui limitait son intérêt pour des applications professionnelles.

Cette fois, Deep Research / Deep Research Max représente une réécriture au niveau de l'architecture. Google le définit comme un "agent de recherche autonome de nouvelle génération" capable de planifier, d'exécuter et de synthétiser de manière autonome des tâches de recherche complexes, en utilisant diverses sources d'outils (Web, serveurs MCP, contexte d'URL, exécution de code, recherche de fichiers) pour produire un rapport structuré et sourcé. Les deux versions ont été lancées simultanément pour répondre à des besoins d'ingénierie différents.

| Dimension de comparaison | Deep Research (Standard) | Deep Research Max | Cas d'utilisation |

|---|---|---|---|

| Objectif d'optimisation | Vitesse et latence | Exhaustivité et profondeur | – |

| Durée de raisonnement | Courte (secondes à minutes) | Longue (minutes à heures) | – |

| Calcul au moment du test | Standard | Étendu | – |

| Itérations multi-tours | 1-2 tours | Raisonnement profond multi-tours | – |

| Mode d'appel | Synchrone / Interaction en temps réel | Asynchrone / Tâche de fond | – |

| Coût | Faible | Élevé | – |

| Cas d'usage typiques | Assistant de recherche conversationnel, support client | Rapports d'investissement, analyse sectorielle, due diligence | – |

Dans son article de blog officiel, Google précise : Deep Research Max est conçu pour les flux de travail qui acceptent une attente asynchrone et recherchent une qualité de synthèse maximale. Si vous effectuez de la due diligence interne, de la recherche sectorielle approfondie ou de la génération automatique de longs rapports, Max est le choix le plus approprié. Pour un assistant IA orienté vers l'interaction en temps réel avec l'utilisateur final, la faible latence de la version standard est plus adaptée.

💡 Conseil d'intégration : Deep Research et sa version Max sont accessibles via les niveaux payants de l'API Gemini. Les développeurs peuvent utiliser directement les interfaces de la série Gemini 3.1 Pro via le service proxy API APIYI (apiyi.com). La plateforme a unifié ces services sous un protocole compatible avec OpenAI, ce qui permet de contourner les obstacles liés aux réseaux transfrontaliers et à l'enregistrement de comptes.

II. Les 4 percées majeures de Deep Research Max

Ce qui retient le plus l'attention dans cette version, ce sont les quatre sauts technologiques majeurs. Ensemble, ils confèrent à Deep Research Max le statut de véritable "agent de recherche autonome de niveau entreprise".

2.1 Première percée : support natif du protocole MCP pour accéder à n'importe quelle donnée tierce

Le protocole MCP (Model Context Protocol), promu par Anthropic, vise à permettre aux agents IA d'accéder à des outils et des sources de données externes de manière unifiée. Deep Research Max est le premier produit de l'écosystème Google à intégrer le MCP comme citoyen de première classe. Les développeurs n'ont qu'à encapsuler leurs données privées ou tierces dans un serveur MCP pour que l'agent puisse les interroger comme s'il s'agissait d'outils natifs.

Lors de la conférence, Google a dévoilé ses premiers partenaires MCP : FactSet, S&P Global et PitchBook, trois géants de la donnée financière, collaborent avec Google pour concevoir des serveurs MCP. Cela permet aux clients communs d'intégrer ces flux de données financières spécialisées directement dans les flux de travail de Deep Research. Pour les secteurs de la finance, du droit ou de la santé, cela signifie enfin une méthode d'intégration standardisée, sans avoir à réécrire des couches d'adaptation pour chaque source de données.

2.2 Deuxième percée : sortie visuelle native, adieu aux rapports purement textuels

Auparavant, les grands modèles de langage ne renvoyaient essentiellement que du texte Markdown ; pour ajouter des graphiques, il fallait invoquer une API de dessin ou un interpréteur de code. Deep Research Max génère désormais, au cours même du raisonnement, des tableaux HTML, des graphiques SVG et des infographies. Ces éléments visuels font partie intégrante du flux de raisonnement de l'agent, et non plus comme des ajouts a posteriori.

Les formats de sortie incluent : des tableaux HTML structurés (intégrables directement dans une page web), des graphiques SVG vectoriels (camemberts, histogrammes, chronologies, etc.) et des infographies complètes (prêtes à être envoyées par e-mail ou sur Slack). Si le projet intègre un modèle d'image de haute qualité comme Nano Banana, Deep Research peut même générer des visuels plus complexes. Cette évolution transforme la sortie de Deep Research : on passe d'un "long Markdown avec références" à un "rapport multimodal prêt à être intégré dans un tableau de bord".

2.3 Troisième percée : fusion inter-sources entre Web et données privées

Auparavant, Deep Research ne pouvait effectuer que des recherches sur le Web public, laissant sans solution le problème majeur des entreprises : intégrer des informations privées (documents SaaS, données CRM, rapports ERP) dans leurs recherches. La nouvelle version permet, en un seul appel API, d'activer simultanément Google Search, des serveurs MCP distants, le contexte d'URL, l'exécution de code et la recherche de fichiers, l'agent décidant lui-même quel outil utiliser.

Plus important encore, les développeurs peuvent désactiver totalement l'accès au Web pour que l'agent n'effectue ses recherches que dans les sources de données privées spécifiées. Pour les secteurs sensibles (finance, droit, santé), cet interrupteur est une véritable clé de voûte : il garantit que l'agent ne divulguera pas accidentellement des informations internes lors d'une requête sur le Web public. C'est un détail de conformité crucial, trop souvent négligé dans le déploiement de l'IA en entreprise.

2.4 Quatrième percée : saut de performance – amélioration sur trois benchmarks clés

Les benchmarks officiels publiés par Google montrent une amélioration significative des performances de Deep Research Max par rapport à la version de décembre 2024 :

| Benchmark | Version déc. 2024 | Deep Research Max (04/2026) | Amélioration |

|---|---|---|---|

| DeepSearchQA | 66,1 % | 93,3 % | +27,2 points |

| Humanity's Last Exam | 46,4 % | 54,6 % | +8,2 points |

| ARC-AGI-2 (modèle de base) | 31,1 % (Gemini 3 Pro) | 77,1 % (Gemini 3.1 Pro) | Plus de 2× |

Le benchmark DeepSearchQA, qui évalue spécifiquement la recherche Web autonome et le raisonnement complexe, affiche un score de 93,3 %, proche du plafond théorique. Cela signifie que sur la tâche fondamentale consistant à "rechercher des informations de manière autonome et rédiger une réponse précise", Deep Research Max ne laisse pratiquement plus aucune chance à la concurrence.

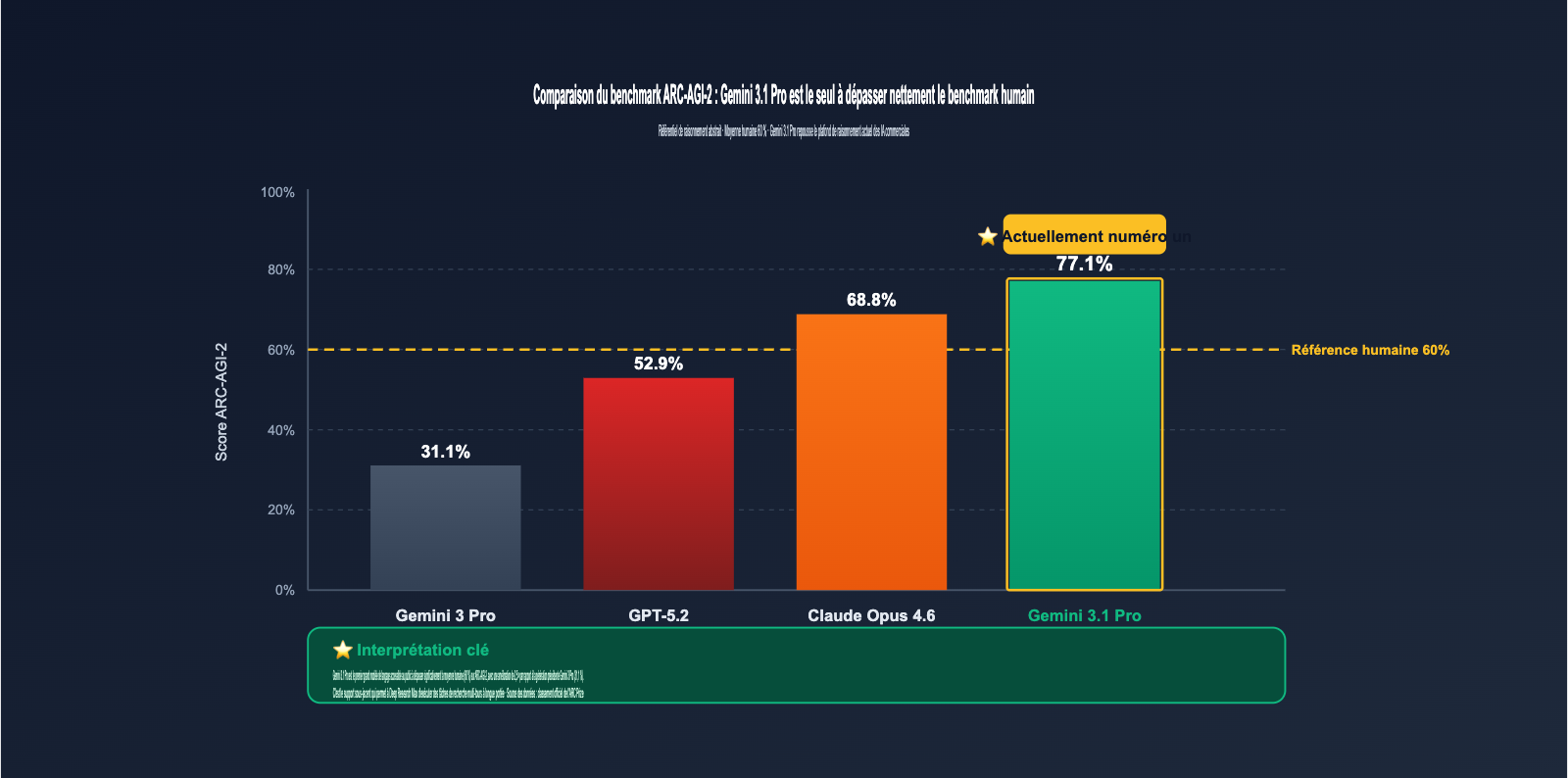

III. La véritable signification du score de 77,1 % à ARC-AGI-2

De nombreux développeurs voient le chiffre "77,1 %" et pensent instinctivement que c'est "pas mal". Mais pour comprendre la réelle valeur de ce score, il faut saisir la difficulté du benchmark ARC-AGI-2.

3.1 Qu'est-ce que l'ARC-AGI-2 ?

L'ARC-AGI-2 est maintenu par l'organisation ARC Prize. Il est spécifiquement conçu pour tester la capacité de raisonnement abstrait d'une IA sur des modèles logiques inédits, jamais rencontrés dans les données d'entraînement. Le test présente quelques exemples (paires entrée → sortie) pour que le modèle déduise des règles implicites, puis il applique ces règles pour résoudre une nouvelle entrée inconnue. La référence humaine est de 60 %, donc un score de 77,1 % dépasse déjà la moyenne humaine.

La difficulté fondamentale de ce benchmark est la suivante : le modèle ne peut pas obtenir un bon score en mémorisant. Chaque modèle est généré de toutes pièces et n'a aucun lien avec le corpus d'entraînement. C'est pourquoi l'ARC-AGI-2 est considéré par l'industrie comme l'un des étalons-or pour mesurer la "véritable capacité de raisonnement abstrait".

3.2 Comparaison horizontale : Gemini 3.1 Pro est le plus puissant à ce jour

| Modèle | Score ARC-AGI-2 | vs Référence humaine (60%) | Remarques |

|---|---|---|---|

| Gemini 3.1 Pro | 77,1 % | +17,1 pp | Premier modèle ouvert dépassant nettement l'humain |

| Claude Opus 4.6 | 68,8 % | +8,8 pp | Modèle phare d'Anthropic |

| Référence humaine | 60,0 % | – | Niveau moyen |

| GPT-5.2 | 52,9 % | -7,1 pp | OpenAI |

| Gemini 3 Pro | 31,1 % | -28,9 pp | Génération précédente |

On peut constater que Gemini 3.1 Pro surpasse non seulement tous les grands modèles commerciaux, mais qu'il est le seul modèle ouvert et accessible à dépasser significativement la référence humaine. C'est la première fois qu'une IA commerciale creuse un tel écart avec l'humain sur un benchmark strict de "raisonnement logique inédit". Deep Research Max hérite directement de cette capacité de raisonnement — c'est le socle qui lui permet d'exécuter des tâches de recherche complexes sur de longues durées et des itérations multiples.

🎯 Conseil d'utilisation : Si votre produit est orienté vers des scénarios de raisonnement intensif tels que la recherche, le conseil, l'analyse d'investissement ou l'analyse juridique, la combinaison Gemini 3.1 Pro + Deep Research Max devrait être immédiatement intégrée à votre évaluation technique. Vous pouvez y accéder rapidement pour des tests via la plateforme APIYI (apiyi.com), qui prend en charge l'invocation compatible OpenAI pour de nombreux modèles phares, dont Gemini 3.1 Pro.

IV. Prise en main rapide de l'API Deep Research Max

Maintenant que la théorie est posée, voici le code le plus minimaliste pour lancer vos premières requêtes. Deep Research Max utilise l'interface standard de l'API Gemini et est disponible en préversion pour les niveaux payants.

4.1 Appel de base : Lancer une recherche web via un Agent

from google import genai

from google.genai import types

# Connexion via le point de terminaison unifié APIYI pour éviter les problèmes de réseau transfrontalier

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analysez le paysage mondial des modèles d'embedding au premier semestre 2026, listez les 5 principaux fournisseurs et leurs avantages différenciateurs",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Activation de Google Search

thinking_config=types.ThinkingConfig(thinking_level="max") # Budget de réflexion niveau Max

)

)

print(response.text) # Affiche le rapport de recherche complet (incluant tableaux HTML natifs / graphiques SVG)

Ce code effectue trois actions : sélection du modèle Deep Research Max, activation de l'outil Google Search et configuration du niveau de réflexion maximal. L'Agent planifiera lui-même le parcours de recherche, effectuera des itérations d'analyse et produira finalement un rapport complet avec citations et visualisations.

4.2 Appel avancé : Connexion à un serveur MCP pour des recherches sur données privées

Si vous souhaitez utiliser Deep Research Max sur des données internes à votre entreprise (par exemple CRM, wiki interne), vous devez encapsuler les sources de données dans un serveur MCP, puis les déclarer lors de l'appel :

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analysez les types de clients ayant le taux de désabonnement le plus élevé dans le pipeline de vente du T1",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

Notez qu'ici google_search n'est pas activé, ce qui signifie que l'Agent effectue ses recherches exclusivement au sein de vos données privées, sans envoyer de requêtes externes à Google. C'est une capacité cruciale pour les scénarios de conformité en entreprise.

4.3 Basculer entre la version Standard et la version Max

Si votre scénario concerne des conversations en temps réel pour le grand public, où la vitesse prime sur la profondeur, remplacez simplement le nom du modèle par deep-research-preview-04-2026. Les interfaces sont parfaitement compatibles, la différence réside uniquement dans le budget de calcul interne et le nombre d'itérations.

💡 Conseil pour un essai rapide : Lors de votre première utilisation, nous vous recommandons de tester quelques démos avec la version standard de Deep Research pour vous familiariser avec le style de réponse de l'Agent, puis de passer à la version Max pour vos tâches métier réelles. Nous suggérons d'utiliser la plateforme APIYI apiyi.com pour une connexion directe ; elle prend en charge l'invocation du modèle compatible OpenAI pour Gemini 3.1 Pro, Deep Research et Deep Research Max, facilitant ainsi les tests comparatifs.

V. Analyse de l'impact de Deep Research Max : quels flux de travail seront remodelés ?

La sortie de ce nouvel outil n'est qu'un début ; sa véritable valeur réside dans la transformation des flux de travail existants. D'après les documents de lancement et les premiers retours de la communauté, quatre domaines seront particulièrement impactés.

5.1 Recherche en investissement et analyse sectorielle

C'est le scénario explicitement mis en avant par Google lors de la conférence. Trois fournisseurs de données financières — FactSet, S&P Global et PitchBook — ont collaboré pour créer des serveurs MCP. L'objectif est de permettre aux analystes "buy-side" d'interroger simultanément des rapports financiers, des études sectorielles et des bases de données de fusions-acquisitions via une instruction en langage naturel, générant automatiquement des rapports visuels. Un premier jet qui prenait autrefois 2 jours pourrait désormais être prêt en 30 minutes. Il ne s'agit pas de remplacer l'analyste, mais de le libérer des tâches mécaniques de recherche documentaire.

5.2 Due diligence et contrôle de conformité en entreprise

Le principal défi pour les équipes juridiques et de conformité lors d'une due diligence est de "devoir consulter à la fois des informations publiques et des archives internes". Le mode "données privées uniquement" de Deep Research Max permet aux avocats de confier en toute sécurité les données clients à l'Agent pour analyse, sans craindre qu'elles ne soient indexées par des moteurs de recherche. Grâce à la sortie visuelle native, les rapports finaux peuvent être intégrés directement dans Notion ou Confluence.

5.3 Synthèses académiques et recherche documentaire

Pour les chercheurs, l'étape la plus chronophage dans la rédaction d'une revue de littérature est de digérer rapidement plus de 200 documents pour en extraire un cadre argumentatif. Le raisonnement approfondi multi-étapes de Deep Research Max permet de lire des dizaines de PDF en un seul appel et de générer une structure détaillée. Avec une fenêtre de contexte de 1M de tokens, un seul appel suffit à assimiler les publications essentielles d'un domaine de recherche complet.

5.4 Mise à niveau des assistants IA dans les produits SaaS

De nombreux produits SaaS intègrent déjà des assistants IA, mais la plupart se contentent d'un "GPT-4 + RAG" basique. La version standard de Deep Research (à faible latence) offre à ces produits une voie de montée en gamme : transformer le Copilot en un véritable Agent autonome capable d'agréger des données web, des données produit et des données privées pour répondre aux questions, plutôt que de simplement chercher des mots-clés dans des documents.

VI. Comparaison de Deep Research Max avec les produits similaires

Analysons le positionnement de Deep Research Max dans l'écosystème actuel. Les produits de "recherche / raisonnement approfondi" se divisent principalement en trois catégories.

| Produit | Fabricant | Recherche autonome | Support MCP | Visualisation native | Données privées | Note globale |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ Approfondi multi-tours | ✅ Citoyen de 1er rang | ✅ HTML/SVG natif | ✅ Mode Web off | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ Multi-tours | Partiel | Partiel | Partiel | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCP natif | ❌ Principalement texte | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ Principalement Web | ❌ | Partiel | ❌ | ⭐⭐⭐ |

| RAG + Agent auto-hébergé | Divers | Selon l'implémentation | Selon l'implémentation | À développer | ✅ | ⭐⭐ |

Comme on peut le constater, Deep Research Max excelle sur 4 dimensions clés : raisonnement approfondi multi-tours + support MCP natif + visualisation native + fusion de données privées multi-sources. Il s'agit actuellement de la solution d'Agent de recherche la plus aboutie sur le plan technique parmi les produits commerciaux.

📌 Conseil de sélection : Si votre application exige un raisonnement approfondi, une conformité stricte des données privées et des sorties visuelles, Deep Research Max est la solution optimale. Si vous n'avez besoin que d'un assistant de recherche Web léger, Perplexity ou la version standard de Deep Research suffiront. Vous pouvez utiliser APIYI (apiyi.com) pour accéder à ces modèles de manière centralisée, évitant ainsi de configurer séparément l'authentification et les interfaces de chaque fournisseur.

VII. FAQ sur Deep Research Max

Q1 : Quelle est la différence entre Deep Research Max et Gemini 3.1 Pro classique ?

Gemini 3.1 Pro est le modèle de base qui fournit la puissance de raisonnement. Deep Research Max est un Agent de recherche autonome construit sur 3.1 Pro, intégrant des capacités d'Agent telles que l'appel à plusieurs outils, l'itération multi-tours et la visualisation native. En résumé, 3.1 Pro est le "cerveau", tandis que Deep Research Max est le "chercheur équipé de mains, de pieds et d'outils".

Q2 : Comment les développeurs peuvent-ils invoquer Deep Research Max ?

Deep Research Max est une fonctionnalité payante de l'API Gemini. L'accès direct peut nécessiter de gérer des contraintes réseau et de paiement internationales. Le moyen le plus simple est de passer par une plateforme de service proxy API comme APIYI (apiyi.com), qui permet de payer en monnaie locale, offre une compatibilité totale avec les interfaces officielles et permet d'accéder à une large gamme de modèles, dont la série Gemini 3.1 Pro, en un seul endroit.

Q3 : Combien Deep Research Max coûte-t-il de plus que la version standard ?

Google n'a pas communiqué de multiplicateur précis, mais au vu de la description mentionnant "l'extension du calcul au moment de l'inférence (test-time compute) et l'itération approfondie multi-tours", le coût par invocation de Max sera nettement plus élevé que celui de la version standard, probablement entre 3 et 10 fois plus. Il est conseillé d'utiliser la version standard pour les tâches courantes et de passer à Max uniquement pour les besoins de recherche de haut niveau.

Q4 : Puis-je créer mon propre serveur MCP pour accéder à Deep Research Max ?

Oui. MCP est un protocole ouvert. N'importe quelle équipe peut implémenter son propre serveur MCP selon les spécifications pour exposer des données issues d'ERP, CRM ou de bases de connaissances internes sous forme d'interfaces standardisées pour l'Agent. Google encourage explicitement les contributions de la communauté pour les implémentations de serveurs MCP.

Q5 : Les sorties de Deep Research Max peuvent-elles être intégrées directement dans une page Web ?

Oui. Les sorties natives incluent des tableaux HTML, des graphiques SVG et des mises en page structurées, qui peuvent être directement intégrés dans des pages Web, des tableaux de bord ou des e-mails. C'est l'un des avantages différenciateurs majeurs de Deep Research Max par rapport aux sorties LLM traditionnelles.

Q6 : L'Agent peut-il fonctionner si l'accès au Web est totalement désactivé ?

Oui. L'Agent effectuera ses recherches uniquement à partir des sources de données privées que vous avez spécifiées (serveurs MCP, corpus de recherche de fichiers, contexte d'URL, etc.). C'est le mode d'utilisation privilégié pour les scénarios de conformité en entreprise, où les données ne quittent jamais le périmètre interne.

Q7 : Quelle est la taille de la fenêtre de contexte de Deep Research Max ?

Héritée de Gemini 3.1 Pro, elle est de 1 048 576 jetons (environ 1M) en entrée et jusqu'à 65 536 jetons (environ 65K) en sortie. Cela signifie qu'une seule invocation peut traiter des dizaines de longs articles de recherche ou une bibliothèque entière de documentation produit.

Q8 : Le score de 77,1 % à l'ARC-AGI-2 signifie-t-il que Gemini 3.1 Pro est le plus puissant en tout ?

On ne peut pas en déduire une telle généralité. L'ARC-AGI-2 mesure le raisonnement abstrait ; les 77,1 % indiquent que Gemini 3.1 Pro est en tête sur cette dimension spécifique. Pour le code, le multimodal ou la compréhension du chinois, il faut se référer aux benchmarks correspondants. Dans l'ensemble, Gemini 3.1 Pro reste l'un des modèles phares de premier plan.

Q9 : Deep Research Max va-t-il remplacer les systèmes RAG ?

Pas à court terme. Il s'agit plutôt d'une relation complémentaire. Le RAG conserve des avantages en termes de coûts et de latence pour le "rappel précis de données d'entreprise spécifiques". Deep Research Max est idéal pour les tâches à haute valeur ajoutée nécessitant une "fusion multi-sources + raisonnement approfondi + production visuelle". La meilleure pratique consiste à utiliser le RAG pour les questions-réponses de premier niveau et à passer à Deep Research Max pour les besoins complexes.

Q10 : Comment Deep Research Max se comporte-t-il en chinois ?

Les capacités multilingues de Gemini 3.1 Pro incluent le chinois, et Deep Research Max en hérite. Cependant, notez que l'outil Google Search privilégie par défaut l'anglais. Pour les recherches en chinois, il est recommandé d'activer simultanément le domaine chinois de Google Search et un serveur MCP en chinois pour améliorer considérablement la couverture de l'information.

VIII. Conclusion : Points clés pour le déploiement de Deep Research Max

En résumé, voici les points essentiels que tout développeur doit retenir concernant Google Deep Research Max :

Premièrement, Deep Research Max est l'agent de recherche autonome le plus prometteur de 2026. Ses quatre percées majeures — support MCP, visualisation native, fusion multi-sources et bond de performance — propulsent enfin les agents de recherche en entreprise vers une phase opérationnelle concrète. Deuxièmement, les deux versions répondent à des besoins distincts : la version standard optimise la latence pour les interactions en temps réel, tandis que la version Max privilégie la profondeur et la synthèse pour les tâches asynchrones complexes. Choisissez selon votre cas d'usage. Troisièmement, le score de 77,1 % à l'ARC-AGI-2 n'est pas qu'un simple chiffre ; il signifie que le modèle sous-jacent, Gemini 3.1 Pro, a clairement surpassé la moyenne humaine en matière de raisonnement abstrait. Associé au framework d'invocation du modèle de Deep Research Max, nous disposons enfin d'une solution commercialement viable pour les recherches complexes de longue haleine.

Quatrièmement, le protocole MCP est en passe de devenir le standard de facto pour les agents de nouvelle génération. Le fait que Google en fasse un support de premier ordre est un signal fort. Anthropic étant également un fervent promoteur du MCP, et avec le support déjà présent dans Cursor ou Claude Desktop, un écosystème solide est en train de se structurer autour de ce protocole. Investir dès maintenant dans l'apprentissage et l'implémentation de serveurs MCP est un choix à fort retour sur investissement. Cinquièmement, le chemin d'accès depuis la Chine est clair : Deep Research / Max passe par le niveau de prévisualisation payant de l'API Gemini. Des plateformes de service proxy API comme APIYI (apiyi.com) permettent de gérer rapidement l'intégralité du processus, de l'inscription au paiement et à l'invocation, sans avoir à se soucier des contraintes réseau transfrontalières ou des cartes bancaires internationales.

🎯 Recommandation finale : Si vous développez des produits IA dans les domaines de la recherche, du conseil, de l'analyse, de l'éducation ou du droit, intégrez immédiatement Deep Research Max dans votre évaluation technologique. Il représente le summum actuel de l'ingénierie des agents IA commerciaux. Les premiers à l'adopter bénéficieront d'un avantage concurrentiel majeur. Vous pouvez tester rapidement l'intégration via la plateforme APIYI (apiyi.com) et, en combinant la fenêtre de contexte de 1M de Gemini 3.1 Pro avec ses capacités multimodales, faire évoluer vos scénarios classiques de RAG, de service client intelligent ou de génération de contenu vers une forme d'agent autonome de nouvelle génération.

Le lancement de Deep Research Max n'est qu'un début. Google a clairement indiqué dans son blog qu'il s'agit d'une "étape décisive pour les agents de recherche autonomes" (a step change for autonomous research agents). Votre capacité à saisir cette fenêtre d'opportunité technologique déterminera directement votre positionnement concurrentiel pour le second semestre 2026.

Auteur : Équipe technique APIYI | Spécialistes de la mise en œuvre pratique des grands modèles de langage. Pour plus de contenus techniques, visitez APIYI sur apiyi.com