Nota del autor: Este artículo explica en detalle el principio real de la estratificación de imágenes en gpt-image-2, los fenómenos de procesamiento en el backend con Python, los métodos de invocación de API y las estrategias de optimización de costes, ayudando a los desarrolladores a no confundir las capacidades de la cadena de herramientas con las capacidades nativas del modelo.

Si has estado usando gpt-image-2 recientemente para crear pósteres, gráficos científicos, imágenes de productos o diapositivas, es posible que hayas notado un fenómeno interesante: algunos afirman que puede "estratificar imágenes" e incluso dividir una imagen en objetos editables mediante Python en el backend.

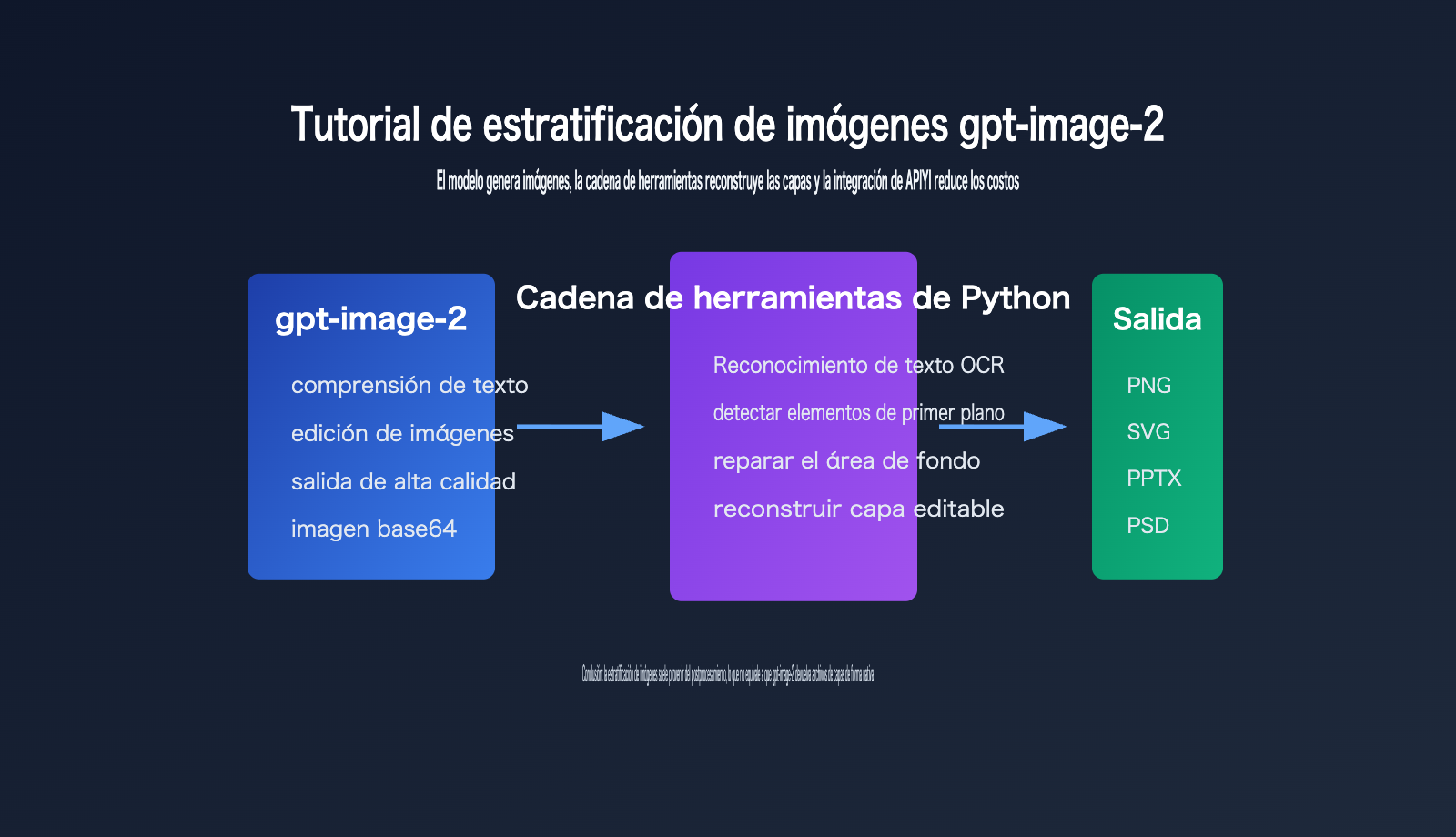

A primera vista, parece que el modelo ha aprendido Photoshop de repente, pero en realidad se parece más a un flujo de trabajo de cadena de herramientas múltiples: gpt-image-2 se encarga de generar o editar imágenes de alta calidad, mientras que los scripts de Python se encargan del OCR, la reparación de fondos, la segmentación de elementos, la reconstrucción de SVG/PPTX/PSD y otros procesos posteriores.

Este no es otro artículo introductorio, sino un desglose completo de lo que gpt-image-2 puede y no puede hacer en cuanto a la estratificación de imágenes, analizado desde las capacidades de la API, los principios de las capas, el postprocesamiento con Python, el cálculo de costes y la implementación en ingeniería.

Valor central: Al terminar de leer este artículo, tendrás claros los límites de la estratificación de imágenes en gpt-image-2, sabrás cómo integrar la API oficial de gpt-image-2 a través de APIYI (apiyi.com) y cómo diseñar un flujo de trabajo de "generación de imágenes a material editable" listo para producción.

Puntos clave de la estratificación de imágenes en gpt-image-2

La clave de la estratificación de imágenes en gpt-image-2 es distinguir primero entre la "salida del modelo" y la "salida del flujo de trabajo del producto".

La página oficial del modelo de OpenAI define a gpt-image-2 como un modelo de imagen para la generación y edición rápida y de alta calidad, que admite entradas de texto, entradas de imagen y salidas de imagen, y que puede utilizarse con los endpoints de generación y edición de la API de Imágenes.

Sin embargo, a juzgar por la forma actual de la API pública, el resultado principal que obtienen los desarrolladores sigue siendo datos de imagen, no archivos de proyecto multicapa al estilo de Photoshop.

| Punto clave | Descripción | Valor para el desarrollador |

|---|---|---|

| Capacidad nativa del modelo | gpt-image-2 se encarga de entender la indicación, la imagen de referencia y la intención de edición, produciendo la imagen final | Adecuado para generar pósteres, imágenes de productos, ilustraciones y borradores visuales |

| Formato de salida de la interfaz | La documentación oficial se centra en campos como b64_json, formato de imagen, dimensiones, calidad y uso de tokens |

Facilita el almacenamiento, la carga, la auditoría y la facturación en el servidor |

| Origen de la estratificación | La mayoría de las capas editables provienen de postprocesamientos como OCR, segmentación, reparación, vectorización, escritura de PPTX/PSD, etc. | Explica "por qué el backend ejecuta Python" |

| Optimización de costes | La API oficial se puede integrar a precio oficial, combinada con bonificaciones por recarga para reducir el coste real | Ideal para generación por lotes, pruebas e integración en producción |

La estratificación de imágenes en gpt-image-2 no es una salida PSD nativa

Uno de los puntos que más se malinterpreta sobre la estratificación de imágenes en gpt-image-2 es confundir el "archivo editable que ve el usuario final" con el "archivo que escupe directamente el modelo".

A nivel de ingeniería, ambos son completamente diferentes.

Lo que el modelo genera directamente es una imagen, que suele ser recibida por la aplicación en formato de datos base64 o como archivo de imagen.

Si un producto puede convertirla en PPTX, SVG o PSD, generalmente significa que el producto ha añadido una capa de sistema de postprocesamiento después del modelo.

Este sistema probablemente esté hecho con Python, ya que Python tiene un ecosistema maduro en procesamiento de imágenes, OCR, inferencia de aprendizaje profundo y generación de documentos de oficina.

Por ejemplo, un ingeniero podría usar OCR para reconocer texto, luego usar inpainting para limpiar el área de texto de la imagen original y, finalmente, usar python-pptx para reconstruir los cuadros de texto y las capas de imagen.

Este tipo de flujo de trabajo puede dar al usuario la sensación de que "la imagen ha sido estratificada", pero en esencia es una inferencia inversa de una estructura editable a partir de una imagen plana.

Esta inferencia inversa no siempre es perfecta.

Cuanto más claro sea el texto, más simple el fondo y más regular el diseño, mejor será el efecto de estratificación.

Si la imagen tiene texturas complejas, sombras semitransparentes, escritura a mano, decoraciones pequeñas o objetos altamente superpuestos, el postprocesamiento es propenso a errores de detección, omisiones y defectos en los bordes.

La estratificación de imágenes en gpt-image-2 requiere prestar atención a los límites entre el modelo y la cadena de herramientas

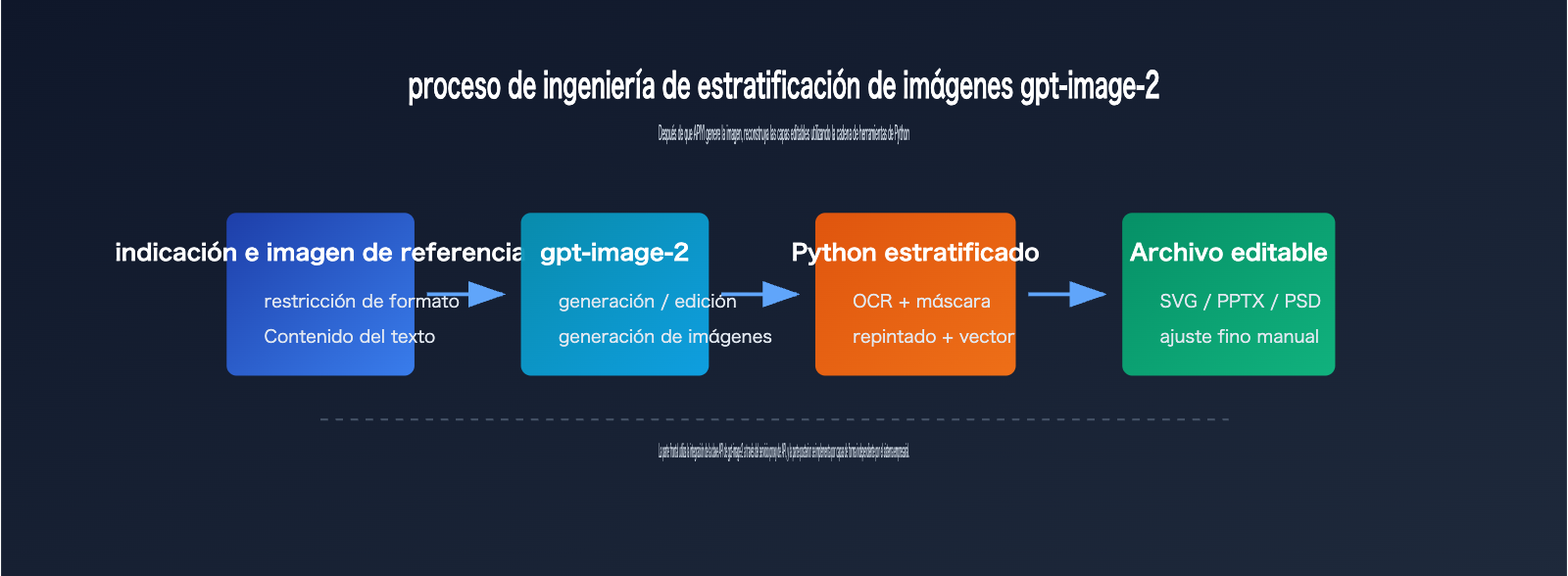

Al desarrollar la estratificación de imágenes con gpt-image-2, los desarrolladores deberían dividir el sistema en dos partes.

La primera parte es la de generación: dejar que gpt-image-2 produzca imágenes con suficiente calidad visual, una estructura clara y un texto lo más preciso posible.

La segunda parte es la de estructuración: utilizar Python u otras herramientas de postprocesamiento para convertir la imagen plana en objetos editables.

Ambas partes tienen objetivos diferentes y, por tanto, métricas de evaluación distintas.

La parte de generación se centra en el seguimiento de la indicación, la composición, la precisión del texto, la consistencia de la imagen y el coste de salida.

La parte de estructuración se centra en la tasa de editabilidad del texto, la precisión de la división de objetos, la naturalidad de la reparación del fondo, la compatibilidad de los archivos exportados y el coste de la corrección manual.

Consejo técnico: Si deseas validar el flujo de estratificación de imágenes de gpt-image-2, te sugiero que primero integres la API oficial de gpt-image-2 a través de APIYI (apiyi.com) para probar la generación y edición, y luego añadas gradualmente los módulos de OCR, segmentación, reparación y exportación. Esto permite aislar y solucionar por separado los problemas del modelo y los del postprocesamiento.

Cómo funciona la estratificación de imágenes en gpt-image-2

La estratificación de imágenes en gpt-image-2 puede entenderse como una ingeniería inversa de "imagen plana a material estructurado".

No se trata simplemente de recortar una imagen, sino de un proceso completo que combina comprensión visual, procesamiento de imágenes tradicional y generación de documentos.

Paso 1: Generar imágenes aptas para la estratificación

Para que la estratificación de imágenes en gpt-image-2 sea más estable, la fase de generación debe estar orientada al postprocesamiento.

La indicación debe solicitar explícitamente un diseño claro, límites de elementos definidos, áreas de texto independientes y texturas de fondo que no sean excesivamente complejas.

Si el objetivo es crear un PPTX o SVG, se recomienda utilizar un diseño plano, bloques de color claros, pocas sombras y pocos degradados.

Si el objetivo es crear un PSD, se recomienda describir claramente la relación entre el sujeto, el fondo, el texto y los elementos decorativos.

Un error común es pedirle al modelo que genere carteles cinematográficos muy complejos y esperar que las herramientas de postprocesamiento separen las capas perfectamente de forma automática.

Esto no es realista bajo las condiciones de ingeniería actuales.

El efecto de estratificación depende en gran medida de la capacidad de análisis de la imagen de entrada.

Paso 2: Detección de texto y objetos

La primera categoría de tareas más común en el backend de Python es la detección.

La detección de texto generalmente utiliza modelos OCR para identificar el contenido, la posición, el tamaño de fuente y los límites del cuadro de texto.

La detección o segmentación de objetos identificará objetos visuales como personas, productos, iconos, líneas y áreas de fondo.

Si se trata de diapositivas o infografías, también puede identificar títulos, párrafos, tablas, flechas, ejes de coordenadas y leyendas.

Esta capa no es que gpt-image-2 "devuelva las capas" por sí mismo, sino que el modelo de postprocesamiento infiere las capas a partir de los píxeles.

Cuanto más precisa sea la inferencia, más se parecerán los archivos PPTX, SVG o PSD exportados al diseño original.

Cuando la inferencia no es precisa, los problemas más comunes incluyen el desplazamiento de los cuadros de texto, fuentes inconsistentes, rastros en la reparación del fondo e iconos fragmentados.

Paso 3: Reparación del fondo y reconstrucción del archivo

Cuando el OCR identifica el área de texto, si se desea que el texto sea editable, generalmente es necesario borrar el texto de la imagen original.

Después de borrar el texto, aparecerán huecos en el fondo.

En este punto, se necesita utilizar algoritmos de inpainting o reparación de imágenes para completar el fondo.

Luego, el sistema vuelve a escribir el texto identificado como cuadros de texto independientes en el PPTX, SVG o PSD.

Si se desea crear capas de objetos más detalladas, también es necesario generar una máscara para los elementos del primer plano, recortar el objeto y escribirlo en diferentes capas.

Este proceso suena como si "el modelo estratificara", pero para ser precisos, es "generación de imagen por el modelo + análisis de imagen con Python + reconstrucción de capas mediante bibliotecas de documentos".

Inicio rápido con la estratificación de imágenes en gpt-image-2

A continuación, presento el flujo mínimo de estratificación de imágenes en gpt-image-2 para desarrolladores.

El primer paso es obtener la imagen a través de la API.

El segundo paso es guardar la imagen como un archivo local.

El tercer paso es enviarla a los módulos de OCR, segmentación, reparación y exportación.

Ejemplo de API minimalista para estratificación

El siguiente ejemplo muestra cómo llamar a la API oficial de gpt-image-2 a través de una interfaz unificada.

from openai import OpenAI

import base64

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

result = client.images.generate(

model="gpt-image-2",

prompt="Genera un cartel de lanzamiento de producto adecuado para su posterior estratificación, fondo de color sólido, áreas de texto claras, límites de elementos definidos",

size="1024x1024",

quality="medium",

output_format="png"

)

image_bytes = base64.b64decode(result.data[0].b64_json)

open("poster.png", "wb").write(image_bytes)

El objetivo de este código no es "obtener un PSD inmediatamente", sino obtener primero una imagen clara adecuada para el postprocesamiento.

Si ves que el servidor continúa llamando a Python, generalmente es porque ha entrado en la fase de OCR, máscara, inpainting o exportación.

Estructura completa de procesamiento

A continuación, presento una estructura de procesamiento más cercana a un proyecto real.

No está vinculada a ningún modelo específico de OCR o segmentación, solo muestra los límites de los módulos.

from pathlib import Path

def generate_image(prompt: str) -> Path:

"""Llama a la API oficial de gpt-image-2 y guarda la imagen plana."""

# client = OpenAI(api_key="YOUR_APIYI_KEY", base_url="https://vip.apiyi.com/v1")

# response = client.images.generate(model="gpt-image-2", prompt=prompt)

return Path("poster.png")

def detect_layout(image_path: Path) -> dict:

"""OCR, detección de objetos, reconocimiento de diseño."""

return {"texts": [], "objects": [], "background_regions": []}

def rebuild_editable_file(image_path: Path, layout: dict) -> Path:

"""Repara el fondo y exporta a SVG, PPTX o PSD."""

return Path("poster-editable.pptx")

prompt = "Genera un cartel de producto de IA con texto claro, elementos separados y adecuado para edición por capas"

image_path = generate_image(prompt)

layout = detect_layout(image_path)

editable_path = rebuild_editable_file(image_path, layout)

print(editable_path)

En entornos de producción, se recomienda dividir generate_image y rebuild_editable_file en tareas asíncronas.

La generación de la imagen puede requerir tiempo de espera, y el postprocesamiento también puede consumir CPU o GPU.

Para equipos que necesitan generar carteles, imágenes de productos o gráficos científicos por lotes, es mejor que las llamadas a la API y las tareas de postprocesamiento entren en una cola, registrando el tiempo de ejecución y la causa de los fallos en cada paso.

Consejo de inicio rápido: La API oficial de gpt-image-2 en APIYI (apiyi.com) es ideal para probar primero la fase de generación y luego integrar tu propio módulo de estratificación en Python. De esta forma, mantienes la capacidad del modelo oficial mientras controlas la lógica de archivos editables en tu propio sistema.

Plantillas de indicación para estratificación

Si el objetivo final es que sea "estratificable", la indicación debe ser más contenida que en la generación de imágenes común.

| Objetivo | Indicación recomendada | Indicación no recomendada |

|---|---|---|

| Estratificación de carteles | Fondo de color sólido o degradado de baja complejidad, texto de título independiente, bordes del producto claros | Generar carteles cinematográficos complejos con muchas texturas y humo |

| Estratificación de PPT | Estilo de infografía plana, incluye títulos claros, iconos, flechas y tres secciones de explicación | Generar visuales abstractos con alto sentido artístico |

| Estratificación de imágenes de producto | Producto en el centro, fondo limpio, sombras suaves, bordes definidos | Hacer que el producto se fusione fuertemente con el fondo |

| Reconstrucción SVG | Formas geométricas, líneas, bloques de color, poco texto, evitar texturas de fotos reales | Muchas texturas pequeñas, personajes complejos y materiales transparentes |

Una buena indicación reducirá significativamente la dificultad del postprocesamiento.

Desde una perspectiva de ingeniería, "adecuado para generar" y "adecuado para estratificar" no son el mismo objetivo.

Los usuarios normales quieren impacto visual, los sistemas de estratificación quieren una estructura clara.

Si vas a realizar una producción automatizada de materiales, deberías priorizar la claridad estructural.

Análisis del fenómeno del backend en Python en la estratificación de imágenes con gpt-image-2

Cuando los usuarios ven que Python procesa la estratificación de imágenes de gpt-image-2 en segundo plano, generalmente se debe a una de estas tres razones:

La primera es el script de encapsulación de la API.

Para reducir la duplicación de código, los desarrolladores escriben scripts en Python que invocan a gpt-image-2, guardan automáticamente las imágenes, registran los parámetros, gestionan los errores y realizan reintentos. Este tipo de script no significa que el modelo se ejecute internamente mediante Python.

La segunda es el script de postprocesamiento de imágenes.

Por ejemplo, enviar la imagen resultante a un modelo de OCR, segmentación, relleno de fondo, herramientas de vectorización o bibliotecas de generación de PPTX/PSD. Estos scripts son la verdadera fuente de esa "sensación de capas".

La tercera es el script de flujo de trabajo de agentes.

Si el usuario invoca la generación de imágenes a través de ChatGPT, Codex, Claude Code u otras herramientas de agentes, el agente puede seleccionar automáticamente una herramienta de Python para completar la descarga, conversión, recorte, composición o generación de archivos. Esto sigue siendo una invocación de herramientas a nivel de producto, no una capacidad nativa de gpt-image-2 para devolver múltiples capas.

¿Por qué se usa Python habitualmente para la estratificación de imágenes en gpt-image-2?

Python es ideal para la estratificación de imágenes en gpt-image-2, no por ser misterioso, sino por su ecosistema completo.

| Etapa de procesamiento | Tareas comunes en Python | Valor típico |

|---|---|---|

| Invocación de API | Llamar a la API de imágenes, guardar imágenes en base64, registrar parámetros | Generación estable de imágenes |

| OCR | Identificar contenido de texto, posición y cuadros de texto | Convertir texto de imagen en texto editable |

| Segmentación | Generar máscaras de sujeto, fondo, iconos y líneas | Separar objetos visuales |

| Relleno | Borrar texto u objetos y rellenar el fondo | Crear una imagen base limpia |

| Exportación | Escribir en SVG, PPTX, PSD u otros formatos | Entrega de archivos editables |

La ventaja de este flujo es su flexibilidad. Los desarrolladores pueden elegir diferentes modelos de OCR, modelos de segmentación y formatos de exportación según el escenario de negocio. La desventaja es que la estabilidad del resultado no depende totalmente de gpt-image-2. Si el OCR identifica mal un carácter o el relleno de fondo falla, el archivo editable final tendrá problemas, incluso si la imagen original era de alta calidad.

La estratificación de imágenes de gpt-image-2 no es lo mismo que las "capas" (layers) de seguridad

Existe otro término que suele causar confusión: "layers".

En los materiales de seguridad de OpenAI, se mencionan expresiones como image input layers, image output layers o multiple layers of protection. Aquí, "layers" se refiere a capas de detección de seguridad, capas de detección de entrada/salida o capas de protección, no a capas de Photoshop. Si solo ves la palabra "layers" en inglés y la traduces directamente como "capas de imagen", es fácil que se malinterprete.

Al realizar una selección técnica, sugiero volver siempre a los campos de la API y al formato de salida. Si la interfaz no devuelve una lista de capas, una lista de máscaras, un árbol de objetos o un archivo PSD, no puede considerarse una interfaz nativa de estratificación de imágenes.

Criterios de fiabilidad para la estratificación de imágenes en gpt-image-2

Para determinar si una solución de estratificación de imágenes de gpt-image-2 es fiable, se pueden observar cuatro indicadores:

- Si distingue claramente entre la salida de la imagen original y la salida del postprocesamiento.

- Si puede mostrar el origen de cada capa, por ejemplo, capa de texto OCR, capa de fondo, capa de objeto en primer plano.

- Si permite la corrección manual.

- Si puede reproducir el resultado de la estratificación de la misma imagen.

Si un sistema solo dice "estratificación automática por IA" pero no explica la lógica de OCR, máscaras, relleno y exportación, los desarrolladores deben evaluar con cautela.

Sugerencia de solución: En proyectos reales, puedes obtener la capacidad de generación estable de gpt-image-2 a través del canal oficial y luego convertir la capacidad de estratificación de Python en un servicio interno. De esta forma, aprovechas el canal oficial sin vincular la "caja negra" del postprocesamiento a una única herramienta.

Costes de la API de estratificación de imágenes de gpt-image-2 y el cálculo del 86%

Los costes de la estratificación de imágenes de gpt-image-2 deben desglosarse. La generación del modelo es una parte del coste; el OCR, la segmentación, el relleno, la exportación y el almacenamiento son otra. Si solo miras "cuánto cuesta generar un archivo editable final", es fácil juzgar mal el presupuesto.

Referencia de precios oficiales de la estratificación de imágenes de gpt-image-2

Según la página de precios oficial de la API de OpenAI, los precios públicos de gpt-image-2 incluyen entrada de imagen, entrada de imagen en caché, salida de imagen, entrada de texto y entrada de texto en caché.

| Ítem de facturación | Precio oficial | Significado en la estratificación |

|---|---|---|

| Image input | 8,00 USD / 1 millón de tokens | Al introducir imágenes de referencia, edición o material |

| Cached image input | 2,00 USD / 1 millón de tokens | Coste de entrada de imagen en caché reutilizable |

| Image output | 30,00 USD / 1 millón de tokens | Coste principal de la imagen de salida |

| Text input | 5,00 USD / 1 millón de tokens | Indicaciones, instrucciones de edición, diseño |

| Cached text input | 1,25 USD / 1 millón de tokens | Optimización de costes para indicaciones en caché |

El precio oficial es la base para el presupuesto. Sin embargo, en proyectos reales, también hay que considerar reintentos por fallos, colas de procesamiento por lotes, potencia de cálculo para postprocesamiento, validación humana y costes de almacenamiento. Si necesitas generar frecuentemente múltiples versiones de carteles, te sugiero controlar los costes mediante las indicaciones, el tamaño, la calidad y las estrategias de reintento.

Costes al usar la API de transferencia oficial para la estratificación de imágenes de gpt-image-2

La API de transferencia oficial de gpt-image-2 en APIYI (apiyi.com) permite el acceso según los precios oficiales, lo cual es ideal para equipos que desean mantener el canal del modelo oficial mientras reducen la complejidad de la integración.

La promoción de recarga mencionada es: recarga 100 USD y recibe un 10% adicional de saldo. Calculando estrictamente como "100 USD pagados por 110 USD de saldo disponible", el coste unitario equivalente es aproximadamente el 90,9% del precio oficial. Si se calcula según la promoción de la plataforma y el descuento integral, puede entenderse como un rango de ahorro cercano al 14% (86% del precio original), sujeto a las reglas de liquidación de la plataforma.

| Método de acceso | Base de precio | Ventajas | Consideraciones |

|---|---|---|---|

| API oficial de OpenAI | Precio oficial | Canal nativo, documentación completa | Gestión propia de cuenta, pagos y límites |

| API de transferencia de APIYI | Precio oficial | Acceso rápido, interfaz unificada | Recarga según reglas de la plataforma |

| Promoción de recarga | 100 USD + 10% | Reduce el coste unitario real | El descuento depende del saldo final |

| Solución propia (proxy) | Variable | Alta flexibilidad | Mayor coste de cumplimiento y mantenimiento |

Sugerencia de costes: Si vas a realizar pruebas de producto para la estratificación de imágenes con gpt-image-2, te recomiendo usar primero la API de transferencia de APIYI para procesar entre 50 y 100 muestras, registrar el coste de generación, la tasa de éxito de la estratificación y el tiempo de corrección manual antes de decidir si escalar las llamadas por lotes.

Lista de verificación para la optimización de costes

La optimización de costes no debe centrarse solo en el precio unitario. Es más importante reducir la generación innecesaria.

- Usa indicaciones estructuradas para reducir los reintentos causados por composiciones poco claras.

- Realiza una validación de diseño con calidad media antes de aumentar la calidad para la versión final.

- Almacena en caché las indicaciones de plantilla para reducir los costes de entrada de texto repetitivo.

- Utiliza imágenes de referencia y normas de diseño uniformes para el mismo producto, facilitando el postprocesamiento.

- Clasifica las muestras fallidas para distinguir si el fallo es de la generación del modelo o de la estratificación en Python.

- Prioriza el estilo de infografía plana para escenarios que requieran entregas editables.

Estas prácticas suelen ser más efectivas que simplemente buscar un precio unitario más bajo.

Comparativa de soluciones de capas de imagen para gpt-image-2

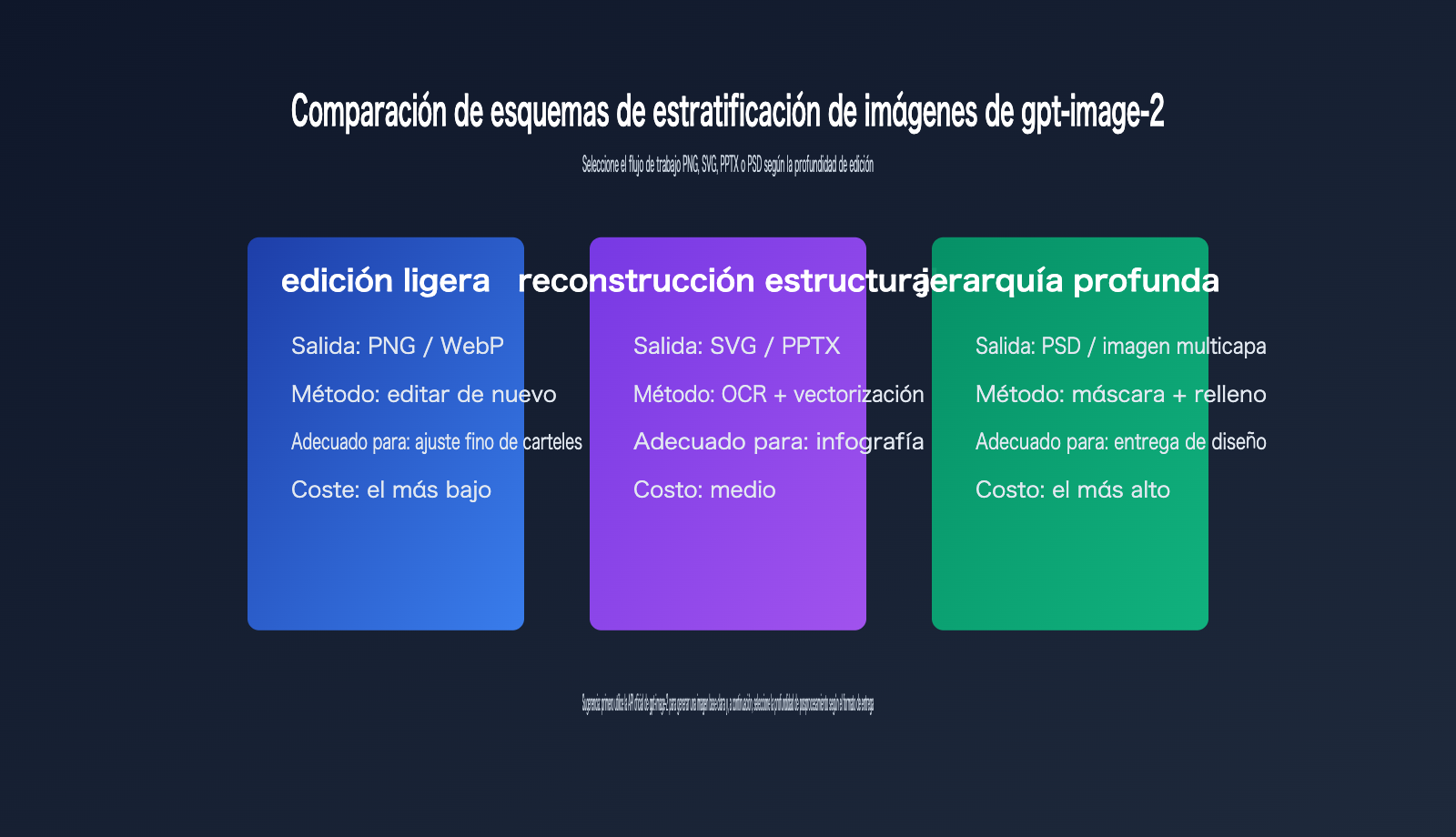

Los diferentes equipos tienen requisitos distintos para el manejo de capas en gpt-image-2.

Algunos solo quieren cambiar el título, otros necesitan exportar a PPTX, otros requieren un PSD completo, y otros simplemente buscan generar un SVG con una estructura clara.

La siguiente comparativa te ayudará a elegir la ruta adecuada.

Ruta 1 de capas de imagen en gpt-image-2: Continuar con la edición de imágenes

Si solo necesitas modificar contenido parcial, la forma más sencilla no es usar capas, sino seguir editando con gpt-image-2.

Por ejemplo, cambiar títulos, colores, fondos, reemplazar imágenes de productos o añadir iconos pequeños, todo se puede hacer a través de la interfaz de edición de imágenes.

Esta ruta tiene el costo más bajo y la menor complejidad de sistema.

La desventaja es que cada edición requiere regenerar parte o la totalidad de la imagen, y no permite seleccionar capas individuales con la precisión de un software de diseño.

Es ideal para gestión de contenidos, imágenes para redes sociales y carteles rápidos.

Ruta 2 de capas de imagen en gpt-image-2: Exportar a SVG o PPTX

Si la imagen es un gráfico, un diagrama de flujo, un póster científico o una infografía, la reconstrucción en SVG/PPTX suele ser más práctica que un PSD.

Esto se debe a que los elementos de este tipo de imágenes suelen ser texto, iconos, líneas, rectángulos, flechas y algunos elementos decorativos.

El OCR puede reconocer el texto, la vectorización puede reconstruir líneas y bloques de color, y las librerías de PPTX pueden crear cuadros de texto editables.

Esta ruta es adecuada para bases de conocimiento corporativas, presentaciones científicas, materiales de ventas y material didáctico.

No busca una restauración perfecta de todos los píxeles, sino que se enfoca en la "editabilidad" y en que el resultado sea "suficientemente parecido".

Ruta 3 de capas de imagen en gpt-image-2: Generar PSD o paquetes de materiales multicapa

El uso de capas en PSD es lo más complejo.

Si necesitas separar personas, productos, fondos, texto, sombras y decoraciones en capas distintas, el sistema requiere capacidades de segmentación y reparación mucho más potentes.

Para imágenes con estilo fotográfico complejo, es difícil que un PSD automático alcance el nivel de un diseñador profesional.

Una estrategia más realista es generar un "PSD semiautomático": el sistema separa primero el fondo, el sujeto, el texto y algunos objetos clave, y luego el diseñador realiza los ajustes manuales.

Esta ruta es ideal para diseño de marca, imágenes principales de comercio electrónico, creatividad publicitaria y materiales de alto valor que requieren reutilización a largo plazo.

Preguntas frecuentes sobre las capas de imagen en gpt-image-2

¿Puede gpt-image-2 exportar directamente a PSD?

Basándonos en la forma actual de la API pública, no debe entenderse como una herramienta que "exporta directamente archivos de capas PSD".

La documentación oficial destaca la generación de imágenes, edición, datos de imagen en base64, formatos de salida, dimensiones, calidad y consumo de tokens.

Si algún producto permite exportar a PSD, generalmente es porque ha integrado adicionalmente Photoshop, una librería de escritura de PSD o un módulo de postprocesamiento desarrollado internamente.

¿El código Python en las capas de imagen de gpt-image-2 es código interno del modelo?

Generalmente no.

Lo que los usuarios ven como Python es más probable que sean scripts de flujo de trabajo externos.

Estos podrían encargarse de llamar a la API, guardar imágenes, ejecutar OCR, generar máscaras, reparar fondos, vectorizar gráficos o escribir en archivos PPTX/PSD.

Estos scripts pertenecen a la capa de aplicación, no al modelo en sí.

¿Por qué las capas de imagen de gpt-image-2 parecen capas reales?

Porque el sistema de postprocesamiento puede reconstruir la estructura a partir de los píxeles.

Por ejemplo, tras el reconocimiento de texto, este puede convertirse en un cuadro de texto editable.

El sujeto del producto puede convertirse en una capa de imagen independiente mediante una máscara.

El fondo, tras ser reparado, puede convertirse en una base limpia.

Al superponer estas capas, el resultado se asemeja mucho a un archivo de proyecto exportado desde un software de diseño.

¿Son adecuadas las capas de imagen de gpt-image-2 para todas las imágenes?

No.

Las imágenes adecuadas para este proceso suelen tener un diseño claro, bordes definidos, poco texto, fondos no muy complejos y elementos que no estén altamente superpuestos.

Las imágenes no aptas incluyen fotografías complejas, ilustraciones con texturas intensas, materiales transparentes, una gran cantidad de decoraciones pequeñas y composiciones altamente artísticas.

¿Cómo mejorar la tasa de éxito en las capas de imagen de gpt-image-2?

Empieza optimizando la indicación.

Pide al modelo que genere una estructura clara, con bordes definidos, áreas de texto independientes y fondos de baja complejidad.

Luego, limita el tamaño y el estilo de la imagen para evitar que el sistema de postprocesamiento tenga que lidiar con demasiados detalles.

Finalmente, utiliza un conjunto de muestras para evaluar la precisión del OCR, la precisión de la separación de objetos y el tiempo de corrección manual.

En la capa de invocación de la API, se recomienda gestionar de forma unificada las solicitudes de la API oficial de gpt-image-2 para facilitar el registro de costos y el seguimiento de muestras fallidas.

¿Es obligatorio usar la API para las capas de imagen de gpt-image-2?

Si solo generas imágenes ocasionalmente, puedes usar la interfaz gráfica.

Si necesitas realizar generación por lotes, auditorías automáticas, almacenamiento de materiales, exportación de archivos editables o colaboración en equipo, deberías usar la API.

La API permite que cada paso sea rastreable, reintentable y facturable, además de facilitar la conexión con servicios de postprocesamiento en Python internos.

¿Cómo entender el descuento del 14% (86% del precio) en las capas de imagen de gpt-image-2?

La forma en que los usuarios acceden a través de esta plataforma a la API oficial de gpt-image-2 es cobrando según el precio oficial, mientras que al recargar 100 dólares se obtiene un 10% adicional.

Desde un punto de vista puramente matemático, 100 dólares se convierten en 110 dólares de saldo, lo que equivale a un costo unitario de aproximadamente el 90.9%.

Si la plataforma muestra un "14% de descuento sobre el precio oficial" en promociones, liquidaciones integrales o canales específicos, debes basarte en el saldo real recibido, la facturación del panel de control y las condiciones de la promoción.

Al escribir tu presupuesto, se recomienda mantener tres columnas: "Precio oficial", "Costo tras bono de recarga" y "Descuento promocional de la plataforma", para evitar confusiones financieras.

Puntos clave sobre la estratificación de imágenes en gpt-image-2

- El juicio fundamental sobre la estratificación de imágenes en gpt-image-2 es: el modelo suele generar imágenes planas; las capas provienen generalmente de cadenas de herramientas de postprocesamiento.

- El procesamiento backend en Python no tiene misterios; se utiliza comúnmente para la invocación del modelo, OCR, máscaras (mask), inpainting, vectorización y exportación de archivos.

- Si la interfaz no devuelve archivos PSD, árboles de objetos, listas de capas o listas de máscaras, no debería promocionarse como una capacidad de estratificación nativa del modelo.

- Para mejorar la tasa de éxito en la estratificación, la indicación debe estar orientada al postprocesamiento, procurando que la estructura de la imagen sea clara y los límites de los elementos estén bien definidos.

- Para ediciones ligeras se puede seguir utilizando gpt-image-2; la entrega estructurada es más adecuada para SVG/PPTX, y solo se debería considerar PSD para entregas de diseño profundo.

- La API oficial de gpt-image-2 es adecuada para la integración en el lado de la generación, mientras que el servicio de estratificación en Python es más apropiado para ser controlado por los propios sistemas de negocio.

- El cálculo de costes debe considerar simultáneamente el precio oficial del modelo, las bonificaciones por recarga, la potencia de cálculo para el postprocesamiento, los reintentos tras fallos y el tiempo de corrección manual.

Referencias sobre la estratificación de imágenes en gpt-image-2

Este artículo se redactó consultando recursos en inglés y contrastándolos con la documentación pública de la API.

- Página del modelo OpenAI GPT Image 2: developers.openai.com/api/docs/models/gpt-image-2

- Documentación de OpenAI Images and vision: developers.openai.com/api/docs/guides/images-vision

- Referencia de la API de OpenAI Images: developers.openai.com/api/reference/resources/images

- Precios de la API de OpenAI: openai.com/api/pricing

- Discusión en Reddit sobre habilidades de Python en GPT Image 2: reddit.com/r/ClaudeCode/comments/1stokpq

- Discusión en Reddit sobre GPT Image 2 para diapositivas editables: reddit.com/r/ChatGPT/comments/1suwjp8

Estos materiales apuntan a una conclusión común: la capacidad de generación y edición de gpt-image-2 es muy potente, pero las capas editables son, por lo general, el resultado de flujos de trabajo en la capa de aplicación.

Resumen sobre la estratificación de imágenes en gpt-image-2

Lo más importante en la estratificación de imágenes con gpt-image-2 no es obsesionarse con la pregunta puntual de si es un "PSD nativo", sino establecer los límites correctos del sistema.

En el lado de la generación, gpt-image-2 se encarga de convertir la indicación y la imagen de referencia en imágenes de alta calidad.

En el lado de la ingeniería, la cadena de herramientas de Python se encarga de analizar la imagen plana para convertirla en texto, objetos, fondos y archivos editables.

Al separar claramente estas dos etapas, los desarrolladores pueden evaluar con mayor precisión los resultados, los costos y la mantenibilidad.

Si tu objetivo es automatizar la creación de pósteres por lotes, gráficos para presentaciones, visuales de productos o materiales de diseño, te recomiendo usar primero gpt-image-2 para generar una imagen base con una estructura clara y, luego, realizar un posprocesamiento en formatos como SVG, PPTX o PSD, según tus necesidades de entrega.

Para la capa de acceso, puedes utilizar preferiblemente la API oficial de gpt-image-2 disponible en APIYI (apiyi.com). Realiza la invocación del modelo respetando los precios oficiales y aprovecha la promoción donde obtienes un 10% adicional al recargar 100 dólares, lo que reduce tus costos operativos reales.

Cuando gestionas por separado la "capacidad del modelo", la "capacidad de posprocesamiento", el "formato de entrega" y la "estructura de costos", la estratificación de imágenes en gpt-image-2 deja de ser una función misteriosa y se convierte en un flujo de producción visual verificable, escalable y listo para producción.

Para intercambio técnico y pruebas de acceso a modelos, puedes visitar APIYI (apiyi.com), una plataforma ideal para equipos de desarrolladores que necesitan una integración unificada de gpt-image-2, la serie GPT y otras API de modelos diversos.