El 21 de abril de 2026, Google lanzó dos agentes de investigación autónomos de próxima generación en la vista previa pública de la API de Gemini: Deep Research y Deep Research Max, ambos basados en el modelo Gemini 3.1 Pro presentado en febrero. Este es un paso crucial en la estrategia de Google para llevar la "investigación autónoma a largo plazo" desde los productos de consumo hacia las API para desarrolladores. Cabe destacar que Deep Research Max alcanzó un 93.3% en DeepSearchQA y heredó la capacidad de razonamiento central de Gemini 3.1 Pro en ARC-AGI-2 con un 77.1%, más del doble que Gemini 3 Pro.

Lo más importante es que esta generación de Deep Research introduce tres nuevas características de nivel de ingeniería: acceso mediante el protocolo MCP (Model Context Protocol) a cualquier fuente de datos privada, salida visual nativa (tablas HTML / gráficos SVG / infografías) y fusión de datos entre la web y fuentes privadas. Esto significa que, por primera vez, los desarrolladores pueden realizar una única invocación del modelo para que el agente busque simultáneamente en la red pública, la intranet corporativa y datos profesionales de terceros, generando directamente informes visuales listos para integrar en paneles de control.

Este artículo, basado en los materiales oficiales de Google y la documentación de la API de Gemini, explica detalladamente los 4 avances clave de Deep Research Max, las diferencias con la versión estándar, el significado real del 77.1% en ARC-AGI-2 y cómo los desarrolladores pueden acceder a estas capacidades.

一、¿Qué es Deep Research Max?: Un agente de investigación autónomo impulsado por Gemini 3.1 Pro

Deep Research no es un concepto nuevo; Google lo abrió a los consumidores en la aplicación Gemini a finales de 2024, permitiendo que la IA realizara búsquedas web y redactara un informe con referencias. Sin embargo, la versión de consumo tenía funciones limitadas, la API no estaba abierta y no podía conectarse a datos privados, lo que limitaba su valor para implementaciones de ingeniería.

Esta versión de Deep Research / Deep Research Max es una reescritura a nivel de arquitectura. Google lo define como un "agente de investigación autónomo de próxima generación" capaz de planificar, ejecutar y sintetizar tareas de investigación de múltiples pasos, abarcando diversas fuentes de herramientas como la web, servidores MCP, contexto de URL, ejecución de código y recuperación de archivos, para finalmente producir informes estructurados con citas. Ambas versiones se lanzaron simultáneamente, orientadas a diferentes necesidades de ingeniería.

| Dimensión de comparación | Deep Research (Estándar) | Deep Research Max | Escenario de aplicación |

|---|---|---|---|

| Objetivo de optimización | Velocidad y latencia | Integridad y profundidad | – |

| Tiempo de razonamiento | Corto (segundos a minutos) | Largo (minutos a horas) | – |

| Cómputo en tiempo de prueba | Estándar | Extendido | – |

| Iteraciones multironda | 1-2 rondas | Razonamiento profundo multironda | – |

| Modo de invocación | Sincrónico / Interacción en tiempo real | Asincrónico / Tarea en segundo plano | – |

| Costo | Bajo | Alto | – |

| Casos de uso típicos | Asistente de investigación conversacional, centro de atención al cliente | Informes de inversión, análisis industrial, debida diligencia | – |

Google señaló explícitamente en su blog oficial: Deep Research Max está diseñado para flujos de trabajo que aceptan esperas asincrónicas y buscan la máxima calidad en los resultados. Si realizas debida diligencia interna, investigación industrial profunda o generación automática de informes extensos, Max es la opción más adecuada; si se trata de un asistente de IA para interacción en tiempo real con usuarios finales, la baja latencia de la versión estándar es más amigable.

💡 Sugerencia de acceso: Tanto Deep Research como Max están disponibles a través del nivel de pago de la API de Gemini. Los desarrolladores pueden invocar la serie Gemini 3.1 Pro directamente a través de APIYI (apiyi.com), plataforma que ya ha unificado la encapsulación bajo el protocolo compatible con OpenAI, evitando barreras como las restricciones de red transfronterizas y el registro de cuentas.

2. Los 4 avances principales de Deep Research Max

Lo más destacado de este lanzamiento son las 4 actualizaciones de ingeniería que marcan un antes y un después. En conjunto, son las que dotan a Deep Research Max de la verdadera forma de un "Agente de investigación autónomo de nivel empresarial".

2.1 Primer avance: Soporte nativo para el protocolo MCP, acceso a cualquier dato de terceros

El Protocolo de Contexto de Modelo (MCP, por sus siglas en inglés) es un protocolo abierto liderado por Anthropic, cuyo objetivo es permitir que los agentes de IA accedan a cualquier herramienta externa y fuente de datos de manera unificada. Deep Research Max es el primer producto del ecosistema de Google en integrar MCP como un ciudadano de primera clase. Los desarrolladores solo necesitan encapsular sus datos privados o de terceros en un servidor MCP, y el agente podrá consultarlos como si estuviera invocando una herramienta nativa.

En la presentación, Google reveló los primeros socios de MCP: FactSet, S&P Global y PitchBook, tres gigantes de los datos financieros, están colaborando con Google para diseñar servidores MCP, permitiendo que sus clientes comunes integren estos flujos de datos financieros profesionales en el flujo de trabajo de Deep Research. Esto significa que los agentes de investigación en sectores como finanzas, derecho y medicina finalmente cuentan con una ruta de acceso estandarizada, sin necesidad de reescribir capas de adaptación para cada fuente de datos.

2.2 Segundo avance: Salida visual nativa, adiós a los informes de solo texto

La salida de los LLM tradicionales suele limitarse a texto en formato Markdown; para añadir gráficos, era necesario invocar una API de dibujo o un intérprete de código adicional. Deep Research Max genera tablas HTML, gráficos SVG e infografías de forma nativa durante el proceso de razonamiento. Estos productos visuales son una parte orgánica del flujo de razonamiento del agente, no un parche posterior.

Las formas de salida reales incluyen: tablas HTML estructuradas (que se pueden incrustar directamente en páginas web), gráficos SVG escalables (gráficos de sectores, de barras, líneas de tiempo, etc.) e infografías con diseños completos (ideales para enviar por correo o publicar en Slack). Si el proyecto integra un modelo de imagen de alta calidad como Nano Banana, Deep Research también puede invocarlo para generar productos visuales más complejos. Este cambio transforma la salida de Deep Research de un "Markdown largo con citas" a un "informe multimodal listo para incrustar en paneles de control".

2.3 Tercer avance: Fusión entre la Web y datos privados

Anteriormente, Deep Research solo podía buscar en la red pública, lo que no resolvía el mayor punto de dolor de los usuarios empresariales: integrar información privada (documentos en SaaS, datos de CRM, informes de ERP, etc.) en la investigación. La nueva versión permite habilitar simultáneamente Google Search, servidores MCP remotos, contexto de URL, ejecución de código y búsqueda de archivos en una sola llamada a la API, y el agente decidirá autónomamente qué herramienta utilizar.

Más importante aún, los desarrolladores pueden desactivar completamente el acceso a la Web, permitiendo que el agente realice la investigación solo en las fuentes de datos privadas especificadas. Para sectores altamente sensibles a la conformidad de datos, como las finanzas, el derecho y la medicina, este interruptor es la verdadera clave de desbloqueo: garantiza que el agente no filtre accidentalmente información interna en las consultas de búsqueda pública. Este es un detalle de cumplimiento crucial que a menudo se pasa por alto en la implementación de IA empresarial.

2.4 Cuarto avance: Salto en el rendimiento – Mejora integral en tres puntos de referencia

La comparativa oficial publicada por Google muestra que Deep Research Max presenta una mejora de rendimiento significativa en comparación con la versión de diciembre de 2024:

| Punto de referencia | Versión de dic. 2024 | Deep Research Max (04/2026) | Margen de mejora |

|---|---|---|---|

| DeepSearchQA | 66.1% | 93.3% | +27.2 puntos porcentuales |

| Humanity's Last Exam | 46.4% | 54.6% | +8.2 puntos porcentuales |

| ARC-AGI-2 (modelo base) | 31.1% (Gemini 3 Pro) | 77.1% (Gemini 3.1 Pro) | Más de 2× |

El punto de referencia DeepSearchQA evalúa específicamente la capacidad de búsqueda web autónoma + razonamiento integral; una puntuación del 93.3% ya está cerca del límite superior. Esto significa que, en la tarea central de "buscar información de forma autónoma y escribir respuestas precisas", Deep Research Max ya casi no deja margen para que la competencia le saque ventaja.

三、El verdadero significado de ARC-AGI-2 al 77.1%

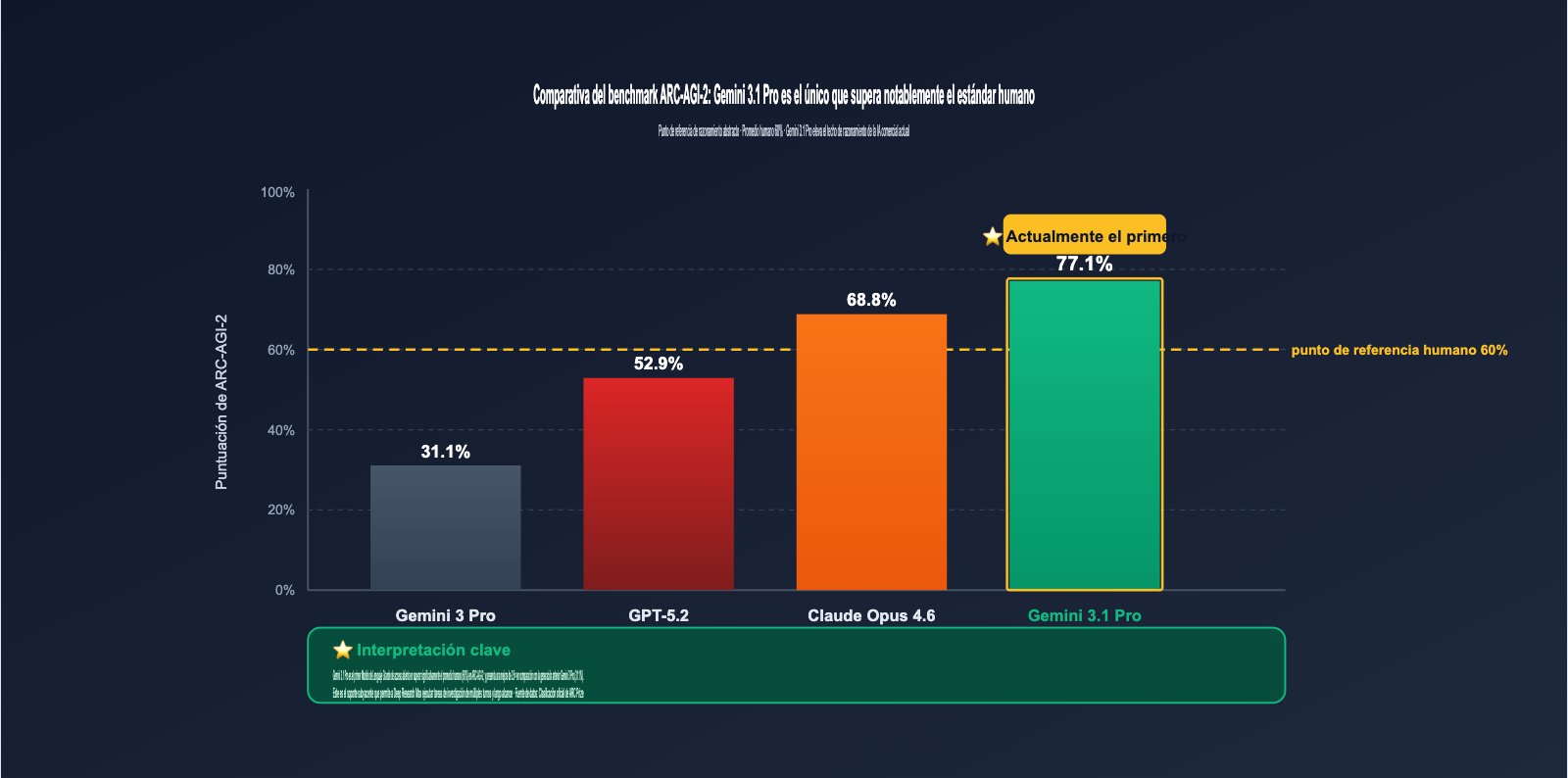

Muchos desarrolladores ven la cifra del "77.1%" y piensan instintivamente que "no está mal", pero para entender la dificultad del benchmark ARC-AGI-2, es necesario comprender el valor real detrás de esta puntuación.

3.1 ¿Qué es ARC-AGI-2?

ARC-AGI-2 es mantenido por la organización ARC Prize y está diseñado específicamente para probar la capacidad de razonamiento abstracto de la IA en patrones lógicos completamente nuevos, nunca antes vistos en los datos de entrenamiento. Funciona mediante varios ejemplos (pares de entrada → salida) para que el modelo infiera reglas implícitas y luego aplique esas reglas para resolver nuevas entradas inéditas. El punto de referencia humano es del 60%, por lo que un 77.1% ya supera el nivel promedio de las personas.

La dificultad central de este benchmark radica en que: el modelo no puede obtener una buena puntuación basándose en la memoria. Cualquier patrón es generado de forma nueva y no tiene relación con el corpus de entrenamiento. Es por esto que ARC-AGI-2 es considerado en la industria como uno de los estándares de oro para medir la "capacidad real de razonamiento abstracto".

3.2 Comparativa: Gemini 3.1 Pro es el más potente actualmente

| Modelo | Puntuación ARC-AGI-2 | vs Referencia Humana (60%) | Notas |

|---|---|---|---|

| Gemini 3.1 Pro | 77.1% | +17.1 pp | Primer modelo abierto que supera claramente al humano |

| Claude Opus 4.6 | 68.8% | +8.8 pp | Buque insignia de Anthropic |

| Referencia humana | 60.0% | – | Nivel promedio |

| GPT-5.2 | 52.9% | -7.1 pp | OpenAI |

| Gemini 3 Pro | 31.1% | -28.9 pp | Generación anterior |

Como se puede observar, Gemini 3.1 Pro no solo superó a todos los modelos de lenguaje grandes comerciales, sino que es el único modelo abierto y accesible que supera significativamente el punto de referencia humano. Esta es la primera vez que una IA comercial abre una brecha respecto a los humanos en un benchmark estricto de "razonamiento lógico nuevo". Deep Research Max hereda directamente esta capacidad de razonamiento, lo cual es el soporte subyacente que le permite ejecutar tareas de investigación de larga duración y múltiples iteraciones.

🎯 Sugerencia de capacidad: Si tu producto está orientado a escenarios de razonamiento de alta intensidad como investigación, consultoría, análisis de inversiones o análisis legal, la combinación de Gemini 3.1 Pro + Deep Research Max debería incluirse de inmediato en tu evaluación técnica. Puedes realizar pruebas de acceso rápido a través de la plataforma APIYI (apiyi.com), la cual ya admite la invocación compatible con OpenAI para varios modelos insignia, incluido Gemini 3.1 Pro.

IV. Inicio rápido con la API de Deep Research Max

Una vez explicada la teoría, aquí tienes el código más conciso para realizar una invocación funcional. Deep Research Max utiliza la interfaz estándar de la API de Gemini y está disponible en el nivel de pago para vista previa.

4.1 Invocación básica: Ejecutar una investigación web con un Agente

from google import genai

from google.genai import types

# Conexión a través del servicio proxy de API de APIYI para evitar problemas de red transfronterizos

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analiza el panorama del mercado global de modelos de incrustación (embedding) en la primera mitad de 2026, enumera los 5 principales proveedores y sus ventajas diferenciadoras",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Habilitar Google Search

thinking_config=types.ThinkingConfig(thinking_level="max") # Presupuesto de razonamiento nivel Max

)

)

print(response.text) # Genera el informe de investigación completo (incluye tablas HTML nativas / gráficos SVG)

Este código realiza tres acciones: selecciona el modelo Deep Research Max, activa la herramienta Google Search y establece el nivel máximo de razonamiento. El Agente planificará de forma autónoma la ruta de búsqueda, realizará análisis iterativos en múltiples rondas y finalmente producirá un informe completo con citas y visualizaciones.

4.2 Invocación avanzada: Conexión a servidores MCP para investigación con datos privados

Si necesitas utilizar Deep Research Max para procesar datos internos de la empresa (como CRM o wikis internas), debes encapsular las fuentes de datos en un servidor MCP y declararlo durante la invocación:

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analiza los tipos de clientes con mayor tasa de abandono en el pipeline de ventas del Q1 de la empresa",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

Ten en cuenta que aquí no se ha habilitado google_search, lo que significa que el Agente realiza la investigación exclusivamente dentro del ámbito de los datos privados y no enviará consultas externas a Google. Esta es una capacidad crítica para escenarios de cumplimiento empresarial.

4.3 Cambio entre la versión estándar y la versión Max

Si tu escenario está orientado a conversaciones en tiempo real para usuarios finales, donde la velocidad es más importante que la profundidad, simplemente cambia el nombre del modelo a deep-research-preview-04-2026. Las interfaces de ambos son totalmente compatibles; la diferencia radica únicamente en el presupuesto de cálculo interno y el número de rondas de iteración.

💡 Consejo de prueba rápida: Al conectar por primera vez, te sugerimos usar la versión estándar de Deep Research para ejecutar algunas demos y familiarizarte con el estilo de salida del Agente antes de escalar a Max para tareas de negocio reales. Recomendamos realizar la conexión directamente a través de la plataforma APIYI (apiyi.com), que admite la invocación compatible con OpenAI para múltiples modelos, incluyendo Gemini 3.1 Pro, Deep Research y Deep Research Max, facilitando el cambio y la comparación.

V. Análisis de impacto de Deep Research Max: ¿Qué flujos de trabajo se transformarán?

El lanzamiento de nuevas herramientas es solo el comienzo; el verdadero valor reside en cómo cambiarán los flujos de trabajo existentes. Basándonos en los materiales de lanzamiento y los comentarios iniciales de la comunidad, estos 4 campos son los que recibirán un mayor impacto.

5.1 Investigación de inversiones y análisis sectorial

Este es el escenario que Google destacó explícitamente en su presentación. Tres proveedores de datos financieros (FactSet, S&P Global y PitchBook) se han unido para crear servidores MCP, con el objetivo de que los analistas de compra puedan invocar datos de informes financieros, estudios sectoriales y bases de datos de fusiones y adquisiciones mediante una única instrucción en lenguaje natural, generando automáticamente informes visuales. Un borrador que antes tomaba 2 días, ahora podría completarse en 30 minutos. Esto no reemplaza al analista, sino que lo libera de la búsqueda mecánica de información.

5.2 Debida diligencia corporativa y auditoría de cumplimiento

El mayor problema para los equipos legales y de cumplimiento al realizar una debida diligencia es que "necesitan consultar información pública y archivos internos simultáneamente". El modo de "datos privados solamente" de Deep Research Max permite a los abogados confiar datos de clientes al Agente para su análisis sin temor a que sean registrados por motores de búsqueda. Junto con la salida visual nativa, el informe final de debida diligencia puede incrustarse directamente en Notion o Confluence.

5.3 Reseñas académicas e investigación bibliográfica

La parte más laboriosa para los académicos al escribir artículos de revisión es digerir rápidamente más de 200 referencias para crear un marco argumentativo. El razonamiento profundo de múltiples rondas de Deep Research Max permite leer decenas de archivos PDF en una sola invocación y generar un esquema estructurado. Gracias a la ventana de contexto de 1M de tokens, una sola llamada puede procesar la literatura central de toda una línea de investigación.

5.4 Actualización de asistentes de IA en productos SaaS

Muchos productos SaaS ya están integrando Copilots de IA, pero la mayoría de las implementaciones actuales son solo "GPT-4 + RAG empaquetado". La versión estándar de Deep Research (baja latencia) ofrece a estos productos una ruta de actualización: reemplazar el Copilot por un Agente autónomo real, capaz de responder preguntas integrando datos web, datos internos del producto y datos privados del usuario, en lugar de limitarse a buscar palabras clave en documentos.

VI. Comparativa de Deep Research Max frente a productos similares

Analicemos la posición de Deep Research Max dentro del ecosistema actual. Los productos líderes en "investigación / razonamiento profundo" se pueden dividir básicamente en tres categorías:

| Producto | Fabricante | Investigación autónoma | Soporte MCP | Visualización nativa | Datos privados | Puntuación global |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ Profunda multietapa | ✅ Ciudadano de primera | ✅ HTML/SVG nativo | ✅ Modo Web off | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ Multietapa | Parcial | Parcial | Parcial | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCP nativo | ❌ Principalmente texto | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ Principalmente Web | ❌ | Parcial | ❌ | ⭐⭐⭐ |

| RAG + Agente propio | Varios | Depende de la implementación | Depende de la implementación | Requiere desarrollo | ✅ | ⭐⭐ |

Como se observa, Deep Research Max logra la oferta más completa en cuatro dimensiones clave: razonamiento profundo multietapa + soporte integral de MCP + visualización nativa + integración de datos privados de fuentes cruzadas. Es, actualmente, la solución de Agente de investigación más madura a nivel de ingeniería en el mercado comercial.

📌 Consejo de selección: Si tu aplicación requiere razonamiento profundo, cumplimiento de datos privados y resultados visuales, Deep Research Max es la mejor opción actual. Si solo necesitas un asistente de búsqueda web ligero, puedes optar por Perplexity o la versión estándar de Deep Research. Puedes integrar todos estos modelos de manera unificada a través de APIYI (apiyi.com), evitando configurar repetidamente las credenciales e interfaces de múltiples proveedores.

VII. Preguntas frecuentes (FAQ) sobre Deep Research Max

P1: ¿Qué diferencia hay entre Deep Research Max y el Gemini 3.1 Pro estándar?

Gemini 3.1 Pro es el Modelo de Lenguaje Grande base que proporciona la capacidad de razonamiento; Deep Research Max es un Agente de investigación autónomo construido sobre 3.1 Pro, que encapsula la invocación de múltiples herramientas, iteraciones múltiples, visualización nativa y otras capacidades de agente. En pocas palabras, 3.1 Pro es el "cerebro", y Deep Research Max es el "investigador equipado con manos, pies y herramientas".

P2: ¿Cómo pueden los desarrolladores en China invocar Deep Research Max?

Deep Research Max es una función del nivel de pago de la API de Gemini, y el acceso directo desde China requiere resolver problemas de red transfronteriza y pagos internacionales. La ruta más sencilla es utilizar plataformas de servicio proxy de API como APIYI (apiyi.com), que permiten pagar en yuanes, son totalmente compatibles con las interfaces oficiales y admiten el acceso integral a múltiples modelos, incluida la serie Gemini 3.1 Pro.

P3: ¿Cuánto más caro es Deep Research Max que la versión estándar?

Google no ha anunciado una cifra exacta, pero basándose en descripciones como "ampliación de computación en tiempo de prueba" y "iteraciones profundas de múltiples rondas", se infiere que el costo por invocación de Max será significativamente mayor que el de la versión estándar, posiblemente de 3 a 10 veces más. Se recomienda utilizar la versión estándar para tareas no críticas y pasar a Max cuando se requiera una profundidad de nivel superior.

P4: ¿Puedo escribir mi propio servidor MCP para acceder a Deep Research Max?

Sí. MCP es un protocolo abierto; cualquier equipo puede implementar su propio servidor MCP siguiendo las especificaciones para exponer datos de ERP, CRM, bases de conocimiento internas, etc., como interfaces estándar para el Agente. Google también ha expresado explícitamente su entusiasmo por las implementaciones de servidores MCP creadas por la comunidad.

P5: ¿Pueden incrustarse los resultados de Deep Research Max directamente en páginas web?

Sí. La salida nativa incluye tablas HTML, gráficos SVG y diseños estructurados, elementos que pueden incrustarse directamente en páginas web, paneles de control o correos electrónicos. Esta es una de las ventajas diferenciadoras clave de Deep Research Max frente a la salida de los LLM tradicionales.

P6: ¿Puede el Agente funcionar correctamente si se deshabilita por completo el acceso a la Web?

Sí. El Agente realizará su investigación únicamente utilizando las fuentes de datos privadas que hayas especificado, como servidores MCP, materiales de búsqueda de archivos (File Search) y contextos de URL. Este es precisamente el modo de uso central para entornos de cumplimiento corporativo, donde los datos nunca abandonan el perímetro de la empresa.

P7: ¿Cuál es el tamaño de la ventana de contexto de Deep Research Max?

Heredada de Gemini 3.1 Pro, tiene una entrada de contexto de 1,048,576 Tokens (aprox. 1M) y una salida máxima de 65,536 Tokens (aprox. 65K). Esto significa que una sola invocación puede procesar decenas de artículos extensos o todo un repositorio de documentación de productos.

P8: ¿El 77.1% en ARC-AGI-2 significa que la capacidad general de Gemini 3.1 Pro es la mejor?

No se puede inferir directamente. ARC-AGI-2 mide el razonamiento abstracto; el 77.1% indica que Gemini 3.1 Pro lidera en esa dimensión específica, pero el rendimiento en programación, capacidades multimodales, comprensión del chino y otras áreas debe evaluarse según sus respectivos estándares. Desde una perspectiva global, Gemini 3.1 Pro es uno de los modelos insignia de primera línea actual.

P9: ¿Deep Research Max reemplazará a los sistemas RAG?

A corto plazo no los reemplazará por completo, es más probable que tengan una relación complementaria. El RAG aún tiene ventajas irremplazables de costo y latencia en escenarios de "recuperación precisa de datos corporativos específicos". Deep Research Max es ideal para tareas de alto valor que requieren "fusión de múltiples fuentes + razonamiento profundo + resultados visuales". La mejor práctica es utilizar RAG para preguntas y respuestas de primer nivel y escalar a Deep Research Max cuando surjan necesidades de mayor profundidad.

P10: ¿Cómo es el desempeño de Deep Research Max en escenarios en chino?

La capacidad multilingüe de Gemini 3.1 Pro incluye el chino, y Deep Research Max hereda esta base. No obstante, ten en cuenta que la herramienta de búsqueda de Google tiene preferencia por el inglés de forma predeterminada; para tareas de investigación en chino, se recomienda habilitar simultáneamente el dominio de búsqueda en chino de Google y un servidor MCP en chino, lo que puede mejorar significativamente la cobertura de información.

VIII. Resumen: Puntos clave para la implementación de Deep Research Max

Repasando todo el artículo, estos son los puntos fundamentales que todo desarrollador debe recordar sobre Google Deep Research Max:

Primero, Deep Research Max es el Agente de investigación autónoma más destacado de 2026. Sus cuatro avances principales —soporte para MCP, visualización nativa, integración de fuentes cruzadas y salto en el rendimiento— han llevado la ingeniería de Agentes de investigación a nivel empresarial a una etapa realmente viable. Segundo, los dos modelos tienen enfoques distintos: la versión estándar optimiza la velocidad y la latencia para interacciones en tiempo real, mientras que la versión Max optimiza la profundidad y la síntesis para tareas asíncronas complejas; elige según tu caso de uso. Tercero, el 77.1% en ARC-AGI-2 no es solo un número: significa que el modelo subyacente, Gemini 3.1 Pro, ha superado claramente el nivel promedio humano en la capacidad central de razonamiento abstracto. Junto con el marco de invocación del modelo de Deep Research Max, finalmente contamos con una solución comercialmente viable para tareas de investigación complejas y de larga duración.

Cuarto, el protocolo MCP se convertirá en el estándar de facto para la próxima generación de Agentes, y el hecho de que Google lo trate como un ciudadano de primera clase es una señal clara. Anthropic también es un gran impulsor de MCP y, con el soporte existente en herramientas como Cursor y Claude Desktop, todo el ecosistema está convergiendo en torno a este protocolo. Para los desarrolladores, aprender e implementar servidores MCP es una inversión con un alto retorno (ROI). Quinto, la ruta de acceso desde China es clara: Deep Research / Max opera a través del nivel de vista previa de pago de la API de Gemini. Mediante plataformas de servicio proxy de API como APIYI (apiyi.com), puedes completar todo el proceso —desde el registro y el pago hasta la invocación— rápidamente, sin tener que lidiar con problemas de red transfronteriza o tarjetas de crédito internacionales.

🎯 Recomendación final: Si estás construyendo productos de IA relacionados con investigación, consultoría, análisis, educación o servicios legales, incorpora Deep Research Max en tu evaluación técnica de inmediato. Representa el nivel más alto de ingeniería de Agentes de IA comerciales en la actualidad; quienes actúen primero obtendrán las mayores ventajas competitivas en diferenciación de producto. Puedes realizar pruebas de acceso rápido a través de la plataforma APIYI (apiyi.com) y, combinándolo con la ventana de contexto de 1M y las capacidades multimodales de Gemini 3.1 Pro, elevar tus escenarios tradicionales de RAG, atención al cliente inteligente o generación de contenido a la siguiente generación de Agentes autónomos.

El lanzamiento de Deep Research Max es solo el comienzo. Google ha declarado explícitamente en su blog que esto es "un cambio de paradigma para los agentes de investigación autónomos". La capacidad de aprovechar esta ventana de iteración de herramientas determinará directamente la posición competitiva de los productos de IA en la segunda mitad de 2026.

Autor: Equipo técnico de APIYI | Enfocados en la implementación práctica de Modelos de Lenguaje Grande. Para más contenido técnico, visita APIYI en apiyi.com