Le duel entre GPT-5.5 et Claude Opus 4.7 est l'un des sujets qui passionne le plus les développeurs en ce premier semestre 2026.

Il ne s'agit pas ici de simples modèles de conversation.

GPT-5.5 met l'accent sur le codage agentique (agentic coding), l'utilisation de l'ordinateur, le travail intellectuel et l'analyse scientifique.

De son côté, Claude Opus 4.7 se concentre sur le raisonnement complexe, les tâches d'agent à long terme, la vision haute résolution, les capacités de mémoire et un respect plus strict des instructions.

Demander « lequel est le meilleur » serait trop simpliste.

La question pertinente est plutôt : votre tâche concerne-t-elle la correction de code, les questions-réponses sur une base de connaissances, l'analyse de longs contextes, la compréhension visuelle, l'automatisation par agents, ou s'agit-il d'appels API de production coûteux ?

Le choix entre GPT-5.5 et Claude Opus 4.7 variera considérablement selon la nature de votre mission.

Lors du lancement officiel de GPT-5.5, OpenAI a directement intégré Claude Opus 4.7 dans ses tableaux de comparaison.

Anthropic, de son côté, positionne Claude Opus 4.7 comme son modèle généraliste le plus puissant à ce jour, soulignant ses progrès en codage agentique, en travail intellectuel, ainsi que dans les tâches visuelles et de mémorisation.

Cet article est basé sur des sources officielles anglophones, sans recours à des sources secondaires en chinois.

Il est important de préciser que le terme « Claude 4.7 » utilisé ici désigne spécifiquement Claude Opus 4.7.

À l'heure où nous écrivons ces lignes, aucune information officielle d'Anthropic n'indique la sortie d'un modèle Claude Sonnet 4.7.

Conclusions clés : GPT-5.5 vs Claude Opus 4.7

La première différence entre GPT-5.5 et Claude Opus 4.7 réside dans leur positionnement.

OpenAI définit GPT-5.5 comme un modèle mieux adapté aux flux de travail réels. Il met l'accent sur le codage, le débogage, la recherche en ligne, l'analyse de données, la génération de documents et de tableaux, ainsi que sur l'exécution de tâches via divers outils.

Anthropic définit Claude Opus 4.7 comme son modèle généraliste le plus puissant. Il privilégie le raisonnement complexe, le codage agentique, les tâches de longue haleine, la compréhension visuelle, la mémoire et l'auto-vérification.

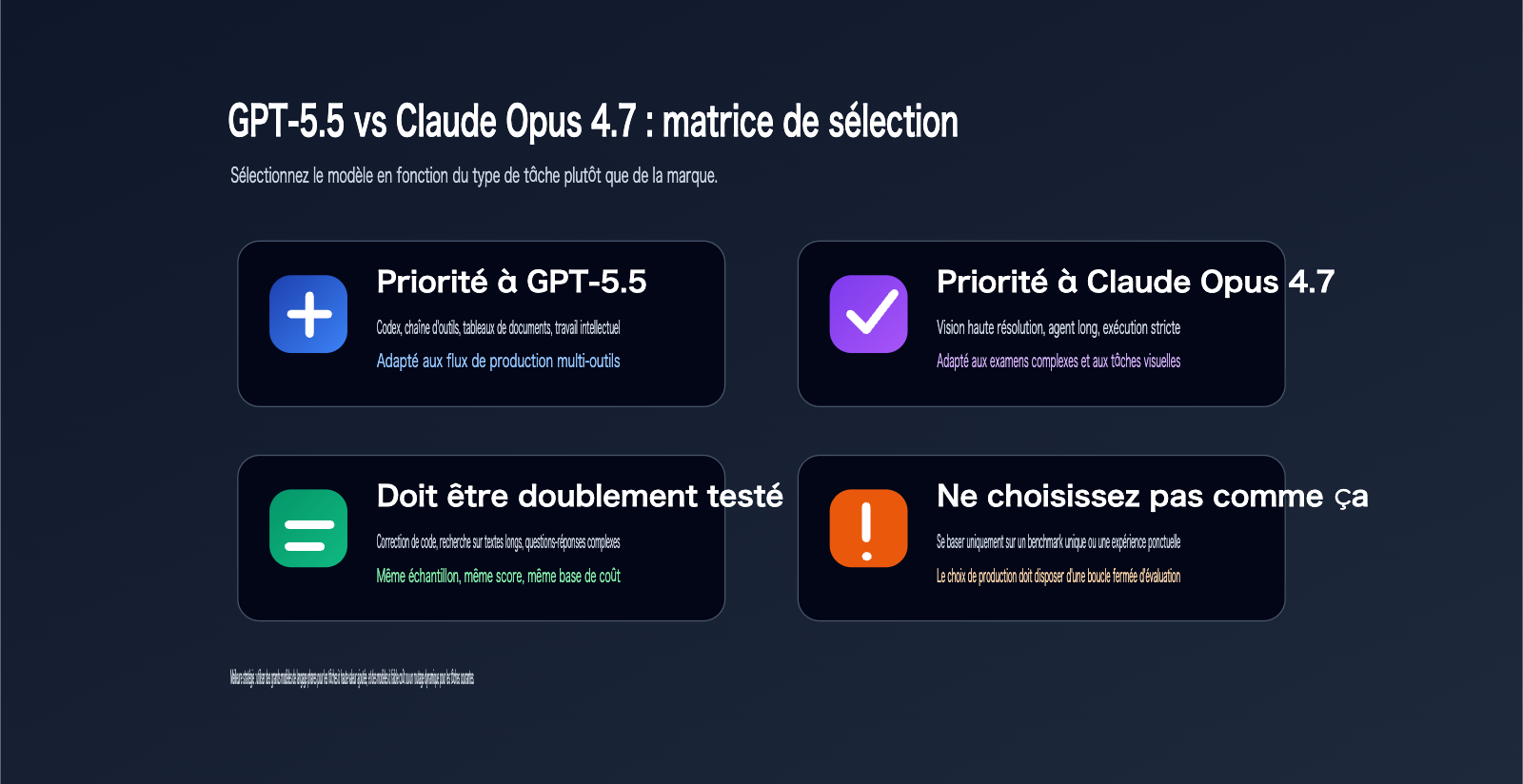

Si votre mission concerne des projets d'ingénierie complexes, des modifications multi-fichiers, l'invocation d'outils et le travail intellectuel, GPT-5.5 mérite souvent d'être testé en priorité.

Si vous travaillez sur des agents de longue durée avec Claude Code, la compréhension de captures d'écran, la vérification de mise en page de documents, la mémoire du système de fichiers et le respect strict des instructions, Claude Opus 4.7 est à privilégier.

Si vous avez besoin d'intégrer les deux types de modèles, nous vous recommandons d'utiliser le service proxy API APIYI (apiyi.com) pour le routage et l'évaluation multi-modèles, afin d'éviter de figer le choix du modèle dans votre code métier.

Comparaison rapide : GPT-5.5 vs Claude Opus 4.7

| Dimension | GPT-5.5 | Claude Opus 4.7 | Conseil de choix |

|---|---|---|---|

| Positionnement | Flux de travail réels et IA agentique | Modèle Claude généraliste le plus puissant | Choisir selon la tâche |

| Capacité de codage | Performances fortes sur Terminal-Bench 2.0 | Amélioration notable en codage agentique | Tester les deux |

| Contexte étendu | Jusqu'à 1M de jetons via API | Fenêtre de contexte de 1M | Adaptés aux longs contextes |

| Capacité visuelle | Collaboration multimodale et outils | Support d'images haute résolution | Claude pour les tâches visuelles lourdes |

| Contrôle du raisonnement | reasoning_effort | effort / adaptive thinking | Systèmes de paramètres différents |

| Coût API | 5 $ entrée / 30 $ sortie par million de jetons | 5 $ entrée / 25 $ sortie par million de jetons | Claude moins cher en sortie |

| Écosystème | ChatGPT, Codex, API | Claude, Claude Code, API | Selon le flux de travail |

Conseil : Si vous n'arrivez pas à déterminer lequel de GPT-5.5 ou Claude Opus 4.7 est le plus adapté, préparez 30 à 50 échantillons de votre activité réelle et utilisez APIYI (apiyi.com) pour tester les deux modèles simultanément. Comparez ensuite le taux de réussite, le temps de réponse, le coût et les évaluations humaines.

Comparaison des capacités de codage : GPT-5.5 vs Claude Opus 4.7

Le codage est le terrain de comparaison le plus crucial entre GPT-5.5 et Claude Opus 4.7.

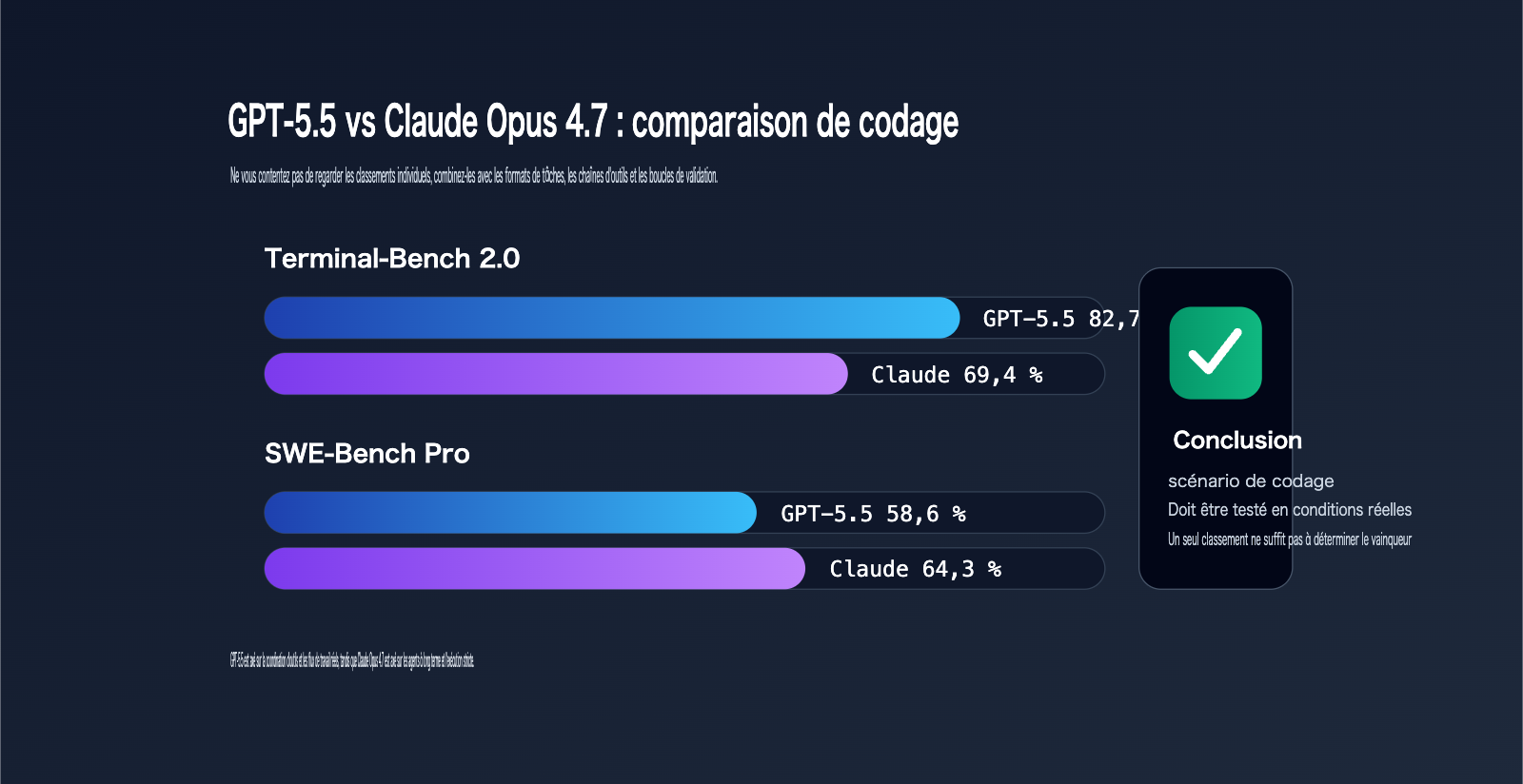

Selon les données officielles d'OpenAI, GPT-5.5 atteint 82,7 % sur Terminal-Bench 2.0. Dans le même tableau, Claude Opus 4.7 affiche 69,4 %. Cependant, sur l'évaluation publique SWE-Bench Pro, GPT-5.5 obtient 58,6 % contre 64,3 % pour Claude Opus 4.7.

Cela montre qu'aucun des deux modèles ne domine systématiquement l'autre.

GPT-5.5 excelle dans les flux de travail complexes en ligne de commande, la planification, l'itération et la coordination d'outils. Claude Opus 4.7, quant à lui, reste très compétitif sur les tâches de résolution d'issues GitHub.

Les documents officiels d'Anthropic soulignent également que Claude Opus 4.7 affiche une amélioration de 13 % par rapport à l'Opus 4.6 sur leur benchmark de codage de 93 tâches. L'amélioration par rapport à la génération précédente est donc bien réelle.

Cependant, comparer GPT-5.5 et Claude Opus 4.7 ne peut se résumer à un seul benchmark. Le travail de codage réel inclut également : la compréhension de code existant, l'identification des risques, le contrôle du périmètre des modifications, la complétion des tests, l'exécution de commandes, la gestion des échecs, l'explication des changements et la génération de notes de revue.

GPT-5.5 met l'accent sur l'exécution multi-outils et l'accomplissement de tâches avec moins de jetons dans les scénarios Codex. Claude Opus 4.7 se concentre sur les agents à long terme, l'effort soutenu et un respect plus strict des instructions dans les scénarios Claude Code.

Suggestions pour les scénarios de codage : GPT-5.5 vs Claude Opus 4.7

| Tâche de codage | Priorité de test recommandée | Raison |

|---|---|---|

| Flux de travail CLI complexes | GPT-5.5 | Score officiel plus élevé sur Terminal-Bench 2.0 |

| Correction d'issues GitHub | Claude Opus 4.7 / GPT-5.5 | Claude meilleur sur SWE-Bench Pro, écosystème GPT-5.5 fort |

| Compréhension de bases de code | GPT-5.5 | Scénario Codex axé sur le contexte multi-systèmes |

| Tâches d'agents longue durée | Claude Opus 4.7 | Meilleure gestion de l'effort et du budget de tâches |

| Revue et validation de code | Les deux conviennent | Se concentrer sur la boucle de test |

| Corrections de masse sensibles au coût | Test réel requis | Différences marquées dans l'utilisation des jetons |

Conseil : Ne vous fiez pas uniquement aux classements. Nous vous suggérons d'utiliser vos propres issues, tests échoués, revues de PR et tâches de refactorisation sur APIYI (apiyi.com) pour effectuer une évaluation comparative. Vérifiez si chaque modèle exécute réellement les tests, s'il modifie par erreur des fichiers non pertinents et s'il est capable d'identifier les risques.

Travail intellectuel et capacités de recherche : GPT-5.5 vs Claude Opus 4.7

La comparaison entre GPT-5.5 et Claude Opus 4.7 sur le travail intellectuel est également cruciale.

Les documents officiels d'OpenAI indiquent que GPT-5.5 atteint 84,9 % sur GDPval, tandis que Claude Opus 4.7 obtient 80,3 % dans le même tableau. GPT-5.5 Pro se situe à 82,3 %. Cela démontre que GPT-5.5 est extrêmement performant sur les évaluations de connaissances professionnelles listées par OpenAI.

OpenAI souligne également que GPT-5.5 a fait des progrès significatifs dans la génération de documents, de tableaux, de présentations, ainsi que dans le traitement de la recherche opérationnelle et des données commerciales.

Du côté d'Anthropic, les documents officiels de Claude Opus 4.7 mettent en avant ses performances exceptionnelles en matière de travail intellectuel, de mémoire, de vision et de travail d'agent à long terme. Une caractéristique majeure de Claude Opus 4.7 est sa rigueur accrue dans le traitement des données. Anthropic cite l'évaluation de Hex, suggérant que le modèle est plus enclin à signaler les données manquantes plutôt que de fournir des alternatives plausibles mais erronées. Ceci est essentiel pour l'analyse financière, les rapports de recherche, les audits de conformité et le traitement des tableaux de données.

Si vos tâches intellectuelles nécessitent que le modèle produise des documents professionnels élégants, complets et structurés, GPT-5.5 mérite d'être testé. Si vos tâches exigent que le modèle reste prudent face à des données manquantes, contradictoires ou dans des contextes longs, Claude Opus 4.7 est extrêmement compétitif.

Choix pour le travail intellectuel : GPT-5.5 vs Claude Opus 4.7

| Scénario | Avantage GPT-5.5 | Avantage Claude Opus 4.7 | Suggestion |

|---|---|---|---|

| Rapports commerciaux | Génération structurée forte | Rigueur des données | Comparer les deux |

| Analyse de tableaux | Capacité Codex forte | Vérification visuelle et analyse graphique | Selon le format d'entrée |

| Recherche financière | Performance GDPval forte | Amélioration du module Finance générale | Tester avec des échantillons réels |

| Audit de conformité | Capacité globale forte | Prudence sur les données manquantes | Priorité à Claude |

| Résumé multi-documents | Contexte long fort | Mémoire et instructions strictes | Selon la qualité des citations |

Conseil : Le plus grand risque dans le travail intellectuel est le contenu qui "semble complet mais contient des hallucinations". Lors de vos tests comparatifs entre GPT-5.5 et Claude Opus 4.7 sur APIYI (apiyi.com), nous vous suggérons de décomposer la notation humaine en 5 dimensions : exactitude factuelle, cohérence des citations, taux d'omission, qualité de la structure et applicabilité.

GPT-5.5 vs Claude Opus 4.7 : Analyse des capacités visuelles et de la fenêtre de contexte

GPT-5.5 et Claude Opus 4.7 prennent tous deux en charge une longue fenêtre de contexte, mais avec des nuances importantes.

Selon les documents officiels d'OpenAI, l'API de GPT-5.5 dispose d'une fenêtre de contexte de 1 million de jetons.

De son côté, la présentation des modèles d'Anthropic indique que Claude Opus 4.7 prend également en charge une fenêtre de contexte de 1 million de jetons, avec une limite de sortie de 128 000 jetons.

Pour les tâches nécessitant une longue fenêtre de contexte, les deux modèles sont désormais capables de traiter de vastes documents, des bases de code complètes et des dossiers complexes.

Cependant, en ce qui concerne les tâches visuelles, les évolutions apportées à Claude Opus 4.7 sont plus marquées.

La documentation d'Anthropic précise que Claude Opus 4.7 est le premier modèle Claude à prendre en charge les images haute résolution, avec une résolution maximale portée à 2576 px / 3,75 MP.

C'est un atout majeur pour la compréhension de captures d'écran, l'analyse de documents numérisés, la vérification de présentations, l'analyse de graphiques et l'utilisation assistée par ordinateur (computer use).

Anthropic souligne également que les coordonnées des images correspondent désormais au pixel réel (ratio 1:1), ce qui réduit le besoin de conversions d'échelle.

GPT-5.5 possède également de solides capacités multimodales et d'utilisation assistée par ordinateur, mais si votre flux de travail repose principalement sur des captures d'écran haute résolution, des graphiques, des mises en page de documents ou des coordonnées d'interface utilisateur, Claude Opus 4.7 mérite d'être testé en priorité.

Si vos entrées se composent essentiellement de longs textes, de bases de code, de documents métier, de données structurées ou de résultats de chaînes d'outils, il est recommandé d'évaluer GPT-5.5 et Claude Opus 4.7 avec le même jeu de données.

Différences de paramètres API et de migration : GPT-5.5 vs Claude Opus 4.7

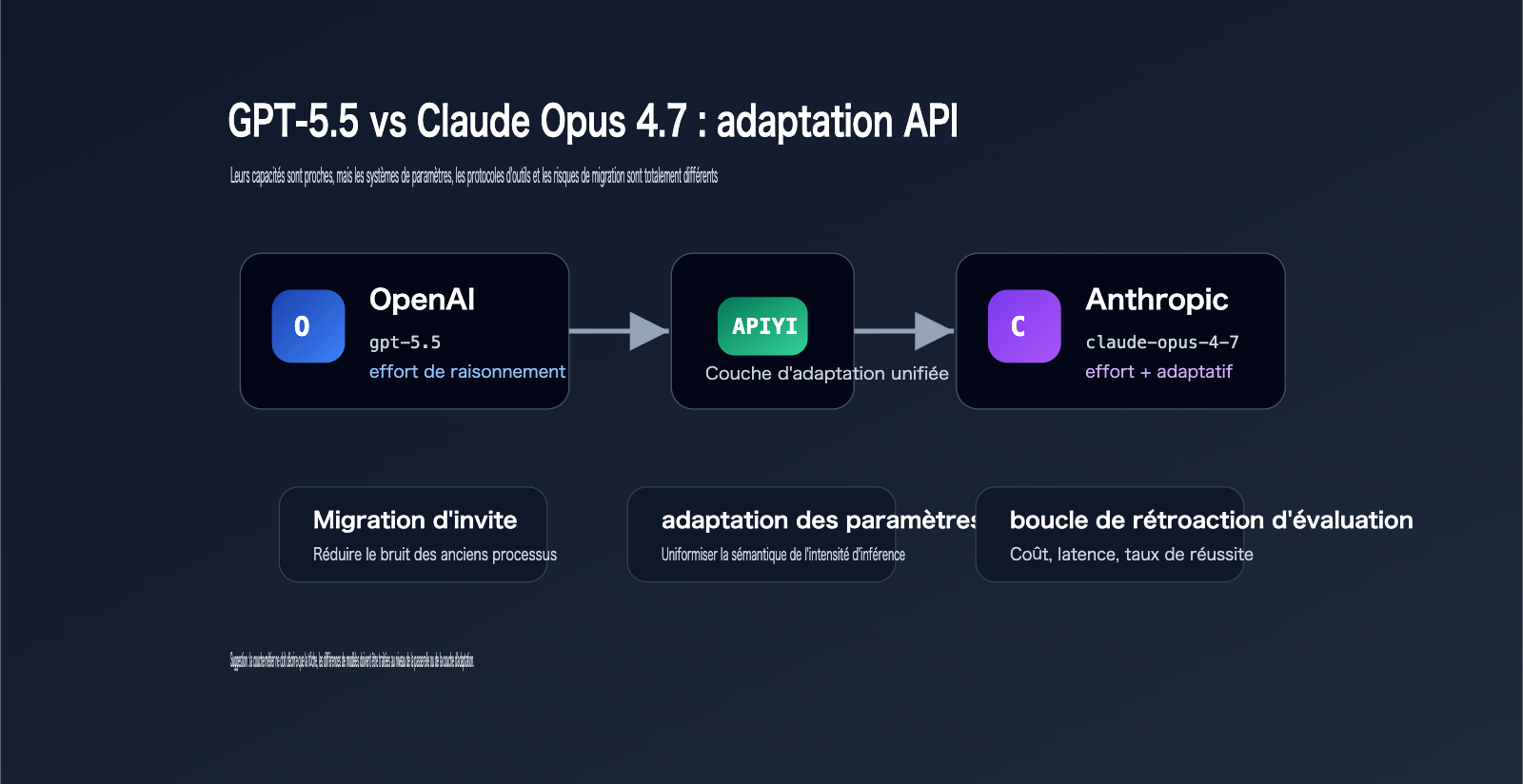

La migration entre l'API de GPT-5.5 et celle de Claude Opus 4.7 implique des changements significatifs.

GPT-5.5 s'inscrit dans l'écosystème OpenAI, avec des paramètres clés tels que model, reasoning_effort, l'appel d'outils via l'API Responses et le contrôle du format de sortie.

Claude Opus 4.7 appartient à l'écosystème Messages API d'Anthropic, où les paramètres essentiels incluent adaptive thinking, effort, task budget, max_tokens et l'appel d'outils.

La documentation officielle d'Anthropic indique que Claude Opus 4.7 a supprimé les budgets de réflexion étendus (extended thinking budgets).

L'ancienne syntaxe thinking: {"type": "enabled", "budget_tokens": N} renverra désormais une erreur 400.

La nouvelle approche consiste à utiliser thinking: {"type": "adaptive"} et à définir l'effort via output_config.

Anthropic précise également qu'à partir de Claude Opus 4.7, toute configuration de temperature, top_p ou top_k différente de la valeur par défaut entraînera une erreur 400.

Il s'agit d'un point de migration crucial pour de nombreux projets existants.

Si vous utilisiez auparavant temperature=0 pour garantir des sorties déterministes, sachez que cette valeur ne garantissait déjà pas une cohérence absolue.

En comparaison, la migration vers GPT-5.5 se concentre davantage sur la reconstruction des invites (prompts), l'évaluation du reasoning_effort, les flux de travail avec outils et les invites axées sur les résultats.

Points clés de la migration API : GPT-5.5 vs Claude Opus 4.7

| Élément de migration | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| ID du modèle | gpt-5.5 |

claude-opus-4-7 |

| Contrôle du raisonnement | reasoning_effort | effort + adaptive thinking |

| Longue fenêtre de contexte | 1M context window | 1M context window |

| Limite de sortie | Selon les spécifications API OpenAI | 128k max output |

| Paramètres de température | Configuration selon support API OpenAI | Erreur si température/top_p/top_k non par défaut |

| Flux de travail outils | Système d'outils Responses API | Système d'outils Messages API |

| Risques de migration | Spécification excessive dans les anciennes invites | Budget de réflexion et anciens paramètres d'échantillonnage |

Conseil : Si vous devez intégrer à la fois GPT-5.5 et Claude Opus 4.7, il est déconseillé de multiplier les logiques d'appel dans votre code métier. Vous pouvez utiliser APIYI (apiyi.com) pour disposer d'une passerelle compatible OpenAI, et gérer les différences de modèles, de paramètres et de gestion d'erreurs au niveau de la couche passerelle ou d'adaptation.

GPT-5.5 vs Claude Opus 4.7 : Choisir entre coût et performance

Le choix entre GPT-5.5 et Claude Opus 4.7 ne se résume pas à une simple comparaison des tarifs unitaires.

Selon les données officielles d'OpenAI, le prix de l'API GPT-5.5 est de 5 $ par million de jetons en entrée et de 30 $ par million de jetons en sortie.

De son côté, l'aperçu des modèles d'Anthropic indique que Claude Opus 4.7 coûte 5 $ par million de jetons en entrée et 25 $ par million de jetons en sortie.

Si l'on regarde uniquement le prix de sortie, Claude Opus 4.7 est plus avantageux.

Cependant, OpenAI souligne que GPT-5.5 est plus efficace en termes de jetons (token efficient) dans Codex que son prédécesseur, GPT-5.4.

Anthropic met également en avant la capacité de Claude Opus 4.7 à maîtriser ses coûts grâce à la gestion de l'effort, du budget de tâche et de la réflexion adaptative.

Le coût réel dépend donc de la nature de vos tâches.

Si GPT-5.5 parvient à accomplir une mission en moins d'étapes, son coût total ne sera pas nécessairement plus élevé.

À l'inverse, si Claude Opus 4.7 consomme massivement des jetons de sortie en mode « xhigh » ou « max effort », son coût total peut rapidement grimper.

L'évaluation des coûts doit se concentrer sur le « coût total pour accomplir une tâche conforme » plutôt que sur le prix unitaire par million de jetons.

Dimensions d'évaluation des coûts : GPT-5.5 vs Claude Opus 4.7

| Dimension de coût | Ce qu'il faut enregistrer | Pourquoi est-ce important ? |

|---|---|---|

| Jetons d'entrée | Invite, contexte, résultats d'outils | Écarts importants sur les tâches à long contexte |

| Jetons de sortie | Réponse finale, paramètres d'outils, réflexion | Le prix de sortie est généralement plus élevé |

| Nombre d'étapes | Nombre de tours nécessaires | Les cycles multiples multiplient les coûts |

| Taux de réussite | Réussite immédiate ou corrections répétées | Les échecs sont des coûts cachés |

| Latence | Temps d'attente utilisateur | Un effort élevé augmente le temps d'attente |

| Révision humaine | Besoin de correction manuelle | Une mauvaise qualité transfère les coûts |

Conseil : Pour les applications d'entreprise, l'optimisation des coûts ne consiste pas simplement à choisir le modèle le moins cher. Nous vous recommandons d'utiliser APIYI (apiyi.com) pour enregistrer les entrées, sorties, latences, modèles, paramètres et scores humains de chaque invocation, afin d'utiliser le « coût par tâche conforme » comme indicateur final.

Décision sur les cas d'usage : GPT-5.5 vs Claude Opus 4.7

Si vous êtes un développeur indépendant, le choix entre GPT-5.5 et Claude Opus 4.7 peut se faire en fonction de votre écosystème d'outils.

Si vous utilisez régulièrement Codex, commencez par tester GPT-5.5.

Si vous utilisez Claude Code, privilégiez Claude Opus 4.7.

Si vous êtes responsable technique en entreprise, ne prenez pas de décision basée uniquement sur une expérience personnelle.

Vous devriez établir un jeu de tâches de référence et comparer les deux modèles au sein d'un même cadre d'entrée, de sortie, de notation et de suivi des coûts.

Pour les équipes de création de contenu, GPT-5.5 mérite d'être testé en priorité pour le contenu structuré, la recherche et synthèse, les tableaux et le travail multi-outils.

Claude Opus 4.7 est à privilégier pour les expressions nuancées, les contextes longs, l'analyse de documents visuels et la vérification de fichiers.

Si vous gérez une plateforme API ou un produit SaaS, nous vous conseillons de mettre en place un routage de modèles.

Par exemple, dirigez les questions simples vers des modèles moins coûteux, et réservez l'invocation du modèle GPT-5.5 ou Claude Opus 4.7 pour le code complexe et les tâches d'agent avancées.

Cela permet d'éviter que toutes les requêtes ne soient traitées par les modèles phares, optimisant ainsi vos ressources.

Liste de contrôle pour la migration : GPT-5.5 vs Claude Opus 4.7

Ne vous contentez pas d'une simple évaluation subjective avant la mise en production.

Il est recommandé de préparer au moins 5 types d'échantillons :

- Échantillons de réussite : Cas où le modèle fonctionne parfaitement.

- Échantillons limites : Cas complexes ou ambigus propices aux erreurs.

- Échantillons à longue fenêtre de contexte : Pour tester la rétention d'informations.

- Échantillons d'invocation d'outils : Pour vérifier la précision des appels de fonctions.

- Échantillons de récupération après échec : Pour tester la résilience du système.

Pour chaque échantillon, enregistrez le modèle, les paramètres, les jetons d'entrée, les jetons de sortie, le temps de latence, le taux de réussite au premier essai et la note humaine.

Testez également les paliers à faible coût et les paliers à haute performance.

Côté GPT-5.5, vous pouvez tester différents reasoning_effort.

Côté Claude Opus 4.7, vous pouvez tester les niveaux medium, high, xhigh et max effort.

Ne réglez pas systématiquement les deux modèles sur leur configuration maximale. La configuration maximale indique la limite supérieure, mais ne garantit pas le meilleur rapport coût-efficacité en production.

Comment interpréter les données d'évaluation entre GPT-5.5 et Claude Opus 4.7 ?

Les benchmarks publics pour GPT-5.5 et Claude Opus 4.7 sont utiles, mais ne reflètent pas directement vos résultats métier.

La raison est simple : les évaluations publiques utilisent des ensembles de tâches, des invites, des environnements d'exécution et des règles de notation fixes.

Votre système métier, lui, sera confronté à des données bruitées, des manques de contexte, des expressions utilisateurs instables, des échecs d'outils, des restrictions d'accès et le poids des invites historiques.

Par conséquent, voir GPT-5.5 dominer un benchmark ne signifie pas que toutes vos tâches doivent basculer vers GPT-5.5. De même, si Claude Opus 4.7 est en tête sur un autre test, cela ne signifie pas qu'il faut tout migrer vers Claude.

La méthode la plus prudente consiste à utiliser les benchmarks officiels comme des indicateurs de la direction des capacités des modèles.

Par exemple :

- Terminal-Bench 2.0 est plus représentatif des flux de travail complexes en ligne de commande.

- SWE-Bench Pro se rapproche davantage de la résolution réelle d'issues GitHub.

- GDPval est plus proche de la capacité à fournir des livrables basés sur des connaissances professionnelles.

- Les benchmarks visuels et la prise en charge des images haute résolution sont plus adaptés pour évaluer les captures d'écran, les graphiques, l'interface utilisateur et la mise en page de documents.

Lors du déploiement, vous devez mapper ces dimensions à vos propres scénarios produits :

- Si votre produit est un assistant de codage IDE, privilégiez le taux de réussite des corrections de code, le taux de réussite des tests, le taux de modifications non pertinentes et la qualité des explications.

- Si votre produit est une base de connaissances d'entreprise, privilégiez la précision des citations, le taux d'omission de faits, la gestion des conflits et les limites de refus de réponse.

- Si votre produit est un agent automatisé, privilégiez le nombre d'invocations d'outils, la récupération après échec, le taux d'achèvement des tâches et le coût total.

- Si votre produit traite des documents visuels, privilégiez la reconnaissance des coordonnées, la transcription de graphiques, la compréhension de la mise en page et le coût de correction humaine.

La valeur d'APIYI (apiyi.com) réside dans la possibilité d'exécuter ces tests de modèles via une interface unifiée. Avec les mêmes entrées, les mêmes dimensions de notation et les mêmes champs de journalisation, les conclusions comparatives entre GPT-5.5 et Claude Opus 4.7 deviennent réellement exploitables.

FAQ : GPT-5.5 vs Claude Opus 4.7

Qui de GPT-5.5 ou Claude Opus 4.7 est le plus adapté pour le développement ?

Les deux sont excellents.

GPT-5.5 est plus performant sur Terminal-Bench 2.0, ce qui le rend idéal pour les processus complexes en ligne de commande et les flux de travail Codex.

Claude Opus 4.7 affiche des résultats impressionnants sur SWE-Bench Pro et se prête parfaitement aux tâches d'agent de longue durée avec Claude Code.

Pour vos projets réels, nous vous conseillons de réaliser des tests comparatifs en utilisant le même ensemble d'issues et de commandes de test.

Qui de GPT-5.5 ou Claude Opus 4.7 est le plus adapté pour les bases de connaissances ?

Si votre priorité est la génération structurée et l'organisation via de multiples outils, testez GPT-5.5 en priorité.

Si vous privilégiez l'identification des données manquantes, la prudence dans les réponses et la rigueur sur les longues fenêtres de contexte, testez plutôt Claude Opus 4.7.

Le choix final doit reposer sur la précision des citations et le coût de la relecture humaine.

Qui de GPT-5.5 ou Claude Opus 4.7 est le plus adapté aux tâches visuelles ?

Claude Opus 4.7 intègre officiellement le support des images haute résolution dans sa documentation.

Si vos tâches impliquent des captures d'écran, des coordonnées, la mise en page de documents ou de la vérification visuelle, Claude Opus 4.7 mérite d'être testé en premier.

GPT-5.5 est également performant pour les flux de travail multimodal, mais les tâches visuelles intensives nécessitent une évaluation spécifique.

Qui de GPT-5.5 ou Claude Opus 4.7 est le plus économique ?

Selon les tarifs officiels, le coût d'entrée est de 5 $ par million de tokens pour les deux modèles.

Le coût de sortie pour Claude Opus 4.7 est de 25 $ par million de tokens, contre 30 $ pour GPT-5.5.

Cependant, le coût réel dépendra du nombre de tours nécessaires pour accomplir la tâche, de la longueur de la sortie, du taux d'échec et des coûts de correction humaine.

Résumé : GPT-5.5 vs Claude Opus 4.7

Il n'existe pas de réponse universelle pour départager GPT-5.5 et Claude Opus 4.7.

GPT-5.5 est plus adapté aux flux de travail de production multi-outils, au codage Codex, à la génération de tableaux, au travail intellectuel et à l'exécution de tâches complexes.

Claude Opus 4.7 excelle dans la vision haute résolution, les tâches d'agent longue durée, le respect strict des instructions, la mémorisation de fichiers et le traitement prudent des données.

Si vous êtes un utilisateur individuel, choisissez en fonction de l'écosystème d'outils que vous utilisez habituellement.

Si vous êtes une entreprise, vous devez impérativement effectuer des tests sur des échantillons réels.

Si vous êtes un développeur API, nous vous recommandons de gérer les différences entre les modèles au niveau d'une couche d'adaptation, sans lier strictement GPT-5.5 ou Claude Opus 4.7 à votre logique métier.

APIYI (apiyi.com) est idéal pour servir de point d'entrée unifié, gérer l'historique des invocations du modèle, surveiller les coûts et faciliter le basculement entre différents modèles.

En résumé : utilisez GPT-5.5 pour les tâches complexes multi-outils, Claude Opus 4.7 pour la vision de haute précision et les agents longue durée, et des modèles à faible coût pour les requêtes courantes, tout en ajustant votre routage en fonction des données d'évaluation.

Références :

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort