تعد المقارنة بين GPT-5.5 وClaude Opus 4.7 واحدة من أكثر المواضيع التي تهم المطورين في النصف الأول من عام 2026.

كلا النموذجين ليسا مجرد نماذج دردشة تقليدية.

يركز GPT-5.5 بشكل أكبر على البرمجة الوكيلة (agentic coding)، واستخدام الحاسوب، والأعمال المعرفية، والتحليل العلمي.

بينما يركز Claude Opus 4.7 على الاستنتاج المعقد، ومهام الوكيل طويلة الأمد، والرؤية عالية الدقة، وقدرات الذاكرة، والالتزام الصارم بالتعليمات.

إذا سألت "أيهما أقوى؟"، فستكون الإجابة سطحية للغاية.

السؤال الأكثر عملية هو: هل مهمتك تتعلق بإصلاح الأكواد، أو الإجابة على الأسئلة من قواعد المعرفة، أو تحليل السياقات الطويلة، أو الفهم البصري، أو الأتمتة الوكيلة، أم استدعاءات API ذات تكلفة عالية؟

سيختلف اختيارك بين GPT-5.5 وClaude Opus 4.7 بشكل كبير بناءً على المهمة المطلوبة.

عندما أطلقت OpenAI نموذج GPT-5.5 رسميًا، قامت بإدراج Claude Opus 4.7 مباشرة في جداول التقييم المتعددة.

كما قامت Anthropic بتصنيف Claude Opus 4.7 كأقوى نموذج متاح لديها للاستخدام العام، مؤكدة على تحسيناته في البرمجة الوكيلة، والأعمال المعرفية، والمهام البصرية، ومهام الذاكرة.

تستند هذه المقالة إلى المصادر الرسمية باللغة الإنجليزية، ولا تعتمد على مصادر ثانوية.

تجدر الإشارة إلى أن "Claude 4.7" المذكور هنا يشير تحديدًا إلى Claude Opus 4.7.

حتى وقت كتابة هذا المقال، لا تشير المصادر الرسمية لشركة Anthropic إلى إصدار Claude Sonnet 4.7.

الاستنتاج الجوهري للمقارنة بين GPT-5.5 و Claude Opus 4.7

يكمن الاختلاف الأساسي بين GPT-5.5 و Claude Opus 4.7 في تحديد موقع كل نموذج.

تُعرّف OpenAI نموذج GPT-5.5 بأنه أكثر ملاءمة لسير العمل الحقيقي، حيث يركز على البرمجة، وتصحيح الأخطاء، والبحث عبر الإنترنت، وتحليل البيانات، وتوليد المستندات والجداول، وإنجاز المهام عبر أدوات متعددة.

بينما تُعرّف Anthropic نموذج Claude Opus 4.7 بأنه أقوى نموذج عام متاح لديها، مع التركيز على الاستنتاج المعقد، والبرمجة الوكيلة، والمهام طويلة الأمد، والفهم البصري، وقدرات الذاكرة، والتحقق الذاتي.

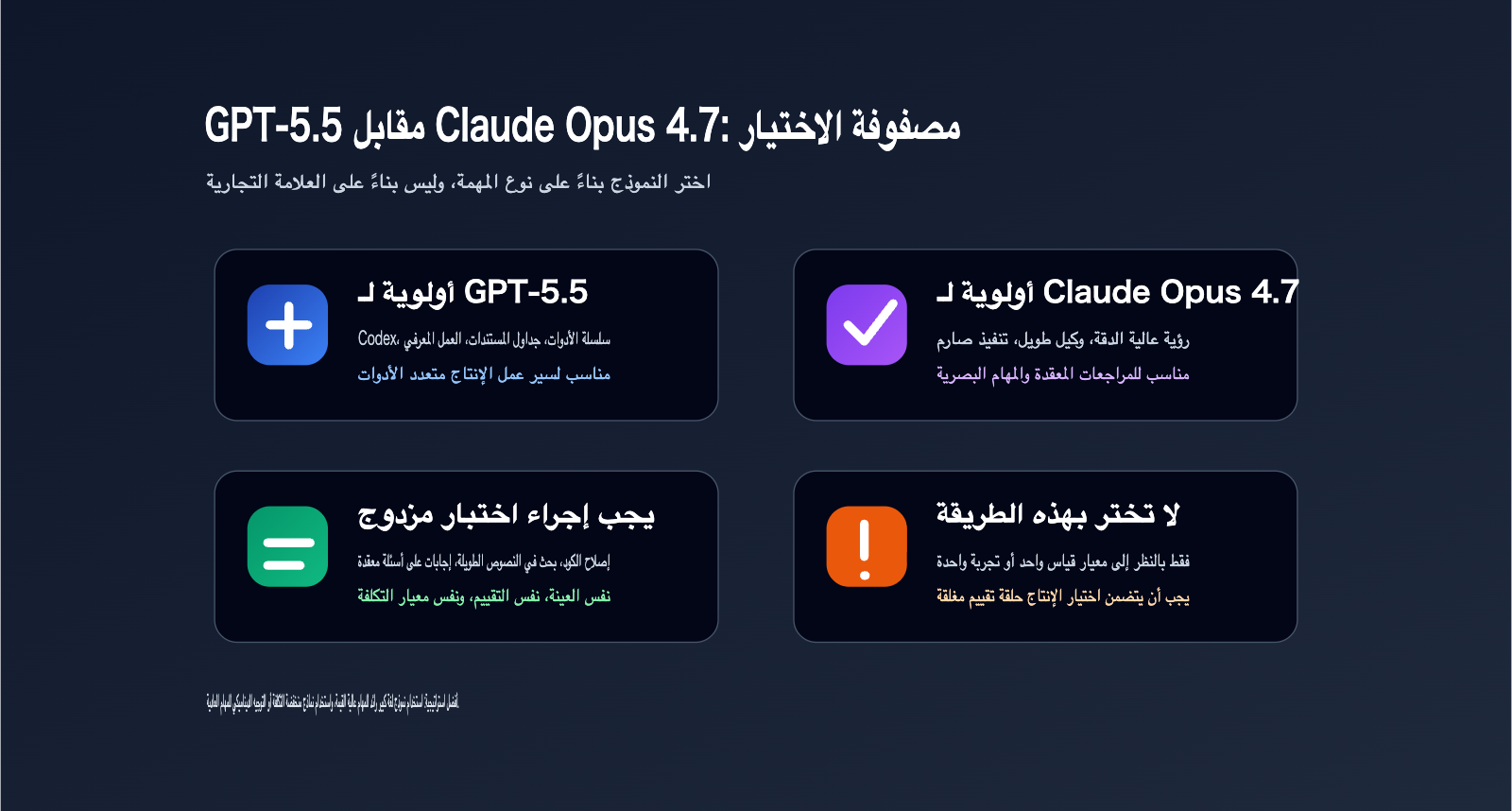

إذا كانت مهمتك تتعلق بمشاريع هندسية معقدة، أو تعديلات عبر ملفات متعددة، أو استدعاء الأدوات والأعمال المعرفية، فغالبًا ما يكون GPT-5.5 هو الأكثر استحقاقًا للاختبار أولاً.

أما إذا كانت مهمتك تتعلق بالوكلاء طويلي الأمد (Claude Code)، أو فهم لقطات الشاشة، أو التحقق من تنسيق المستندات، أو ذاكرة نظام الملفات، والالتزام الصارم بالتعليمات، فإن Claude Opus 4.7 يستحق الأولوية في الاختبار.

إذا كنت بحاجة إلى دمج كلا النوعين من النماذج، فنوصي باستخدام خدمة وكيل API من APIYI (apiyi.com) لتوجيه وتقييم النماذج المتعددة، لتجنب ربط اختيار النموذج بشكل ثابت داخل كود العمل الخاص بك.

مقارنة سريعة بين GPT-5.5 و Claude Opus 4.7

| البعد | GPT-5.5 | Claude Opus 4.7 | نصيحة الاختيار |

|---|---|---|---|

| التموضع الرسمي | سير العمل الحقيقي والذكاء الاصطناعي الوكيل | أقوى نموذج Claude متاح | اختر بناءً على نوع المهمة |

| قدرات البرمجة | أداء قوي في Terminal-Bench 2.0 | تحسن ملحوظ في البرمجة الوكيلة | كلاهما يستحق الاختبار |

| السياق الطويل | نافذة سياق تصل إلى 1M عبر API | نافذة سياق 1M | كلاهما مناسب للسياق الطويل |

| القدرات البصرية | تعاون متعدد الوسائط مع الأدوات | دعم للصور عالية الدقة | المهام البصرية الثقيلة تفضل Claude |

| التحكم في الاستنتاج | reasoning_effort | effort / adaptive thinking | أنظمة معلمات مختلفة |

| تكلفة API | 5$ للإدخال / 30$ للإخراج لكل مليون توكن | 5$ للإدخال / 25$ للإخراج لكل مليون توكن | سعر إخراج Claude أقل |

| مدخلات النظام | ChatGPT, Codex, API | Claude, Claude Code, API | يعتمد على سير العمل |

نصيحة الاختيار: إذا لم تتمكن من تحديد أيهما أنسب لمهمتك بين GPT-5.5 و Claude Opus 4.7، ننصحك بإعداد 30-50 عينة عمل حقيقية، وتشغيل كلا النموذجين عبر APIYI (apiyi.com) في وقت واحد، ومقارنة معدل النجاح، ووقت الاستجابة، والتكلفة، والتقييم البشري.

مقارنة قدرات البرمجة بين GPT-5.5 و Claude Opus 4.7

تعد البرمجة ساحة المنافسة الأكثر أهمية بين GPT-5.5 و Claude Opus 4.7.

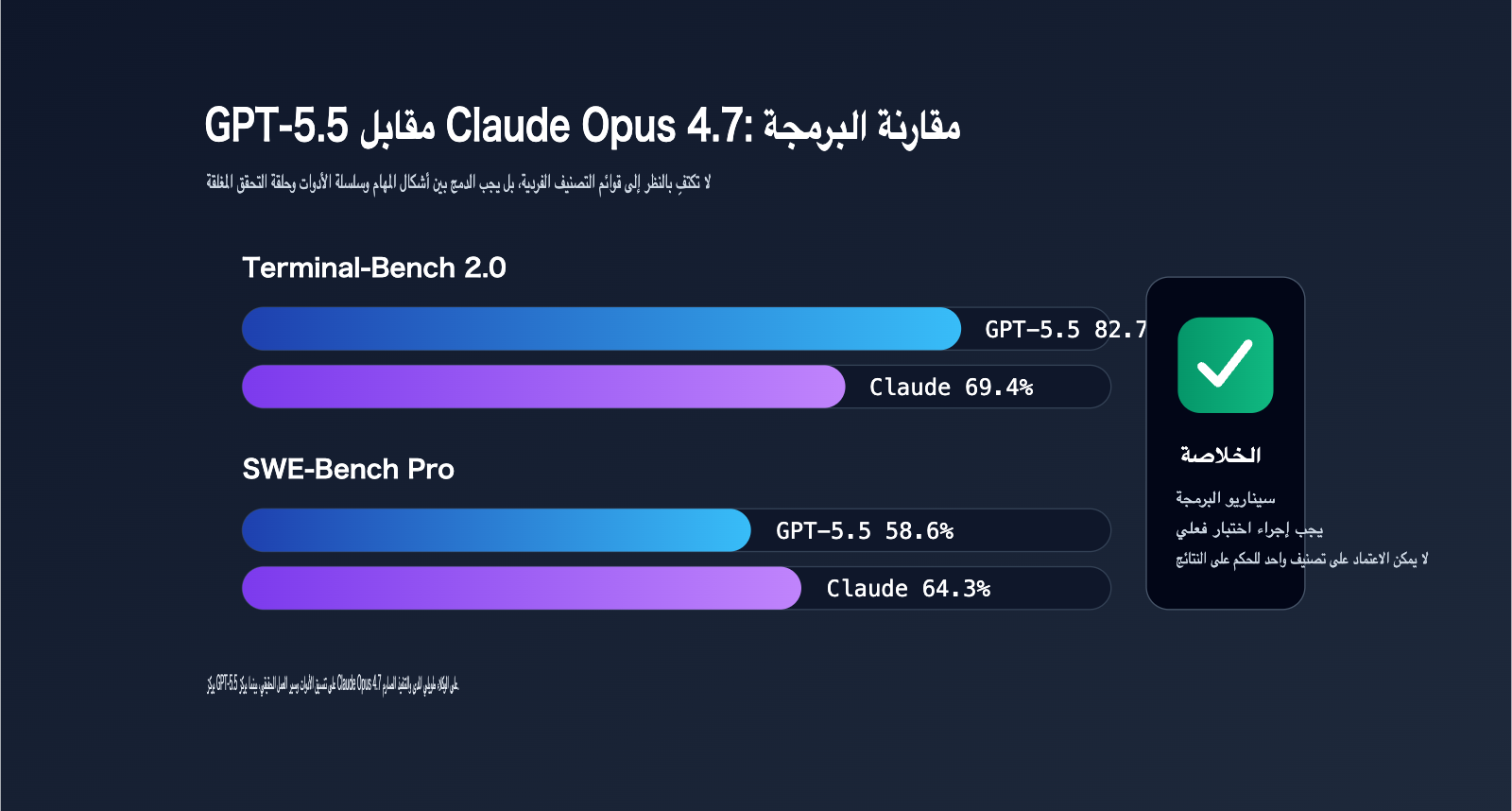

وفقاً للبيانات الرسمية من OpenAI، حقق GPT-5.5 نسبة 82.7% في اختبار Terminal-Bench 2.0.

وفي الجدول نفسه، سجل Claude Opus 4.7 نسبة 69.4%.

أما في التقييم العام لـ SWE-Bench Pro، فقد سجل GPT-5.5 نسبة 58.6%، بينما تفوق Claude Opus 4.7 بنسبة 64.3%.

هذا يشير إلى أن أياً من النموذجين لا يتفوق بشكل مطلق على الآخر.

يتميز GPT-5.5 بأداء أقوى في سير العمل المعقد عبر سطر الأوامر، والتخطيط، والتكرار، وتنسيق الأدوات.

بينما يمتلك Claude Opus 4.7 قدرة تنافسية عالية في المهام المتعلقة بحل مشكلات GitHub.

كما تؤكد المواد الرسمية لشركة Anthropic أن Claude Opus 4.7 حقق تحسناً بنسبة 13% مقارنة بـ Opus 4.6 في معيار البرمجة المكون من 93 مهمة، مما يعني أن التطور في قدرات البرمجة لدى Claude Opus 4.7 مقارنة بالجيل السابق واضح وملموس.

ومع ذلك، عند المقارنة بين GPT-5.5 و Claude Opus 4.7، لا ينبغي اعتبار معيار واحد (Benchmark) بمثابة النتيجة النهائية.

فالعمل البرمجي الحقيقي يتضمن أيضاً: فهم الكود القديم، تحديد المخاطر، التحكم في نطاق التغييرات، إكمال الاختبارات، تشغيل الأوامر، التعامل مع الإخفاقات، شرح التغييرات، وإنشاء ملاحظات المراجعة.

يركز GPT-5.5 في سيناريوهات Codex على التنفيذ عبر الأدوات المختلفة وإنجاز المهام بعدد أقل من الرموز (Tokens).

بينما يركز Claude Opus 4.7 في سيناريوهات Claude Code على الوكلاء طويلي الأمد (Long-horizon agents)، والجهد العالي (xhigh effort)، والالتزام الصارم بالتعليمات.

توصيات لسيناريوهات البرمجة بين GPT-5.5 و Claude Opus 4.7

| مهمة البرمجة | النموذج الموصى بتجربته أولاً | السبب |

|---|---|---|

| سير عمل سطر الأوامر المعقد | GPT-5.5 | درجة رسمية أعلى في Terminal-Bench 2.0 |

| إصلاح مشكلات GitHub | كلاهما (Claude & GPT) | Claude يتفوق في SWE-Bench، وGPT يمتلك نظاماً بيئياً قوياً |

| فهم قواعد الكود الضخمة | GPT-5.5 | سيناريو Codex يركز على السياق عبر الأنظمة |

| مهام الوكيل طويلة الأمد | Claude Opus 4.7 | يتوافق بشكل أفضل مع الجهد العالي وميزانية المهام |

| مراجعة الكود والتحقق | كلاهما مناسب | التركيز على دورة الاختبار المغلقة |

| الإصلاحات الجماعية الحساسة للتكلفة | يتطلب اختباراً فعلياً | اختلافات كبيرة في استهلاك الرموز (Tokens) |

نصيحة للاختيار: لا تعتمد فقط على قوائم التصنيف عند اختيار نموذج للبرمجة. نوصي بإدخال مشكلاتك الحقيقية، والاختبارات الفاشلة، ومراجعات PR، ومهام إعادة الهيكلة في منصة APIYI (apiyi.com) لإجراء تقييم مقارن، وتسجيل ما إذا كان النموذج قد قام فعلياً بتشغيل الاختبارات، أو أجرى تعديلات خاطئة على ملفات غير ذات صلة، أو كان قادراً على توضيح المخاطر.

قدرات العمل المعرفي والبحثي بين GPT-5.5 و Claude Opus 4.7

تعد المقارنة بين GPT-5.5 و Claude Opus 4.7 في مجال العمل المعرفي أمراً بالغ الأهمية أيضاً.

تشير المواد الرسمية لشركة OpenAI إلى أن GPT-5.5 حقق نسبة 84.9% في اختبار GDPval، بينما سجل Claude Opus 4.7 نسبة 80.3% في الجدول نفسه، وحقق GPT-5.5 Pro نسبة 82.3%. هذا يدل على قوة أداء GPT-5.5 في تقييمات العمل المعرفي المتخصص.

كما تؤكد OpenAI أن GPT-5.5 شهد تحسناً ملحوظاً في إنشاء المستندات، والجداول، والعروض التقديمية، ومعالجة البحوث التشغيلية والمدخلات التجارية.

من جانب Anthropic، تؤكد المواد الرسمية لـ Claude Opus 4.7 على تميزه في العمل المعرفي، والذاكرة، والرؤية، والعمل الوكيل طويل الأمد. ومن أهم مميزات Claude Opus 4.7 هو انضباطه العالي في التعامل مع البيانات؛ حيث تشير تقييمات (Hex) إلى أنه يفضل التصريح بوضوح عند فقدان البيانات بدلاً من تقديم بدائل تبدو منطقية ولكنها خاطئة، وهو أمر حيوي للتحليل المالي، والتقارير البحثية، ومراجعات الامتثال، ومعالجة جداول البيانات.

إذا كانت مهام عملك المعرفي تتطلب إنشاء مستندات أعمال جميلة وكاملة وذات هيكل واضح، فإن GPT-5.5 يستحق التجربة بالتأكيد. أما إذا كانت مهامك تتطلب من النموذج الحذر في التعامل مع البيانات المفقودة أو المتضاربة أو ضمن سياقات طويلة، فإن Claude Opus 4.7 منافس قوي جداً.

اختيار النموذج للعمل المعرفي بين GPT-5.5 و Claude Opus 4.7

| السيناريو | ميزة GPT-5.5 | ميزة Claude Opus 4.7 | التوصية |

|---|---|---|---|

| تقارير الأعمال | إنشاء هيكلي قوي | انضباط بيانات عالٍ | قارن بينهما |

| تحليل الجداول | قدرة قوية في مستندات Codex | تحليل بصري ورسوم بيانية دقيق | يعتمد على شكل المدخلات |

| البحوث المالية | أداء قوي في GDPval | تحسينات في وحدة التمويل العام | اختبر بعينات حقيقية |

| مراجعة الامتثال | قدرة شاملة قوية | حذر في معالجة البيانات المفقودة | جرب Claude أولاً |

| تلخيص مستندات متعددة | سياق طويل قوي | ذاكرة وتعليمات صارمة | اختر بناءً على جودة المراجع |

نصيحة للاختيار: أكبر مخاوف العمل المعرفي هو أن تبدو النتيجة "كاملة ظاهرياً ولكنها تحتوي على هلوسات". عند إجراء مقارنة بين GPT-5.5 و Claude Opus 4.7 على منصة APIYI (apiyi.com)، نوصي بتقسيم التقييم البشري إلى 5 أبعاد: دقة الحقائق، اتساق المراجع، معدل الإغفال، جودة الهيكل، والقابلية للتنفيذ.

مقارنة بين GPT-5.5 و Claude Opus 4.7: القدرات البصرية والسياق الطويل

يدعم كل من GPT-5.5 و Claude Opus 4.7 سياقاً طويلاً، لكن مع وجود اختلافات في التفاصيل.

تشير المواد الرسمية من OpenAI إلى أن واجهة برمجة تطبيقات (API) الخاصة بـ GPT-5.5 توفر نافذة سياق بحجم 1 مليون رمز (tokens).

كما يوضح نظرة عامة على نماذج Anthropic أن Claude Opus 4.7 يدعم أيضاً نافذة سياق بحجم 1 مليون رمز، مع دعم يصل إلى 128 ألف رمز للمخرجات القصوى.

في مهام السياق الطويل، دخل كلا النموذجين نطاق القدرة على معالجة المستندات الضخمة، وقواعد الأكواد البرمجية، وحزم البيانات المعقدة.

ولكن فيما يتعلق بالمهام البصرية، فإن التغييرات الرسمية في Claude Opus 4.7 أكثر وضوحاً.

تُظهر وثائق Anthropic أن Claude Opus 4.7 هو أول نموذج من Claude يدعم الصور عالية الدقة، حيث تمت زيادة الحد الأقصى لدقة الصورة إلى 2576 بكسل / 3.75 ميجابكسل.

يعد هذا أمراً مهماً لفهم لقطات الشاشة، وصور المستندات، والتحقق من العروض التقديمية، وتحليل الرسوم البيانية، واستخدام الحاسوب (computer use).

كما ذكرت Anthropic أن إحداثيات الصورة تتوافق الآن مع البكسلات الحقيقية بنسبة 1:1، مما يقلل من الحاجة إلى عمليات تحويل وتوسيع الإحداثيات.

يمتلك GPT-5.5 أيضاً قدرات قوية في تعدد الوسائط واستخدام الحاسوب، ولكن إذا كان جوهر مدخلاتك يعتمد على لقطات شاشة عالية الدقة، أو رسوم بيانية، أو تنسيقات مستندات، أو إحداثيات واجهة المستخدم (UI)، فإن Claude Opus 4.7 يستحق الأولوية في الاختبار.

أما إذا كانت مدخلاتك عبارة عن نصوص طويلة، أو قواعد أكواد برمجية، أو مستندات أعمال، أو بيانات مهيكلة، أو نتائج سلاسل أدوات، فمن الضروري تقييم كل من GPT-5.5 و Claude Opus 4.7 باستخدام نفس مجموعة العينات.

مقارنة بين GPT-5.5 و Claude Opus 4.7: معايير API واختلافات الترحيل

تعد اختلافات الترحيل بين واجهات برمجة التطبيقات لـ GPT-5.5 و Claude Opus 4.7 كبيرة جداً.

ينتمي GPT-5.5 إلى نظام نماذج OpenAI، وتشمل معاييره الرئيسية: model، و reasoning_effort، واستدعاء أدوات Responses API، والتحكم في تنسيق المخرجات.

بينما ينتمي Claude Opus 4.7 إلى نظام Anthropic Messages API، وتشمل معاييره الرئيسية: adaptive thinking، و effort، و task budget، و max_tokens، واستدعاء الأدوات.

تُظهر وثائق Anthropic الرسمية أن Claude Opus 4.7 قد أزال ميزانيات التفكير الموسعة (extended thinking budgets).

الصيغة القديمة thinking: {"type": "enabled", "budget_tokens": N} ستؤدي إلى خطأ 400.

يجب استخدام الصيغة الجديدة thinking: {"type": "adaptive"}، وتعيين الجهد (effort) من خلال output_config.

كما أوضحت Anthropic أنه بدءاً من Claude Opus 4.7، فإن تعيين قيم غير افتراضية لـ temperature أو top_p أو top_k سيؤدي إلى خطأ 400.

تعد هذه نقطة ترحيل مهمة للعديد من المشاريع القديمة.

إذا كنت تعتمد سابقاً على temperature=0 للحصول على مخرجات حتمية، فأنت بحاجة إلى إعادة فهم الأمر: فـ temperature=0 لم تكن تضمن التطابق التام في الأصل.

في المقابل، يركز ترحيل GPT-5.5 بشكل أكبر على إعادة بناء الموجه (Prompt)، وتقييم reasoning_effort، وسير عمل الأدوات، والموجهات التي تعطي الأولوية للنتائج.

نقاط الترحيل الرئيسية بين GPT-5.5 و Claude Opus 4.7

| عنصر الترحيل | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| معرف النموذج | gpt-5.5 |

claude-opus-4-7 |

| التحكم في الاستدلال | reasoning_effort | effort + adaptive thinking |

| السياق الطويل | 1M context window | 1M context window |

| الحد الأقصى للمخرجات | حسب مواصفات OpenAI API | 128k max output |

| معايير الحرارة | تُضبط حسب دعم OpenAI API | القيم غير الافتراضية لـ temperature/top_p/top_k تسبب خطأ |

| سير عمل الأدوات | نظام أدوات Responses API | نظام أدوات Messages API |

| مخاطر الترحيل | التحديد المفرط في الموجهات القديمة | ميزانية التفكير ومعايير أخذ العينات القديمة |

نصيحة للاختيار: إذا كنت بحاجة إلى دمج كل من GPT-5.5 و Claude Opus 4.7، فلا يُنصح بكتابة مجموعتين منفصلتين من منطق الاستدعاء في كود العمل الخاص بك. يمكنك استخدام خدمة وكيل API مثل APIYI (apiyi.com) لتوفير مدخل متوافق وموحد مع OpenAI، ثم إدارة اختلافات النماذج والمعايير ومعالجة الأخطاء في طبقة البوابة (Gateway) أو طبقة التكيف.

مقارنة التكلفة والأداء بين GPT-5.5 و Claude Opus 4.7

لا يمكن تقييم تكلفة استخدام GPT-5.5 مقابل Claude Opus 4.7 بالنظر إلى سعر الوحدة فقط.

وفقاً للبيانات الرسمية من OpenAI، يبلغ سعر API الخاص بـ GPT-5.5 خمسة دولارات لكل مليون رمز (token) للمدخلات، و30 دولاراً لكل مليون رمز للمخرجات.

بينما تظهر نظرة عامة على نماذج Anthropic أن سعر Claude Opus 4.7 هو 5 دولارات لكل مليون رمز للمدخلات، و25 دولاراً لكل مليون رمز للمخرجات.

بالنظر إلى سعر المخرجات فقط، يبدو أن Claude Opus 4.7 أقل تكلفة.

ومع ذلك، تؤكد OpenAI أن GPT-5.5 أكثر كفاءة في استهلاك الرموز (token efficient) ضمن بيئة Codex مقارنة بـ GPT-5.4.

كما تؤكد Anthropic أن Claude Opus 4.7 يتحكم في التكاليف من خلال ميزات الجهد (effort)، وميزانية المهام (task budget)، والتفكير التكيفي (adaptive thinking).

لذا، تعتمد التكلفة الحقيقية على طبيعة المهمة:

- إذا تمكن GPT-5.5 من إنجاز المهمة في عدد أقل من الجولات، فقد لا تكون تكلفته الإجمالية أعلى.

- إذا استهلك Claude Opus 4.7 عدداً كبيراً من رموز المخرجات في مستويات الجهد العالي (xhigh أو max effort)، فقد ترتفع تكلفته الإجمالية أيضاً.

يجب أن يركز تقييم التكلفة على "التكلفة الإجمالية لإنجاز مهمة مقبولة"، وليس فقط على سعر المليون رمز.

أبعاد تقييم التكلفة بين GPT-5.5 و Claude Opus 4.7

| بُعد التكلفة | ما يجب تسجيله | لماذا هو مهم؟ |

|---|---|---|

| رموز المدخلات | الموجه (Prompt)، السياق، نتائج الأدوات | تظهر فروق كبيرة في مهام السياق الطويل |

| رموز المخرجات | الإجابة النهائية، معاملات الأدوات، مخرجات الاستنتاج | عادة ما تكون أسعار المخرجات أغلى |

| الجولات | عدد الجولات المطلوبة لإتمام المهمة | الجولات المتعددة تضاعف التكلفة |

| معدل النجاح | الإنجاز من المرة الأولى أم الحاجة للتصحيح | إعادة المحاولة عند الفشل تكلفة خفية |

| التأخير (Latency) | وقت انتظار المستخدم | الجهد العالي يزيد من وقت الانتظار |

| المراجعة البشرية | الحاجة لتصحيح بشري | الجودة المنخفضة تنقل التكلفة إلى البشر |

نصيحة للاختيار: بالنسبة لتطبيقات الشركات، لا يقتصر تحسين تكلفة نموذج اللغة الكبير على اختيار النموذج الأرخص. نوصي باستخدام APIYI (apiyi.com) لتسجيل المدخلات والمخرجات، والتأخير، والنموذج المستخدم، والمعاملات، والتقييم البشري لكل استدعاء، واعتماد "تكلفة المهمة المقبولة" كمؤشر نهائي.

اتخاذ القرار بشأن سيناريوهات الاستخدام

إذا كنت مطوراً فردياً، يمكنك اختيار GPT-5.5 أو Claude Opus 4.7 بناءً على منظومة الأدوات التي تفضلها:

- إذا كنت تستخدم Codex بشكل متكرر، فابدأ باختبار GPT-5.5.

- إذا كنت تستخدم Claude Code، فابدأ باختبار Claude Opus 4.7.

أما إذا كنت مسؤولاً تقنياً في شركة، فلا يُنصح باتخاذ القرار بناءً على التجربة الشخصية فقط.

يجب عليك بناء مجموعة مهام (task set) ومقارنة النموذجين ضمن نفس بيئة المدخلات والمخرجات والتقييم وتسجيل التكاليف.

- إذا كنت تعمل ضمن فريق محتوى، فإن GPT-5.5 يستحق الأولوية في الاختبار للمحتوى المهيكل، والبحث والتلخيص، والجداول، والعمليات متعددة الأدوات.

- بينما يستحق Claude Opus 4.7 الأولوية في الاختبار للمهام التي تتطلب دقة في التعبير، والسياق الطويل، والمواد البصرية، والتحقق من الملفات.

إذا كنت تدير منصة API أو منتج SaaS، فنحن نقترح تطبيق "توجيه النماذج" (model routing).

على سبيل المثال، يمكن توجيه الأسئلة العامة إلى نماذج أقل تكلفة، بينما يتم ترقية المهام البرمجية المعقدة ومهام الوكيل (agent) الطويلة إلى GPT-5.5 أو Claude Opus 4.7. هذا يمنع توجيه كافة الطلبات إلى النماذج الرائدة (Flagship models) ويحسن كفاءة التكلفة.

قائمة التحقق من الترحيل: GPT-5.5 مقابل Claude Opus 4.7

لا تكتفِ بتجربة ذاتية واحدة قبل الإطلاق.

يُنصح بإعداد 5 فئات من العينات على الأقل:

- عينات النجاح: الحالات التي تعمل فيها النماذج بشكل مثالي.

- عينات الحدود: الحالات التي يسهل فيها حدوث خطأ في التقدير.

- عينات السياق الطويل: اختبار قدرة النموذج على التعامل مع مدخلات ضخمة.

- عينات استدعاء الأدوات: اختبار دقة تنفيذ المهام الخارجية.

- عينات استعادة الفشل: اختبار قدرة النموذج على التصحيح الذاتي عند حدوث خطأ.

يجب تسجيل كل عينة مع تحديد النموذج، المعاملات (Parameters)، عدد الرموز (Tokens) المدخلة والمخرجة، الوقت المستغرق، ما إذا كانت ناجحة من المحاولة الأولى، والتقييم البشري.

في الوقت نفسه، اختبر كلاً من فئات التكلفة المنخفضة وفئات القدرة العالية.

بالنسبة لـ GPT-5.5، يمكنك اختبار مستويات مختلفة من reasoning_effort.

أما بالنسبة لـ Claude Opus 4.7، فيمكنك اختبار مستويات medium و high و xhigh و max effort.

لا تقم بتعيين كلا النموذجين على أعلى إعدادات افتراضياً؛ فالمواصفات القصوى توضح الحد الأقصى للقدرة، لكنها لا تعكس بالضرورة كفاءة التكلفة في بيئة الإنتاج.

كيف تفسر بيانات تقييم GPT-5.5 مقابل Claude Opus 4.7؟

تعتبر معايير التقييم (Benchmarks) العامة لـ GPT-5.5 و Claude Opus 4.7 ذات قيمة مرجعية، لكن لا يمكن مساواتها مباشرة بنتائج عملك الفعلي.

السبب بسيط: التقييمات العامة عادة ما تعتمد على مجموعات مهام ثابتة، وموجهات (Prompts) محددة، وبيئة تشغيل وقواعد تقييم ثابتة.

أما نظام عملك فسيواجه بيانات غير نظيفة، نقصاً في السياق، تعبيرات مستخدمين غير مستقرة، فشل الأدوات، قيود الصلاحيات، وإرثاً من الموجهات (Prompts) القديمة.

لذلك، رؤية تفوق GPT-5.5 في معيار معين لا يعني بالضرورة تحويل جميع المهام إليه. وكذلك الأمر بالنسبة لـ Claude Opus 4.7.

الطريقة الأكثر أماناً هي اعتبار المعايير الرسمية بمثابة إشارات لتوجهات قدرات النموذج.

على سبيل المثال:

- يعكس Terminal-Bench 2.0 قدرات سير عمل سطر الأوامر المعقدة بشكل أفضل.

- يقترب SWE-Bench Pro أكثر من القدرة الحقيقية على إصلاح مشكلات GitHub.

- يقترب GDPval أكثر من القدرة على تقديم المعرفة المهنية.

- أما معايير الرؤية ودعم الصور عالية الدقة، فهي الأنسب لتقييم المهام المتعلقة بلقطات الشاشة، الرسوم البيانية، واجهات المستخدم، وتنسيقات المستندات.

عند التطبيق العملي، تحتاج إلى ربط هذه الأبعاد بسياق منتجك الخاص:

- إذا كان منتجك مساعد برمجة (IDE)، فامنح الأولوية لمعدل نجاح إصلاح الكود، ومعدل نجاح الاختبارات، ومعدل التغييرات غير ذات الصلة، وجودة الشرح.

- إذا كان منتجك قاعدة معرفية مؤسسية، فامنح الأولوية لدقة الاستشهاد، ومعدل إغفال الحقائق، ومعالجة التعارضات، وحدود رفض الإجابة.

- إذا كان منتجك وكيل أتمتة (Agent)، فامنح الأولوية لعدد استدعاءات الأدوات، واستعادة الفشل، ومعدل إنجاز المهام، والتكلفة الإجمالية.

- إذا كان منتجك معالجة مستندات مرئية، فامنح الأولوية للتعرف على الإحداثيات، وتحويل الرسوم البيانية، وفهم التنسيق، وتكلفة التصحيح البشري.

تكمن قيمة APIYI (apiyi.com) في تنفيذ اختبارات هذه النماذج تحت واجهة موحدة. فاستخدام نفس المدخلات، ونفس أبعاد التقييم، ونفس حقول السجلات هو ما يجعل استنتاجات المقارنة بين GPT-5.5 و Claude Opus 4.7 قابلة لإعادة الاستخدام فعلياً.

أسئلة شائعة حول المقارنة بين GPT-5.5 و Claude Opus 4.7

أيهما أفضل لكتابة الكود: GPT-5.5 أم Claude Opus 4.7؟

كلاهما خياران ممتازان.

يتفوق GPT-5.5 في اختبار Terminal-Bench 2.0، مما يجعله مناسباً للعمليات المعقدة عبر سطر الأوامر وسير عمل Codex.

بينما يظهر Claude Opus 4.7 أداءً قوياً في اختبار SWE-Bench Pro، كما أنه مثالي لمهام الوكيل (Agent) طويلة الأمد باستخدام Claude Code.

بالنسبة للمشاريع الحقيقية، نوصي بإجراء اختبارات مزدوجة باستخدام نفس مجموعة المشكلات (issues) وأوامر الاختبار.

أيهما أفضل للإجابة على الأسئلة من قواعد المعرفة؟

إذا كان تركيزك ينصب على التوليد المنظم وتنظيم الأدوات المتعددة، فامنح الأولوية لاختبار GPT-5.5.

أما إذا كان تركيزك على تحديد البيانات المفقودة، والدقة في التعبير، والانضباط في التعامل مع نافذة السياق الطويلة، فامنح الأولوية لاختبار Claude Opus 4.7.

في النهاية، يجب أن يعتمد قرارك على دقة الاستشهادات وتكلفة المراجعة البشرية.

أيهما أفضل للمهام البصرية؟

يدعم Claude Opus 4.7 رسمياً الصور عالية الدقة وفقاً للوثائق الرسمية.

إذا كانت مهامك تتضمن لقطات الشاشة، أو تحديد الإحداثيات، أو تنسيق المستندات، أو التحقق البصري، فإن Claude Opus 4.7 يستحق الأولوية في الاختبار.

يعد GPT-5.5 مناسباً أيضاً لسير عمل متعدد الوسائط، ولكن المهام البصرية المكثفة تتطلب تقييماً منفصلاً.

أيهما أقل تكلفة؟

وفقاً للأسعار الرسمية، يبلغ سعر المدخلات لكل مليون رمز (token) 5 دولارات لكليهما.

أما سعر المخرجات، فيبلغ 25 دولاراً لكل مليون رمز لـ Claude Opus 4.7، بينما يبلغ 30 دولاراً لكل مليون رمز لـ GPT-5.5.

ومع ذلك، تعتمد التكلفة الفعلية على عدد الجولات المطلوبة لإتمام المهمة، وطول المخرجات، ومعدل الفشل، وتكاليف التصحيح البشري.

ملخص المقارنة بين GPT-5.5 و Claude Opus 4.7

لا توجد إجابة مطلقة تناسب جميع السيناريوهات عند المقارنة بين GPT-5.5 و Claude Opus 4.7.

يعد GPT-5.5 أكثر ملاءمة لسير عمل الإنتاج متعدد الأدوات، وبرمجة Codex، وإنشاء جداول المستندات، والعمل المعرفي، وتنفيذ المهام المعقدة.

بينما يتفوق Claude Opus 4.7 في المهام البصرية عالية الدقة، ومهام الوكيل طويلة المدى، واتباع التعليمات الصارمة، وذاكرة الملفات، ومعالجة البيانات بحذر.

- إذا كنت مستخدماً فردياً، يمكنك الاختيار بناءً على النظام البيئي للأدوات التي تستخدمها عادةً.

- إذا كنت مستخدماً مؤسسياً، فيجب عليك إجراء تقييم باستخدام عينات حقيقية.

- إذا كنت مطور API، فننصح بإدارة فروقات النماذج في طبقة التكيف (Adaptation Layer)، وتجنب ربط منطق عملك بنموذج معين مثل GPT-5.5 أو Claude Opus 4.7 بشكل دائم.

تعتبر خدمة APIYI (apiyi.com) خياراً مثالياً للعمل كبوابة موحدة للنماذج، مع توفير سجلات الاستدعاء، ومراقبة التكاليف، والتبديل بين نماذج متعددة.

التوصية النهائية: استخدم GPT-5.5 للمهام المعقدة التي تتطلب أدوات متعددة، واستخدم Claude Opus 4.7 للمهام البصرية عالية الدقة ومهام الوكيل الطويلة، واستخدم نماذج منخفضة التكلفة للطلبات العادية، ثم استمر في تعديل مسار التوجيه بناءً على بيانات التقييم.

المراجع:

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort