Der Vergleich zwischen GPT-5.5 und Claude Opus 4.7 gehört zu den wichtigsten Gegenüberstellungen für Entwickler in der ersten Jahreshälfte 2026.

Beide sind weit mehr als einfache Chat-Modelle.

GPT-5.5 legt den Schwerpunkt auf agentic coding, Computernutzung, Wissensarbeit und wissenschaftliche Analysen.

Claude Opus 4.7 hingegen fokussiert sich auf komplexe Schlussfolgerungen, langfristige Agenten-Aufgaben, hochauflösende visuelle Verarbeitung, Gedächtnisleistung und eine strengere Einhaltung von Anweisungen.

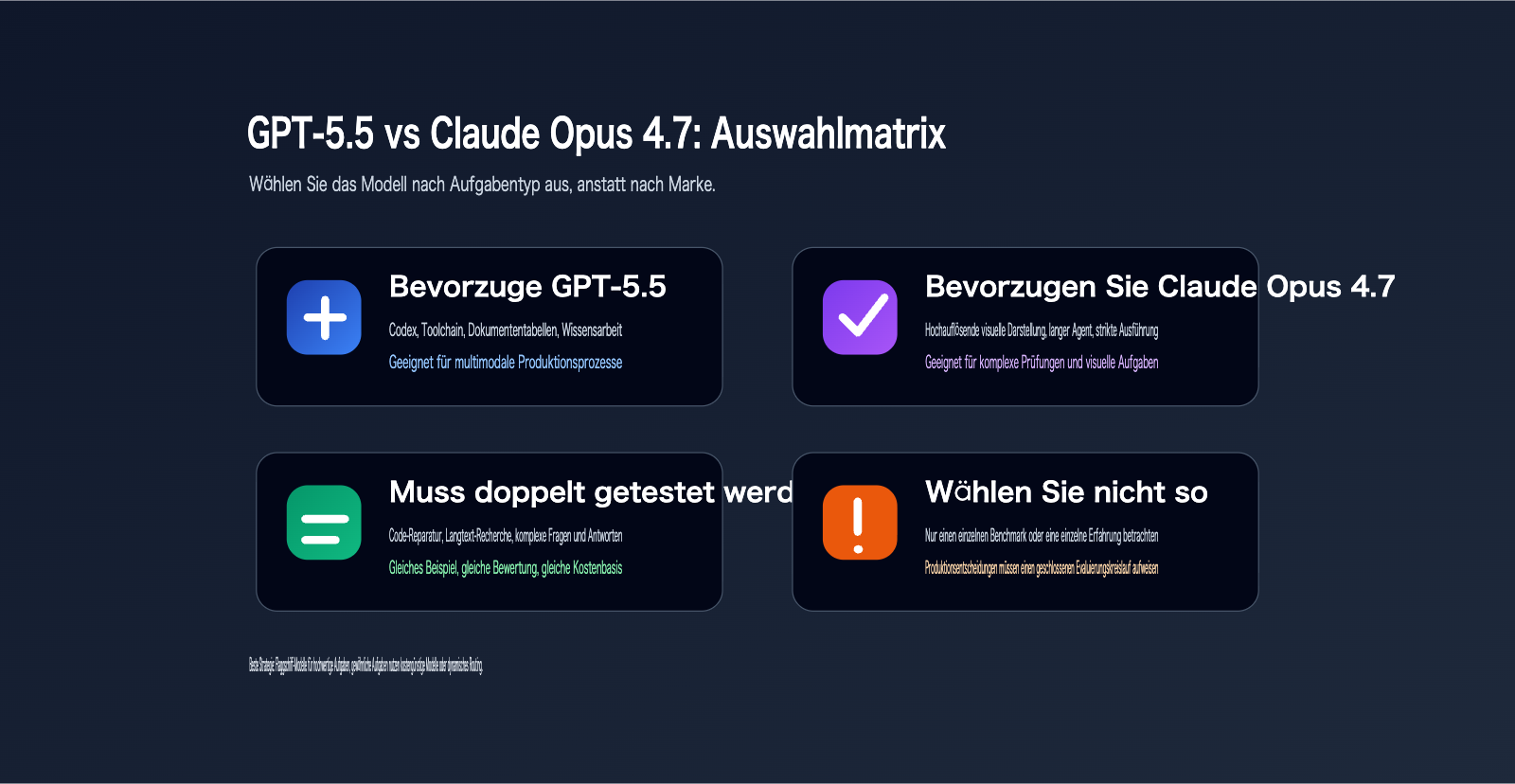

Die Frage „Welches ist besser?“ wäre zu kurz gegriffen.

Die sinnvollere Frage lautet: Besteht Ihre Aufgabe aus Code-Korrekturen, Wissensdatenbank-Abfragen, Analyse langer Kontexte, visuellem Verständnis, automatisierten Agenten oder kostspieligen Produktions-API-Aufrufen?

Je nach Aufgabe fällt die Wahl zwischen GPT-5.5 und Claude Opus 4.7 deutlich unterschiedlich aus.

Als OpenAI GPT-5.5 offiziell veröffentlichte, wurde Claude Opus 4.7 direkt in die Vergleichstabellen aufgenommen.

Auch Anthropic positioniert Claude Opus 4.7 als sein derzeit leistungsfähigstes, allgemein verfügbares Modell und hebt die Verbesserungen bei agentic coding, Wissensarbeit, visuellen Aufgaben und Gedächtnisfunktionen hervor.

Dieser Artikel basiert auf offiziellen englischsprachigen Quellen und verzichtet auf chinesische Sekundärquellen.

Es sei darauf hingewiesen, dass sich „Claude 4.7“ in diesem Artikel explizit auf Claude Opus 4.7 bezieht.

Zum Zeitpunkt der Erstellung dieses Artikels gibt es in den offiziellen Unterlagen von Anthropic keinen Hinweis auf eine Veröffentlichung von Claude Sonnet 4.7.

Kernfazit: GPT-5.5 vs Claude Opus 4.7

Der grundlegende Unterschied zwischen GPT-5.5 und Claude Opus 4.7 liegt in ihrer Ausrichtung.

OpenAI definiert GPT-5.5 als ein Modell, das besser für reale Arbeitsabläufe geeignet ist.

Es betont Programmierung, Fehlersuche, Online-Recherche, Datenanalyse, die Erstellung von Dokumenten und Tabellen sowie die aufgabenübergreifende Zusammenarbeit mit verschiedenen Tools.

Anthropic definiert Claude Opus 4.7 als sein leistungsfähigstes, allgemein verfügbares Modell.

Es legt den Schwerpunkt auf komplexe Schlussfolgerungen, agentic coding, langfristige Aufgaben, visuelles Verständnis, Gedächtnisleistung und Selbstprüfung.

Wenn Ihre Aufgaben komplexe technische Projekte innerhalb von Codex, dateiübergreifende Änderungen, Tool-Aufrufe und Wissensarbeit umfassen, ist GPT-5.5 oft die erste Wahl für Tests.

Wenn Ihre Aufgaben hingegen langwierige Agenten-Prozesse mit Claude Code, das Verständnis von Screenshots, die Überprüfung von Dokumentenlayouts, das Gedächtnis für Dateisysteme und eine strikte Einhaltung von Anweisungen erfordern, ist Claude Opus 4.7 vorzuziehen.

Wenn Sie beide Modelltypen einheitlich anbinden müssen, empfiehlt sich die Nutzung des API-Proxy-Dienstes APIYI (apiyi.com) für Multi-Modell-Routing und Evaluierung, um die Modellauswahl nicht fest in Ihrem Anwendungscode zu verankern.

Schneller Vergleich: GPT-5.5 vs Claude Opus 4.7

| Dimension | GPT-5.5 | Claude Opus 4.7 | Empfehlung |

|---|---|---|---|

| Offizielle Positionierung | Reale Workflows & agentic AI | Stärkstes verfügbares Claude-Modell | Nach Aufgabentyp wählen |

| Programmierfähigkeit | Stark bei Terminal-Bench 2.0 | Deutliche Verbesserung bei agentic coding | Beide testen |

| Langes Kontextfenster | API bis zu 1M Kontext | 1M Kontextfenster | Beide für lange Kontexte geeignet |

| Visuelle Fähigkeiten | Multimodal & Tool-Kollaboration | Unterstützung für hochauflösende Bilder | Claude bei visuellen Aufgaben |

| Steuerung der Schlussfolgerung | reasoning_effort | effort / adaptive thinking | Unterschiedliche Parameter-Systeme |

| API-Kosten | $5 Input / $30 Output pro Mio. Token | $5 Input / $25 Output pro Mio. Token | Claude günstiger bei Output |

| Ökosystem-Zugang | ChatGPT, Codex, API | Claude, Claude Code, API | Abhängig vom Workflow |

Empfehlung: Wenn Sie sich nicht sicher sind, ob GPT-5.5 oder Claude Opus 4.7 besser geeignet ist, bereiten Sie 30–50 reale Geschäftsbeispiele vor und lassen Sie diese über APIYI (apiyi.com) durch beide Modelle laufen. Vergleichen Sie dann Erfolgsraten, Antwortzeiten, Kosten und menschliche Bewertungen.

GPT-5.5 vs. Claude Opus 4.7: Vergleich der Programmierfähigkeiten

Die Programmierung ist das zentrale Einsatzszenario für den Vergleich zwischen GPT-5.5 und Claude Opus 4.7.

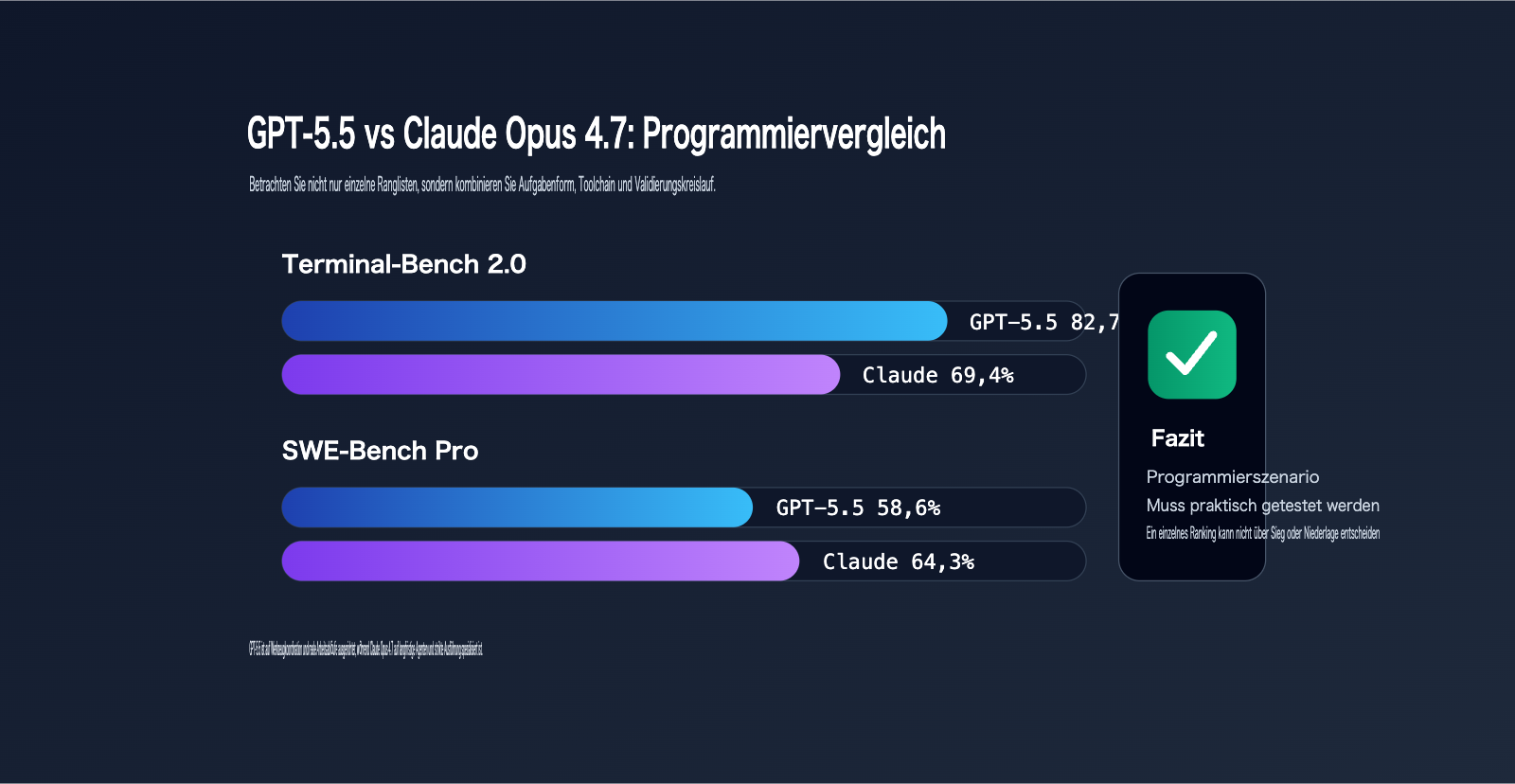

Offizielle Daten von OpenAI zeigen, dass GPT-5.5 im Terminal-Bench 2.0 einen Wert von 82,7 % erreicht.

In derselben Tabelle liegt Claude Opus 4.7 bei 69,4 %.

Beim öffentlichen Benchmark SWE-Bench Pro erreicht GPT-5.5 58,6 %, während Claude Opus 4.7 bei 64,3 % liegt.

Dies verdeutlicht, dass keiner der beiden Modelle in allen Bereichen einseitig dominiert.

GPT-5.5 zeigt bei komplexen Befehlszeilen-Workflows, der Planung, iterativen Prozessen und der Tool-Koordination eine stärkere Performance.

Claude Opus 4.7 ist hingegen bei Aufgaben zur Lösung von GitHub-Issues äußerst wettbewerbsfähig.

Anthropic betont in offiziellen Unterlagen zudem, dass Claude Opus 4.7 in ihrem 93-Task-Coding-Benchmark eine Verbesserung von 13 % gegenüber Opus 4.6 erzielt hat.

Dies belegt, dass die Fortschritte bei der Programmierung gegenüber der Vorgängergeneration bei Claude Opus 4.7 deutlich sind.

Beim direkten Vergleich von GPT-5.5 und Claude Opus 4.7 sollte jedoch kein einzelner Benchmark als alleinige Entscheidungsgrundlage dienen.

Echte Programmierarbeit umfasst zudem: das Verstehen von Legacy-Code, die Risikoerkennung, die Kontrolle des Änderungsumfangs, das Vervollständigen von Tests, das Ausführen von Befehlen, die Fehlerbehandlung, das Erläutern von Änderungen sowie das Erstellen von Review-Notizen.

GPT-5.5 glänzt im Codex-Szenario durch die übergreifende Tool-Ausführung und die Erledigung von Aufgaben mit weniger Token.

Claude Opus 4.7 betont im Claude-Code-Szenario langfristige Agenten-Aufgaben, hohen Aufwand (xhigh effort) und eine striktere Befolgung von Anweisungen.

Empfehlungen für Programmierszenarien: GPT-5.5 vs. Claude Opus 4.7

| Programmieraufgabe | Empfohlener Test | Grund |

|---|---|---|

| Komplexe CLI-Workflows | GPT-5.5 | Höherer offizieller Wert im Terminal-Bench 2.0 |

| GitHub-Issue-Fixes | Claude Opus 4.7 / GPT-5.5 | SWE-Bench Pro für Claude, GPT-5.5 hat starkes Ökosystem |

| Verständnis großer Codebasen | GPT-5.5 | Codex-Szenario betont systemübergreifenden Kontext |

| Langfristige Agenten-Aufgaben | Claude Opus 4.7 | Bessere Eignung für xhigh effort und Task-Budgets |

| Code-Review & Validierung | Beide geeignet | Fokus auf Test-Closed-Loop |

| Kostensensitive Batch-Fixes | Erfordert Praxistest | Große Unterschiede im Token-Verbrauch |

Empfehlung: Verlassen Sie sich bei Programmiermodellen nicht nur auf Ranglisten. Wir empfehlen, Ihre echten Issues, fehlgeschlagenen Tests, PR-Reviews und Refactoring-Aufgaben bei APIYI (apiyi.com) einem Vergleichstest zu unterziehen. Protokollieren Sie dabei, ob das Modell tatsächlich Tests ausführt, ob es versehentlich irrelevante Dateien ändert und ob es Risiken präzise benennen kann.

GPT-5.5 vs. Claude Opus 4.7: Wissensarbeit und Recherche

Der Vergleich zwischen GPT-5.5 und Claude Opus 4.7 im Bereich der Wissensarbeit ist ebenfalls von entscheidender Bedeutung.

Offizielle Materialien von OpenAI zeigen, dass GPT-5.5 im GDPval-Benchmark 84,9 % erreicht.

Claude Opus 4.7 liegt in derselben Tabelle bei 80,3 %.

GPT-5.5 Pro erreicht 82,3 %.

Dies unterstreicht, dass GPT-5.5 bei den von OpenAI aufgeführten professionellen Wissensaufgaben eine sehr starke Leistung zeigt.

OpenAI betont zudem, dass GPT-5.5 bei der Erstellung von Dokumenten, Tabellen, Präsentationen sowie bei der Bearbeitung von operativen Studien und geschäftlichen Inputs deutliche Fortschritte gemacht hat.

Seitens Anthropic wird hervorgehoben, dass Claude Opus 4.7 besonders bei Wissensarbeit, Gedächtnisleistung, Vision und langfristigen, agentenbasierten Aufgaben überzeugt.

Ein wichtiges Merkmal von Claude Opus 4.7 ist eine stärkere Datendisziplin.

Anthropic zitiert in diesem Zusammenhang eine Bewertung von Hex, wonach das Modell bei fehlenden Daten eher bereit ist, dies explizit zu benennen, anstatt eine plausibel klingende, aber falsche Alternative zu generieren.

Dies ist für Finanzanalysen, Forschungsberichte, Compliance-Prüfungen und die Verarbeitung von Datentabellen von großer Bedeutung.

Wenn Ihre Wissensarbeit erfordert, dass das Modell ästhetische, vollständige und strukturell klare Geschäftsdokumente erstellt, ist GPT-5.5 definitiv einen Test wert.

Wenn Ihre Aufgabe jedoch verlangt, dass das Modell bei fehlenden oder widersprüchlichen Daten sowie in langen Kontexten vorsichtig und präzise bleibt, ist Claude Opus 4.7 ebenfalls äußerst wettbewerbsfähig.

Auswahlhilfe: Wissensarbeit mit GPT-5.5 vs. Claude Opus 4.7

| Szenario | Vorteil GPT-5.5 | Vorteil Claude Opus 4.7 | Empfehlung |

|---|---|---|---|

| Geschäftsberichte | Starke strukturierte Generierung | Hohe Datendisziplin | Beide vergleichen |

| Tabellenanalyse | Starke Codex-Tabellenfähigkeiten | Visuelle Prüfung & Chart-Analyse | Je nach Input-Format |

| Finanzforschung | Starke GDPval-Performance | Verbesserungen im Finance-Modul | Mit echten Daten testen |

| Compliance-Prüfung | Starke Gesamtleistung | Vorsicht bei fehlenden Daten | Claude bevorzugt testen |

| Zusammenfassung mehrerer Dokumente | Starker langer Kontext | Gedächtnis & strikte Anweisungen | Nach Referenzqualität wählen |

Empfehlung: Bei Wissensarbeit ist das größte Risiko, dass Ergebnisse „vollständig aussehen, aber Halluzinationen enthalten“. Wenn Sie bei APIYI (apiyi.com) einen Vergleich zwischen GPT-5.5 und Claude Opus 4.7 durchführen, empfehlen wir, die manuelle Bewertung in fünf Dimensionen zu unterteilen: faktische Genauigkeit, Konsistenz der Zitate, Auslassungsrate, strukturelle Qualität und Umsetzbarkeit.

GPT-5.5 vs. Claude Opus 4.7: Visuelle Fähigkeiten und langes Kontextfenster

Sowohl GPT-5.5 als auch Claude Opus 4.7 unterstützen lange Kontextfenster, unterscheiden sich jedoch in den Details.

Offizielle Unterlagen von OpenAI zeigen, dass die GPT-5.5-API über ein Kontextfenster von 1 Mio. Token verfügt.

Die Modellübersicht von Anthropic gibt an, dass Claude Opus 4.7 ebenfalls ein Kontextfenster von 1 Mio. Token unterstützt und eine maximale Ausgabe von 128k Token ermöglicht.

Bei Aufgaben mit langem Kontext sind beide Modelle in der Lage, umfangreiche Dokumente, Code-Repositories und komplexe Datensätze zu verarbeiten.

Bei visuellen Aufgaben sind die Änderungen bei Claude Opus 4.7 jedoch deutlicher.

Die Dokumentation von Anthropic weist darauf hin, dass Claude Opus 4.7 das erste Claude-Modell ist, das hochauflösende Bilder unterstützt, wobei die maximale Bildauflösung auf 2576px / 3,75 MP erhöht wurde.

Dies ist entscheidend für das Verständnis von Screenshots, Dokumentenbildern, die Überprüfung von Präsentationen, die Analyse von Diagrammen und die Computer-Nutzung (Computer Use).

Anthropic erwähnt zudem, dass Bildkoordinaten nun 1:1 den tatsächlichen Pixeln entsprechen, was die Umrechnung von Koordinatenskalierungen reduziert.

GPT-5.5 verfügt ebenfalls über starke multimodale Fähigkeiten und Computer-Nutzung. Wenn Ihr Fokus jedoch auf hochauflösenden Screenshots, Diagrammen, Dokumentenlayouts oder UI-Koordinaten liegt, ist Claude Opus 4.7 einen vorrangigen Test wert.

Wenn Ihre Eingaben hauptsächlich aus langen Texten, Code-Repositories, Geschäftsdokumenten, strukturierten Daten und Toolchain-Ergebnissen bestehen, sollten Sie sowohl GPT-5.5 als auch Claude Opus 4.7 mit demselben Datensatz evaluieren.

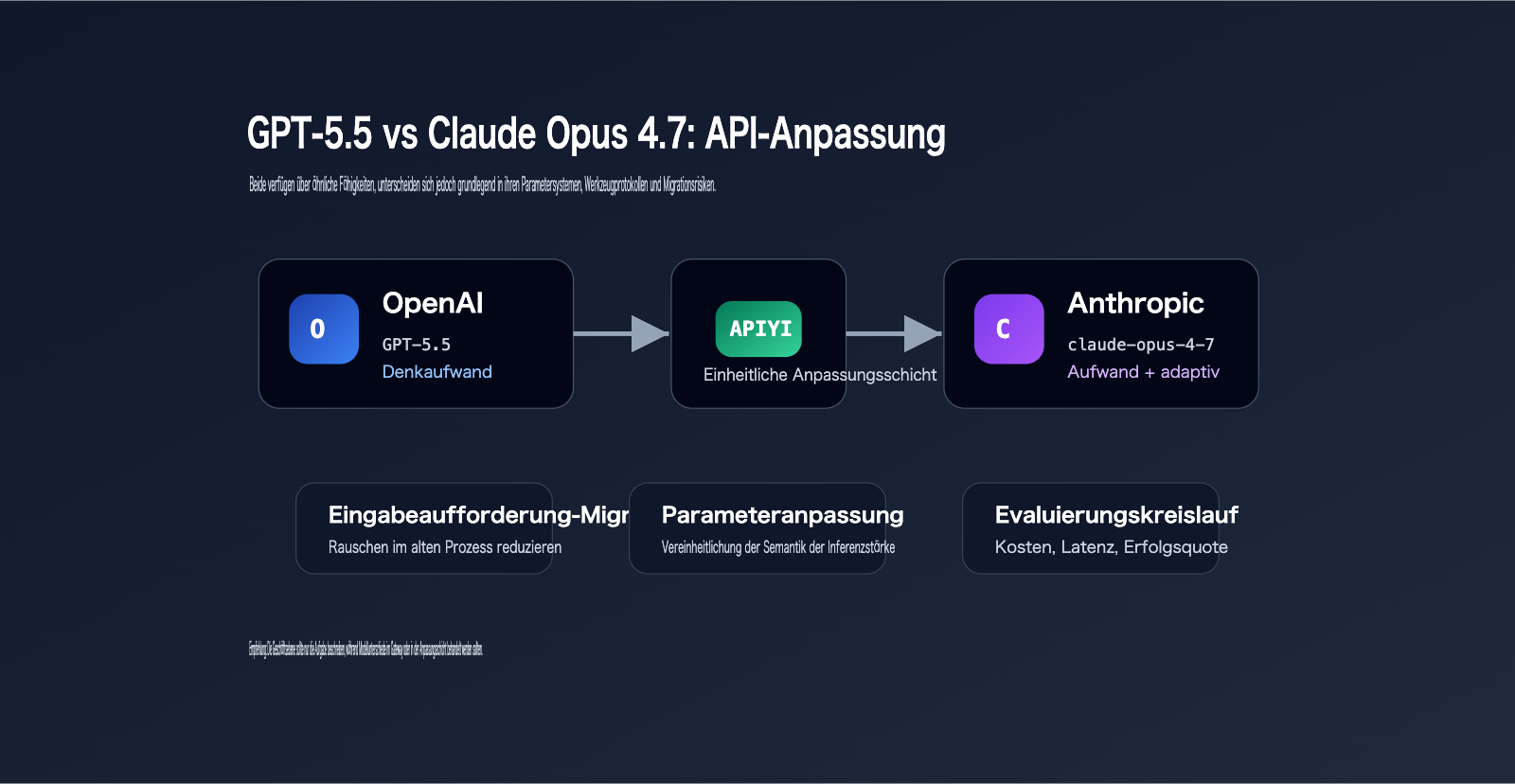

GPT-5.5 vs. Claude Opus 4.7: API-Parameter und Migrationsunterschiede

Die Unterschiede bei der API-Migration zwischen GPT-5.5 und Claude Opus 4.7 sind erheblich.

GPT-5.5 gehört zum OpenAI-Modell-Ökosystem; wichtige Parameter sind hier model, reasoning_effort, Responses-API-Toolaufrufe und die Steuerung des Ausgabeformats.

Claude Opus 4.7 gehört zum Anthropic Messages-API-System; wichtige Parameter sind hier adaptive thinking, effort, task budget, max_tokens und Toolaufrufe.

Die offizielle Dokumentation von Anthropic zeigt, dass Claude Opus 4.7 die extended thinking budgets entfernt hat.

Die alte Schreibweise thinking: {"type": "enabled", "budget_tokens": N} führt zu einem 400-Fehler.

Die neue Schreibweise sollte thinking: {"type": "adaptive"} verwenden, wobei der effort über output_config eingestellt wird.

Anthropic weist außerdem darauf hin, dass ab Claude Opus 4.7 das Festlegen von nicht standardmäßigen temperature-, top_p– oder top_k-Werten zu einem 400-Fehler führt.

Dies ist ein wichtiger Migrationspunkt für viele bestehende Projekte.

Falls Sie sich bisher auf temperature=0 für deterministische Ausgaben verlassen haben, müssen Sie dies neu bewerten: temperature=0 garantierte ohnehin keine vollständige Konsistenz.

Im Vergleich dazu liegt der Schwerpunkt bei der Migration auf GPT-5.5 eher auf der Rekonstruktion von Eingabeaufforderungen (Prompts), der Bewertung von reasoning_effort, Tool-Workflows und ergebnisorientierten Eingabeaufforderungen.

Wichtige Punkte für die API-Migration: GPT-5.5 vs. Claude Opus 4.7

| Migrationspunkt | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| Modell-ID | gpt-5.5 |

claude-opus-4-7 |

| Inferenzsteuerung | reasoning_effort |

effort + adaptive thinking |

| Langes Kontextfenster | 1M Kontextfenster | 1M Kontextfenster |

| Ausgabelimit | Gemäß OpenAI API-Spezifikation | 128k max. Ausgabe |

| Temperaturparameter | Konfiguration gemäß OpenAI API | Nicht standardmäßige Werte führen zu Fehlern |

| Tool-Workflow | Responses-API-Tool-System | Messages-API-Tool-System |

| Migrationsrisiko | Übermäßig spezifizierte alte Prompts | thinking budget und alte Sampling-Parameter |

Empfehlung: Wenn Sie sowohl GPT-5.5 als auch Claude Opus 4.7 anbinden müssen, ist es nicht ratsam, zwei separate Aufruflogiken direkt in den Anwendungscode zu schreiben. Sie können APIYI (apiyi.com) als einheitlichen, OpenAI-kompatiblen Einstiegspunkt nutzen und Modellunterschiede, Parameteranpassungen sowie Fehlerbehandlung auf der Gateway- oder Adapterebene verwalten.

GPT-5.5 vs. Claude Opus 4.7: Kosten- und Leistungsvergleich

Bei der Wahl zwischen GPT-5.5 und Claude Opus 4.7 sollten Sie nicht nur auf den Einzelpreis schauen.

Laut offiziellen Angaben von OpenAI kostet die GPT-5.5-API 5 USD pro Million Eingabe-Token und 30 USD pro Million Ausgabe-Token.

Die Modellübersicht von Anthropic zeigt für Claude Opus 4.7 einen Preis von 5 USD pro Million Eingabe-Token und 25 USD pro Million Ausgabe-Token.

Betrachtet man nur den Preis für die Ausgabe, ist Claude Opus 4.7 günstiger.

OpenAI betont jedoch, dass GPT-5.5 bei der Nutzung von Codex deutlich effizienter mit Token umgeht als GPT-5.4.

Anthropic hebt wiederum hervor, dass Claude Opus 4.7 die Kosten durch Funktionen wie „Effort“, „Task Budget“ und „Adaptive Thinking“ steuert.

Die tatsächlichen Kosten hängen also stark von der Art der Aufgabe ab.

Wenn GPT-5.5 eine Aufgabe in weniger Schritten erledigt, sind die Gesamtkosten unter Umständen nicht höher.

Wenn Claude Opus 4.7 hingegen bei Einstellungen wie „xhigh“ oder „max effort“ eine große Menge an Ausgabe-Token verbraucht, können die Gesamtkosten ebenfalls steigen.

Die Kostenbewertung sollte sich daher auf die „Gesamtkosten für eine erfolgreiche Aufgabenerledigung“ beziehen und nicht nur auf den Preis pro Million Token.

Bewertungsdimensionen für GPT-5.5 vs. Claude Opus 4.7

| Kostendimension | Was zu erfassen ist | Warum es wichtig ist |

|---|---|---|

| Eingabe-Token | Prompt, Kontext, Tool-Ergebnisse | Große Kostenunterschiede bei langen Kontexten |

| Ausgabe-Token | Endgültige Antwort, Tool-Parameter, Schlussfolgerungen | Ausgabe-Token sind meist teurer |

| Runden | Anzahl der Runden bis zur Erledigung | Mehrere Runden erhöhen die Kosten massiv |

| Erfolgsrate | Erledigung im ersten Anlauf oder Korrekturschleifen | Fehlversuche sind versteckte Kosten |

| Latenz | Wartezeit des Nutzers | Hoher „Effort“ erhöht die Wartezeit |

| Manuelle Prüfung | Ist eine menschliche Korrektur nötig? | Schlechte Qualität verursacht Folgekosten |

Empfehlung: Für Unternehmenseinsätze bedeutet Kostenoptimierung nicht einfach nur das günstigste Modell zu wählen. Wir empfehlen, über APIYI (apiyi.com) Eingaben, Ausgaben, Latenz, Modell, Parameter und manuelle Bewertungen zu erfassen, um die „Kosten pro erfolgreicher Aufgabe“ als finale Kennzahl zu nutzen.

Entscheidungshilfe: Einsatzszenarien für GPT-5.5 vs. Claude Opus 4.7

Als Einzelentwickler können Sie GPT-5.5 und Claude Opus 4.7 nach dem jeweiligen Tool-Ökosystem auswählen.

Wenn Sie häufig mit Codex arbeiten, testen Sie zuerst GPT-5.5.

Wenn Sie Claude Code bevorzugen, ist Claude Opus 4.7 die erste Wahl.

Als technischer Leiter in einem Unternehmen sollten Sie Entscheidungen jedoch nicht auf Basis persönlicher Erfahrungen treffen.

Erstellen Sie stattdessen ein Aufgaben-Set und vergleichen Sie beide Modelle innerhalb derselben Testumgebung hinsichtlich Eingabe, Ausgabe, Bewertung und Kosten.

Für Content-Teams ist GPT-5.5 bei strukturierten Inhalten, Recherche, Tabellenkalkulationen und der Arbeit mit mehreren Tools einen Test wert.

Claude Opus 4.7 empfiehlt sich besonders für Aufgaben, die präzise Ausdrucksweise, lange Kontexte, visuelle Daten und Dokumentenprüfung erfordern.

Wenn Sie eine API-Plattform oder ein SaaS-Produkt betreiben, empfiehlt sich der Einsatz von Modell-Routing.

Leiten Sie beispielsweise einfache Anfragen an kostengünstigere Modelle weiter und nutzen Sie GPT-5.5 oder Claude Opus 4.7 nur für komplexen Code oder umfangreiche Agenten-Aufgaben.

So vermeiden Sie, dass jede Anfrage direkt an die Flaggschiff-Modelle geht.

Checkliste für die Migration: GPT-5.5 vs. Claude Opus 4.7

Verlassen Sie sich vor dem Go-Live nicht nur auf einen subjektiven Eindruck.

Es wird empfohlen, mindestens 5 Arten von Stichproben vorzubereiten:

- Erfolgreiche Beispiele.

- Grenzfälle, die leicht zu Fehlinterpretationen führen.

- Beispiele mit langem Kontext.

- Beispiele für den Werkzeugaufruf (Tool Calling).

- Beispiele für die Fehlerwiederherstellung.

Für jedes Beispiel sollten das Modell, die Parameter, die Eingabe-Token, die Ausgabe-Token, die Dauer, der Erfolg beim ersten Versuch und eine manuelle Bewertung protokolliert werden.

Testen Sie dabei sowohl die kostengünstigen als auch die leistungsstarken Varianten.

Bei GPT-5.5 können Sie verschiedene reasoning_effort-Stufen testen.

Bei Claude Opus 4.7 können Sie die Stufen medium, high, xhigh und max effort testen.

Gehen Sie nicht davon aus, dass beide Modelle standardmäßig mit der höchsten Konfiguration betrieben werden sollten.

Die Maximalkonfiguration zeigt lediglich das theoretische Limit auf, nicht jedoch die Wirtschaftlichkeit im produktiven Einsatz.

Wie interpretiert man die Benchmarking-Daten von GPT-5.5 vs. Claude Opus 4.7?

Öffentliche Benchmarks für GPT-5.5 und Claude Opus 4.7 sind zwar wertvolle Referenzen, lassen sich jedoch nicht direkt auf Ihre geschäftlichen Ergebnisse übertragen.

Der Grund ist einfach: Öffentliche Tests verwenden meist feste Aufgabensets, vorgegebene Eingabeaufforderungen, definierte Laufzeitumgebungen und starre Bewertungsregeln.

Ihr Geschäftssystem hingegen wird mit unsauberen Daten, fehlendem Kontext, unpräzisen Benutzereingaben, fehlerhaften Werkzeugen, Berechtigungseinschränkungen und Altlasten aus früheren Prompts konfrontiert.

Nur weil GPT-5.5 in einem bestimmten Benchmark führt, bedeutet das nicht, dass alle Aufgaben auf GPT-5.5 umgestellt werden sollten.

Ebenso wenig bedeutet ein Vorsprung von Claude Opus 4.7 in einem anderen Benchmark, dass Sie komplett zu Claude wechseln sollten.

Ein sichererer Ansatz ist es, offizielle Benchmarks als Indikatoren für die Stärken eines Modells zu betrachten.

- Terminal-Bench 2.0 eignet sich beispielsweise besser, um komplexe Befehlszeilen-Workflows zu bewerten.

- SWE-Bench Pro kommt der tatsächlichen Fähigkeit zur Behebung von GitHub-Issues am nächsten.

- GDPval ist näher an der Bereitstellung von Fachwissen.

Visuelle Benchmarks und die Unterstützung hochauflösender Bilder eignen sich besser zur Beurteilung von Aufgaben rund um Screenshots, Diagramme, Benutzeroberflächen und Dokumentenlayouts.

Bei der Implementierung müssen Sie diese Dimensionen auf Ihre eigenen Produktszenarien übertragen.

- Wenn Ihr Produkt ein KI-Assistent für die Programmierung ist, priorisieren Sie die Erfolgsquote bei Code-Korrekturen, die Testabdeckung, die Rate irrelevanter Änderungen und die Qualität der Erklärungen.

- Wenn es sich um eine Unternehmens-Wissensdatenbank handelt, priorisieren Sie die Genauigkeit der Zitate, die Vollständigkeit der Fakten, den Umgang mit Widersprüchen und die Grenzen der Verweigerung.

- Wenn es sich um einen automatisierten Agenten handelt, priorisieren Sie die Anzahl der Werkzeugaufrufe, die Fehlerwiederherstellung, die Aufgabenabschlussrate und die Gesamtkosten.

- Wenn es sich um visuelle Dokumentenverarbeitung handelt, priorisieren Sie die Koordinatenerkennung, die Diagrammtranskription, das Layoutverständnis und die Kosten für manuelle Korrekturen.

Der Wert von APIYI (apiyi.com) liegt darin, diese Modelltests unter einer einheitlichen Schnittstelle auszuführen.

Erst durch identische Eingaben, einheitliche Bewertungskriterien und konsistente Protokollfelder werden die Schlussfolgerungen aus dem Vergleich von GPT-5.5 und Claude Opus 4.7 wirklich reproduzierbar.

GPT-5.5 vs. Claude Opus 4.7 FAQ

Wer eignet sich besser zum Programmieren: GPT-5.5 oder Claude Opus 4.7?

Beide Modelle sind hervorragend geeignet.

GPT-5.5 zeigt eine stärkere Performance im Terminal-Bench 2.0 und eignet sich daher besonders für komplexe Befehlszeilen-Workflows und Codex-Arbeitsabläufe.

Claude Opus 4.7 überzeugt im SWE-Bench Pro und ist ideal für langwierige Agenten-Aufgaben mit Claude Code.

Für reale Projekte empfehlen wir, beide Modelle mit denselben Issues und Testbefehlen einem direkten Vergleich zu unterziehen.

Wer eignet sich besser für Wissensdatenbank-Abfragen?

Wenn der Fokus auf strukturierter Generierung und der Organisation durch mehrere Tools liegt, sollten Sie GPT-5.5 priorisieren.

Wenn es hingegen um die Identifizierung fehlender Daten, eine vorsichtige Ausdrucksweise und Disziplin bei langen Kontextfenstern geht, ist Claude Opus 4.7 die bessere Wahl.

Letztendlich sollten die Genauigkeit der Zitate und der Aufwand für die manuelle Überprüfung ausschlaggebend sein.

Wer eignet sich besser für visuelle Aufgaben?

Claude Opus 4.7 bietet laut offizieller Dokumentation eine explizite Unterstützung für hochauflösende Bilder.

Wenn Ihre Aufgaben Screenshots, Koordinaten, Dokumentenlayouts oder visuelle Validierungen umfassen, ist Claude Opus 4.7 einen Test wert.

GPT-5.5 ist ebenfalls für multimodale Workflows geeignet, jedoch sollten visuelle Schwerlastaufgaben separat evaluiert werden.

Wer ist kostengünstiger?

Gemäß den offiziellen Preisen liegen die Kosten für den Input bei beiden Modellen bei 5 USD pro Million Token.

Der Output-Preis für Claude Opus 4.7 liegt bei 25 USD pro Million Token, während GPT-5.5 30 USD pro Million Token kostet.

Die tatsächlichen Kosten hängen jedoch von der Anzahl der für die Aufgabe benötigten Runden, der Ausgabelänge, der Fehlerrate und dem Aufwand für manuelle Korrekturen ab.

Zusammenfassung: GPT-5.5 vs. Claude Opus 4.7

Es gibt keine pauschale Antwort darauf, ob GPT-5.5 oder Claude Opus 4.7 für alle Szenarien besser ist.

GPT-5.5 eignet sich besser für produktive Workflows mit mehreren Tools, Codex-Programmierung, die Erstellung von Dokumententabellen, Wissensarbeit und die Ausführung komplexer Aufgaben.

Claude Opus 4.7 ist die bessere Wahl für hochauflösende visuelle Aufgaben, langfristige Agenten-Prozesse, strikte Befolgung von Anweisungen, Dateigedächtnis und eine vorsichtige Datenverarbeitung.

Als privater Nutzer sollten Sie nach dem Ökosystem Ihrer bevorzugten Tools entscheiden.

Als Unternehmenskunde ist eine Evaluierung mit echten Datensätzen unerlässlich.

Als API-Entwickler sollten Sie Modellunterschiede in einer Adapter-Schicht verwalten und die Geschäftslogik nicht fest an GPT-5.5 oder Claude Opus 4.7 binden.

APIYI (apiyi.com) eignet sich hervorragend als einheitlicher Modell-Einstiegspunkt für Aufrufprotokolle, Kostenüberwachung und den Wechsel zwischen verschiedenen Modellen.

Unsere Empfehlung: Nutzen Sie GPT-5.5 für komplexe Aufgaben mit mehreren Tools, Claude Opus 4.7 für hochpräzise visuelle Aufgaben und lange Agenten-Prozesse, und setzen Sie kostengünstige Modelle für Standardanfragen ein. Optimieren Sie Ihr Routing kontinuierlich auf Basis von Evaluierungsdaten.

Referenzen:

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort