Сравнение GPT-5.5 и Claude Opus 4.7 — одна из самых обсуждаемых тем среди разработчиков в первой половине 2026 года.

Важно понимать: оба решения — это не просто чат-боты.

GPT-5.5 делает упор на агентное программирование (agentic coding), работу с компьютером, интеллектуальный анализ данных и научные исследования.

Claude Opus 4.7, в свою очередь, фокусируется на сложных логических рассуждениях, долгосрочных агентных задачах, высокоточном визуальном восприятии, возможностях памяти и строгом следовании инструкциям.

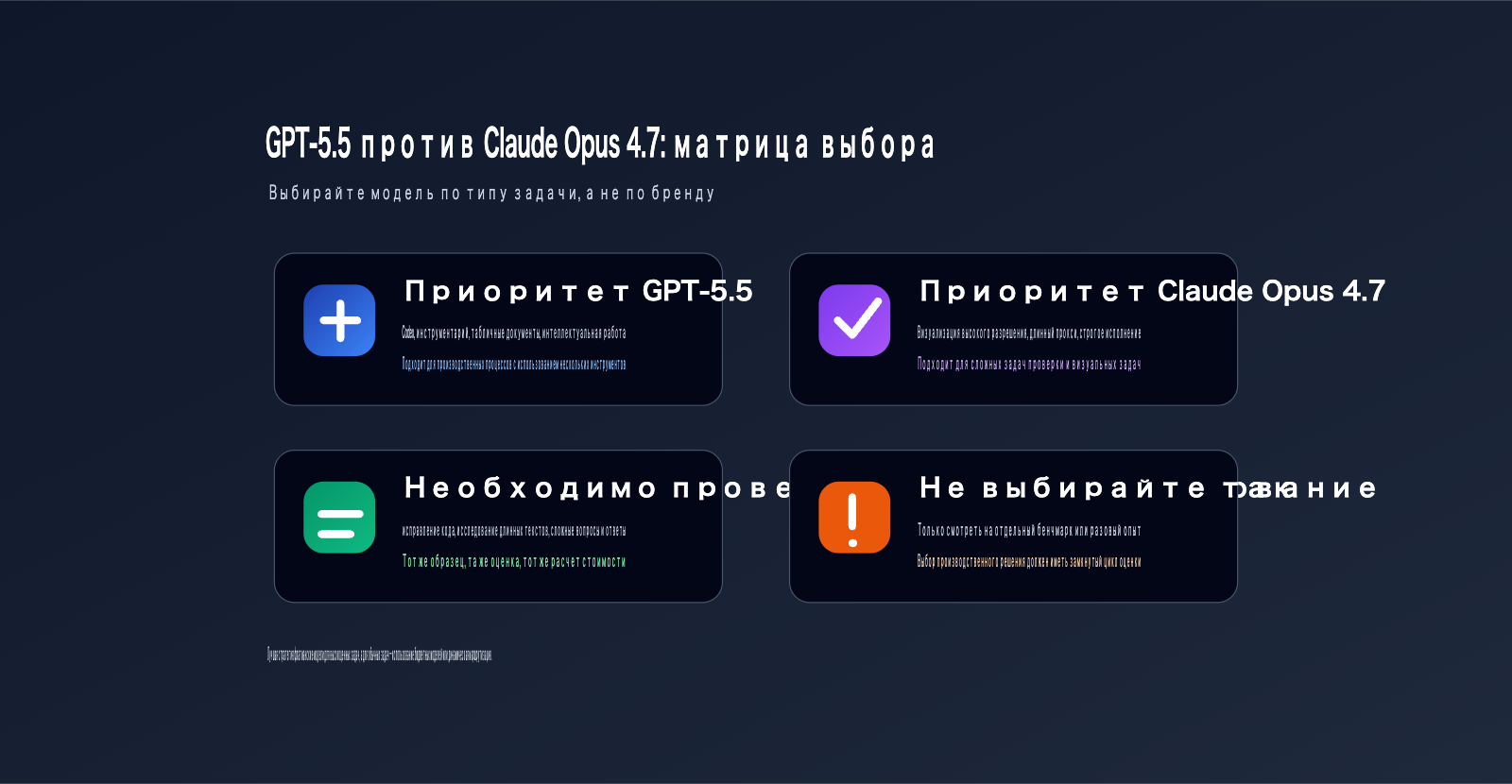

Ответ на вопрос «кто из них сильнее» будет слишком поверхностным.

Куда полезнее спросить: какая у вас задача? Исправление кода, ответы по базе знаний, анализ длинного контекста, визуальное понимание, автоматизация агентов или высокобюджетные вызовы API в продакшене?

Выбор между GPT-5.5 и Claude Opus 4.7 будет кардинально отличаться в зависимости от конкретного сценария.

Когда OpenAI официально выпустила GPT-5.5, она сразу включила Claude Opus 4.7 в свои сравнительные таблицы.

В свою очередь, Anthropic позиционирует Claude Opus 4.7 как свою самую мощную модель общего назначения, подчеркивая улучшения в агентном программировании, интеллектуальной работе, визуальных задачах и работе с памятью.

Данная статья подготовлена на основе официальных англоязычных материалов.

Важное уточнение: под «Claude 4.7» в этой статье понимается именно Claude Opus 4.7. На момент написания статьи официальных данных о выходе Claude Sonnet 4.7 от Anthropic не поступало.

Основные выводы: GPT-5.5 vs Claude Opus 4.7

Первое различие между GPT-5.5 и Claude Opus 4.7 заключается в их позиционировании.

OpenAI определяет GPT-5.5 как модель, максимально адаптированную для реальных рабочих процессов. Она делает упор на написание кода, отладку, онлайн-исследования, анализ данных, создание документов и таблиц, а также на выполнение задач с использованием различных инструментов.

Anthropic же позиционирует Claude Opus 4.7 как свою самую мощную универсальную модель. Она выделяется сложными логическими рассуждениями, агентным программированием, долгосрочными задачами, визуальным пониманием, памятью и способностью к самопроверке.

Если ваша задача — сложный инженерный проект в Codex, правки между файлами, вызов инструментов и интеллектуальная работа, GPT-5.5 часто стоит тестировать в первую очередь.

Если же ваша задача — длительные агентные процессы в Claude Code, анализ скриншотов, проверка верстки документов, работа с памятью файловой системы и строгое следование инструкциям, то Claude Opus 4.7 будет предпочтительнее.

Если вам нужно интегрировать обе модели, рекомендуем использовать сервис-прокси API APIYI (apiyi.com) для маршрутизации и оценки моделей, чтобы не «зашивать» выбор модели жестко в бизнес-код.

Краткое сравнение: GPT-5.5 vs Claude Opus 4.7

| Параметр | GPT-5.5 | Claude Opus 4.7 | Рекомендация |

|---|---|---|---|

| Позиционирование | Реальные рабочие процессы и агентный ИИ | Самая мощная универсальная модель Claude | Выбирайте под задачу |

| Программирование | Высокая эффективность в Terminal-Bench 2.0 | Значительный прогресс в агентном программировании | Нужно тестировать обе |

| Контекстное окно | До 1 млн токенов через API | 1 млн токенов | Обе подходят для длинного контекста |

| Визуальные способности | Мультимодальность и работа с инструментами | Поддержка изображений высокого разрешения | Для визуальных задач лучше Claude |

| Управление логикой | reasoning_effort | effort / adaptive thinking | Разные системы параметров |

| Стоимость API | $5 вход / $30 выход (за 1 млн токенов) | $5 вход / $25 выход (за 1 млн токенов) | Claude дешевле на выходе |

| Экосистема | ChatGPT, Codex, API | Claude, Claude Code, API | Зависит от рабочего процесса |

Рекомендация: если вы не уверены, что выбрать, подготовьте 30–50 реальных бизнес-кейсов и прогоните их через обе модели с помощью APIYI (apiyi.com). Сравните коэффициент успешности, время отклика, стоимость и экспертную оценку результатов.

Сравнение возможностей программирования: GPT-5.5 против Claude Opus 4.7

Программирование — это ключевой сценарий для сравнения GPT-5.5 и Claude Opus 4.7.

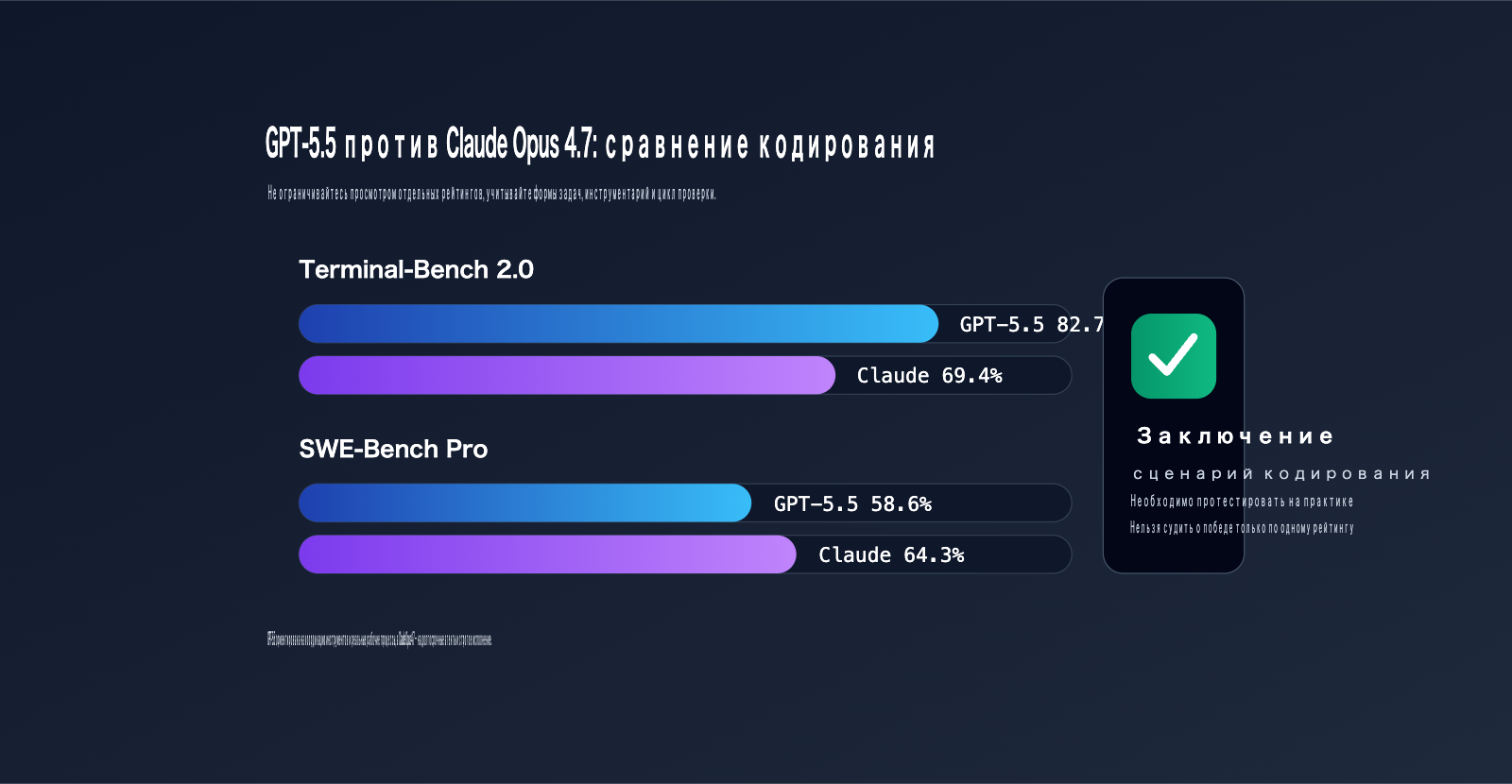

Согласно официальным данным OpenAI, GPT-5.5 достигает 82,7% в бенчмарке Terminal-Bench 2.0.

В той же таблице результат Claude Opus 4.7 составляет 69,4%.

Однако в публичном тестировании SWE-Bench Pro показатели иные: GPT-5.5 — 58,6%, а Claude Opus 4.7 — 64,3%.

Это говорит о том, что ни одна из моделей не является безоговорочным победителем.

GPT-5.5 показывает лучшие результаты в сложных рабочих процессах командной строки, планировании, итерациях и координации инструментов.

Claude Opus 4.7, в свою очередь, очень конкурентоспособен в задачах по решению проблем GitHub (GitHub issues).

В официальных материалах Anthropic также подчеркивается, что Claude Opus 4.7 на 13% эффективнее версии Opus 4.6 в их собственном бенчмарке из 93 задач по программированию.

Это означает, что прогресс Claude Opus 4.7 по сравнению с предыдущим поколением очевиден.

Тем не менее, при сравнении GPT-5.5 и Claude Opus 4.7 нельзя опираться только на один бенчмарк.

Реальная работа программиста включает в себя: чтение старого кода, выявление рисков, контроль области изменений, дополнение тестов, выполнение команд, обработку ошибок, объяснение изменений и создание заметок к ревью (review notes).

В сценариях Codex модель GPT-5.5 делает упор на кросс-инструментальное выполнение и решение задач с меньшим количеством токенов.

В сценариях Claude Code модель Claude Opus 4.7 делает акцент на долгосрочных агентах, высокой интенсивности работы (xhigh effort) и более строгом следовании инструкциям.

Рекомендации по выбору модели для программирования

| Задача программирования | Что лучше протестировать в первую очередь | Причина |

|---|---|---|

| Сложные рабочие процессы в CLI | GPT-5.5 | Более высокий официальный балл в Terminal-Bench 2.0 |

| Исправление GitHub issues | Оба (Claude и GPT-5.5) | Claude лучше в SWE-Bench Pro, у GPT-5.5 сильнее экосистема |

| Понимание крупных кодовых баз | GPT-5.5 | Сценарии Codex лучше работают с кросс-системным контекстом |

| Длительные агентные задачи | Claude Opus 4.7 | xhigh effort лучше сочетается с бюджетом задач |

| Ревью и проверка кода | Оба подходят | Фокус на цикле тестирования |

| Массовые исправления (чувствительность к цене) | Требуется тест | Различия в использовании токенов |

Совет по выбору: не ориентируйтесь только на рейтинги. Мы рекомендуем взять ваши реальные задачи (issues), упавшие тесты, PR-ревью и задачи по рефакторингу и провести сравнительное тестирование в APIYI (apiyi.com). Проверьте, действительно ли модель запускает тесты, не меняет ли она лишние файлы и способна ли адекватно оценить риски.

Интеллектуальная работа и исследовательские способности: GPT-5.5 против Claude Opus 4.7

Сравнение GPT-5.5 и Claude Opus 4.7 в области интеллектуальной работы также имеет решающее значение.

Согласно официальным материалам OpenAI, GPT-5.5 достигает 84,9% в бенчмарке GDPval.

Claude Opus 4.7 в той же таблице показывает результат 80,3%.

GPT-5.5 Pro набирает 82,3%.

Это говорит о том, что в профессиональных задачах, указанных OpenAI, GPT-5.5 демонстрирует очень сильные результаты.

OpenAI также подчеркивает, что GPT-5.5 значительно улучшился в генерации документов, таблиц, презентаций, а также в обработке операционных исследований и бизнес-данных.

Что касается Anthropic, официальные материалы по Claude Opus 4.7 выделяют его успехи в интеллектуальной работе (knowledge work), памяти, зрении (vision) и долгосрочных агентных задачах.

Важной особенностью Claude Opus 4.7 является более строгая работа с данными.

На странице Anthropic приводится отзыв Hex, где отмечается, что модель при отсутствии данных скорее укажет на их нехватку, чем предложит правдоподобный, но неверный вариант.

Это крайне важно для финансового анализа, подготовки отчетов, комплаенс-проверок и работы с табличными данными.

Если ваша интеллектуальная работа требует создания красивых, полных и структурированных бизнес-документов, GPT-5.5 определенно стоит протестировать.

Если же ваша задача требует от модели осторожности при работе с отсутствующими или противоречивыми данными, а также с длинным контекстом, Claude Opus 4.7 будет очень конкурентоспособным выбором.

Выбор модели для интеллектуальной работы

| Сценарий | Преимущество GPT-5.5 | Преимущество Claude Opus 4.7 | Рекомендация |

|---|---|---|---|

| Бизнес-отчеты | Отличная генерация структур | Строгая работа с данными | Сравнить обе |

| Анализ таблиц | Сильные способности Codex | Визуальная проверка и анализ графиков | Зависит от формата ввода |

| Финансовые исследования | Высокие показатели GDPval | Улучшения в модуле General Finance | Тестировать на реальных данных |

| Комплаенс-проверки | Комплексные способности | Осторожность при нехватке данных | Сначала протестировать Claude |

| Резюмирование документов | Сильный длинный контекст | Память и строгое следование инструкциям | Выбирать по качеству цитирования |

Совет по выбору: в интеллектуальной работе самое страшное — это когда результат «выглядит полным, но содержит галлюцинации». При сравнении GPT-5.5 и Claude Opus 4.7 в APIYI (apiyi.com) мы рекомендуем оценивать результаты по 5 критериям: фактическая точность, согласованность цитат, уровень пропусков, качество структуры и практическая применимость.

Сравнение GPT-5.5 и Claude Opus 4.7: визуальные возможности и работа с длинным контекстом

И GPT-5.5, и Claude Opus 4.7 поддерживают работу с длинным контекстом, но есть нюансы.

Согласно официальным материалам OpenAI, API GPT-5.5 обладает контекстным окном в 1 млн токенов.

Обзор моделей Anthropic показывает, что Claude Opus 4.7 также поддерживает контекстное окно в 1 млн токенов, а максимальный объем вывода составляет 128 тыс. токенов.

В задачах с длинным контекстом обе модели вышли на уровень, позволяющий обрабатывать объемные документы, кодовые базы и сложные наборы данных.

Однако в плане визуальных задач изменения в Claude Opus 4.7 выглядят более существенными.

Документация Anthropic гласит, что Claude Opus 4.7 — первая модель Claude с поддержкой изображений высокого разрешения, где максимальное разрешение увеличено до 2576 пикселей / 3,75 Мп.

Это критически важно для анализа скриншотов, изображений документов, проверки слайдов презентаций, анализа графиков и использования компьютера (computer use).

В Anthropic также отметили, что координаты изображений теперь соответствуют реальным пикселям в соотношении 1:1, что избавляет от необходимости пересчета масштаба координат.

GPT-5.5 также обладает мощными мультимодальными возможностями и функциями для работы с компьютером, но если в основе вашего ввода лежат скриншоты высокого разрешения, графики, верстка документов или UI-координаты, Claude Opus 4.7 определенно стоит протестировать в первую очередь.

Если же вы работаете с длинными текстами, кодовыми базами, бизнес-документацией, структурированными данными и результатами работы цепочек инструментов, то GPT-5.5 и Claude Opus 4.7 стоит оценивать на одном и том же наборе данных.

Различия в API и миграции: GPT-5.5 vs Claude Opus 4.7

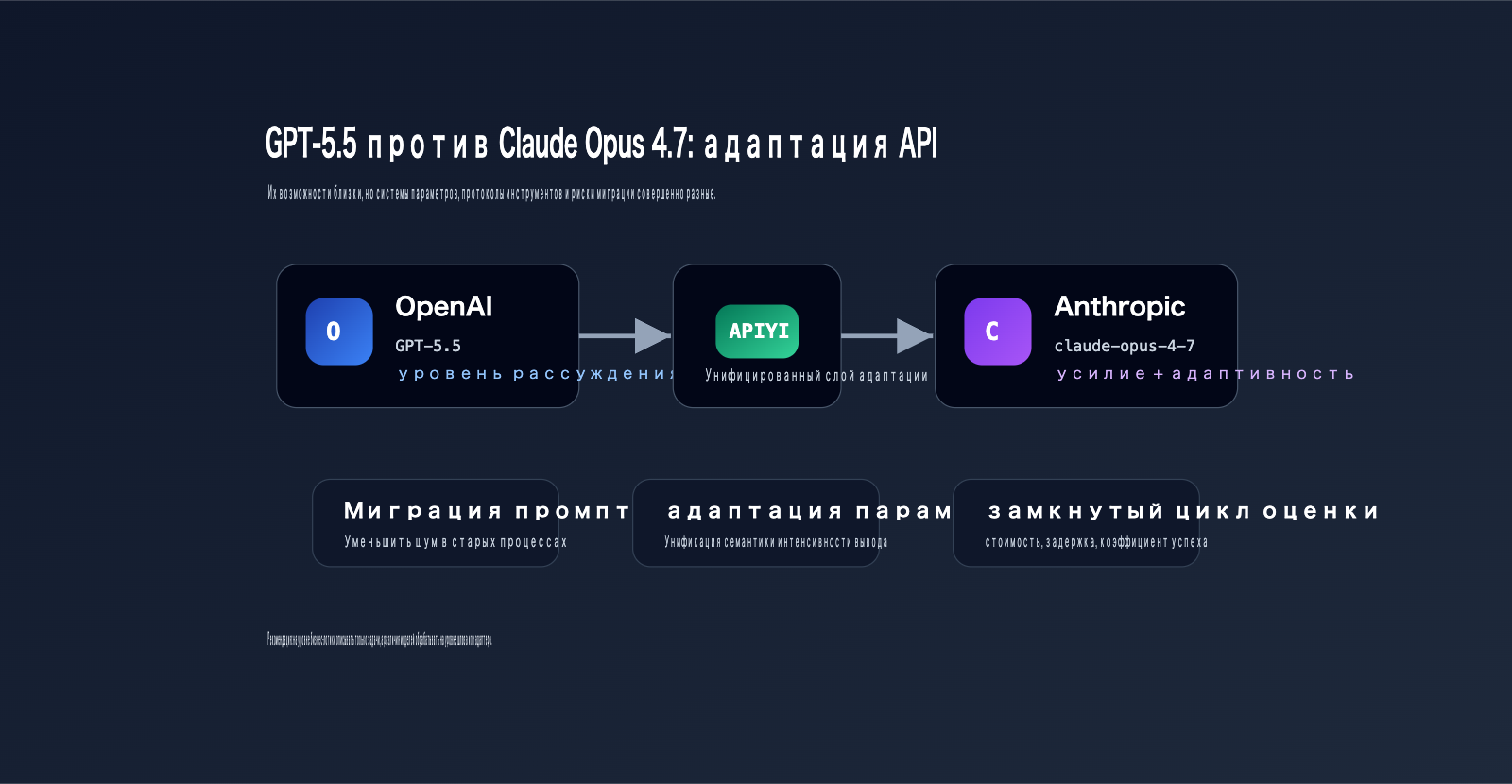

Миграция между API GPT-5.5 и Claude Opus 4.7 — задача не из легких.

GPT-5.5 относится к экосистеме моделей OpenAI, где ключевыми параметрами являются model, reasoning_effort, вызовы инструментов Responses API и управление форматом вывода.

Claude Opus 4.7 принадлежит к экосистеме Anthropic Messages API, где основными параметрами выступают adaptive thinking, effort, task budget, max_tokens и вызовы инструментов.

Согласно документации Anthropic, в Claude Opus 4.7 были удалены extended thinking budgets.

Старый формат записи thinking: {"type": "enabled", "budget_tokens": N} теперь будет возвращать ошибку 400.

Теперь следует использовать thinking: {"type": "adaptive"} и настраивать effort через output_config.

В Anthropic также уточнили, что начиная с Claude Opus 4.7, установка нестандартных значений temperature, top_p или top_k будет приводить к ошибке 400.

Для многих старых проектов это важный момент при миграции.

Если вы ранее полагались на temperature=0 для получения детерминированного вывода, стоит помнить: temperature=0 и раньше не гарантировал полной идентичности ответов.

В свою очередь, при миграции на GPT-5.5 основной упор делается на переработку промптов, оценку reasoning_effort, рабочие процессы с инструментами и промпты, ориентированные на результат.

Ключевые аспекты миграции API: GPT-5.5 vs Claude Opus 4.7

| Параметр миграции | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| ID модели | gpt-5.5 |

claude-opus-4-7 |

| Управление рассуждением | reasoning_effort | effort + adaptive thinking |

| Длинный контекст | 1M context window | 1M context window |

| Лимит вывода | Согласно спецификации OpenAI API | 128k max output |

| Параметр температуры | Настройка согласно поддержке OpenAI API | Нестандартные temperature/top_p/top_k вызывают ошибку |

| Рабочие процессы с инструментами | Система инструментов Responses API | Система инструментов Messages API |

| Риски миграции | Избыточная спецификация в старых промптах | thinking budget и устаревшие параметры выборки |

Совет: Если вам нужно интегрировать и GPT-5.5, и Claude Opus 4.7, не рекомендуется прописывать две разные логики вызова в бизнес-коде. Можно использовать сервис-прокси API APIYI (apiyi.com) для создания единой точки входа, совместимой с OpenAI, а различия в моделях, параметрах и обработке ошибок вынести на уровень шлюза или адаптера.

Сравнение GPT-5.5 и Claude Opus 4.7: выбор по стоимости и производительности

При выборе между GPT-5.5 и Claude Opus 4.7 нельзя ориентироваться только на цену за токен.

Согласно официальным данным OpenAI, стоимость API GPT-5.5 составляет 5 долларов за миллион входных токенов и 30 долларов за миллион выходных токенов.

В обзоре моделей Anthropic указано, что Claude Opus 4.7 стоит 5 долларов за миллион входных токенов и 25 долларов за миллион выходных токенов.

Если смотреть только на стоимость вывода, Claude Opus 4.7 выглядит выгоднее.

Однако OpenAI подчеркивает, что GPT-5.5 более эффективно расходует токены в Codex по сравнению с GPT-5.4.

Anthropic, в свою очередь, отмечает, что Claude Opus 4.7 позволяет контролировать расходы за счет параметров effort (усилия), task budget (бюджет задачи) и адаптивного мышления.

Поэтому реальная стоимость зависит от специфики ваших задач.

Если GPT-5.5 справляется с задачей за меньшее количество итераций, итоговая стоимость может оказаться ниже.

Если же Claude Opus 4.7 при настройках xhigh или max effort потребляет огромное количество выходных токенов, общие затраты могут вырасти.

Оценку стоимости следует проводить по «полной цене выполнения одной качественной задачи», а не просто по прайсу за миллион токенов.

Параметры оценки стоимости: GPT-5.5 vs Claude Opus 4.7

| Параметр стоимости | Что нужно фиксировать | Почему это важно |

|---|---|---|

| Входные токены | Промпт, контекст, результаты работы инструментов | Большая разница в стоимости при длинном контексте |

| Выходные токены | Итоговый ответ, параметры инструментов, логи рассуждений | Стоимость вывода обычно выше |

| Итерации | Сколько шагов нужно для выполнения задачи | Многошаговость увеличивает расходы |

| Успешность | Выполнение с первого раза или с правками | Повторные попытки — это скрытые расходы |

| Задержка | Время ожидания пользователя | Высокий уровень effort увеличивает задержку |

| Ручная проверка | Требуется ли участие человека | Низкое качество перекладывает расходы на людей |

Рекомендация: для корпоративных приложений оптимизация затрат на модели — это не просто выбор самого дешевого варианта. Рекомендуем использовать APIYI (apiyi.com) для отслеживания входных и выходных данных, задержек, параметров моделей и оценок качества. Используйте «стоимость качественного выполнения задачи» в качестве ключевого показателя.

Выбор сценариев использования: GPT-5.5 vs Claude Opus 4.7

Если вы индивидуальный разработчик, выбирайте между GPT-5.5 и Claude Opus 4.7 исходя из экосистемы инструментов.

Часто работаете с Codex? Начните с тестирования GPT-5.5.

Предпочитаете Claude Code? Тестируйте Claude Opus 4.7.

Если вы технический руководитель в компании, не принимайте решение на основе личных ощущений.

Вам стоит создать набор тестовых задач и сравнить обе модели в одинаковых условиях: с идентичными промптами, критериями оценки и учетом затрат.

Для контент-команд: GPT-5.5 стоит протестировать в первую очередь для работы со структурированным контентом, аналитическими исследованиями, таблицами и задачами, требующими использования нескольких инструментов.

Claude Opus 4.7 лучше проявит себя в задачах, требующих осторожности в формулировках, работы с длинным контекстом, визуальными материалами и проверкой документов.

Если вы развиваете API-платформу или SaaS-продукт, рекомендуем внедрить маршрутизацию моделей (model routing).

Например, простые вопросы можно направлять на более дешевые модели, а сложные задачи по написанию кода или работу с длинными агентами — переключать на GPT-5.5 или Claude Opus 4.7.

Это позволит избежать лишних затрат, не отправляя все запросы на флагманские модели.

Чек-лист для миграции: GPT-5.5 vs Claude Opus 4.7

Не ограничивайтесь разовым субъективным тестированием перед запуском.

Рекомендую подготовить как минимум 5 категорий примеров:

- Успешные кейсы — то, что уже работает хорошо.

- Граничные случаи — примеры, на которых модель часто ошибается.

- Длинный контекст — задачи с большим объемом входных данных.

- Вызов инструментов — проверка работы с внешними функциями.

- Восстановление после сбоев — как модель ведет себя при ошибках.

Для каждого примера фиксируйте модель, параметры, количество входных и выходных токенов, время выполнения, успешность с первой попытки и экспертную оценку.

Также обязательно тестируйте как бюджетные варианты, так и модели с высокой производительностью.

- Для GPT-5.5 можно варьировать параметр

reasoning_effort. - Для Claude Opus 4.7 стоит протестировать уровни

medium,high,xhighиmax effort.

Не стоит по умолчанию выставлять максимальные настройки для обоих моделей. Максимальные параметры показывают лишь «потолок» возможностей, а не экономическую эффективность в продакшене.

Как интерпретировать данные тестирования GPT-5.5 vs Claude Opus 4.7?

Публичные бенчмарки для GPT-5.5 и Claude Opus 4.7 полезны, но они не гарантируют аналогичных результатов в ваших бизнес-задачах.

Причина проста: публичные тесты обычно используют фиксированные наборы задач, промпты, среду выполнения и критерии оценки.

Ваша же система столкнется с «грязными» данными, нехваткой контекста, нечеткими запросами пользователей, сбоями инструментов, ограничениями прав доступа и «багажом» старых промптов.

Поэтому, если GPT-5.5 лидирует в каком-то бенчмарке, это не значит, что нужно переводить на него все задачи. И если Claude Opus 4.7 показывает лучшие результаты в другом тесте, это не повод слепо переключаться на него.

Более надежный подход — использовать официальные бенчмарки как ориентир для оценки способностей модели:

- Terminal-Bench 2.0 лучше отражает навыки работы со сложными рабочими процессами в командной строке.

- SWE-Bench Pro ближе к реальной способности исправлять GitHub-ишью.

- GDPval лучше оценивает способность предоставлять экспертные знания.

- Визуальные бенчмарки и поддержка высокого разрешения помогут оценить задачи, связанные со скриншотами, графиками, интерфейсами и версткой документов.

При внедрении важно соотнести эти метрики с вашим продуктом:

- Если это IDE-ассистент, приоритет — успешность исправления кода, прохождение тестов, отсутствие лишних правок и качество пояснений.

- Если это корпоративная база знаний, приоритет — точность цитирования, отсутствие фактических ошибок, обработка противоречий и границы отказа от ответа.

- Если это автоматизированный агент, приоритет — количество вызовов инструментов, восстановление после сбоев, процент завершенных задач и общая стоимость.

- Если это обработка визуальных документов, приоритет — распознавание координат, транскрипция графиков, понимание верстки и затраты на ручную корректировку.

Ценность APIYI (apiyi.com) заключается в том, что вы можете проводить все эти тесты через единый интерфейс. Одинаковые входные данные, идентичные критерии оценки и унифицированные логи — это единственный способ сделать выводы о сравнении GPT-5.5 и Claude Opus 4.7 по-настоящему применимыми на практике.

FAQ: GPT-5.5 против Claude Opus 4.7

Кто лучше справляется с написанием кода: GPT-5.5 или Claude Opus 4.7?

Обе модели отлично подходят для этих задач.

GPT-5.5 показывает лучшие результаты в Terminal-Bench 2.0, что делает её идеальной для сложных процессов в командной строке и рабочих процессов Codex.

Claude Opus 4.7 демонстрирует впечатляющие показатели в SWE-Bench Pro и отлично справляется с длительными агентскими задачами в Claude Code.

Для реальных проектов рекомендуем провести A/B-тестирование на одинаковом наборе issue и тестовых команд.

Кто лучше подходит для ответов на вопросы по базе знаний?

Если ваша цель — структурированная генерация и работа с множеством инструментов, в первую очередь протестируйте GPT-5.5.

Если же приоритет — поиск недостающих данных, осторожность в формулировках и строгая работа с длинным контекстом, лучше начать с Claude Opus 4.7.

В конечном итоге ориентируйтесь на точность цитирования и затраты на ручную проверку.

Кто лучше справляется с визуальными задачами?

В официальной документации Claude Opus 4.7 заявлена расширенная поддержка изображений высокого разрешения.

Если ваши задачи связаны со скриншотами, определением координат, версткой документов и визуальной проверкой, Claude Opus 4.7 заслуживает приоритетного тестирования.

GPT-5.5 также подходит для мультимодальных рабочих процессов, но для задач, где визуальная составляющая является основной, стоит провести отдельное сравнение.

Кто дешевле?

Согласно официальным тарифам, стоимость входных токенов у обеих моделей составляет 5 долларов за миллион токенов.

Стоимость выходных токенов у Claude Opus 4.7 — 25 долларов за миллион, у GPT-5.5 — 30 долларов за миллион.

Однако реальная стоимость зависит от количества итераций, необходимых для выполнения задачи, длины вывода, частоты ошибок и затрат на ручную корректировку.

Итог: GPT-5.5 против Claude Opus 4.7

Универсального ответа на вопрос, что лучше, не существует.

GPT-5.5 лучше подходит для рабочих процессов с использованием множества инструментов, кодинга в стиле Codex, генерации таблиц, интеллектуальной работы и выполнения сложных задач.

Claude Opus 4.7 эффективнее в задачах с визуалом высокого разрешения, длительных агентских процессах, строгом следовании инструкциям, работе с памятью файлов и аккуратной обработке данных.

Если вы частный пользователь, выбирайте модель исходя из экосистемы инструментов, которыми привыкли пользоваться.

Если вы корпоративный клиент, обязательно проводите тестирование на реальных данных.

Если вы API-разработчик, рекомендуем выносить различия моделей на уровень адаптера, чтобы не «зашивать» жесткую привязку к GPT-5.5 или Claude Opus 4.7 в бизнес-логику.

APIYI (apiyi.com) отлично подходит в качестве единой точки входа для моделей, позволяя вести учет вызовов, отслеживать затраты и переключаться между моделями.

Наш совет: используйте GPT-5.5 для сложных задач с множеством инструментов, Claude Opus 4.7 — для высокоточных визуальных и агентских задач, а простые запросы делегируйте более дешевым моделям, постоянно корректируя маршрутизацию на основе данных тестирования.

Ссылки:

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort