GPT-5.5와 Claude Opus 4.7은 2026년 상반기 개발자들이 가장 주목하는 플래그십 모델 대결 중 하나입니다.

두 모델 모두 단순한 챗봇이 아닙니다.

GPT-5.5는 에이전트 기반 코딩(agentic coding), 컴퓨터 사용, 지식 업무 및 과학 연구 분석에 더 중점을 둡니다.

반면, Claude Opus 4.7은 복잡한 추론, 장기 에이전트 작업, 고해상도 시각적 이해, 기억력, 그리고 더욱 엄격한 지시사항 준수에 초점을 맞추고 있습니다.

단순히 "어느 쪽이 더 강력한가?"라고 묻는 것은 너무 단순한 접근입니다.

더 실용적인 질문은 다음과 같아야 합니다. "당신의 작업이 코드 수정, 지식 베이스 질의응답, 긴 컨텍스트 분석, 시각적 이해, 자동화된 에이전트 작업인가요, 아니면 고비용의 프로덕션 API 호출인가요?"

작업의 성격에 따라 GPT-5.5와 Claude Opus 4.7의 선택은 확연히 달라집니다.

OpenAI는 GPT-5.5를 공식 발표하면서 Claude Opus 4.7을 여러 평가 지표에 직접 포함시켰습니다.

Anthropic 또한 Claude Opus 4.7을 현재 가장 강력한 범용 모델로 포지셔닝하며, 에이전트 기반 코딩, 지식 업무, 시각적 작업 및 기억력 분야에서의 향상을 강조하고 있습니다.

본 글은 영어 공식 자료를 바탕으로 정리되었으며, 중국어 2차 자료는 인용하지 않았습니다.

참고로, 본문에서 언급하는 'Claude 4.7'은 정확히 'Claude Opus 4.7'을 의미합니다.

이 글을 작성하는 시점 기준으로, Anthropic 공식 자료에는 Claude Sonnet 4.7의 출시 소식이 없습니다.

GPT-5.5 vs Claude Opus 4.7 핵심 결론

GPT-5.5와 Claude Opus 4.7의 첫 번째 차이점은 모델의 포지셔닝입니다.

OpenAI는 GPT-5.5를 실제 워크플로우에 더 적합한 모델로 정의합니다.

이 모델은 코딩, 디버깅, 온라인 리서치, 데이터 분석, 문서 및 표 생성, 그리고 도구 간 협업을 통한 작업 완성을 강조합니다.

Anthropic은 Claude Opus 4.7을 가장 강력한 범용 모델로 정의합니다.

이 모델은 복잡한 추론, 에이전트 기반 코딩, 장기 작업, 시각적 이해, 기억력 및 자기 검증을 강조합니다.

만약 작업이 Codex 내의 복잡한 엔지니어링 프로젝트, 파일 간 수정, 도구 호출 및 지식 업무라면 GPT-5.5를 우선적으로 테스트하는 것이 좋습니다.

반면 작업이 Claude Code를 활용한 장기 에이전트 작업, 시각적 스크린샷 이해, 문서 레이아웃 검증, 파일 시스템 기억 및 엄격한 지시사항 준수라면 Claude Opus 4.7을 우선적으로 고려하세요.

두 모델을 모두 통합하여 사용해야 한다면, APIYI(apiyi.com)를 통해 다중 모델 라우팅 및 평가를 수행하여 비즈니스 코드에 모델 선택을 고정하지 않는 것을 권장합니다.

GPT-5.5 vs Claude Opus 4.7 빠른 비교

| 구분 | GPT-5.5 | Claude Opus 4.7 | 선택 제안 |

|---|---|---|---|

| 공식 포지셔닝 | 실제 워크플로우 및 에이전트 AI | 최강의 범용 Claude 모델 | 작업 유형에 따라 선택 |

| 코딩 능력 | Terminal-Bench 2.0에서 강력함 | 에이전트 기반 코딩 대폭 향상 | 모두 실무 테스트 권장 |

| 긴 컨텍스트 | API 최대 1M 컨텍스트 | 1M 컨텍스트 윈도우 | 모두 긴 컨텍스트에 적합 |

| 시각적 능력 | 멀티모달 및 도구 협업 | 고해상도 이미지 지원 | 시각 중심 작업은 Claude 추천 |

| 추론 제어 | reasoning_effort | effort / adaptive thinking | 파라미터 체계 상이 |

| API 비용 | 입력 $5 / 출력 $30 (100만 토큰당) | 입력 $5 / 출력 $25 (100만 토큰당) | Claude 출력 비용이 더 저렴 |

| 생태계 접근 | ChatGPT, Codex, API | Claude, Claude Code, API | 워크플로우에 따라 결정 |

선택 제안: GPT-5.5와 Claude Opus 4.7 중 무엇이 더 적합한지 결정하기 어렵다면, 30~50개의 실제 비즈니스 샘플을 준비하여 APIYI(apiyi.com)를 통해 두 모델을 동시에 실행해 보고, 성공률, 응답 시간, 비용 및 수동 평가 결과를 비교해 보세요.

GPT-5.5 vs Claude Opus 4.7 코딩 능력 비교

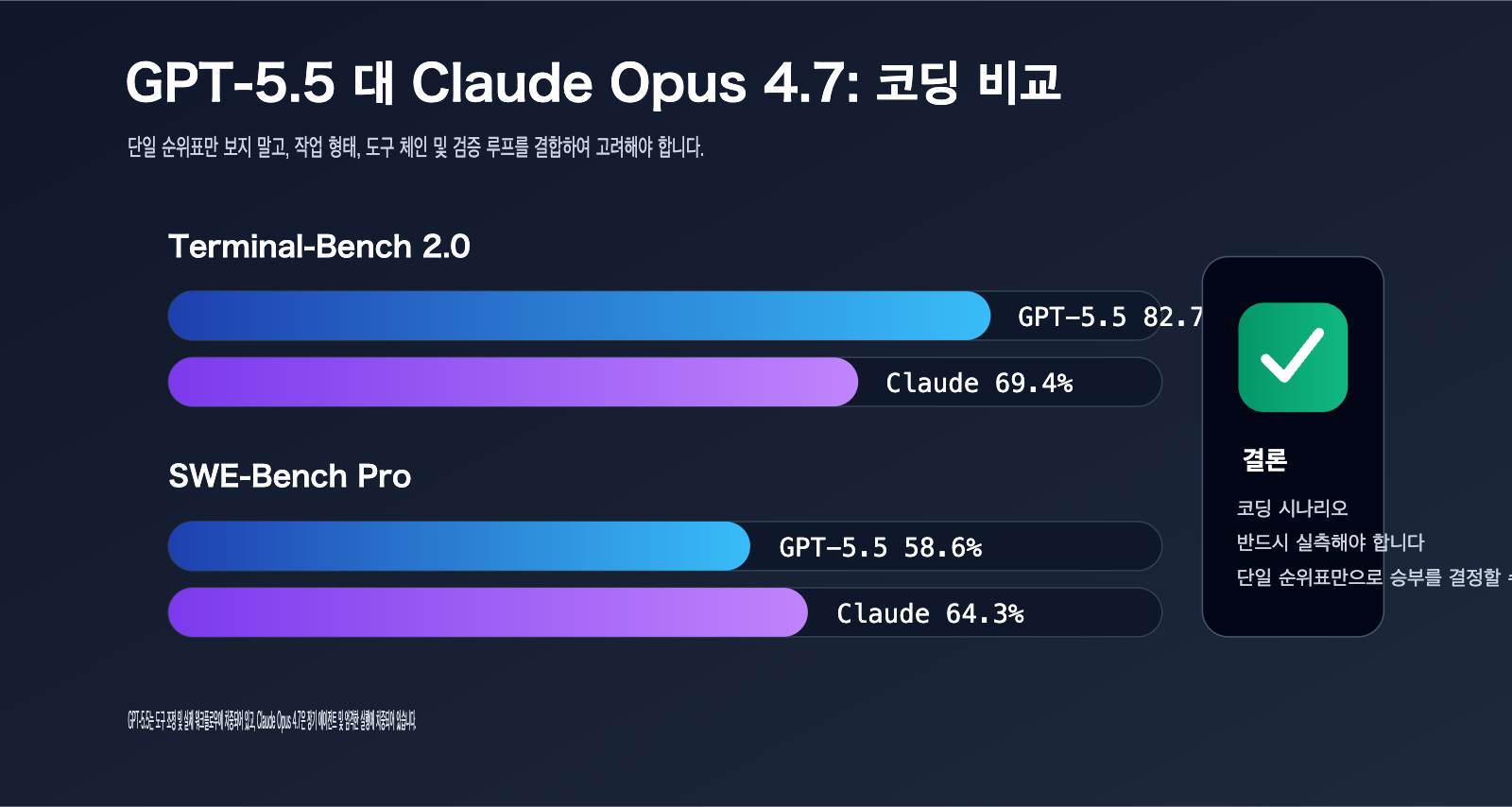

코딩은 GPT-5.5와 Claude Opus 4.7을 비교하는 가장 핵심적인 영역입니다.

OpenAI 공식 데이터에 따르면, GPT-5.5는 Terminal-Bench 2.0에서 82.7%의 성능을 기록했습니다. 같은 지표에서 Claude Opus 4.7은 69.4%를 기록했죠. 반면, SWE-Bench Pro 공개 평가에서는 GPT-5.5가 58.6%, Claude Opus 4.7이 64.3%를 기록했습니다.

이는 두 모델 중 어느 하나가 일방적으로 우세하지 않다는 것을 보여줍니다.

- GPT-5.5: 명령줄 복잡한 워크플로우, 계획 수립, 반복 작업 및 도구 조정에서 더 뛰어난 성능을 보입니다.

- Claude Opus 4.7: GitHub 이슈 해결 유형의 작업에서 매우 강력한 경쟁력을 갖추고 있습니다.

Anthropic 공식 자료에 따르면, Claude Opus 4.7은 자체적인 93개 작업 코딩 벤치마크에서 이전 버전인 Opus 4.6 대비 13% 향상된 성능을 보였습니다. 이는 Claude Opus 4.7의 코딩 능력이 확실히 개선되었음을 의미합니다.

하지만 특정 벤치마크 하나만으로 전체를 판단할 수는 없습니다. 실제 코딩 업무에는 기존 코드 이해, 위험 식별, 변경 범위 제어, 테스트 보완, 명령어 실행, 실패 처리, 변경 사항 설명 및 리뷰 노트 생성 등 다양한 과정이 포함되기 때문입니다.

- GPT-5.5: Codex 시나리오에서 도구 간 실행과 더 적은 토큰으로 작업을 완료하는 효율성을 강조합니다.

- Claude Opus 4.7: Claude Code 시나리오에서 장기 에이전트 작업, 높은 노력(xhigh effort) 투입, 그리고 엄격한 지시 사항 준수를 강조합니다.

GPT-5.5 vs Claude Opus 4.7 코딩 시나리오 추천

| 코딩 작업 | 우선 테스트 추천 | 이유 |

|---|---|---|

| 명령줄 복잡한 워크플로우 | GPT-5.5 | Terminal-Bench 2.0 공식 점수 우위 |

| GitHub 이슈 해결 | Claude Opus 4.7 / GPT-5.5 모두 | SWE-Bench Pro는 Claude 우위, GPT-5.5는 생태계 강점 |

| 대규모 코드베이스 이해 | GPT-5.5 | Codex 시나리오의 시스템 간 컨텍스트 강점 |

| 장기 에이전트 작업 | Claude Opus 4.7 | xhigh effort 및 작업 예산 최적화 |

| 코드 리뷰 및 검증 | 둘 다 적합 | 테스트 루프 완성도 확인 필요 |

| 비용 민감형 대량 수정 | 실측 필요 | 토큰 사용 패턴 차이 큼 |

선택 가이드: 코딩 모델을 고를 때 순위표만 보지 마세요. 실제 이슈, 실패한 테스트, PR 리뷰 및 리팩토링 작업을 APIYI(apiyi.com)에서 비교 평가해 보시길 권장합니다. 각 모델이 실제로 테스트를 수행하는지, 관련 없는 파일을 잘못 수정하지 않는지, 위험 요소를 제대로 설명하는지 기록해 보세요.

GPT-5.5 vs Claude Opus 4.7 지식 업무 및 연구 능력

지식 업무 영역에서의 비교 또한 매우 중요합니다. OpenAI 공식 자료에 따르면 GPT-5.5는 GDPval에서 84.9%를 기록했으며, Claude Opus 4.7은 80.3%를 기록했습니다. GPT-5.5 Pro는 82.3%를 나타냈습니다. 이는 OpenAI가 제시한 전문 지식 업무 평가에서 GPT-5.5가 매우 강력한 성능을 보여줌을 의미합니다.

OpenAI는 GPT-5.5가 문서, 표, 프레젠테이션 생성 및 운영 연구와 비즈니스 입력 처리 분야에서 눈에 띄는 향상을 보였다고 강조합니다.

반면, Anthropic의 Claude Opus 4.7은 지식 업무, 메모리, 비전 및 장기 에이전트 작업에서 뛰어난 성능을 보입니다. 특히 '데이터 규율(Data Discipline)'이 강점입니다. Hex의 평가를 인용하면, Claude Opus 4.7은 데이터가 부족할 때 그럴듯하지만 틀린 답변을 내놓기보다 데이터가 부족함을 명확히 밝히는 경향이 있습니다. 이는 금융 분석, 연구 보고서, 규정 준수 검토 및 데이터 표 처리에서 매우 중요합니다.

비즈니스 문서를 아름답고 완벽하며 구조적으로 명확하게 작성해야 한다면 GPT-5.5를, 데이터가 부족하거나 상충하는 상황에서 신중함을 유지해야 한다면 Claude Opus 4.7을 추천합니다.

GPT-5.5 vs Claude Opus 4.7 지식 업무 선택

| 시나리오 | GPT-5.5 강점 | Claude Opus 4.7 강점 | 추천 |

|---|---|---|---|

| 비즈니스 보고서 | 구조화된 생성 능력 | 데이터 규율 | 둘 다 비교 |

| 표 분석 | Codex 문서 표 처리 능력 | 시각적 검증 및 차트 분석 | 입력 형태에 따라 선택 |

| 금융 연구 | GDPval 성능 우위 | 일반 금융 모듈 향상 | 실제 샘플로 테스트 |

| 규정 준수 검토 | 종합 능력 우위 | 데이터 부족 시 신중함 | Claude 우선 테스트 |

| 다중 문서 요약 | 긴 컨텍스트 강점 | 메모리 및 엄격한 지시 준수 | 인용 품질에 따라 선택 |

선택 가이드: 지식 업무에서 가장 위험한 것은 "완벽해 보이지만 실제로는 환각(Hallucination)이 있는 경우"입니다. APIYI(apiyi.com)에서 비교 테스트를 진행할 때, 인공 평가 항목을 사실 정확성, 인용 일관성, 누락률, 구조 품질, 실행 가능성 등 5가지 차원으로 세분화하여 평가해 보시길 권장합니다.

GPT-5.5 vs Claude Opus 4.7 시각 및 긴 컨텍스트 처리 능력

GPT-5.5와 Claude Opus 4.7 모두 긴 컨텍스트를 지원하지만, 세부적인 부분에서 차이가 있습니다.

OpenAI 공식 자료에 따르면, GPT-5.5 API는 1M 컨텍스트 윈도우를 제공합니다.

Anthropic 모델 개요에서는 Claude Opus 4.7 또한 1M 토큰의 컨텍스트 윈도우를 지원하며, 128k의 최대 출력(max output)을 제공한다고 밝히고 있습니다.

긴 컨텍스트 작업에서 두 모델 모두 대규모 문서, 코드베이스, 복잡한 자료 패키지를 처리할 수 있는 수준에 도달했습니다.

하지만 시각적 작업에서는 Claude Opus 4.7의 변화가 더욱 뚜렷합니다.

Anthropic 문서에 따르면, Claude Opus 4.7은 고해상도 이미지를 지원하는 최초의 Claude 모델로, 최대 이미지 해상도가 2576px / 3.75MP까지 향상되었습니다.

이는 스크린샷 이해, 문서 이미지, 슬라이드 검증, 차트 분석 및 컴퓨터 사용(computer use) 기능에 매우 중요합니다.

또한 Anthropic은 이미지 좌표가 이제 실제 픽셀과 1:1로 대응되어 좌표 변환 과정이 줄어들었다고 언급했습니다.

GPT-5.5 역시 강력한 멀티모달 및 컴퓨터 사용 능력을 갖추고 있지만, 고해상도 스크린샷, 차트, 문서 레이아웃 또는 UI 좌표가 입력의 핵심이라면 Claude Opus 4.7을 우선적으로 테스트해 볼 가치가 있습니다.

반면 긴 텍스트, 코드베이스, 비즈니스 문서, 구조화된 자료 및 도구 체인 결과가 주요 입력값이라면, GPT-5.5와 Claude Opus 4.7 모두 동일한 샘플로 평가해 보는 것이 좋습니다.

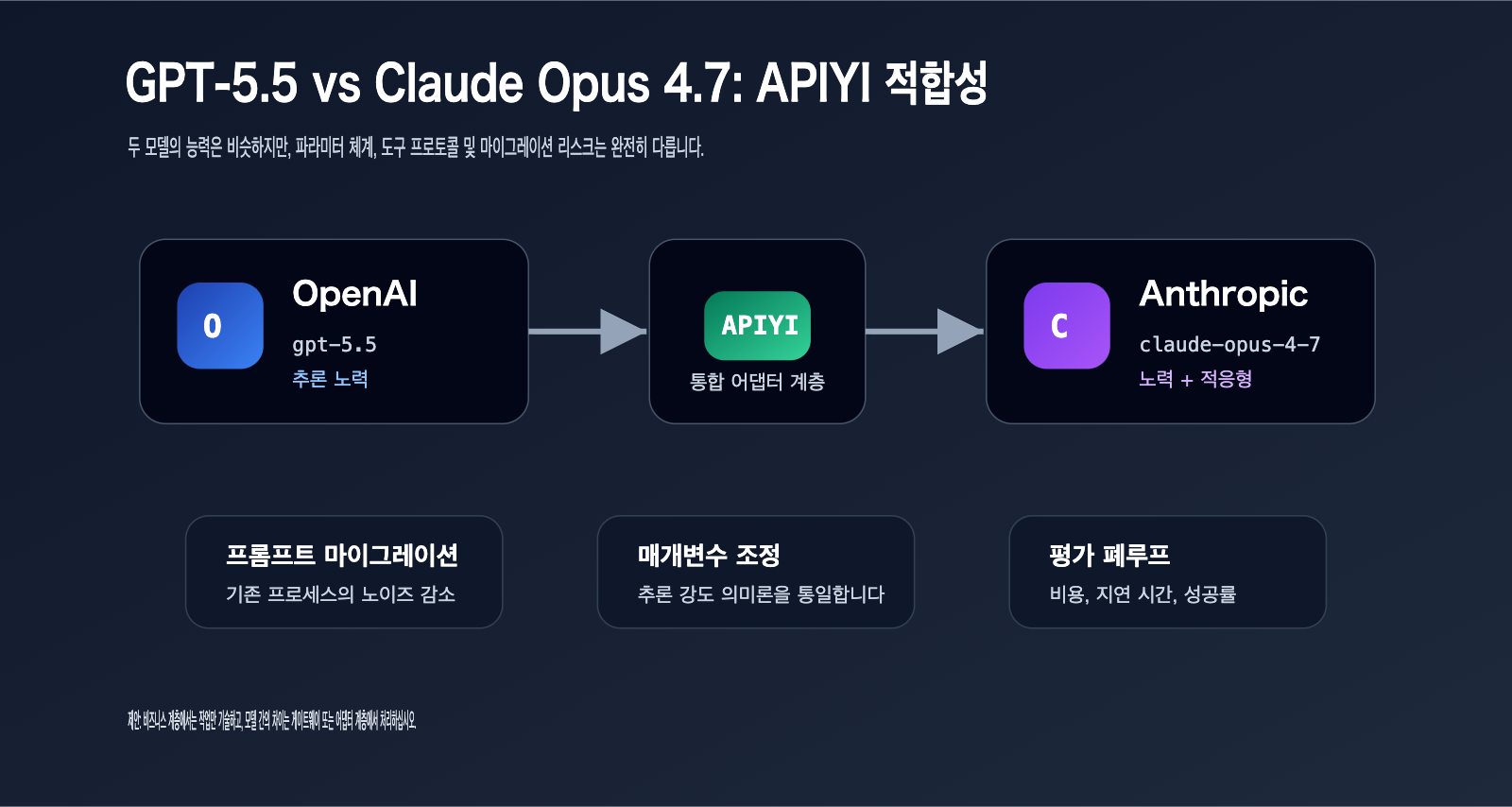

GPT-5.5 vs Claude Opus 4.7 API 매개변수 및 마이그레이션 차이

GPT-5.5와 Claude Opus 4.7 간의 API 마이그레이션 차이는 매우 큽니다.

GPT-5.5는 OpenAI 모델 체계에 속하며, 주요 매개변수로는 model, reasoning_effort, Responses API 도구 호출 및 출력 형식 제어 등이 있습니다.

Claude Opus 4.7은 Anthropic Messages API 체계에 속하며, 주요 매개변수로는 adaptive thinking, effort, task budget, max_tokens 및 도구 호출이 포함됩니다.

Anthropic 공식 문서에 따르면, Claude Opus 4.7은 extended thinking budgets를 제거했습니다.

기존의 thinking: {"type": "enabled", "budget_tokens": N} 방식은 400 에러를 반환합니다.

새로운 방식은 thinking: {"type": "adaptive"}를 사용하고, output_config를 통해 effort를 설정해야 합니다.

또한 Anthropic은 Claude Opus 4.7부터 기본값이 아닌 temperature, top_p 또는 top_k를 설정할 경우 400 에러가 발생한다고 명시했습니다.

이는 많은 기존 프로젝트에서 중요한 마이그레이션 포인트입니다.

만약 이전에 temperature=0을 사용하여 결정론적 출력을 얻고자 했다면 다시 고려해야 합니다. 사실 temperature=0이라고 해서 항상 완전히 동일한 결과가 보장되는 것은 아니었으니까요.

반면, GPT-5.5의 마이그레이션 중점은 프롬프트 재구성, reasoning_effort 평가, 도구 워크플로우 및 결과 우선 프롬프트에 맞춰져 있습니다.

GPT-5.5 vs Claude Opus 4.7 API 마이그레이션 핵심

| 마이그레이션 항목 | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| 모델 ID | gpt-5.5 |

claude-opus-4-7 |

| 추론 제어 | reasoning_effort | effort + adaptive thinking |

| 긴 컨텍스트 | 1M context window | 1M context window |

| 출력 제한 | OpenAI API 사양 준수 | 128k max output |

| 온도 매개변수 | OpenAI API 지원에 따라 구성 | 기본값 외 설정 시 에러 발생 |

| 도구 워크플로우 | Responses API 도구 체계 | Messages API 도구 체계 |

| 마이그레이션 위험 | 기존 프롬프트의 과도한 지정 | thinking budget 및 샘플링 관련 기존 매개변수 |

선택 제안: GPT-5.5와 Claude Opus 4.7을 동시에 도입해야 한다면, 비즈니스 코드에 두 가지 호출 로직을 분산하여 작성하는 것은 권장하지 않습니다. APIYI(apiyi.com)를 통해 통합된 OpenAI 호환 엔트리를 활용하고, 모델 간 차이, 매개변수 차이 및 오류 처리는 게이트웨이 계층이나 어댑터 계층에서 관리하는 것이 효율적입니다.

GPT-5.5 vs Claude Opus 4.7 비용 및 성능 선택 가이드

GPT-5.5와 Claude Opus 4.7의 비용을 단순히 단가만으로 비교해서는 안 됩니다.

OpenAI 공식 자료에 따르면, GPT-5.5 API 가격은 입력 토큰 100만 개당 5달러, 출력 토큰 100만 개당 30달러입니다.

반면 Anthropic 모델 개요를 보면, Claude Opus 4.7은 입력 토큰 100만 개당 5달러, 출력 토큰 100만 개당 25달러로 책정되어 있습니다.

출력 가격만 놓고 보면 Claude Opus 4.7이 더 저렴해 보입니다.

하지만 OpenAI는 GPT-5.5가 Codex 환경에서 이전 버전인 GPT-5.4보다 훨씬 더 효율적인 토큰 사용량을 보여준다고 강조합니다.

Anthropic 역시 Claude Opus 4.7이 노력(effort), 작업 예산(task budget), 적응형 사고(adaptive thinking)를 통해 비용을 제어한다고 설명합니다.

결국 실제 비용은 어떤 형태의 작업을 수행하느냐에 따라 달라집니다.

만약 GPT-5.5가 더 적은 대화 턴으로 작업을 완료한다면, 전체 비용은 오히려 더 낮을 수 있습니다.

반대로 Claude Opus 4.7이 xhigh 또는 max effort 설정에서 많은 출력 토큰을 소모한다면 전체 비용이 상승할 수도 있죠.

따라서 비용 평가는 단순히 100만 토큰당 단가가 아니라, '하나의 완성된 작업을 처리하는 데 드는 총비용'을 기준으로 삼아야 합니다.

GPT-5.5 vs Claude Opus 4.7 비용 평가 항목

| 비용 항목 | 기록 내용 | 중요성 |

|---|---|---|

| 입력 토큰 | 프롬프트, 컨텍스트, 도구 결과 | 긴 컨텍스트 작업 시 비용 차이 발생 |

| 출력 토큰 | 최종 답변, 도구 파라미터, 추론 관련 출력 | 출력 단가가 일반적으로 더 비쌈 |

| 대화 턴 | 작업 완료까지 필요한 턴 수 | 턴이 많아질수록 비용 증폭 |

| 성공률 | 한 번에 완료 vs 반복 수정 | 실패 후 재시도는 숨은 비용 |

| 지연 시간 | 사용자가 대기하는 시간 | 높은 effort 설정은 대기 시간 증가 |

| 인적 검토 | 사람이 직접 수정해야 하는지 여부 | 품질 저하는 비용 전가로 이어짐 |

선택 제안: 기업용 애플리케이션의 경우, 모델 비용 최적화는 단순히 저렴한 모델을 선택하는 것이 아닙니다. APIYI(apiyi.com)를 통해 매 호출 시 입력, 출력, 지연 시간, 모델, 파라미터 및 인적 평가 점수를 기록하고, '합격 작업당 비용'을 최종 지표로 활용하는 것을 추천합니다.

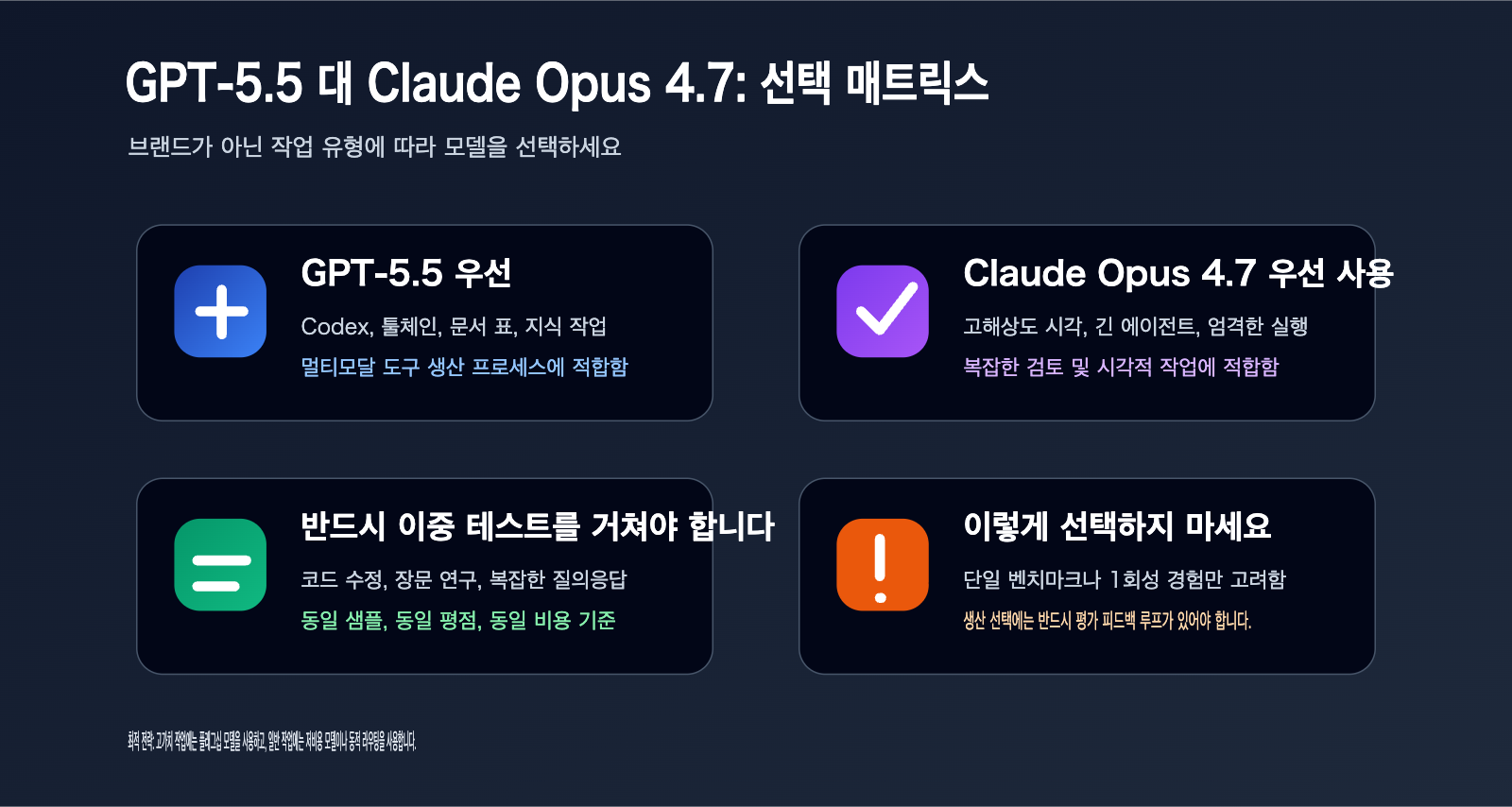

GPT-5.5 vs Claude Opus 4.7 활용 시나리오 결정

개인 개발자라면 도구 생태계에 맞춰 GPT-5.5와 Claude Opus 4.7 중 선택할 수 있습니다.

평소 Codex를 자주 사용한다면 GPT-5.5를 먼저 테스트해 보세요.

반대로 Claude Code를 주로 사용한다면 Claude Opus 4.7이 더 적합할 것입니다.

기업의 기술 책임자라면 개인적인 경험에 의존해 결정해서는 안 됩니다.

작업 세트를 구축하여 두 모델을 동일한 입력, 출력, 평가 및 비용 기록 시스템 하에서 비교해야 합니다.

콘텐츠 팀이라면 구조화된 콘텐츠, 연구 정리, 표 작업 및 멀티 도구 활용 작업에서 GPT-5.5를 우선 테스트해 볼 가치가 있습니다.

Claude Opus 4.7은 신중한 표현, 긴 컨텍스트 처리, 시각 자료 분석 및 파일 검증 작업에서 우선적으로 테스트해 보길 권장합니다.

API 플랫폼이나 SaaS 제품을 운영 중이라면 모델 라우팅을 도입하는 것이 좋습니다.

예를 들어, 일반적인 질의응답은 비용이 저렴한 모델로 처리하고, 복잡한 코드 작성이나 긴 에이전트 작업은 GPT-5.5나 Claude Opus 4.7로 업그레이드하는 방식입니다.

이렇게 하면 모든 요청이 플래그십 모델로 몰리는 것을 방지하여 효율적으로 운영할 수 있습니다.

GPT-5.5 vs Claude Opus 4.7 마이그레이션 체크리스트

서비스 배포 전, 단순히 주관적인 경험에만 의존해서는 안 됩니다. 최소 5가지 유형의 샘플을 준비하는 것을 권장합니다.

- 첫 번째: 성공 샘플

- 두 번째: 오판하기 쉬운 경계 샘플

- 세 번째: 긴 컨텍스트 샘플

- 네 번째: 도구 호출 샘플

- 다섯 번째: 실패 복구 샘플

각 샘플마다 모델명, 파라미터, 입력 토큰, 출력 토큰, 소요 시간, 1회 성공 여부, 그리고 수동 평가 점수를 기록하세요.

또한, 저비용 등급과 고성능 등급을 각각 테스트해야 합니다.

- GPT-5.5 측: 다양한

reasoning_effort를 테스트할 수 있습니다. - Claude Opus 4.7 측:

medium,high,xhigh,max effort를 테스트할 수 있습니다.

두 모델 모두 무조건 최고 사양으로 설정하지 마세요. 최고 사양은 모델의 한계치를 보여줄 뿐, 실제 운영 환경에서의 가성비를 대변하지는 않습니다.

GPT-5.5 vs Claude Opus 4.7 평가 데이터, 어떻게 해석할까?

GPT-5.5와 Claude Opus 4.7의 공개 벤치마크는 참고할 가치가 충분하지만, 여러분의 비즈니스 결과와 동일하다고 볼 수는 없습니다.

이유는 간단합니다. 공개 평가는 보통 고정된 작업 세트, 고정된 프롬프트, 고정된 실행 환경 및 평가 규칙을 따르기 때문입니다.

반면, 여러분의 비즈니스 시스템은 데이터 오염, 컨텍스트 누락, 사용자의 모호한 표현, 도구 실패, 권한 제한, 그리고 기존 프롬프트의 부채 등 다양한 변수를 마주하게 됩니다.

따라서 GPT-5.5가 특정 벤치마크에서 앞선다고 해서 모든 작업을 GPT-5.5로 전환해야 하는 것은 아닙니다. 반대로 Claude Opus 4.7이 앞선다고 해서 무조건 Claude로 갈아타야 하는 것도 아니죠.

가장 현명한 방법은 공식 벤치마크를 모델의 능력 방향을 알려주는 '나침반'으로 활용하는 것입니다.

- Terminal-Bench 2.0: 복잡한 명령줄 워크플로우 능력을 확인하는 데 유용합니다.

- SWE-Bench Pro: 실제 GitHub 이슈 해결 능력과 가깝습니다.

- GDPval: 전문 지식 전달 능력을 평가하는 데 적합합니다.

- 시각적 벤치마크 및 고해상도 이미지 지원: 스크린샷, 차트, UI, 문서 레이아웃 관련 작업 판단에 유리합니다.

실제 적용 시에는 이러한 지표를 여러분의 제품 시나리오에 매핑해야 합니다.

- IDE 코딩 어시스턴트라면: 코드 수정 성공률, 테스트 통과율, 무관한 변경 비율, 설명 품질을 우선 확인하세요.

- 기업용 지식 베이스라면: 인용 정확도, 사실 누락률, 충돌 처리, 답변 거부 경계를 우선 확인하세요.

- 자동화 에이전트라면: 도구 호출 횟수, 실패 복구, 작업 완료율, 총비용을 우선 확인하세요.

- 시각적 문서 처리라면: 좌표 인식, 차트 전사, 레이아웃 이해도, 수동 수정 비용을 우선 확인하세요.

APIYI(apiyi.com)의 가치는 이러한 모델 테스트를 통합된 인터페이스에서 실행할 수 있게 해준다는 점에 있습니다. 동일한 입력, 동일한 평가 기준, 동일한 로그 필드를 사용해야만 GPT-5.5 vs Claude Opus 4.7 비교 결과가 진정한 의미를 갖게 됩니다.

GPT-5.5 vs Claude Opus 4.7 FAQ

GPT-5.5와 Claude Opus 4.7 중 코딩에 더 적합한 모델은 무엇인가요?

둘 다 훌륭한 선택지입니다.

GPT-5.5는 Terminal-Bench 2.0에서 더 강력한 성능을 보여주며, 복잡한 명령줄 프로세스나 Codex 워크플로우에 적합합니다.

반면 Claude Opus 4.7은 SWE-Bench Pro에서 매우 뛰어난 성과를 보이며, Claude Code를 활용한 장시간 에이전트 작업에 최적화되어 있습니다.

실제 프로젝트에 적용할 때는 동일한 이슈 세트와 테스트 명령어를 사용하여 두 모델을 모두 테스트해보는 것을 권장합니다.

GPT-5.5와 Claude Opus 4.7 중 지식 베이스 질의응답에 더 적합한 모델은 무엇인가요?

구조화된 생성과 다양한 도구를 활용한 정리가 중요하다면 GPT-5.5를 우선적으로 테스트해보세요.

반면 누락된 데이터 식별, 신중한 표현, 긴 컨텍스트 윈도우에서의 엄격한 준수가 중요하다면 Claude Opus 4.7이 더 나은 선택이 될 수 있습니다.

최종 선택은 인용 정확도와 인적 검토 비용을 고려하여 결정해야 합니다.

GPT-5.5와 Claude Opus 4.7 중 시각적 작업에 더 적합한 모델은 무엇인가요?

Claude Opus 4.7은 공식 문서에서 고해상도 이미지 지원을 명확히 밝히고 있습니다.

스크린샷 분석, 좌표 추출, 문서 레이아웃 파악, 시각적 검증이 포함된 작업이라면 Claude Opus 4.7을 우선적으로 테스트해보는 것이 좋습니다.

GPT-5.5 역시 멀티모달 워크플로우를 잘 지원하지만, 시각적 비중이 높은 작업이라면 별도의 평가가 필요합니다.

GPT-5.5와 Claude Opus 4.7 중 어떤 것이 더 저렴한가요?

공식 단가 기준으로 두 모델 모두 입력 비용은 100만 토큰당 5달러입니다.

출력 비용의 경우 Claude Opus 4.7은 100만 토큰당 25달러, GPT-5.5는 100만 토큰당 30달러입니다.

하지만 실제 비용은 작업 완료에 필요한 호출 횟수, 출력 길이, 실패율, 그리고 인적 수정 비용에 따라 달라진다는 점을 기억하세요.

GPT-5.5 vs Claude Opus 4.7 요약

GPT-5.5와 Claude Opus 4.7 중 모든 상황에 완벽한 정답은 없습니다.

GPT-5.5는 다중 도구 생산 워크플로우, Codex 코딩, 문서 및 표 생성, 지식 작업 및 복잡한 작업 실행에 더 적합합니다.

Claude Opus 4.7은 고해상도 시각 작업, 장기 에이전트 작업, 엄격한 지시 사항 준수, 파일 기억 및 신중한 데이터 처리에 강점이 있습니다.

개인 사용자라면 평소 사용하는 도구 생태계에 맞춰 선택하는 것이 좋고, 기업 사용자라면 반드시 실제 샘플 데이터로 평가를 진행해야 합니다.

API 개발자라면 모델 간 차이를 어댑터 계층에서 관리하여 특정 비즈니스 로직에 GPT-5.5나 Claude Opus 4.7을 종속시키지 않는 것이 좋습니다.

APIYI(apiyi.com)는 통합 모델 게이트웨이, 호출 기록 관리, 비용 모니터링 및 다중 모델 전환 역할을 수행하기에 최적화된 서비스입니다.

최종 제안: 복잡도가 높은 다중 도구 작업에는 GPT-5.5를, 고정밀 시각 작업 및 긴 에이전트 작업에는 Claude Opus 4.7을 사용하세요. 일반적인 요청은 저비용 모델로 처리하고, 평가 데이터를 기반으로 지속적으로 라우팅을 조정하는 전략을 추천합니다.

참고 자료:

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort