GPT-5.5 vs Claude Opus 4.7 是 2026 年上半年开发者最关心的旗舰模型对比之一。

两者都不是单纯的聊天模型。

GPT-5.5 更强调 agentic coding、计算机使用、知识工作和科研分析。

Claude Opus 4.7 则强调复杂推理、长期代理任务、高分辨率视觉、记忆能力和更严格的指令跟随。

如果只问「哪个更强」,答案会很粗糙。

更实用的问题应该是:你的任务是代码修复、知识库问答、长上下文分析、视觉理解、自动化代理,还是高成本的生产 API 调用?

不同任务下,GPT-5.5 vs Claude Opus 4.7 的选择会明显不同。

OpenAI 官方发布 GPT-5.5 时,直接把 Claude Opus 4.7 放进多项评测表中。

Anthropic 官方也把 Claude Opus 4.7 定位为其目前最强的通用可用模型,并强调它在 agentic coding、知识工作、视觉任务和记忆任务上的提升。

本文基于英文官方资料进行整理,不引用中文二手资料。

需要特别说明的是,本文讨论的「Claude 4.7」准确指 Claude Opus 4.7。

截至本文写作时,Anthropic 官方资料中并未显示 Claude Sonnet 4.7 已发布。

GPT-5.5 vs Claude Opus 4.7 核心结论

GPT-5.5 vs Claude Opus 4.7 的第一层差异,是模型定位不同。

OpenAI 把 GPT-5.5 定义为更适合真实工作流的模型。

它强调编码、调试、在线研究、数据分析、文档和表格生成,以及跨工具完成任务。

Anthropic 把 Claude Opus 4.7 定义为其最强的通用可用模型。

它强调复杂推理、agentic coding、长程任务、视觉理解、记忆能力和自我校验。

如果你的任务是 Codex 里的复杂工程项目、跨文件修改、工具调用和知识工作,GPT-5.5 往往更值得优先测试。

如果你的任务是 Claude Code 长时间代理、视觉截图理解、文档排版校验、文件系统记忆和严格指令跟随,Claude Opus 4.7 更值得优先测试。

如果你需要统一接入两类模型,建议通过 API易 apiyi.com 做多模型路由和评测,避免把模型选择写死在业务代码里。

GPT-5.5 vs Claude Opus 4.7 快速对比

| 维度 | GPT-5.5 | Claude Opus 4.7 | 选择建议 |

|---|---|---|---|

| 官方定位 | 真实工作流和 agentic AI | 最强通用可用 Claude 模型 | 按任务类型选 |

| 编码能力 | Terminal-Bench 2.0 表现强 | agentic coding 明显提升 | 都应实测 |

| 长上下文 | API 最高 1M context | 1M context window | 都适合长上下文 |

| 视觉能力 | 多模态与工具协作 | 高分辨率图像支持 | 视觉重任务偏 Claude |

| 推理控制 | reasoning_effort | effort / adaptive thinking | 参数体系不同 |

| API 成本 | $5 输入 / $30 输出每百万 token | $5 输入 / $25 输出每百万 token | Claude 输出价更低 |

| 生态入口 | ChatGPT、Codex、API | Claude、Claude Code、API | 取决于工作流 |

选择建议:如果你无法确定 GPT-5.5 vs Claude Opus 4.7 哪个更适合,建议先准备 30-50 条真实业务样本,通过 API易 apiyi.com 同时跑两个模型,对比成功率、响应时间、成本和人工评分。

GPT-5.5 vs Claude Opus 4.7 编码能力对比

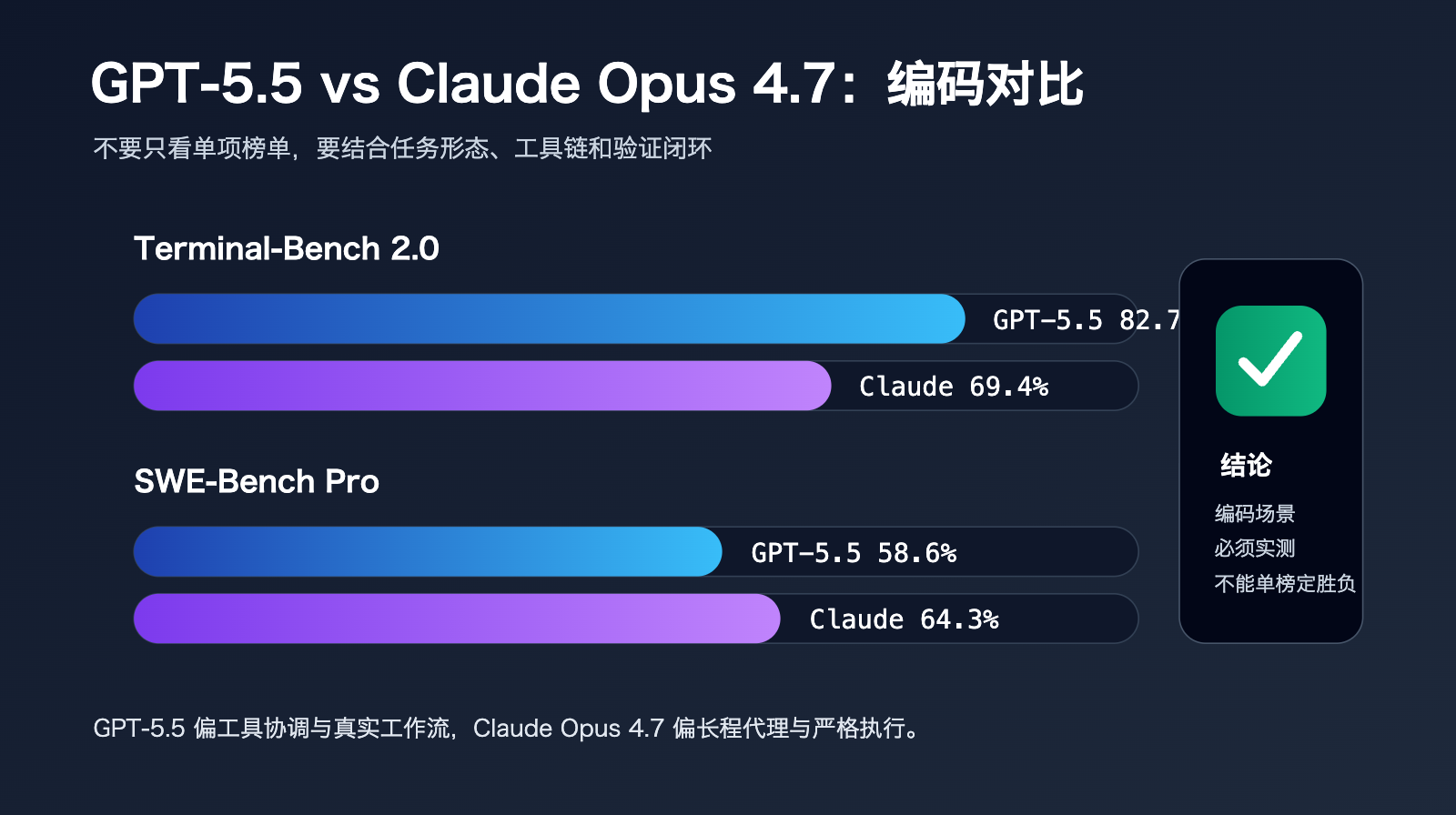

编码是 GPT-5.5 vs Claude Opus 4.7 最核心的对比场景。

OpenAI 官方数据显示,GPT-5.5 在 Terminal-Bench 2.0 上达到 82.7%。

同一张表中,Claude Opus 4.7 为 69.4%。

在 SWE-Bench Pro 公开评测上,GPT-5.5 为 58.6%,Claude Opus 4.7 为 64.3%。

这说明两个模型并不是单边胜出。

GPT-5.5 在命令行复杂工作流、计划、迭代和工具协调上表现更突出。

Claude Opus 4.7 在 GitHub issue 解决类任务上也有很强竞争力。

Anthropic 官方材料还强调,Claude Opus 4.7 在其 93-task coding benchmark 上比 Opus 4.6 提升 13%。

这意味着 Claude Opus 4.7 相对上一代的编码提升是明确的。

但如果只看 GPT-5.5 vs Claude Opus 4.7,不能把某一个 benchmark 当成全部结论。

真实编码工作还包括:读懂旧代码、识别风险、改动范围控制、测试补齐、运行命令、处理失败、解释变更和生成 review notes。

GPT-5.5 在 Codex 场景中强调跨工具执行和更少 token 完成任务。

Claude Opus 4.7 在 Claude Code 场景中强调长程代理、xhigh effort 和更严格的指令跟随。

GPT-5.5 vs Claude Opus 4.7 编码场景建议

| 编码任务 | 更推荐优先测试 | 原因 |

|---|---|---|

| 命令行复杂工作流 | GPT-5.5 | Terminal-Bench 2.0 官方分数更高 |

| GitHub issue 修复 | Claude Opus 4.7 / GPT-5.5 都测 | SWE-Bench Pro Claude 更高,GPT-5.5 生态强 |

| 大型代码库理解 | GPT-5.5 | Codex 场景强调跨系统上下文 |

| 长时间代理任务 | Claude Opus 4.7 | xhigh effort 与 task budget 更贴合 |

| 代码审查与验证 | 两者都适合 | 重点看测试闭环 |

| 成本敏感批量修复 | 需要实测 | token 使用形态差异大 |

选择建议:编码模型不要只看榜单。我们建议把你的真实 issue、失败测试、PR review 和重构任务放入 API易 apiyi.com 做对比评测,记录每个模型是否真的跑了测试、是否误改无关文件、是否能说明风险。

GPT-5.5 vs Claude Opus 4.7 知识工作与研究能力

GPT-5.5 vs Claude Opus 4.7 在知识工作上的对比也很关键。

OpenAI 官方材料显示,GPT-5.5 在 GDPval 上达到 84.9%。

Claude Opus 4.7 在同一表中为 80.3%。

GPT-5.5 Pro 为 82.3%。

这说明在 OpenAI 所列的专业知识工作评测中,GPT-5.5 表现非常强。

OpenAI 还强调 GPT-5.5 在生成文档、表格、演示文稿、处理运营研究和商业输入方面有明显提升。

Anthropic 方面,Claude Opus 4.7 的官方资料强调它在 knowledge work、memory、vision 和 long-horizon agentic work 上表现突出。

Claude Opus 4.7 的一个重要特点是更强的数据纪律。

Anthropic 页面引用 Hex 的评价,认为它在缺失数据时更愿意说明缺失,而不是给出看似合理但错误的替代。

这对金融分析、研究报告、合规审查和数据表格处理很重要。

如果你的知识工作任务需要模型写出漂亮、完整、结构清晰的业务文档,GPT-5.5 非常值得测试。

如果你的任务需要模型在缺失数据、冲突数据和长上下文中保持谨慎,Claude Opus 4.7 也非常有竞争力。

GPT-5.5 vs Claude Opus 4.7 知识工作选择

| 场景 | GPT-5.5 优势 | Claude Opus 4.7 优势 | 建议 |

|---|---|---|---|

| 商业报告 | 结构化生成强 | 数据纪律强 | 两者对比 |

| 表格分析 | Codex 文档表格能力强 | 视觉校验和图表分析强 | 看输入形态 |

| 金融研究 | GDPval 表现强 | General Finance 模块提升 | 用真实样本测 |

| 合规审查 | 综合能力强 | 缺失数据处理谨慎 | Claude 优先测 |

| 多文档总结 | 长上下文强 | 记忆和严格指令强 | 按引用质量选 |

选择建议:知识工作最怕「看起来很完整,实际有幻觉」。在 API易 apiyi.com 做 GPT-5.5 vs Claude Opus 4.7 对比时,建议把人工评分拆成事实准确性、引用一致性、遗漏率、结构质量和可执行性 5 个维度。

GPT-5.5 vs Claude Opus 4.7 视觉与长上下文能力

GPT-5.5 vs Claude Opus 4.7 都支持长上下文,但细节不同。

OpenAI 官方材料显示,GPT-5.5 API 具备 1M context window。

Anthropic 模型总览显示,Claude Opus 4.7 也支持 1M tokens context window,并支持 128k max output。

在长上下文任务中,两者都进入了可处理大型文档、代码库和复杂资料包的范围。

但视觉任务上,Claude Opus 4.7 的官方变化更明确。

Anthropic 文档显示,Claude Opus 4.7 是首个支持高分辨率图像的 Claude 模型,最大图像分辨率提升到 2576px / 3.75MP。

这对截图理解、文档图像、幻灯片校验、图表分析和 computer use 很重要。

Anthropic 还提到,图像坐标现在与真实像素 1:1 对应,减少了坐标缩放换算。

GPT-5.5 也有很强的多模态和计算机使用能力,但如果你的输入核心是高分辨率截图、图表、文档版式或 UI 坐标,Claude Opus 4.7 值得优先测试。

如果你的输入是长文本、代码库、业务文档、结构化资料和工具链结果,GPT-5.5 与 Claude Opus 4.7 都需要用同一套样本评估。

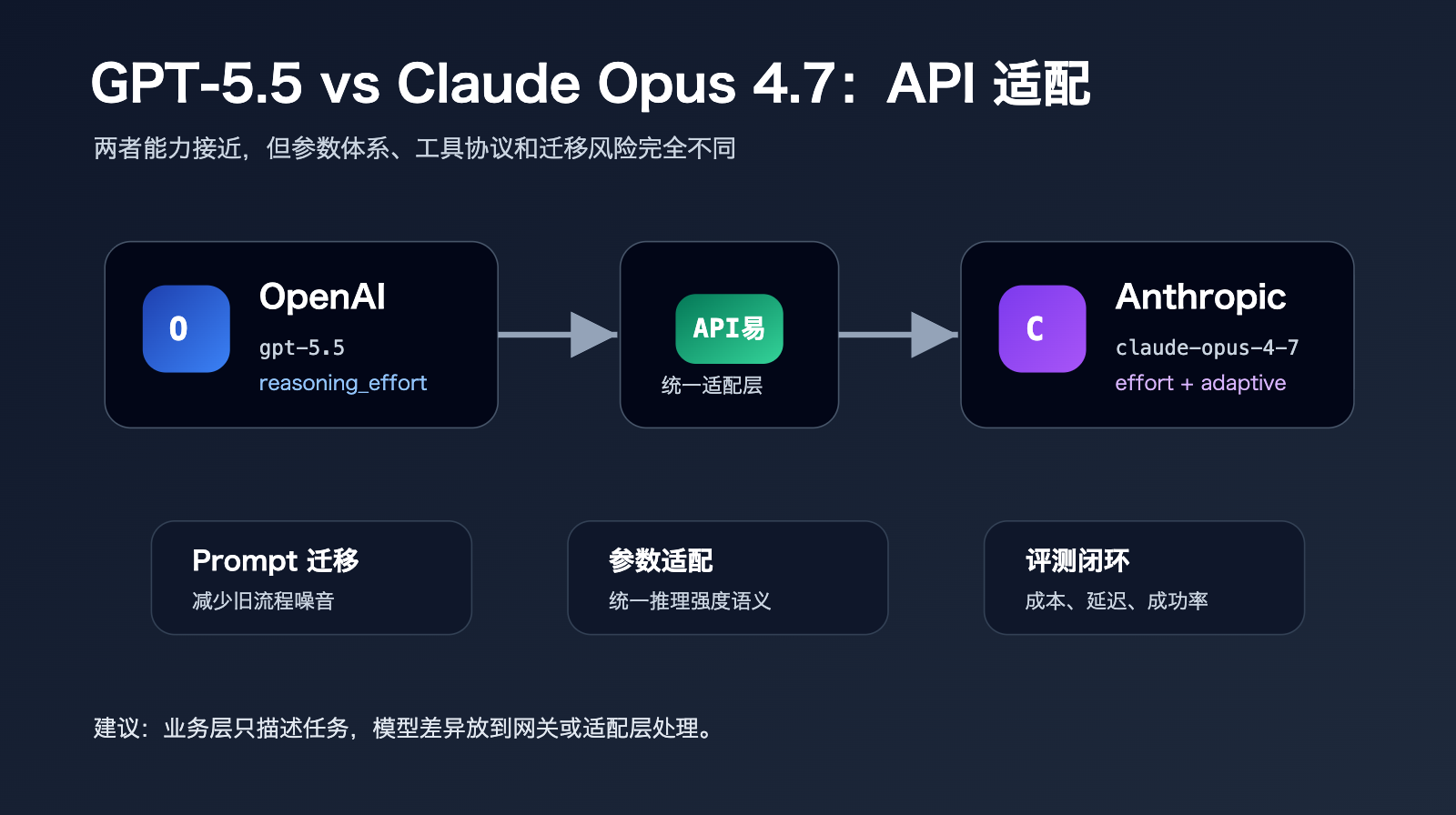

GPT-5.5 vs Claude Opus 4.7 API 参数与迁移差异

GPT-5.5 vs Claude Opus 4.7 的 API 迁移差异非常大。

GPT-5.5 属于 OpenAI 模型体系,重点参数包括 model、reasoning_effort、Responses API 工具调用和输出格式控制。

Claude Opus 4.7 属于 Anthropic Messages API 体系,重点参数包括 adaptive thinking、effort、task budget、max_tokens 和工具调用。

Anthropic 官方文档显示,Claude Opus 4.7 移除了 extended thinking budgets。

旧写法 thinking: {"type": "enabled", "budget_tokens": N} 会返回 400 错误。

新写法应使用 thinking: {"type": "adaptive"},并通过 output_config 设置 effort。

Anthropic 还说明,从 Claude Opus 4.7 开始,设置非默认 temperature、top_p 或 top_k 会返回 400 错误。

这对很多旧项目是重要迁移点。

如果你之前依赖 temperature=0 做确定性输出,需要重新理解:temperature=0 本来也不保证完全一致。

相比之下,GPT-5.5 的迁移重点更偏 Prompt 重建、reasoning_effort 评估、工具工作流和结果优先提示词。

GPT-5.5 vs Claude Opus 4.7 API 迁移重点

| 迁移项 | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| 模型 ID | gpt-5.5 |

claude-opus-4-7 |

| 推理控制 | reasoning_effort | effort + adaptive thinking |

| 长上下文 | 1M context window | 1M context window |

| 输出上限 | OpenAI API 规格为准 | 128k max output |

| 温度参数 | 按 OpenAI API 支持情况配置 | 非默认 temperature/top_p/top_k 会报错 |

| 工具工作流 | Responses API 工具体系 | Messages API 工具体系 |

| 迁移风险 | 旧 Prompt 过度指定 | thinking budget 和 sampling 旧参数 |

选择建议:如果你需要同时接入 GPT-5.5 和 Claude Opus 4.7,不建议业务代码直接写两套分散调用逻辑。可以通过 API易 apiyi.com 做统一 OpenAI 兼容入口,再把模型差异、参数差异和错误处理放到网关层或适配层管理。

GPT-5.5 vs Claude Opus 4.7 成本与性能选择

GPT-5.5 vs Claude Opus 4.7 的成本不能只看单价。

OpenAI 官方资料显示,GPT-5.5 API 价格为每百万输入 token 5 美元、每百万输出 token 30 美元。

Anthropic 模型总览显示,Claude Opus 4.7 为每百万输入 token 5 美元、每百万输出 token 25 美元。

单看输出价格,Claude Opus 4.7 更低。

但 OpenAI 强调,GPT-5.5 在 Codex 中比 GPT-5.4 更 token efficient。

Anthropic 也强调 Claude Opus 4.7 通过 effort、task budget 和 adaptive thinking 控制成本。

所以真实成本取决于任务形态。

如果 GPT-5.5 用更少轮次完成任务,它的总成本未必更高。

如果 Claude Opus 4.7 在 xhigh 或 max effort 下大量消耗输出 token,它的总成本也可能上升。

成本评估应看「完成一次合格任务的总成本」,而不是只看每百万 token 单价。

GPT-5.5 vs Claude Opus 4.7 成本评估维度

| 成本维度 | 应该记录什么 | 为什么重要 |

|---|---|---|

| 输入 token | Prompt、上下文、工具结果 | 长上下文任务成本差异大 |

| 输出 token | 最终回答、工具参数、推理相关输出 | 输出价格通常更贵 |

| 轮次 | 完成任务需要几轮 | 多轮会放大成本 |

| 成功率 | 一次完成还是反复修正 | 失败重试是隐形成本 |

| 延迟 | 用户等待时间 | 高 effort 会增加等待 |

| 人工复核 | 是否需要人类修正 | 质量差会转嫁成本 |

选择建议:对企业应用来说,模型成本优化不是简单选择便宜模型。建议通过 API易 apiyi.com 记录每次调用的输入、输出、延迟、模型、参数和人工评分,以「合格任务成本」作为最终指标。

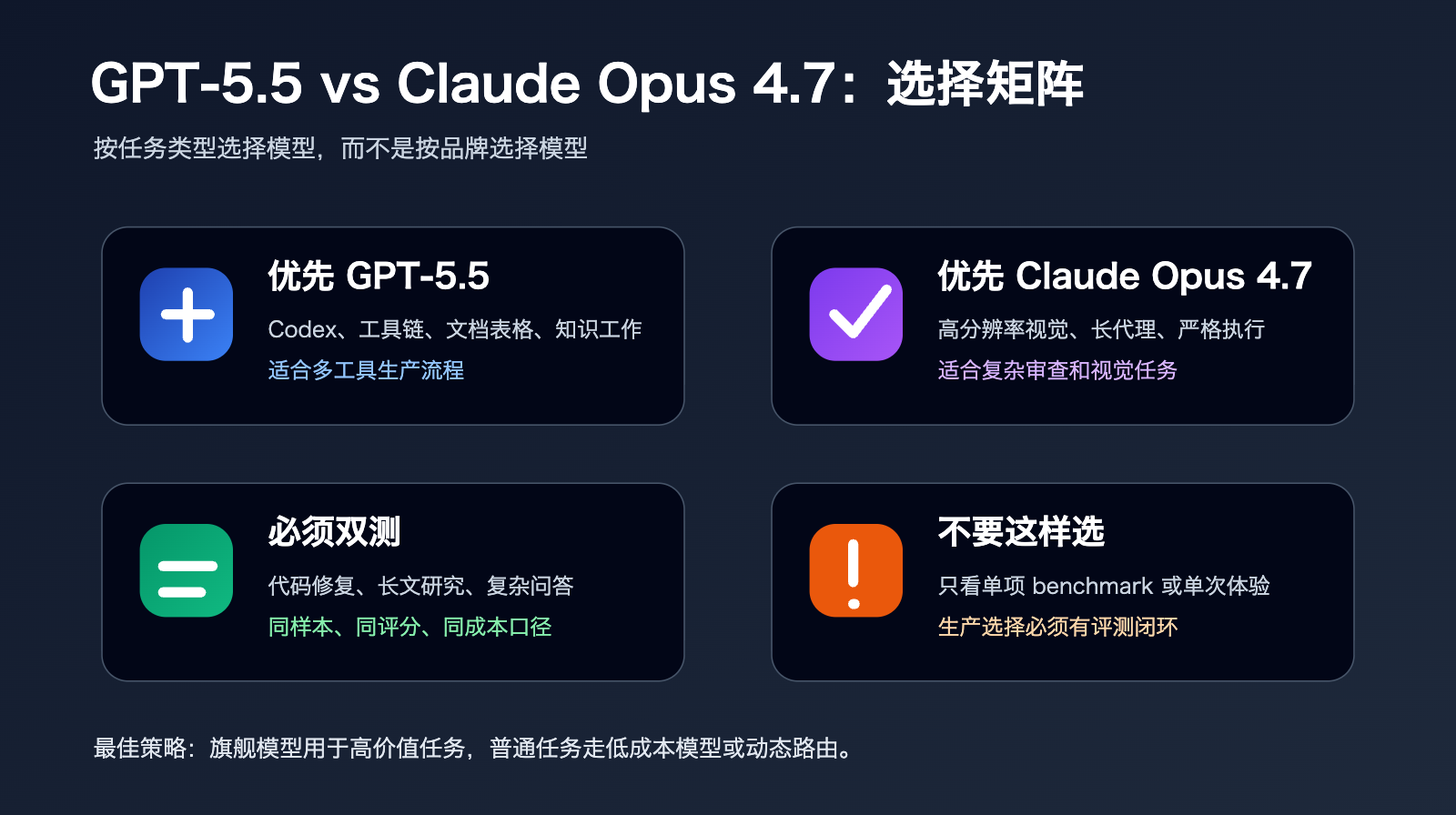

GPT-5.5 vs Claude Opus 4.7 适用场景决策

如果你是个人开发者,GPT-5.5 vs Claude Opus 4.7 可以按工具生态选择。

你常用 Codex,就先测 GPT-5.5。

你常用 Claude Code,就先测 Claude Opus 4.7。

如果你是企业技术负责人,不建议按个人体验拍板。

你应该建立任务集,把两者放到同一套输入、输出、评分和成本记录里比较。

如果你是内容团队,GPT-5.5 在结构化内容、研究整理、表格和多工具工作中值得优先测试。

Claude Opus 4.7 在谨慎表达、长上下文、视觉资料和文件校验中值得优先测试。

如果你是 API 平台或 SaaS 产品,建议做模型路由。

例如普通问答走成本更低的模型,复杂代码和长代理任务再升级到 GPT-5.5 或 Claude Opus 4.7。

这样可以避免所有请求都打到旗舰模型。

GPT-5.5 vs Claude Opus 4.7 迁移检查清单

上线前不要只做一次主观体验。

建议至少准备 5 类样本。

第一类是成功样本。

第二类是容易误判的边界样本。

第三类是长上下文样本。

第四类是工具调用样本。

第五类是失败恢复样本。

每条样本都要记录模型、参数、输入 token、输出 token、耗时、是否一次成功和人工评分。

同时要分别测试低成本档位和高能力档位。

GPT-5.5 侧可以测试不同 reasoning_effort。

Claude Opus 4.7 侧可以测试 medium、high、xhigh 和 max effort。

不要默认把两个模型都开到最高配置。

最高配置只能说明上限,不能说明生产性价比。

GPT-5.5 vs Claude Opus 4.7 评测数据如何解读?

GPT-5.5 vs Claude Opus 4.7 的公开 benchmark 很有参考价值,但不能直接等同于你的业务结果。

原因很简单:公开评测通常有固定任务集、固定提示词、固定运行环境和固定评分规则。

你的业务系统则会遇到脏数据、上下文缺失、用户表达不稳定、工具失败、权限限制和历史 Prompt 包袱。

因此,看到 GPT-5.5 在某个 benchmark 上领先,不代表所有任务都应该切到 GPT-5.5。

看到 Claude Opus 4.7 在另一个 benchmark 上领先,也不代表所有任务都应该切到 Claude。

更稳妥的方式是把官方 benchmark 当作模型能力方向的提示。

例如 Terminal-Bench 2.0 更能说明复杂命令行工作流能力。

SWE-Bench Pro 更接近真实 GitHub issue 修复能力。

GDPval 更接近专业知识工作交付能力。

视觉 benchmark 和高分辨率图像支持,则更适合判断截图、图表、UI、文档版式相关任务。

落地时,你需要把这些维度映射到自己的产品场景。

如果产品是 IDE 编码助手,优先看代码修复成功率、测试通过率、无关改动率和解释质量。

如果产品是企业知识库,优先看引用准确率、事实遗漏率、冲突处理和拒答边界。

如果产品是自动化代理,优先看工具调用次数、失败恢复、任务完成率和总成本。

如果产品是视觉文档处理,优先看坐标识别、图表转录、版式理解和人工修正成本。

API易 apiyi.com 的价值就在于把这些模型测试放到统一接口下执行。

同样的输入、同样的评分维度、同样的日志字段,才能让 GPT-5.5 vs Claude Opus 4.7 的结论真正可复用。

GPT-5.5 vs Claude Opus 4.7 FAQ

GPT-5.5 vs Claude Opus 4.7 谁更适合写代码?

两者都适合。

GPT-5.5 在 Terminal-Bench 2.0 上更强,适合命令行复杂流程和 Codex 工作流。

Claude Opus 4.7 在 SWE-Bench Pro 表现很强,也适合 Claude Code 长时间代理任务。

真实项目建议用同一组 issue 和测试命令双测。

GPT-5.5 vs Claude Opus 4.7 谁更适合知识库问答?

如果重点是结构化生成和多工具整理,优先测试 GPT-5.5。

如果重点是缺失数据识别、谨慎表达和长上下文纪律,优先测试 Claude Opus 4.7。

最终应看引用准确率和人工复核成本。

GPT-5.5 vs Claude Opus 4.7 谁更适合视觉任务?

Claude Opus 4.7 在官方文档中明确加入高分辨率图像支持。

如果任务涉及截图、坐标、文档版式和视觉校验,Claude Opus 4.7 值得优先测试。

GPT-5.5 也适合多模态工作流,但视觉重任务需要单独评测。

GPT-5.5 vs Claude Opus 4.7 谁更便宜?

按官方单价,二者输入价均为每百万 token 5 美元。

Claude Opus 4.7 输出价为每百万 token 25 美元,GPT-5.5 输出价为每百万 token 30 美元。

但实际成本取决于完成任务需要的轮次、输出长度、失败率和人工修正成本。

GPT-5.5 vs Claude Opus 4.7 总结

GPT-5.5 vs Claude Opus 4.7 没有一个适用于所有场景的绝对答案。

GPT-5.5 更适合多工具生产工作流、Codex 编码、文档表格生成、知识工作和复杂任务执行。

Claude Opus 4.7 更适合高分辨率视觉、长程代理任务、严格指令跟随、文件记忆和谨慎的数据处理。

如果你是个人用户,可以按常用工具生态优先选择。

如果你是企业用户,必须用真实样本评测。

如果你是 API 开发者,建议把模型差异放到适配层管理,不要把 GPT-5.5 或 Claude Opus 4.7 绑定死在业务逻辑里。

API易 apiyi.com 适合承担统一模型入口、调用记录、成本观测和多模型切换的角色。

最终建议是:用 GPT-5.5 处理高复杂度多工具任务,用 Claude Opus 4.7 处理高精度视觉和长代理任务,用低成本模型处理普通请求,再通过评测数据持续调整路由。

参考资料:

- OpenAI Introducing GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic Introducing Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Anthropic Claude Opus 4.7 API docs: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Anthropic Models overview: platform.claude.com/docs/en/about-claude/models/overview

- Anthropic Effort docs: platform.claude.com/docs/en/build-with-claude/effort