في 21 أبريل 2026، أطلقت Google في المعاينة العامة لـ Gemini API نموذجين من وكلاء البحث الذاتي من الجيل التالي: Deep Research و Deep Research Max، وكلاهما يعتمد على نموذج Gemini 3.1 Pro الذي تم إصداره في فبراير من هذا العام. تعد هذه خطوة محورية من Google لنقل قدرات "البحث الذاتي طويل الأمد" من المنتجات الاستهلاكية إلى واجهات برمجة التطبيقات (API) الخاصة بالمطورين بشكل كامل. وقد حقق Deep Research Max نسبة 93.3% في اختبار DeepSearchQA، كما ورث قدرات الاستدلال الأساسية لنموذج Gemini 3.1 Pro في اختبار ARC-AGI-2 بنسبة 77.1%، وهو ما يتجاوز ضعف أداء Gemini 3 Pro.

والأهم من ذلك، أن هذا الجيل من Deep Research يقدم ثلاث ميزات هندسية جديدة: بروتوكول سياق النموذج (MCP) للوصول إلى أي مصدر بيانات خاص، مخرجات مرئية أصلية (جداول HTML / مخططات SVG / رسوم بيانية)، ودمج البيانات عبر الويب والمصادر الخاصة. وهذا يعني أنه لأول مرة، يمكن للمطورين من خلال استدعاء API واحد، تمكين الوكيل (Agent) من البحث في الشبكة العامة + الشبكة الداخلية للشركة + بيانات الطرف الثالث المتخصصة في آن واحد، وإنتاج تقارير مرئية جاهزة للتضمين في لوحات التحكم مباشرة.

تستعرض هذه المقالة، بناءً على إصدارات Google الرسمية ووثائق Gemini API، الاختراقات الأربعة الرئيسية لـ Deep Research Max، والفروقات بينه وبين نسخة Deep Research العادية، والمعنى الحقيقي لنسبة 77.1% في اختبار ARC-AGI-2، وكيفية وصول المطورين المحليين إلى هذه القدرات.

أولاً: ما هو Deep Research Max؟ وكيل بحثي مستقل مدعوم بـ Gemini 3.1 Pro

البحث العميق (Deep Research) ليس مفهوماً جديداً، فقد أتاحت Google نسخة أساسية منه في تطبيق Gemini للمستهلكين في أواخر عام 2024، مما يسمح للذكاء الاصطناعي بإجراء عمليات بحث عبر الويب وكتابة تقرير يتضمن مراجع. لكن النسخة الموجهة للمستهلكين كانت محدودة الوظائف، ولا توفر واجهة برمجة تطبيقات (API) خارجية، ولا تدعم ربط البيانات الخاصة، مما جعل قيمتها في التطبيقات الهندسية محدودة.

أما Deep Research / Deep Research Max هذه المرة، فهي إعادة كتابة كاملة على مستوى البنية التحتية. وتعرفها Google بأنها "الجيل القادم من وكلاء البحث المستقلين"؛ حيث يمكنها التخطيط والتنفيذ وتجميع مهام البحث متعددة الخطوات بشكل مستقل، مع تجاوز مصادر الأدوات المختلفة مثل الويب، وخوادم MCP، وسياق الروابط (URL Context)، وتنفيذ الأكواد، والبحث في الملفات، لإنتاج تقرير مهيكل ومدعوم بالمراجع في النهاية. تم إطلاق الإصدارين معاً لتلبية احتياجات هندسية مختلفة.

| وجه المقارنة | Deep Research (النسخة القياسية) | Deep Research Max | سيناريوهات الاستخدام |

|---|---|---|---|

| هدف التحسين | السرعة وزمن الاستجابة | الشمولية والعمق | – |

| مدة الاستدلال | قصيرة (ثوانٍ إلى دقائق) | طويلة (دقائق إلى ساعات) | – |

| الحوسبة أثناء الاختبار | قياسية | موسعة | – |

| التكرار متعدد الجولات | 1-2 جولة | جولات استدلال عميقة | – |

| نمط الاستدعاء | متزامن / تفاعل لحظي | غير متزامن / مهام خلفية | – |

| التكلفة | منخفضة | مرتفعة | – |

| حالات الاستخدام النموذجية | مساعد بحث تفاعلي، مراكز خدمة العملاء | تقارير الاستثمار، تحليل القطاعات، العناية الواجبة | – |

أشارت Google بوضوح في مدونتها الرسمية إلى أن: Deep Research Max مخصص لسير العمل الذي يتقبل الانتظار غير المتزامن ويسعى للحصول على أعلى جودة من المخرجات الشاملة. إذا كنت تعمل في مجال العناية الواجبة داخل الشركات، أو أبحاث القطاعات العميقة، أو إنشاء التقارير الطويلة تلقائياً، فإن Max هو الخيار الأنسب؛ أما إذا كنت تبني مساعد ذكاء اصطناعي تفاعلي للمستخدم النهائي، فإن زمن الاستجابة المنخفض للنسخة القياسية سيكون أكثر ملاءمة.

💡 نصيحة للربط: تتوفر كل من Deep Research وMax عبر طبقة الدفع في Gemini API. يمكن للمطورين في المنطقة العربية استدعاء واجهات Gemini 3.1 Pro مباشرة عبر منصة APIYI (apiyi.com)، حيث توفر المنصة تغليفاً موحداً متوافقاً مع بروتوكول OpenAI، مما يغنيك عن عناء الشبكات العابرة للحدود وتحديات تسجيل الحسابات.

ثانياً: 4 اختراقات جوهرية في Deep Research Max

أكثر ما يستحق الاهتمام في هذا الإصدار هو القفزات الأربع في القدرات الهندسية، والتي تجعل من Deep Research Max "وكيلاً بحثياً مستقلاً بمستوى مؤسسي".

2.1 الاختراق الأول: دعم بروتوكول MCP الأصلي للوصول إلى أي بيانات خارجية

يعد بروتوكول سياق النموذج (Model Context Protocol – MCP) بروتوكولاً مفتوحاً تقوده Anthropic، ويهدف إلى تمكين وكلاء الذكاء الاصطناعي من الوصول إلى أي أدوات أو مصادر بيانات خارجية بطريقة موحدة. Deep Research Max هو أول منتج في منظومة Google يدمج MCP كعنصر أساسي. يحتاج المطورون فقط إلى تغليف البيانات الخاصة أو بيانات الطرف الثالث في خادم MCP، ليتمكن الوكيل من البحث فيها تماماً كما يستدعي الأدوات الأصلية.

كشفت Google أيضاً عن الدفعة الأولى من شركاء MCP: عمالقة البيانات المالية FactSet وS&P Global وPitchBook، الذين يتعاونون مع Google لتصميم خوادم MCP، مما يتيح للعملاء المشتركين دمج تدفقات البيانات المالية الاحترافية في سير عمل Deep Research. وهذا يعني أن وكلاء البحث في مجالات التمويل والقانون والطب لديهم أخيراً مسار ربط موحد، دون الحاجة لإعادة كتابة طبقات التكيف لكل مصدر بيانات.

2.2 الاختراق الثاني: المخرجات المرئية الأصلية، وداعاً للتقارير النصية فقط

كانت نماذج اللغة التقليدية (LLM) تعيد نصوص Markdown فقط، وكان يتطلب إضافة المخططات استدعاء واجهة برمجة تطبيقات للرسم أو مترجم أكواد. أما Deep Research Max فيقوم أثناء عملية الاستدلال بتوليد جداول HTML، ومخططات SVG، ورسوم معلوماتية (Infographics) بشكل أصلي، حيث تعتبر هذه المخرجات المرئية جزءاً عضوياً من تدفق استدلال الوكيل، وليست مجرد إضافات لاحقة.

تشمل المخرجات الفعلية: جداول HTML مهيكلة (يمكن تضمينها مباشرة في صفحات الويب)، مخططات SVG قابلة للتوسع (مخططات دائرية، أعمدة، خطوط زمنية)، ورسوماً معلوماتية كاملة التنسيق (مناسبة للإرسال عبر البريد الإلكتروني أو Slack). إذا كان المشروع يدمج نموذج صور عالي الجودة مثل Nano Banana، يمكن لـ Deep Research استدعاؤه لإنشاء مخرجات بصرية أكثر تعقيداً. هذا التغيير يرتقي بمخرجات Deep Research من "نص Markdown طويل مع مراجع" إلى "تقرير متعدد الوسائط يمكن تضمينه مباشرة في لوحات التحكم".

2.3 الاختراق الثالث: دمج مصادر الويب والبيانات الخاصة

في السابق، كان Deep Research يقتصر على البحث في الويب العام، مما ترك أكبر نقطة ألم للمستخدمين من الشركات دون حل: دمج وثائق SaaS، وبيانات CRM، وتقارير ERP وغيرها من المعلومات الخاصة في عملية البحث. الإصدار الجديد يسمح بتفعيل Google Search، وخوادم MCP البعيدة، وسياق الروابط، وتنفيذ الأكواد، والبحث في الملفات في استدعاء API واحد، حيث يقرر الوكيل بنفسه أي أداة يستخدم.

والأهم من ذلك، يمكن للمطورين إيقاف الوصول إلى الويب تماماً، مما يجعل الوكيل يجري أبحاثه فقط ضمن مصادر البيانات الخاصة المحددة. بالنسبة لقطاعات التمويل والقانون والطب التي تتطلب امتثالاً صارماً للبيانات، يعد هذا المفتاح هو الحل الحقيقي؛ فهو يضمن عدم تسريب المعلومات الداخلية عن غير قصد إلى استعلامات البحث العامة. هذه تفصيلة امتثال بالغة الأهمية وغالباً ما يتم تجاهلها في تطبيقات الذكاء الاصطناعي المؤسسية.

2.4 الاختراق الرابع: قفزة في الأداء – تحسن شامل في ثلاثة معايير

تُظهر مقارنات المعايير الرسمية التي نشرتها Google أن Deep Research Max حقق تحسناً ملحوظاً مقارنة بإصدار ديسمبر 2024:

| معيار الاختبار | إصدار ديسمبر 2024 | Deep Research Max (أبريل 2026) | نسبة التحسن |

|---|---|---|---|

| DeepSearchQA | 66.1% | 93.3% | +27.2 نقطة مئوية |

| Humanity's Last Exam | 46.4% | 54.6% | +8.2 نقطة مئوية |

| ARC-AGI-2 (النموذج الأساسي) | 31.1% (Gemini 3 Pro) | 77.1% (Gemini 3.1 Pro) | تحسن بمقدار الضعف (2×) |

معيار DeepSearchQA مخصص لتقييم قدرات البحث المستقل عبر الويب + الاستدلال الشامل، وقد اقتربت نتيجته البالغة 93.3% من السقف الأعلى. وهذا يعني أن Deep Research Max في مهمته الأساسية المتمثلة في "البحث المستقل عن المعلومات وكتابة إجابات دقيقة" قد أصبح متفوقاً لدرجة يصعب معها على المنافسين اللحاق به.

ثالثاً: المعنى الحقيقي لنسبة 77.1% في اختبار ARC-AGI-2

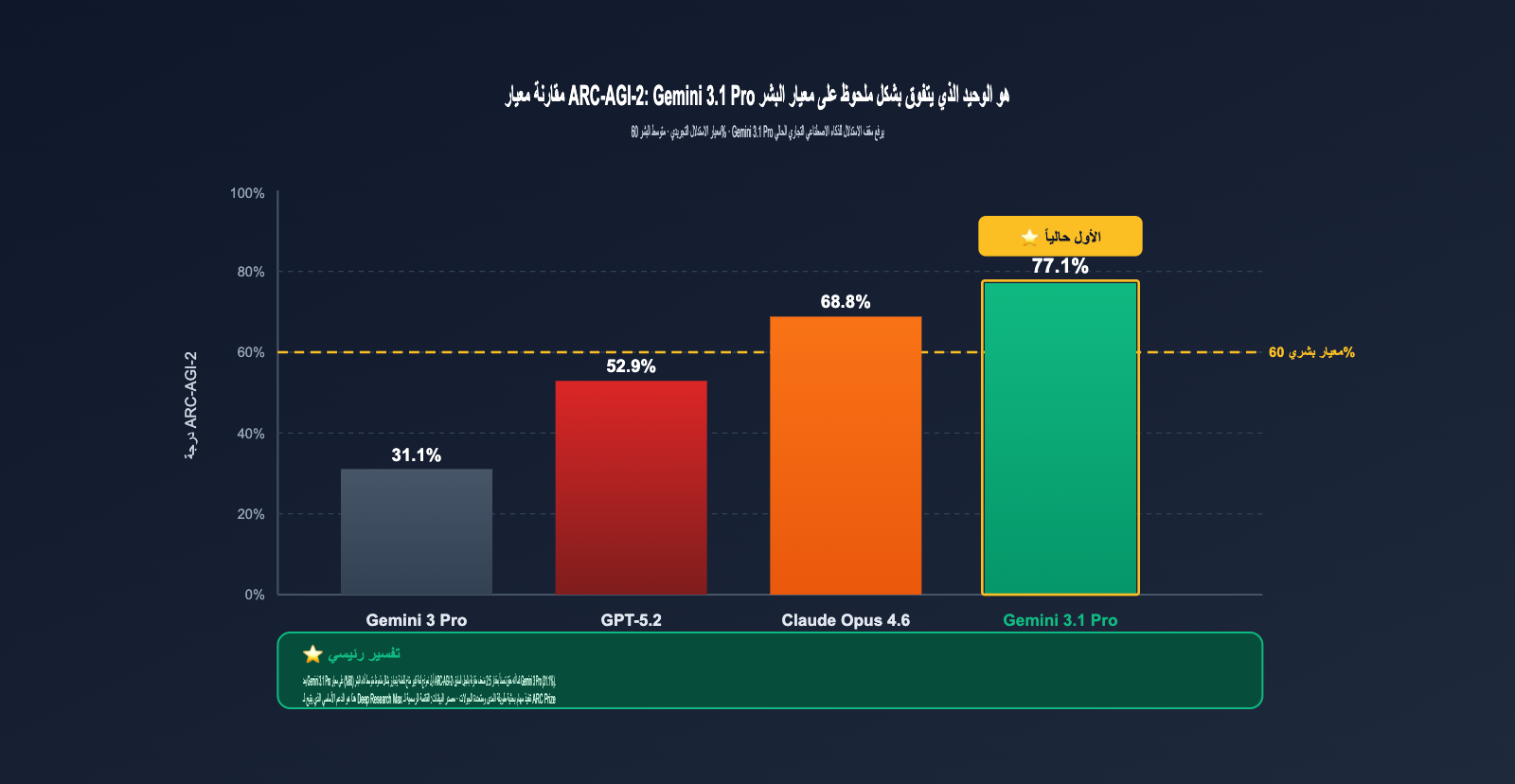

قد يظن الكثير من المطورين عند رؤية رقم "77.1%" أنه مجرد "نتيجة جيدة"، ولكن لفهم القيمة الحقيقية لهذه النتيجة، يجب أولاً إدراك مدى صعوبة معيار ARC-AGI-2.

3.1 ما هو ARC-AGI-2؟

يتم إدارة ARC-AGI-2 بواسطة منظمة ARC Prize، وهو مخصص لاختبار قدرة الذكاء الاصطناعي على الاستنتاج التجريدي في أنماط منطقية جديدة تماماً لم يسبق له رؤيتها في بيانات التدريب. يعتمد الاختبار على تقديم أمثلة (أزواج من المدخلات والمخرجات) ليقوم النموذج باستنتاج القواعد الضمنية، ثم تطبيق تلك القواعد لحل مدخلات جديدة لم يراها من قبل. المعيار البشري هو 60%، لذا فإن نسبة 77.1% تعني أن النموذج قد تجاوز بالفعل متوسط الأداء البشري.

تكمن الصعوبة الجوهرية في هذا المعيار في أن: النموذج لا يمكنه الاعتماد على الحفظ لتحقيق نقاط عالية. فكل الأنماط يتم إنشاؤها حديثاً ولا علاقة لها ببيانات التدريب. وهذا هو السبب في اعتبار ARC-AGI-2 أحد المعايير الذهبية في الصناعة لقياس "قدرة الاستنتاج التجريدي الحقيقية".

3.2 مقارنة أفقية: Gemini 3.1 Pro هو الأقوى حالياً

| النموذج | نتيجة ARC-AGI-2 | مقابل المعيار البشري (60%) | ملاحظات |

|---|---|---|---|

| Gemini 3.1 Pro | 77.1% | +17.1 نقطة مئوية | أول نموذج مفتوح يتفوق بوضوح على البشر |

| Claude Opus 4.6 | 68.8% | +8.8 نقطة مئوية | نموذج Anthropic الرائد |

| المعيار البشري | 60.0% | – | المتوسط العام |

| GPT-5.2 | 52.9% | -7.1 نقطة مئوية | OpenAI |

| Gemini 3 Pro | 31.1% | -28.9 نقطة مئوية | الجيل السابق |

كما نرى، لم يتفوق Gemini 3.1 Pro على جميع نماذج اللغة الكبيرة التجارية فحسب، بل إنه النموذج الوحيد المتاح للوصول الذي يتجاوز بوضوح المعيار البشري. هذه هي المرة الأولى التي يبتعد فيها الذكاء الاصطناعي التجاري عن البشر في معيار صارم لـ "الاستنتاج المنطقي الجديد". لقد ورث Deep Research Max هذه القدرة الاستنتاجية بشكل مباشر، وهو ما يمثل الدعم الأساسي الذي يمكنه من تنفيذ مهام بحثية طويلة المدى ومتعددة الجولات.

🎯 نصيحة تقنية: إذا كان منتجك موجهاً لمجالات تتطلب استنتاجاً مكثفاً مثل البحث، الاستشارات، التحليل الاستثماري، أو التحليل القانوني، فيجب عليك إدراج مزيج Gemini 3.1 Pro و Deep Research Max في تقييمك التقني فوراً. يمكنك الوصول إليه واختباره بسرعة عبر منصة APIYI (apiyi.com)، حيث تدعم المنصة بالفعل استدعاءات متوافقة مع OpenAI للعديد من النماذج الرائدة، بما في ذلك Gemini 3.1 Pro.

4. Deep Research Max API 快速上手

理论说完,下面给出能直接运行的最精简调用代码。Deep Research Max 使用 Gemini API 标准接口,付费层级已开放预览。

4.1 基础调用:让 Agent 撰写一份 Web 研究报告

from google import genai

from google.genai import types

# 通过 APIYI 统一中转点接入,避免跨境网络问题

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="分析 2026 年上半年全球嵌入模型市场格局,列出 Top 5 厂商及其差异化优势",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # 启用 Google Search

thinking_config=types.ThinkingConfig(thinking_level="max") # Max 档思考预算

)

)

print(response.text) # 输出完整研究报告(含原生 HTML 表格 / SVG 图表)

这段代码完成了三件事:选定 Deep Research Max 模型、启用 Google Search 工具、设置最高档思考级别。Agent 会自主规划检索路径,进行多轮迭代分析,最终产出一份包含引用和可视化的完整报告。

4.2 进阶调用:接入 MCP 服务器进行私有数据研究

如果需要使用 Deep Research Max 处理公司内部数据(例如 CRM、内部 Wiki),则需要将数据源封装为 MCP 服务器,并在调用时进行声明:

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="分析公司 Q1 销售管线中流失率最高的客户类型",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

请注意,此处没有启用 google_search,这意味着 Agent 完全在私有数据范围内进行研究,不会向 Google 发出任何外部查询。这是企业合规场景下最关键的一项能力。

4.3 标准版与 Max 版的切换

如果你的应用场景是面向 C 端的实时对话,且速度比深度更重要,只需将模型名称更改为 deep-research-preview-04-2026 即可。两者的接口完全兼容,差异仅在于内部计算预算和迭代轮数。

💡 快速试用建议:首次接入时,建议先使用标准版 Deep Research 运行几个 Demo 以熟悉 Agent 的输出风格,再升级到 Max 版本处理真实业务任务。我们建议通过 APIYI (apiyi.com) 平台直接接入,该平台同时支持 Gemini 3.1 Pro、Deep Research、Deep Research Max 等多种模型的 OpenAI 兼容调用,便于切换与对比。

5. Deep Research Max 影响分析:哪些工作流将被重塑

新工具的发布只是起点,真正的价值在于它将改变哪些既有的工作流。根据发布资料和早期社区反馈,以下 4 个领域受到的冲击最大。

5.1 投研与行业分析

这是 Google 在发布会上明确点名的场景。FactSet、S&P Global 和 PitchBook 三家金融数据商联手开发了 MCP 服务器,目标是让买方分析师能通过一句自然语言指令同时调用财报数据、行业研究和并购数据库,自动产出可视化研报。原本需要 2 天撰写的初稿,现在可能 30 分钟就能完成。这并非替代分析师,而是将他们从机械的资料检索中解放出来。

5.2 企业尽调与合规审查

法律和合规团队在进行尽调时,最大的痛点在于“既要查公开信息,又要看内部档案”。Deep Research Max 的“仅限私有数据”模式让律师可以放心地将客户数据交给 Agent 进行分析,无需担心被搜索引擎记录。配合原生可视化输出,最终的尽调报告可以直接嵌入 Notion 或 Confluence 中。

5.3 学术综述与文献研究

学者撰写综述类论文时,最耗时的环节是将 200 多篇文献快速消化并整理成论点框架。Deep Research Max 的多轮深度推理能力可以在一次调用中阅读数十篇 PDF 并生成结构化大纲。配合 1M Token 的上下文窗口,单次调用即可消化整个研究方向的核心文献。

5.4 SaaS 产品中的 AI 助理升级

许多 SaaS 产品已经集成了 AI Copilot,但目前的实现大多是“包装一下 GPT-4 + RAG”。Deep Research 标准版(低延迟)为这类产品提供了一条升级路径:将 Copilot 升级为真正的自主 Agent,使其能够跨越 Web 数据、产品内数据和用户私有数据进行综合回答,而不仅仅是在文档里搜索关键词。

سادساً: مقارنة Deep Research Max مع المنتجات المماثلة

لنضع Deep Research Max في سياق السوق الحالي. تنقسم منتجات "البحث / الاستدلال العميق" السائدة حالياً إلى ثلاث فئات رئيسية.

| المنتج | الشركة المصنعة | بحث ذاتي | دعم MCP | تصور مرئي أصلي | بيانات خاصة | التقييم الشامل |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ عمق متعدد الجولات | ✅ دعم أساسي | ✅ HTML/SVG أصلي | ✅ وضع Web off | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ جولات متعددة | جزئي | جزئي | جزئي | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCP أصلي | ❌ نصوص فقط | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ ويب بشكل أساسي | ❌ | جزئي | ❌ | ⭐⭐⭐ |

| RAG + Agent مخصص | جهات مختلفة | يعتمد على التنفيذ | يعتمد على التنفيذ | يتطلب تطوير | ✅ | ⭐⭐ |

كما يتضح، حقق Deep Research Max تكاملاً في 4 أبعاد أساسية: استدلال عميق متعدد الجولات + دعم MCP كعنصر أساسي + تصور مرئي أصلي + دمج البيانات الخاصة عبر مصادر متعددة. يعد هذا حالياً أكثر حلول وكلاء البحث (Agent) نضجاً من الناحية الهندسية في المنتجات التجارية.

📌 نصيحة للاختيار: إذا كانت تطبيقاتك تتطلب استدلالاً عميقاً، وامتثالاً للبيانات الخاصة، ومخرجات مرئية، فإن Deep Research Max هو الخيار الأمثل حالياً. أما إذا كنت تحتاج فقط إلى مساعد بحث ويب خفيف، فيمكنك اختيار Perplexity أو الإصدار القياسي من Deep Research. يمكنك الوصول إلى هذه النماذج ومقارنتها عبر منصة APIYI (apiyi.com) بشكل موحد، مما يغنيك عن تكرار إعدادات المصادقة والواجهات لكل مزود على حدة.

سابعاً: الأسئلة الشائعة حول Deep Research Max

س1: ما الفرق بين Deep Research Max و Gemini 3.1 Pro العادي؟

Gemini 3.1 Pro هو النموذج الأساسي الذي يوفر قدرات الاستدلال، بينما Deep Research Max هو وكيل بحث ذاتي (Agent) مبني فوق 3.1 Pro، يغلف قدرات الوكيل مثل استدعاء الأدوات المتعددة، والتكرار متعدد الجولات، والتصور المرئي الأصلي. ببساطة، 3.1 Pro هو "الدماغ"، و Deep Research Max هو "الباحث المجهز بالأدوات والمهارات".

س2: كيف يمكن للمطورين في المنطقة العربية استدعاء Deep Research Max؟

Deep Research Max هو ميزة ضمن فئة Gemini API المدفوعة. أسهل طريقة هي استخدام منصات الوساطة الموحدة مثل APIYI (apiyi.com)، والتي تتيح الدفع بالعملة المحلية، وتوفر واجهات متوافقة تماماً مع الواجهات الرسمية، مع دعم الوصول الموحد لسلسلة Gemini 3.1 Pro ونماذج أخرى.

س3: ما مدى تكلفة Deep Research Max مقارنة بالإصدار القياسي؟

لم تعلن Google عن مضاعفات دقيقة، ولكن بناءً على وصف "توسيع نطاق الحوسبة أثناء وقت الاختبار (test-time compute) والتكرار العميق متعدد الجولات"، فإن تكلفة الاستدعاء الواحد لـ Max ستكون أعلى بشكل ملحوظ من الإصدار القياسي، ربما بمقدار 3 إلى 10 أضعاف. يُنصح باستخدام الإصدار القياسي للمهام العادية، والترقية إلى Max عند الحاجة إلى استدلال عميق فائق.

س4: هل يمكنني كتابة خادم MCP خاص بي للاتصال بـ Deep Research Max؟

نعم، MCP هو بروتوكول مفتوح، ويمكن لأي فريق تنفيذ خادم MCP الخاص به وفقاً للمواصفات، وتغليف بيانات مثل ERP أو CRM أو قواعد المعرفة الداخلية كواجهات قياسية ليستخدمها الوكيل. وقد رحبت Google بمساهمات المجتمع في تنفيذ خوادم MCP.

س5: هل يمكن تضمين مخرجات Deep Research Max مباشرة في صفحات الويب؟

نعم، المخرجات الأصلية تتضمن جداول HTML، ورسوم SVG، وتخطيطات مهيكلة، ويمكن تضمين هذه النواتج مباشرة في صفحات الويب أو لوحات التحكم أو رسائل البريد الإلكتروني. هذه إحدى المزايا الجوهرية التي تميز Deep Research Max عن مخرجات النماذج اللغوية التقليدية.

س6: هل يمكن للوكيل العمل بشكل طبيعي عند تعطيل الوصول إلى الويب تماماً؟

نعم، سيقوم الوكيل بإجراء البحث فقط ضمن مصادر البيانات الخاصة التي تحددها، مثل خوادم MCP، أو البحث في الملفات (File Search)، أو سياق الروابط (URL Context). هذا هو نمط الاستخدام الأساسي لسيناريوهات الامتثال المؤسسي، حيث تظل البيانات بالكامل داخل حدود المؤسسة.

س7: ما هو حجم نافذة السياق لـ Deep Research Max؟

يرث النموذج نافذة السياق من Gemini 3.1 Pro، وهي 1,048,576 رمزاً (حوالي 1 مليون)، بحد أقصى للمخرجات يبلغ 65,536 رمزاً (حوالي 65 ألف). وهذا يعني أن استدعاءً واحداً يمكنه معالجة عشرات الأوراق البحثية الطويلة أو مكتبة وثائق منتج كاملة.

س8: هل يعني تفوق النموذج في اختبار ARC-AGI-2 بنسبة 77.1% أنه الأقوى في جميع القدرات العامة؟

لا يمكن استنتاج ذلك مباشرة. يقيس اختبار ARC-AGI-2 الاستدلال التجريدي، ونسبة 77.1% تشير إلى تفوق Gemini 3.1 Pro في هذا البعد المحدد؛ لكن الأبعاد الأخرى مثل البرمجة، والوسائط المتعددة، وفهم اللغة العربية تعتمد على معاييرها الخاصة. من حيث الأداء الشامل، يعد Gemini 3.1 Pro أحد النماذج الرائدة في الفئة الأولى حالياً.

س9: هل سيحل Deep Research Max محل أنظمة RAG؟

على المدى القصير، لن يحل محلها تماماً، بل سيكون علاقة تكاملية. لا تزال أنظمة RAG تتمتع بمزايا لا يمكن الاستغناء عنها من حيث التكلفة والسرعة في سيناريوهات "الاسترجاع الدقيق لبيانات مؤسسية محددة"؛ بينما يناسب Deep Research Max المهام عالية القيمة التي تتطلب "دمج مصادر متعددة + استدلال عميق + مخرجات مرئية". الممارسة المثلى هي استخدام RAG للإجابة على الأسئلة المباشرة، والترقية إلى Deep Research Max عند الحاجة إلى استدلال عميق.

س10: كيف هو أداء Deep Research Max في السياق العربي؟

يتمتع Gemini 3.1 Pro بقدرات لغوية متعددة تشمل العربية، ويرث Deep Research Max هذا الأساس. ومع ذلك، تجدر الإشارة إلى أن أداة بحث Google تعطي الأولوية للغة الإنجليزية افتراضياً، لذا يُنصح عند تنفيذ مهام بحث باللغة العربية بتفعيل نطاق بحث Google العربي بالتزامن مع خادم MCP عربي، مما يعزز بشكل ملحوظ تغطية المعلومات.

ثامناً: الخلاصة: النقاط الجوهرية لتطبيق Deep Research Max

بالنظر إلى ما تناولناه في هذا المقال حول Google Deep Research Max، إليك أهم النقاط التي يجب على المطورين وضعها في الاعتبار:

أولاً، يُعد Deep Research Max أبرز وكيل بحث ذاتي (Autonomous Research Agent) يستحق المتابعة في عام 2026، حيث قدم 4 اختراقات جوهرية — دعم بروتوكول MCP، التصور البصري الأصلي، دمج المصادر المتعددة، والقفزة في الأداء — مما دفع هندسة وكلاء البحث على مستوى المؤسسات إلى مرحلة قابلة للتطبيق العملي. ثانياً، لكل إصدار موقعه الخاص: الإصدار القياسي (Standard) مُحسّن للسرعة وزمن الاستجابة ليناسب التفاعل اللحظي، بينما الإصدار (Max) مُحسّن للعمق والشمولية ليناسب المهام المعقدة غير المتزامنة، لذا اختر ما يناسب سيناريو عملك. ثالثاً، تحقيق نسبة 77.1% في اختبار ARC-AGI-2 ليس مجرد رقم، بل يعني أن نموذج Gemini 3.1 Pro الأساسي قد تفوق بوضوح على متوسط قدرات البشر في الاستدلال التجريدي، ومع إطار عمل استدعاء الأدوات في Deep Research Max، أصبح لدينا أخيراً حل تجاري جاهز للمهام البحثية المعقدة وطويلة الأمد.

رابعاً، سيصبح بروتوكول MCP المعيار الفعلي للجيل القادم من الوكلاء، ودعم جوجل له كأولوية هو إشارة واضحة بذلك. وبما أن شركة Anthropic هي أيضاً من الداعمين الرئيسيين لـ MCP، ومع وجود دعم مسبق في أدوات مثل Cursor وClaude Desktop، فإن النظام البيئي بأكمله يتشكل حول هذا البروتوكول. لذا، فإن استثمار المطورين وقتهم في تعلم وتنفيذ خوادم MCP يعد خياراً ذا عائد استثماري مرتفع (ROI). خامساً، مسار الوصول من داخل الصين واضح: يتم الوصول إلى Deep Research / Max عبر طبقة المعاينة المدفوعة لـ Gemini API، ومن خلال منصات وكيل API الموحدة مثل APIYI (apiyi.com)، يمكنك إتمام عملية التسجيل والدفع والاستدعاء بسرعة، دون الحاجة إلى القلق بشأن الشبكات العابرة للحدود أو بطاقات الائتمان الدولية.

🎯 نصيحة أخيرة: إذا كنت تقوم ببناء منتجات ذكاء اصطناعي في مجالات البحث، الاستشارات، التحليل، التعليم، أو القانون، بادر فوراً بإدراج Deep Research Max ضمن تقييمك التقني. فهو يمثل أعلى مستوى لهندسة وكلاء الذكاء الاصطناعي التجاريين حالياً، ومن يبدأ أولاً سيحصد أكبر قدر من التميز التنافسي. يمكنك الوصول للاختبار بسرعة عبر منصة APIYI (apiyi.com)، والاستفادة من نافذة السياق التي تبلغ 1 مليون رمز (Token) وقدرات الوسائط المتعددة في Gemini 3.1 Pro لترقية سيناريوهات RAG التقليدية، وخدمة العملاء الذكية، وتوليد المحتوى إلى الجيل التالي من الوكلاء الذاتيين.

إن إطلاق Deep Research Max هو مجرد البداية. فقد صرحت جوجل بوضوح في مدونتها بأن هذا يمثل "تغييراً جذرياً لوكلاء البحث الذاتيين" (a step change for autonomous research agents). إن القدرة على استغلال هذه النافذة الزمنية لتحديث أدواتك ستحدد بشكل مباشر موقع منتجك التنافسي في النصف الثاني من عام 2026.

إعداد: فريق APIYI التقني | نركز على التطبيق العملي لنماذج اللغة الكبيرة، للمزيد من المحتوى التقني تفضلوا بزيارة APIYI عبر apiyi.com