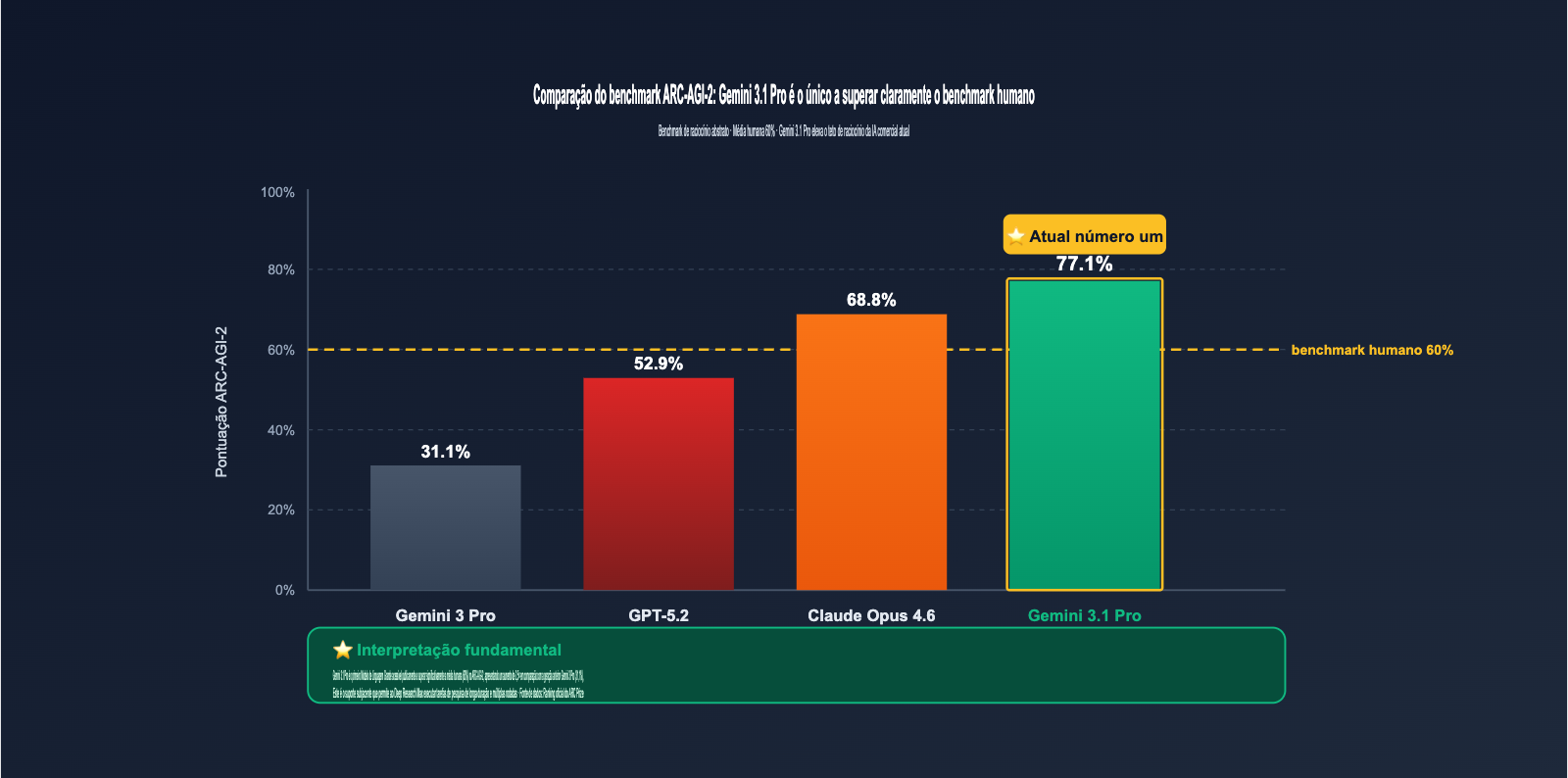

Em 21 de abril de 2026, o Google lançou simultaneamente duas novas gerações de agentes de pesquisa autônomos na visualização pública da API Gemini: Deep Research e Deep Research Max, ambos baseados no modelo Gemini 3.1 Pro, anunciado em fevereiro deste ano. Este é um passo fundamental do Google para levar a "pesquisa autônoma de longo prazo" dos produtos de consumo para as APIs de desenvolvedores. O Deep Research Max atingiu 93,3% no DeepSearchQA e herdou a capacidade de raciocínio central do Gemini 3.1 Pro no ARC-AGI-2, com 77,1% — mais que o dobro do Gemini 3 Pro.

Mais importante ainda, esta geração do Deep Research introduz três novos recursos de nível de engenharia: acesso a qualquer fonte de dados privada via protocolo MCP (Model Context Protocol), saída visual nativa (tabelas HTML / gráficos SVG / infográficos) e fusão de dados entre fontes Web e privadas. Isso significa que, pela primeira vez, os desenvolvedores podem, por meio de uma única invocação do modelo, permitir que o agente pesquise simultaneamente na rede pública, na intranet da empresa e em dados profissionais de terceiros, gerando relatórios visuais prontos para serem incorporados em dashboards.

Este artigo, baseado nas informações oficiais do Google e na documentação da API Gemini, explica detalhadamente os 4 avanços principais do Deep Research Max, as diferenças em relação ao Deep Research comum, o significado real dos 77,1% no ARC-AGI-2 e como os desenvolvedores brasileiros podem acessar essa capacidade.

一、O que é o Deep Research Max: Agente de pesquisa autônomo impulsionado pelo Gemini 3.1 Pro

O Deep Research não é um conceito novo; o Google já havia disponibilizado a versão básica no aplicativo Gemini para consumidores no final de 2024, permitindo que a IA realizasse pesquisas na web e escrevesse um relatório com citações. No entanto, a versão para o consumidor possui funcionalidades limitadas, a API não é aberta e não permite a conexão com dados privados, o que limita seu valor para implementação em engenharia.

Desta vez, o Deep Research / Deep Research Max é uma reescrita em nível de arquitetura. O Google o define como um "agente de pesquisa autônomo de próxima geração" — capaz de planejar, executar e sintetizar tarefas de pesquisa de várias etapas de forma autônoma, abrangendo diversas fontes de ferramentas como web, servidores MCP, contexto de URL, execução de código e recuperação de arquivos, resultando em relatórios estruturados com citações. Ambas as versões foram lançadas simultaneamente, atendendo a diferentes necessidades de engenharia.

| Dimensão de Comparação | Deep Research (Versão Padrão) | Deep Research Max | Cenário de Aplicação |

|---|---|---|---|

| Objetivo de Otimização | Velocidade e latência | Abrangência e profundidade | – |

| Tempo de Raciocínio | Curto (segundos a minutos) | Longo (minutos a horas) | – |

| Computação em tempo de teste | Padrão | Estendido | – |

| Iteração de múltiplas rodadas | 1-2 rodadas | Raciocínio profundo de várias rodadas | – |

| Modo de Invocação | Síncrono / Interação em tempo real | Assíncrono / Tarefa em segundo plano | – |

| Custo | Menor | Maior | – |

| Casos de uso típicos | Assistente de pesquisa conversacional, central de atendimento | Relatórios de investimento, análise de setor, due diligence | – |

O Google destacou claramente em seu blog oficial: o Deep Research Max é voltado para fluxos de trabalho que aceitam a espera assíncrona e buscam a mais alta qualidade de resultados abrangentes. Se você trabalha com due diligence interna, pesquisa setorial profunda ou geração automática de relatórios longos, o Max é a escolha mais adequada; se for um assistente de IA voltado para interação em tempo real com o usuário final, a baixa latência da versão padrão é mais amigável.

💡 Sugestão de acesso: Tanto o Deep Research quanto o Max estão disponíveis através do nível pago da API Gemini. Desenvolvedores brasileiros podem acessar a série Gemini 3.1 Pro diretamente através do APIYI (apiyi.com), que já encapsula a interface de forma unificada com o protocolo compatível com OpenAI, evitando barreiras como redes transfronteiriças e registro de contas.

2. As 4 principais inovações do Deep Research Max

O que mais chama a atenção neste lançamento são os quatro saltos evolutivos em termos de engenharia. Juntos, eles conferem ao Deep Research Max o status de um verdadeiro "Agente de pesquisa autônomo de nível empresarial".

2.1 Primeira inovação: suporte nativo ao protocolo MCP para acesso a dados de terceiros

O Model Context Protocol (MCP) é um protocolo aberto liderado pela Anthropic, cujo objetivo é permitir que agentes de IA acessem ferramentas e fontes de dados externas de forma unificada. O Deep Research Max é o primeiro produto do ecossistema Google a integrar o MCP como um cidadão de primeira classe. Os desenvolvedores só precisam encapsular dados privados ou de terceiros em um servidor MCP, e o agente poderá acessá-los como se fossem ferramentas nativas.

No lançamento, o Google revelou os primeiros parceiros de MCP: FactSet, S&P Global e PitchBook, gigantes de dados financeiros, estão trabalhando com o Google no design de servidores MCP, permitindo que clientes comuns integrem esses fluxos de dados financeiros profissionais aos fluxos de trabalho do Deep Research. Isso significa que agentes de pesquisa em áreas como finanças, direito e medicina finalmente possuem um caminho de integração padronizado, sem a necessidade de reescrever camadas de adaptação para cada fonte de dados.

2.2 Segunda inovação: saída visual nativa, adeus aos relatórios apenas em texto

Tradicionalmente, a saída de um Modelo de Linguagem Grande limita-se a textos em markdown; para incluir gráficos, era necessário chamar uma API de desenho ou um interpretador de código. O Deep Research Max gera tabelas HTML, gráficos SVG e infográficos nativamente durante o processo de raciocínio. Esses produtos visuais são parte orgânica do fluxo de raciocínio do agente, e não um complemento posterior.

As formas de saída incluem: tabelas HTML estruturadas (que podem ser incorporadas diretamente em páginas web), gráficos SVG escaláveis (gráficos de pizza, barras, linhas do tempo, etc.) e infográficos com layout completo (ideais para e-mails ou Slack). Se o projeto integrar um modelo de imagem de alta qualidade, como o Nano Banana, o Deep Research pode até solicitar a geração de elementos visuais mais complexos. Essa mudança eleva a saída do Deep Research de um "longo markdown com referências" para um "relatório multimodal pronto para painéis de controle".

2.3 Terceira inovação: fusão entre Web e dados privados

O Deep Research anterior só conseguia pesquisar na rede pública, o que não resolvia a maior dor dos usuários corporativos: integrar documentos de SaaS, dados de CRM, relatórios de ERP e outras informações privadas à pesquisa. A nova versão permite habilitar simultaneamente, em uma única chamada de API, o Google Search, servidores MCP remotos, contexto de URL, execução de código e busca de arquivos, com o agente decidindo autonomamente qual ferramenta utilizar.

Mais importante ainda, os desenvolvedores podem desativar completamente o acesso à Web, permitindo que o agente realize pesquisas apenas em fontes de dados privadas especificadas. Para setores altamente sensíveis à conformidade de dados, como finanças, direito e medicina, este interruptor é a chave definitiva — ele garante que o agente não vaze acidentalmente informações internas para consultas de pesquisa pública. Este é um detalhe de conformidade crucial, frequentemente negligenciado na implementação de IA corporativa.

2.4 Quarta inovação: salto de desempenho – melhorias em três benchmarks principais

Os benchmarks oficiais publicados pelo Google mostram que o Deep Research Max apresenta um desempenho significativamente superior em relação à versão de dezembro de 2024:

| Benchmark | Versão de Dez/2024 | Deep Research Max (Abr/2026) | Aumento |

|---|---|---|---|

| DeepSearchQA | 66,1% | 93,3% | +27,2 pontos percentuais |

| Humanity's Last Exam | 46,4% | 54,6% | +8,2 pontos percentuais |

| ARC-AGI-2 (modelo base) | 31,1% (Gemini 3 Pro) | 77,1% (Gemini 3.1 Pro) | Mais de 2× |

O benchmark DeepSearchQA avalia especificamente a capacidade de pesquisa autônoma na rede combinada com raciocínio complexo; a pontuação de 93,3% já está próxima do limite máximo. Isso significa que, na tarefa central de "pesquisar materiais autonomamente e redigir respostas precisas", o Deep Research Max dificilmente será superado por concorrentes similares.

III. O real significado dos 77,1% no ARC-AGI-2

Muitos desenvolvedores veem o número "77,1%" e pensam instintivamente que é "ok", mas é preciso entender a dificuldade do benchmark ARC-AGI-2 para compreender o verdadeiro valor dessa pontuação.

3.1 O que é o ARC-AGI-2

O ARC-AGI-2 é mantido pela organização ARC Prize e foi projetado especificamente para testar a capacidade de raciocínio abstrato de uma IA em padrões lógicos inéditos, nunca vistos nos dados de treinamento. Ele utiliza alguns exemplos (pares de entrada → saída) para que o modelo deduza regras implícitas e, em seguida, aplique essas regras para resolver novas entradas desconhecidas. A referência humana é de 60%, portanto, 77,1% já supera a média humana.

A dificuldade central deste benchmark é que: o modelo não pode pontuar apenas memorizando. Qualquer padrão é gerado na hora, sem relação com o corpus de treinamento. É por isso que o ARC-AGI-2 é visto na indústria como um dos padrões-ouro para medir a "capacidade real de raciocínio abstrato".

3.2 Comparação: Gemini 3.1 Pro é o mais forte atualmente

| Modelo | Pontuação ARC-AGI-2 | vs Referência Humana (60%) | Notas |

|---|---|---|---|

| Gemini 3.1 Pro | 77,1% | +17,1 pp | Primeiro modelo aberto a superar claramente os humanos |

| Claude Opus 4.6 | 68,8% | +8,8 pp | Flagship da Anthropic |

| Referência Humana | 60,0% | – | Nível médio |

| GPT-5.2 | 52,9% | -7,1 pp | OpenAI |

| Gemini 3 Pro | 31,1% | -28,9 pp | Geração anterior |

Como você pode ver, o Gemini 3.1 Pro não apenas superou todos os modelos de linguagem grandes comerciais, mas é o único modelo acessível publicamente que ultrapassa claramente a referência humana. Esta é a primeira vez que uma IA comercial abre uma vantagem sobre os humanos em um benchmark rigoroso de "raciocínio lógico inédito". O Deep Research Max herda diretamente essa capacidade de raciocínio — que é o suporte fundamental para realizar tarefas de pesquisa de longa duração e iterações múltiplas.

🎯 Dica de Capacidade: Se o seu produto é voltado para cenários de raciocínio de alta intensidade, como pesquisa, consultoria, análise de investimentos ou análise jurídica, a combinação de Gemini 3.1 Pro + Deep Research Max deve ser incluída imediatamente na sua avaliação técnica. Você pode testar rapidamente através da plataforma APIYI (apiyi.com), que já oferece suporte a chamadas compatíveis com OpenAI para diversos modelos de ponta, incluindo o Gemini 3.1 Pro.

IV. Guia Rápido: Deep Research Max API

Agora que já vimos a teoria, aqui está o código mais enxuto para você colocar o modelo para rodar. O Deep Research Max utiliza a interface padrão da Gemini API e está disponível na camada paga para visualização.

4.1 Chamada básica: Deixe o agente realizar uma pesquisa na web

from google import genai

from google.genai import types

# Conecte-se através do serviço proxy de API da APIYI para evitar problemas de rede transfronteiriça

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analise o panorama global do mercado de modelos de embedding no primeiro semestre de 2026, liste os 5 principais fornecedores e suas vantagens diferenciais",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Habilitar Google Search

thinking_config=types.ThinkingConfig(thinking_level="max") # Orçamento de raciocínio nível Max

)

)

print(response.text) # Exibe o relatório de pesquisa completo (incluindo tabelas HTML nativas / gráficos SVG)

Este código realiza três tarefas: seleciona o modelo Deep Research Max, ativa a ferramenta Google Search e define o nível máximo de raciocínio. O agente planejará autonomamente o caminho da busca, realizará análises iterativas em várias rodadas e, por fim, produzirá um relatório completo com referências e visualizações.

4.2 Chamada avançada: Conectando a um servidor MCP para pesquisa de dados privados

Se você precisar usar o Deep Research Max para processar dados internos da empresa (como CRM ou wiki interna), você precisará encapsular as fontes de dados em um servidor MCP e declará-las durante a chamada:

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analise os tipos de clientes com a maior taxa de rotatividade no pipeline de vendas do Q1 da empresa",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

Observe que aqui não habilitamos o google_search, o que significa que o agente realiza a pesquisa inteiramente dentro do escopo dos dados privados, sem enviar consultas externas ao Google. Esta é uma capacidade crucial para cenários de conformidade corporativa.

4.3 Alternando entre a versão Standard e a Max

Se o seu cenário for voltado para conversas em tempo real com o usuário final, onde a velocidade é mais importante que a profundidade, basta alterar o nome do modelo para deep-research-preview-04-2026. As interfaces de ambos são totalmente compatíveis, diferenciando-se apenas no orçamento de computação interna e no número de rodadas de iteração.

💡 Dica para testes rápidos: Na primeira integração, recomendamos usar a versão Standard do Deep Research para rodar alguns demos e se familiarizar com o estilo de saída do agente, antes de migrar para o Max para tarefas de negócios reais. Recomendamos a conexão direta através da plataforma APIYI (apiyi.com), que suporta chamadas compatíveis com OpenAI para diversos modelos, incluindo Gemini 3.1 Pro, Deep Research e Deep Research Max, facilitando a alternância e comparação.

V. Análise de impacto do Deep Research Max: Quais fluxos de trabalho serão transformados

O lançamento de novas ferramentas é apenas o começo; o verdadeiro valor reside em como elas alterarão os fluxos de trabalho existentes. Com base nos materiais de lançamento e no feedback inicial da comunidade, estas 4 áreas sofrerão o maior impacto.

5.1 Pesquisa de investimentos e análise de mercado

Este é o cenário explicitamente destacado pelo Google no lançamento. Três provedores de dados financeiros — FactSet, S&P Global e PitchBook — uniram forças para criar servidores MCP, com o objetivo de permitir que analistas do lado comprador (buy-side) utilizem comandos em linguagem natural para acessar simultaneamente dados de relatórios financeiros, pesquisas de mercado e bancos de dados de fusões e aquisições, gerando relatórios visuais automaticamente. Um rascunho que levava 2 dias para ser escrito agora pode ser gerado em 30 minutos. Isso não substitui o analista, mas o liberta da busca mecânica por informações.

5.2 Due diligence corporativa e revisão de conformidade

A maior dor das equipes jurídicas e de conformidade ao realizar uma due diligence é "precisar consultar informações públicas e arquivos internos simultaneamente". O modo "apenas dados privados" do Deep Research Max permite que advogados enviem dados de clientes para o agente analisar com segurança, sem medo de que sejam registrados por motores de busca. Com a saída visual nativa, o relatório final de due diligence pode ser incorporado diretamente no Notion ou Confluence.

5.3 Revisão acadêmica e pesquisa bibliográfica

A parte mais demorada para acadêmicos ao escreverem artigos de revisão é digerir rapidamente mais de 200 referências em um arcabouço argumentativo. O raciocínio profundo de múltiplas rodadas do Deep Research Max pode ler dezenas de PDFs em uma única chamada e gerar um esboço estruturado. Com uma janela de contexto de 1 milhão de tokens, uma única chamada pode processar a literatura central de toda uma linha de pesquisa.

5.4 Evolução dos assistentes de IA em produtos SaaS

Muitos produtos SaaS já estão integrando IAs do tipo Copilot, mas a implementação atual é, na maioria das vezes, apenas um "GPT-4 + RAG encapsulado". A versão Standard do Deep Research (baixa latência) oferece um caminho de atualização para esses produtos: substituir o Copilot por um agente autônomo real, capaz de cruzar dados da web, dados internos do produto e dados privados do usuário para responder a perguntas de forma abrangente, em vez de apenas buscar palavras-chave em documentos.

VI. Comparativo: Deep Research Max vs. Produtos Semelhantes

Vamos situar o Deep Research Max no mapa da indústria. Atualmente, os produtos de "pesquisa / raciocínio profundo" podem ser divididos em três categorias principais.

| Produto | Desenvolvedor | Pesquisa Autônoma | Suporte a MCP | Visualização Nativa | Dados Privados | Avaliação Geral |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ Profunda multietapa | ✅ Cidadão de primeira classe | ✅ Nativo HTML/SVG | ✅ Modo Web off | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ Multietapa | Parcial | Parcial | Parcial | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCP nativo | ❌ Focado em texto | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ Focado em Web | ❌ | Parcial | ❌ | ⭐⭐⭐ |

| RAG + Agent próprio | Vários | Depende da implementação | Depende da implementação | Requer dev próprio | ✅ | ⭐⭐ |

Como você pode ver, o Deep Research Max se destaca por ser o mais completo em 4 dimensões fundamentais: raciocínio profundo multietapa + suporte de primeira classe ao MCP + visualização nativa + integração de dados privados de várias fontes. Atualmente, é a solução de Agent de pesquisa com a engenharia mais madura no mercado.

📌 Dica de seleção: Se a sua aplicação exige raciocínio profundo, conformidade com dados privados e resultados visuais, o Deep Research Max é a melhor escolha atual. Se precisar apenas de um assistente de busca web leve, o Perplexity ou a versão padrão do Deep Research dão conta do recado. Você pode acessar e comparar esses modelos através do APIYI (apiyi.com), evitando ter que configurar várias chaves de autenticação de diferentes fornecedores.

VII. Perguntas Frequentes (FAQ) sobre o Deep Research Max

Q1: Qual a diferença entre o Deep Research Max e o Gemini 3.1 Pro comum?

O Gemini 3.1 Pro é o modelo de base que fornece a capacidade de raciocínio. Já o Deep Research Max é um Agent de pesquisa autônomo construído sobre o 3.1 Pro, encapsulando capacidades como invocação de múltiplas ferramentas, iterações multietapa e visualização nativa. Em resumo: o 3.1 Pro é o "cérebro" e o Deep Research Max é o "pesquisador com mãos, pés e ferramentas prontas para o trabalho".

Q2: Como desenvolvedores brasileiros podem acessar o Deep Research Max?

O Deep Research Max é um recurso disponível nos níveis pagos da API do Gemini. O acesso direto pode enfrentar desafios de rede e pagamento. O caminho mais simples é utilizar um serviço proxy de API como o APIYI (apiyi.com), que permite pagamentos locais, oferece total compatibilidade com a interface oficial e permite integrar diversos modelos, incluindo a série Gemini 3.1 Pro, em um só lugar.

Q3: Quanto o Deep Research Max custa a mais do que a versão padrão?

O Google não divulgou um multiplicador exato, mas, considerando as descrições de "computação em tempo de teste estendida e iterações profundas", o custo por chamada do Max será significativamente maior que o da versão padrão, provavelmente entre 3 a 10 vezes. A recomendação é usar a versão padrão para tarefas simples e migrar para o Max apenas quando precisar de profundidade máxima.

Q4: Posso criar meu próprio servidor MCP para integrar ao Deep Research Max?

Sim. O MCP é um protocolo aberto. Qualquer equipe pode implementar seu próprio servidor MCP conforme a especificação, expondo dados de ERP, CRM ou bases de conhecimento internas como interfaces padrão para o Agent. O Google também incentivou a comunidade a contribuir com implementações de servidores MCP.

Q5: Os resultados do Deep Research Max podem ser incorporados em páginas web?

Sim. O resultado nativo inclui tabelas HTML, gráficos SVG e layouts estruturados, que podem ser incorporados diretamente em páginas web, dashboards ou e-mails. Esta é uma das principais vantagens competitivas do Deep Research Max em comparação à saída de texto dos LLMs tradicionais.

Q6: O Agent consegue funcionar se eu desabilitar totalmente o acesso à Web?

Sim. O Agent trabalhará apenas com os dados que você especificar, como servidores MCP, arquivos de pesquisa (File Search) ou contextos de URL, garantindo que os dados não saiam das fronteiras da empresa — um requisito fundamental para cenários de conformidade corporativa.

Q7: Qual o tamanho da janela de contexto do Deep Research Max?

Ele herda a capacidade do Gemini 3.1 Pro, com 1.048.576 tokens de contexto de entrada (aprox. 1 milhão) e 65.536 tokens de saída. Isso significa que uma única chamada pode processar dezenas de artigos longos ou todo o acervo de documentação de um produto.

Q8: O índice 77.1% no ARC-AGI-2 significa que o Gemini 3.1 Pro é o melhor em tudo?

Não dá para tirar essa conclusão. O ARC-AGI-2 mede o raciocínio abstrato; os 77.1% mostram que o Gemini 3.1 Pro lidera nessa dimensão específica. Para código, multimodalidade e compreensão de idiomas (como o chinês), é preciso consultar outros benchmarks. De modo geral, o Gemini 3.1 Pro é um dos modelos de elite no mercado atual.

Q9: O Deep Research Max substituirá os sistemas RAG?

Não a curto prazo; a relação é mais de complementaridade. O RAG ainda possui vantagens imbatíveis de custo e latência em cenários de "recuperação precisa de dados corporativos específicos". O Deep Research Max é ideal para tarefas de alto valor que exigem "fusão de múltiplas fontes + raciocínio profundo + entrega visual". A melhor prática é usar o RAG para perguntas e respostas rápidas e escalar para o Deep Research Max quando o nível de profundidade exigido for maior.

Q10: Como o Deep Research Max se comporta em cenários em chinês?

O Gemini 3.1 Pro possui capacidades multilíngues, incluindo chinês, e o Deep Research Max herda essa base. Vale notar que a ferramenta de busca do Google prioriza o inglês por padrão; para tarefas de pesquisa em chinês, recomenda-se habilitar a busca do Google em domínios chineses junto a um servidor MCP em chinês para melhorar significativamente a cobertura da informação.

VIII. Resumo: Pontos-chave para a implementação do Deep Research Max

Revisando o artigo, aqui estão os pontos fundamentais que os desenvolvedores precisam ter em mente sobre o Google Deep Research Max:

Primeiro, o Deep Research Max é o Agente de pesquisa autônoma mais notável de 2026. Com quatro grandes avanços — suporte a MCP, visualização nativa, fusão de fontes cruzadas e salto de desempenho — ele elevou a engenharia de Agentes de pesquisa de nível empresarial a um estágio de viabilidade prática. Segundo, os dois modelos possuem propósitos distintos: a versão padrão é otimizada para velocidade e baixa latência, ideal para interações em tempo real; já a versão Max é otimizada para profundidade e abrangência, sendo perfeita para tarefas assíncronas complexas. Basta escolher conforme o seu cenário. Terceiro, o resultado de 77,1% no ARC-AGI-2 não é apenas um número. Isso significa que o Gemini 3.1 Pro subjacente superou a média humana na capacidade central de raciocínio abstrato. Combinado com o framework de invocação de ferramentas do Deep Research Max, finalmente temos uma solução comercialmente viável para tarefas de pesquisa complexas e de longa duração.

Quarto, o protocolo MCP se tornará o padrão de fato para a próxima geração de Agentes. O fato de o Google tê-lo integrado como um cidadão de primeira classe é um sinal claro. A Anthropic também é uma das principais promotoras do MCP e, com o suporte já existente no Cursor, Claude Desktop e outros, todo o ecossistema está se formando em torno dele. Para os desenvolvedores, investir tempo agora para aprender e implementar servidores MCP é uma escolha com alto retorno sobre investimento (ROI). Quinto, o caminho de acesso no Brasil e outros países é claro: o Deep Research / Max utiliza o nível de visualização paga da API do Gemini. Por meio de plataformas de serviço proxy de API como a APIYI (apiyi.com), é possível concluir rapidamente todo o processo, desde o registro e pagamento até a invocação, sem a necessidade de lidar pessoalmente com redes transfronteiriças ou cartões de crédito internacionais.

🎯 Sugestão final: Se você está construindo produtos de IA voltados para pesquisa, consultoria, análise, educação ou área jurídica, inclua imediatamente o Deep Research Max na sua avaliação de seleção tecnológica. Ele representa o nível mais alto da engenharia de Agentes de IA comercial atualmente; quem começar primeiro obterá as maiores vantagens competitivas em diferenciação de produto. Você pode realizar testes de acesso rápido através da plataforma APIYI (apiyi.com) e, combinando com a janela de contexto de 1M e as capacidades multimodais do Gemini 3.1 Pro, elevar seus cenários tradicionais de RAG, atendimento ao cliente inteligente e geração de conteúdo para a próxima geração de Agentes autônomos.

O lançamento do Deep Research Max é apenas o começo. O Google afirmou claramente em seu blog que esta é uma "mudança de patamar para agentes de pesquisa autônomos". A capacidade de aproveitar esta janela de oportunidade tecnológica determinará diretamente a posição competitiva do seu produto de IA no segundo semestre de 2026.

Autor: Equipe Técnica APIYI | Focados na implementação prática de Modelos de Linguagem Grande, para mais conteúdos técnicos visite APIYI em apiyi.com