Am 21. April 2026 hat Google im Rahmen der öffentlichen Vorschau der Gemini API zwei neue, autonome Forschungs-Agenten der nächsten Generation eingeführt: Deep Research und Deep Research Max. Beide basieren auf dem im Februar veröffentlichten Modell Gemini 3.1 Pro. Dies ist ein entscheidender Schritt von Google, um „langfristige autonome Forschung“ von Verbraucherprodukten vollständig für Entwickler-APIs zu öffnen. Dabei erreicht Deep Research Max einen Wert von 93,3 % bei DeepSearchQA und erbt die grundlegenden Schlussfolgerungsfähigkeiten von Gemini 3.1 Pro mit 77,1 % bei ARC-AGI-2 – das ist mehr als doppelt so viel wie bei Gemini 3 Pro.

Noch wichtiger ist, dass diese Generation von Deep Research drei neue Funktionen auf Ingenieursebene einführt: MCP-Protokoll-Anbindung (Model Context Protocol) für beliebige private Datenquellen, native Visualisierungsausgabe (HTML-Tabellen / SVG-Diagramme / Infografiken) sowie die datenübergreifende Fusion von Web- und privaten Daten. Das bedeutet, dass Entwickler erstmals über einen einzigen Modellaufruf einen Agenten anweisen können, gleichzeitig im öffentlichen Internet, im Firmenintranet und in professionellen Drittanbieter-Datenbanken zu recherchieren und direkt einen Visualisierungsbericht zu erstellen, der in Dashboards eingebettet werden kann.

Dieser Artikel basiert auf den offiziellen Veröffentlichungen von Google und der Gemini API-Dokumentation. Wir erläutern die vier zentralen Durchbrüche von Deep Research Max, die Unterschiede zur Standardversion von Deep Research, die tatsächliche Bedeutung der 77,1 % bei ARC-AGI-2 und wie Entwickler hierzulande auf diese Funktionen zugreifen können.

I. Was ist Deep Research Max: Ein autonomer Forschungs-Agent, angetrieben von Gemini 3.1 Pro

Deep Research ist kein neues Konzept. Google hat bereits Ende 2024 eine Basisversion in der Gemini-App für Endnutzer freigeschaltet, die es der KI ermöglicht, Web-Recherchen durchzuführen und einen Bericht mit Quellenangaben zu erstellen. Die Funktionen der Konsumentenversion waren jedoch begrenzt, die API nicht öffentlich zugänglich und eine Anbindung an private Daten nicht möglich, was den praktischen Nutzen für Unternehmen einschränkte.

Das aktuelle Deep Research / Deep Research Max ist eine architektonische Neuentwicklung. Google definiert es als "autonomen Forschungs-Agenten der nächsten Generation" – er kann Forschungsaufgaben autonom planen, ausführen und synthetisieren. Dabei greift er auf eine Vielzahl von Werkzeugen wie das Web, MCP-Server, URL-Kontexte, Code-Ausführung und Dateisuche zurück, um am Ende strukturierte Berichte mit Quellenangaben zu liefern. Beide Versionen wurden gleichzeitig veröffentlicht und decken unterschiedliche technische Anforderungen ab.

| Vergleichsdimension | Deep Research (Standard) | Deep Research Max | Einsatzszenario |

|---|---|---|---|

| Optimierungsziel | Geschwindigkeit & Latenz | Vollständigkeit & Tiefe | – |

| Inferenzdauer | Kurz (Sekunden bis Minuten) | Lang (Minuten bis Stunden) | – |

| Test-Time Compute | Standard | Erweitert | – |

| Iterationen | 1-2 Runden | Mehrstufige Tiefenanalyse | – |

| Aufrufmodus | Synchron / Echtzeit | Asynchron / Hintergrund | – |

| Kosten | Niedriger | Höher | – |

| Typische Anwendungsfälle | Konversations-Assistent, Kundenservice | Investment-Research, Branchenanalyse, Due Diligence | – |

Google betont im offiziellen Blog: Deep Research Max ist für Workflows konzipiert, die asynchrone Wartezeiten akzeptieren und höchste Qualität bei der Synthese anstreben. Wenn Sie interne Due-Diligence-Prüfungen, tiefgehende Branchenstudien oder die automatische Erstellung langer Berichte durchführen, ist Max die bessere Wahl. Für KI-Assistenten mit Echtzeit-Interaktion ist die geringe Latenz der Standardversion vorteilhafter.

💡 Anbindungsempfehlung: Sowohl Deep Research als auch Max sind über die kostenpflichtigen Ebenen der Gemini API verfügbar. Entwickler können die Gemini 3.1 Pro-Schnittstellen direkt über APIYI (apiyi.com) aufrufen. Die Plattform bietet eine einheitliche, OpenAI-kompatible Schnittstelle, die Hürden wie grenzüberschreitende Netzwerke oder komplexe Kontoregistrierungen eliminiert.

II. Die 4 Kern-Durchbrüche von Deep Research Max

Besonders bemerkenswert sind die vier technologischen Sprünge dieser Veröffentlichung. Erst durch ihr Zusammenspiel erhält Deep Research Max die Form eines echten "autonomen Forschungs-Agenten für Unternehmen".

2.1 Erster Durchbruch: Native MCP-Protokollunterstützung für beliebige Datenquellen

Das Model Context Protocol (MCP) ist ein von Anthropic initiiertes offenes Protokoll, das es KI-Agenten ermöglicht, auf einheitliche Weise auf externe Werkzeuge und Datenquellen zuzugreifen. Deep Research Max ist das erste Produkt im Google-Ökosystem, das MCP als Bürger erster Klasse integriert. Entwickler müssen private oder Drittanbieter-Daten lediglich als MCP-Server kapseln, und der Agent kann sie wie native Werkzeuge abfragen.

Google gab zudem erste MCP-Partner bekannt: FactSet, S&P Global und PitchBook arbeiten mit Google zusammen, um MCP-Server zu entwerfen, damit Kunden diese professionellen Finanzdatenströme direkt in ihre Deep-Research-Workflows einbinden können. Dies bedeutet, dass Forschungs-Agenten in Bereichen wie Finanzen, Recht oder Medizin endlich einen standardisierten Zugangsweg haben, ohne für jede Datenquelle eine eigene Adapter-Schicht schreiben zu müssen.

2.2 Zweiter Durchbruch: Native Visualisierung statt reiner Textberichte

Herkömmliche LLMs geben meist nur Markdown-Text aus. Um Diagramme hinzuzufügen, musste bisher eine separate Grafik-API oder ein Code-Interpreter aufgerufen werden. Deep Research Max generiert während des Inferenzprozesses nativ HTML-Tabellen, SVG-Diagramme und Infografiken. Diese visuellen Ergebnisse sind integraler Bestandteil des Inferenz-Workflows und kein nachträglicher Patch.

Die Ausgabe umfasst: Strukturierte HTML-Tabellen (direkt in Webseiten einbettbar), skalierbare SVG-Diagramme (Kreis-, Balken-, Zeitstrahldiagramme) und vollständige Infografiken (ideal für E-Mails oder Slack). Wenn das Projekt hochwertige Bildmodelle wie Nano Banana integriert, kann Deep Research diese sogar für komplexere visuelle Darstellungen nutzen. Diese Änderung wertet die Ausgabe von einem "langen Markdown mit Quellen" zu einem "multimodalen Bericht, der direkt in Dashboards eingebettet werden kann" auf.

2.3 Dritter Durchbruch: Verschmelzung von Web- und privaten Datenquellen

Frühere Versionen von Deep Research konnten nur das öffentliche Internet durchsuchen. Das größte Problem für Unternehmenskunden – die Einbindung von SaaS-Dokumenten, CRM-Daten, ERP-Berichten und anderen privaten Informationen – blieb ungelöst. Die neue Version ermöglicht es, in einem einzigen API-Aufruf Google Search, Remote-MCP-Server, URL-Kontext, Code-Ausführung und Dateisuche gleichzeitig zu aktivieren, wobei der Agent autonom entscheidet, welches Werkzeug er verwendet.

Noch wichtiger: Entwickler können den Web-Zugriff komplett deaktivieren, sodass der Agent seine Recherchen ausschließlich innerhalb der definierten privaten Datenquellen durchführt. Für Branchen mit hohen Anforderungen an die Datensicherheit (Finanzen, Recht, Medizin) ist dieser Schalter der entscheidende Faktor – er stellt sicher, dass keine internen Informationen versehentlich in öffentliche Suchanfragen gelangen. Dies ist ein oft übersehenes, aber für die Unternehmenseinführung von KI extrem wichtiges Compliance-Detail.

2.4 Vierter Durchbruch: Leistungssprung – Umfassende Verbesserung der Benchmarks

Die offiziellen Benchmarks von Google zeigen, dass Deep Research Max im Vergleich zur Version vom Dezember 2024 eine signifikante Leistungssteigerung aufweist:

| Benchmark | Version Dez. 2024 | Deep Research Max (04/2026) | Steigerung |

|---|---|---|---|

| DeepSearchQA | 66,1 % | 93,3 % | +27,2 Prozentpunkte |

| Humanity's Last Exam | 46,4 % | 54,6 % | +8,2 Prozentpunkte |

| ARC-AGI-2 (Basismodell) | 31,1 % (Gemini 3 Pro) | 77,1 % (Gemini 3.1 Pro) | Über 2× |

Der DeepSearchQA-Benchmark bewertet speziell die Fähigkeit zur autonomen Netzsuche und synthetischen Inferenz. Mit einem Score von 93,3 % ist das theoretische Limit fast erreicht. Das bedeutet, dass Deep Research Max bei der Kernaufgabe "autonomes Recherchieren und Erstellen präziser Antworten" kaum noch von Wettbewerbern übertroffen werden kann.

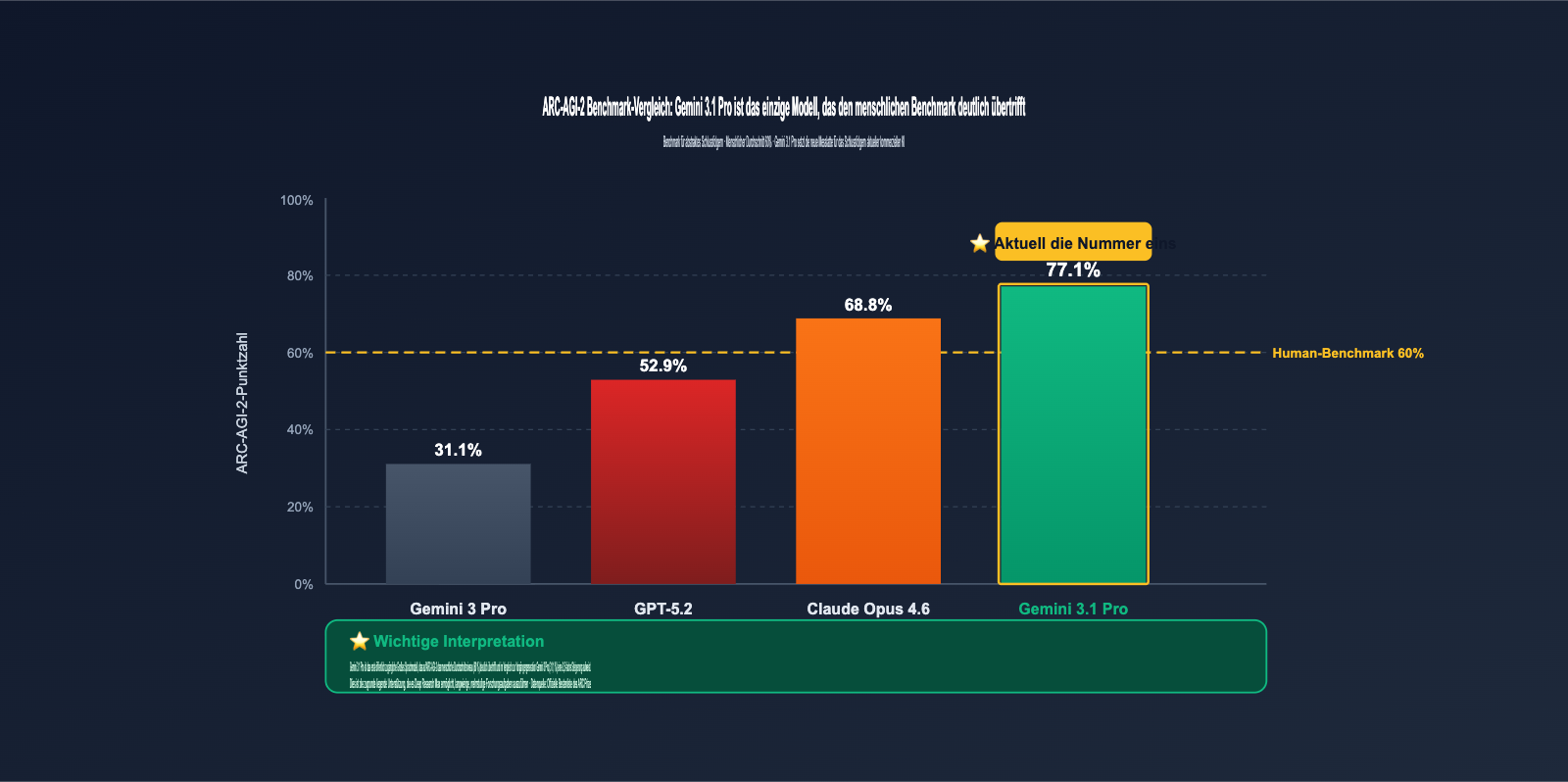

3. Die wahre Bedeutung von 77,1 % bei ARC-AGI-2

Viele Entwickler sehen die Zahl „77,1 %“ und denken instinktiv: „Nicht schlecht“. Um jedoch die tatsächliche Tragweite dieses Ergebnisses zu verstehen, muss man den Schwierigkeitsgrad des ARC-AGI-2-Benchmarks kennen.

3.1 Was ist ARC-AGI-2?

ARC-AGI-2 wird von der ARC Prize-Organisation verwaltet und wurde speziell entwickelt, um die abstrakten Schlussfolgerungsfähigkeiten von KI-Modellen anhand von völlig neuen, in den Trainingsdaten absolut unbekannten logischen Mustern zu testen. Das Modell erhält einige Beispiele (Eingabe-Ausgabe-Paare), aus denen es implizite Regeln ableiten muss, um diese dann auf eine völlig neue Eingabe anzuwenden. Der menschliche Benchmark liegt bei 60 %, womit 77,1 % bereits deutlich über dem menschlichen Durchschnitt liegen.

Der Kernschwierigkeitsgrad dieses Benchmarks liegt darin, dass sich das Modell nicht durch Auswendiglernen profilieren kann. Jedes Muster wird neu generiert und steht in keinem Zusammenhang mit den Trainingsdaten. Genau deshalb gilt ARC-AGI-2 in der Branche als einer der Goldstandards für die Messung „echter abstrakter Schlussfolgerungsfähigkeiten“.

3.2 Vergleich: Gemini 3.1 Pro ist aktuell am stärksten

| Modell | ARC-AGI-2 Ergebnis | vs. Menschlicher Benchmark (60 %) | Anmerkung |

|---|---|---|---|

| Gemini 3.1 Pro | 77,1 % | +17,1 pp | Erstes offenes Modell, das den Menschen deutlich übertrifft |

| Claude Opus 4.6 | 68,8 % | +8,8 pp | Anthropic Flaggschiff |

| Menschlicher Benchmark | 60,0 % | – | Durchschnittsniveau |

| GPT-5.2 | 52,9 % | -7,1 pp | OpenAI |

| Gemini 3 Pro | 31,1 % | -28,9 pp | Vorherige Generation |

Wie man sieht, übertrifft Gemini 3.1 Pro nicht nur alle kommerziellen Großmodelle, sondern ist auch das einzige offen zugängliche Modell, das den menschlichen Benchmark deutlich übertrifft. Dies ist das erste Mal, dass eine kommerzielle KI bei einem strengen Benchmark für „neuartige logische Schlussfolgerungen“ einen Vorsprung gegenüber dem Menschen erzielt. Deep Research Max erbt diese Schlussfolgerungsfähigkeit direkt – dies ist die fundamentale Stütze, die es dem Modell ermöglicht, langwierige, mehrstufige Forschungsaufgaben zu bewältigen.

🎯 Empfehlung: Wenn Ihr Produkt auf hochintensive Schlussfolgerungsszenarien wie Forschung, Beratung, Investitionsanalyse oder juristische Analysen ausgerichtet ist, sollte die Kombination aus Gemini 3.1 Pro und Deep Research Max sofort in Ihre technische Evaluierung aufgenommen werden. Sie können das Modell schnell über die Plattform APIYI (apiyi.com) testen, die bereits OpenAI-kompatible Aufrufe für eine Vielzahl von Flaggschiff-Modellen, einschließlich Gemini 3.1 Pro, unterstützt.

IV. Deep Research Max API: Schnelleinstieg

Nachdem wir die Theorie geklärt haben, finden Sie hier den kompaktesten Code, um Deep Research Max direkt auszuführen. Deep Research Max nutzt die Gemini-API-Standardschnittstelle und ist in der Bezahlversion als Vorschau verfügbar.

4.1 Grundlegender Aufruf: Einen Web-Research-Agenten starten

from google import genai

from google.genai import types

# Über den APIYI-API-Proxy-Dienst verbinden, um Netzwerkprobleme zu vermeiden

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analysieren Sie die Marktlandschaft für eingebettete Modelle in der ersten Jahreshälfte 2026 und listen Sie die Top-5-Anbieter sowie deren differenzierte Vorteile auf",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Google Search aktivieren

thinking_config=types.ThinkingConfig(thinking_level="max") # Max-Stufe für das Denkbudget

)

)

print(response.text) # Gibt den vollständigen Forschungsbericht aus (inkl. nativem HTML/SVG)

Dieser Code führt drei Schritte aus: Auswahl des Deep Research Max-Modells, Aktivierung der Google Search-Tools und Einstellung der höchsten Denkstufe. Der Agent plant eigenständig den Suchpfad, führt iterative Analysen durch und erstellt schließlich einen vollständigen Bericht mit Quellenangaben und Visualisierungen.

4.2 Fortgeschrittener Aufruf: Einbindung eines MCP-Servers für private Daten

Wenn Sie Deep Research Max für interne Unternehmensdaten (z. B. CRM, internes Wiki) nutzen möchten, müssen Sie die Datenquelle als MCP-Server kapseln und beim Aufruf deklarieren:

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Analysieren Sie die Kundentypen mit der höchsten Abwanderungsrate in der Q1-Vertriebspipeline des Unternehmens",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

Beachten Sie, dass hier kein google_search aktiviert ist. Das bedeutet, der Agent führt seine Recherche ausschließlich innerhalb der privaten Daten durch und sendet keine externen Anfragen an Google. Dies ist eine entscheidende Funktion für die Einhaltung von Unternehmensrichtlinien.

4.3 Wechsel zwischen Standard- und Max-Version

Wenn Ihr Anwendungsfall auf Echtzeit-Dialoge für Endnutzer (C-End) ausgerichtet ist, bei denen Geschwindigkeit wichtiger als Tiefe ist, ändern Sie den Modellnamen einfach in deep-research-preview-04-2026. Beide Schnittstellen sind vollständig kompatibel; der Unterschied liegt lediglich im internen Rechenbudget und der Anzahl der Iterationsschritte.

💡 Tipp für den ersten Test: Wir empfehlen, für die ersten Versuche die Standardversion von Deep Research zu nutzen, um sich mit dem Ausgabestil des Agenten vertraut zu machen, bevor Sie für echte geschäftliche Aufgaben auf die Max-Version umsteigen. Wir empfehlen die Anbindung über die Plattform APIYI (apiyi.com), da diese die OpenAI-kompatible Nutzung verschiedener Modelle wie Gemini 3.1 Pro, Deep Research und Deep Research Max unterstützt und einen einfachen Vergleich ermöglicht.

V. Wirkungsanalyse von Deep Research Max: Welche Workflows werden transformiert?

Die Veröffentlichung neuer Tools ist nur der Anfang; der wahre Wert liegt darin, wie sie bestehende Arbeitsabläufe verändern. Basierend auf den Veröffentlichungsunterlagen und ersten Community-Rückmeldungen werden folgende vier Bereiche am stärksten beeinflusst:

5.1 Investment-Research und Branchenanalyse

Dies ist ein von Google explizit genanntes Szenario. Die Finanzdatenanbieter FactSet, S&P Global und PitchBook haben gemeinsam MCP-Server entwickelt, damit Analysten auf der Käuferseite mit einer einzigen natürlichsprachlichen Anweisung gleichzeitig Finanzberichte, Branchenstudien und M&A-Datenbanken abrufen und automatisch visualisierte Berichte erstellen können. Ein Entwurf, für den früher zwei Tage Arbeit nötig waren, könnte nun in 30 Minuten erstellt sein. Dies ersetzt nicht den Analysten, sondern befreit ihn von der mechanischen Datensuche.

5.2 Due Diligence und Compliance-Prüfung

Die größte Herausforderung für Rechts- und Compliance-Teams bei der Due Diligence besteht darin, sowohl öffentliche Informationen als auch interne Unterlagen zu prüfen. Der "Nur private Daten"-Modus von Deep Research Max ermöglicht es Anwälten, Kundendaten sicher vom Agenten analysieren zu lassen, ohne befürchten zu müssen, dass diese von Suchmaschinen indiziert werden. Dank der nativen Visualisierung können die fertigen Berichte direkt in Notion oder Confluence eingebettet werden.

5.3 Akademische Übersichtsarbeiten und Literaturrecherche

Der zeitaufwendigste Teil beim Schreiben von Übersichtsarbeiten ist die Zusammenfassung von über 200 Quellen zu einem argumentativen Rahmen. Die tiefgreifende Schlussfolgerung von Deep Research Max kann in einem einzigen Aufruf Dutzende von PDFs lesen und eine strukturierte Gliederung erstellen. Dank des 1M-Token-Kontextfensters kann ein einziger Aufruf die Kernliteratur eines gesamten Forschungsbereichs abdecken.

5.4 Upgrade von KI-Assistenten in SaaS-Produkten

Viele SaaS-Produkte setzen bereits auf KI-Copiloten, doch die meisten Implementierungen sind lediglich "verpacktes GPT-4 + RAG". Die Standardversion von Deep Research (mit niedriger Latenz) bietet hier einen Upgrade-Pfad: Copiloten können zu echten autonomen Agenten weiterentwickelt werden, die Webdaten, produktinterne Daten und private Nutzerdaten kombinieren, anstatt nur nach Schlüsselwörtern in Dokumenten zu suchen.

VI. Deep Research Max im Vergleich zu ähnlichen Produkten

Betrachten wir Deep Research Max im Branchenkontext. Aktuelle Produkte für „Recherche / Deep Reasoning“ lassen sich grob in drei Kategorien einteilen.

| Produkt | Hersteller | Autonome Recherche | MCP-Unterstützung | Native Visualisierung | Private Daten | Gesamtbewertung |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ Mehrstufige Tiefe | ✅ Erstklassig | ✅ HTML/SVG nativ | ✅ Web-off-Modus | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ Mehrstufig | Teilweise | Teilweise | Teilweise | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCP nativ | ❌ Hauptsächlich Text | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ Hauptsächlich Web | ❌ | Teilweise | ❌ | ⭐⭐⭐ |

| Eigenbau RAG + Agent | Verschiedene | Abhängig von Umsetzung | Abhängig von Umsetzung | Eigene Entwicklung nötig | ✅ | ⭐⭐ |

Wie man sieht, bietet Deep Research Max in vier Kernbereichen die vollständigste Lösung: Mehrstufiges Deep Reasoning + erstklassige MCP-Unterstützung + native Visualisierung + übergreifende Integration privater Daten. Dies ist derzeit die technisch ausgereifteste Recherche-Agenten-Lösung unter den kommerziellen Produkten.

📌 Auswahlhilfe: Wenn Ihre Anwendung Anforderungen an Deep Reasoning, Compliance bei privaten Daten und visualisierte Ausgaben stellt, ist Deep Research Max die derzeit optimale Lösung. Wenn Sie lediglich einen leichtgewichtigen Web-Recherche-Assistenten benötigen, sind Perplexity oder die Standardversion von Deep Research ausreichend. Über APIYI (apiyi.com) können Sie diese Modelle zentral anbinden und vergleichen, ohne die Authentifizierung und Schnittstellen für jeden Anbieter einzeln konfigurieren zu müssen.

VII. Häufig gestellte Fragen (FAQ) zu Deep Research Max

F1: Was ist der Unterschied zwischen Deep Research Max und dem normalen Gemini 3.1 Pro?

Gemini 3.1 Pro ist das zugrunde liegende Basismodell, das die Reasoning-Fähigkeiten bereitstellt. Deep Research Max ist ein darauf aufbauender autonomer Recherche-Agent, der Fähigkeiten wie Multi-Tool-Aufrufe, mehrstufige Iterationen und native Visualisierung kapselt. Einfach ausgedrückt: 3.1 Pro ist das „Gehirn“, Deep Research Max ist der „Rechercheur mit Händen, Füßen und Werkzeugen“.

F2: Wie können Entwickler in China Deep Research Max nutzen?

Deep Research Max ist eine kostenpflichtige Funktion der Gemini-API. Der direkte Zugriff erfordert Lösungen für grenzüberschreitende Netzwerke und Zahlungen. Der einfachste Weg führt über eine einheitliche Proxy-Plattform wie APIYI (apiyi.com). Hier kann in RMB bezahlt werden, die Schnittstellen sind vollständig kompatibel mit dem Original, und es wird der Zugriff auf eine Reihe von Modellen, einschließlich der Gemini 3.1 Pro-Serie, aus einer Hand ermöglicht.

F3: Wie viel teurer ist Deep Research Max im Vergleich zur Standardversion?

Google hat keine genauen Faktoren veröffentlicht. Basierend auf der Beschreibung „erweiterte Test-Time-Compute und mehrstufige tiefe Iterationen“ ist jedoch davon auszugehen, dass die Kosten pro Aufruf bei Max deutlich höher liegen als bei der Standardversion, schätzungsweise um den Faktor 3 bis 10. Es empfiehlt sich, Aufgaben mit geringerer Priorität mit der Standardversion auszuführen und nur bei Bedarf für komplexe Analysen auf Max zu wechseln.

F4: Kann ich meinen eigenen MCP-Server schreiben, um Deep Research Max anzubinden?

Ja. MCP ist ein offenes Protokoll. Jedes Team kann gemäß der Spezifikation eigene MCP-Server implementieren, um Daten aus ERP-, CRM- oder internen Wissensdatenbanken als Standardschnittstellen für den Agenten bereitzustellen. Google begrüßt ausdrücklich Beiträge der Community zur Implementierung von MCP-Servern.

F5: Können die Ausgaben von Deep Research Max direkt in Webseiten eingebettet werden?

Ja. Die native Ausgabe umfasst HTML-Tabellen, SVG-Diagramme und strukturierte Layouts. Diese Ergebnisse können direkt in Webseiten, Dashboards oder E-Mails eingebettet werden. Dies ist einer der wesentlichen Differenzierungsvorteile von Deep Research Max gegenüber der Ausgabe traditioneller LLMs.

F6: Funktioniert der Agent auch, wenn der Webzugriff vollständig deaktiviert ist?

Ja. Der Agent führt seine Recherche dann ausschließlich auf Basis der von Ihnen angegebenen MCP-Server, File-Search-Korpora, URL-Kontexte und anderen privaten Datenquellen durch. Dies ist das Kernszenario für Unternehmens-Compliance – Daten verlassen zu keinem Zeitpunkt die Unternehmensgrenzen.

F7: Wie groß ist das Kontextfenster von Deep Research Max?

Es erbt die Kapazität von Gemini 3.1 Pro: 1.048.576 Tokens (ca. 1 Mio.) für die Eingabe und maximal 65.536 Tokens (ca. 65.000) für die Ausgabe. Das bedeutet, dass ein einzelner Aufruf Dutzende langer wissenschaftlicher Arbeiten oder eine gesamte Produktdokumentation verarbeiten kann.

F8: Bedeutet der ARC-AGI-2-Wert von 77,1 %, dass Gemini 3.1 Pro in allen allgemeinen Fähigkeiten am stärksten ist?

Das lässt sich nicht direkt so schlussfolgern. ARC-AGI-2 misst abstraktes Schlussfolgern; die 77,1 % zeigen, dass Gemini 3.1 Pro in dieser spezifischen Dimension führend ist. Für andere Bereiche wie Programmierung, multimodale Fähigkeiten oder das Verständnis der chinesischen Sprache müssen die jeweiligen Benchmarks betrachtet werden. In der Gesamtbetrachtung gehört Gemini 3.1 Pro jedoch zu den führenden Flaggschiff-Modellen.

F9: Wird Deep Research Max RAG-Systeme ersetzen?

Kurzfristig nicht vollständig, es handelt sich eher um eine ergänzende Beziehung. RAG bietet bei der „präzisen Abfrage spezifischer Unternehmensdaten“ weiterhin unersetzliche Vorteile bei Kosten und Latenz. Deep Research Max eignet sich für hochwertige Aufgaben, die „Multi-Source-Integration + Deep Reasoning + visualisierte Ergebnisse“ erfordern. Die bewährte Praxis besteht darin, RAG für die erste Ebene der Beantwortung zu nutzen und bei Bedarf für tiefgehende Anforderungen auf Deep Research Max zu eskalieren.

F10: Wie schlägt sich Deep Research Max bei chinesischsprachigen Inhalten?

Die Mehrsprachigkeit von Gemini 3.1 Pro umfasst auch Chinesisch, was Deep Research Max als Basis erbt. Beachten Sie jedoch, dass das Google-Search-Tool standardmäßig englischsprachige Ergebnisse bevorzugt. Für chinesische Rechercheaufgaben empfiehlt es sich, gleichzeitig die Google-Suche für den chinesischen Sprachraum sowie chinesischsprachige MCP-Server zu aktivieren, um die Informationsabdeckung deutlich zu verbessern.

VIII. Fazit: Die Kernpunkte für den Einsatz von Deep Research Max

Wenn wir den gesamten Artikel Revue passieren lassen, gibt es für Entwickler einige entscheidende Punkte zu Deep Research Max, die man sich merken sollte:

Erstens: Deep Research Max ist der autonom forschende Agent, den man 2026 im Auge behalten muss. Mit vier zentralen Durchbrüchen – MCP-Unterstützung, native Visualisierung, domänenübergreifende Integration und ein massiver Leistungssprung – wurde die Entwicklung von KI-Agenten auf Unternehmensebene endlich praxisreif. Zweitens: Die beiden Versionen haben unterschiedliche Schwerpunkte: Die Standardversion ist auf Geschwindigkeit und geringe Latenz für Echtzeit-Interaktionen optimiert, während die Max-Version auf Tiefe und Komplexität für asynchrone, umfangreiche Aufgaben ausgelegt ist – wählen Sie einfach je nach Anwendungsfall. Drittens: Die 77,1 % bei ARC-AGI-2 sind kein bloßes Zahlenspiel. Es bedeutet, dass das zugrunde liegende Gemini 3.1 Pro in der Kernkompetenz der abstrakten Schlussfolgerung das menschliche Durchschnittsniveau übertroffen hat. In Kombination mit dem Tool-Aufruf-Framework von Deep Research Max gibt es nun endlich eine kommerziell nutzbare Lösung für komplexe, langwierige Forschungsaufgaben.

Viertens: Das MCP-Protokoll wird zum De-facto-Standard für Agenten der nächsten Generation. Dass Google es als erstklassiges Feature unterstützt, ist ein deutliches Signal. Auch Anthropic treibt MCP maßgeblich voran; zusammen mit der Unterstützung durch Tools wie Cursor oder Claude Desktop bildet sich hier ein ganzes Ökosystem. Für Entwickler ist es eine Investition mit hohem ROI, sich jetzt mit der Implementierung von MCP-Servern zu befassen. Fünftens: Der Zugangsweg in China ist klar definiert: Deep Research / Max läuft über die kostenpflichtige Vorschau-Ebene der Gemini-API. Über einheitliche API-Proxy-Dienste wie APIYI (apiyi.com) lässt sich der gesamte Prozess von der Registrierung über die Bezahlung bis hin zum Modellaufruf schnell abwickeln, ohne dass man sich selbst um grenzüberschreitende Netzwerke oder ausländische Kreditkarten kümmern muss.

🎯 Abschließende Empfehlung: Wenn Sie KI-Produkte in den Bereichen Forschung, Beratung, Analyse, Bildung oder Recht entwickeln, nehmen Sie Deep Research Max sofort in Ihre technische Evaluierung auf. Es repräsentiert den aktuellen Höchststand der kommerziellen KI-Agenten-Entwicklung. Wer frühzeitig handelt, sichert sich den größten Wettbewerbsvorteil durch Produktdifferenzierung. Nutzen Sie die Plattform APIYI (apiyi.com) für einen schnellen Testzugang und kombinieren Sie dies mit dem 1M-Kontextfenster und den multimodalen Fähigkeiten von Gemini 3.1 Pro, um klassische RAG-, intelligente Kundenservice- oder Content-Generierungs-Szenarien auf die nächste Stufe autonomer Agenten zu heben.

Die Veröffentlichung von Deep Research Max ist erst der Anfang. Google hat im Blog bereits klargestellt, dass dies "a step change for autonomous research agents" – ein sprunghafter Wandel – ist. Ob Sie dieses Zeitfenster der Werkzeug-Iteration nutzen können, wird direkt über die Wettbewerbsposition Ihres KI-Produkts in der zweiten Jahreshälfte 2026 entscheiden.

Autor: APIYI Technik-Team | Wir konzentrieren uns auf die praktische Anwendung von großen Sprachmodellen. Weitere technische Inhalte finden Sie unter APIYI (apiyi.com).