Anmerkung des Autors: Eine tiefgreifende Analyse der Unterschiede zwischen Claude Opus 4.7 und GLM-5.1 im Bereich der Programmierung, einschließlich Benchmarks wie SWE-Bench und CursorBench, langfristiger autonomer Codierung und API-Preisen, um Entwicklern bei der Auswahl des am besten geeigneten Modells zu helfen.

Im April 2026 erlebte der Bereich der KI-Programmierung ein direktes Aufeinandertreffen zweier Schwergewichte. Am 7. April veröffentlichte Zhipu AI (Z.ai) das Open-Source-Modell GLM-5.1, das mit 58,4 Punkten im SWE-Bench Pro die weltweite Spitzenposition einnahm. Nur 9 Tage später, am 16. April, veröffentlichte Anthropic Claude Opus 4.7, wobei der CursorBench von 58 % auf 70 % stieg und die Anzahl der gelösten Aufgaben im Rakuten-SWE-Bench das Dreifache von Version 4.6 erreichte.

Die beiden Modelle haben unterschiedliche Positionierungen, Architekturen und Preisstrukturen – konkurrieren jedoch direkt auf dem Kerngebiet der Programmierung. APIYI (apiyi.com) hat beide Modelle bereits integriert, sodass Entwickler sie über eine einheitliche Schnittstelle schnell vergleichen können.

Kernnutzen: Nach dem Lesen dieses Artikels werden Sie die jeweiligen Programmiervorteile beider Modelle kennen und wissen, welches Sie für welches Szenario auswählen sollten.

Vergleich der Kernparameter: Claude Opus 4.7 vs. GLM-5.1

| Vergleichsdimension | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Veröffentlichungsdatum | 16.04.2026 | 07.04.2026 |

| Entwickler | Anthropic | Zhipu AI (Z.ai) |

| Modellarchitektur | Geschlossen | 744B MoE (40B aktive Parameter) |

| Open-Source-Lizenz | ❌ Geschlossen | ✅ MIT-Lizenz (vollständig offen) |

| Kontextfenster | 1M Token | 200K Token |

| Maximale Ausgabe | 128K Token | 131K Token |

| API-Eingabepreis | $5 / MTok | $1 / MTok |

| API-Ausgabepreis | $25 / MTok | $3,2 / MTok |

| Visuelle Fähigkeiten | ✅ 2576px / 3,75MP | ✅ Unterstützt |

| Denkmodus | Adaptives Denken | Multi-Modus-Denken |

| SWE-Bench Pro | Erwartet > 57,3 (Punktzahl von 4.6) | 58,4 (aktuell führend) |

| CursorBench | 70 % | — |

| Trainingshardware | US-GPU-Cluster | Huawei Ascend 910B |

🎯 Kurzes Fazit: Wenn Sie maximale Programmierleistung + extrem langes Kontextfenster + visuelles Verständnis suchen, wählen Sie Opus 4.7. Wenn Sie maximale Kosteneffizienz + Open-Source-Kontrolle + eine ausreichend starke Programmierleistung bevorzugen, wählen Sie GLM-5.1. Beide Modelle sind auf APIYI (apiyi.com) verfügbar.

Tiefenanalyse der Programmier-Benchmarks

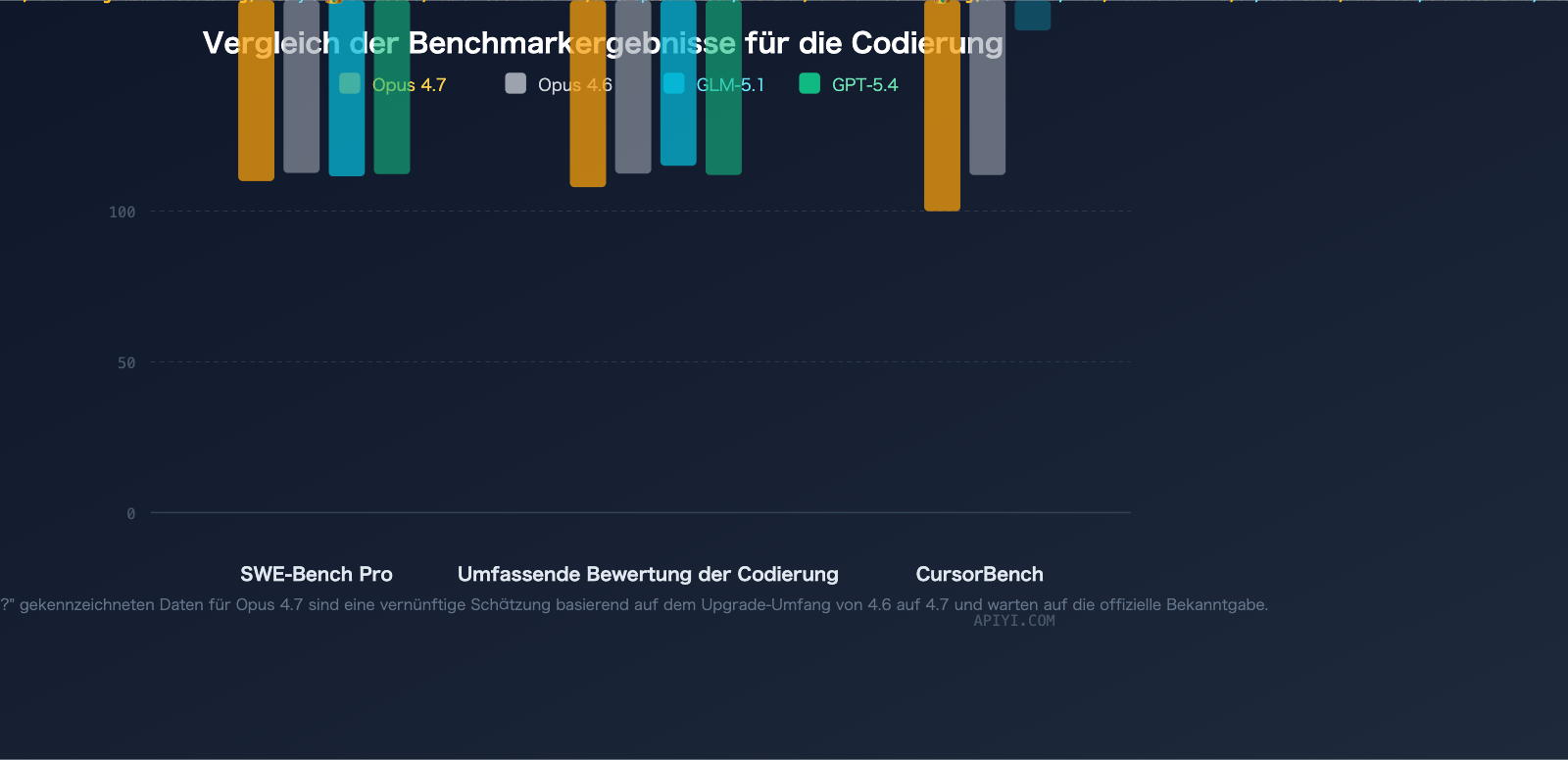

SWE-Bench Pro: GLM-5.1 aktuell führend

SWE-Bench Pro ist einer der renommiertesten Benchmarks für reale Programmieraufgaben, bei dem die Fähigkeit von Modellen getestet wird, echte GitHub-Issues zu lösen.

| Modell | SWE-Bench Pro | Rang |

|---|---|---|

| GLM-5.1 | 58,4 | #1 |

| GPT-5.4 | 57,7 | #2 |

| Claude Opus 4.6 | 57,3 | #3 |

| Claude Opus 4.7 | Erwartet > 57,3 | Update folgt |

GLM-5.1 führt mit 58,4 Punkten die SWE-Bench Pro-Rangliste an und übertrifft damit GPT-5.4 (57,7) sowie Claude Opus 4.6 (57,3). Bemerkenswert ist, dass Opus 4.7 im Vergleich zu 4.6 im Programmierbereich deutliche Fortschritte erzielt hat (CursorBench +12pp, Rakuten-SWE-Bench 3-fach). Es wird erwartet, dass der SWE-Bench Pro-Wert von Opus 4.7 signifikant steigt, was jedoch zum Zeitpunkt der Veröffentlichung noch nicht offiziell bestätigt wurde.

CursorBench: Opus 4.7 mit großem Vorsprung

CursorBench testet die Programmierfähigkeiten von Modellen in einer echten IDE-Umgebung (Cursor-Editor) und kommt damit täglichen Entwicklungsszenarien am nächsten.

| Modell | CursorBench |

|---|---|

| Claude Opus 4.7 | 70% |

| Claude Opus 4.6 | 58% |

| GLM-5.1 | Keine Daten |

Coding Composite (Kodierungs-Gesamtbewertung)

Die Kodierungs-Gesamtbewertung aggregiert mehrere Dimensionen wie SWE-Bench Pro, Terminal-Bench 2.0 und NL2Repo:

| Modell | Kodierungs-Gesamtbewertung |

|---|---|

| GPT-5.4 | 58,0 |

| Claude Opus 4.6 | 57,5 |

| GLM-5.1 | 54,9 |

| Claude Opus 4.7 | Erwartet deutlich über 4,6 |

Bei der kombinierten Kodierungsbewertung liegt Claude Opus 4.6 mit 57,5 vor GLM-5.1 mit 54,9. Es wird erwartet, dass Opus 4.7 den Vorsprung bei der kombinierten Kodierungsleistung weiter ausbaut.

🎯 Fazit: GLM-5.1 ist bei SWE-Bench Pro als Einzeldisziplin am stärksten, aber bei der kombinierten Kodierungsleistung bleibt die Claude-Serie führend. Entwickler können über APIYI (apiyi.com) beide Modelle gleichzeitig einbinden und A/B-Tests in ihren eigenen Projekten durchführen.

Tiefenvergleich der Programmierfähigkeiten

Benchmarks sind nur ein Aspekt. In realen Programmierszenarien zeigen beide Modelle völlig unterschiedliche Stärken.

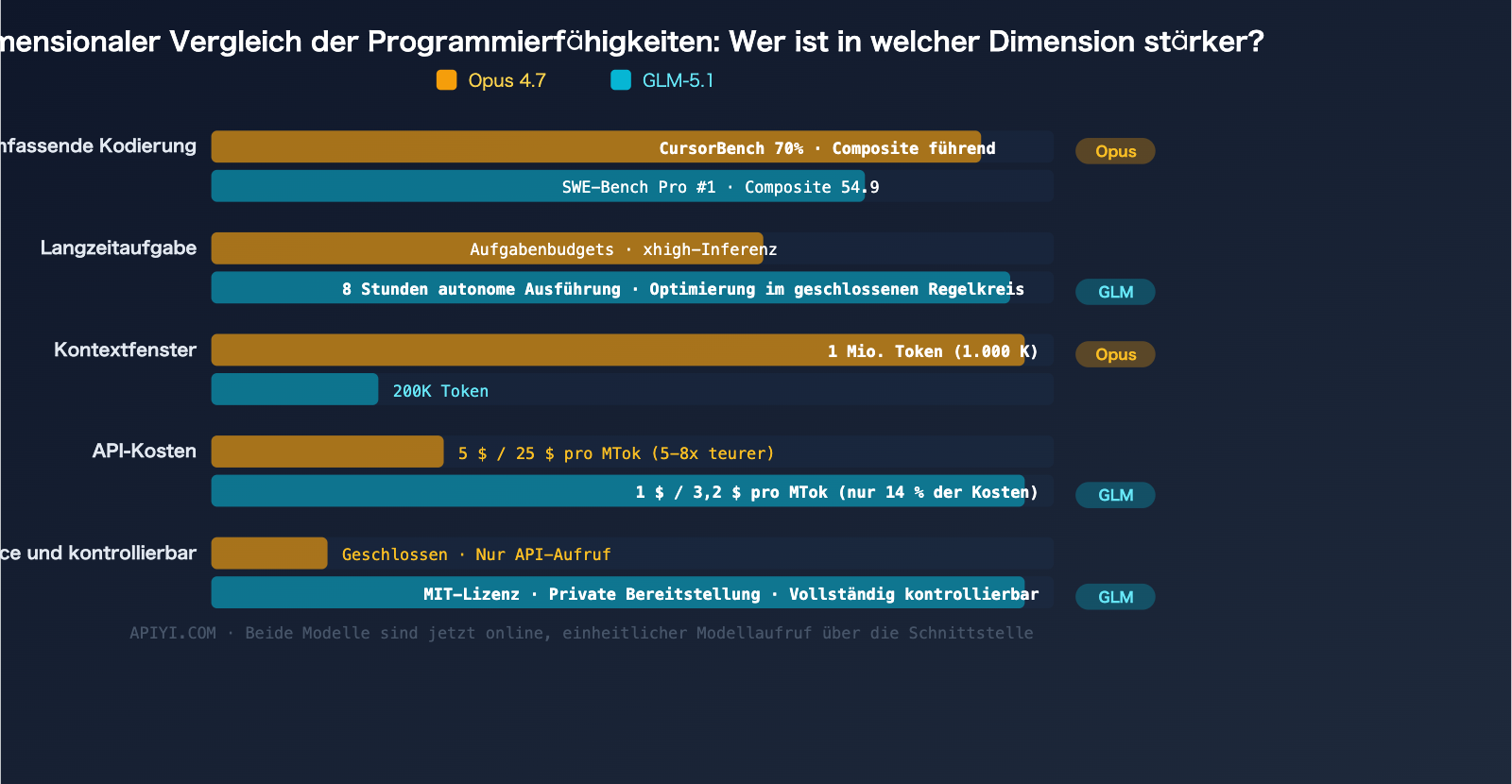

Autonome Langzeit-Programmierung

Dies ist das Killer-Feature von GLM-5.1.

| Langzeit-Fähigkeiten | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Max. autonome Laufzeit | Abhängig vom Task-Budget | 8 Stunden ununterbrochen |

| Autonomer Zyklus | Unterstützt Multi-Step-Agents | Vollständiger „Planen→Ausführen→Testen→Fixen→Optimieren“-Zyklus |

| Token-Budget-Management | Task Budgets (neue Funktion) | Integriertes Langzeit-Task-Management |

| Selbstheilung | Automatische Korrektur beim Coden | Autonomer Zyklus aus Experiment, Analyse und Optimierung |

GLM-5.1 kann Programmieraufgaben über bis zu 8 Stunden hinweg kontinuierlich und autonom ausführen und dabei einen geschlossenen „Experiment→Analyse→Optimierung“-Zyklus bilden. Dies ist bei großen Refactorings oder modulübergreifenden Migrationen ein enormer Vorteil.

Opus 4.7 ist zwar durch Task Budgets und die xhigh-Inferenzstufe bei langen Aufgaben leistungsfähiger geworden, konzentriert sich jedoch eher auf „effiziente Erledigung innerhalb eines Budgets“ als auf „unbegrenzte Ausführung über lange Zeiträume“.

Agenten-Aufgaben (Agentic Tasks)

| Agenten-Fähigkeiten | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| MCP-native Unterstützung | ✅ Tief optimiert | ✅ Unterstützt |

| Effizienz bei Tool-Aufrufen | Weniger Aufrufe, mehr Inferenz | Aktive Tool-Nutzung |

| Zuverlässigkeit bei Multi-Steps | Sehr hoch | Hoch |

| Kontext-Management | 1M Token Kontextfenster | 200K Token |

| Sub-Agent-Management | Feinsteuerung (einstellbar) | Unterstützt |

Bei Agenten-Aufgaben ist das 1M-Token-Kontextfenster von Opus 4.7 ein entscheidender Vorteil. Beim Arbeiten mit großen Codebasen kann Opus 4.7 mehr Dateikontext auf einmal laden, was Informationsverluste reduziert.

Code-Review und Refactoring

| Code-Review-Fähigkeiten | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Anweisungspräzision | Führt Anweisungen wörtlicher aus | Flexible Interpretation |

| Selbstvalidierung | Validierung vor der Ausgabe (neu) | Unterstützt |

| Großdateiverarbeitung | 1M Kontext lädt ganze Codebasen | 200K Limit erfordert ggf. Segmentierung |

| Visuelle Prüfung | Verständnis hochauflösender Screenshots | Grundlegende visuelle Fähigkeiten |

Schnelle Programmierung und tägliche Entwicklung

| Tägliche Programmierung | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Reaktionsgeschwindigkeit | Mittel | Schnell |

| API-Kosten | $5/$25 pro MTok | $1/$3.2 pro MTok |

| Codestil | Prägnanter, inferenzorientiert | Detaillierte Kommentare, toolorientiert |

| Mehrsprachigkeit | Exzellent | Exzellent (chinesische Kommentare natürlicher) |

Preisvergleich: 5-facher Kostenunterschied

Der Preis ist bei der Modellwahl ein nicht zu unterschätzender Faktor. Die Preisunterschiede sind massiv:

| Abrechnungsposten | Claude Opus 4.7 | GLM-5.1 | Unterschied |

|---|---|---|---|

| Input-Preis | $5 / MTok | $1 / MTok | Opus 5x teurer |

| Output-Preis | $25 / MTok | $3.2 / MTok | Opus 7.8x teurer |

| Cache-Preis | Standard-Cache-Rabatt | $0.26 / MTok | GLM-Cache extrem günstig |

| Lang-Kontext-Aufschlag | Keine | Keine | — |

Kostenschätzung für reale Szenarien

Angenommen, ein mittelgroßes Entwicklungsteam verbraucht monatlich 500M Token (je zur Hälfte Input und Output):

| Modell | Monatliche Input-Kosten | Monatliche Output-Kosten | Monatliche Gesamtkosten |

|---|---|---|---|

| Opus 4.7 | $1.250 | $6.250 | $7.500 |

| GLM-5.1 | $250 | $800 | $1.050 |

| Preisdifferenz | — | — | $6.450/Monat |

Die Kosten für GLM-5.1 betragen nur etwa 14 % der Kosten von Opus 4.7. Für budgetbewusste Teams ist dies ein entscheidender Unterschied.

🎯 Kostenoptimierungsstrategie: Über die APIYI-Plattform (apiyi.com) können Sie beide Modelle flexibel einsetzen – überlassen Sie komplexe Architekturdesigns und Code-Reviews Opus 4.7 und verlagern Sie die massenhafte tägliche Code-Generierung sowie Batch-Aufgaben auf GLM-5.1. Die einheitliche Schnittstelle der Plattform macht die Umsetzung einer Multi-Modell-Strategie extrem kostengünstig.

Empfehlungen für verschiedene Szenarien

Szenarien für Claude Opus 4.7

- Verarbeitung riesiger Codebasen: Wenn der Kontext von Dutzenden Dateien gleichzeitig geladen werden muss (1 Mio. vs. 200.000 Token).

- Code-Reviews und Sicherheitsaudits: Wenn höchste Präzision und Selbstverifizierungsfähigkeiten erforderlich sind.

- Multimodale Entwicklung: Wenn UI-Screenshots, Designentwürfe oder Dokumentenbilder verstanden werden müssen (3,75 MP hochauflösende Bildverarbeitung).

- Zuverlässigkeitsanforderungen auf Unternehmensebene: Wenn stabiler, kommerzieller Support durch einen geschlossenen Anbieter benötigt wird.

- Komplexe, rechenintensive Programmierung: Szenarien wie mathematische Berechnungen oder Algorithmen-Design, die tiefgreifendes logisches Denken erfordern.

Szenarien für GLM-5.1

- Langfristige autonome Entwicklung: Wenn das Modell über mehrere Stunden hinweg kontinuierlich an großen Refactorings arbeiten muss.

- Kostensensible Batch-Aufgaben: CI/CD-Integration, massenhafte Codegenerierung und automatisierte Tests.

- Private Bereitstellung: Wenn das Modell auf eigenen Servern betrieben werden muss (MIT-Lizenz, vollständig offen).

- Chinesische Entwicklungsumgebung: Chinesische Code-Kommentare und Dokumentationserstellung sind natürlicher und flüssiger.

- SWE-Bench-Aufgaben: Reale Programmieraufgaben wie das Lösen von GitHub-Issues oder das Beheben von Bugs.

Best Practice: Die Zwei-Modell-Strategie

| Aufgabentyp | Empfohlenes Modell | Grund |

|---|---|---|

| Architekturdesign & technische Konzepte | Opus 4.7 | Tiefes logisches Denken + extrem langes Kontextfenster |

| Tägliche Programmierung | GLM-5.1 | Kostengünstig bei ausreichender Qualität |

| Code-Review | Opus 4.7 | Präzision + Selbstverifizierung |

| Massenhafte Codegenerierung | GLM-5.1 | Kosten betragen nur 14 % |

| Bug-Fixing (GitHub Issue) | GLM-5.1 | Spitzenreiter im SWE-Bench Pro |

| Refactoring über mehrere Dateien | Opus 4.7 | Vorteil durch 1 Mio. Kontextfenster |

| Langfristige autonome Aufgaben | GLM-5.1 | 8 Stunden autonome Ausführung |

| UI/Screenshot-bezogene Entwicklung | Opus 4.7 | 3,75 MP hochauflösende Bildverarbeitung |

🎯 Empfehlung für die zentrale Verwaltung: APIYI (apiyi.com) bietet sowohl Claude Opus 4.7 als auch GLM-5.1 an. Entwickler können beide Modelle über denselben API-Schlüssel und eine einheitliche, OpenAI-kompatible Schnittstelle aufrufen. So lässt sich je nach Aufgabentyp flexibel wechseln, um optimale Effizienz und Kosteneffizienz bei der Programmierung zu erreichen.

Häufig gestellte Fragen (FAQ)

Q1: Ist GLM-5.1 wirklich besser als Claude Opus?

Das kommt auf die Dimension an. Beim SWE-Bench Pro übertrifft GLM-5.1 (58,4) tatsächlich Opus 4.6 (57,3), jedoch liegt Opus 4.6 (57,5) bei der allgemeinen Programmierbewertung vor GLM-5.1 (54,9). Da Opus 4.7 ein bedeutendes Upgrade gegenüber 4.6 darstellt, dürfte der Vorsprung bei der allgemeinen Programmierleistung weiter wachsen. Insgesamt ist Opus 4.7 umfassender, aber GLM-5.1 bietet in spezifischen Szenarien (langfristige Aufgaben, SWE-Bench-Aufgaben) einzigartige Vorteile.

Q2: GLM-5.1 ist so viel günstiger – reicht die Qualität aus?

Für die meisten Programmieraufgaben reicht sie aus. Die Leistung von GLM-5.1 im SWE-Bench Pro beweist, dass es über erstklassige Programmierfähigkeiten verfügt. Testergebnisse zeigen, dass es 94,6 % der Programmierleistung von Claude Opus 4.6 erreicht, bei nur einem Fünftel bis einem Achtel der Kosten. Ein direkter Vergleich über APIYI (apiyi.com) ist der sicherste Weg, um eine Entscheidung zu treffen.

Q3: Können beide Modelle über dieselbe Schnittstelle aufgerufen werden?

Ja. APIYI (apiyi.com) stellt eine einheitliche, OpenAI-kompatible Schnittstelle bereit. Sie müssen lediglich die Modell-ID ändern, um zwischen Claude Opus 4.7 und GLM-5.1 zu wechseln, ohne den Code-Rahmen anzupassen oder mehrere API-Schlüssel verwalten zu müssen.

Zusammenfassung

Die wichtigsten Erkenntnisse aus dem Programmiervergleich zwischen Claude Opus 4.7 und GLM-5.1:

- SWE-Bench Pro Einzelwertung: GLM-5.1 (58,4) führt derzeit, wobei die Ergebnisse für Opus 4.7 noch ausstehen.

- Umfassende Programmierfähigkeiten: Die Opus-Serie ist insgesamt führend; die 70%ige Verbesserung bei CursorBench und die dreifache Steigerung bei Rakuten-SWE-Bench von Version 4.7 sind beeindruckend.

- Autonomes Programmieren über lange Zeiträume: Die Fähigkeit von GLM-5.1 zur 8-stündigen autonomen Ausführung ist ein Alleinstellungsmerkmal.

- Kontextfenster: Das 1M-Kontextfenster von Opus 4.7 ist fünfmal so groß wie das von GLM-5.1, was bei der Arbeit mit umfangreichen Codebasen einen deutlichen Vorteil bietet.

- Preisunterschied: Die Kosten für GLM-5.1 betragen nur etwa 14 % derer von Opus 4.7.

- Open-Source-Vorteil: GLM-5.1 steht unter der MIT-Lizenz, was eine private Bereitstellung und individuelle Anpassungen ermöglicht.

Die optimale Strategie ist kein Entweder-oder, sondern das Zusammenspiel beider Modelle – nutzen Sie Opus 4.7 für hochwertige Aufgaben und GLM-5.1 für hochfrequente Batch-Aufgaben. APIYI (apiyi.com) hat beide Modelle integriert, sodass Entwickler über eine einheitliche Schnittstelle flexibel auf beide zugreifen können, um die perfekte Balance zwischen Effizienz und Kosten zu erzielen.

📚 Referenzen

-

VentureBeat – Bericht zur Open-Source-Veröffentlichung von GLM-5.1: Detaillierter Bericht über den Spitzenplatz von GLM-5.1 in SWE-Bench Pro.

- Link:

venturebeat.com/technology/ai-joins-the-8-hour-work-day-as-glm-ships-5-1-open-source-llm-beating-opus-4 - Hinweis: Bericht eines führenden Tech-Magazins inklusive Benchmarking-Daten.

- Link:

-

MarkTechPost – Technische Analyse von GLM-5.1: Technische Analyse des 754B-Agenten-Modells.

- Link:

marktechpost.com/2026/04/08/z-ai-introduces-glm-5-1 - Hinweis: Enthält Architekturdetails und eine Analyse der 8-stündigen autonomen Ausführungsfähigkeit.

- Link:

-

Anthropic Offiziell – Veröffentlichung von Claude Opus 4.7: Vollständige Upgrade-Hinweise.

- Link:

anthropic.com/news/claude-opus-4-7 - Hinweis: Offizielle Ankündigung und Benchmarking-Daten zu Opus 4.7.

- Link:

-

GLM-5.1 HuggingFace Modellseite: Download und Dokumentation des Open-Source-Modells.

- Link:

huggingface.co/zai-org/GLM-5.1 - Hinweis: Modellgewichte unter MIT-Lizenz und Bereitstellungsanleitungen.

- Link:

-

Claude API-Dokumentation – Modellübersicht: Technische Spezifikationen aller Claude-Modelle.

- Link:

platform.claude.com/docs/en/about-claude/models/overview - Hinweis: Offizielle Modellparameter, Preisgestaltung und Funktionsvergleiche.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren. Weitere Informationen finden Sie im APIYI Dokumentationszentrum unter docs.apiyi.com.