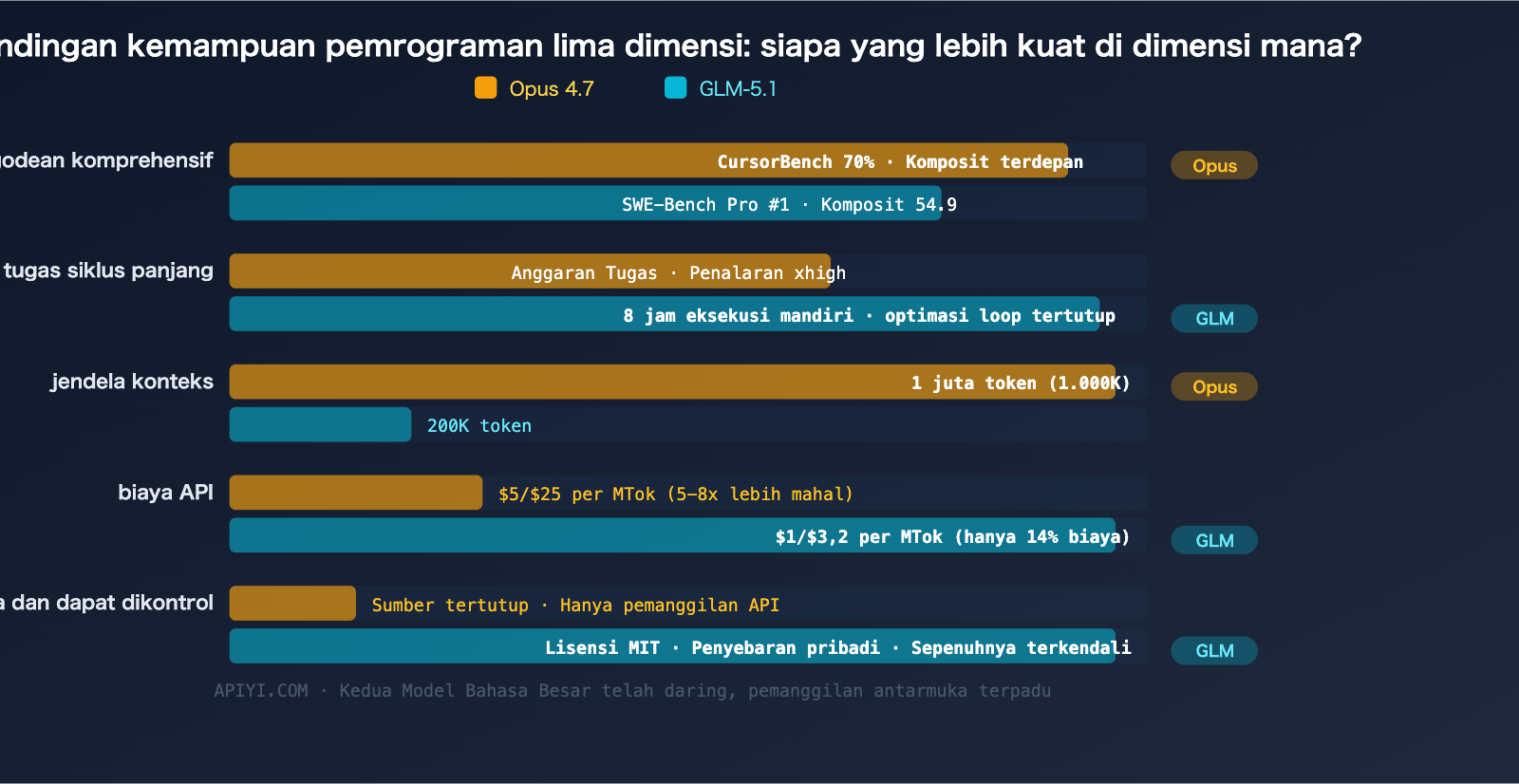

Catatan penulis: Analisis mendalam mengenai perbedaan kemampuan pemrograman antara Claude Opus 4.7 dan GLM-5.1, mencakup tolok ukur seperti SWE-Bench, CursorBench, pengodean otonom jangka panjang, hingga harga API, untuk membantu pengembang memilih model pengodean yang paling tepat.

Pada April 2026, dunia pemrograman AI menyaksikan pertarungan sengit antara dua pemain besar. Pada 7 April, Zhipu AI (Z.ai) merilis model sumber terbuka GLM-5.1, yang menduduki puncak peringkat global dengan skor 58,4 pada SWE-Bench Pro. Hanya 9 hari kemudian, pada 16 April, Anthropic merilis Claude Opus 4.7, dengan peningkatan CursorBench dari 58% menjadi 70%, dan jumlah tugas yang diselesaikan pada Rakuten-SWE-Bench mencapai 3 kali lipat dari versi 4.6.

Kedua model ini memiliki posisi, arsitektur, dan perbedaan harga yang sangat kontras—namun bersaing langsung di medan perang utama yaitu pemrograman. APIYI apiyi.com telah meluncurkan kedua model ini, sehingga pengembang dapat melakukan perbandingan cepat melalui antarmuka terpadu.

Nilai Inti: Setelah membaca artikel ini, Anda akan memahami keunggulan pemrograman masing-masing model dan model mana yang harus dipilih untuk skenario yang berbeda.

Perbandingan Parameter Inti Claude Opus 4.7 vs GLM-5.1

| Dimensi Perbandingan | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Tanggal Rilis | 16.04.2026 | 07.04.2026 |

| Pengembang | Anthropic | Zhipu AI (Z.ai) |

| Arsitektur Model | Sumber tertutup | 744B MoE (40B parameter aktif) |

| Lisensi Sumber Terbuka | ❌ Sumber tertutup | ✅ Lisensi MIT (terbuka sepenuhnya) |

| Jendela Konteks | 1M token | 200K token |

| Output Maksimum | 128K token | 131K token |

| Harga Input API | $5 / MTok | $1 / MTok |

| Harga Output API | $25 / MTok | $3.2 / MTok |

| Kemampuan Visual | ✅ 2576px / 3.75MP | ✅ Didukung |

| Mode Berpikir | Adaptive Thinking | Multi-mode Thinking |

| SWE-Bench Pro | Estimasi > 57,3 (skor 4.6) | 58,4 (Puncak saat ini) |

| CursorBench | 70% | — |

| Perangkat Keras Pelatihan | Klaster GPU AS | Huawei Ascend 910B |

🎯 Kesimpulan Cepat: Jika Anda mengejar kemampuan pemrograman terbaik + jendela konteks super panjang + pemahaman visual, pilih Opus 4.7; jika Anda mengejar efisiensi biaya terbaik + kontrol sumber terbuka + kemampuan pemrograman yang cukup kuat, pilih GLM-5.1. Kedua model sudah tersedia di APIYI apiyi.com.

Perbandingan Mendalam Benchmark Pemrograman

SWE-Bench Pro: GLM-5.1 Saat Ini Memimpin

SWE-Bench Pro adalah salah satu benchmark pengodean dunia nyata yang paling otoritatif saat ini, yang menguji kemampuan model dalam menyelesaikan Issue nyata di GitHub.

| Model | SWE-Bench Pro | Peringkat |

|---|---|---|

| GLM-5.1 | 58.4 | #1 |

| GPT-5.4 | 57.7 | #2 |

| Claude Opus 4.6 | 57.3 | #3 |

| Claude Opus 4.7 | Estimasi > 57.3 | Menunggu pembaruan |

GLM-5.1 memuncaki SWE-Bench Pro dengan skor 58.4, melampaui GPT-5.4 (57.7) dan Claude Opus 4.6 (57.3). Perlu dicatat bahwa Opus 4.7 memiliki peningkatan signifikan di bidang pengodean dibandingkan 4.6 (CursorBench +12pp, Rakuten-SWE-Bench 3x lipat), dan skor SWE-Bench Pro-nya diperkirakan akan meningkat secara substansial, namun belum diumumkan hingga artikel ini diterbitkan.

CursorBench: Opus 4.7 Memimpin Jauh

CursorBench menguji kemampuan penulisan kode model dalam lingkungan IDE nyata (editor Cursor), yang lebih mendekati skenario pengembangan sehari-hari.

| Model | CursorBench |

|---|---|

| Claude Opus 4.7 | 70% |

| Claude Opus 4.6 | 58% |

| GLM-5.1 | Belum ada data |

Skor Komposit Pengodean (Coding Composite)

Skor komposit pengodean menggabungkan beberapa dimensi seperti SWE-Bench Pro, Terminal-Bench 2.0, dan NL2Repo:

| Model | Skor Komposit Pengodean |

|---|---|

| GPT-5.4 | 58.0 |

| Claude Opus 4.6 | 57.5 |

| GLM-5.1 | 54.9 |

| Claude Opus 4.7 | Estimasi jauh lebih tinggi dari 4.6 |

Dalam skor komposit pengodean, Claude Opus 4.6 memimpin dengan 57.5 dibandingkan GLM-5.1 yang meraih 54.9. Kemampuan pengodean komposit Opus 4.7 diperkirakan akan semakin memperlebar jarak.

🎯 Analisis: GLM-5.1 menjadi yang terkuat pada kategori SWE-Bench Pro, namun dalam kemampuan pengodean komposit, seri Claude masih tetap unggul. Pengembang dapat menggunakan layanan proksi API APIYI (apiyi.com) untuk mengakses kedua model secara bersamaan dan melakukan A/B testing pada proyek Anda sendiri.

Analisis Mendalam Kemampuan Skenario Pemrograman

Tolok ukur (benchmark) hanyalah satu dimensi. Dalam skenario pemrograman nyata, kedua model ini menunjukkan keunggulan yang sangat berbeda.

Pengodean Otonom Jangka Panjang

Ini adalah fitur unggulan dari GLM-5.1.

| Kemampuan Jangka Panjang | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Waktu Eksekusi Otonom Maksimal | Tergantung pada Anggaran Tugas | 8 jam tanpa henti |

| Siklus Otonom | Mendukung agen multi-langkah | Siklus tertutup penuh «Rencana→Eksekusi→Uji→Perbaikan→Optimasi» |

| Manajemen Anggaran Token | Anggaran Tugas (fitur baru) | Manajemen tugas panjang bawaan |

| Perbaikan Mandiri | Perbaikan otomatis saat pengodean | Siklus otonom eksperimen→analisis→optimasi |

GLM-5.1 mampu menjalankan tugas pengodean secara otonom selama 8 jam penuh, membentuk siklus tertutup «eksperimen→analisis→optimasi», yang sangat unggul dalam skenario seperti refaktorisasi skala besar atau migrasi lintas modul.

Meskipun Opus 4.7 telah meningkatkan kemampuan tugas panjang melalui Anggaran Tugas dan tingkat inferensi xhigh, model ini lebih berfokus pada "penyelesaian efisien sesuai anggaran" daripada "eksekusi tanpa batas waktu".

Tugas Agen (Agentic Tasks)

| Kemampuan Agen | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Dukungan Asli MCP | ✅ Optimasi mendalam | ✅ Didukung |

| Efisiensi Pemanggilan Alat | Lebih sedikit panggilan, lebih banyak inferensi | Aktif menggunakan alat |

| Keandalan Multi-langkah | Sangat tinggi | Tinggi |

| Manajemen Konteks | Konteks super panjang 1M token | 200K token |

| Manajemen Sub-agen | Kontrol presisi (dapat diatur) | Didukung |

Untuk tugas agen, jendela konteks 1M token milik Opus 4.7 adalah keunggulan mutlak. Saat menangani basis kode yang besar, Opus 4.7 dapat memuat lebih banyak konteks file sekaligus, sehingga mengurangi kehilangan informasi.

Tinjauan dan Refaktorisasi Kode

| Kemampuan Tinjauan Kode | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Presisi Instruksi | Eksekusi lebih literal, akurat tanpa terlewat | Interpretasi fleksibel |

| Kemampuan Verifikasi Mandiri | Verifikasi sebelum output (baru) | Didukung |

| Pemrosesan File Besar | Memuat seluruh basis kode dengan konteks 1M | Batas 200K mungkin perlu segmentasi |

| Tinjauan Visual | Pemahaman tangkapan layar resolusi tinggi | Visual dasar |

Pengodean Cepat dan Pengembangan Harian

| Pengodean Harian | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Kecepatan Respons | Sedang | Lebih cepat |

| Biaya API | $5/$25 per MTok | $1/$3.2 per MTok |

| Gaya Kode | Lebih ringkas, condong ke inferensi | Komentar detail, condong ke pemanggilan alat |

| Dukungan Multi-bahasa | Luar biasa | Luar biasa (komentar kode bahasa Indonesia lebih alami) |

Perbandingan Harga: Selisih Biaya 5 Kali Lipat

Harga adalah faktor yang tidak bisa diabaikan saat memilih model. Perbedaan harga keduanya sangat signifikan:

| Item Penagihan | Claude Opus 4.7 | GLM-5.1 | Selisih |

|---|---|---|---|

| Harga Input | $5 / MTok | $1 / MTok | Opus lebih mahal 5 kali |

| Harga Output | $25 / MTok | $3.2 / MTok | Opus lebih mahal 7,8 kali |

| Harga Cache | Diskon Cache standar | $0.26 / MTok | Cache GLM sangat murah |

| Premi Konteks Panjang | Tidak ada | Tidak ada | — |

Estimasi Biaya Skenario Nyata

Asumsikan tim pengembang menengah menghabiskan 500M token per bulan (setengah input + setengah output):

| Model yang Digunakan | Biaya Input Bulanan | Biaya Output Bulanan | Total Bulanan |

|---|---|---|---|

| Opus 4.7 | $1.250 | $6.250 | $7.500 |

| GLM-5.1 | $250 | $800 | $1.050 |

| Selisih | — | — | $6.450/bulan |

Biaya GLM-5.1 hanya sekitar 14% dari biaya Opus 4.7. Bagi tim yang sensitif terhadap anggaran, ini adalah perbedaan yang menentukan.

🎯 Strategi Optimasi Biaya: Melalui platform APIYI apiyi.com, Anda dapat dengan fleksibel mengatur kedua model—serahkan desain arsitektur kompleks dan tinjauan kode kepada Opus 4.7, lalu serahkan tugas pembuatan kode harian dan pemrosesan batch dalam jumlah besar kepada GLM-5.1. Antarmuka terpadu platform membuat biaya penerapan strategi multi-model menjadi sangat rendah.

Saran Pemilihan untuk Berbagai Skenario

Skenario Memilih Claude Opus 4.7

- Pemrosesan basis kode skala besar: Memerlukan pemuatan konteks puluhan file sekaligus (1M vs 200K).

- Tinjauan kode dan audit keamanan: Memerlukan akurasi yang sangat tinggi dan kemampuan verifikasi mandiri.

- Pengembangan multimodal: Perlu memahami tangkapan layar UI, draf desain, dan gambar dokumen (visual resolusi tinggi 3,75MP).

- Kebutuhan keandalan tingkat perusahaan: Memerlukan dukungan komersial tertutup yang stabil.

- Pengodean intensif penalaran kompleks: Skenario yang memerlukan penalaran mendalam seperti perhitungan matematika, desain algoritma, dll.

Skenario Memilih GLM-5.1

- Pengembangan mandiri jangka panjang: Memerlukan model untuk bekerja terus-menerus selama berjam-jam guna menyelesaikan perombakan (refactoring) besar.

- Tugas batch yang sensitif terhadap biaya: Integrasi CI/CD, pembuatan kode massal, dan pengujian otomatis.

- Penyebaran privat: Perlu menjalankan model di server sendiri (lisensi MIT, terbuka sepenuhnya).

- Lingkungan pengembangan bahasa Mandarin: Pembuatan komentar kode dan dokumentasi dalam bahasa Mandarin lebih alami dan lancar.

- Tugas kelas SWE-Bench: Menyelesaikan GitHub Issue, memperbaiki bug, dan tugas pengodean dunia nyata lainnya.

Praktik Terbaik: Strategi Model Ganda

| Jenis Tugas | Model yang Direkomendasikan | Alasan |

|---|---|---|

| Desain arsitektur & solusi teknis | Opus 4.7 | Penalaran mendalam + jendela konteks super panjang |

| Penulisan kode sehari-hari | GLM-5.1 | Biaya rendah, kualitas memadai |

| Tinjauan kode | Opus 4.7 | Akurasi + verifikasi mandiri |

| Pembuatan kode massal | GLM-5.1 | Biaya hanya 14% |

| Perbaikan bug (GitHub Issue) | GLM-5.1 | Puncak peringkat SWE-Bench Pro |

| Perombakan multi-file | Opus 4.7 | Keunggulan jendela konteks 1M |

| Tugas mandiri jangka panjang | GLM-5.1 | Eksekusi mandiri selama 8 jam |

| Pengembangan terkait UI/tangkapan layar | Opus 4.7 | Visual resolusi tinggi 3,75MP |

🎯 Saran Manajemen Terpadu: APIYI apiyi.com telah meluncurkan Claude Opus 4.7 dan GLM-5.1 secara bersamaan. Pengembang dapat memanggil kedua model melalui satu kunci API dan antarmuka yang kompatibel dengan OpenAI, serta beralih secara fleksibel sesuai jenis tugas untuk mencapai efisiensi pengodean dan keseimbangan biaya yang optimal.

Pertanyaan yang Sering Diajukan (FAQ)

Q1: Apakah GLM-5.1 benar-benar lebih kuat daripada Claude Opus?

Tergantung pada dimensi spesifiknya. Pada kategori SWE-Bench Pro, GLM-5.1 (58,4) memang melampaui Opus 4.6 (57,3), namun dalam skor komprehensif pengodean, Opus 4.6 (57,5) memimpin di atas GLM-5.1 (54,9). Sebagai peningkatan besar dari 4.6, kemampuan pengodean komprehensif Opus 4.7 diperkirakan akan semakin unggul. Secara keseluruhan, Opus 4.7 lebih kuat secara komprehensif, tetapi GLM-5.1 memiliki keunggulan unik dalam skenario tertentu (tugas jangka panjang, tugas kelas SWE-Bench).

Q2: GLM-5.1 jauh lebih murah, apakah kualitasnya cukup?

Untuk sebagian besar tugas pengodean, cukup. Performa GLM-5.1 pada SWE-Bench Pro membuktikan bahwa model ini memiliki kemampuan pengodean tingkat atas. Data evaluasi menunjukkan bahwa model ini mencapai 94,6% dari kemampuan pengodean Claude Opus 4.6, namun dengan harga hanya 1/5 hingga 1/8. Melakukan perbandingan langsung melalui APIYI apiyi.com adalah cara paling aman sebelum mengambil keputusan.

Q3: Bisakah kedua model dipanggil melalui antarmuka yang sama?

Bisa. APIYI apiyi.com menyediakan antarmuka terpadu yang kompatibel dengan OpenAI. Anda hanya perlu mengganti ID model untuk beralih antara Claude Opus 4.7 dan GLM-5.1 tanpa perlu mengubah kerangka kerja kode atau mengelola banyak kunci API.

Ringkasan

Kesimpulan utama dari perbandingan pemrograman antara Claude Opus 4.7 dan GLM-5.1:

- SWE-Bench Pro: GLM-5.1 (58,4) saat ini memimpin, namun skor Opus 4.7 belum dirilis.

- Kemampuan Coding Komprehensif: Seri Opus secara keseluruhan masih unggul, dengan peningkatan 70% pada CursorBench dan 3x lipat pada Rakuten-SWE-Bench untuk versi 4.7 yang sangat mengesankan.

- Coding Otonom Jangka Panjang: Eksekusi otonom selama 8 jam pada GLM-5.1 menjadi nilai jual yang unik.

- Jendela Konteks: Jendela konteks 1M pada Opus 4.7 adalah 5 kali lipat dari GLM-5.1, memberikan keunggulan nyata dalam menangani basis kode yang besar.

- Selisih Harga: Biaya GLM-5.1 hanya sekitar 14% dari biaya Opus 4.7.

- Keunggulan Open Source: GLM-5.1 menggunakan lisensi MIT, mendukung penyebaran privat dan kustomisasi bebas.

Strategi terbaik bukanlah memilih salah satu, melainkan mengombinasikan kedua model tersebut—gunakan Opus 4.7 untuk tugas bernilai tinggi dan GLM-5.1 untuk tugas batch frekuensi tinggi. APIYI apiyi.com telah meluncurkan kedua model tersebut, memungkinkan pengembang untuk melakukan pemanggilan model secara fleksibel melalui antarmuka terpadu guna mencapai keseimbangan optimal antara efisiensi coding dan biaya.

📚 Referensi

-

VentureBeat – Laporan Rilis Open Source GLM-5.1: Laporan mendetail tentang GLM-5.1 yang memuncaki SWE-Bench Pro.

- Tautan:

venturebeat.com/technology/ai-joins-the-8-hour-work-day-as-glm-ships-5-1-open-source-llm-beating-opus-4 - Keterangan: Laporan dari media teknologi otoritatif yang memuat data benchmark.

- Tautan:

-

MarkTechPost – Analisis Teknis GLM-5.1: Analisis teknis model agen 754B.

- Tautan:

marktechpost.com/2026/04/08/z-ai-introduces-glm-5-1 - Keterangan: Berisi detail arsitektur dan analisis kemampuan eksekusi otonom 8 jam.

- Tautan:

-

Anthropic Official – Rilis Claude Opus 4.7: Penjelasan lengkap mengenai peningkatan versi.

- Tautan:

anthropic.com/news/claude-opus-4-7 - Keterangan: Pengumuman resmi dan data benchmark untuk Opus 4.7.

- Tautan:

-

Halaman Model HuggingFace GLM-5.1: Unduhan model open source dan dokumentasi.

- Tautan:

huggingface.co/zai-org/GLM-5.1 - Keterangan: Bobot model di bawah lisensi MIT dan panduan penyebaran.

- Tautan:

-

Dokumentasi API Claude – Ikhtisar Model: Spesifikasi teknis semua model Claude.

- Tautan:

platform.claude.com/docs/en/about-claude/models/overview - Keterangan: Parameter model resmi, harga, dan perbandingan fitur.

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Mari berdiskusi di kolom komentar. Untuk informasi lebih lanjut, kunjungi pusat dokumentasi APIYI di docs.apiyi.com