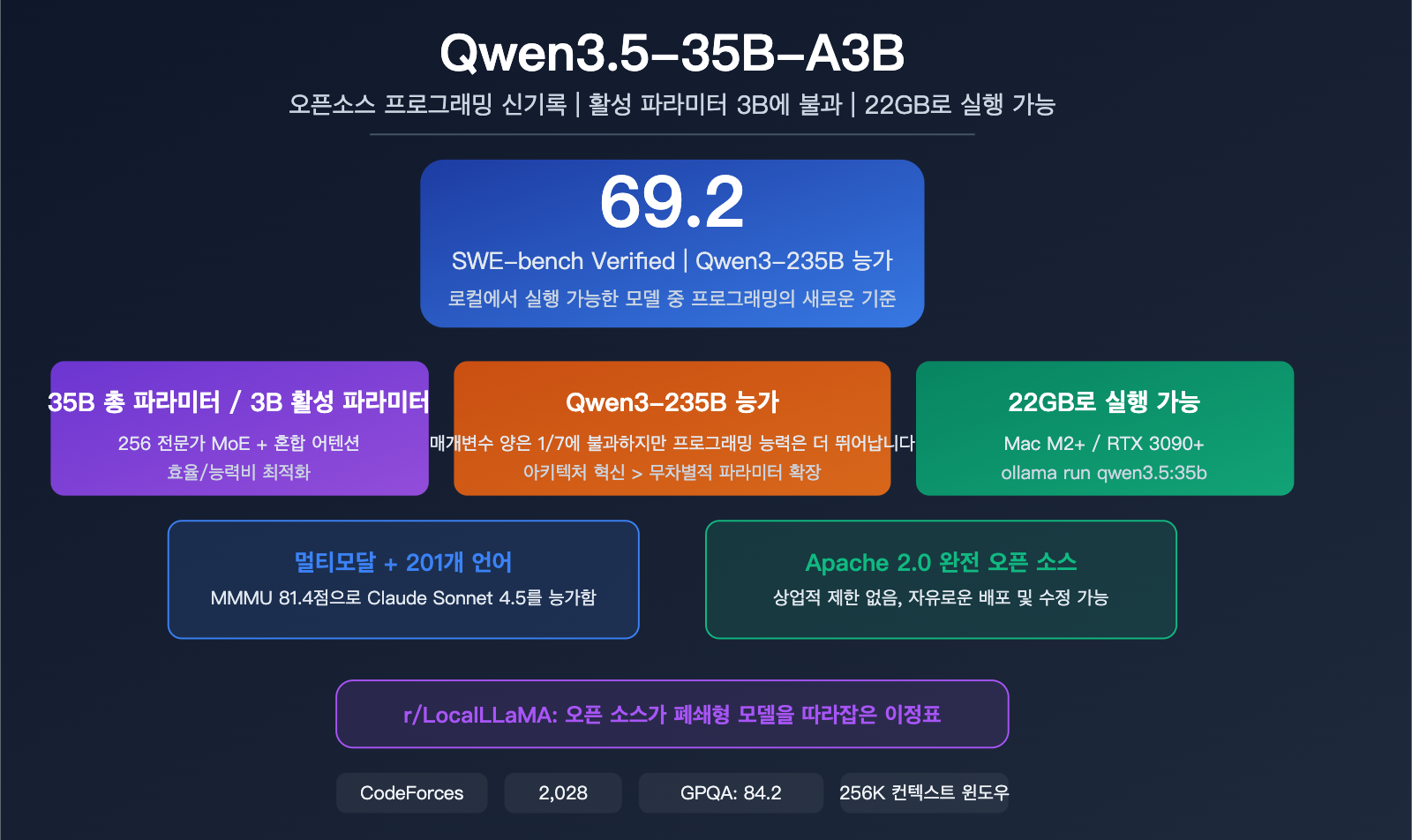

작성자 주: Qwen3.5-35B-A3B는 단 3B의 활성 파라미터만으로 SWE-bench Verified에서 69.2점을 기록하며 이전 세대인 Qwen3-235B를 넘어섰습니다. r/LocalLLaMA 커뮤니티에서는 이를 오픈소스가 폐쇄형 모델을 따라잡는 중요한 이정표로 평가하고 있습니다. 본 글에서는 이 모델의 기술적 아키텍처와 실제 가치를 심층 분석합니다.

r/LocalLLaMA 커뮤니티에서 최근 뜨거운 화제가 된 소식이 있습니다. 바로 Qwen3.5-35B-A3B가 단 3B의 활성 파라미터만으로 SWE-bench Verified에서 69.2점을 기록했다는 점입니다. 이는 이전 세대인 235B 파라미터의 Qwen3를 넘어선 수치이며, 로컬에서 구동 가능한 모델 중 프로그래밍 능력을 새롭게 정의했습니다. 커뮤니티는 이를 오픈소스 모델이 폐쇄형 모델을 추월하는 중요한 신호로 보고 있습니다. 소비자용 하드웨어에서 구동 가능한 35B 모델이 GPT-5 mini 수준의 프로그래밍 능력을 갖추게 된 것입니다.

핵심 가치: 이 글을 통해 Qwen3.5-35B가 왜 오픈소스 커뮤니티에서 큰 반향을 일으키고 있는지, MoE 아키텍처가 어떻게 '작은 몸집으로 큰 능력'을 구현했는지, 그리고 로컬 및 클라우드에서 이를 어떻게 활용할 수 있는지 알아보세요.

Qwen3.5-35B 핵심 요약

| 요점 | 설명 | 의미 |

|---|---|---|

| 총 파라미터 | 350억 (35B) | MoE 아키텍처 |

| 활성 파라미터 | 단 30억 (3B) | 극강의 효율성 |

| SWE-bench Verified | 69.2점 | Qwen3-235B 추월 |

| GPQA Diamond | 84.2점 | 대학원 수준 추론 |

| 컨텍스트 윈도우 | 기본 256K / 확장 1M+ | YaRN 확장 |

| 실행 요구사항 | 22GB 메모리/VRAM | 소비자용 하드웨어 가능 |

| 오픈소스 라이선스 | Apache 2.0 | 완전 개방 |

왜 r/LocalLLaMA 커뮤니티는 Qwen3.5-35B를 주목하는가

r/LocalLLaMA는 Reddit에서 가장 활발한 로컬 대규모 언어 모델 커뮤니티로, 멤버들은 "내 하드웨어에서 돌아가면서도 충분히 강력한 모델은 무엇인가?"라는 핵심 질문에 집중합니다.

Qwen3.5-35B-A3B는 이러한 요구사항을 완벽하게 충족합니다.

- 총 35B 파라미터이지만 추론 시 3B만 활성화되어 22GB 메모리를 가진 Mac이나 GPU에서도 원활하게 구동됩니다.

- 프로그래밍 능력(SWE-bench 69.2점)은 파라미터 수가 7배나 많은 이전 세대 Qwen3-235B를 능가합니다.

- Apache 2.0 라이선스로 완전 오픈소스화되어 상업적 제한이 없습니다.

커뮤니티의 평가는 다음과 같습니다: "Qwen 35B를 실행해 보세요. 훌륭한 챗봇이며 작업 자동화에 충분합니다." 이는 로컬 배포 사용자들이 가장 중요하게 생각하는 **'충분한 성능, 빠른 속도, 저렴한 비용'**이라는 핵심 가치를 대변합니다.

Qwen3.5-35B 아키텍처 심층 분석

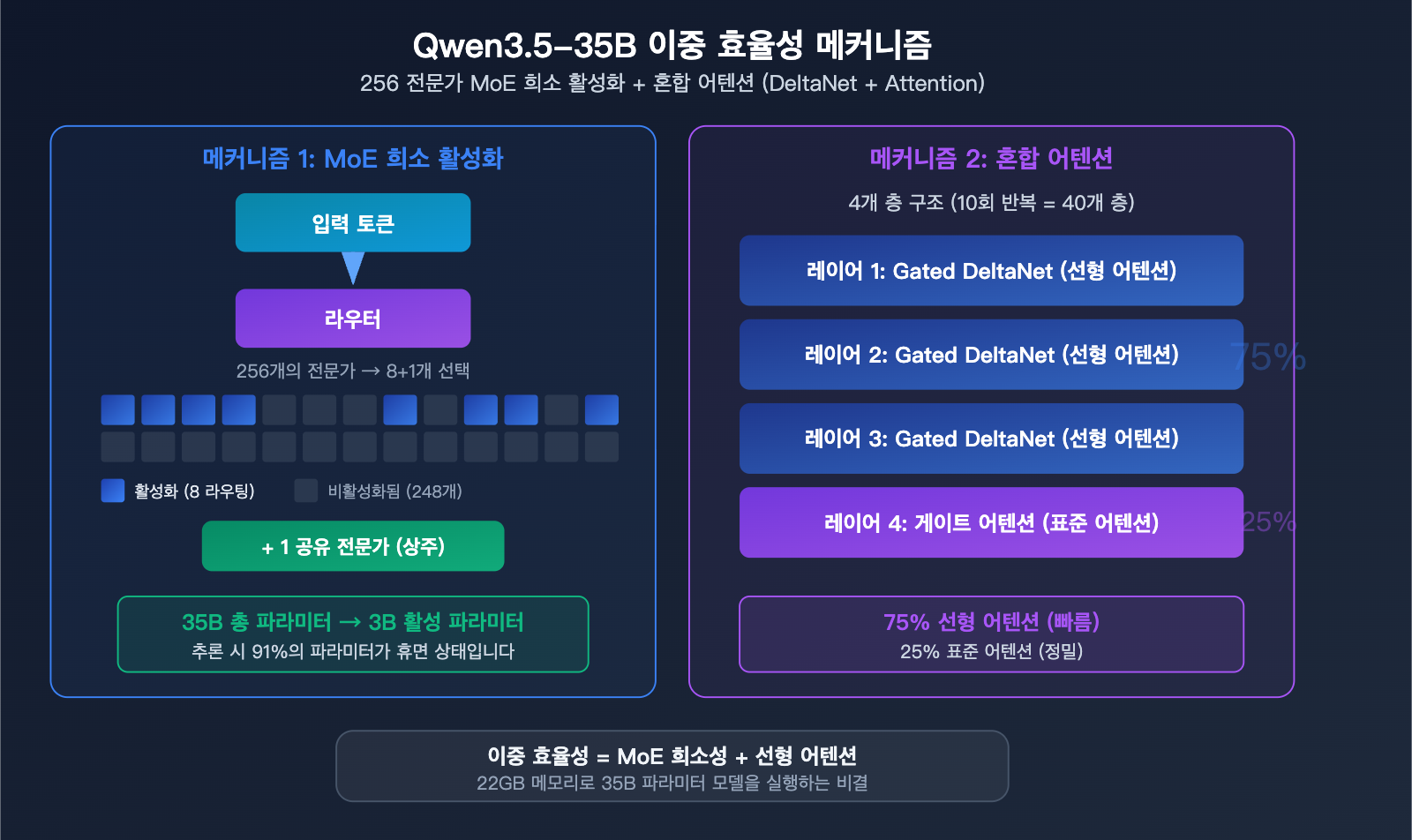

256개 전문가의 MoE 아키텍처

Qwen3.5-35B-A3B는 매우 정교한 혼합 전문가(MoE) 아키텍처를 채택했습니다.

| 아키텍처 파라미터 | 수치 | 설명 |

|---|---|---|

| 총 파라미터 | 35B | 전체 전문가 파라미터의 합 |

| 활성 파라미터 | 3B | 매 추론 시 활성화 |

| 전문가 총수 | 256개 | 초미세 입도 분업 |

| 활성 전문가 | 8 라우팅 + 1 공유 | 매번 9개 전문가 선택 |

| 레이어 수 | 40층 | 딥 네트워크 |

| 히든 차원 | 2048 | 컴팩트한 설계 |

혼합 어텐션 메커니즘

Qwen3.5-35B는 순수 Transformer가 아닌 혼합 어텐션 설계를 채택했습니다.

매 4층마다 다음과 같은 구조를 가집니다: 3층 Gated DeltaNet(선형 어텐션) + 1층 Gated Attention(표준 어텐션)

| 어텐션 유형 | 레이어 비중 | 특징 |

|---|---|---|

| Gated DeltaNet | 75% | 선형 어텐션, 빠른 추론 |

| Gated Attention | 25% | 표준 어텐션, 높은 정밀도 |

이러한 혼합 설계의 묘미는 대부분의 연산을 효율적인 선형 어텐션으로 처리하고, 핵심 레이어에서만 계산량이 많은 표준 어텐션을 사용한다는 점입니다. 이것이 바로 35B 파라미터임에도 22GB 메모리만 필요한 비결입니다. 전문가의 희소 활성화뿐만 아니라 어텐션 메커니즘 자체도 최적화된 것이죠.

🎯 기술 인사이트: Qwen3.5-35B의 아키텍처 설계는 2026년 MoE 모델의 최신 트렌드인 '256 전문가 초미세 입도 + 혼합 어텐션'을 대표합니다. 이러한 아키텍처가 제공하는 효율성을 직접 경험하고 싶다면, 로컬 배포 없이 APIYI(apiyi.com)를 통해 Qwen3.5 시리즈 API를 바로 호출해 보세요.

Qwen3.5-35B 평가 데이터 심층 분석

Qwen3.5-35B 프로그래밍 평가

| 평가 기준 | Qwen3.5 35B-A3B | 비교 참조 | 설명 |

|---|---|---|---|

| SWE-bench Verified | 69.2 | Qwen3-235B: <69 | 7배 규모의 이전 세대 능가 |

| LiveCodeBench v6 | 74.6 | – | 실시간 프로그래밍 성능 우수 |

| CodeForces | 2,028 | – | 대회 수준의 실력 |

Qwen3.5-35B 추론 및 지식 평가

| 평가 기준 | Qwen3.5 35B-A3B | 설명 |

|---|---|---|

| GPQA Diamond | 84.2 | 대학원 수준의 과학적 추론 |

| MMLU-Pro | 85.3 | 다학제적 지식 |

| MMLU-Redux | 93.3 | 지식 이해도 |

| HMMT Feb 2025 | 89.0 | 수학 경시대회 |

| IFEval | 91.9 | 지시 이행 능력 |

Qwen3.5-35B 멀티모달 평가

| 평가 기준 | Qwen3.5 35B-A3B | 설명 |

|---|---|---|

| MMMU | 81.4 | 멀티모달 이해 (Claude Sonnet 4.5의 79.6에 근접) |

| MMMU-Pro | 75.1 | 고난도 멀티모달 |

| MathVision | 83.9 | 시각적 수학 추론 |

| VideoMME | 86.6 | 영상 이해 |

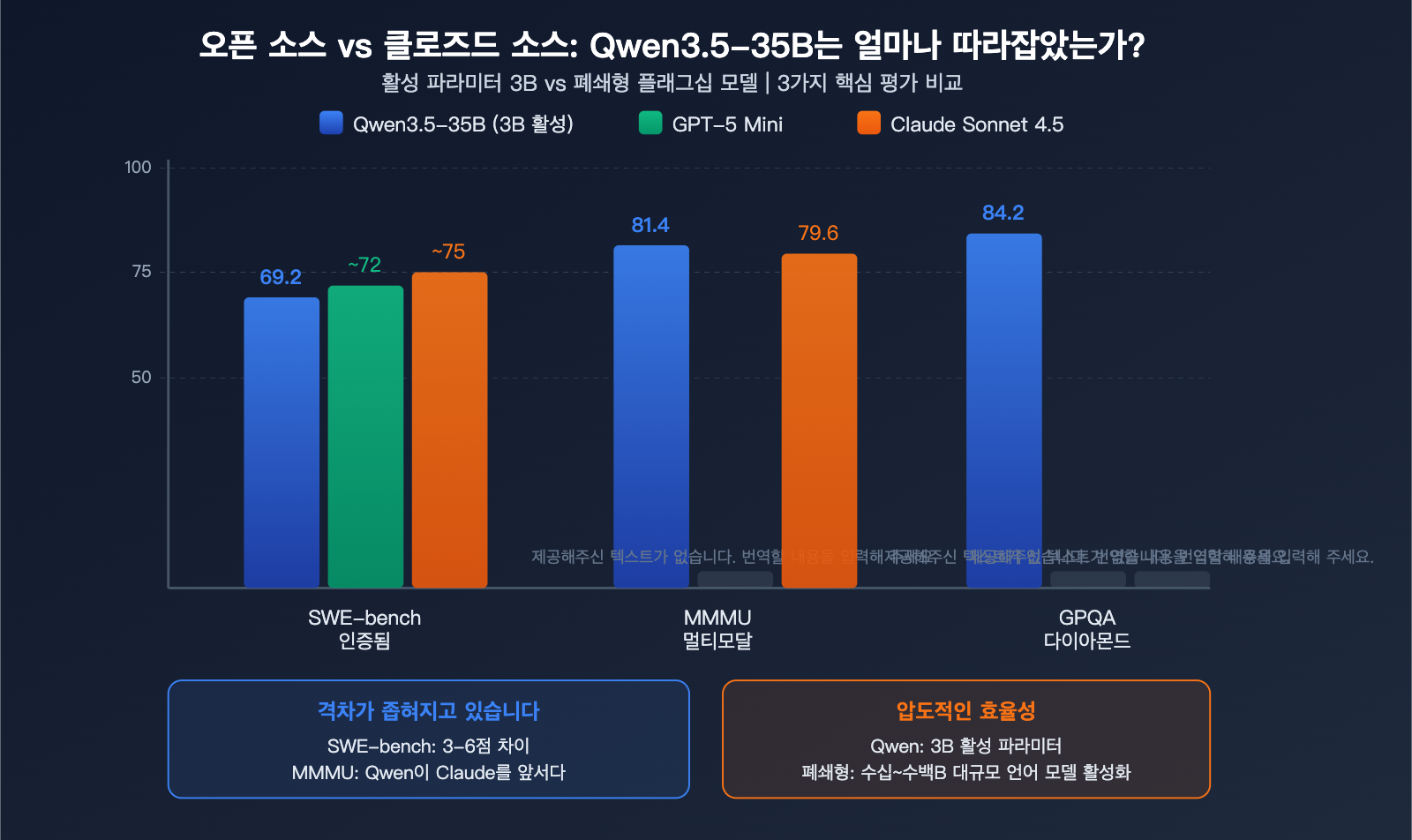

Qwen3.5-35B와 폐쇄형 모델 비교

커뮤니티에서 가장 궁금해하는 점이죠. 35B 오픈소스 모델이 과연 폐쇄형 모델을 얼마나 따라잡았을까요?

| 항목 | Qwen3.5 35B | GPT-5 Mini | Claude Sonnet 4.5 | 격차 |

|---|---|---|---|---|

| SWE-bench | 69.2 | ~72 | ~75 | 3-6점 차이 |

| MMMU | 81.4 | – | 79.6 | 역전 |

| GPQA Diamond | 84.2 | – | – | 최상위권 |

| 활성 파라미터 | 3B | ~수십B | 미공개 | 효율성 압도 |

| 로컬 실행 가능 | 예 (22GB) | 아니오 | 아니오 | 독보적 강점 |

커뮤니티의 핵심 의견: Qwen3.5-35B는 프로그래밍 분야에서 GPT-5 Mini급 모델과의 격차를 3-6점까지 좁혔으며, 멀티모달 분야에서는 Claude Sonnet 4.5를 추월했습니다. 단 3B의 활성 파라미터로 로컬 실행이 가능하다는 점을 고려하면, 공개된 모델 중 효율성 대비 성능비가 가장 뛰어난 모델일 것입니다.

💡 실용적인 팁: Qwen3.5-35B와 폐쇄형 모델 간의 실제 성능 차이를 직접 확인하고 싶다면, APIYI(apiyi.com)를 통해 Qwen3.5, Claude, GPT를 동시에 호출하여 본인의 작업 환경에서 A/B 테스트를 진행해 보세요.

Qwen3.5-35B 로컬 배포 가이드

하드웨어 요구사항 및 배포 방식

| 배포 방식 | 하드웨어 요구사항 | 권장 시나리오 |

|---|---|---|

| Ollama | 22GB+ RAM/VRAM | 가장 간편함, 원클릭 실행 |

| vLLM | GPU + 24GB+ VRAM | 프로덕션급 처리량 |

| SGLang | GPU + 24GB+ VRAM | 고성능 처리량 권장 |

| KTransformers | CPU + GPU 혼합 | 저사양 하드웨어 |

| LM Studio | 22GB+ RAM | 직관적인 GUI 제공 |

Ollama 원클릭 배포

# 설치 후 명령어 한 줄로 바로 실행 가능합니다

ollama run qwen3.5:35b

API 호출을 통한 사용 (로컬 배포 불필요)

로컬 배포가 번거롭다면 API를 통해 호출하는 것이 가장 간단한 방법입니다:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="qwen3.5-35b-a3b",

messages=[{

"role": "user",

"content": "이 파이썬 코드를 검토해서 성능 병목 구간을 찾아줘"

}],

temperature=0.6, # 프로그래밍 작업 시 0.6 권장

max_tokens=32768

)

print(response.choices[0].message.content)

Thinking 모드와 일반 모드 전환 방법

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Thinking 모드 (심층 추론, 복잡한 작업에 적합)

response_thinking = client.chat.completions.create(

model="qwen3.5-35b-a3b",

messages=[{"role": "user", "content": "이 알고리즘의 시간 복잡도를 분석해줘"}],

temperature=1.0,

top_p=0.95,

max_tokens=32768

)

# 일반 모드 (빠른 답변)

response_fast = client.chat.completions.create(

model="qwen3.5-35b-a3b",

messages=[{"role": "user", "content": "퀵 정렬 함수를 작성해줘"}],

temperature=0.7,

top_p=0.8,

max_tokens=32768,

extra_body={"chat_template_kwargs": {"enable_thinking": False}}

)

🚀 배포 제안: 로컬 배포는 데이터 프라이버시가 중요하거나 오프라인 환경에서 작업할 때 적합합니다. 일상적인 개발 작업에는 APIYI(apiyi.com)를 통한 API 호출을 추천합니다. 속도가 더 빠르고 하드웨어 유지보수가 필요 없으며, Qwen3.5와 Claude, GPT 사이를 자유롭게 전환할 수 있습니다.

Qwen3.5 전체 모델 라인업 한눈에 보기

Qwen3.5 시리즈 사양 비교

| 모델 | 총 파라미터 | 활성 파라미터 | SWE-bench | 최소 메모리 | 포지션 |

|---|---|---|---|---|---|

| Qwen3.5-4B | 4B | 4B (Dense) | – | 8GB | 경량 입문용 |

| Qwen3.5-9B | 9B | 9B (Dense) | – | 12GB | 효율적인 일상용 |

| Qwen3.5-27B | 27B | 27B (Dense) | 72.4 | 22GB | 고밀도 정밀형 |

| Qwen3.5-35B-A3B | 35B | 3B (MoE) | 69.2 | 22GB | 효율성 끝판왕 |

| Qwen3.5-122B-A10B | 122B | 10B (MoE) | – | – | 중고급형 |

| Qwen3.5-397B-A17B | 397B | 17B (MoE) | 76.4 | – | 플래그십 |

모델 선택 가이드:

- 22GB 장비 사용자: 35B-A3B(MoE, 빠르지만 정밀도는 약간 낮음) 또는 27B(Dense, 약간 느리지만 더 정밀함)를 추천합니다.

- 최고의 가성비 추구: 35B-A3B를 선택하세요. 추론 시 3B 파라미터만 사용하여 매우 효율적입니다.

- 최고의 정밀도 추구: MoE를 사용하지 않는 27B Dense 모델을 추천합니다.

🎯 API 선택: APIYI(apiyi.com)를 통해 4B부터 397B까지 Qwen3.5 전 시리즈를 필요에 따라 선택할 수 있습니다. 하나의 API 키로 다양한 규모의 Qwen 모델은 물론, Claude나 GPT 같은 폐쇄형 모델까지 유연하게 전환하며 사용하세요.

자주 묻는 질문 (FAQ)

Q1: Qwen3.5-35B와 27B 중 무엇을 선택해야 하나요?

두 모델 모두 약 22GB의 메모리가 필요합니다. 35B-A3B는 MoE 아키텍처(3~5배 빠르지만 정확도는 약간 낮음)이고, 27B는 Dense 아키텍처(더 정확하지만 느림)입니다. 프로그래밍 작업에서는 큰 차이가 없으며(SWE-bench 69.2 vs 72.4), 일상적인 대화에는 35B(속도 중심)를, 정밀한 작업에는 27B(정확도 중심)를 추천합니다. APIYI(apiyi.com)를 통해 두 모델을 동시에 호출하여 비교해 보세요.

Q2: 오픈소스 모델이 정말 폐쇄형 모델을 따라잡고 있나요?

네, 하지만 조건이 있습니다. Qwen3.5-35B는 MMMU 벤치마크에서 Claude Sonnet 4.5를 앞섰고(81.4 vs 79.6), SWE-bench에서도 GPT-5 Mini와 불과 3점 차이밖에 나지 않습니다. 하지만 가장 난이도가 높은 프로그래밍 작업이나 복잡한 추론 영역에서는 여전히 폐쇄형 플래그십 모델(Claude Opus 4.5, GPT-5.4)이 확실한 우위를 점하고 있습니다. 오픈소스가 격차를 좁히고는 있지만, 아직 최상위 폐쇄형 모델을 완전히 따라잡은 것은 아닙니다.

Q3: 22GB Mac에서 Qwen3.5-35B를 실행할 수 있나요?

네, 가능합니다. Qwen3.5-35B-A3B는 추론 시 3B 파라미터만 활성화하므로, 22GB 통합 메모리를 갖춘 Mac(M2/M3/M4 기본 구성 등)에서 원활하게 실행됩니다. Ollama(ollama run qwen3.5:35b)를 사용하여 간편하게 시작하는 것을 추천합니다. 로컬 배포가 번거롭다면 APIYI(apiyi.com)를 통해 클라우드에서 호출하는 것이 훨씬 편리합니다.

요약

Qwen3.5-35B가 오픈소스 프로그래밍 분야에서 새로운 기록을 세운 5가지 핵심 포인트:

- 효율성 혁명: 총 파라미터 35B 중 3B만 활성화되어 22GB 메모리로 실행 가능하며, 이전 세대 235B 모델을 능가하는 프로그래밍 성능을 보여줍니다.

- 프로그래밍 실력: SWE-bench 69.2, CodeForces 2028, LiveCodeBench 74.6을 기록하며 로컬 모델의 새로운 기준을 제시했습니다.

- 아키텍처 혁신: 256 전문가 MoE + 하이브리드 어텐션(DeltaNet + 표준 Attention)을 결합하여 효율성과 성능의 최적 균형을 달성했습니다.

- 오픈소스의 추격: MMMU에서 Claude Sonnet 4.5를 추월하고 SWE-bench에서 GPT-5 Mini에 근접하는 등 격차를 빠르게 좁히고 있습니다.

- 완전 개방: Apache 2.0 라이선스로 상업적 제한 없이 로컬 배포 비용 0원으로 이용할 수 있습니다.

Qwen3.5-35B는 한 가지 사실을 증명했습니다. 오픈소스 모델은 더 이상 폐쇄형 모델의 하위 호환이 아니라, 훨씬 높은 효율성으로 그들을 추격하고 심지어 앞서나가고 있다는 점입니다. APIYI(apiyi.com)를 통해 Qwen3.5 시리즈와 폐쇄형 모델을 동시에 연동해 보세요. 하나의 API 키로 실제 작업에서 오픈소스와 폐쇄형 모델 간의 성능 차이를 직접 비교해 볼 수 있습니다.

📚 참고 자료

-

Qwen3.5-35B-A3B 모델 카드 – Hugging Face: 전체 기술 사양 및 평가 데이터

- 링크:

huggingface.co/Qwen/Qwen3.5-35B-A3B - 설명: 아키텍처 세부 정보, 평가 점수 및 추론 파라미터 권장 사항 포함

- 링크:

-

Qwen3.5 GitHub 저장소: 오픈 소스 코드 및 배포 가이드

- 링크:

github.com/QwenLM/Qwen3.5 - 설명: 전체 모델 가중치 다운로드 및 배포 문서 포함

- 링크:

-

Qwen3.5 완벽 가이드: 전체 시리즈 평가 및 아키텍처 분석

- 링크:

techie007.substack.com/p/qwen-35-the-complete-guide-benchmarks - 설명: 전체 모델 패밀리 비교 및 폐쇄형 모델과의 벤치마크 비교

- 링크:

-

Ollama – Qwen3.5:35B: 로컬 원클릭 배포

- 링크:

ollama.com/library/qwen3.5:35b - 설명: 가장 간편한 로컬 실행 방법

- 링크:

작성자: APIYI 기술 팀

기술 교류: 댓글을 통해 여러분의 Qwen3.5 로컬 배포 경험을 공유해 주세요. 더 많은 AI 모델 연동 자료는 APIYI docs.apiyi.com 문서 센터에서 확인하실 수 있습니다.