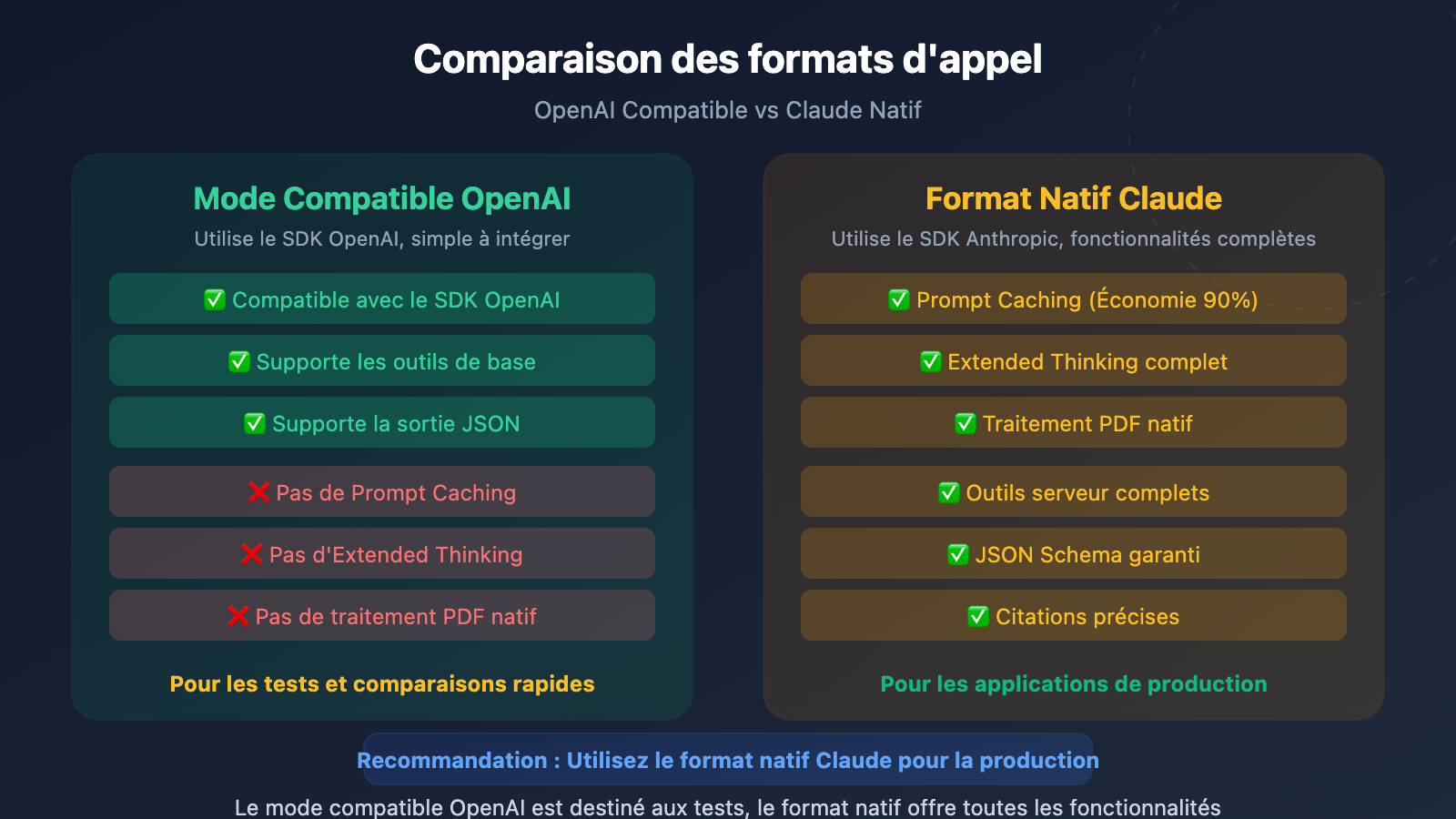

Note de l'auteur : Comparaison détaillée des 7 différences clés entre le mode compatible OpenAI et le format natif de l'API Claude, incluant le support de fonctionnalités comme le Prompt Caching, l'Extended Thinking et l'appel d'outils, pour vous aider à choisir la méthode d'intégration la plus adaptée.

Appeler un modèle Claude avec le SDK OpenAI ne nécessite que de changer une ligne base_url, ce qui semble très pratique — mais vous pourriez ainsi perdre 90% d'économies grâce au Prompt Caching, ne pas pouvoir obtenir le processus de raisonnement Extended Thinking, et perdre la capacité de traitement natif des PDF. Cet article compare ces deux méthodes d'intégration sur 7 points clés pour vous aider à faire le bon choix.

Valeur clé : Après avoir lu cet article, vous saurez clairement, pour votre cas d'utilisation, s'il faut choisir le mode compatible OpenAI ou le format natif Claude, évitant ainsi de dépenser plus ou de perdre des fonctionnalités à cause d'un mauvais choix de format. Le point essentiel est que si vous utilisez un modèle Claude, privilégiez l'appel avec son format natif, plutôt que le mode compatible OpenAI.

Différences fondamentales entre le mode compatible OpenAI et le format natif Claude

| Dimension de différence | Mode compatible OpenAI | Format natif Claude | Impact |

|---|---|---|---|

| Prompt Caching | ✗ Non supporté | ✓ Supporté (économise 90% des coûts) | ⭐⭐⭐⭐⭐ Très élevé |

| Extended Thinking | ✗ Ne retourne pas le raisonnement | ✓ Retourne la chaîne de pensée complète | ⭐⭐⭐⭐⭐ Très élevé |

| Traitement de l'invite système | Plusieurs fusionnées en une | Champ de niveau supérieur indépendant | ⭐⭐⭐ Moyen |

| Appel d'outils | Support de base | Support complet + outils serveur | ⭐⭐⭐⭐ Élevé |

| Traitement PDF | ✗ Non supporté | ✓ Type document natif | ⭐⭐⭐⭐ Élevé |

| Sortie structurée | ✗ strict ignoré | ✓ Garantie JSON Schema | ⭐⭐⭐⭐ Élevé |

| Citations | ✗ Non supporté | ✓ Localisation précise des références | ⭐⭐⭐ Moyen |

Différence essentielle entre le mode compatible OpenAI et le format natif Claude

En termes simples, le mode compatible OpenAI est une couche de traduction — il traduit les requêtes au format OpenAI dans un format compréhensible par Claude, puis retraduit la réponse de Claude au format OpenAI. Ce processus de traduction est imparfait : les multiples types de blocs de contenu supportés par l'API native Claude (thinking, text, tool_use, citations) sont aplatis en une seule chaîne content lors de la retraduction au format OpenAI.

Anthropic indique clairement que le point de terminaison compatible OpenAI est principalement destiné au "test et à la comparaison des capacités des modèles", et n'est pas une solution prête pour la production ou à long terme.

Comparaison de la structure des requêtes entre le mode compatible OpenAI et le format natif Claude

La différence la plus évidente au niveau du code entre les deux formats est la position de l'invite système et la structure de la réponse :

# ====== Mode compatible OpenAI ======

from openai import OpenAI

client = OpenAI(

api_key="votre-clé-api",

base_url="https://vip.apiyi.com/v1" # Accès via APIYI

)

# L'invite système est placée dans le tableau messages

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Vous êtes un expert technique"},

{"role": "user", "content": "Expliquez Tokenizer"}

]

)

# La réponse est une chaîne content unique

print(response.choices[0].message.content)

Voir le code de requête au format natif Claude

# ====== Format natif de l'API Claude ======

import anthropic

client = anthropic.Anthropic(

api_key="votre-clé-api",

base_url="https://vip.apiyi.com" # Accès via APIYI

)

# L'invite système est un champ de niveau supérieur indépendant

response = client.messages.create(

model="claude-sonnet-4-6",

system="Vous êtes un expert technique", # Champ indépendant, pas dans messages

messages=[

{"role": "user", "content": "Expliquez Tokenizer"}

],

max_tokens=1024

)

# La réponse est un tableau de blocs de contenu multiples

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"Processus de réflexion : {block.thinking}")

🎯 Recommandation d'intégration : APIYI apiyi.com supporte à la fois le format compatible OpenAI et le format natif Claude. Si vous utilisez actuellement le SDK OpenAI et n'avez besoin que des fonctionnalités de dialogue de base, le mode compatible permet une prise en main rapide ; si vous avez besoin du Prompt Caching ou de l'Extended Thinking, il est recommandé de passer au format natif.

Différence 1 : Prompt Caching (impact le plus important sur les coûts)

C'est la différence la plus significative entre les deux formats. Le Prompt Caching de Claude peut réduire le coût des entrées répétitives de 90 %, mais le mode compatible OpenAI ne prend pas du tout en charge cette fonctionnalité.

| Détails du Prompt Caching | Format natif Claude | Mode compatible OpenAI |

|---|---|---|

| Marqueur de contrôle du cache | Paramètre cache_control |

✗ Non supporté |

| Cache 5 min (écriture 1.25x) | ✓ | ✗ |

| Cache 1 heure (écriture 2x) | ✓ | ✗ |

| Lecture sur accès au cache (0.1x) | ✓ Économie de 90% | ✗ |

| Statistiques d'utilisation du cache | ✓ Retourne des données détaillées | ✗ Les champs sont toujours vides |

| Seuil minimal de cache | Opus : 4 096 / Sonnet 4.6 : 2 048 | — |

Quelle est la différence de coût réelle ? Prenons l'exemple d'un flux de travail Agent typique : chaque tour de conversation contient environ 10 000 tokens d'invite système et de définitions d'outils. Sur 10 tours de conversation :

- Sans cache (mode compatible OpenAI) : 10 tours × 10 000 tokens = 100 000 tokens d'entrée facturés au prix plein

- Avec cache (format natif Claude) : Premier tour au prix plein + 9 tours d'accès au cache (0.1x) = 10 000 + 9 000 = 19 000 tokens équivalents

Réduction des coûts d'environ 81 %. Plus le nombre de tours de conversation est élevé, plus l'avantage économique du Prompt Caching est significatif.

Différence 2 : Extended Thinking (capacité de raisonnement)

Le Extended Thinking de Claude permet au modèle de raisonner en profondeur avant de répondre. Bien qu'il puisse être activé dans le mode compatible OpenAI via extra_body, le processus de raisonnement ne vous est pas retourné – vous ne voyez que la réponse finale.

# Mode compatible OpenAI – Peut déclencher la réflexion, mais le processus n'est pas visible

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "Comment résoudre ce problème de mathématiques ?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content ne contient que la réponse finale

# Le processus de réflexion est consommé mais non retourné ❌

Dans le format natif Claude, vous pouvez obtenir le bloc de contenu thinking complet, ce qui est crucial pour le débogage, l'audit et les scénarios de raisonnement complexe.

Différence 3 : Format d'appel d'outils

Les deux formats prennent en charge l'appel d'outils, mais il existe quelques différences clés :

| Différences d'appel d'outils | Mode compatible OpenAI | Format natif Claude |

|---|---|---|

| Structure de définition d'outil | function.parameters |

input_schema |

| Outils côté serveur (recherche/exécution de code) | ✗ Non supporté | ✓ web_search / code_execution |

Mode strict (garantie de sortie) |

✗ Ignoré | ✓ Garantie JSON Schema |

| Cache des outils | ✗ Non supporté | ✓ cache_control |

| Appels d'outils parallèles | ✓ Supporté | ✓ Supporté |

Différences 4-7 : Autres distinctions importantes

Différence 4 : Traitement des documents PDF. L'API native Claude prend en charge les blocs de contenu de type: "document", permettant de traiter directement les fichiers PDF et d'en extraire le contenu structuré. Dans le mode compatible OpenAI, le contenu de type file est simplement ignoré.

Différence 5 : Sortie structurée. Dans le mode compatible OpenAI, les paramètres response_format et strict sont ignorés, il n'y a donc aucune garantie que la sortie respecte strictement le JSON Schema. Le format natif Claude prend en charge la garantie de schéma via output_config.format.

Différence 6 : Citations. Le format natif Claude peut retourner un positionnement précis des citations (index du document, position des caractères), ce qui est adapté à la traçabilité des sources dans les scénarios RAG. Le mode compatible OpenAI n'a pas de champ correspondant.

Différence 7 : Paramètres ignorés. Les paramètres OpenAI suivants sont silencieusement ignorés lors de l'appel à Claude : frequency_penalty, presence_penalty, seed, logprobs, logit_bias, n (doit être 1). Une température supérieure à 1 est automatiquement tronquée à 1.

🎯 Rappel important : Si votre code dépend de

frequency_penaltyoupresence_penaltypour contrôler le style de sortie, notez que ces paramètres ne sont pas actifs lors du passage à Claude. Il est recommandé d'ajuster l'invite système pour obtenir un effet similaire. Lors de la connexion via APIYI apiyi.com, la plateforme gère ces détails de compatibilité.

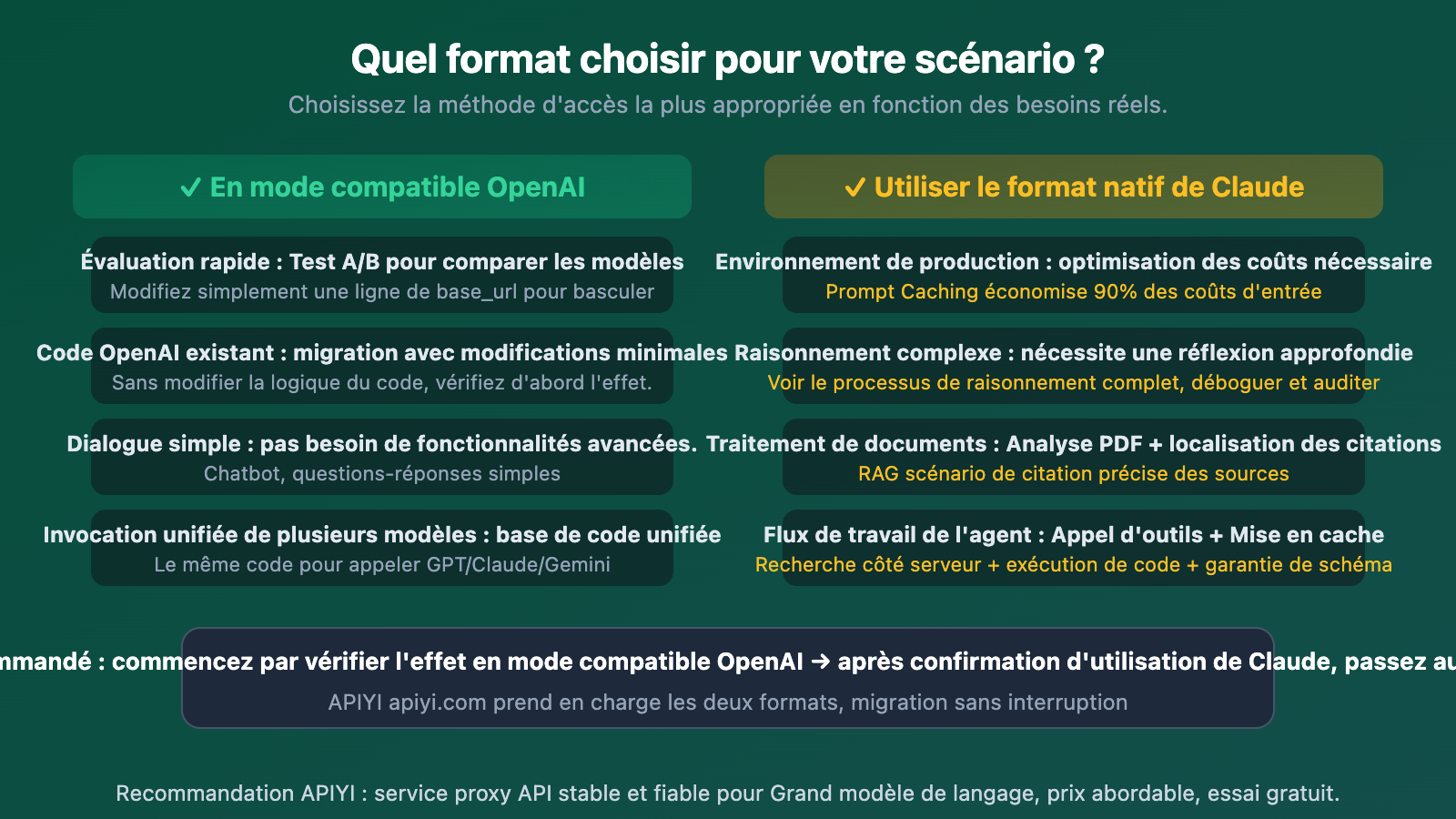

Mode compatible OpenAI vs Format natif Claude : Choix du scénario

| Scénario d'utilisation | Format recommandé | Raison principale |

|---|---|---|

| Évaluation rapide / Test A-B | Compatible OpenAI | Changer le base_url suffit, aucune modification de code |

| Migration d'un projet OpenAI existant | D'abord Compatible OpenAI → Puis Natif | Valider l'efficacité d'abord, puis migrer progressivement |

| Conversations longues en production | Natif Claude | Prompt Caching économise 80%+ des coûts |

| Agent / Appels d'outils intensifs | Natif Claude | Outils côté serveur + Cache + Garantie du schéma |

| Scénarios PDF / RAG | Natif Claude | Traitement natif des documents + Citations |

| Code unifié multi-modèles | Compatible OpenAI | Un seul code pour appeler GPT/Claude/Gemini |

🎯 Conseil de migration : Passer du mode compatible OpenAI au format natif Claude implique principalement : (1) extraire le message

systemdu tableaumessagesvers un champ de niveau supérieur ; (2) remplacerparametersdans la définition des outils parinput_schema; (3) gérer la structure multi-blocs du contenu dans la réponse. Utiliser APIYI apiyi.com pour l'intégration peut simplifier ce processus.

Questions fréquentes

Q1 : Utiliser le mode compatible OpenAI pour appeler Claude réduit-il les fonctionnalités par rapport à l’appel de GPT ?

Oui, un peu. Lors de l'appel de Claude en mode compatible OpenAI, des paramètres comme frequency_penalty, presence_penalty, seed, logprobs, response_format sont silencieusement ignorés. Ils sont actifs lors de l'appel de GPT. Si votre code dépend de ces paramètres, soyez vigilant lors du passage de GPT à Claude. Cependant, les fonctionnalités principales comme la conversation, la sortie en streaming et les appels d'outils basiques fonctionnent parfaitement.

Q2 : Peut-on mélanger le format natif Claude et le format OpenAI ?

Oui. APIYI apiyi.com prend en charge les deux formats simultanément. Vous pouvez, dans un même projet, utiliser le format compatible OpenAI pour les dialogues simples (gain de temps de développement) et le format natif Claude pour les flux de travail d'agent nécessitant du Prompt Caching (économie de coûts en tokens). Les deux formats utilisent la même clé API.

Q3 : Passer du mode compatible OpenAI au format natif Claude est-il difficile ?

Les modifications sont limitées, principalement 3 points :

- Remplacer le SDK

openaiparanthropic(ou utiliser directement des requêtes HTTP) - Extraire l'invite système du tableau

messagesvers un champsystemindépendant - Traiter la réponse en parcourant le tableau

contentau lieu dechoices[0].message.content

Si vous passez par APIYI apiyi.com, la plateforme fournit une documentation unifiée et des exemples de code pour les deux formats, rendant la migration plus fluide.

Résumé

Les critères essentiels pour choisir entre le mode compatible OpenAI et le format natif Claude :

- Le Prompt Caching est la plus grande différence : Dans les environnements de production avec des conversations longues ou des scénarios d'Agent, l'utilisation du format natif Claude peut réduire les coûts en tokens d'entrée de 80 à 90 %. Cet écart est bien plus significatif que les autres différences fonctionnelles.

- Le mode compatible OpenAI est idéal pour une validation rapide : Si vous testez simplement les performances de Claude ou effectuez des comparaisons A/B, il suffit de modifier une ligne (

base_url) sans avoir à réécrire votre code. - Le format natif est recommandé pour la production : Des fonctionnalités comme Extended Thinking, le traitement de PDF, les Citations ou les sorties structurées ne sont disponibles qu'avec le format natif.

Choisir le bon mode de connexion permet à la fois d'exploiter toutes les capacités de Claude et de maximiser l'efficacité des coûts.

Nous recommandons de vous connecter via APIYI (apiyi.com). La plateforme prend en charge à la fois le format compatible OpenAI et le format natif Claude. Une seule clé suffit pour basculer facilement entre les deux, vous permettant de répondre aux besoins de différents scénarios.

📚 Références

-

Documentation de compatibilité Anthropic OpenAI SDK : Liste complète des paramètres officiellement pris en charge et non pris en charge.

- Lien :

platform.claude.com/docs/en/api/openai-sdk - Description : Contient des explications détaillées sur tous les paramètres ignorés et les champs de réponse.

- Lien :

-

Documentation Claude Prompt Caching : Mécanisme de mise en cache des invites et règles de facturation.

- Lien :

platform.claude.com/docs/en/build-with-claude/prompt-caching - Description : Tarification et seuils minimums pour les deux niveaux de cache (5 minutes et 1 heure).

- Lien :

-

Référence de l'API Claude Messages : Format complet des requêtes et réponses pour l'API native Claude.

- Lien :

platform.claude.com/docs/en/api/messages - Description : Spécifications détaillées des blocs de contenu, de l'appel d'outils et du format de sortie en flux.

- Lien :

-

Documentation Claude Extended Thinking : Méthode d'utilisation de la fonctionnalité de pensée étendue.

- Lien :

platform.claude.com/docs/en/build-with-claude/extended-thinking - Description : Comment activer et obtenir la sortie complète du processus de raisonnement.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : Bienvenue dans les commentaires pour discuter. Plus de ressources sont disponibles dans le centre de documentation APIYI : docs.apiyi.com