Note de l'auteur : Analyse approfondie du mécanisme de facturation du cache de l'API Claude, comparaison des différences de coût entre l'écriture en cache de 5 minutes et d'1 heure, réponse à la question de la correspondance du cache entre comptes, et comparaison des différences de facturation du cache entre AWS Bedrock et l'API officielle d'Anthropic.

Le Prompt Caching de l'API Claude est un moyen essentiel pour réduire les coûts d'appel de l'API, mais de nombreux développeurs ont des doutes sur les détails de la facturation du cache : Comment choisir entre le cache de 5 minutes et celui d'1 heure ? Le cache peut-il être partagé entre différents comptes ? En quoi la facturation du cache d'AWS Bedrock diffère-t-elle de celle de l'API officielle ?

Valeur clé : Après avoir lu cet article, vous comprendrez parfaitement les 3 mécanismes principaux de la facturation du cache de l'API Claude, maîtriserez la méthode pour choisir la stratégie de cache optimale et éviterez les dépenses inutiles.

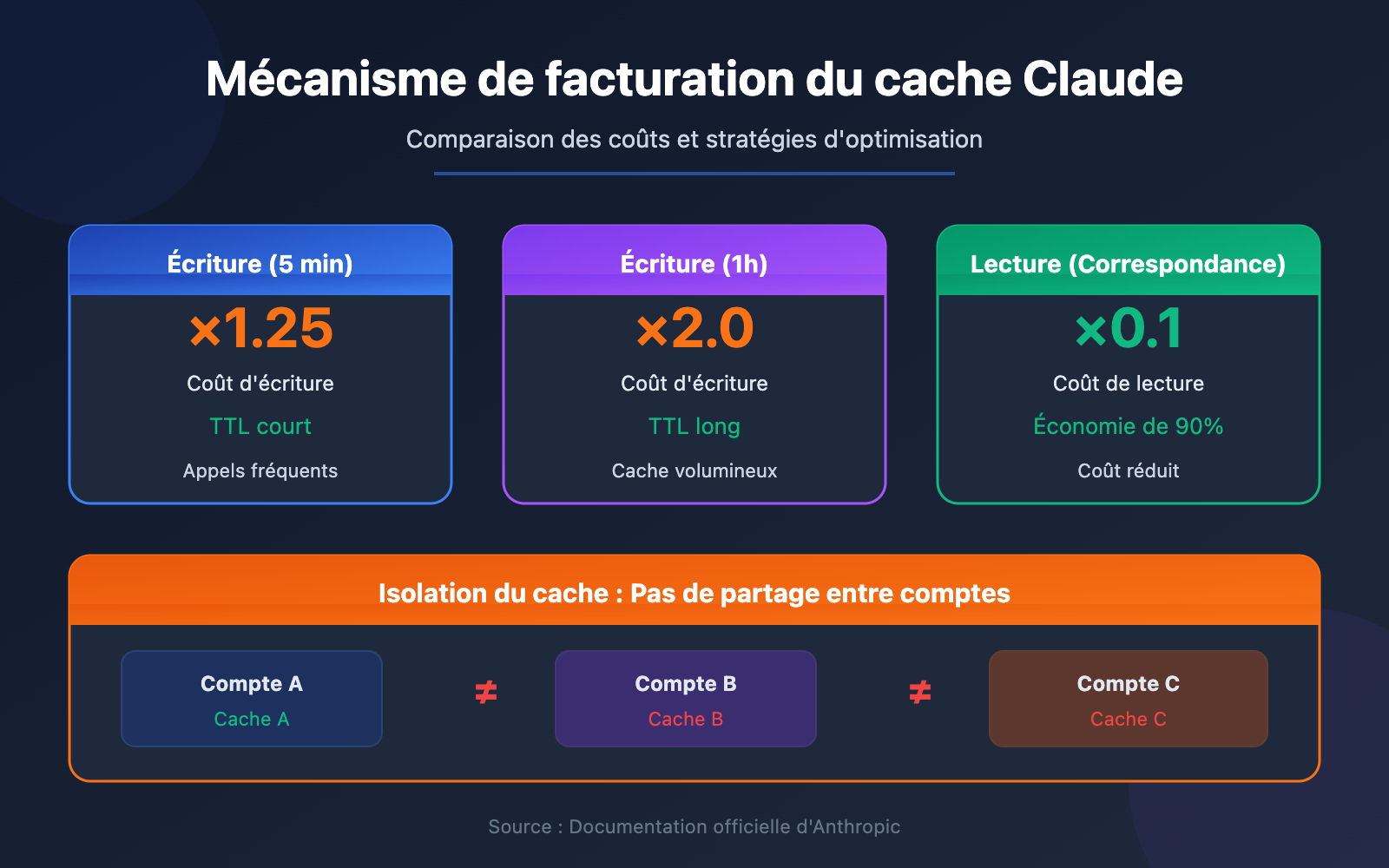

Points clés de la facturation du cache de l'API Claude

| Point clé | Description | Valeur |

|---|---|---|

| Écriture en cache (5 min) | Coût d'écriture = Prix d'entrée de base × 1.25 | Coût le plus bas, adapté aux appels fréquents |

| Écriture en cache (1h) | Coût d'écriture = Prix d'entrée de base × 2.0 | TTL plus long, adapté au cache volumineux mais peu fréquent |

| Lecture du cache (correspondance) | Coût de lecture = Prix d'entrée de base × 0.1 | Coût réduit de 90% après correspondance |

| Isolation du cache | Isolation au niveau du Workspace, organisations complètement isolées | Le cache ne peut pas être partagé entre différents comptes |

Taux de base de la facturation du cache Claude

Le Prompt Caching de l'API Claude utilise un système de facturation à taux unifié. Quel que soit le modèle utilisé (Opus 4.6, Sonnet 4.6 ou Haiku 4.5), les règles de taux pour les opérations de cache sont exactement les mêmes :

- Écriture en cache (TTL 5 min) : Prix d'entrée de base × 1.25

- Écriture en cache (TTL 1h) : Prix d'entrée de base × 2.0

- Lecture du cache (correspondance) : Prix d'entrée de base × 0.1

Cela signifie qu'à chaque correspondance de cache, vous ne payez que 10% du prix d'entrée standard. Par exemple, pour Claude Sonnet 4.6, le prix d'entrée standard est de 3 $/MTok, le prix après correspondance de cache n'est que de 0,3 $/MTok, ce qui représente une économie de 90% sur le coût d'entrée.

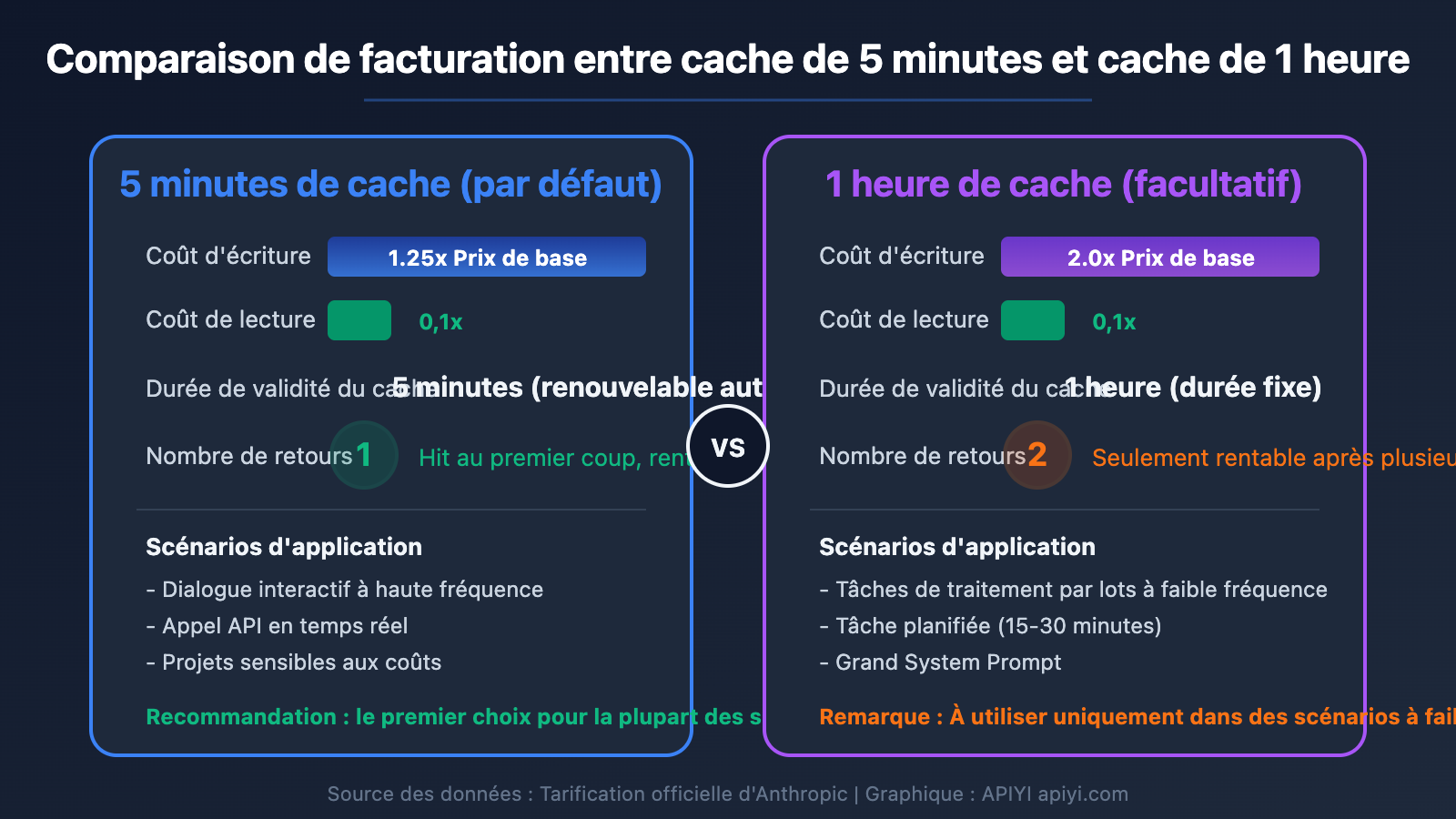

Calcul du seuil de rentabilité de la facturation du cache

Il est très important de comprendre le rapport coût-bénéfice du cache. L'écriture en cache a un coût supplémentaire, mais la lecture du cache est extrêmement bon marché. La clé est de savoir : après combien de correspondances le cache commence-t-il à être « rentable » ?

- Cache de 5 minutes : Écriture 1.25x + Lecture 0.1x = Après la première écriture, il suffit d'1 correspondance pour être rentable (car une lecture normale coûte 1x, tandis qu'une lecture du cache coûte 0.1x, économisant 0.9x > le supplément payé de 0.25x)

- Cache d'1 heure : Écriture 2.0x + Lecture 0.1x = Après la première écriture, il faut 2 correspondances pour être rentable (supplément payé de 1.0x, chaque correspondance économisant 0.9x)

Ainsi, le cache de 5 minutes est presque toujours un choix « gagnant », tandis que le cache d'1 heure nécessite de s'assurer d'au moins 2 correspondances pendant sa durée de validité.

Comparaison de la facturation du cache Claude : 5 minutes vs 1 heure

Différence de prix entre le cache de 5 minutes et celui de 1 heure

Voici les prix détaillés pour l'écriture en cache de 5 minutes et de 1 heure, par modèle :

| Modèle | Prix d'entrée de base | Écriture cache 5 min (×1.25) | Écriture cache 1h (×2.0) | Lecture cache (×0.1) |

|---|---|---|---|---|

| Claude Opus 4.6 | 5,00 $/MTok | 6,25 $/MTok | 10,00 $/MTok | 0,50 $/MTok |

| Claude Sonnet 4.6 | 3,00 $/MTok | 3,75 $/MTok | 6,00 $/MTok | 0,30 $/MTok |

| Claude Haiku 4.5 | 1,00 $/MTok | 1,25 $/MTok | 2,00 $/MTok | 0,10 $/MTok |

Stratégie de choix du TTL pour la facturation du cache Claude

Le cache de 5 minutes et celui de 1 heure ne sont pas mutuellement exclusifs. Vous pouvez choisir en fonction de vos besoins, voire les utiliser ensemble dans une même requête.

Cas d'utilisation du cache de 5 minutes :

- Appels API à haute fréquence (plusieurs requêtes par minute), le cache est rafraîchi en continu

- Dialogues interactifs où l'utilisateur envoie des messages, le cache est automatiquement renouvelé

- Projets sensibles aux coûts, les frais d'écriture sont plus bas

Cas d'utilisation du cache de 1 heure :

- Traitement par lots, où un lot de données est traité toutes les quelques dizaines de minutes

- Grands prompts système, coûteux à écrire, que vous souhaitez conserver plus longtemps

- Tâches planifiées, exécutées toutes les 15-30 minutes

Mécanisme important : Le cache de 5 minutes est automatiquement rafraîchi (son TTL est renouvelé) à chaque fois qu'il est utilisé. Donc si votre fréquence d'appel est suffisante (au moins une requête toutes les 5 minutes), le cache peut rester actif indéfiniment, sans avoir besoin de choisir le cache de 1 heure.

🎯 Conseil technique : Dans la plupart des cas, le cache de 5 minutes est suffisant. Lorsque vous utilisez l'API Claude via la plateforme APIYI apiyi.com, les règles de facturation du cache sont identiques à celles d'Anthropic, et vous pouvez gérer les stratégies de cache de plusieurs modèles via une interface unifiée.

Utilisation mixte des TTL dans la facturation du cache Claude

Anthropic permet d'utiliser simultanément les deux types de contrôle de cache (1 heure et 5 minutes) dans une même requête, mais avec une contrainte clé :

Les TTL doivent être ordonnés du plus long au plus court : Le marqueur de cache de 1 heure doit apparaître avant celui de 5 minutes.

En pratique, vous pouvez définir un prompt système qui change peu en cache de 1 heure, et des exemples few-shot qui changent plus fréquemment en cache de 5 minutes :

import anthropic

client = anthropic.Anthropic(

api_key="VOTRE_CLÉ_API",

base_url="https://vip.apiyi.com" # Appel via APIYI

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Vous êtes un assistant spécialisé dans la documentation technique...(grand prompt système)...",

"cache_control": {"type": "ephemeral", "ttl": "3600"} # Cache 1 heure

}

],

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "Voici le document de référence...(contexte important)...",

"cache_control": {"type": "ephemeral"} # Cache par défaut 5 minutes

},

{

"type": "text",

"text": "Sur la base du document ci-dessus, répondez : qu'est-ce que le Prompt Caching ?"

}

]

}

]

)

Voir le code pour vérifier l’état des hits de cache

import anthropic

client = anthropic.Anthropic(

api_key="VOTRE_CLÉ_API",

base_url="https://vip.apiyi.com"

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Le contenu de votre prompt système (doit faire >= 1024 tokens pour déclencher le cache)",

"cache_control": {"type": "ephemeral"}

}

],

messages=[{"role": "user", "content": "Bonjour"}]

)

# Vérifier l'utilisation du cache

usage = response.usage

print(f"Tokens d'entrée : {usage.input_tokens}")

print(f"Tokens écrits en cache : {usage.cache_creation_input_tokens}")

print(f"Tokens lus depuis le cache : {usage.cache_read_input_tokens}")

# Déterminer l'état du cache

if usage.cache_read_input_tokens > 0:

print("Cache hit ! Économie de 90 % sur le coût d'entrée")

elif usage.cache_creation_input_tokens > 0:

print("Première écriture en cache, les requêtes suivantes utiliseront le cache")

💡 Note : Il y a un nombre minimum de tokens requis pour le cache. Claude Opus 4.6 nécessite au moins 1024 tokens, tout comme Sonnet 4.6 et Haiku 4.5. Le contenu en dessous de ce seuil ne sera pas mis en cache.

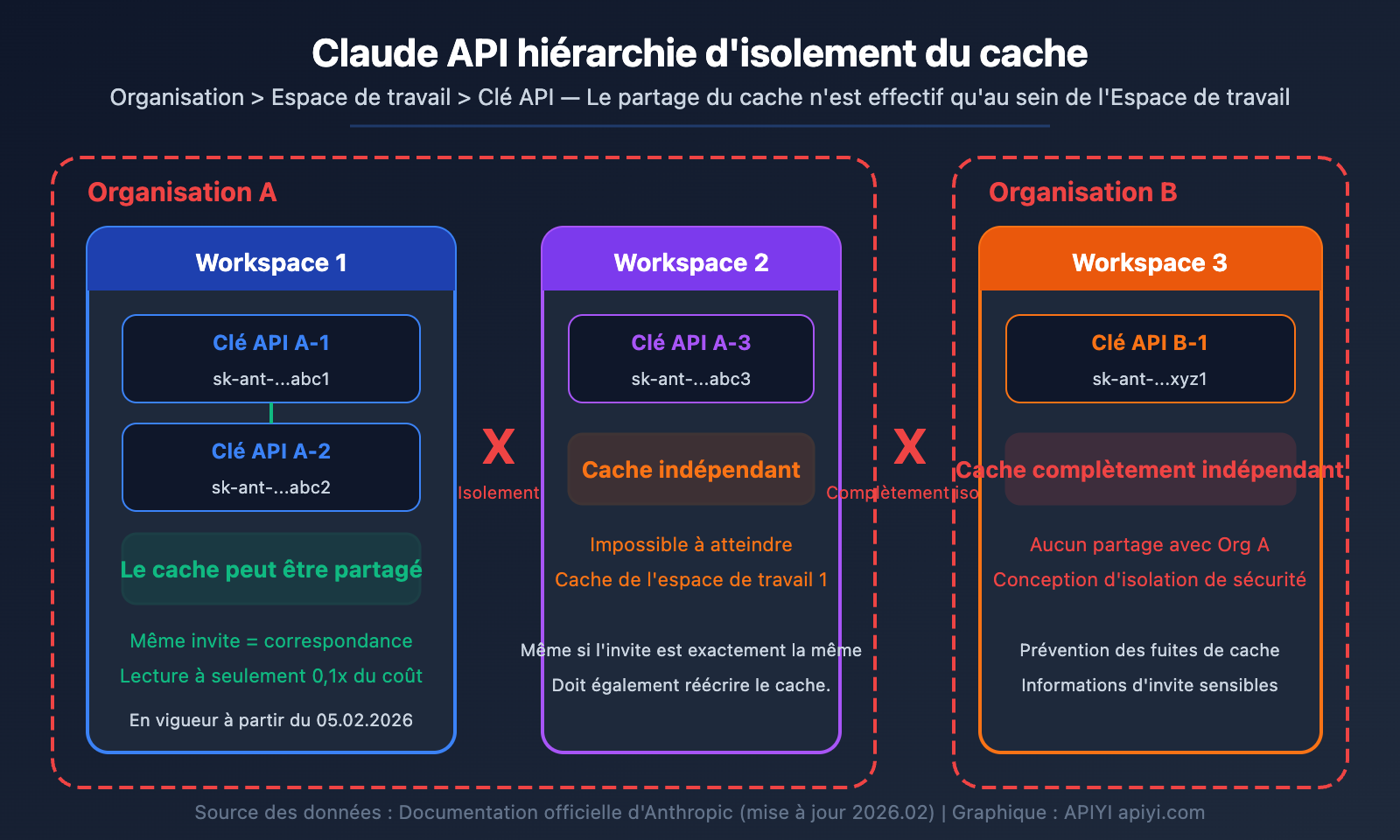

Facturation du cache Claude : Mécanisme d'isolation inter-comptes

C'est la question qui préoccupe le plus les développeurs : Le cache écrit par le compte A peut-il être utilisé (hit) par le compte B ?

Règle fondamentale de l'isolation du cache Claude

La réponse est claire : Non. Le cache est complètement isolé entre différentes organisations (Organization).

Depuis le 5 février 2026, Anthropic a affiné le niveau de granularité de l'isolation du cache, passant du « niveau Organisation » au « niveau Workspace ». Cela signifie :

| Scénario | Le cache est-il partagé ? | Explication |

|---|---|---|

| Différentes clés API au sein d'un même Workspace | ✅ Oui | Au sein d'un même espace de travail, le même prompt utilisera le cache existant. |

| Différents Workspaces au sein d'une même Organisation | ❌ Non | Même sous la même organisation, les espaces de travail sont isolés. |

| Comptes de différentes Organisations | ❌ Absolument pas | Complètement indépendants, même si le prompt est identique à 100%. |

| Différents utilisateurs via des plateformes proxy comme APIYI | ❌ Non | Les requêtes des différents utilisateurs sont acheminées via des identifiants amont distincts. |

Impact pratique de l'isolation du cache Claude

Analyse de scénario : Imaginez que vous avez deux comptes API Claude (appartenant à des Organisations différentes) exécutant simultanément un lot de tâches de traitement de données.

- Le compte A envoie une requête, déclenchant l'écriture dans le cache, et paie le coût d'écriture (1.25x).

- Le compte B envoie exactement le même prompt dans les 5 minutes.

- Résultat : Le compte B ne pourra pas utiliser le cache du compte A. Le compte B déclenchera également une écriture dans le cache et paiera à nouveau 1.25x.

Cette conception est motivée par des considérations de sécurité et de confidentialité. Le contenu du cache peut inclure des System Prompts sensibles ou des données métier ; un partage inter-organisations présenterait un risque de fuite de données.

Stratégie d'optimisation : Si vous avez besoin que plusieurs services partagent un cache pour réduire les coûts, vous devez placer leurs clés API dans le même Workspace, et non pas utiliser des comptes d'Organisations différentes.

🎯 Conseil pratique : Sur la plateforme APIYI (apiyi.com), les requêtes de chaque utilisateur sont traitées via un canal amont unifié. Si vous avez besoin de partager un cache entre plusieurs projets, il est recommandé de planifier judicieusement la structure de vos Workspaces dans l'Anthropic Console, en plaçant les projets nécessitant un cache partagé au sein d'un même Workspace.

Conditions pour un hit de cache Claude

Outre l'isolation par Workspace, il existe une autre condition clé pour qu'un cache soit utilisé : le prompt doit être identique à 100%.

La clé de cache (Cache Key) est générée via un hachage cryptographique du contenu du prompt. La correspondance inclut :

tools(définition des outils)system(invite système)messages(historique des messages)

Ces trois parties sont concaténées dans l'ordre, jusqu'à la position du marqueur cache_control. Si un seul caractère diffère (y compris les espaces, les retours à la ligne), le cache ne sera pas utilisé.

Facturation du cache Claude : Comparaison AWS Bedrock vs Anthropic officiel

Différences de facturation du cache entre AWS Bedrock et l'API Anthropic

De nombreuses entreprises utilisent Claude via AWS Bedrock. La facturation de son cache présente les différences suivantes avec l'API officielle d'Anthropic :

| Dimension de comparaison | API Anthropic officielle | AWS Bedrock |

|---|---|---|

| Écriture du cache (5 min) | 1.25x prix de base | 1.25x prix de base |

| Écriture du cache (1 h) | 2.0x prix de base | 2.0x prix de base (seulement certains modèles) |

| Lecture du cache | 0.1x prix de base | 0.1x prix de base |

| Modèles supportant le cache 1 h | Tous les modèles compatibles cache | Seulement Haiku 4.5, Sonnet 4.5, Opus 4.5 |

| Niveau d'isolation du cache | Niveau Workspace | Niveau Organization (AWS Account) |

| Prix régionaux | Prix global unifié | Majoration d'environ 10% pour les endpoints régionaux |

| Prix de base des inputs | Prix standard officiel | Essentiellement identique à l'officiel |

Différences clés de facturation du cache Claude sur AWS Bedrock

Différence 1 : Gamme de modèles supportant le cache 1 heure

À compter de janvier 2026, AWS Bedrock ne supporte le cache TTL de 1 heure que pour Claude Haiku 4.5, Sonnet 4.5 et Opus 4.5. Les derniers modèles Opus 4.6 et Sonnet 4.6 sur Bedrock pourraient ne pas encore supporter l'option de cache de 1 heure. Si vous avez besoin de la combinaison dernier modèle + cache 1 heure, il est recommandé d'utiliser directement l'API officielle d'Anthropic.

Différence 2 : Granularité de l'isolation du cache

AWS Bedrock maintient une isolation du cache au niveau Organization (c'est-à-dire au niveau du compte AWS), tandis que l'API officielle d'Anthropic est désormais affinée au niveau Workspace. Cela signifie que sur Bedrock, tous les appels sous le même compte AWS peuvent partager le cache, ce qui est une granularité plus large que l'API officielle.

Différence 3 : Différences de prix régionaux

Les endpoints régionaux d'AWS Bedrock (comme us-east-1, eu-west-1) peuvent avoir une majoration de prix d'environ 10% par rapport à l'endpoint global. Cette majoration se reflète également dans les frais d'écriture et de lecture du cache.

💰 Conseil d'optimisation des coûts : Si vous utilisez principalement l'API Claude et avez besoin d'un contrôle fin de la stratégie de cache, l'appel de l'API native d'Anthropic via APIYI apiyi.com est un choix plus flexible. La plateforme prend en charge la transmission complète des paramètres de contrôle du cache et offre des prix plus avantageux.

Questions fréquentes

Q1 : Peut-on choisir librement entre le cache 5 minutes et le cache 1 heure ?

Oui. En définissant le paramètre cache_control dans la requête. Par défaut, si aucun TTL n'est spécifié, c'est le cache de 5 minutes. Définir explicitement "ttl": "3600" active le cache de 1 heure. Vous pouvez également mélanger les deux TTL dans une même requête, mais vous devez vous assurer que le contenu du cache de 1 heure est placé avant celui du cache de 5 minutes. Dans la plupart des cas, le cache de 5 minutes + renouvellement automatique est suffisant, il n'est pas nécessaire de payer plus pour choisir le cache de 1 heure.

Q2 : Deux comptes API Claude différents peuvent-ils partager un hit de cache ?

Non. Le cache est isolé au niveau du Workspace (à partir de février 2026). Si deux comptes appartiennent à des Organizations différentes, les caches sont complètement indépendants. S'ils appartiennent à la même Organization mais à des Workspaces différents, ils ne peuvent pas non plus partager le cache. Ce n'est qu'en utilisant différentes clés API au sein du même Workspace que le même prompt pourra toucher le même cache. Pour partager le cache et réduire les coûts, il faut placer plusieurs clés API dans le même Workspace.

Q3 : Comment savoir si le cache a été touché ?

Le champ usage de la réponse de l'API contiendra deux métriques : cache_creation_input_tokens et cache_read_input_tokens. Si cache_read_input_tokens > 0, cela signifie que le cache a été touché. Lors d'un appel via la plateforme APIYI apiyi.com, ces champs sont renvoyés tels quels, vous pouvez ainsi surveiller directement le taux de hits du cache pour optimiser les coûts.

Q4 : Y a-t-il un nombre minimum de tokens requis pour le contenu du cache ?

Oui. Le seuil minimum de cache pour tous les modèles Claude est de 1024 tokens. Si votre System Prompt ou le contenu de votre contexte fait moins de 1024 tokens, le cache ne sera pas activé. Il est recommandé d'utiliser comme contenu de cache les invites système longues, les exemples Few-shot ou les documents de référence, afin de tirer pleinement parti du mécanisme de cache pour réduire les coûts.

Résumé

Points clés de la tarification du cache de l'API Claude :

- Cache de 5 minutes écrit à 1,25x, cache de 1 heure écrit à 2,0x : Dans la plupart des cas, le cache de 5 minutes suffit. En cas d'appels fréquents, le cache est automatiquement renouvelé, offrant un effet similaire à un cache de longue durée.

- Lecture du cache à seulement 0,1x : En cas de succès du cache, vous économisez 90% du coût des entrées. Un seul succès de cache sur 5 minutes suffit à rentabiliser l'opération.

- Isolation du cache au niveau du Workspace : Le cache ne peut pas être partagé entre différentes organisations ou différents Workspaces. Une planification judicieuse de la structure des Workspaces est nécessaire.

Pour les développeurs ayant besoin d'effectuer de nombreux appels à l'API Claude, une utilisation stratégique du cache peut réduire significativement les coûts. Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour les appels à l'API Claude. Elle prend en charge la transmission complète des paramètres de cache, offre une gestion d'interface unifiée et fournit un crédit de test gratuit pour vous aider à valider l'efficacité de votre stratégie de mise en cache.

Références

-

Documentation officielle d'Anthropic Prompt Caching : Explication complète de la fonctionnalité de cache de l'API Claude.

- Lien :

platform.claude.com/docs/en/build-with-claude/prompt-caching - Description : Contient les paramètres clés tels que les multiplicateurs tarifaires du cache, la configuration du TTL, les exigences minimales en tokens, etc.

- Lien :

-

Page de tarification de l'API Anthropic : Tarifs les plus récents pour tous les modèles Claude.

- Lien :

platform.claude.com/docs/en/about-claude/pricing - Description : Contient les prix de base pour les entrées/sorties ainsi que la tarification détaillée des opérations de cache.

- Lien :

-

Documentation AWS Bedrock Prompt Caching : Guide d'utilisation du cache Claude sur la plateforme AWS.

- Lien :

docs.aws.amazon.com/bedrock/latest/userguide/prompt-caching.html - Description : Méthodes de configuration spécifiques à Bedrock et liste des modèles pris en charge.

- Lien :

-

Annonce du cache d'1 heure sur AWS Bedrock : Communication sur le lancement de la fonctionnalité de cache avec TTL d'1 heure.

- Lien :

aws.amazon.com/about-aws/whats-new/2026/01/amazon-bedrock-one-hour-duration-prompt-caching/ - Description : Portée des modèles supportant le cache d'1 heure sur Bedrock et modalités d'utilisation.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter des questions liées à la tarification du cache Claude dans les commentaires. Pour plus d'astuces sur l'utilisation des API, visitez le centre de documentation d'APIYI : docs.apiyi.com