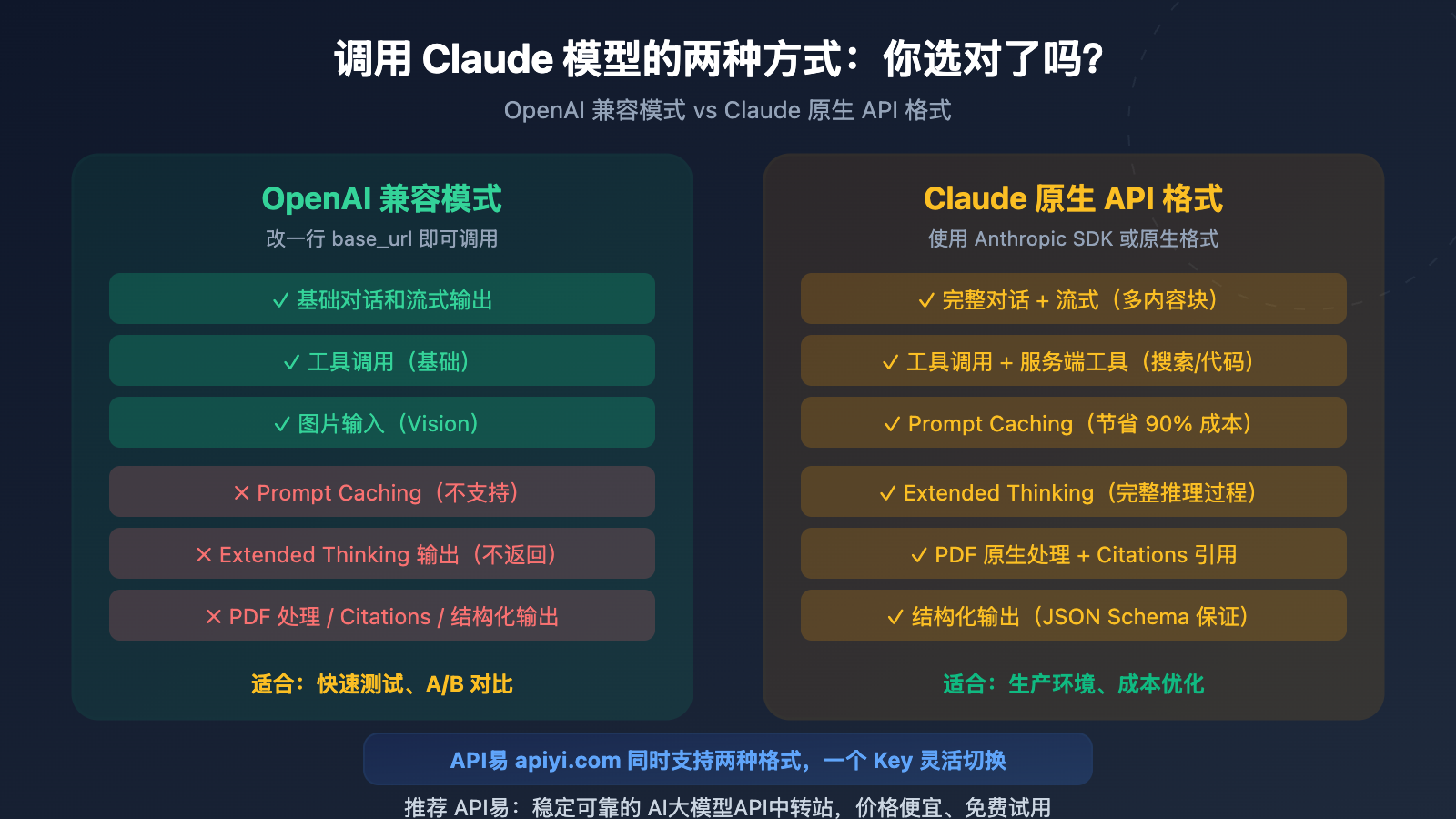

作者注:详细对比 OpenAI 兼容模式和 Claude 原生 API 格式的 7 个关键差异,包括 Prompt Caching、Extended Thinking、工具调用等功能支持情况,帮你选择最适合的接入方式

用 OpenAI SDK 调用 Claude 模型只需改一行 base_url,看起来很方便——但你可能因此 损失 90% 的 Prompt Caching 成本节省、无法获取 Extended Thinking 推理过程、丢失 PDF 原生处理能力。本文将对比这两种接入方式的 7 个关键差异,帮你做出正确选择。

核心价值: 看完本文,你将明确在你的使用场景下,该选择 OpenAI 兼容模式还是 Claude 原生格式,避免因格式选错而多花钱或丢功能。核心点在于,如果你用 Claude 模型,优先用 Claude 原先格式调用,而非 OpenAI 兼容模式。

OpenAI 兼容模式 vs Claude 原生格式 核心差异

| 差异维度 | OpenAI 兼容模式 | Claude 原生格式 | 影响程度 |

|---|---|---|---|

| Prompt Caching | ✗ 不支持 | ✓ 支持(节省 90% 成本) | ⭐⭐⭐⭐⭐ 极高 |

| Extended Thinking | ✗ 不返回推理过程 | ✓ 完整返回思考链 | ⭐⭐⭐⭐⭐ 极高 |

| 系统提示词处理 | 多个合并为一个 | 独立顶层字段 | ⭐⭐⭐ 中 |

| 工具调用 | 基础支持 | 完整支持 + 服务端工具 | ⭐⭐⭐⭐ 高 |

| PDF 处理 | ✗ 不支持 | ✓ 原生 document 类型 | ⭐⭐⭐⭐ 高 |

| 结构化输出 | ✗ strict 被忽略 | ✓ JSON Schema 保证 | ⭐⭐⭐⭐ 高 |

| Citations 引用 | ✗ 不支持 | ✓ 精确引用定位 | ⭐⭐⭐ 中 |

OpenAI 兼容模式 vs Claude 原生格式的本质区别

简单来说,OpenAI 兼容模式是一个翻译层——它将 OpenAI 格式的请求翻译成 Claude 能理解的格式,再将 Claude 的响应翻译回 OpenAI 格式。这个翻译过程是有损的:Claude 原生 API 支持的多种内容块类型(thinking、text、tool_use、citations)在翻译回 OpenAI 格式时被扁平化为一个 content 字符串。

Anthropic 官方明确表示:OpenAI 兼容端点主要用于"测试和对比模型能力",并非长期或生产就绪的解决方案。

OpenAI 兼容模式 vs Claude 原生格式的请求结构对比

两种格式在代码层面的最直观差异是系统提示词的位置和响应的结构:

# ====== OpenAI 兼容模式 ======

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://vip.apiyi.com/v1" # 通过 API易 接入

)

# 系统提示词放在 messages 数组中

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "你是技术专家"},

{"role": "user", "content": "解释 Tokenizer"}

]

)

# 响应是单一 content 字符串

print(response.choices[0].message.content)

查看 Claude 原生格式的请求代码

# ====== Claude 原生 API 格式 ======

import anthropic

client = anthropic.Anthropic(

api_key="your-api-key",

base_url="https://vip.apiyi.com" # 通过 API易 接入

)

# 系统提示词是独立的顶层字段

response = client.messages.create(

model="claude-sonnet-4-6",

system="你是技术专家", # 独立字段,不在 messages 中

messages=[

{"role": "user", "content": "解释 Tokenizer"}

],

max_tokens=1024

)

# 响应是多内容块数组

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"思考过程: {block.thinking}")

🎯 接入建议: API易 apiyi.com 同时支持 OpenAI 兼容格式和 Claude 原生格式。如果你当前使用 OpenAI SDK 且只需基础对话功能,兼容模式可以快速上手;如果需要 Prompt Caching 或 Extended Thinking,建议切换到原生格式。

OpenAI 兼容模式 vs Claude 原生格式 功能详解

差异 1:Prompt Caching(成本影响最大)

这是两种格式最重要的差异。Claude 的 Prompt Caching 可以将重复内容的输入成本降低 90%,但 OpenAI 兼容模式完全不支持这一功能。

| Prompt Caching 细节 | Claude 原生格式 | OpenAI 兼容模式 |

|---|---|---|

| 缓存控制标记 | cache_control 参数 |

✗ 不支持 |

| 5 分钟缓存(写入 1.25x) | ✓ | ✗ |

| 1 小时缓存(写入 2x) | ✓ | ✗ |

| 缓存命中读取(0.1x) | ✓ 节省 90% | ✗ |

| 缓存使用量统计 | ✓ 返回详细数据 | ✗ 字段始终为空 |

| 最小缓存阈值 | Opus: 4,096 / Sonnet 4.6: 2,048 | — |

实际成本差距有多大? 以一个典型的 Agent 工作流为例:每轮对话包含约 10,000 Token 的系统提示词和工具定义。在 10 轮对话中:

- 无缓存(OpenAI 兼容模式): 10 轮 × 10,000 Token = 100,000 Input Token 全价计费

- 有缓存(Claude 原生格式): 首轮全价 + 9 轮缓存命中(0.1x)= 10,000 + 9,000 = 19,000 等效 Token

成本降低约 81%。对话轮次越多,Prompt Caching 的成本优势越显著。

差异 2:Extended Thinking(推理能力)

Claude 的 Extended Thinking 让模型在回答前先进行深度推理。虽然可以通过 extra_body 在 OpenAI 兼容模式中启用 Extended Thinking,但 推理过程不会返回给你——你只能看到最终答案。

# OpenAI 兼容模式 —— 可以触发思考,但看不到思考过程

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "这个数学题怎么解?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content 只有最终答案

# 思考过程被消费但不返回 ❌

在 Claude 原生格式中,你可以获取完整的 thinking 内容块,这对于调试、审计和复杂推理场景非常重要。

差异 3:工具调用格式

两种格式都支持工具调用,但有几个关键差异:

| 工具调用差异 | OpenAI 兼容模式 | Claude 原生格式 |

|---|---|---|

| 工具定义结构 | function.parameters |

input_schema |

| 服务端工具(搜索/代码执行) | ✗ 不支持 | ✓ web_search / code_execution |

strict 模式(输出保证) |

✗ 被忽略 | ✓ JSON Schema 保证 |

| 工具缓存 | ✗ 不支持 | ✓ cache_control |

| 并行工具调用 | ✓ 支持 | ✓ 支持 |

差异 4-7:其他重要区别

差异 4:PDF 文档处理。Claude 原生 API 支持 type: "document" 内容块,可以直接处理 PDF 文件并提取结构化内容。OpenAI 兼容模式中 file 类型内容会被直接忽略。

差异 5:结构化输出。OpenAI 兼容模式中 response_format 和 strict 参数均被忽略,无法保证输出严格遵循 JSON Schema。Claude 原生格式通过 output_config.format 支持 Schema 保证。

差异 6:Citations 引用。Claude 原生格式可以返回精确的引用定位(文档索引、字符位置),适合 RAG 场景中的来源追溯。OpenAI 兼容模式没有对应字段。

差异 7:被忽略的参数。以下 OpenAI 参数在调用 Claude 时会被静默忽略:frequency_penalty、presence_penalty、seed、logprobs、logit_bias、n(必须为 1)。temperature 超过 1 会被自动截断为 1。

🎯 重要提醒: 如果你的代码依赖

frequency_penalty或presence_penalty来控制输出风格,切换到 Claude 时需要注意这些参数不生效。建议通过调整系统提示词来达到类似效果。通过 API易 apiyi.com 接入时,平台会处理这些兼容性细节。

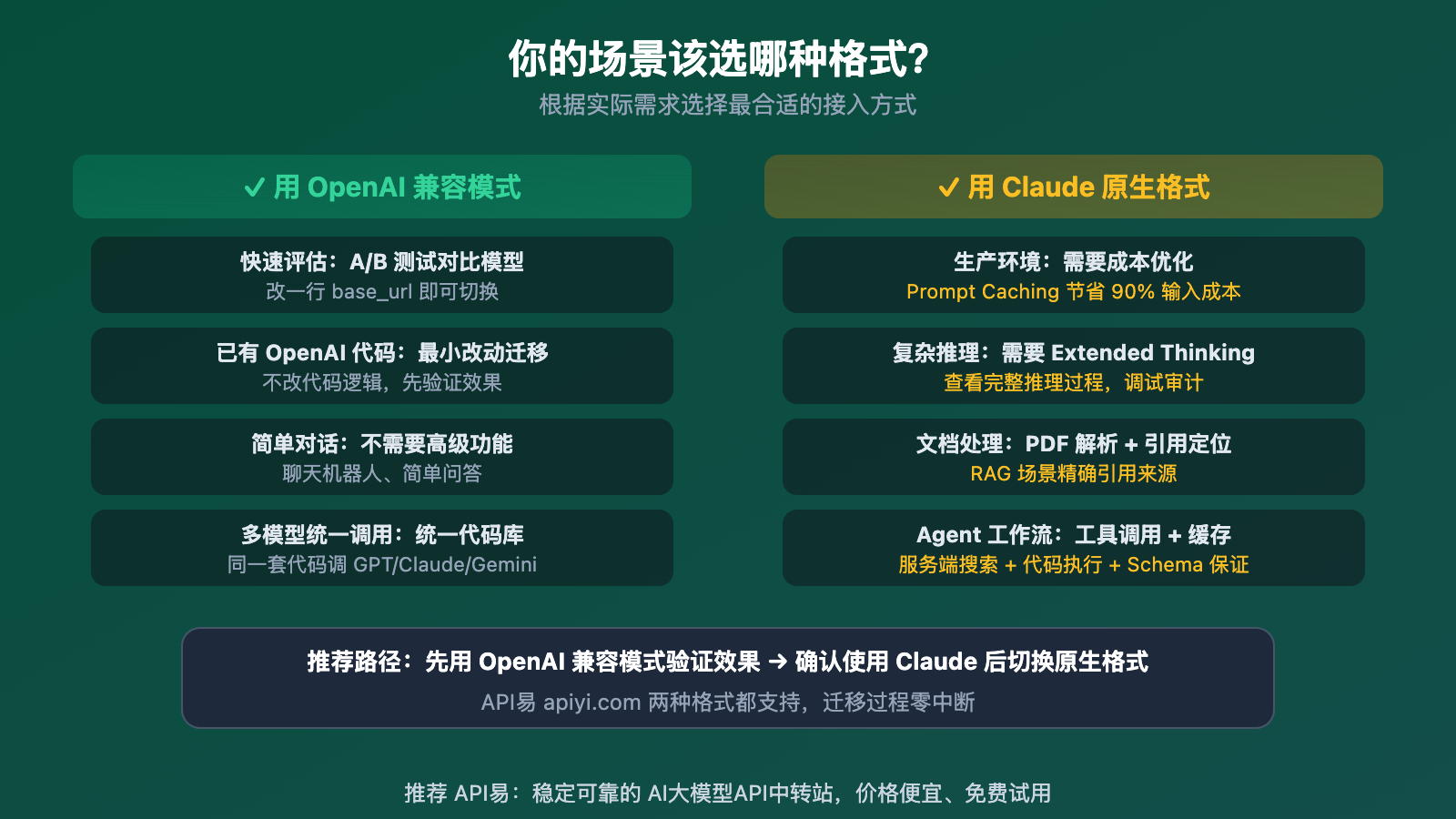

OpenAI 兼容模式 vs Claude 原生格式 场景选择

| 使用场景 | 推荐格式 | 核心原因 |

|---|---|---|

| 快速评估 / A-B 测试 | OpenAI 兼容 | 改 base_url 即可,零代码改动 |

| 已有 OpenAI 项目迁移 | 先 OpenAI 兼容 → 后原生 | 先验证效果,再逐步迁移 |

| 生产环境长对话 | Claude 原生 | Prompt Caching 节省 80%+ 成本 |

| Agent / 工具调用密集 | Claude 原生 | 服务端工具 + 缓存 + Schema 保证 |

| PDF / RAG 场景 | Claude 原生 | 原生文档处理 + Citations 引用 |

| 多模型统一代码 | OpenAI 兼容 | 一套代码调用 GPT/Claude/Gemini |

🎯 迁移建议: 从 OpenAI 兼容模式迁移到 Claude 原生格式,主要工作量在于:(1)将 system 消息从 messages 中提取到顶层字段;(2)将工具定义的

parameters改为input_schema;(3)处理响应中的多内容块结构。通过 API易 apiyi.com 接入可以简化这个过程。

常见问题

Q1: 用 OpenAI 兼容模式调用 Claude,功能会不会比调 GPT 少?

会少一些。OpenAI 兼容模式调用 Claude 时,frequency_penalty、presence_penalty、seed、logprobs、response_format 等参数都会被静默忽略。而调用 GPT 时这些参数是生效的。所以如果你的代码依赖这些参数,从 GPT 切换到 Claude 时需要注意。不过核心的对话、流式输出、基础工具调用都完全正常。

Q2: Claude 原生格式和 OpenAI 格式可以混用吗?

可以。API易 apiyi.com 同时支持两种格式。你可以在同一个项目中,对简单对话使用 OpenAI 兼容格式(省开发时间),对需要 Prompt Caching 的 Agent 工作流使用 Claude 原生格式(省 Token 成本)。两种格式使用同一个 API Key。

Q3: 从 OpenAI 兼容模式切换到 Claude 原生格式难吗?

改动量不大,主要有 3 处:

- SDK 从

openai换为anthropic(或直接使用 HTTP 请求) - 系统提示词从 messages 数组中提取为独立的

system字段 - 响应处理从

choices[0].message.content改为遍历content数组

如果通过 API易 apiyi.com 接入,平台提供两种格式的统一文档和代码示例,迁移更加顺畅。

总结

OpenAI 兼容模式 vs Claude 原生格式的核心选择依据:

- Prompt Caching 是最大差异: 生产环境中长对话和 Agent 场景,使用 Claude 原生格式可节省 80-90% 的输入 Token 成本,这个差距远大于其他功能差异

- OpenAI 兼容模式适合快速验证: 如果只是测试 Claude 效果或进行 A/B 对比,改一行

base_url就够了,不需要重写代码 - 生产环境建议使用原生格式: Extended Thinking、PDF 处理、Citations、结构化输出等功能只有原生格式才能完整使用

选对接入方式,既能发挥 Claude 的全部能力,又能最大化成本效率。

推荐通过 API易 apiyi.com 接入,平台同时支持 OpenAI 兼容格式和 Claude 原生格式,一个 Key 即可灵活切换,轻松应对不同场景需求。

📚 参考资料

-

Anthropic OpenAI SDK 兼容性文档: 官方支持和不支持的参数完整列表

- 链接:

platform.claude.com/docs/en/api/openai-sdk - 说明: 包含所有被忽略参数和响应字段的详细说明

- 链接:

-

Claude Prompt Caching 文档: Prompt 缓存机制和计费规则

- 链接:

platform.claude.com/docs/en/build-with-claude/prompt-caching - 说明: 5 分钟和 1 小时两种缓存级别的定价和最小阈值

- 链接:

-

Claude Messages API 参考: Claude 原生 API 的完整请求和响应格式

- 链接:

platform.claude.com/docs/en/api/messages - 说明: content blocks、工具调用、流式输出的详细格式规范

- 链接:

-

Claude Extended Thinking 文档: 扩展思考功能的使用方法

- 链接:

platform.claude.com/docs/en/build-with-claude/extended-thinking - 说明: 如何启用和获取完整的推理过程输出

- 链接:

作者: APIYI 技术团队

技术交流: 欢迎在评论区讨论,更多资料可访问 API易 docs.apiyi.com 文档中心