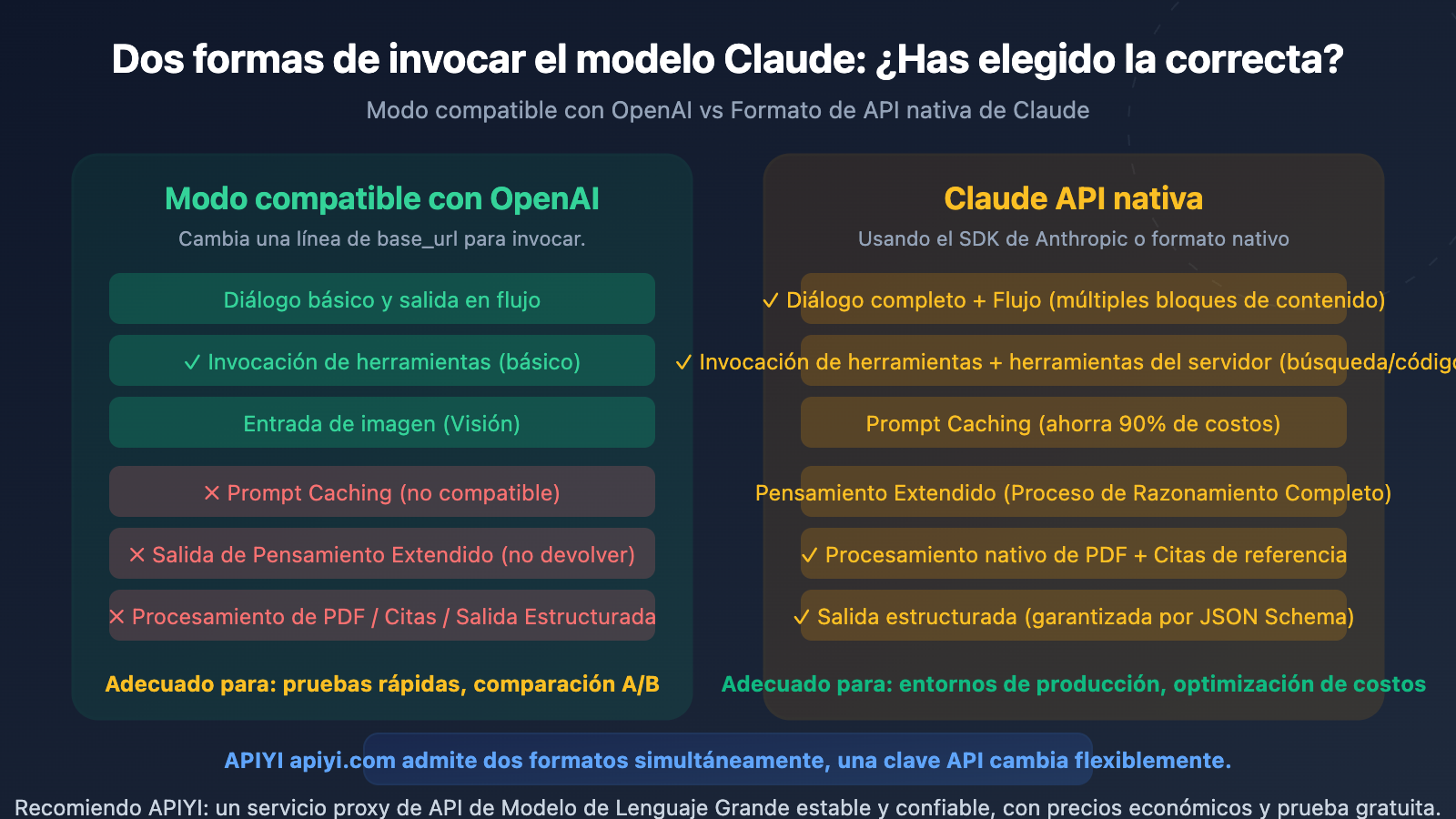

Nota del autor: Comparación detallada de las 7 diferencias clave entre el modo compatible con OpenAI y el formato nativo de la API de Claude, incluyendo el soporte para funciones como Prompt Caching, Extended Thinking y la invocación de herramientas, para ayudarte a elegir el método de conexión más adecuado.

Usar el SDK de OpenAI para invocar modelos Claude solo requiere cambiar una línea base_url, lo que parece muy conveniente, pero podrías estar perdiendo un ahorro del 90% en costos gracias a Prompt Caching, no obtener el proceso de razonamiento Extended Thinking y perder la capacidad nativa de procesar PDFs. Este artículo compara estas 7 diferencias clave entre los dos métodos de conexión para ayudarte a tomar la decisión correcta.

Valor central: Después de leer este artículo, tendrás claro si en tu caso de uso debes elegir el modo compatible con OpenAI o el formato nativo de Claude, evitando gastar más dinero o perder funcionalidades por elegir el formato incorrecto. El punto clave es que si usas modelos Claude, prioriza la invocación en el formato nativo de Claude, no en el modo compatible con OpenAI.

Diferencias clave entre el modo compatible con OpenAI y el formato nativo de Claude

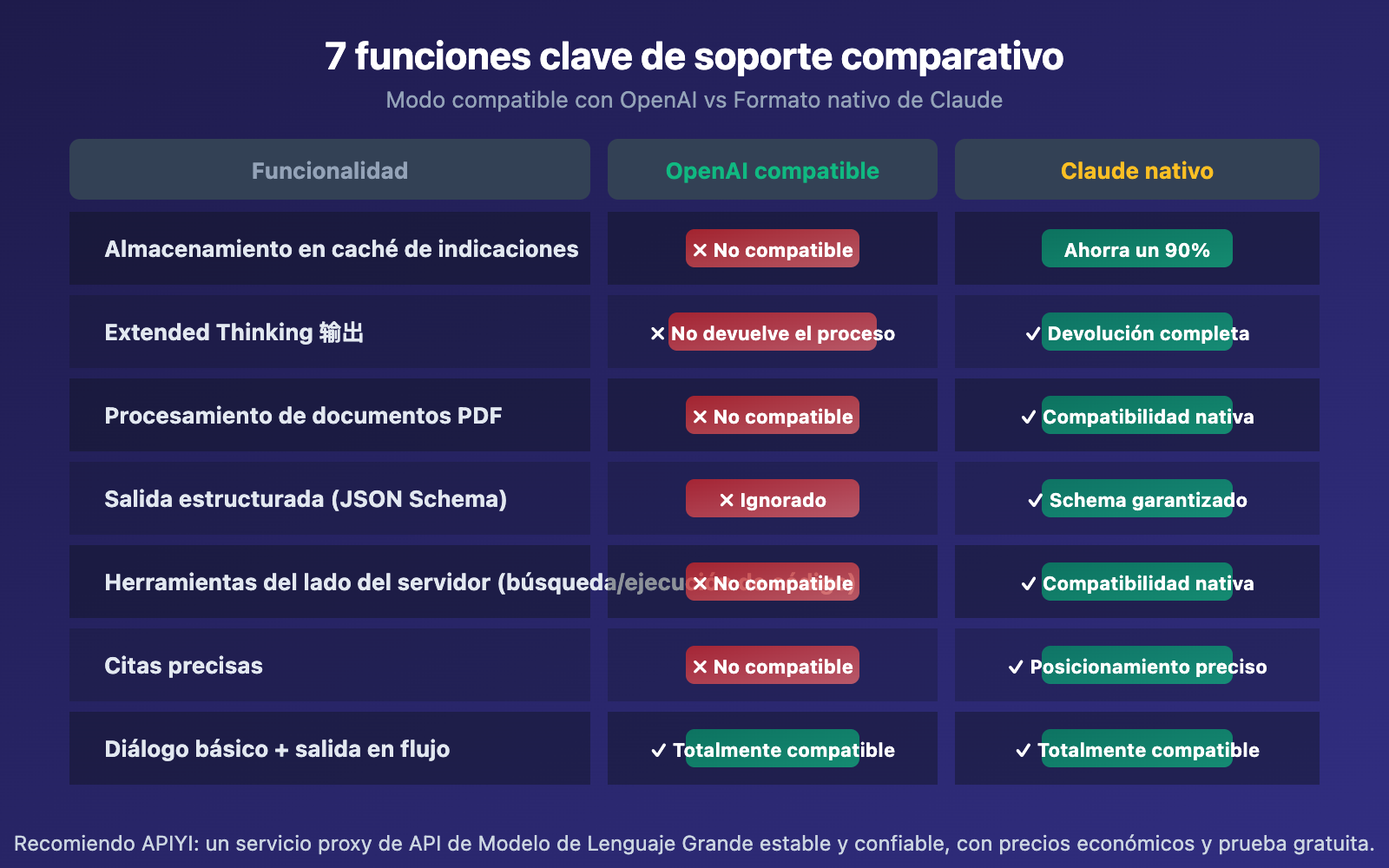

| Dimensión de diferencia | Modo compatible con OpenAI | Formato nativo de Claude | Impacto |

|---|---|---|---|

| Prompt Caching | ✗ No compatible | ✓ Compatible (ahorra 90% de costos) | ⭐⭐⭐⭐⭐ Muy alto |

| Extended Thinking | ✗ No devuelve el proceso de razonamiento | ✓ Devuelve la cadena de pensamiento completa | ⭐⭐⭐⭐⭐ Muy alto |

| Procesamiento de indicaciones del sistema | Múltiples se combinan en uno | Campo independiente de nivel superior | ⭐⭐⭐ Medio |

| Invocación de herramientas | Soporte básico | Soporte completo + herramientas del servidor | ⭐⭐⭐⭐ Alto |

| Procesamiento de PDF | ✗ No compatible | ✓ Tipo de documento nativo | ⭐⭐⭐⭐ Alto |

| Salida estructurada | ✗ Se ignora strict |

✓ Garantizado con JSON Schema | ⭐⭐⭐⭐ Alto |

| Citas (Citations) | ✗ No compatible | ✓ Ubicación precisa de referencias | ⭐⭐⭐ Medio |

La diferencia esencial entre el modo compatible con OpenAI y el formato nativo de Claude

En pocas palabras, el modo compatible con OpenAI es una capa de traducción: traduce las solicitudes en formato OpenAI a un formato que Claude pueda entender, y luego traduce la respuesta de Claude de vuelta al formato OpenAI. Este proceso de traducción tiene pérdidas: los múltiples tipos de bloques de contenido que soporta la API nativa de Claude (thinking, text, tool_use, citations) se aplanan en una sola cadena content al traducirse de vuelta al formato OpenAI.

Anthropic ha declarado explícitamente que el endpoint compatible con OpenAI está destinado principalmente para "probar y comparar las capacidades del modelo", y no es una solución lista para producción o a largo plazo.

Comparación de la estructura de solicitudes: Modo compatible con OpenAI vs Formato nativo de Claude

La diferencia más obvia a nivel de código entre los dos formatos es la ubicación de la indicación del sistema y la estructura de la respuesta:

# ====== Modo compatible con OpenAI ======

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://vip.apiyi.com/v1" # Conexión a través de APIYI

)

# La indicación del sistema va dentro del array `messages`

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Eres un experto técnico"},

{"role": "user", "content": "Explica el Tokenizer"}

]

)

# La respuesta es una única cadena `content`

print(response.choices[0].message.content)

Ver el código de solicitud en formato nativo de Claude

# ====== Formato nativo de la API de Claude ======

import anthropic

client = anthropic.Anthropic(

api_key="your-api-key",

base_url="https://vip.apiyi.com" # Conexión a través de APIYI

)

# La indicación del sistema es un campo independiente de nivel superior

response = client.messages.create(

model="claude-sonnet-4-6",

system="Eres un experto técnico", # Campo independiente, no está en `messages`

messages=[

{"role": "user", "content": "Explica el Tokenizer"}

],

max_tokens=1024

)

# La respuesta es un array de múltiples bloques de contenido

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"Proceso de pensamiento: {block.thinking}")

🎯 Recomendación de conexión: APIYI apiyi.com es compatible tanto con el formato OpenAI como con el formato nativo de Claude. Si actualmente usas el SDK de OpenAI y solo necesitas funciones básicas de conversación, el modo compatible te permite empezar rápidamente; pero si necesitas Prompt Caching o Extended Thinking, te recomendamos cambiar al formato nativo.

Modo Compatible con OpenAI vs Formato Nativo de Claude: Explicación Detallada de Funciones

Diferencia 1: Prompt Caching (Impacto de Costo Más Significativo)

Esta es la diferencia más importante entre los dos formatos. El Prompt Caching de Claude puede reducir el costo de entrada de contenido repetido en un 90%, pero el modo compatible con OpenAI no admite esta función en absoluto.

| Detalles de Prompt Caching | Formato Nativo de Claude | Modo Compatible con OpenAI |

|---|---|---|

| Marcador de control de caché | Parámetro cache_control |

✗ No compatible |

| Caché de 5 minutos (escritura 1.25x) | ✓ | ✗ |

| Caché de 1 hora (escritura 2x) | ✓ | ✗ |

| Lectura por acierto de caché (0.1x) | ✓ Ahorra 90% | ✗ |

| Estadísticas de uso de caché | ✓ Devuelve datos detallados | ✗ Los campos siempre están vacíos |

| Umbral mínimo de caché | Opus: 4,096 / Sonnet 4.6: 2,048 | — |

¿Cuál es la diferencia real de costo? Tomemos como ejemplo un flujo de trabajo típico de un Agente: cada turno de conversación contiene aproximadamente 10,000 tokens de indicaciones del sistema y definiciones de herramientas. En 10 turnos de conversación:

- Sin caché (Modo compatible con OpenAI): 10 turnos × 10,000 tokens = 100,000 tokens de entrada facturados a precio completo.

- Con caché (Formato nativo de Claude): Primer turno a precio completo + 9 turnos con acierto de caché (0.1x) = 10,000 + 9,000 = 19,000 tokens equivalentes.

Reducción de costo de aproximadamente el 81%. Cuantos más turnos de conversación haya, más significativa será la ventaja de costo del Prompt Caching.

Diferencia 2: Extended Thinking (Capacidad de Razonamiento)

El Extended Thinking de Claude permite que el modelo realice un razonamiento profundo antes de responder. Aunque se puede habilitar en el modo compatible con OpenAI mediante extra_body, el proceso de razonamiento no se te devuelve; solo ves la respuesta final.

# Modo compatible con OpenAI —— Puede desencadenar el pensamiento, pero no ves el proceso.

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "¿Cómo se resuelve este problema matemático?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content solo tiene la respuesta final.

# El proceso de pensamiento se consume pero no se devuelve ❌

En el formato nativo de Claude, puedes obtener el bloque de contenido completo del thinking, lo cual es muy importante para depuración, auditoría y escenarios de razonamiento complejo.

Diferencia 3: Formato de Invocación de Herramientas

Ambos formatos admiten la invocación de herramientas, pero hay algunas diferencias clave:

| Diferencias en Invocación de Herramientas | Modo Compatible con OpenAI | Formato Nativo de Claude |

|---|---|---|

| Estructura de definición de herramientas | function.parameters |

input_schema |

| Herramientas del lado del servidor (búsqueda/ejecución de código) | ✗ No compatible | ✓ web_search / code_execution |

Modo strict (garantía de salida) |

✗ Se ignora | ✓ Garantía de JSON Schema |

| Caché de herramientas | ✗ No compatible | ✓ cache_control |

| Invocación paralela de herramientas | ✓ Compatible | ✓ Compatible |

Diferencias 4-7: Otras Distinciones Importantes

Diferencia 4: Procesamiento de documentos PDF. La API nativa de Claude admite bloques de contenido type: "document", lo que permite procesar directamente archivos PDF y extraer contenido estructurado. En el modo compatible con OpenAI, el contenido de tipo file se ignora directamente.

Diferencia 5: Salida estructurada. En el modo compatible con OpenAI, los parámetros response_format y strict se ignoran, por lo que no se puede garantizar que la salida siga estrictamente el JSON Schema. El formato nativo de Claude admite la garantía de Schema a través de output_config.format.

Diferencia 6: Citations (Citas). El formato nativo de Claude puede devolver ubicaciones de citas precisas (índice del documento, posición del carácter), adecuadas para el rastreo de fuentes en escenarios RAG. El modo compatible con OpenAI no tiene campos correspondientes.

Diferencia 7: Parámetros ignorados. Los siguientes parámetros de OpenAI se ignoran silenciosamente al llamar a Claude: frequency_penalty, presence_penalty, seed, logprobs, logit_bias, n (debe ser 1). Si temperature supera 1, se trunca automáticamente a 1.

🎯 Recordatorio importante: Si tu código depende de

frequency_penaltyopresence_penaltypara controlar el estilo de salida, ten en cuenta que estos parámetros no tienen efecto al cambiar a Claude. Se recomienda ajustar las indicaciones del sistema para lograr un efecto similar. Al conectarse a través de APIYI apiyi.com, la plataforma maneja estos detalles de compatibilidad.

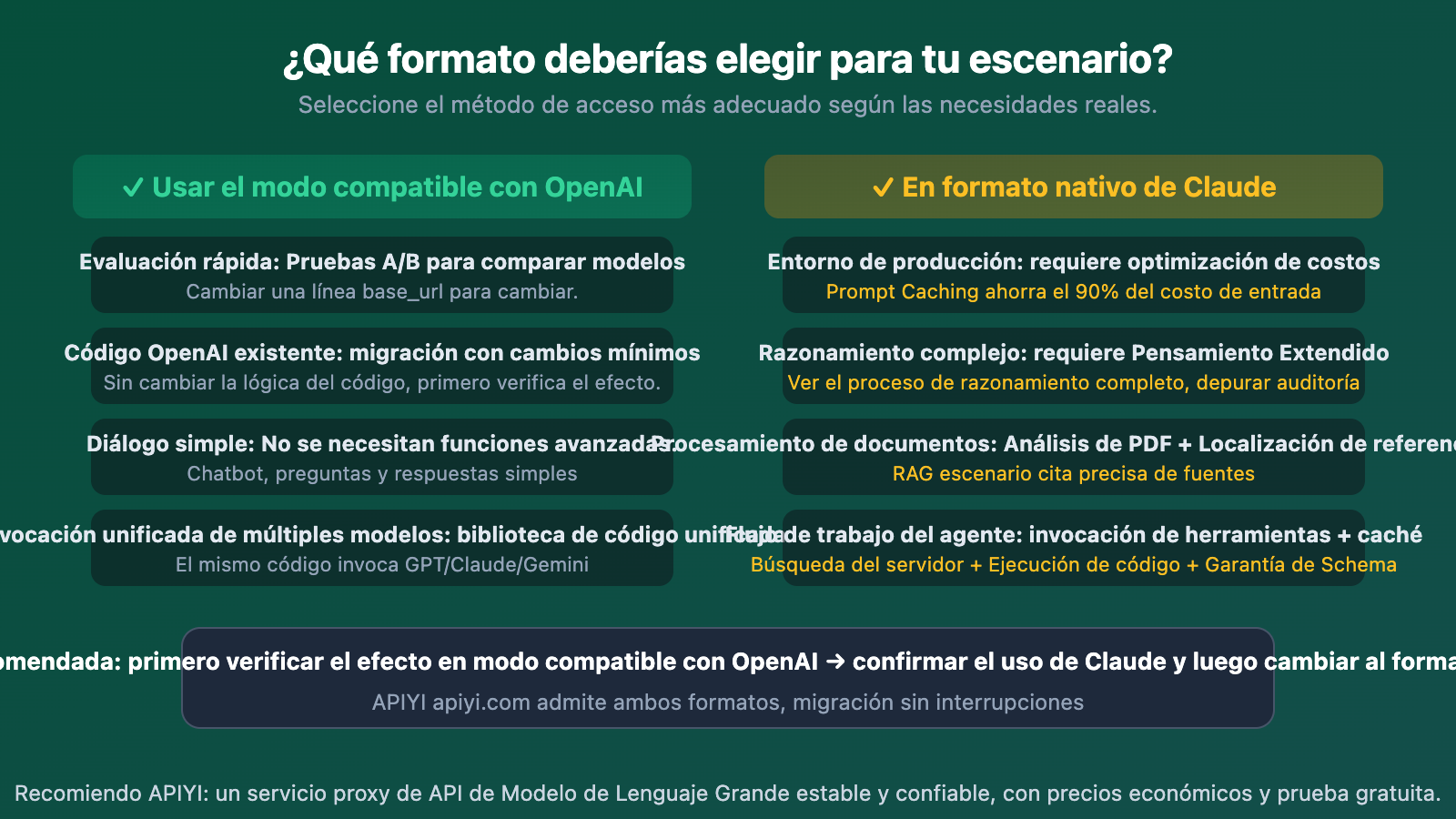

Modo Compatible con OpenAI vs Formato Nativo de Claude: Selección de Escenarios

| Escenario de Uso | Formato Recomendado | Razón Principal |

|---|---|---|

| Evaluación Rápida / Pruebas A-B | Compatible con OpenAI | Cambiar base_url es suficiente, cero cambios en el código |

| Migración de Proyectos Existentes de OpenAI | Primero Compatible con OpenAI → Luego Nativo | Primero validar resultados, luego migrar gradualmente |

| Diálogos Largos en Entorno de Producción | Nativo de Claude | Prompt Caching ahorra más del 80% del costo |

| Agente / Uso Intensivo de Herramientas | Nativo de Claude | Herramientas del servidor + Caché + Garantía de Schema |

| Escenarios con PDF / RAG | Nativo de Claude | Procesamiento nativo de documentos + Citas (Citations) |

| Código Unificado para Múltiples Modelos | Compatible con OpenAI | Un solo código para invocar GPT/Claude/Gemini |

🎯 Recomendación de Migración: Migrar del modo compatible con OpenAI al formato nativo de Claude implica principalmente: (1) extraer el mensaje

systemdel arraymessagesa un campo de nivel superior; (2) cambiar la definición de herramientas deparametersainput_schema; (3) manejar la estructura de múltiples bloques de contenido en la respuesta. Usar APIYI (apiyi.com) para la conexión puede simplificar este proceso.

Preguntas Frecuentes

P1: ¿Al usar el modo compatible con OpenAI para invocar a Claude, habrá menos funciones que al invocar a GPT?

Sí, algunas menos. Al usar el modo compatible con OpenAI para invocar a Claude, parámetros como frequency_penalty, presence_penalty, seed, logprobs, response_format se ignoran silenciosamente. Estos parámetros sí funcionan al invocar a GPT. Por lo tanto, si tu código depende de estos parámetros, debes tenerlo en cuenta al cambiar de GPT a Claude. Sin embargo, las funciones principales como diálogo, salida en flujo (streaming) y el uso básico de herramientas funcionan completamente bien.

P2: ¿Se pueden mezclar el formato nativo de Claude y el formato de OpenAI?

Sí. APIYI (apiyi.com) admite ambos formatos simultáneamente. Puedes usar el formato compatible con OpenAI para diálogos simples (ahorra tiempo de desarrollo) y el formato nativo de Claude para flujos de trabajo de Agente que requieran Prompt Caching (ahorra costos de Token) dentro del mismo proyecto. Ambos formatos usan la misma clave API.

P3: ¿Es difícil cambiar del modo compatible con OpenAI al formato nativo de Claude?

Los cambios no son extensos, principalmente hay 3 áreas:

- Cambiar el SDK de

openaiaanthropic(o usar directamente solicitudes HTTP) - Extraer la indicación del sistema del array

messagesa un camposystemindependiente - Cambiar el procesamiento de la respuesta de

choices[0].message.contenta iterar sobre el arraycontent

Si te conectas a través de APIYI (apiyi.com), la plataforma proporciona documentación unificada y ejemplos de código para ambos formatos, haciendo la migración más fluida.

Resumen

Criterios clave para elegir entre el modo compatible con OpenAI y el formato nativo de Claude:

- El Prompt Caching es la mayor diferencia: En entornos de producción con conversaciones largas y escenarios de Agent, usar el formato nativo de Claude puede ahorrar entre un 80% y un 90% del costo de los tokens de entrada. Esta brecha es mucho mayor que cualquier otra diferencia funcional.

- El modo compatible con OpenAI es ideal para validación rápida: Si solo estás probando el rendimiento de Claude o haciendo comparaciones A/B, cambiar la

base_urles suficiente; no necesitas reescribir el código. - Para entornos de producción se recomienda el formato nativo: Funciones como Extended Thinking, procesamiento de PDF, Citations y salida estructurada solo están disponibles completamente en el formato nativo.

Elegir el método de integración correcto te permite aprovechar al máximo las capacidades de Claude y optimizar la eficiencia de costos.

Se recomienda acceder a través de APIYI apiyi.com. La plataforma admite tanto el formato compatible con OpenAI como el formato nativo de Claude, permitiéndote cambiar entre ellos con una sola clave para adaptarte fácilmente a diferentes necesidades.

📚 Referencias

-

Documentación de compatibilidad del SDK de OpenAI de Anthropic: Lista completa de parámetros oficialmente soportados y no soportados.

- Enlace:

platform.claude.com/docs/en/api/openai-sdk - Descripción: Incluye explicaciones detalladas de todos los parámetros ignorados y campos de respuesta.

- Enlace:

-

Documentación de Prompt Caching de Claude: Mecanismo de caché de prompts y reglas de facturación.

- Enlace:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Descripción: Precios y umbrales mínimos para los dos niveles de caché (5 minutos y 1 hora).

- Enlace:

-

Referencia de la API de Mensajes de Claude: Formato completo de solicitud y respuesta de la API nativa de Claude.

- Enlace:

platform.claude.com/docs/en/api/messages - Descripción: Especificaciones detalladas para bloques de contenido, llamadas a herramientas y salida en flujo continuo.

- Enlace:

-

Documentación de Extended Thinking de Claude: Cómo usar la función de pensamiento extendido.

- Enlace:

platform.claude.com/docs/en/build-with-claude/extended-thinking - Descripción: Cómo habilitar y obtener la salida completa del proceso de razonamiento.

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Bienvenidos a debatir en la sección de comentarios. Para más recursos, visita el centro de documentación de APIYI docs.apiyi.com.