Nota del autor: Análisis en profundidad del mecanismo de facturación de caché de Claude API, comparación de las diferencias de precio entre la escritura de caché de 5 minutos y 1 hora, respuesta a preguntas sobre aciertos de caché entre cuentas, y comparación de las diferencias de facturación de caché entre AWS Bedrock y la API oficial de Anthropic.

El Prompt Caching de Claude API es un medio central para reducir el costo de las llamadas a la API, pero muchos desarrolladores tienen dudas sobre los detalles de su facturación: ¿Cómo elegir entre la caché de 5 minutos y la de 1 hora? ¿Se puede compartir la caché entre cuentas? ¿En qué se diferencia la facturación de caché de AWS Bedrock de la oficial?

Valor central: Después de leer este artículo, comprenderás completamente los 3 mecanismos centrales de facturación de caché de Claude API, dominarás el método para elegir la estrategia de caché óptima y evitarás gastos innecesarios.

Puntos Clave de la Facturación de Caché de Claude API

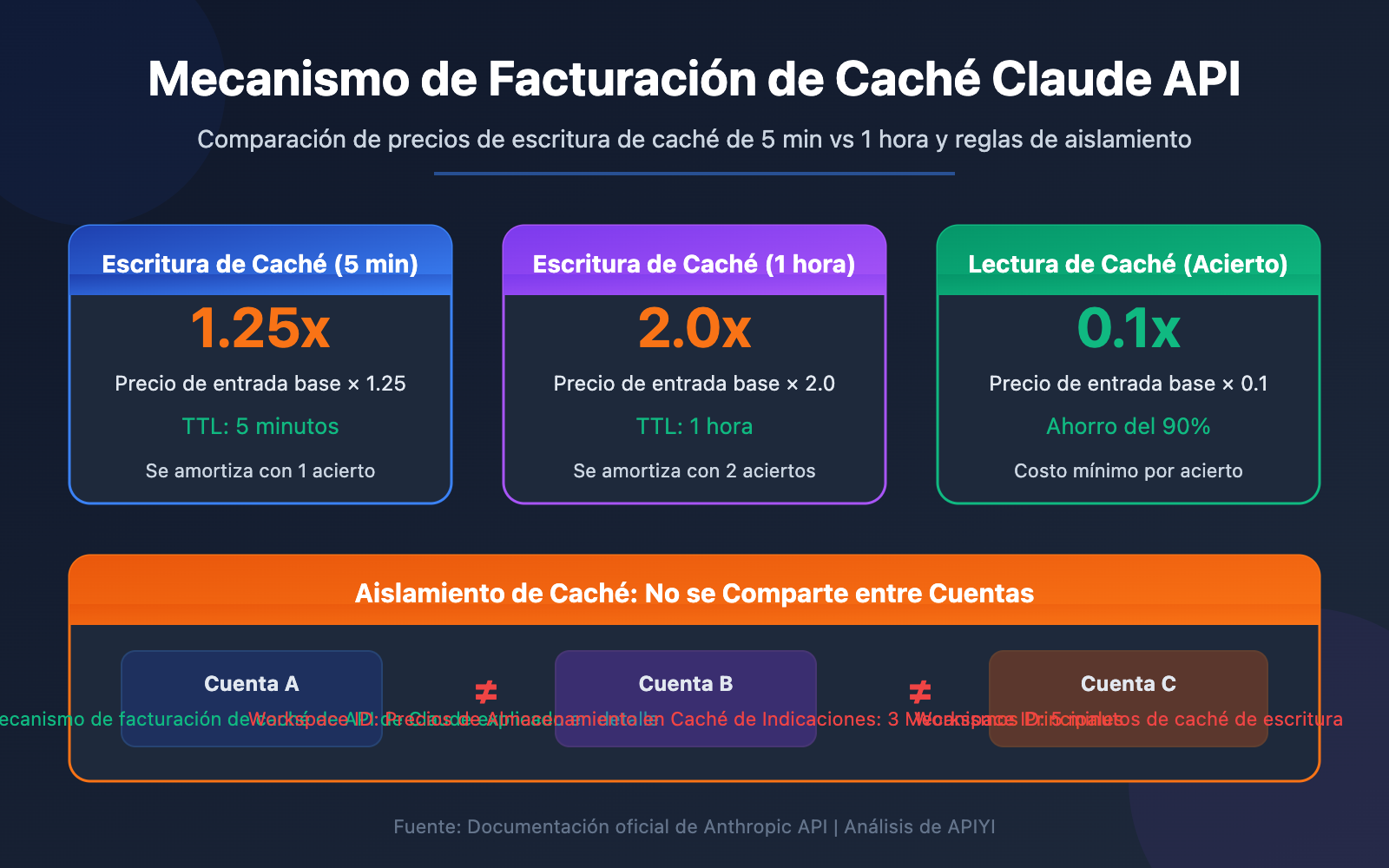

| Punto | Explicación | Valor |

|---|---|---|

| Escritura de caché de 5 min | Costo de escritura = Precio de entrada base × 1.25 | Costo más bajo, ideal para llamadas de alta frecuencia |

| Escritura de caché de 1 hora | Costo de escritura = Precio de entrada base × 2.0 | TTL más largo, ideal para caché de baja frecuencia pero gran volumen |

| Lectura de caché (acierto) | Costo de lectura = Precio de entrada base × 0.1 | Costo reducido en un 90% tras el acierto |

| Aislamiento de caché | Aislamiento a nivel de Workspace, organizaciones completamente separadas | No se puede compartir caché entre cuentas |

Tasas Base de Facturación de Caché de Claude

El Prompt Caching de Claude API utiliza un sistema unificado de facturación por tasas. Independientemente del modelo que uses (Opus 4.6, Sonnet 4.6 o Haiku 4.5), las reglas de tasas para las operaciones de caché son completamente consistentes:

- Escritura de caché (TTL de 5 min): Precio de entrada base × 1.25

- Escritura de caché (TTL de 1 hora): Precio de entrada base × 2.0

- Lectura de caché (acierto): Precio de entrada base × 0.1

Esto significa que por cada acierto de caché, solo pagas el 10% del precio de entrada estándar. Tomando como ejemplo Claude Sonnet 4.6, cuyo precio de entrada estándar es $3/MTok, el precio por acierto de caché es solo $0.3/MTok, ahorrando un 90% del costo de entrada.

Cálculo de Amortización de la Facturación de Caché de Claude

Es muy importante comprender la relación costo-beneficio del caché. La escritura de caché tiene un costo adicional, pero la lectura de caché es extremadamente barata. La clave está en: ¿cuántas veces debe ser alcanzada la caché para empezar a "amortizarse"?

- Caché de 5 min: Escritura 1.25x + Lectura 0.1x = Después de la primera escritura, se amortiza con solo 1 acierto (porque la lectura normal es 1x, mientras que la lectura de caché es 0.1x, ahorrando 0.9x > el pago adicional de 0.25x)

- Caché de 1 hora: Escritura 2.0x + Lectura 0.1x = Después de la primera escritura, necesita 2 aciertos para amortizarse (pago adicional de 1.0x, cada acierto ahorra 0.9x)

Por lo tanto, la caché de 5 minutos es casi siempre una elección "rentable", mientras que la caché de 1 hora requiere asegurar al menos 2 aciertos dentro de su período de validez.

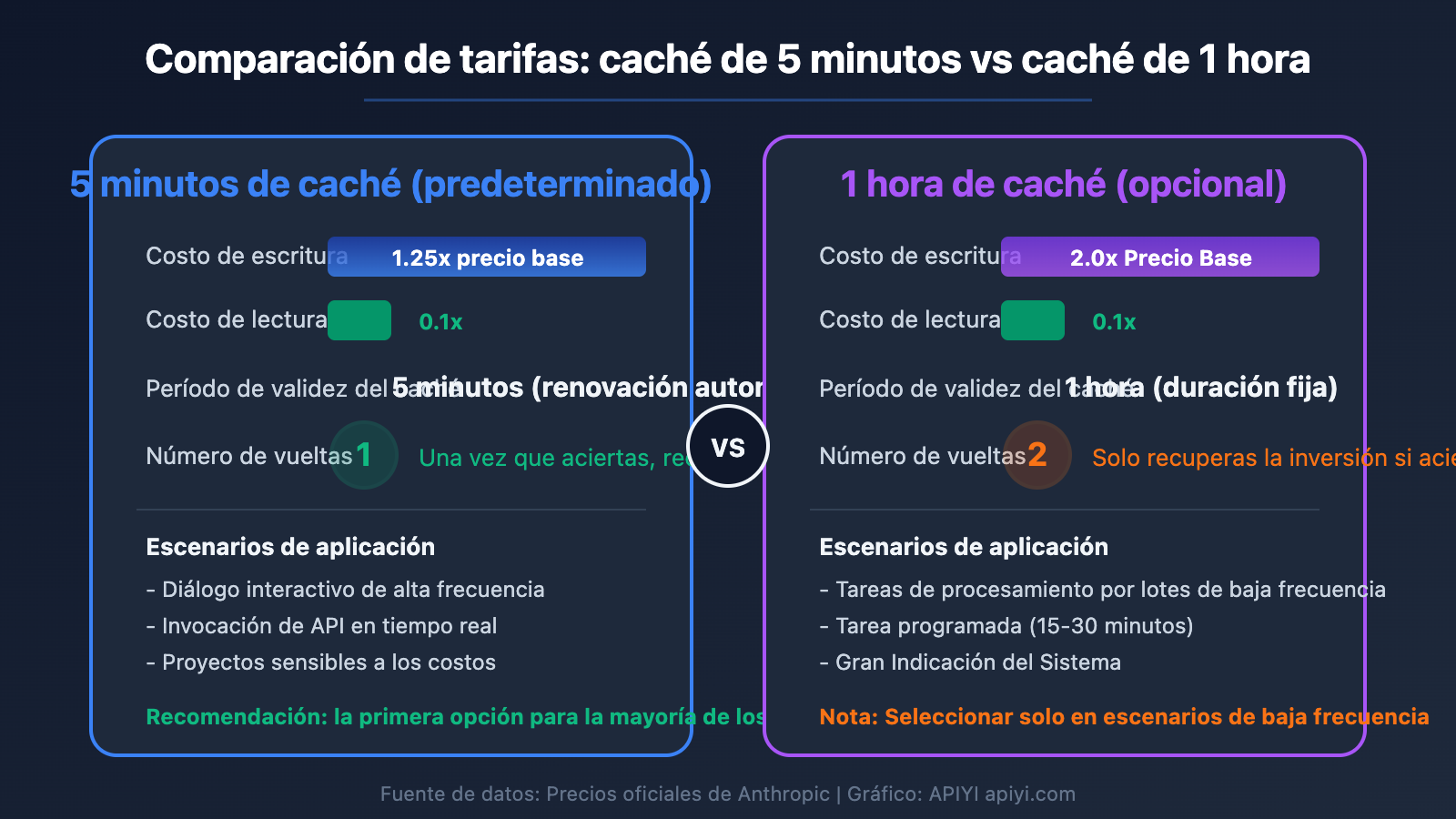

Comparación de costos de caché de Claude: 5 minutos vs 1 hora

Diferencia de precios entre caché de 5 minutos y 1 hora

A continuación se muestran los precios específicos de escritura para caché de 5 minutos y 1 hora, utilizando varios modelos como ejemplo:

| Modelo | Precio base de entrada | Escritura de caché 5 min (×1.25) | Escritura de caché 1 hora (×2.0) | Lectura de caché (×0.1) |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00/MTok | $6.25/MTok | $10.00/MTok | $0.50/MTok |

| Claude Sonnet 4.6 | $3.00/MTok | $3.75/MTok | $6.00/MTok | $0.30/MTok |

| Claude Haiku 4.5 | $1.00/MTok | $1.25/MTok | $2.00/MTok | $0.10/MTok |

Estrategia de selección de TTL para la facturación de caché de Claude

La caché de 5 minutos y la de 1 hora no son opciones mutuamente excluyentes. Puedes elegir de manera flexible según el escenario real, e incluso mezclarlas en una misma solicitud.

Casos de uso para caché de 5 minutos:

- Llamadas API de alta frecuencia (varias solicitudes por minuto), donde la caché se actualiza continuamente dentro de 5 minutos

- Escenarios de diálogo interactivo, donde el usuario envía mensajes continuamente y la caché se renueva automáticamente

- Proyectos sensibles a los costos, con tarifas de escritura más bajas

Casos de uso para caché de 1 hora:

- Tareas de procesamiento por lotes, donde un conjunto de datos puede ejecutarse solo cada varias decenas de minutos

- System Prompt grande, con alto costo de escritura, donde se desea que la caché dure más tiempo

- Escenarios de tareas programadas, que se ejecutan cada 15-30 minutos

Mecanismo importante: La caché de 5 minutos actualiza automáticamente su TTL cada vez que se acierta, lo que equivale a una "renovación". Por lo tanto, si tu frecuencia de llamadas es lo suficientemente alta (al menos una solicitud cada 5 minutos), la caché puede permanecer activa indefinidamente, sin necesidad de elegir la caché de 1 hora.

🎯 Recomendación técnica: En la mayoría de los escenarios, la caché de 5 minutos es suficiente. Al utilizar la plataforma APIYI apiyi.com para llamar a la API de Claude, las reglas de facturación de caché son completamente consistentes con las oficiales, y además admite la gestión de estrategias de caché para múltiples modelos a través de una interfaz unificada.

Uso mixto de TTL en la facturación de caché de Claude

Anthropic permite utilizar simultáneamente dos controles de caché (1 hora y 5 minutos) en una misma solicitud, pero con una restricción clave:

Los TTL deben ordenarse de mayor a menor: La marca de caché de 1 hora debe aparecer antes que la marca de caché de 5 minutos.

En la práctica, puedes configurar el System Prompt (que cambia con poca frecuencia) como caché de 1 hora, y los ejemplos Few-shot (que cambian con mayor frecuencia) como caché de 5 minutos:

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com" # Llamada a través de APIYI

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Eres un asistente profesional de documentación técnica...(System Prompt extenso)...",

"cache_control": {"type": "ephemeral", "ttl": "3600"} # Caché de 1 hora

}

],

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "A continuación se muestra la documentación de referencia...(contexto extenso)...",

"cache_control": {"type": "ephemeral"} # Caché predeterminada de 5 minutos

},

{

"type": "text",

"text": "Basándote en el documento anterior, responde: ¿Qué es Prompt Caching?"

}

]

}

]

)

Ver código para verificar el estado de aciertos de caché

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com"

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Tu contenido de System Prompt (debe tener >= 1024 tokens para activar la caché)",

"cache_control": {"type": "ephemeral"}

}

],

messages=[{"role": "user", "content": "Hola"}]

)

# Verificar el uso de caché

usage = response.usage

print(f"Tokens de entrada: {usage.input_tokens}")

print(f"Tokens de escritura en caché: {usage.cache_creation_input_tokens}")

print(f"Tokens de acierto en caché: {usage.cache_read_input_tokens}")

# Determinar el estado de la caché

if usage.cache_read_input_tokens > 0:

print("¡Acierto en caché! Se ahorró un 90% del costo de entrada")

elif usage.cache_creation_input_tokens > 0:

print("Primera escritura en caché, las solicitudes posteriores acertarán en caché")

💡 Nota: Existe un requisito mínimo de tokens para la caché. Claude Opus 4.6 requiere al menos 1024 tokens, y Sonnet 4.6 y Haiku 4.5 también requieren al menos 1024 tokens. El contenido por debajo de este umbral no se almacenará en caché.

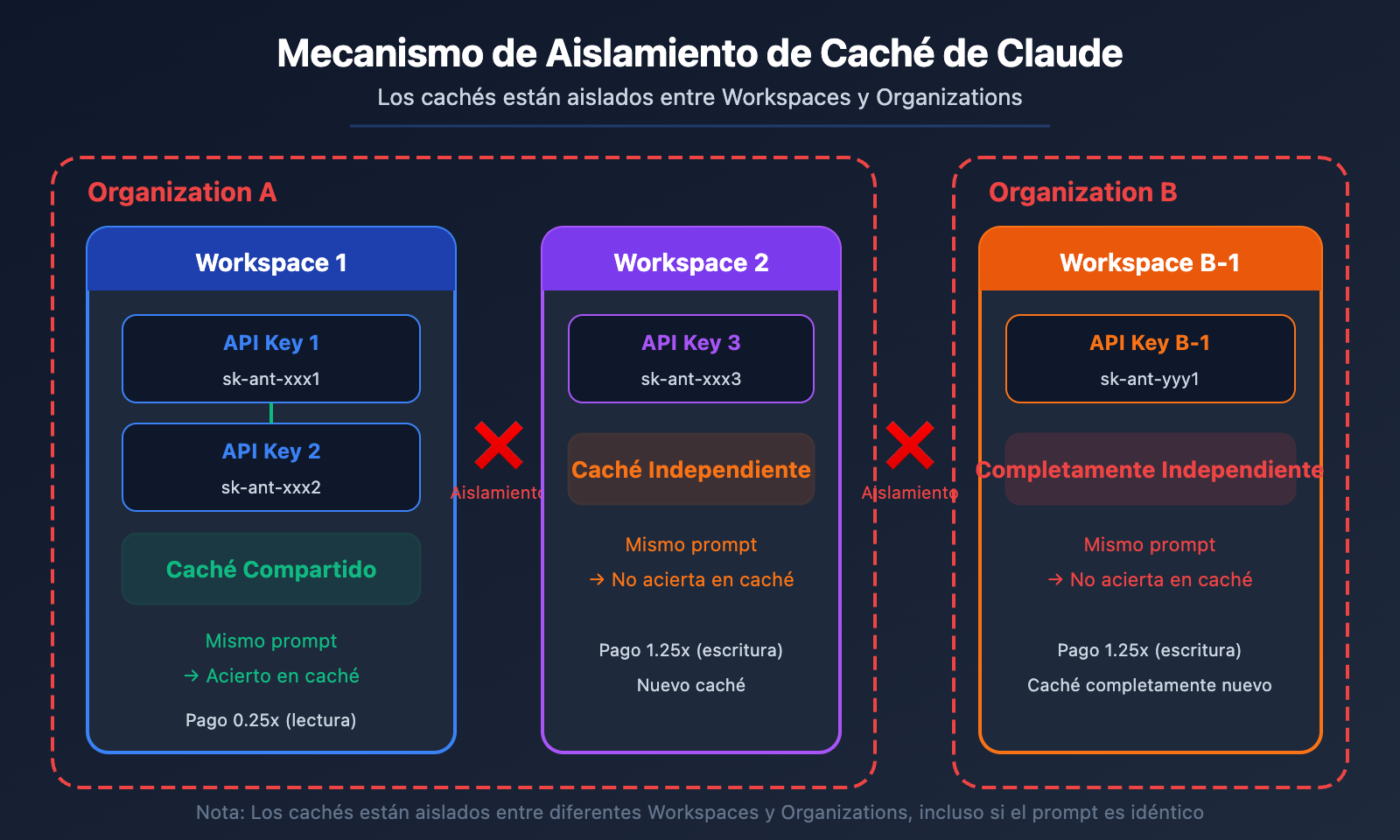

Facturación de caché de Claude: Mecanismo de aislamiento entre cuentas

Esta es la pregunta que más preocupa a muchos desarrolladores: ¿Puede la cuenta B acceder al caché escrito por la cuenta A?

Reglas principales del aislamiento de caché de Claude

La respuesta es clara: No. El caché está completamente aislado entre diferentes organizaciones (Organization).

A partir del 5 de febrero de 2026, Anthropic ha refinado aún más la granularidad del aislamiento de caché, pasando del "nivel de organización" al "nivel de Workspace". Esto significa:

| Escenario | ¿Se comparte el caché? | Explicación |

|---|---|---|

| Diferentes claves API dentro del mismo Workspace | ✅ Se comparte | Dentro del mismo espacio de trabajo, el mismo prompt activará el caché |

| Diferentes Workspaces dentro de la misma Organization | ❌ No se comparte | Aunque estén en la misma organización, los espacios de trabajo están aislados |

| Cuentas de diferentes Organizations | ❌ No se comparte en absoluto | Completamente independientes, incluso si el prompt es 100% idéntico |

| Diferentes usuarios a través de plataformas proxy como APIYI | ❌ No se comparte | Las solicitudes de diferentes usuarios se enrutan a credenciales ascendentes distintas |

Impacto práctico del aislamiento de caché de Claude

Análisis de escenario: Supongamos que tienes dos cuentas de API de Claude (pertenecientes a diferentes Organizations) ejecutando simultáneamente un lote de tareas de procesamiento de datos.

- La cuenta A envía una solicitud, activa la escritura en caché y paga la tarifa de escritura de 1.25x

- La cuenta B envía exactamente el mismo prompt dentro de 5 minutos

- Resultado: La cuenta B no accederá al caché de la cuenta A, B también activará la escritura en caché y pagará nuevamente 1.25x

Este diseño se basa en consideraciones de seguridad y privacidad: el contenido de la caché puede incluir System Prompts sensibles o datos comerciales, y compartirlos entre organizaciones conllevaría riesgos de fuga de datos.

Estrategia de optimización: Si necesitas que varios servicios compartan caché para reducir costos, debes colocar sus claves API en el mismo Workspace, en lugar de usar cuentas de diferentes Organizations.

🎯 Recomendación práctica: En la plataforma APIYI (apiyi.com), las solicitudes de cada usuario se procesan a través de un canal ascendente unificado. Si necesitas compartir caché entre múltiples proyectos, se recomienda planificar adecuadamente la estructura de Workspaces en Anthropic Console, colocando los proyectos que requieran compartir caché dentro del mismo Workspace.

Condiciones para el acierto en caché de Claude

Además del aislamiento por Workspace, hay otra condición clave para el acierto en caché: el prompt debe ser 100% idéntico.

La clave de caché (Cache Key) se genera mediante un hash criptográfico del contenido del prompt. El alcance de la coincidencia incluye:

tools(definiciones de herramientas)system(indicación del sistema)messages(historial de mensajes)

Estas tres partes se concatenan en orden, hasta la posición marcada por cache_control. Si hay cualquier diferencia de un solo carácter (incluyendo espacios, saltos de línea), no se producirá un acierto en caché.

Comparación de tarificación de caché de Claude: AWS Bedrock vs Anthropic oficial

Diferencias en la tarificación de caché entre AWS Bedrock y la API oficial de Anthropic

Muchas empresas utilizan Claude a través de AWS Bedrock, cuya tarificación de caché presenta las siguientes diferencias con la API oficial de Anthropic:

| Dimensión de comparación | API oficial de Anthropic | AWS Bedrock |

|---|---|---|

| Escritura en caché (5 minutos) | 1.25x precio base | 1.25x precio base |

| Escritura en caché (1 hora) | 2.0x precio base | 2.0x precio base (solo algunos modelos) |

| Lectura de caché | 0.1x precio base | 0.1x precio base |

| Modelos con soporte de caché de 1 hora | Todos los modelos compatibles con caché | Solo Haiku 4.5, Sonnet 4.5, Opus 4.5 |

| Nivel de aislamiento de caché | Nivel de Workspace | Nivel de Organización (Cuenta AWS) |

| Precios regionales | Precio global unificado | Prima de ~10% en endpoints regionales |

| Precio base de entrada | Precio estándar oficial | Básicamente igual al oficial |

Diferencias clave en la tarificación de caché de Claude en AWS Bedrock

Diferencia 1: Alcance de soporte de modelos para caché de 1 hora

Hasta enero de 2026, AWS Bedrock solo admite TTL de caché de 1 hora para Claude Haiku 4.5, Sonnet 4.5 y Opus 4.5. Los modelos más recientes, Opus 4.6 y Sonnet 4.6, pueden no tener aún la opción de caché de 1 hora en Bedrock. Si necesitas la combinación del modelo más reciente + caché de 1 hora, se recomienda usar directamente la API oficial de Anthropic.

Diferencia 2: Granularidad del aislamiento de caché

AWS Bedrock mantiene el aislamiento de caché a nivel de Organización (es decir, a nivel de Cuenta AWS), mientras que la API oficial de Anthropic ya se ha refinado al nivel de Workspace. Esto significa que en Bedrock, todas las llamadas bajo la misma cuenta de AWS pueden compartir caché, una granularidad más gruesa que la API oficial.

Diferencia 3: Diferencias de precios regionales

Los endpoints regionales de AWS Bedrock (como us-east-1, eu-west-1) pueden tener una prima de precio de aproximadamente un 10% en comparación con el endpoint global. Esta prima también se reflejará en los costos de escritura y lectura de caché.

💰 Consejo de optimización de costos: Si utilizas principalmente la API de Claude y necesitas un control detallado de la estrategia de caché, llamar a la API nativa de Anthropic a través de APIYI (apiyi.com) es una opción más flexible. La plataforma admite la transmisión completa de parámetros de control de caché y ofrece precios más ventajosos.

Preguntas frecuentes

P1: ¿Se puede elegir libremente entre caché de 5 minutos y de 1 hora?

Sí. Se controla mediante el parámetro cache_control en la solicitud. Por defecto, si no se especifica TTL, es caché de 5 minutos; si se establece explícitamente "ttl": "3600", es caché de 1 hora. También puedes mezclar ambos TTL en la misma solicitud, pero debes asegurarte de que el contenido de caché de 1 hora esté antes que el de 5 minutos. En la mayoría de los escenarios, la caché de 5 minutos + renovación automática es suficiente, no es necesario pagar extra por la opción de 1 hora.

P2: ¿Pueden dos cuentas diferentes de la API de Claude compartir aciertos de caché?

No. El caché está aislado a nivel de Workspace (después de febrero de 2026). Si dos cuentas pertenecen a diferentes Organizaciones, el caché es completamente independiente. Si pertenecen a la misma Organización pero a diferentes Workspaces, tampoco pueden compartirlo. Solo cuando se usan diferentes claves API dentro del mismo Workspace, el mismo prompt puede dar en el mismo caché. Para compartir caché y reducir costos, es necesario colocar múltiples claves API dentro del mismo Workspace.

P3: ¿Cómo se determina si hubo un acierto en la caché?

El campo usage en la respuesta de la API incluirá dos métricas: cache_creation_input_tokens y cache_read_input_tokens. Si cache_read_input_tokens > 0, significa que hubo un acierto en la caché. Cuando se llama a través de la plataforma APIYI (apiyi.com), estos campos se devuelven tal cual, permitiéndote monitorear directamente la tasa de aciertos de caché para optimizar costos.

P4: ¿Hay un requisito mínimo de tokens para el contenido de la caché?

Sí. El umbral mínimo de caché para todos los modelos Claude es de 1024 tokens. Si tu System Prompt o el contenido del contexto tiene menos de 1024 tokens, la caché no se activará. Se recomienda usar indicaciones de sistema extensas, ejemplos de Few-shot o documentos de referencia como contenido de caché para aprovechar al máximo el mecanismo de caché y reducir costos.

Resumen

Los puntos clave de la facturación de caché de la API de Claude:

- Escritura en caché de 5 minutos a 1.25x, escritura de 1 hora a 2.0x: En la mayoría de los escenarios, basta con el caché de 5 minutos. En llamadas de alta frecuencia, el caché se renueva automáticamente, logrando un efecto similar al de un caché de larga duración.

- Lectura de caché a solo 0.1x: Al acertar en el caché, se ahorra un 90% del costo de entrada. Con el caché de 5 minutos, un solo acierto ya cubre el costo.

- Aislamiento a nivel de Workspace: El caché no se puede compartir entre diferentes organizaciones o Workspaces. Es necesario planificar la estructura del Workspace de manera adecuada.

Para los desarrolladores que necesitan realizar numerosas llamadas a la API de Claude, el uso estratégico del caché puede reducir significativamente los costos. Se recomienda realizar las llamadas a la API de Claude a través de la plataforma APIYI apiyi.com, que admite la transmisión completa de parámetros de caché, la gestión unificada de interfaces y ofrece créditos de prueba gratuitos para ayudarte a validar la efectividad de tu estrategia de caché.

Referencias

-

Documentación oficial de Anthropic Prompt Caching: Explicación completa de la funcionalidad de caché de la API de Claude.

- Enlace:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Descripción: Incluye parámetros clave como las tasas de precios del caché, configuración de TTL y requisitos mínimos de tokens.

- Enlace:

-

Página de precios de Anthropic API: Los precios más recientes de todos los modelos Claude.

- Enlace:

platform.claude.com/docs/en/about-claude/pricing - Descripción: Incluye los precios base de entrada/salida y la facturación detallada para operaciones de caché.

- Enlace:

-

Documentación de AWS Bedrock Prompt Caching: Guía para usar el caché de Claude en la plataforma AWS.

- Enlace:

docs.aws.amazon.com/bedrock/latest/userguide/prompt-caching.html - Descripción: Métodos de configuración de caché específicos de Bedrock y lista de modelos compatibles.

- Enlace:

-

Anuncio de caché de 1 hora en AWS Bedrock: Comunicado sobre el lanzamiento de la funcionalidad de caché con TTL de 1 hora.

- Enlace:

aws.amazon.com/about-aws/whats-new/2026/01/amazon-bedrock-one-hour-duration-prompt-caching/ - Descripción: Alcance de modelos compatibles con caché de 1 hora en Bedrock y formas de uso.

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Bienvenidos a discutir temas relacionados con la facturación del caché de Claude en la sección de comentarios. Para más consejos sobre el uso de APIs, visita el centro de documentación de APIYI en docs.apiyi.com.