Catatan Penulis: Analisis mendalam mekanisme penagihan cache Claude API, membandingkan perbedaan harga penulisan cache 5 menit vs 1 jam, menjawab pertanyaan mengenai hit cache lintas akun, dan membandingkan perbedaan penagihan cache antara AWS Bedrock dan API resmi Anthropic.

Prompt Caching di Claude API adalah cara inti untuk menurunkan biaya pemanggilan API, tetapi banyak pengembang yang masih bingung dengan detail penagihan cache: Bagaimana memilih antara cache 5 menit dan cache 1 jam? Bisakah cache dibagikan lintas akun? Apa perbedaan penagihan cache antara AWS Bedrock dan API resmi?

Nilai Inti: Setelah membaca artikel ini, Anda akan sepenuhnya memahami 3 mekanisme inti penagihan cache Claude API, menguasai metode pemilihan strategi cache yang optimal, dan menghindari pemborosan biaya yang tidak perlu.

Poin Inti Penagihan Cache Claude API

| Poin | Penjelasan | Nilai |

|---|---|---|

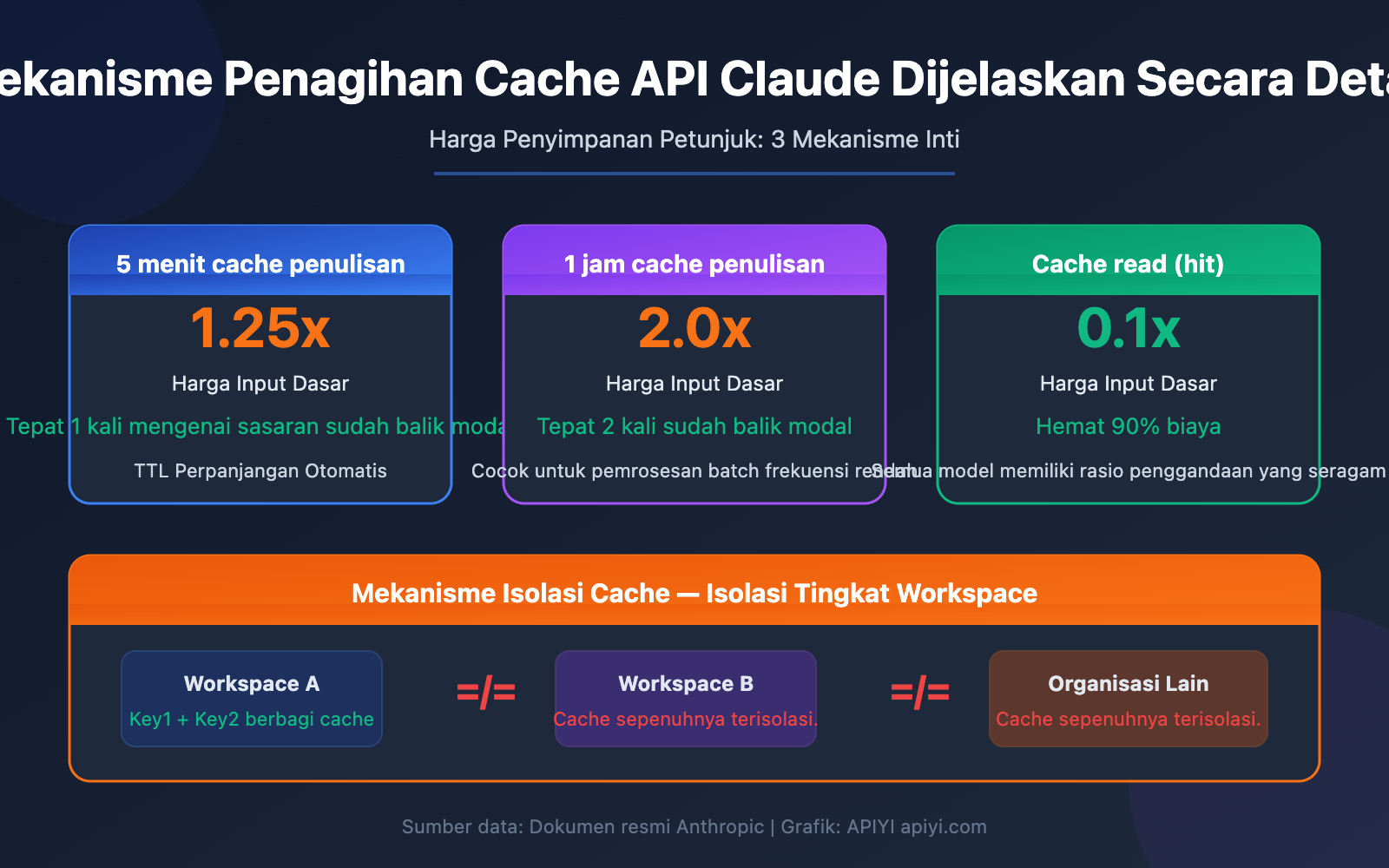

| Penulisan Cache 5 Menit | Biaya penulisan = Harga input dasar × 1.25 | Biaya terendah, cocok untuk pemanggilan frekuensi tinggi |

| Penulisan Cache 1 Jam | Biaya penulisan = Harga input dasar × 2.0 | TTL lebih lama, cocok untuk cache jarang tapi besar |

| Pembacaan Cache (Hit) | Biaya pembacaan = Harga input dasar × 0.1 | Biaya turun 90% setelah hit |

| Isolasi Cache | Isolasi tingkat Workspace, organisasi berbeda terisolasi sepenuhnya | Cache tidak dapat dibagikan lintas akun |

Rasio Dasar Penagihan Cache Claude

Prompt Caching di Claude API menggunakan sistem penagihan rasio yang seragam. Terlepas dari model yang digunakan (Opus 4.6, Sonnet 4.6, atau Haiku 4.5), aturan rasio untuk operasi cache sepenuhnya konsisten:

- Penulisan Cache (TTL 5 menit): Harga input dasar × 1.25

- Penulisan Cache (TTL 1 jam): Harga input dasar × 2.0

- Pembacaan Cache (Hit): Harga input dasar × 0.1

Artinya, setiap kali cache di-hit, Anda hanya perlu membayar 10% dari harga input standar. Sebagai contoh, dengan Claude Sonnet 4.6 yang memiliki harga input standar $3/MTok, harga hit cache hanya $0.3/MTok, menghemat 90% biaya input.

Perhitungan Balik Modal Penagihan Cache Claude

Memahami keuntungan biaya dari cache sangat penting. Penulisan cache memiliki biaya tambahan, tetapi pembacaan cache sangat murah. Kuncinya adalah—berapa kali cache harus di-hit sebelum mulai "balik modal"?

- Cache 5 menit: Penulisan 1.25x + Pembacaan 0.1x = Setelah penulisan pertama, cukup di-hit 1 kali untuk balik modal (karena pembacaan normal adalah 1x, sedangkan pembacaan cache 0.1x, hemat 0.9x > tambahan bayar 0.25x)

- Cache 1 jam: Penulisan 2.0x + Pembacaan 0.1x = Setelah penulisan pertama, perlu di-hit 2 kali untuk balik modal (tambahan bayar 1.0x, setiap hit hemat 0.9x)

Jadi, cache 5 menit hampir selalu pilihan yang "menguntungkan", sedangkan cache 1 jam perlu dipastikan di-hit setidaknya 2 kali dalam masa berlaku.

Perbandingan Biaya Cache Claude: 5 Menit vs 1 Jam

Perbedaan Harga Cache 5 Menit vs 1 Jam

Berikut adalah harga spesifik untuk penulisan cache 5 menit dan 1 jam untuk berbagai model:

| Model | Harga Input Dasar | Penulisan Cache 5 Menit (×1.25) | Penulisan Cache 1 Jam (×2.0) | Pembacaan Cache (×0.1) |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00/MTok | $6.25/MTok | $10.00/MTok | $0.50/MTok |

| Claude Sonnet 4.6 | $3.00/MTok | $3.75/MTok | $6.00/MTok | $0.30/MTok |

| Claude Haiku 4.5 | $1.00/MTok | $1.25/MTok | $2.00/MTok | $0.10/MTok |

Strategi Pemilihan TTL untuk Penagihan Cache Claude

Cache 5 menit dan 1 jam bukanlah pilihan yang saling eksklusif. Kamu bisa memilih secara fleksibel berdasarkan skenario aktual, bahkan mencampur keduanya dalam satu permintaan yang sama.

Skenario yang cocok untuk Cache 5 Menit:

- Panggilan API frekuensi tinggi (beberapa kali per menit), cache terus diperbarui dalam 5 menit

- Skenario percakapan interaktif, pengguna terus mengirim pesan, cache diperpanjang otomatis

- Proyek yang sensitif terhadap biaya, biaya penulisan lebih rendah

Skenario yang cocok untuk Cache 1 Jam:

- Tugas pemrosesan batch, satu set data mungkin diproses setiap beberapa puluh menit sekali

- System Prompt yang besar, biaya penulisan tinggi, ingin cache bertahan lebih lama

- Skenario tugas terjadwal, dieksekusi setiap 15-30 menit sekali

Mekanisme penting: Cache 5 menit secara otomatis akan menyegarkan TTL setiap kali diakses (hit), sama dengan "perpanjangan". Jadi jika frekuensi panggilanmu cukup tinggi (setidaknya ada satu permintaan dalam 5 menit), cache sebenarnya bisa bertahan selamanya, tidak perlu memilih cache 1 jam.

🎯 Saran teknis: Cache 5 menit sudah cukup untuk sebagian besar skenario. Saat memanggil API Claude melalui platform APIYI apiyi.com, aturan penagihan cache sepenuhnya konsisten dengan resmi, dan mendukung manajemen strategi cache untuk berbagai model melalui satu antarmuka.

Penggunaan TTL Campuran dalam Penagihan Cache Claude

Anthropic mengizinkan penggunaan dua kontrol cache (1 jam dan 5 menit) dalam satu permintaan yang sama, tetapi ada satu batasan penting:

TTL diurutkan dari yang terpanjang: Tanda cache 1 jam harus muncul sebelum tanda cache 5 menit.

Dalam penerapan praktis, kamu bisa mengatur System Prompt yang jarang berubah sebagai cache 1 jam, dan contoh Few-shot yang berubah lebih sering sebagai cache 5 menit:

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com" # Panggil melalui APIYI

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Kamu adalah asisten dokumentasi teknis yang profesional...(banyak petunjuk sistem)...",

"cache_control": {"type": "ephemeral", "ttl": "3600"} # Cache 1 jam

}

],

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "Berikut adalah dokumen referensi...(banyak konteks)...",

"cache_control": {"type": "ephemeral"} # Cache 5 menit default

},

{

"type": "text",

"text": "Tolong jawab berdasarkan dokumen di atas: Apa itu Prompt Caching?"

}

]

}

]

)

Lihat kode pemeriksaan status hit cache

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com"

)

response = client.messages.create(

model="claude-sonnet-4-6-20260320",

max_tokens=1024,

system=[

{

"type": "text",

"text": "Isi petunjuk sistem Anda (perlu >= 1024 tokens untuk memicu cache)",

"cache_control": {"type": "ephemeral"}

}

],

messages=[{"role": "user", "content": "Halo"}]

)

# Periksa penggunaan cache

usage = response.usage

print(f"Input tokens: {usage.input_tokens}")

print(f"Token input pembuatan cache: {usage.cache_creation_input_tokens}")

print(f"Token input pembacaan cache: {usage.cache_read_input_tokens}")

# Tentukan status cache

if usage.cache_read_input_tokens > 0:

print("Cache hit! Menghemat 90% biaya input")

elif usage.cache_creation_input_tokens > 0:

print("Cache ditulis pertama kali, permintaan berikutnya akan hit cache")

💡 Perhatian: Ada persyaratan jumlah token minimum untuk cache. Claude Opus 4.6 memerlukan setidaknya 1024 tokens, Sonnet 4.6 dan Haiku 4.5 juga memerlukan setidaknya 1024 tokens. Konten di bawah ambang batas ini tidak akan di-cache.

Claude 缓存计费: Mekanisme Isolasi Cache Antar Akun

Ini adalah pertanyaan yang paling sering ditanyakan pengembang: Cache yang ditulis oleh akun A, apakah bisa diakses oleh akun B?

Aturan Inti Isolasi Cache Claude

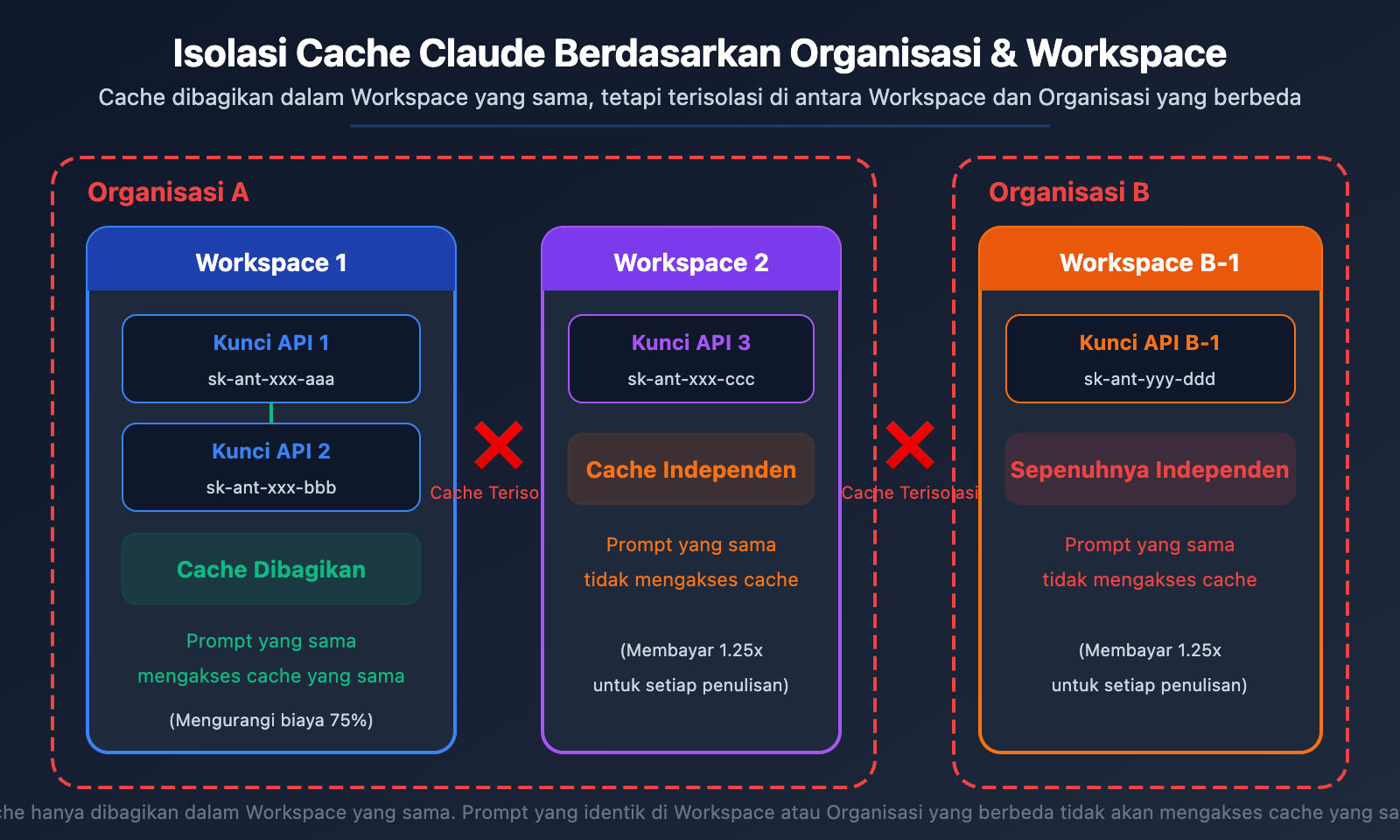

Jawabannya jelas: Tidak bisa. Cache sepenuhnya terisolasi di antara organisasi (Organization) yang berbeda.

Sejak 5 Februari 2026, Anthropic telah memperhalus granularitas isolasi cache dari tingkat "organisasi" menjadi tingkat "Workspace". Artinya:

| Skenario | Apakah Cache Dibagikan? | Penjelasan |

|---|---|---|

| Kunci API berbeda dalam Workspace yang sama | ✅ Dapat dibagikan | Dalam ruang kerja yang sama, prompt yang identik akan mengakses cache yang sama |

| Workspace berbeda dalam Organization yang sama | ❌ Tidak dibagikan | Meskipun dalam organisasi yang sama, cache antar workspace tetap terisolasi |

| Akun dari Organization yang berbeda | ❌ Sama sekali tidak dibagikan | Sepenuhnya independen, bahkan jika promptnya 100% sama |

| Pengguna berbeda melalui platform proksi seperti APIYI | ❌ Tidak dibagikan | Permintaan dari pengguna berbeda akan dirutekan ke kredensial upstream yang berbeda |

Dampak Nyata Isolasi Cache Claude

Analisis Skenario: Misalkan kamu memiliki dua akun Claude API (milik Organization berbeda) dan menjalankan tugas pemrosesan data yang sama secara bersamaan.

- Akun A mengirim permintaan, memicu penulisan cache, membayar biaya penulisan 1.25x

- Akun B mengirim prompt yang persis sama dalam 5 menit

- Hasil: Akun B tidak akan mengakses cache dari akun A. Akun B juga akan memicu penulisan cache dan membayar 1.25x lagi

Ini adalah desain yang didasarkan pada pertimbangan keamanan dan privasi — konten cache mungkin berisi System Prompt sensitif atau data bisnis. Berbagi cache lintas organisasi dapat menimbulkan risiko kebocoran data.

Strategi Optimasi: Jika kamu memerlukan beberapa layanan untuk berbagi cache guna mengurangi biaya, kamu harus menempatkan Kunci API mereka di bawah Workspace yang sama, bukan menggunakan akun Organization yang berbeda.

🎯 Saran Praktis: Di platform APIYI apiyi.com, permintaan setiap pengguna akan diproses melalui saluran upstream yang terpadu. Jika kamu perlu berbagi cache di antara beberapa proyek, disarankan untuk merencanakan struktur Workspace di Anthropic Console dengan baik, menempatkan proyek-proyek yang perlu berbagi cache dalam Workspace yang sama.

Syarat Cache Claude Dapat Diakses

Selain isolasi Workspace, ada satu syarat kunci agar cache dapat diakses — prompt harus 100% identik.

Kunci cache (Cache Key) dibuat dengan menghasilkan hash kriptografis dari konten prompt. Cakupan pencocokan mencakup:

tools(definisi alat)system(petunjuk sistem)messages(riwayat pesan)

Ketiga bagian di atas digabungkan secara berurutan, hingga posisi penanda cache_control. Jika ada satu karakter pun yang berbeda (termasuk spasi, karakter baris baru), cache tidak akan dapat diakses.

Perbandingan Biaya Cache Claude: AWS Bedrock vs Anthropic Resmi

Perbedaan Biaya Cache antara AWS Bedrock dan API Anthropic Resmi

Banyak perusahaan menggunakan Claude melalui AWS Bedrock, dan skema biaya caching-nya memiliki perbedaan berikut dengan API resmi Anthropic:

| Dimensi Perbandingan | API Resmi Anthropic | AWS Bedrock |

|---|---|---|

| Penulisan Cache 5 menit | 1.25x harga dasar | 1.25x harga dasar |

| Penulisan Cache 1 jam | 2.0x harga dasar | 2.0x harga dasar (hanya model tertentu) |

| Pembacaan Cache | 0.1x harga dasar | 0.1x harga dasar |

| Model yang mendukung cache 1 jam | Semua model yang mendukung cache | Hanya Haiku 4.5, Sonnet 4.5, Opus 4.5 |

| Tingkat isolasi cache | Tingkat Workspace | Tingkat Organization (AWS Account) |

| Harga regional | Harga global seragam | Premium endpoint regional ~10% |

| Harga input dasar | Harga standar resmi | Pada dasarnya sama dengan harga resmi |

Perbedaan Kunci dalam Biaya Cache Claude AWS Bedrock

Perbedaan Pertama: Cakupan Dukungan Model untuk Cache 1 Jam

Hingga Januari 2026, AWS Bedrock hanya mendukung TTL cache 1 jam untuk Claude Haiku 4.5, Sonnet 4.5, dan Opus 4.5. Model terbaru seperti Opus 4.6 dan Sonnet 4.6 mungkin belum mendukung opsi cache 1 jam di Bedrock. Jika Anda membutuhkan kombinasi model terbaru + cache 1 jam, disarankan untuk langsung menggunakan API resmi Anthropic.

Perbedaan Kedua: Granularitas Isolasi Cache

AWS Bedrock mempertahankan isolasi cache di tingkat Organization (yaitu tingkat AWS Account), sedangkan API resmi Anthropic telah diperhalus hingga tingkat Workspace. Artinya, di Bedrock, semua pemanggilan di bawah akun AWS yang sama dapat berbagi cache, dengan granularitas yang lebih kasar dibandingkan API resmi.

Perbedaan Ketiga: Variasi Harga Regional

Endpoint regional AWS Bedrock (seperti us-east-1, eu-west-1) mungkin memiliki premium harga sekitar 10% dibandingkan endpoint global. Premium ini juga akan tercermin dalam biaya penulisan dan pembacaan cache.

💰 Saran Optimasi Biaya: Jika Anda terutama menggunakan Claude API dan memiliki kebutuhan kontrol yang lebih halus terhadap strategi cache, memanggil API native Anthropic melalui APIYI apiyi.com adalah pilihan yang lebih fleksibel. Platform ini mendukung pengiriman parameter kontrol cache yang lengkap dan menawarkan harga yang lebih kompetitif.

Pertanyaan Umum

Q1: Bisakah cache 5 menit dan 1 jam dipilih secara mandiri?

Bisa. Kontrol dengan mengatur parameter cache_control dalam permintaan. Secara default, jika TTL tidak ditentukan, akan menggunakan cache 5 menit. Atur secara eksplisit "ttl": "3600" untuk cache 1 jam. Anda juga dapat mencampur kedua TTL dalam satu permintaan yang sama, tetapi pastikan konten cache 1 jam ditempatkan sebelum cache 5 menit. Dalam kebanyakan skenario, cache 5 menit + perpanjangan otomatis sudah cukup, tidak perlu membayar ekstra untuk memilih cache 1 jam.

Q2: Bisakah dua akun Claude API yang berbeda berbagi hit cache?

Tidak bisa. Cache diisolasi pada tingkat Workspace (setelah Februari 2026). Jika dua akun milik Organization yang berbeda, cache sepenuhnya terpisah. Jika milik Organization yang sama tetapi Workspace berbeda, juga tidak bisa berbagi. Hanya ketika menggunakan kunci API yang berbeda di dalam Workspace yang sama, prompt yang sama dapat mengenai cache yang sama. Untuk berbagi cache dan mengurangi biaya, Anda perlu menempatkan beberapa kunci API di dalam Workspace yang sama.

Q3: Bagaimana cara mengetahui apakah cache berhasil di-hit?

Bidang usage dalam respons API akan berisi dua metrik: cache_creation_input_tokens dan cache_read_input_tokens. Jika cache_read_input_tokens > 0, itu berarti cache berhasil di-hit. Saat memanggil melalui platform APIYI apiyi.com, bidang-bidang ini akan dikembalikan apa adanya, sehingga Anda dapat langsung memantau tingkat hit cache untuk mengoptimalkan biaya.

Q4: Apakah ada persyaratan jumlah token minimum untuk konten cache?

Ada. Ambang batas minimum cache untuk semua model Claude adalah 1024 token. Jika System Prompt atau konten konteks Anda kurang dari 1024 token, cache tidak akan berlaku. Disarankan untuk menggunakan petunjuk sistem dalam jumlah besar, contoh Few-shot, atau dokumen referensi sebagai konten cache, untuk memanfaatkan sepenuhnya mekanisme cache guna mengurangi biaya.

Ringkasan

Inti dari penagihan cache Claude API:

- Cache 5 menit ditulis dengan 1.25x, cache 1 jam ditulis dengan 2.0x: Sebagian besar skenario cukup menggunakan cache 5 menit, pada pemanggilan frekuensi tinggi cache akan diperpanjang otomatis, efeknya setara dengan cache jangka panjang

- Pembacaan cache hanya 0.1x: Setelah cache terpakai, menghemat 90% biaya input, cache 5 menit cukup terpakai 1 kali untuk balik modal

- Cache diisolasi pada tingkat Workspace: Cache tidak dapat dibagikan antar organisasi atau antar Workspace yang berbeda, perlu perencanaan struktur Workspace yang tepat

Bagi pengembang yang membutuhkan pemanggilan Claude API dalam jumlah besar, penggunaan strategi cache yang tepat dapat menurunkan biaya secara signifikan. Direkomendasikan untuk melakukan pemanggilan Claude API melalui platform APIYI apiyi.com, yang mendukung penerusan parameter cache lengkap, manajemen antarmuka terpadu, serta menyediakan kredit uji coba gratis untuk membantu Anda memverifikasi efektivitas strategi cache.

Referensi

-

Dokumentasi Resmi Anthropic Prompt Caching: Penjelasan lengkap fitur cache Claude API

- Tautan:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Keterangan: Memuat parameter inti seperti rasio harga cache, pengaturan TTL, persyaratan token minimum

- Tautan:

-

Halaman Harga Anthropic API: Harga terbaru semua model Claude

- Tautan:

platform.claude.com/docs/en/about-claude/pricing - Keterangan: Memuat harga input/output dasar serta rincian penagihan untuk operasi cache

- Tautan:

-

Dokumentasi AWS Bedrock Prompt Caching: Panduan penggunaan cache Claude di platform AWS

- Tautan:

docs.aws.amazon.com/bedrock/latest/userguide/prompt-caching.html - Keterangan: Konfigurasi cache khusus Bedrock dan daftar model yang didukung

- Tautan:

-

Pengumuman Cache 1 Jam AWS Bedrock: Penjelasan rilis fitur TTL cache 1 jam

- Tautan:

aws.amazon.com/about-aws/whats-new/2026/01/amazon-bedrock-one-hour-duration-prompt-caching/ - Keterangan: Cakupan model dan cara penggunaan cache 1 jam yang didukung Bedrock

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Selamat berdiskusi tentang masalah penagihan cache Claude di bagian komentar, untuk tips penggunaan API lainnya dapat mengunjungi pusat dokumentasi APIYI docs.apiyi.com