La comparativa entre GPT-5.5 y Claude Opus 4.7 es uno de los temas que más interesan a los desarrolladores durante la primera mitad de 2026.

Ninguno de los dos es un simple modelo de chat.

GPT-5.5 pone un mayor énfasis en la programación mediante agentes (agentic coding), el uso de computadoras, el trabajo de conocimiento y el análisis científico.

Por su parte, Claude Opus 4.7 destaca en el razonamiento complejo, tareas de agentes a largo plazo, visión de alta resolución, capacidades de memoria y un seguimiento de instrucciones mucho más estricto.

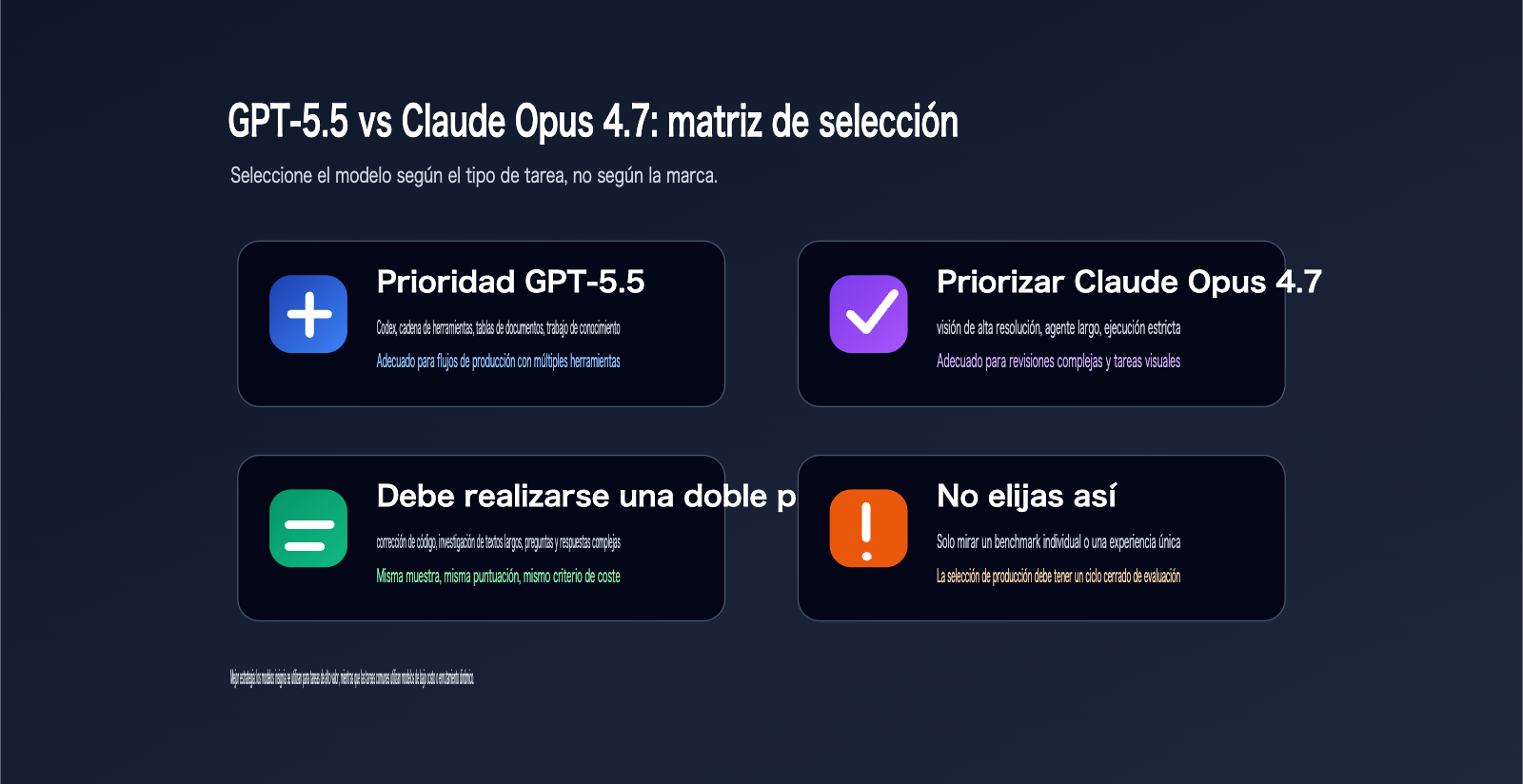

Si solo preguntas "¿cuál es mejor?", la respuesta será demasiado simplista.

Una pregunta más útil sería: ¿Tu tarea consiste en corrección de código, respuestas basadas en bases de conocimiento, análisis de contexto largo, comprensión visual, agentes automatizados o invocación del modelo a gran escala con costos elevados?

La elección entre GPT-5.5 y Claude Opus 4.7 variará significativamente según la tarea.

Cuando OpenAI lanzó oficialmente GPT-5.5, incluyó directamente a Claude Opus 4.7 en sus tablas de evaluación comparativa.

Anthropic, por su parte, posiciona a Claude Opus 4.7 como su modelo de uso general más potente hasta la fecha, destacando sus mejoras en programación mediante agentes, trabajo de conocimiento, tareas visuales y de memoria.

Este artículo ha sido elaborado basándose en documentación oficial en inglés, sin recurrir a fuentes secundarias en chino.

Es importante aclarar que, en este artículo, cuando mencionamos "Claude 4.7", nos referimos específicamente a Claude Opus 4.7.

Hasta la fecha de redacción de este artículo, la documentación oficial de Anthropic no indica que Claude Sonnet 4.7 haya sido lanzado.

Conclusiones clave: GPT-5.5 vs Claude Opus 4.7

La diferencia fundamental entre GPT-5.5 y Claude Opus 4.7 radica en el posicionamiento de cada modelo.

OpenAI define a GPT-5.5 como un modelo más orientado a flujos de trabajo reales. Destaca en codificación, depuración, investigación en línea, análisis de datos, generación de documentos y tablas, y en la ejecución de tareas mediante herramientas.

Anthropic define a Claude Opus 4.7 como su modelo de uso general más potente. Se centra en el razonamiento complejo, la programación mediante agentes, las tareas de larga duración, la comprensión visual, la memoria y la autoverificación.

Si tu tarea implica proyectos de ingeniería complejos en Codex, modificaciones entre archivos, llamadas a herramientas y trabajo de conocimiento, a menudo vale la pena priorizar GPT-5.5 para realizar pruebas.

Si tu tarea implica agentes de larga duración con Claude Code, comprensión de capturas de pantalla, verificación de formato de documentos, memoria del sistema de archivos y un seguimiento estricto de instrucciones, Claude Opus 4.7 es la opción a probar primero.

Si necesitas integrar ambos tipos de modelos, te recomendamos utilizar el servicio proxy de API APIYI (apiyi.com) para gestionar el enrutamiento y la evaluación de múltiples modelos, evitando así fijar la elección del modelo directamente en tu código de negocio.

Comparativa rápida: GPT-5.5 vs Claude Opus 4.7

| Dimensión | GPT-5.5 | Claude Opus 4.7 | Recomendación |

|---|---|---|---|

| Posicionamiento oficial | Flujos de trabajo reales e IA agente | Modelo Claude de uso general más potente | Elegir según el tipo de tarea |

| Capacidad de codificación | Rendimiento sólido en Terminal-Bench 2.0 | Mejora notable en agentic coding | Ambos requieren pruebas |

| Contexto largo | 1M de contexto vía API | Ventana de contexto de 1M | Ambos aptos para contexto largo |

| Capacidad visual | Colaboración multimodal y de herramientas | Soporte para imágenes de alta resolución | Claude para tareas visuales intensas |

| Control de razonamiento | reasoning_effort | effort / adaptive thinking | Sistemas de parámetros distintos |

| Costo de API | $5 entrada / $30 salida por millón de tokens | $5 entrada / $25 salida por millón de tokens | Claude es más barato en salida |

| Acceso al ecosistema | ChatGPT, Codex, API | Claude, Claude Code, API | Depende del flujo de trabajo |

Recomendación: Si no puedes decidir cuál es mejor para tu caso, te sugerimos preparar entre 30 y 50 muestras de negocio reales y ejecutar ambos modelos a través de APIYI (apiyi.com) para comparar la tasa de éxito, el tiempo de respuesta, el costo y la evaluación humana.

Comparativa de capacidades de programación: GPT-5.5 vs Claude Opus 4.7

La programación es el escenario de comparación más crítico entre GPT-5.5 y Claude Opus 4.7.

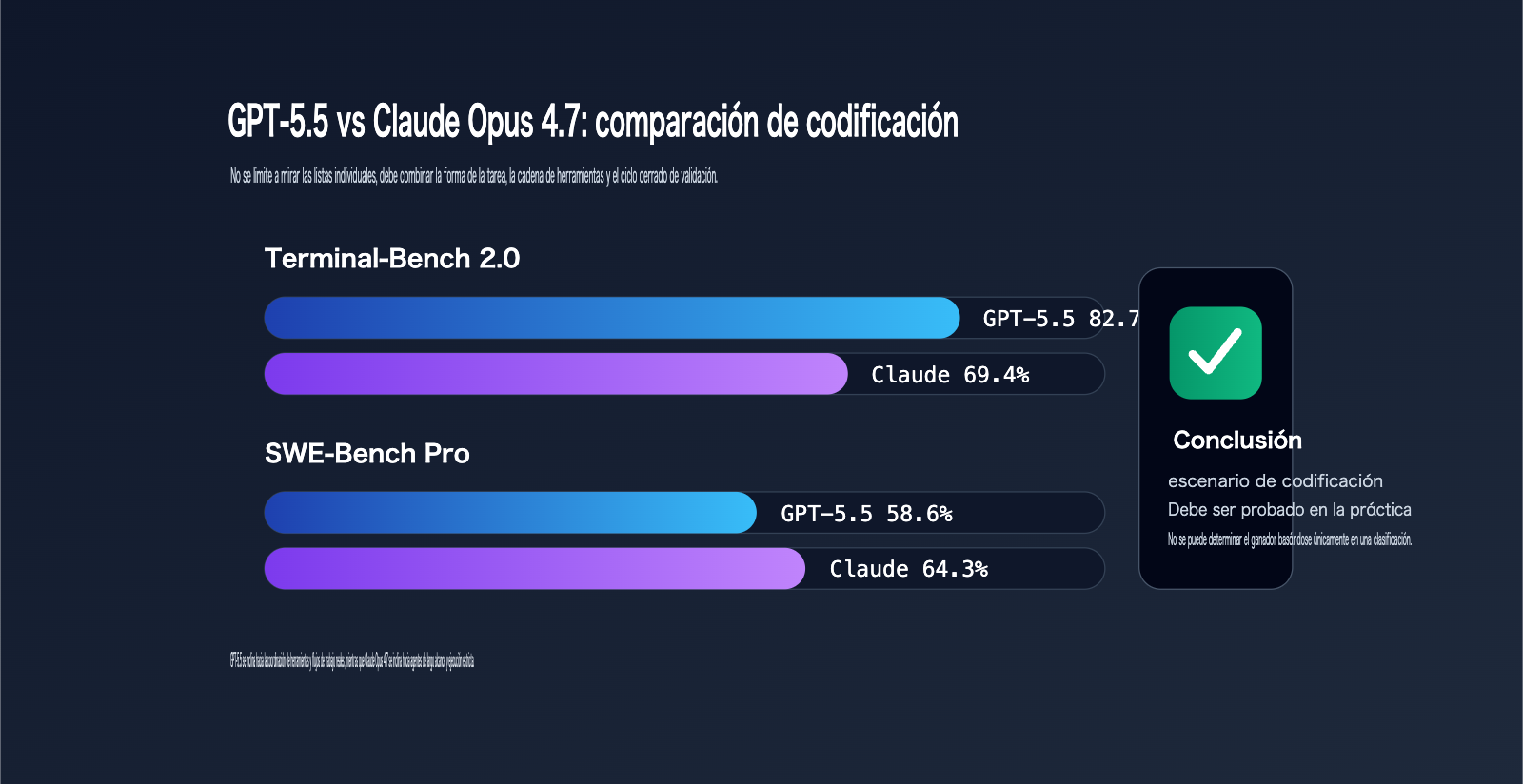

Según los datos oficiales de OpenAI, GPT-5.5 alcanza un 82.7% en Terminal-Bench 2.0.

En la misma tabla, Claude Opus 4.7 obtiene un 69.4%.

Sin embargo, en la evaluación pública SWE-Bench Pro, GPT-5.5 registra un 58.6%, mientras que Claude Opus 4.7 alcanza un 64.3%.

Esto demuestra que ninguno de los dos modelos gana de forma unilateral.

GPT-5.5 destaca más en flujos de trabajo complejos de línea de comandos, planificación, iteración y coordinación de herramientas.

Claude Opus 4.7, por su parte, es muy competitivo en tareas de resolución de issues de GitHub.

El material oficial de Anthropic también subraya que Claude Opus 4.7 mejora un 13% respecto a Opus 4.6 en su benchmark de programación de 93 tareas.

Esto significa que la mejora en programación de Claude Opus 4.7 frente a su generación anterior es clara.

No obstante, al comparar GPT-5.5 y Claude Opus 4.7, no se puede tomar un solo benchmark como conclusión definitiva.

El trabajo de programación real incluye: entender código antiguo, identificar riesgos, controlar el alcance de los cambios, completar pruebas, ejecutar comandos, manejar fallos, explicar cambios y generar notas de revisión.

En el escenario de Codex, GPT-5.5 enfatiza la ejecución entre herramientas y la finalización de tareas con menos tokens.

En el escenario de Claude Code, Claude Opus 4.7 destaca por sus agentes de largo alcance, su gran esfuerzo (xhigh effort) y un seguimiento de instrucciones más estricto.

Recomendaciones para escenarios de programación: GPT-5.5 vs Claude Opus 4.7

| Tarea de programación | Recomendación de prueba | Motivo |

|---|---|---|

| Flujos de trabajo complejos en CLI | GPT-5.5 | Puntuación oficial más alta en Terminal-Bench 2.0 |

| Corrección de issues de GitHub | Ambos | Claude es mejor en SWE-Bench Pro, GPT-5.5 tiene un ecosistema fuerte |

| Comprensión de bases de código grandes | GPT-5.5 | El escenario Codex enfatiza el contexto entre sistemas |

| Tareas de agentes de larga duración | Claude Opus 4.7 | El xhigh effort se ajusta mejor al presupuesto de tareas |

| Revisión y validación de código | Ambos | Enfocarse en el ciclo cerrado de pruebas |

| Correcciones masivas sensibles al costo | Requiere prueba real | Gran diferencia en el uso de tokens |

Consejo de selección: No se guíe solo por los rankings. Recomendamos cargar sus issues reales, pruebas fallidas, revisiones de PR y tareas de refactorización en APIYI (apiyi.com) para realizar una evaluación comparativa, registrando si cada modelo realmente ejecutó las pruebas, si modificó archivos irrelevantes por error y si es capaz de explicar los riesgos.

Comparativa de capacidades de investigación y trabajo de conocimiento: GPT-5.5 vs Claude Opus 4.7

La comparación entre GPT-5.5 y Claude Opus 4.7 en tareas de conocimiento también es fundamental.

El material oficial de OpenAI indica que GPT-5.5 alcanza un 84.9% en GDPval.

Claude Opus 4.7 obtiene un 80.3% en la misma tabla.

GPT-5.5 Pro alcanza un 82.3%.

Esto demuestra que, en las evaluaciones de trabajo de conocimiento profesional listadas por OpenAI, GPT-5.5 tiene un rendimiento muy sólido.

OpenAI también destaca que GPT-5.5 ha mejorado significativamente en la generación de documentos, tablas, presentaciones, procesamiento de investigación operativa y entradas comerciales.

Por parte de Anthropic, la información oficial de Claude Opus 4.7 subraya su rendimiento destacado en trabajo de conocimiento, memoria, visión y agentes de largo alcance.

Una característica importante de Claude Opus 4.7 es su mayor disciplina con los datos.

La página de Anthropic cita la evaluación de Hex, que considera que el modelo está más dispuesto a indicar cuando faltan datos, en lugar de ofrecer alternativas que parecen razonables pero son incorrectas.

Esto es muy importante para el análisis financiero, informes de investigación, revisiones de cumplimiento y procesamiento de tablas de datos.

Si su tarea de trabajo de conocimiento requiere que el modelo redacte documentos de negocio elegantes, completos y con una estructura clara, vale mucho la pena probar GPT-5.5.

Si su tarea requiere que el modelo mantenga la cautela ante datos faltantes, datos conflictivos y contextos largos, Claude Opus 4.7 también es muy competitivo.

Selección para trabajo de conocimiento: GPT-5.5 vs Claude Opus 4.7

| Escenario | Ventaja de GPT-5.5 | Ventaja de Claude Opus 4.7 | Sugerencia |

|---|---|---|---|

| Informes comerciales | Generación estructurada sólida | Disciplina de datos fuerte | Comparar ambos |

| Análisis de tablas | Capacidad de tablas de documentos Codex | Validación visual y análisis de gráficos | Según formato de entrada |

| Investigación financiera | Rendimiento sólido en GDPval | Mejora en el módulo de Finanzas Generales | Probar con muestras reales |

| Revisión de cumplimiento | Capacidad integral sólida | Precaución con datos faltantes | Priorizar prueba con Claude |

| Resumen de múltiples documentos | Contexto largo sólido | Memoria e instrucciones estrictas | Elegir según calidad de citas |

Consejo de selección: Lo que más tememos en el trabajo de conocimiento es que algo "parezca completo, pero tenga alucinaciones". Al realizar la comparativa entre GPT-5.5 y Claude Opus 4.7 en APIYI (apiyi.com), sugerimos desglosar la calificación humana en 5 dimensiones: precisión factual, consistencia de las citas, tasa de omisión, calidad de la estructura y capacidad de ejecución.

GPT-5.5 vs Claude Opus 4.7: Capacidades visuales y de contexto largo

Tanto GPT-5.5 como Claude Opus 4.7 admiten contextos largos, pero con matices importantes.

Según la documentación oficial de OpenAI, la API de GPT-5.5 cuenta con una ventana de contexto de 1M de tokens.

Por su parte, el resumen de modelos de Anthropic indica que Claude Opus 4.7 también soporta una ventana de contexto de 1M de tokens, con una salida máxima de 128k.

En tareas que requieren un contexto extenso, ambos modelos son capaces de procesar documentos voluminosos, bases de código y paquetes de información complejos.

Sin embargo, en tareas visuales, los cambios en Claude Opus 4.7 son más notables.

La documentación de Anthropic señala que Claude Opus 4.7 es el primer modelo de la familia Claude en soportar imágenes de alta resolución, aumentando el límite máximo a 2576px / 3.75MP.

Esto es fundamental para la comprensión de capturas de pantalla, imágenes de documentos, validación de diapositivas, análisis de gráficos y el uso de computadoras (computer use).

Anthropic también menciona que las coordenadas de las imágenes ahora corresponden 1:1 con los píxeles reales, lo que reduce la necesidad de realizar conversiones de escala.

GPT-5.5 también posee capacidades multimodales y de uso de computadora muy potentes, pero si tu entrada principal consiste en capturas de pantalla de alta resolución, gráficos, diseño de documentos o coordenadas de interfaz de usuario, vale la pena priorizar las pruebas con Claude Opus 4.7.

Si tu caso de uso se centra en textos largos, bases de código, documentos empresariales, datos estructurados y resultados de cadenas de herramientas, te recomiendo evaluar tanto GPT-5.5 como Claude Opus 4.7 con el mismo conjunto de muestras.

Diferencias en parámetros de API y migración entre GPT-5.5 y Claude Opus 4.7

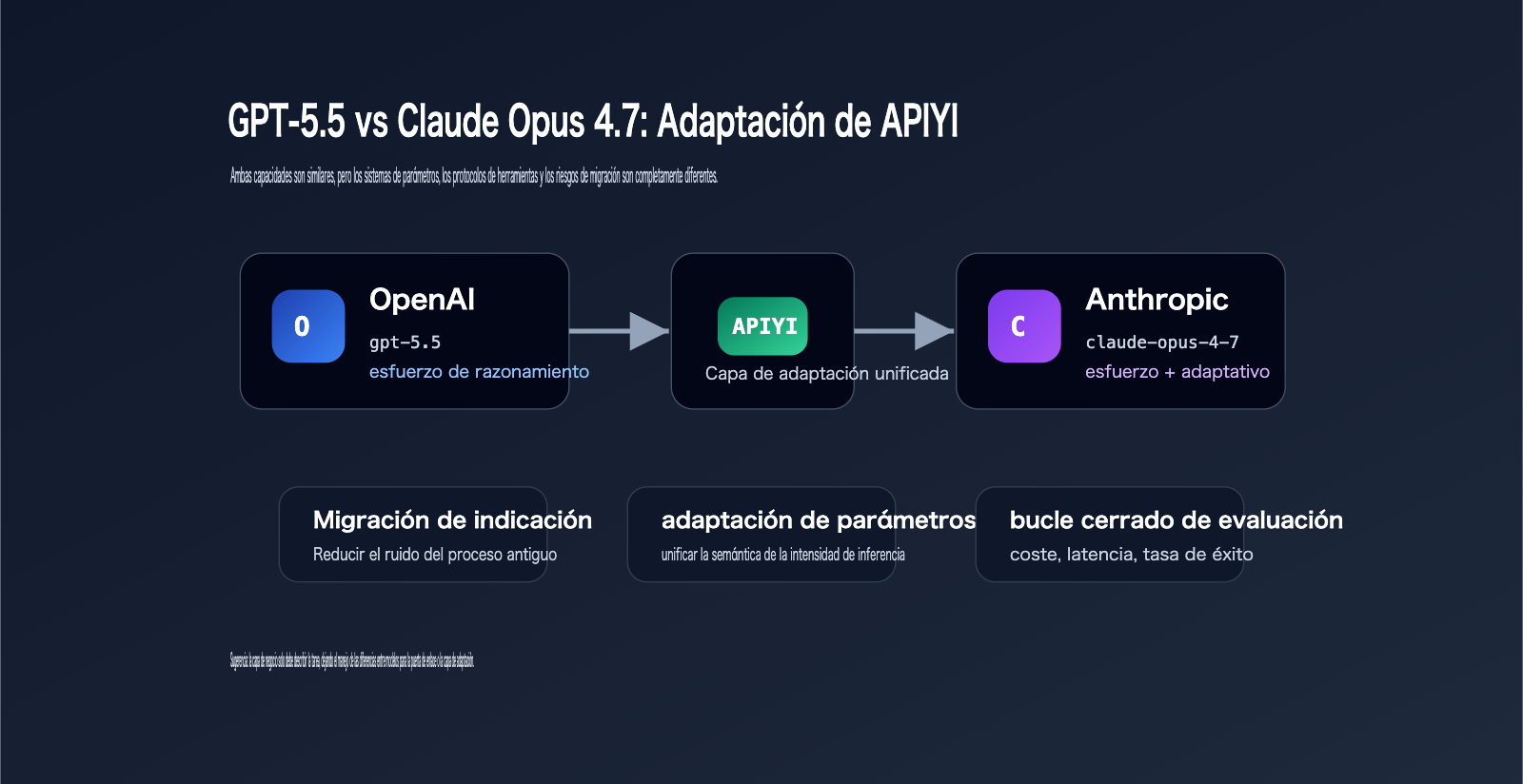

La migración de la API entre GPT-5.5 y Claude Opus 4.7 presenta diferencias significativas.

GPT-5.5 pertenece al ecosistema de modelos de OpenAI, donde los parámetros clave incluyen model, reasoning_effort, llamadas a herramientas de la API de respuestas y control de formato de salida.

Claude Opus 4.7 forma parte del ecosistema de la API de mensajes de Anthropic, con parámetros clave como adaptive thinking, effort, task budget, max_tokens y llamadas a herramientas.

La documentación oficial de Anthropic indica que Claude Opus 4.7 ha eliminado los presupuestos de pensamiento extendido (extended thinking budgets).

La sintaxis antigua thinking: {"type": "enabled", "budget_tokens": N} devolverá un error 400.

La nueva sintaxis debe utilizar thinking: {"type": "adaptive"}, configurando el esfuerzo (effort) a través de output_config.

Anthropic también aclara que, a partir de Claude Opus 4.7, configurar valores no predeterminados para temperature, top_p o top_k devolverá un error 400.

Este es un punto de migración crítico para muchos proyectos antiguos.

Si anteriormente dependías de temperature=0 para obtener una salida determinista, ten en cuenta que temperature=0 nunca garantizó una consistencia absoluta.

En comparación, la migración a GPT-5.5 se centra más en la reconstrucción de la indicación, la evaluación de reasoning_effort, los flujos de trabajo con herramientas y las indicaciones orientadas a resultados.

Puntos clave de migración de API: GPT-5.5 vs Claude Opus 4.7

| Ítem de migración | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| ID del modelo | gpt-5.5 |

claude-opus-4-7 |

| Control de razonamiento | reasoning_effort | effort + adaptive thinking |

| Contexto largo | 1M context window | 1M context window |

| Límite de salida | Según especificaciones de OpenAI API | 128k max output |

| Parámetros de temperatura | Configuración según OpenAI API | Error si se usa temperature/top_p/top_k no predeterminados |

| Flujo de herramientas | Sistema de herramientas Responses API | Sistema de herramientas Messages API |

| Riesgos de migración | Especificación excesiva en la indicación antigua | Parámetros antiguos de thinking budget y sampling |

Recomendación: Si necesitas integrar tanto GPT-5.5 como Claude Opus 4.7, no es aconsejable escribir dos lógicas de llamada dispersas en tu código de negocio. Puedes utilizar el servicio proxy de API APIYI (apiyi.com) para crear una entrada compatible con OpenAI y gestionar las diferencias de modelos, parámetros y manejo de errores en una capa de puerta de enlace o de adaptación.

GPT-5.5 vs Claude Opus 4.7: Análisis de costes y rendimiento

A la hora de comparar los costes entre GPT-5.5 y Claude Opus 4.7, no podemos limitarnos a mirar el precio unitario.

Según la documentación oficial de OpenAI, el precio de la API de GPT-5.5 es de 5 dólares por millón de tokens de entrada y 30 dólares por millón de tokens de salida.

Por su parte, el resumen de modelos de Anthropic indica que Claude Opus 4.7 cuesta 5 dólares por millón de tokens de entrada y 25 dólares por millón de tokens de salida.

Si solo observamos el precio de salida, Claude Opus 4.7 resulta más económico.

Sin embargo, OpenAI destaca que GPT-5.5 es más eficiente en el uso de tokens dentro de Codex en comparación con GPT-5.4.

Del mismo modo, Anthropic subraya que Claude Opus 4.7 controla los costes mediante el esfuerzo (effort), el presupuesto de tareas (task budget) y el pensamiento adaptativo (adaptive thinking).

Por lo tanto, el coste real depende de la naturaleza de la tarea.

Si GPT-5.5 logra completar una tarea en menos rondas, su coste total no tiene por qué ser necesariamente más alto.

Por otro lado, si Claude Opus 4.7 consume una gran cantidad de tokens de salida bajo configuraciones de xhigh o max effort, su coste total también podría dispararse.

La evaluación de costes debe centrarse en el "coste total por completar una tarea satisfactoria" y no simplemente en el precio por millón de tokens.

Dimensiones para la evaluación de costes: GPT-5.5 vs Claude Opus 4.7

| Dimensión de coste | Qué registrar | Por qué es importante |

|---|---|---|

| Tokens de entrada | Indicación, contexto, resultados de herramientas | Gran diferencia en tareas con contexto largo |

| Tokens de salida | Respuesta final, parámetros de herramientas, razonamiento | El precio de salida suele ser más elevado |

| Rondas | Cuántas rondas se necesitan para completar la tarea | Las rondas múltiples multiplican el coste |

| Tasa de éxito | Completado a la primera o con correcciones | Los reintentos por fallo son costes ocultos |

| Latencia | Tiempo de espera del usuario | Un mayor esfuerzo aumenta la espera |

| Revisión humana | ¿Se requiere intervención humana? | La baja calidad traslada el coste a personas |

Recomendación: Para aplicaciones empresariales, la optimización de costes no consiste simplemente en elegir el modelo más barato. Sugerimos utilizar APIYI (apiyi.com) para registrar la entrada, salida, latencia, modelo, parámetros y puntuación humana de cada invocación, utilizando el "coste por tarea satisfactoria" como indicador final.

Decisión de escenarios de uso: GPT-5.5 vs Claude Opus 4.7

Si eres un desarrollador individual, puedes elegir entre GPT-5.5 y Claude Opus 4.7 basándote en el ecosistema de herramientas que utilices.

Si sueles trabajar con Codex, empieza probando GPT-5.5.

Si sueles usar Claude Code, prueba primero con Claude Opus 4.7.

Si eres un responsable técnico en una empresa, no te recomendamos tomar decisiones basadas únicamente en experiencias personales.

Deberías crear un conjunto de tareas y comparar ambos modelos bajo el mismo sistema de entrada, salida, puntuación y registro de costes.

Si trabajas en un equipo de contenidos, vale la pena priorizar las pruebas de GPT-5.5 en tareas de contenido estructurado, investigación y síntesis, tablas y flujos de trabajo con múltiples herramientas.

En el caso de Claude Opus 4.7, es recomendable priorizarlo para tareas que requieran una expresión cautelosa, manejo de contexto largo, análisis de material visual y verificación de documentos.

Si gestionas una plataforma de API o un producto SaaS, te sugerimos implementar un enrutamiento de modelos.

Por ejemplo, las preguntas y respuestas sencillas pueden dirigirse a modelos de menor coste, mientras que las tareas complejas de código y agentes de larga duración pueden derivarse a GPT-5.5 o Claude Opus 4.7.

De esta forma, evitarás que todas las solicitudes saturen los modelos insignia.

Lista de verificación para la migración: GPT-5.5 vs Claude Opus 4.7

No te limites a una experiencia subjetiva antes de poner algo en producción.

Te sugiero preparar al menos 5 tipos de muestras:

- Muestras de éxito.

- Muestras de borde (casos propensos a errores).

- Muestras de contexto largo.

- Muestras de invocación de herramientas.

- Muestras de recuperación ante fallos.

Para cada muestra, registra el modelo, los parámetros, los tokens de entrada, los tokens de salida, el tiempo de ejecución, si fue un éxito al primer intento y la puntuación humana.

Al mismo tiempo, prueba tanto los niveles de bajo costo como los de alta capacidad.

En el lado de GPT-5.5, puedes probar diferentes reasoning_effort.

En el lado de Claude Opus 4.7, puedes probar los niveles medium, high, xhigh y max effort.

No asumas por defecto que ambos modelos deben estar en su configuración máxima.

La configuración máxima solo indica el límite superior, no la rentabilidad en producción.

¿Cómo interpretar los datos de evaluación de GPT-5.5 vs Claude Opus 4.7?

Los benchmarks públicos de GPT-5.5 y Claude Opus 4.7 son muy útiles, pero no equivalen directamente a los resultados de tu negocio.

La razón es simple: las evaluaciones públicas suelen tener conjuntos de tareas, indicaciones, entornos de ejecución y reglas de puntuación fijos.

Tu sistema de negocio se encontrará con datos sucios, falta de contexto, expresiones inestables de los usuarios, fallos en herramientas, restricciones de permisos y el lastre de las indicaciones históricas.

Por lo tanto, ver que GPT-5.5 lidera en un benchmark no significa que todas las tareas deban migrarse a él.

Ver que Claude Opus 4.7 lidera en otro benchmark tampoco significa que debas cambiar todo a Claude.

Una forma más segura es tomar los benchmarks oficiales como una pista sobre la dirección de las capacidades del modelo.

Por ejemplo, Terminal-Bench 2.0 es más representativo de la capacidad en flujos de trabajo complejos de línea de comandos.

SWE-Bench Pro se acerca más a la capacidad real de reparación de problemas en GitHub.

GDPval es más cercano a la capacidad de entrega de conocimientos profesionales.

Los benchmarks visuales y el soporte de imágenes de alta resolución son más adecuados para juzgar tareas relacionadas con capturas de pantalla, gráficos, interfaces de usuario y diseño de documentos.

Al implementar, necesitas mapear estas dimensiones a tus propios escenarios de producto.

Si tu producto es un asistente de codificación en un IDE, prioriza la tasa de éxito en la reparación de código, la tasa de aprobación de pruebas, la tasa de cambios irrelevantes y la calidad de la explicación.

Si tu producto es una base de conocimientos empresarial, prioriza la precisión de las citas, la tasa de omisión de hechos, el manejo de conflictos y los límites de rechazo a responder.

Si tu producto es un agente de automatización, prioriza el número de invocaciones de herramientas, la recuperación ante fallos, la tasa de finalización de tareas y el costo total.

Si tu producto es de procesamiento visual de documentos, prioriza el reconocimiento de coordenadas, la transcripción de gráficos, la comprensión del diseño y el costo de corrección humana.

El valor de APIYI (apiyi.com) radica en ejecutar estas pruebas de modelos bajo una interfaz unificada.

Solo con las mismas entradas, las mismas dimensiones de puntuación y los mismos campos de registro, las conclusiones sobre GPT-5.5 vs Claude Opus 4.7 serán realmente reutilizables.

Preguntas frecuentes sobre GPT-5.5 vs Claude Opus 4.7

¿Cuál es mejor para escribir código: GPT-5.5 o Claude Opus 4.7?

Ambos son excelentes opciones.

GPT-5.5 destaca en Terminal-Bench 2.0, lo que lo hace ideal para flujos de trabajo complejos en línea de comandos y flujos de trabajo con Codex.

Claude Opus 4.7 tiene un rendimiento muy sólido en SWE-Bench Pro y es muy capaz en tareas de agentes de larga duración con Claude Code.

Para proyectos reales, te recomiendo realizar pruebas comparativas utilizando el mismo conjunto de issues y comandos de prueba.

¿Cuál es mejor para preguntas y respuestas sobre bases de conocimiento?

Si tu prioridad es la generación estructurada y la organización con múltiples herramientas, prueba primero con GPT-5.5.

Si te enfocas en la identificación de datos faltantes, una redacción cautelosa y el rigor en contextos extensos, prioriza Claude Opus 4.7.

Al final, la decisión debe basarse en la precisión de las citas y el costo de la revisión humana.

¿Cuál es mejor para tareas visuales?

Claude Opus 4.7 incluye soporte explícito para imágenes de alta resolución en su documentación oficial.

Si tu tarea involucra capturas de pantalla, coordenadas, diseño de documentos o validación visual, vale la pena probar primero con Claude Opus 4.7.

GPT-5.5 también es apto para flujos de trabajo multimodales, pero las tareas con una carga visual pesada requieren una evaluación independiente.

¿Cuál es más económico?

Según los precios oficiales, ambos tienen un costo de entrada de 5 USD por millón de tokens.

El costo de salida de Claude Opus 4.7 es de 25 USD por millón de tokens, mientras que el de GPT-5.5 es de 30 USD por millón de tokens.

Sin embargo, el costo real dependerá del número de rondas necesarias para completar la tarea, la longitud de la salida, la tasa de fallos y el costo de las correcciones humanas.

Resumen: GPT-5.5 vs Claude Opus 4.7

No existe una respuesta única que sirva para todos los escenarios al comparar GPT-5.5 y Claude Opus 4.7.

GPT-5.5 es más adecuado para flujos de trabajo de producción con múltiples herramientas, codificación con Codex, generación de tablas en documentos, trabajo de conocimiento y ejecución de tareas complejas.

Claude Opus 4.7 es superior en tareas visuales de alta resolución, tareas de agentes de largo alcance, seguimiento estricto de instrucciones, memoria de archivos y procesamiento de datos cauteloso.

Si eres un usuario individual, elige según el ecosistema de herramientas que utilices habitualmente.

Si eres un usuario empresarial, es indispensable realizar evaluaciones con muestras reales.

Si eres un desarrollador de API, te sugiero gestionar las diferencias entre modelos en una capa de adaptación; no vincules GPT-5.5 o Claude Opus 4.7 directamente a tu lógica de negocio.

APIYI (apiyi.com) es ideal para actuar como un punto de entrada unificado para modelos, registro de invocaciones, monitoreo de costos y cambio entre múltiples modelos.

Nuestra recomendación final: utiliza GPT-5.5 para tareas de alta complejidad con múltiples herramientas, Claude Opus 4.7 para tareas visuales de alta precisión y agentes largos, y modelos de bajo costo para solicitudes comunes. Luego, ajusta continuamente el enrutamiento basándote en los datos de evaluación.

Referencias:

- OpenAI presenta GPT-5.5: openai.com/index/introducing-gpt-5-5

- Anthropic presenta Claude Opus 4.7: anthropic.com/news/claude-opus-4-7

- Documentación de la API de Anthropic Claude Opus 4.7: platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7

- Descripción general de los modelos de Anthropic: platform.claude.com/docs/en/about-claude/models/overview

- Documentación de Effort de Anthropic: platform.claude.com/docs/en/build-with-claude/effort