21 апреля 2026 года Google представила в рамках публичного превью Gemini API два агента нового поколения для автономных исследований — Deep Research и Deep Research Max. Оба они базируются на модели Gemini 3.1 Pro, выпущенной в феврале этого года. Это важный шаг Google по переносу возможностей «длительных автономных исследований» из потребительских продуктов в API для разработчиков. Deep Research Max показал результат 93,3% в бенчмарке DeepSearchQA и унаследовал ключевые способности к логическому выводу Gemini 3.1 Pro, достигнув 77,1% в ARC-AGI-2 — это более чем в два раза выше показателей Gemini 3 Pro.

Что еще важнее, новое поколение Deep Research получило три инженерных нововведения: протокол MCP (Model Context Protocol) для подключения любых частных источников данных, нативную визуализацию вывода (таблицы HTML / графики SVG / инфографика) и интеграцию веб-данных с частными источниками. Это означает, что впервые разработчики могут с помощью одного вызова API заставить агента одновременно искать информацию в открытом интернете, корпоративных сетях и профессиональных базах данных, сразу формируя визуализированный отчет, готовый для встраивания в дашборды.

В этой статье, опираясь на официальные материалы Google и документацию Gemini API, мы подробно разберем 4 ключевых прорыва Deep Research Max, различия между ним и обычной версией, реальное значение показателя 77,1% в ARC-AGI-2, а также способы интеграции этих возможностей для российских разработчиков.

一、Deep Research Max 是什么:Gemini 3.1 Pro 驱动的自主研究 Agent

Deep Research — это не новая концепция. Еще в конце 2024 года Google открыла базовую версию в приложении Gemini, позволяя ИИ выполнять веб-поиск и составлять отчеты со ссылками. Однако потребительская версия была ограничена: API не был открыт, а интеграция с частными данными отсутствовала, что делало её малопригодной для серьезных инженерных задач.

Текущий релиз Deep Research / Deep Research Max — это полная переработка архитектуры. Google позиционирует его как «автономный исследовательский агент нового поколения». Он способен самостоятельно планировать, выполнять и синтезировать многоэтапные исследовательские задачи, используя веб-поиск, MCP-серверы, контекст URL, выполнение кода и поиск по файлам, выдавая на выходе структурированный отчет со ссылками. Обе версии запущены одновременно и ориентированы на разные инженерные потребности.

| Параметр сравнения | Deep Research (стандарт) | Deep Research Max | Сценарии использования |

|---|---|---|---|

| Цель оптимизации | Скорость и задержка | Комплексность и глубина | — |

| Время рассуждения | Короткое (секунды/минуты) | Длительное (минуты/часы) | — |

| Вычисления во время теста | Стандартные | Расширенные | — |

| Многошаговая итерация | 1-2 цикла | Глубокие многошаговые рассуждения | — |

| Режим вызова | Синхронный / в реальном времени | Асинхронный / фоновая задача | — |

| Стоимость | Ниже | Выше | — |

| Типичные кейсы | Исследовательский ассистент, поддержка | Инвестиционные отчеты, анализ рынка, Due Diligence | — |

В официальном блоге Google четко указано: Deep Research Max предназначен для рабочих процессов, где допустимо асинхронное ожидание ради максимально качественного и комплексного результата. Если вы занимаетесь корпоративным Due Diligence, глубоким отраслевым анализом или автоматической генерацией длинных отчетов, Max — ваш выбор. Если же вам нужен ИИ-ассистент для общения с пользователями в реальном времени, стандартная версия с низкой задержкой будет предпочтительнее.

💡 Совет по интеграции: И Deep Research, и Max доступны через платные уровни Gemini API. Разработчики из РФ могут использовать Gemini 3.1 Pro через сервис-прокси API APIYI (apiyi.com). Платформа уже упаковала всё в протокол, совместимый с OpenAI, что избавляет от проблем с трансграничными платежами и регистрацией аккаунтов.

二、4 ключевых прорыва Deep Research Max

Самое интересное в этом релизе — это четыре качественных скачка в инженерных возможностях. Именно они превращают Deep Research Max в полноценный «корпоративный автономный исследовательский агент».

2.1 Первый прорыв: нативная поддержка протокола MCP для доступа к любым данным

Model Context Protocol (MCP) — это открытый протокол от Anthropic, цель которого — дать ИИ-агентам универсальный способ подключения к любым внешним инструментам и источникам данных. Deep Research Max стал первым продуктом в экосистеме Google, где MCP интегрирован как первоклассный компонент. Разработчикам достаточно упаковать свои частные или сторонние данные в MCP-сервер, и агент сможет обращаться к ним так же легко, как к нативным инструментам.

Google также раскрыла первых партнеров по MCP: финансовые гиганты FactSet, S&P Global и PitchBook уже работают над дизайном своих MCP-серверов, чтобы клиенты могли подключать профессиональные финансовые потоки к рабочим процессам Deep Research. Это означает, что для финансовой, юридической и медицинской сфер наконец-то появился стандартизированный путь интеграции без необходимости переписывать адаптеры под каждый источник данных.

2.2 Второй прорыв: нативная визуализация вместо «простыни» текста

Обычно LLM выдают только Markdown-текст, и для создания графиков приходилось вызывать отдельный API для рисования или интерпретатор кода. Deep Research Max в процессе рассуждения нативно генерирует HTML-таблицы, SVG-графики и инфографику. Эти визуальные элементы являются органичной частью цепочки рассуждений агента, а не «заплаткой» после факта.

Результаты включают: структурированные HTML-таблицы (готовые для вставки на веб-страницы), масштабируемые SVG-графики (круговые, столбчатые, временные шкалы) и полноценную инфографику (удобную для писем или Slack). Если проект интегрирован с качественными моделями генерации изображений, такими как Nano Banana, Deep Research может вызывать их для создания еще более сложных визуальных объектов. Это превращает отчеты из «длинного Markdown со ссылками» в «мультимодальные отчеты, готовые для дашбордов».

2.3 Третий прорыв: интеграция веб-данных и частных источников

Предыдущие версии Deep Research могли искать только в открытом интернете, что не решало главную проблему корпоративных пользователей — интеграцию внутренних документов SaaS, данных CRM и отчетов ERP. Новая версия позволяет в рамках одного API-вызова одновременно задействовать Google Search, удаленные MCP-серверы, контекст URL, выполнение кода и поиск по файлам, при этом агент сам решает, какой инструмент использовать.

Более того, разработчики могут полностью отключить веб-доступ, чтобы агент проводил исследование только по заданным частным источникам. Для отраслей с высокими требованиями к комплаенсу (финансы, право, медицина) этот переключатель — настоящий ключ к успеху, гарантирующий, что агент случайно не «слиет» внутреннюю информацию в поисковые запросы. Это критически важная деталь для внедрения корпоративного ИИ, которой часто пренебрегали.

2.4 Четвертый прорыв: скачок производительности — рост по всем бенчмаркам

Официальные данные Google показывают значительный прирост производительности Deep Research Max по сравнению с версией от декабря 2024 года:

| Бенчмарк | Версия (дек. 2024) | Deep Research Max (апр. 2026) | Прирост |

|---|---|---|---|

| DeepSearchQA | 66.1% | 93.3% | +27.2 п.п. |

| Humanity's Last Exam | 46.4% | 54.6% | +8.2 п.п. |

| ARC-AGI-2 (базовая модель) | 31.1% (Gemini 3 Pro) | 77.1% (Gemini 3.1 Pro) | более чем в 2 раза |

Бенчмарк DeepSearchQA оценивает способность к автономному поиску в сети и комплексному рассуждению. Результат 93.3% близок к теоретическому максимуму. Это означает, что в ключевой задаче «самостоятельно найти информацию и дать точный ответ» Deep Research Max практически не оставляет шансов конкурентам.

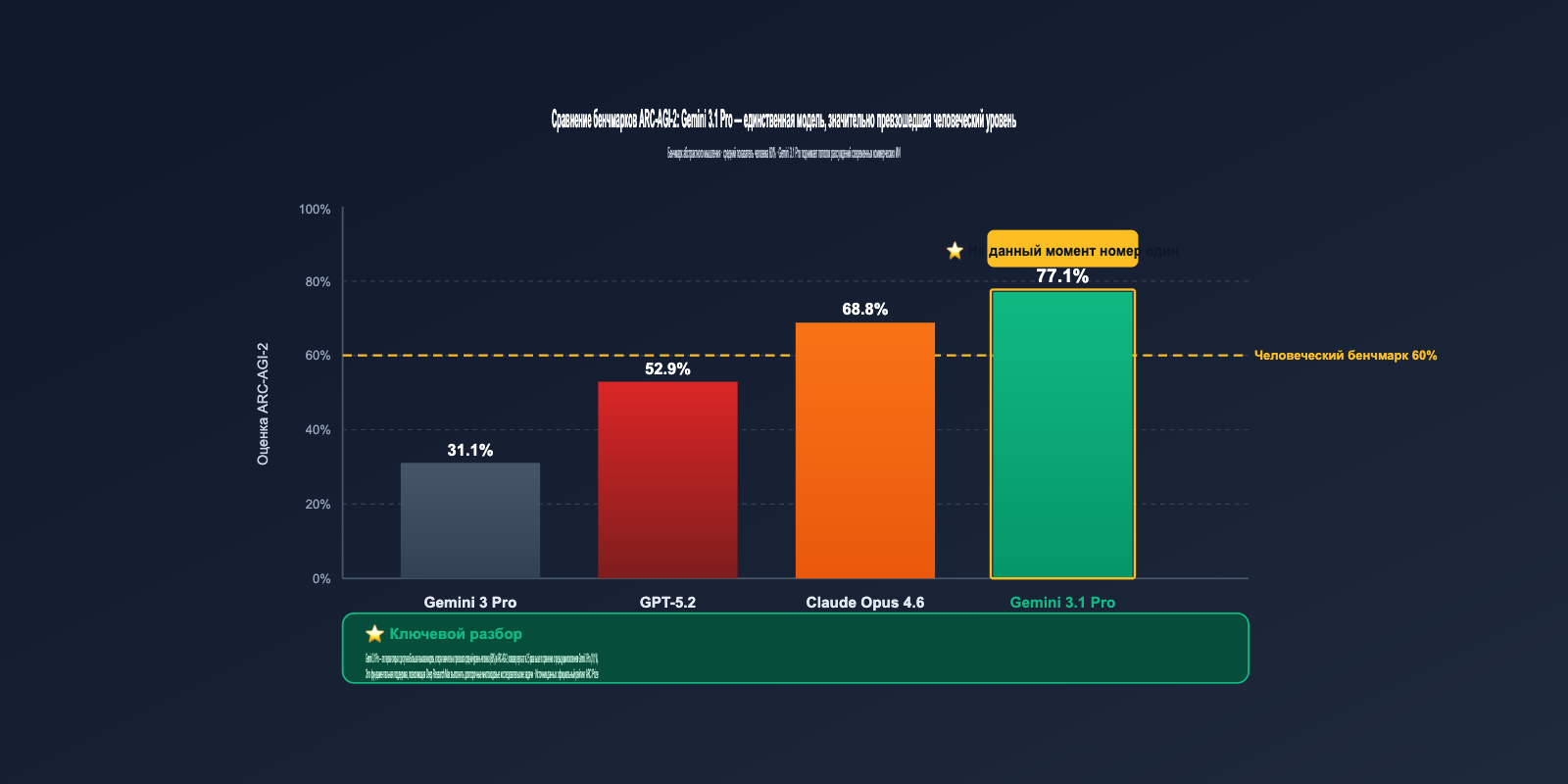

III. Истинное значение показателя 77.1% в ARC-AGI-2

Многие разработчики, видя цифру «77.1%», подсознательно думают: «Ну, неплохо». Однако, чтобы осознать реальную ценность этого результата, нужно понимать уровень сложности бенчмарка ARC-AGI-2.

3.1 Что такое ARC-AGI-2

Бенчмарк ARC-AGI-2, поддерживаемый организацией ARC Prize, специально разработан для проверки способности ИИ к абстрактному мышлению на основе совершенно новых логических паттернов, которые модель никогда не видела в своих обучающих данных. Он предлагает несколько примеров (пар «вход → выход»), чтобы модель могла вывести скрытые правила, а затем применить их к новым, ранее не встречавшимся входным данным. Средний показатель для человека составляет 60%, поэтому 77.1% — это уже результат, превосходящий средние человеческие способности.

Ключевая сложность этого бенчмарка заключается в том, что модель не может просто «зазубрить» ответы. Любые паттерны генерируются с нуля и никак не связаны с обучающим корпусом. Именно поэтому ARC-AGI-2 считается в индустрии одним из «золотых стандартов» для оценки «настоящих способностей к абстрактному мышлению».

3.2 Сравнительный анализ: Gemini 3.1 Pro — текущий лидер

| Модель | Оценка ARC-AGI-2 | vs Человеческий уровень (60%) | Примечание |

|---|---|---|---|

| Gemini 3.1 Pro | 77.1% | +17.1 п.п. | Первая открытая модель, значительно превзошедшая человека |

| Claude Opus 4.6 | 68.8% | +8.8 п.п. | Флагман Anthropic |

| Человеческий уровень | 60.0% | — | Средний показатель |

| GPT-5.2 | 52.9% | -7.1 п.п. | OpenAI |

| Gemini 3 Pro | 31.1% | -28.9 п.п. | Предыдущее поколение |

Как видите, Gemini 3.1 Pro не только обошла все коммерческие большие языковые модели, но и стала единственной открыто доступной моделью, которая заметно превзошла человеческий бенчмарк. Это первый случай в истории коммерческого ИИ, когда модель оторвалась от человека в строгом тесте на «новую логическую аргументацию». Deep Research Max напрямую унаследовала эти способности к рассуждению — именно это является фундаментом, позволяющим ей выполнять сложные, многоэтапные исследовательские задачи.

🎯 Рекомендация: Если ваш продукт ориентирован на исследования, консалтинг, инвестиционный анализ, юридическую экспертизу или другие задачи, требующие интенсивных логических рассуждений, связку Gemini 3.1 Pro + Deep Research Max стоит немедленно включить в план технической оценки. Вы можете быстро протестировать их через платформу APIYI (apiyi.com), которая поддерживает API-совместимые вызовы для множества флагманских моделей, включая Gemini 3.1 Pro.

IV. Быстрый старт с Deep Research Max API

Теорию разобрали, теперь перейдем к самому лаконичному коду, который можно запустить прямо сейчас. Deep Research Max использует стандартный интерфейс Gemini API, а платный уровень уже открыт для предварительного тестирования.

4.1 Базовый вызов: поручаем агенту провести веб-исследование

from google import genai

from google.genai import types

# Подключаемся через единый сервис-прокси APIYI, чтобы избежать проблем с доступом

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Проанализируй рынок эмбеддинг-моделей в первой половине 2026 года, перечисли топ-5 вендоров и их ключевые преимущества",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Включаем Google Search

thinking_config=types.ThinkingConfig(thinking_level="max") # Максимальный бюджет на размышления

)

)

print(response.text) # Выводит полный отчет (включая встроенные HTML-таблицы / SVG-графики)

Этот код выполняет три действия: выбирает модель Deep Research Max, активирует инструмент Google Search и устанавливает максимальный уровень «размышлений». Агент самостоятельно планирует путь поиска, проводит итеративный анализ и в итоге выдает полноценный отчет со ссылками и визуализацией.

4.2 Продвинутый вызов: подключение MCP-сервера для работы с приватными данными

Если вам нужно использовать Deep Research Max для работы с внутренними данными компании (например, CRM или внутренняя вики), необходимо упаковать источники данных в MCP-сервер и указать их при вызове:

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="Проанализируй типы клиентов с самым высоким уровнем оттока в воронке продаж за Q1",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

Обратите внимание: здесь не включен google_search, что означает, что агент проводит исследование исключительно в рамках ваших приватных данных и не отправляет никаких внешних запросов в Google. Это критически важная возможность для корпоративных сценариев, требующих соблюдения комплаенса.

4.3 Переключение между стандартной и Max-версией

Если ваш сценарий — это чат с пользователем в реальном времени, где скорость важнее глубины, просто замените имя модели на deep-research-preview-04-2026. Интерфейсы обеих моделей полностью совместимы, разница лишь во внутренних вычислительных ресурсах и количестве итераций.

💡 Совет для быстрого старта: при первом подключении рекомендуем сначала использовать стандартную версию Deep Research для пары демо-задач, чтобы привыкнуть к стилю ответов агента, а затем переходить на Max для реальных бизнес-задач. Мы советуем подключаться через платформу APIYI (apiyi.com) — она поддерживает вызовы Gemini 3.1 Pro, Deep Research и Deep Research Max с совместимостью под OpenAI, что очень удобно для сравнения и переключения между моделями.

V. Анализ влияния Deep Research Max: какие рабочие процессы изменятся

Выпуск нового инструмента — это только начало; настоящая ценность заключается в том, как он трансформирует существующие процессы. Судя по материалам релиза и первым отзывам сообщества, сильнее всего пострадают (в хорошем смысле) следующие 4 области.

5.1 Инвестиционные исследования и анализ отрасли

Это сценарий, который Google особо выделил на презентации. Финансовые провайдеры FactSet, S&P Global и PitchBook объединились для создания MCP-серверов. Цель проста: позволить аналитикам с помощью одной фразы на естественном языке одновременно запрашивать данные финансовой отчетности, отраслевые исследования и базы данных по слияниям и поглощениям, автоматически получая визуализированные отчеты. То, на что раньше уходило 2 дня, теперь может быть готово за 30 минут. Это не замена аналитика, а освобождение его от рутинного поиска информации.

5.2 Корпоративная проверка (Due Diligence) и комплаенс

Главная боль юридических и комплаенс-отделов при проверках — необходимость «одновременно изучать публичную информацию и внутренние архивы». Режим «только приватные данные» в Deep Research Max позволяет юристам без опасений передавать данные клиентов агенту, не боясь, что они попадут в поисковую выдачу. Благодаря нативной визуализации итоговые отчеты можно сразу вставлять в Notion или Confluence.

5.3 Академические обзоры и работа с литературой

Самый трудоемкий этап написания обзорной статьи — это переработка 200+ источников в единую аргументированную структуру. Глубокие итеративные рассуждения Deep Research Max позволяют за один вызов «прочитать» десятки PDF-файлов и создать структурированный план. А с учетом контекстного окна в 1 млн токенов, один запрос может охватить ключевую литературу по всему направлению исследования.

5.4 Обновление AI-ассистентов в SaaS-продуктах

Многие SaaS-сервисы уже внедряют AI Copilot, но большинство из них — это просто «обертка над GPT-4 + RAG». Стандартная версия Deep Research (с низкой задержкой) дает таким продуктам путь к развитию: превратить Copilot в полноценного автономного агента, способного комплексно отвечать на вопросы, объединяя данные из веба, внутренние данные продукта и приватные данные пользователя, а не просто искать ключевые слова в документации.

VI. Сравнение Deep Research Max с аналогами

Давайте взглянем на Deep Research Max в контексте индустрии. Сегодня все основные решения для «глубоких исследований и рассуждений» можно разделить на три категории.

| Продукт | Вендор | Автономное исследование | Поддержка MCP | Нативная визуализация | Приватные данные | Общий рейтинг |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ Глубокое, многоэтапное | ✅ Приоритетная | ✅ Нативная (HTML/SVG) | ✅ Режим Web off | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ Многоэтапное | Частичная | Частичная | Частичная | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ Нативная MCP | ❌ В основном текст | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ В основном Web | ❌ | Частичная | ❌ | ⭐⭐⭐ |

| Собственная RAG + Агент | Разные | Зависит от реализации | Зависит от реализации | Требует разработки | ✅ | ⭐⭐ |

Как видите, Deep Research Max лидирует по четырем ключевым параметрам: глубокие многоэтапные рассуждения + полноценная поддержка MCP + нативная визуализация + интеграция данных из разных приватных источников. На текущий момент это наиболее инженерно проработанное агентское решение для исследовательских задач.

📌 Совет по выбору: Если вашему проекту критически важны глубокая аналитика, соблюдение требований безопасности при работе с приватными данными и наглядная визуализация, то Deep Research Max — лучший выбор. Если же достаточно легкого ассистента для веб-поиска, присмотритесь к Perplexity или стандартной версии Deep Research. Вы можете подключить и сравнить эти модели через сервис-прокси API APIYI (apiyi.com) — это позволит избежать настройки аутентификации для каждого вендора по отдельности.

VII. FAQ по Deep Research Max

Q1: В чем разница между Deep Research Max и обычным Gemini 3.1 Pro?

Gemini 3.1 Pro — это базовая модель, которая отвечает за логику и вычисления. Deep Research Max — это автономный исследовательский агент, построенный поверх 3.1 Pro. Он дополнен инструментами для вызова внешних функций (tool calling), многошаговой итерации и визуализации. Проще говоря, 3.1 Pro — это «мозг», а Deep Research Max — это «исследователь с набором инструментов и готовыми навыками».

Q2: Как разработчикам из РФ получить доступ к Deep Research Max?

Deep Research Max — это функция платного уровня Gemini API. Для доступа к ней из России обычно требуется обход региональных ограничений. Самый простой путь — использовать единый сервис-прокси APIYI (apiyi.com). Он позволяет оплачивать услуги в рублях, обеспечивает полную совместимость с официальным интерфейсом и предоставляет доступ ко всей линейке моделей, включая Gemini 3.1 Pro.

Q3: Насколько Deep Research Max дороже стандартной версии?

Google не называет точных цифр, но, исходя из описания «расширенных вычислений во время работы (test-time compute) и многоэтапных итераций», стоимость одного вызова Max будет значительно выше стандартной версии (примерно в 3-10 раз). Рекомендуем сначала прогонять простые задачи на стандартной версии, а при необходимости глубокой аналитики переключаться на Max.

Q4: Могу ли я самостоятельно написать MCP-сервер для Deep Research Max?

Да. MCP — это открытый протокол. Любая команда может создать свой MCP-сервер, чтобы предоставить агенту доступ к ERP, CRM или внутренним базам знаний через стандартизированный интерфейс. Google активно приветствует вклад сообщества в развитие MCP.

Q5: Можно ли встроить вывод Deep Research Max прямо в веб-страницу?

Конечно. Нативный вывод включает таблицы HTML, графики SVG и структурированную разметку. Все это можно легко встраивать в веб-интерфейсы, панели управления или даже письма. Это одно из главных преимуществ перед традиционными LLM.

Q6: Будет ли агент работать при полном отключении доступа к интернету?

Да. В этом случае агент будет проводить исследование, опираясь исключительно на указанные вами MCP-серверы, файлы для поиска (File Search) и контекст URL. Это ключевой сценарий для корпоративной безопасности, когда данные не покидают периметр компании.

Q7: Каков размер контекстного окна у Deep Research Max?

Он унаследован от Gemini 3.1 Pro: 1 048 576 токенов (около 1 млн) на вход и до 65 536 токенов на выход. Это позволяет за один присест проанализировать десятки длинных научных статей или целую библиотеку документации к продукту.

Q8: Означает ли показатель ARC-AGI-2 77.1%, что у Gemini 3.1 Pro самые сильные способности в целом?

Не совсем так. ARC-AGI-2 тестирует абстрактное мышление — в этом аспекте Gemini 3.1 Pro действительно лидирует. Однако по другим параметрам (код, мультимодальность, понимание русского языка) нужно смотреть на соответствующие бенчмарки. Но, в целом, Gemini 3.1 Pro — одна из флагманских моделей текущего поколения.

Q9: Заменит ли Deep Research Max системы RAG?

В краткосрочной перспективе — нет, они скорее дополняют друг друга. RAG незаменим там, где нужна высокая точность извлечения данных из специфических корпоративных баз. Deep Research Max идеален для задач «интеграция данных из многих источников + глубокое рассуждение + визуализация». Лучшая стратегия — использовать RAG для ответов на стандартные вопросы, а при необходимости глубокого исследования переходить на Deep Research Max.

Q10: Как Deep Research Max справляется с русским языком?

Gemini 3.1 Pro отлично поддерживает русский язык, и Deep Research Max унаследовал эту способность. Стоит учитывать, что поисковый инструмент Google Search по умолчанию отдает приоритет англоязычным источникам. Для качественного исследования на русском советуем принудительно использовать домены Google Search для русского сегмента и подключать русскоязычные MCP-серверы.

VIII. Итоги: ключевые моменты внедрения Deep Research Max

Подводя итоги, вот несколько ключевых моментов о Google Deep Research Max, которые стоит запомнить каждому разработчику:

Во-первых, Deep Research Max — это самый перспективный автономный исследовательский агент 2026 года. Четыре ключевых прорыва — поддержка MCP, нативная визуализация, кросс-источниковая интеграция и скачок производительности — впервые переводят корпоративных исследовательских агентов на стадию реального промышленного применения. Во-вторых, у каждой версии свое назначение: стандартная версия оптимизирована по задержке и скорости, что идеально подходит для интерактивного взаимодействия, тогда как версия Max заточена под глубину и комплексность, что лучше для асинхронных задач. Выбирайте инструмент под конкретный сценарий. В-третьих, показатель 77.1% в ARC-AGI-2 — это не просто цифры. Это означает, что базовая модель Gemini 3.1 Pro в плане абстрактного мышления уже уверенно превзошла средний человеческий уровень. В сочетании с фреймворком вызова инструментов Deep Research Max, мы наконец получили коммерчески жизнеспособное решение для сложных исследовательских задач с длинным циклом выполнения.

В-четвертых, протокол MCP станет фактическим стандартом для агентов следующего поколения, и тот факт, что Google сделал его первоклассным гражданином своей экосистемы, — четкий сигнал. Anthropic также активно продвигает MCP, и вместе с поддержкой в Cursor, Claude Desktop и других инструментах, вокруг этого протокола формируется целая экосистема. Сейчас изучение и реализация MCP-серверов — это инвестиция с высоким ROI для разработчиков. В-пятых, путь доступа из РФ и СНГ предельно ясен: Deep Research / Max работают через платный уровень Gemini API, а через платформы-посредники, такие как APIYI (apiyi.com), можно быстро пройти весь путь от регистрации и оплаты до вызова модели, не тратя время на решение проблем с трансграничными сетями и зарубежными банковскими картами.

🎯 Финальный совет: если вы создаете AI-продукты в сферах исследований, консалтинга, аналитики, образования или юриспруденции, немедленно включите Deep Research Max в свой список технологий для оценки. Это текущий эталон инженерного уровня коммерческих AI-агентов, и те, кто начнет использовать его первыми, получат максимальное конкурентное преимущество. Вы можете быстро протестировать доступ через платформу APIYI (apiyi.com) и, используя контекстное окно Gemini 3.1 Pro в 1 млн токенов и его мультимодальные возможности, вывести свои традиционные RAG-системы, интеллектуальную поддержку или генерацию контента на уровень автономных агентов нового поколения.

Релиз Deep Research Max — это только начало. Google прямо заявила в своем блоге, что это «качественный скачок для автономных исследовательских агентов» (a step change for autonomous research agents). Сможете ли вы воспользоваться этим окном возможностей, напрямую определит позиции вашего AI-продукта во второй половине 2026 года.

Автор: Техническая команда APIYI | Фокусируемся на практическом внедрении больших языковых моделей. Больше технических материалов на сайте APIYI apiyi.com