Авторское примечание: глубокий сравнительный анализ возможностей Claude Opus 4.7 и GLM-5.1 в сфере программирования. Мы рассмотрим результаты тестов SWE-Bench и CursorBench, возможности автономного кодинга на длинных дистанциях и цены на API, чтобы помочь вам выбрать идеальную модель для разработки.

В апреле 2026 года в мире AI-разработки произошла мощная дуэль двух тяжеловесов. 7 апреля компания Zhipu AI (Z.ai) выпустила открытую модель GLM-5.1, которая возглавила мировой рейтинг SWE-Bench Pro с результатом 58,4 балла. Спустя всего 9 дней, 16 апреля, Anthropic представила Claude Opus 4.7: показатель в CursorBench подскочил с 58% до 70%, а количество решенных задач в Rakuten-SWE-Bench выросло в 3 раза по сравнению с версией 4.6.

У моделей разное позиционирование, архитектура и огромная разница в цене, но в главной битве — написании кода — они сошлись лицом к лицу. Сервис-прокси API APIYI (apiyi.com) уже добавил обе модели, так что вы можете протестировать их через единый интерфейс.

Ключевой вывод: после прочтения статьи вы поймете сильные стороны каждой модели и сможете выбрать ту, что лучше подходит для ваших задач.

Сравнение ключевых характеристик Claude Opus 4.7 и GLM-5.1

| Параметр | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Дата выпуска | 16.04.2026 | 07.04.2026 |

| Разработчик | Anthropic | Zhipu AI (Z.ai) |

| Архитектура | Закрытая | 744B MoE (40B активных параметров) |

| Лицензия | ❌ Закрытая | ✅ MIT (полностью открытая) |

| Контекстное окно | 1M токенов | 200K токенов |

| Макс. вывод | 128K токенов | 131K токенов |

| Цена API (вход) | $5 / M токенов | $1 / M токенов |

| Цена API (выход) | $25 / M токенов | $3.2 / M токенов |

| Работа с визуалом | ✅ 2576px / 3.75MP | ✅ Поддерживается |

| Режим мышления | Adaptive Thinking | Мультирежимный Thinking |

| SWE-Bench Pro | Ожидается > 57.3 (уровень 4.6) | 58.4 (лидер рейтинга) |

| CursorBench | 70% | — |

| Оборудование | GPU-кластер в США | Huawei Ascend 910B |

🎯 Краткий итог: если вам нужна максимальная мощь, огромное контекстное окно и работа с визуальными данными, выбирайте Opus 4.7. Если вы ищете максимальную выгоду, контроль над open-source и отличные навыки программирования, берите GLM-5.1. Обе модели уже доступны на APIYI apiyi.com.

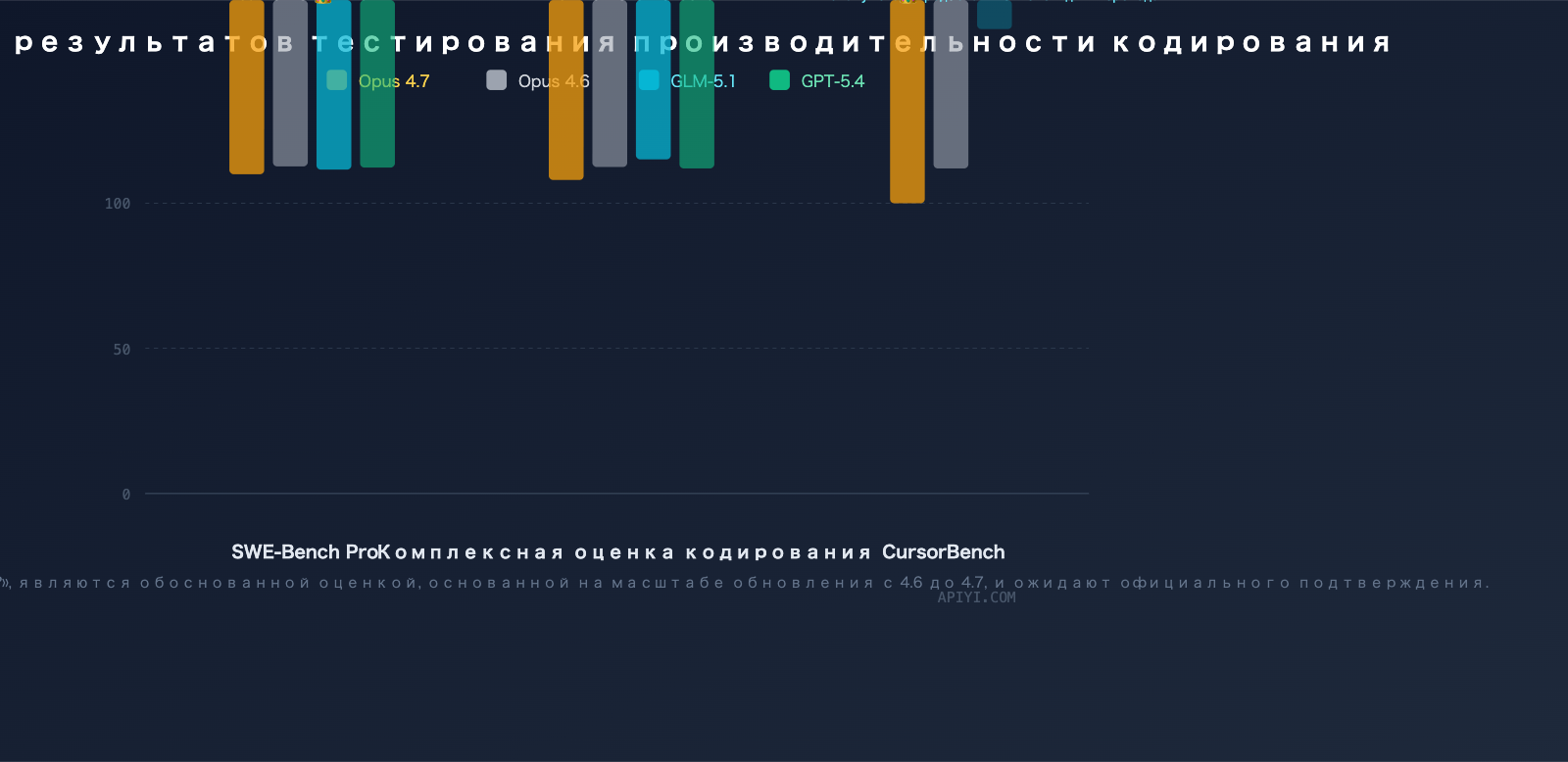

Глубокий сравнительный анализ бенчмарков программирования

SWE-Bench Pro: GLM-5.1 сейчас в лидерах

SWE-Bench Pro — один из самых авторитетных бенчмарков для оценки навыков программирования в реальных условиях, проверяющий способность моделей решать реальные задачи (Issue) на GitHub.

| Модель | SWE-Bench Pro | Рейтинг |

|---|---|---|

| GLM-5.1 | 58.4 | #1 |

| GPT-5.4 | 57.7 | #2 |

| Claude Opus 4.6 | 57.3 | #3 |

| Claude Opus 4.7 | Ожидается > 57.3 | Обновляется |

GLM-5.1 возглавил рейтинг SWE-Bench Pro с результатом 58.4, обойдя GPT-5.4 (57.7) и Claude Opus 4.6 (57.3). Стоит отметить, что Opus 4.7 демонстрирует значительный прогресс в программировании по сравнению с версией 4.6 (CursorBench +12 п.п., Rakuten-SWE-Bench в 3 раза выше), поэтому ожидается, что его показатели в SWE-Bench Pro существенно вырастут, однако на момент публикации данные еще не были официально представлены.

CursorBench: Opus 4.7 с большим отрывом

CursorBench оценивает навыки написания кода в реальной среде IDE (редактор Cursor), что максимально приближено к повседневным задачам разработчика.

| Модель | CursorBench |

|---|---|

| Claude Opus 4.7 | 70% |

| Claude Opus 4.6 | 58% |

| GLM-5.1 | Нет данных |

Комплексная оценка программирования (Coding Composite)

Комплексная оценка объединяет результаты нескольких бенчмарков, включая SWE-Bench Pro, Terminal-Bench 2.0 и NL2Repo:

| Модель | Комплексная оценка |

|---|---|

| GPT-5.4 | 58.0 |

| Claude Opus 4.6 | 57.5 |

| GLM-5.1 | 54.9 |

| Claude Opus 4.7 | Ожидается значительно выше 4.6 |

В комплексном рейтинге Claude Opus 4.6 лидирует с результатом 57.5, опережая GLM-5.1 (54.9). Ожидается, что Opus 4.7 еще больше увеличит этот разрыв.

🎯 Вердикт: GLM-5.1 показал лучший результат в одиночном тесте SWE-Bench Pro, но в плане комплексных навыков программирования семейство Claude по-прежнему удерживает лидерство. Разработчики могут использовать сервис-прокси API APIYI (apiyi.com) для одновременного подключения обеих моделей и проведения A/B-тестирования в своих реальных проектах.

Глубокое сравнение возможностей в задачах программирования

Бенчмарки — это лишь один из показателей. В реальных задачах разработки обе модели демонстрируют совершенно разные сильные стороны.

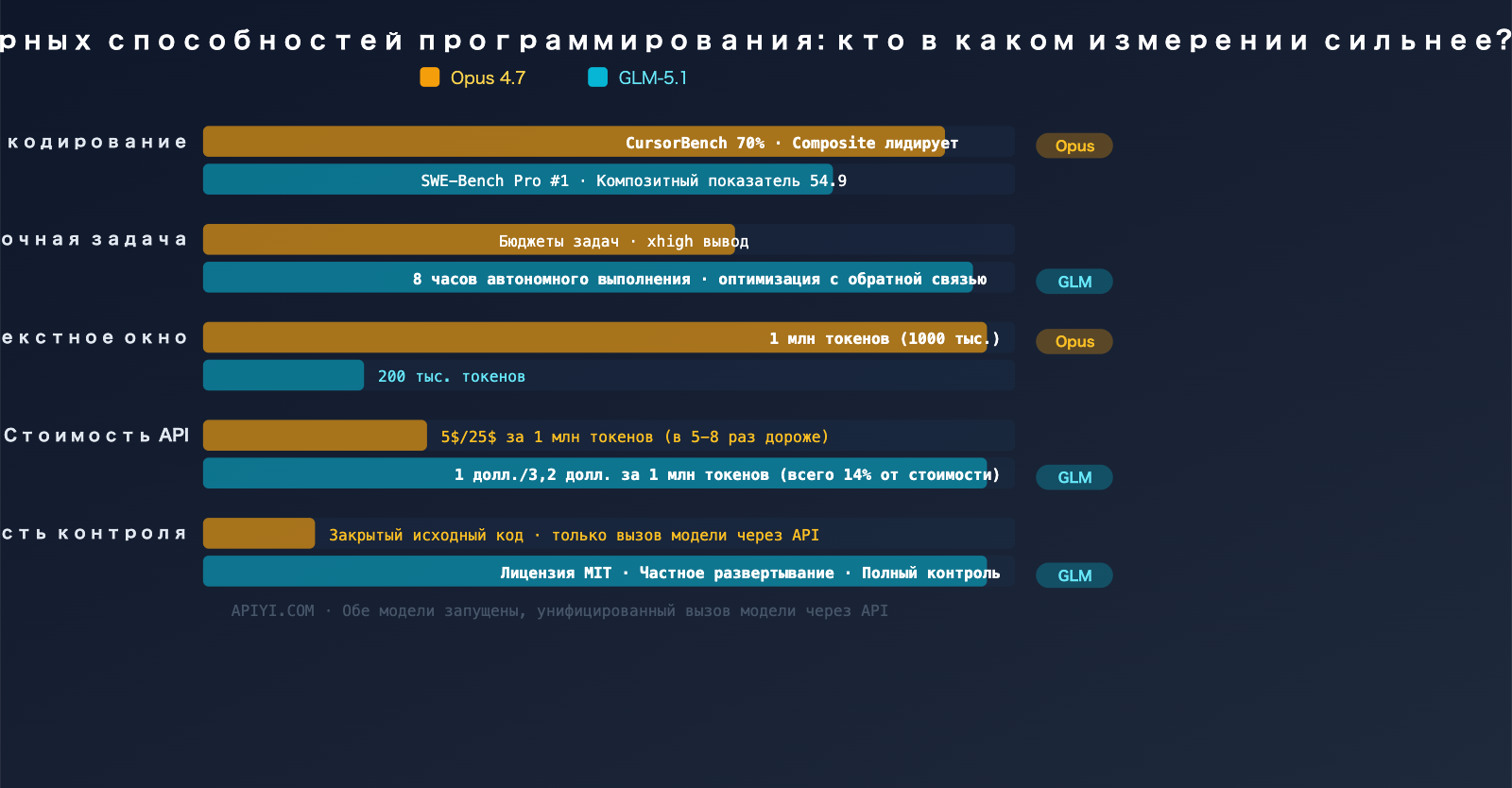

Длительное автономное кодирование

Это киллер-фича GLM-5.1.

| Возможности длительной работы | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Макс. время автономной работы | Зависит от Task Budget | 8 часов без перерыва |

| Автономный цикл | Поддержка многошаговых агентов | Полный цикл «планирование → выполнение → тест → исправление → оптимизация» |

| Управление бюджетом токенов | Task Budgets (новая функция) | Встроенное управление длинными задачами |

| Самовосстановление | Автоисправление при кодировании | Автономный цикл «эксперимент → анализ → оптимизация» |

GLM-5.1 способен непрерывно выполнять задачи по программированию в течение 8 часов, формируя замкнутый цикл «эксперимент — анализ — оптимизация», что дает огромное преимущество при крупном рефакторинге или миграции между модулями.

Хотя Opus 4.7 расширил возможности работы с длинными задачами благодаря Task Budgets и уровню рассуждений xhigh, он больше ориентирован на «эффективное выполнение в рамках бюджета», чем на «бесконечное исполнение в течение длительного времени».

Агентные задачи (Agentic Tasks)

| Агентные возможности | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Нативная поддержка MCP | ✅ Глубокая оптимизация | ✅ Поддерживается |

| Эффективность вызова инструментов | Меньше вызовов, больше рассуждений | Активное использование инструментов |

| Надежность многошаговых задач | Очень высокая | Высокая |

| Управление контекстом | 1 млн токенов (огромный контекст) | 200 тыс. токенов |

| Управление под-агентами | Тонкая настройка (регулируемая) | Поддерживается |

В агентных задачах контекстное окно в 1 млн токенов у Opus 4.7 является подавляющим преимуществом. При работе с большими кодовыми базами Opus 4.7 может загрузить больше контекста файлов за один раз, минимизируя потерю информации.

Анализ кода и рефакторинг

| Возможности анализа кода | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Точность инструкций | Буквальное выполнение, без пропусков | Гибкая интерпретация |

| Самопроверка | Сначала проверка, потом вывод (новое) | Поддерживается |

| Работа с большими файлами | Загрузка всей базы через 1M контекст | Ограничение 200K, может потребоваться сегментация |

| Визуальный анализ | Понимание скриншотов высокого разрешения | Базовое зрение |

Быстрое кодирование и ежедневная разработка

| Ежедневное кодирование | Claude Opus 4.7 | GLM-5.1 |

|---|---|---|

| Скорость отклика | Средняя | Быстрее |

| Стоимость API | $5/$25 за млн токенов | $1/$3.2 за млн токенов |

| Стиль кода | Более лаконичный, упор на логику | Подробные комментарии, упор на инструменты |

| Поддержка языков | Отличная | Отличная (комментарии на русском естественнее) |

Сравнение цен: 5-кратная разница в стоимости

Цена — фактор, который нельзя игнорировать при выборе модели. Разница в стоимости между ними колоссальна:

| Статья расходов | Claude Opus 4.7 | GLM-5.1 | Разница |

|---|---|---|---|

| Цена на входе | $5 / млн токенов | $1 / млн токенов | Opus дороже в 5 раз |

| Цена на выходе | $25 / млн токенов | $3.2 / млн токенов | Opus дороже в 7.8 раз |

| Цена кэширования | Стандартная скидка Cache | $0.26 / млн токенов | Кэш GLM очень дешевый |

| Наценка за контекст | Нет | Нет | — |

Оценка стоимости для реальных сценариев

Предположим, средняя команда разработчиков потребляет 500 млн токенов в месяц (поровну на вход и выход):

| Модель | Ежемесячные затраты на вход | Ежемесячные затраты на выход | Итого в месяц |

|---|---|---|---|

| Opus 4.7 | $1,250 | $6,250 | $7,500 |

| GLM-5.1 | $250 | $800 | $1,050 |

| Разница | — | — | $6,450/мес |

Стоимость GLM-5.1 составляет лишь около 14% от стоимости Opus 4.7. Для команд, чувствительных к бюджету, это решающее различие.

🎯 Стратегия оптимизации затрат: через платформу APIYI (apiyi.com) вы можете гибко переключаться между двумя моделями — доверяйте Opus 4.7 сложную архитектуру и ревью кода, а рутинную генерацию кода и пакетную обработку задач — GLM-5.1. Единый интерфейс платформы делает внедрение мультимодельной стратегии максимально простым.

Рекомендации по выбору в разных сценариях

Когда стоит выбрать Claude Opus 4.7

- Работа с огромными кодовыми базами: если нужно загрузить контекст из десятков файлов за раз (1 млн против 200 тыс. токенов).

- Код-ревью и аудит безопасности: когда требуется высочайшая точность и возможность самопроверки.

- Мультимодальная разработка: когда нужно анализировать скриншоты интерфейсов, макеты дизайна или графики из документации (визуальное разрешение 3,75 Мп).

- Требования корпоративного уровня: нужна стабильная поддержка от проприетарного коммерческого продукта.

- Сложное программирование с упором на рассуждения: математические вычисления, проектирование алгоритмов и другие задачи, требующие глубокого анализа.

Когда стоит выбрать GLM-5.1

- Длительная автономная разработка: если модели нужно работать несколько часов для завершения крупного рефакторинга.

- Массовые задачи с чувствительностью к стоимости: интеграция CI/CD, генерация кода в больших объемах, автоматизированное тестирование.

- Локальное развертывание: нужно запускать модель на собственных серверах (лицензия MIT, полностью открытый код).

- Разработка с упором на китайский язык: комментарии в коде и генерация документации на китайском языке выглядят более естественными.

- Задачи типа SWE-Bench: решение задач из GitHub Issue, исправление багов и другие реальные задачи по написанию кода.

Лучшая стратегия: использование двух моделей

| Тип задачи | Рекомендуемая модель | Причина |

|---|---|---|

| Архитектурное проектирование и техзадания | Opus 4.7 | Глубокие рассуждения + длинный контекст |

| Повседневное написание кода | GLM-5.1 | Низкая стоимость, достаточное качество |

| Код-ревью | Opus 4.7 | Точность + самопроверка |

| Массовая генерация кода | GLM-5.1 | Стоимость всего 14% от цены Opus |

| Исправление багов (GitHub Issue) | GLM-5.1 | Лидер рейтинга SWE-Bench Pro |

| Рефакторинг множества файлов | Opus 4.7 | Преимущество контекста 1 млн |

| Долгие автономные задачи | GLM-5.1 | 8 часов автономного выполнения |

| Разработка на основе UI/скриншотов | Opus 4.7 | Высокое разрешение зрения 3,75 Мп |

🎯 Совет по управлению: сервис-прокси API APIYI (apiyi.com) уже добавил поддержку и Claude Opus 4.7, и GLM-5.1. Разработчики могут использовать один API-ключ и единый совместимый с OpenAI интерфейс для вызова обеих моделей, гибко переключаясь между ними в зависимости от типа задачи для достижения лучшей эффективности и экономии.

Часто задаваемые вопросы

Q1: Действительно ли GLM-5.1 лучше, чем Claude Opus?

Зависит от контекста. В отдельном тесте SWE-Bench Pro модель GLM-5.1 (58,4) действительно обошла Opus 4.6 (57,3), однако по комплексной оценке программирования Opus 4.6 (57,5) все еще впереди GLM-5.1 (54,9). Opus 4.7 — это серьезное обновление версии 4.6, поэтому разрыв в комплексных навыках кодинга, вероятно, снова увеличится. В целом Opus 4.7 мощнее, но GLM-5.1 имеет уникальные преимущества в специфических сценариях (длительные задачи, задачи типа SWE-Bench).

Q2: GLM-5.1 стоит намного дешевле, не страдает ли качество?

Для большинства задач по кодингу — нет, его достаточно. Показатели GLM-5.1 в SWE-Bench Pro доказывают, что модель обладает первоклассными навыками программирования. По данным тестирований, она достигает 94,6% возможностей Claude Opus 4.6 в написании кода, но при этом стоит в 5–8 раз меньше. Лучший способ убедиться в этом — провести сравнение самостоятельно через APIYI (apiyi.com).

Q3: Можно ли вызывать обе модели через один интерфейс?

Да. APIYI (apiyi.com) предоставляет единый интерфейс, совместимый с OpenAI. Вам достаточно просто изменить ID модели, чтобы переключиться между Claude Opus 4.7 и GLM-5.1, без необходимости менять архитектуру кода или управлять несколькими API-ключами.

Итоги

Ключевые выводы из сравнения возможностей программирования Claude Opus 4.7 и GLM-5.1:

- SWE-Bench Pro: GLM-5.1 (58.4) на данный момент лидирует, однако результаты Opus 4.7 еще не опубликованы.

- Комплексные навыки кодинга: Серия Opus в целом впереди. Показатели Opus 4.7 в CursorBench (70%) и трехкратный прирост в Rakuten-SWE-Bench выглядят впечатляюще.

- Автономное программирование: Уникальная фишка GLM-5.1 — способность к 8-часовому циклу автономного выполнения задач.

- Контекстное окно: У Opus 4.7 оно составляет 1 млн токенов, что в 5 раз больше, чем у GLM-5.1, что дает явное преимущество при работе с крупными кодовыми базами.

- Разница в цене: Стоимость GLM-5.1 составляет лишь около 14% от стоимости Opus 4.7.

- Преимущество open-source: GLM-5.1 распространяется по лицензии MIT, что позволяет развертывать модель локально и свободно настраивать её под свои нужды.

Оптимальная стратегия — не выбирать что-то одно, а комбинировать обе модели: используйте Opus 4.7 для высокоуровневых задач, а GLM-5.1 — для частых и массовых операций. APIYI (apiyi.com) уже добавил обе модели в свой сервис-прокси API. Разработчики могут гибко переключаться между ними через единый интерфейс, добиваясь идеального баланса между эффективностью кодинга и затратами.

📚 Справочные материалы

-

VentureBeat — Релиз GLM-5.1 с открытым исходным кодом: Подробный отчет о лидерстве GLM-5.1 в SWE-Bench Pro.

- Ссылка:

venturebeat.com/technology/ai-joins-the-8-hour-work-day-as-glm-ships-5-1-open-source-llm-beating-opus-4 - Описание: Публикация в авторитетном технологическом издании с результатами бенчмарков.

- Ссылка:

-

MarkTechPost — Технический анализ GLM-5.1: Разбор агентной модели на 754 млрд параметров.

- Ссылка:

marktechpost.com/2026/04/08/z-ai-introduces-glm-5-1 - Описание: Детали архитектуры и анализ возможностей 8-часового автономного выполнения задач.

- Ссылка:

-

Anthropic — Анонс Claude Opus 4.7: Полная информация об обновлении.

- Ссылка:

anthropic.com/news/claude-opus-4-7 - Описание: Официальное заявление и данные тестирования Opus 4.7.

- Ссылка:

-

Страница GLM-5.1 на HuggingFace: Загрузка модели и документация.

- Ссылка:

huggingface.co/zai-org/GLM-5.1 - Описание: Веса модели под лицензией MIT и руководство по развертыванию.

- Ссылка:

-

Документация Claude API — Обзор моделей: Технические характеристики всех моделей Claude.

- Ссылка:

platform.claude.com/docs/en/about-claude/models/overview - Описание: Официальные параметры, цены и сравнение функционала.

- Ссылка:

Автор: Техническая команда APIYI

Обсуждение: Приглашаем к дискуссии в комментариях. Больше материалов доступно в центре документации APIYI по адресу docs.apiyi.com.