2026年4月21日、GoogleはGemini APIのパブリックプレビューにおいて、次世代の自律型エージェントであるDeep ResearchとDeep Research Maxの2モデルを同時にリリースしました。これらは今年2月に発表されたGemini 3.1 Proモデルをベースとしています。これは、Googleが「長期的な自律リサーチ」機能をコンシューマー向け製品から開発者向けAPIへと本格的に開放する重要な一歩となります。特にDeep Research Maxは、DeepSearchQAにおいて93.3%のスコアを記録し、Gemini 3.1 Proが持つARC-AGI-2での77.1%というコア推論能力を継承しており、これはGemini 3 Proの2倍以上の性能に相当します。

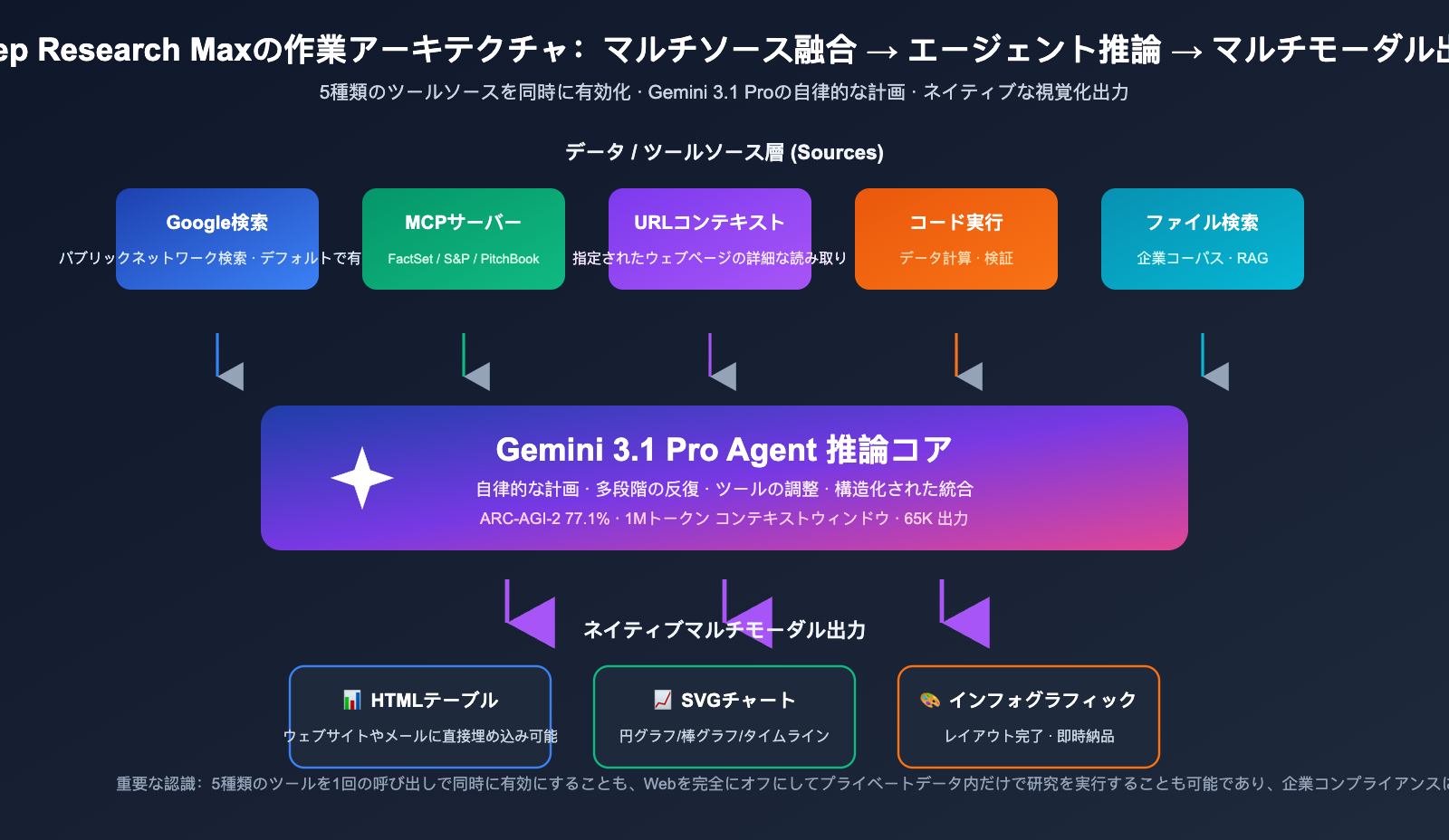

さらに重要なのは、今回のDeep Researchが3つのエンジニアリングレベルの新機能を導入した点です。MCP(Model Context Protocol)による任意のプライベートデータソースへの接続、ネイティブな可視化出力(HTMLテーブル / SVGチャート / インフォグラフィック)、そしてWebとプライベートデータのクロスソース統合です。これにより、開発者は初めて1回のAPI呼び出しで、パブリックWeb、社内イントラネット、サードパーティの専門データを同時に検索し、ダッシュボードに直接組み込める可視化レポートを生成させることが可能になりました。

本記事では、Googleの公式発表資料とGemini APIドキュメントに基づき、Deep Research Maxの4つの核心的なブレイクスルー、標準版との違い、ARC-AGI-2で77.1%を記録したことの真の意味、そして国内の開発者がこの能力をどのように導入すべきかについて詳しく解説します。

一、Deep Research Maxとは:Gemini 3.1 Pro駆動の自律型リサーチエージェント

Deep Researchは新しい概念ではありません。Googleは2024年末にGeminiアプリで基礎版を一般公開しており、AIがWeb検索を実行して引用付きのレポートを作成することができました。しかし、コンシューマー版は機能が制限されており、APIも公開されておらず、プライベートデータも扱えないため、エンジニアリングへの導入価値は限定的でした。

今回のDeep Research / Deep Research Maxは、アーキテクチャレベルでの書き直しが行われています。Googleはこれを「次世代の自律型リサーチエージェント」と定義しており、Web、MCPサーバー、URLコンテキスト、コード実行、ファイル検索など、多様なツールソースを横断して自律的に計画・実行・統合を行い、最終的に引用付きの構造化レポートを出力します。2つのバージョンが同時にリリースされ、それぞれ異なるエンジニアリングニーズに対応しています。

| 比較項目 | Deep Research (標準版) | Deep Research Max | 適用シーン |

|---|---|---|---|

| 最適化目標 | 速度とレイテンシ | 総合性と深さ | – |

| 推論時間 | 短い (秒〜分単位) | 長い (分〜時間単位) | – |

| テスト時計算 (test-time compute) | 標準 | 拡張 | – |

| マルチターン反復 | 1〜2回 | 多段階の深層推論 | – |

| 呼び出しモード | 同期 / リアルタイム対話 | 非同期 / バックグラウンドタスク | – |

| コスト | 低め | 高め | – |

| 代表的なユースケース | 対話型リサーチアシスタント、カスタマーサポート基盤 | 投資調査レポート、業界分析、デューデリジェンス | – |

Googleは公式ブログで、**「Deep Research Maxは、非同期の待ち時間を受け入れ、最高品質の総合的な成果を求めるワークフローのために設計されている」**と明言しています。企業内のデューデリジェンスや詳細な業界調査、長文レポートの自動生成を行う場合はMaxが適しており、C向けリアルタイム対話型のAIアシスタントには、標準版の低レイテンシが適しています。

💡 導入のアドバイス:Deep ResearchとMaxはどちらもGemini APIの有料ティアを通じて利用可能です。国内の開発者は、APIYI(apiyi.com)を通じてGemini 3.1 Proシリーズのインターフェースを直接呼び出すことができます。同プラットフォームはOpenAI互換プロトコルとして統合されており、国境を越えたネットワーク接続やアカウント登録の手間を省くことができます。

二、Deep Research Max の 4 つの核心的なブレイクスルー

今回のリリースで最も注目すべきは、エンジニアリング能力における4つの飛躍的なアップグレードです。これらが組み合わさることで、Deep Research Max は真の「企業向け自律型リサーチエージェント」としての形態を備えることになりました。

2.1 第1のブレイクスルー:ネイティブなMCPプロトコル対応、あらゆるサードパーティデータへの接続

Model Context Protocol (MCP) は Anthropic が主導するオープンプロトコルであり、AIエージェントが統一された方法であらゆる外部ツールやデータソースに接続できるようにすることを目的としています。Deep Research Max は、GoogleエコシステムにおいてMCPをファーストクラスの機能として統合した最初の製品です。開発者はプライベートデータやサードパーティデータをMCPサーバーとしてパッケージ化するだけで、エージェントはネイティブツールを呼び出すかのようにそれらを検索できるようになります。

Googleは発表会で、最初のMCPパートナーも公開しました。FactSet、S&P Global、PitchBookという金融データ大手がGoogleと協力してMCPサーバーを設計しており、共通の顧客はこれらの専門的な金融データストリームをDeep Researchのワークフローに直接接続できるようになります。これは、金融、法律、医療といった専門分野のリサーチエージェントが、データソースごとにアダプター層を書き直す必要のない、標準化された接続経路を手に入れたことを意味します。

2.2 第2のブレイクスルー:ネイティブな可視化出力、テキストのみのレポートからの脱却

従来のLLMの出力は基本的にマークダウン形式のテキストに限られており、グラフや図表を追加するには、描画APIやコードインタープリターを別途呼び出す必要がありました。Deep Research Max は推論プロセスの中でHTMLテーブル、SVGグラフ、インフォグラフィックを直接生成します。これらの可視化成果物は、後付けのパッチではなく、エージェントの推論フローの有機的な一部となっています。

実際の出力形態には、構造化されたHTMLテーブル(Webページに直接埋め込み可能)、スケーラブルなSVGグラフ(円グラフ、棒グラフ、タイムラインなど)、レイアウトが整ったインフォグラフィック(メールやSlackへの貼り付けに最適)が含まれます。プロジェクトにNano Bananaのような高品質な画像モデルが統合されていれば、Deep Researchはそれを呼び出してさらに複雑なビジュアルコンテンツを生成することも可能です。この変更により、Deep Researchの出力は「引用付きの長いマークダウン」から「ダッシュボードに直接埋め込めるマルチモーダルレポート」へと進化しました。

2.3 第3のブレイクスルー:Webとプライベートデータのクロスソース融合

従来のDeep Researchは公開Web情報の検索しかできませんでしたが、企業ユーザーにとっての最大の課題である「SaaS内のドキュメント、CRMデータ、ERPレポートなどのプライベート情報をリサーチに統合する」という点が解決できていませんでした。新バージョンでは、1回のAPI呼び出しでGoogle検索、リモートMCPサーバー、URLコンテキスト、コード実行、ファイル検索を同時に有効化でき、エージェントがどのツールを使うべきかを自律的に判断します。

さらに重要なのは、開発者がWebアクセスを完全に遮断し、エージェントを指定されたプライベートデータソース内でのみリサーチさせることも可能な点です。金融、法律、医療などデータコンプライアンスに厳しい業界にとって、このスイッチは真の「鍵」となります。内部情報が誤って公開Web検索クエリに漏洩することを防げるためです。これは企業でのAI導入において長らく見過ごされてきましたが、極めて重要なコンプライアンス上の詳細です。

2.4 第4のブレイクスルー:性能の飛躍 – 3つの主要ベンチマークで全面向上

Googleが公開した公式ベンチマーク比較によると、Deep Research Maxは2024年12月版と比較して大幅な性能向上を達成しています。

| ベンチマーク | 2024年12月版 | Deep Research Max (2026/04) | 向上幅 |

|---|---|---|---|

| DeepSearchQA | 66.1% | 93.3% | +27.2ポイント |

| Humanity's Last Exam | 46.4% | 54.6% | +8.2ポイント |

| ARC-AGI-2 (ベースモデル) | 31.1% (Gemini 3 Pro) | 77.1% (Gemini 3.1 Pro) | 2倍以上 |

DeepSearchQAベンチマークは、自律的なWeb検索と総合的な推論能力を評価するもので、93.3%というスコアは上限に迫るものです。これは、Deep Research Maxが「自律的に資料を検索し、正確な回答を作成する」という核心的なタスクにおいて、競合他社に差をつけられることはほぼないことを意味しています。

三、ARC-AGI-2 77.1% の真の意味

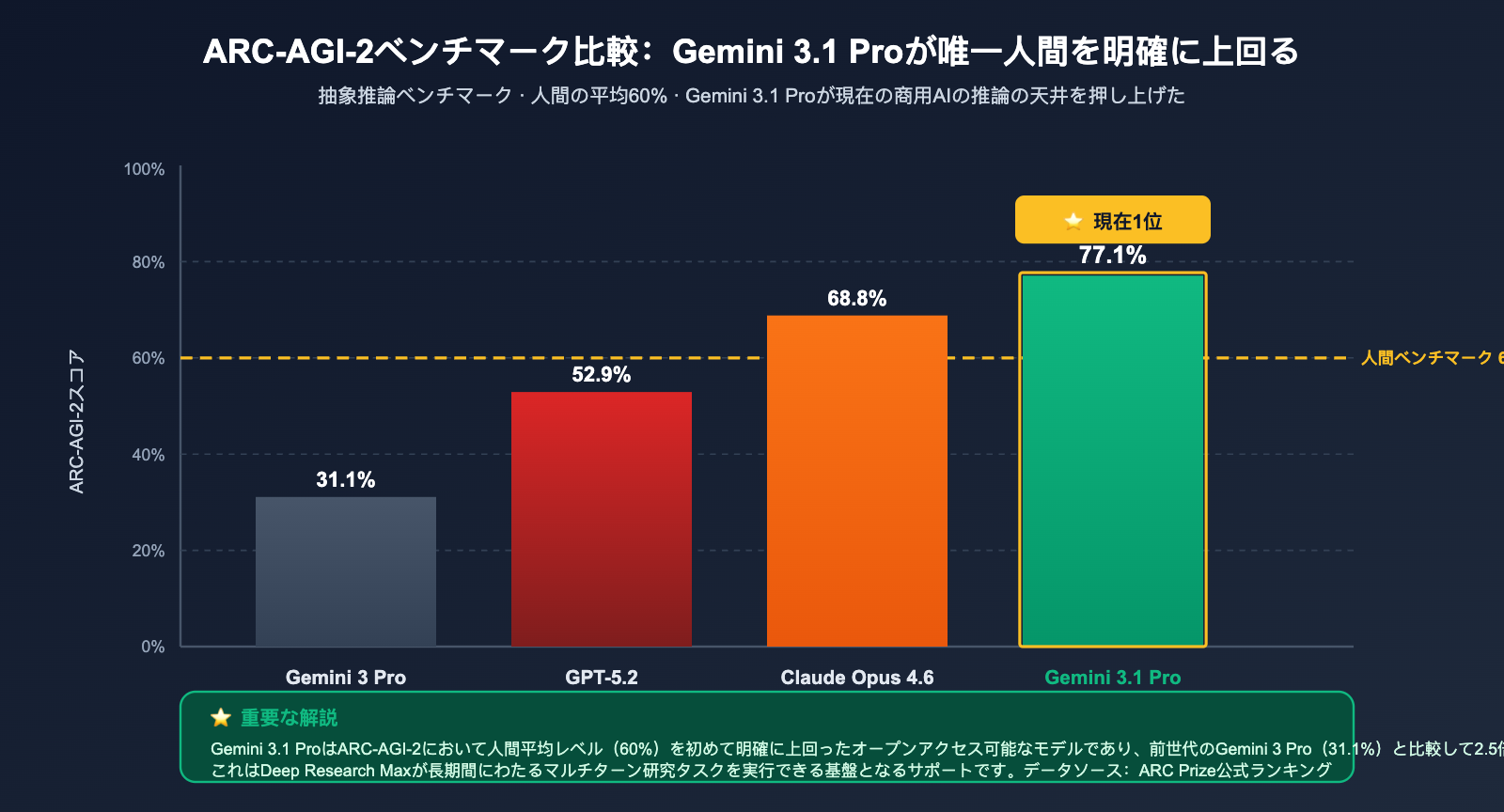

多くの開発者は「77.1%」という数字を見て「悪くないな」と直感的に思うかもしれませんが、ARC-AGI-2 というベンチマークの難易度を理解して初めて、このスコアが持つ真の価値が分かります。

3.1 ARC-AGI-2 とは何か

ARC-AGI-2 は ARC Prize 組織によって管理されており、AI が完全に新しい、学習データには一切含まれていない論理パターンに対する抽象的推論能力をテストするために設計されています。いくつかの例(入力と出力のペア)を通じてモデルに暗黙のルールを推論させ、そのルールを使って未知の新しい入力を解かせます。人間の平均スコアは 60% であるため、77.1% という数値はすでに人間の平均レベルを超えていることを意味します。

このベンチマークの核心的な難しさは、モデルが記憶に頼ってスコアを稼ぐことができない点にあります。すべてのパターンは新しく生成されるものであり、学習データとは無関係です。これが、ARC-AGI-2 が業界で「真の抽象的推論能力」を測定するためのゴールドスタンダードの一つと見なされている理由です。

3.2 横断的比較:Gemini 3.1 Pro が現在最強

| モデル | ARC-AGI-2 スコア | 人類基准 (60%) との比較 | 備考 |

|---|---|---|---|

| Gemini 3.1 Pro | 77.1% | +17.1 pp | 人類を明確に上回った初のオープンモデル |

| Claude Opus 4.6 | 68.8% | +8.8 pp | Anthropic のフラッグシップ |

| 人類基准 | 60.0% | – | 平均レベル |

| GPT-5.2 | 52.9% | -7.1 pp | OpenAI |

| Gemini 3 Pro | 31.1% | -28.9 pp | 前世代 |

ご覧の通り、Gemini 3.1 Pro はすべての商用大規模言語モデルを凌駕しただけでなく、人間基準を明確に上回った唯一のオープンアクセス可能なモデルです。これは商用 AI が「未知の論理推論」という厳格なベンチマークにおいて、初めて人間との差を広げた瞬間と言えます。Deep Research Max はこの推論能力を直接継承しており、長期間かつ多段階の反復研究タスクを実行できる基盤となっています。

🎯 活用アドバイス:研究、コンサルティング、投資分析、法務分析など、高度な推論が求められるシナリオで製品開発を行っている場合、Gemini 3.1 Pro + Deep Research Max の組み合わせを直ちに技術評価の対象に加えるべきです。APIYI (apiyi.com) プラットフォームを通じて、Gemini 3.1 Pro を含む複数のフラッグシップモデルを OpenAI 互換 API で迅速にテスト・導入できます。

四、Deep Research Max API クイックスタート

理論はここまでにして、実際に動作する最小限の呼び出しコードを紹介します。Deep Research Max は Gemini API 標準インターフェースを採用しており、有料プランでプレビュー公開されています。

4.1 基本的な呼び出し:Agent に Web リサーチを実行させる

from google import genai

from google.genai import types

# APIYIの統合中継サービスを経由して接続し、国境を越えたネットワーク問題を回避

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com"}

)

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="2026年前半のグローバルな埋め込みモデル市場の状況を分析し、トップ5のベンダーとその差別化要因を挙げてください",

config=types.GenerateContentConfig(

tools=[types.Tool(google_search={})], # Google検索を有効化

thinking_config=types.ThinkingConfig(thinking_level="max") # Maxレベルの思考予算

)

)

print(response.text) # 完全なリサーチレポートを出力(ネイティブHTMLテーブル/SVGグラフを含む)

このコードでは3つのことを行っています。Deep Research Max モデルの選択、Google Search ツールの有効化、そして最高レベルの思考設定です。Agent は自律的に検索パスを計画し、複数回の反復分析を経て、引用と可視化を含む完全なレポートを作成します。

4.2 高度な呼び出し:MCPサーバーを接続してプライベートデータリサーチを行う

Deep Research Max を使って社内データ(CRMや社内Wikiなど)を調査したい場合は、データソースをMCPサーバーとしてカプセル化し、呼び出し時に宣言する必要があります。

response = client.models.generate_content(

model="deep-research-max-preview-04-2026",

contents="社内のQ1販売パイプラインにおいて、離脱率が最も高い顧客タイプを分析してください",

config=types.GenerateContentConfig(

tools=[

types.Tool(mcp_servers=[

{"url": "https://your-internal-mcp.company.com", "auth": "..."}

]),

types.Tool(file_search={"corpora": ["sales-docs-corpus"]}),

],

thinking_config=types.ThinkingConfig(thinking_level="max")

)

)

ここでは google_search を有効にしていない点に注目してください。これは Agent が完全にプライベートデータ内でのみリサーチを行い、Google に対して外部クエリを一切送信しないことを意味します。これは企業のコンプライアンス要件において最も重要な機能です。

4.3 標準版とMax版の切り替え

C向け(エンドユーザー向け)のリアルタイム対話など、深さよりも速度が重要なシナリオでは、モデル名を deep-research-preview-04-2026 に変更するだけです。両者のインターフェースは完全に互換性があり、違いは内部の計算予算と反復回数のみです。

💡 クイック試用のアドバイス:初めて接続する場合は、まず標準版の Deep Research でいくつかデモを実行して Agent の出力スタイルに慣れ、その後 Max にアップグレードして実際の業務タスクを実行することをお勧めします。APIYI (apiyi.com) プラットフォーム経由での接続を推奨します。同プラットフォームは Gemini 3.1 Pro、Deep Research、Deep Research Max を含む複数のモデルの OpenAI 互換呼び出しをサポートしており、切り替えや比較が容易です。

五、Deep Research Max がもたらす影響:どのようなワークフローが再構築されるか

新しいツールのリリースは始まりに過ぎません。真の価値は、それが既存のワークフローをどう変えるかにあります。リリース資料とコミュニティからの初期フィードバックに基づくと、以下の4つの分野が最も大きな影響を受けるでしょう。

5.1 投資リサーチと業界分析

これは Google が発表会で明確に挙げたシナリオです。FactSet、S&P Global、PitchBook の3社が連携して MCP サーバーを構築しており、バイサイドのアナリストが自然言語の指示一つで、財務データ、業界リサーチ、M&Aデータベースを同時に呼び出し、自動的に可視化されたレポートを作成することを目指しています。本来2日かかっていた初稿が、30分で作成可能になるかもしれません。これはアナリストの代替ではなく、機械的な資料検索から彼らを解放するものです。

5.2 企業のデューデリジェンスとコンプライアンス審査

法務やコンプライアンスチームがデューデリジェンスを行う際の最大の悩みは、「公開情報と内部文書の両方を調査しなければならない」点です。Deep Research Max の「プライベートデータのみ」モードにより、弁護士は検索エンジンに記録される心配をすることなく、安心して顧客データを Agent に渡して分析させることができます。ネイティブな可視化出力と組み合わせることで、最終的なデューデリジェンスレポートは Notion や Confluence に直接埋め込むことが可能です。

5.3 学術レビューと文献調査

学者がレビュー論文を書く際に最も時間がかかるのは、200本以上の文献を素早く消化して論点のフレームワークを作ることです。Deep Research Max の多段階の深い推論能力を使えば、一度の呼び出しで数十本の PDF を読み込み、構造化されたアウトラインを生成できます。1M トークンのコンテキストウィンドウと組み合わせることで、単一の呼び出しで研究分野全体の核心となる文献を網羅的に把握できます。

5.4 SaaS 製品における AI アシスタントのアップグレード

多くの SaaS 製品にはすでに AI Copilot が搭載されていますが、その実装の多くは「GPT-4 + RAG をラップしただけ」のものです。Deep Research 標準版(低遅延)は、こうした製品にアップグレードの道筋を与えました。Copilot を真の自律型 Agent に置き換えることで、Web データ、製品内データ、ユーザーのプライベートデータを横断的に統合し、単なるキーワード検索を超えた回答が可能になります。

6. Deep Research Max と競合製品の比較

Deep Research Max を業界の立ち位置から見てみましょう。現在主流となっている「リサーチ / 高度な推論」製品は、大きく分けて3つのカテゴリーに分類できます。

| 製品 | ベンダー | 自律リサーチ | MCP対応 | ネイティブ可視化 | プライベートデータ | 総合評価 |

|---|---|---|---|---|---|---|

| Deep Research Max | ✅ 多段階深度 | ✅ ファーストクラス | ✅ HTML/SVG ネイティブ | ✅ Webオフモード | ⭐⭐⭐⭐⭐ | |

| OpenAI Deep Research | OpenAI | ✅ 多段階 | 一部 | 一部 | 一部 | ⭐⭐⭐⭐ |

| Anthropic Claude Research | Anthropic | ✅ | ✅ MCPネイティブ | ❌ テキスト中心 | ✅ | ⭐⭐⭐⭐ |

| Perplexity Deep Research | Perplexity | ✅ Web中心 | ❌ | 一部 | ❌ | ⭐⭐⭐ |

| 自社構築 RAG + Agent | 各社 | 実装による | 実装による | 自社開発が必要 | ✅ | ⭐⭐ |

Deep Research Max は、多段階の深度推論、MCPのファーストクラスサポート、ネイティブ可視化、プライベートデータのクロスソース統合という4つのコア次元において、最も完成度が高いことがわかります。これは現在の商用製品の中で、最もエンジニアリング的に成熟したリサーチエージェントソリューションと言えます。

📌 選定のアドバイス: 高度な推論、プライベートデータのコンプライアンス、可視化された出力をすべて求めるアプリケーションであれば、Deep Research Max が現在の最適解です。軽量なWeb検索アシスタントのみが必要な場合は、Perplexity または Deep Research の標準版を選択してください。APIYI (apiyi.com) を利用すれば、これら複数のモデルを一括で接続・比較できるため、各プロバイダーの認証やインターフェースを個別に設定する手間を省くことができます。

7. Deep Research Max に関するよくある質問 (FAQ)

Q1: Deep Research Max と通常の Gemini 3.1 Pro の違いは何ですか?

Gemini 3.1 Pro は推論能力を提供する基盤モデルです。一方、Deep Research Max は 3.1 Pro をベースに構築された自律リサーチエージェントであり、複数のツール呼び出し、多段階の反復処理、ネイティブ可視化といったエージェント機能が統合されています。簡単に言えば、3.1 Pro が「脳」であり、Deep Research Max は「手足とツールを備えた研究員」です。

Q2: 日本の開発者はどのように Deep Research Max を呼び出せますか?

Deep Research Max は Gemini API の有料階層機能です。直接利用する場合は、海外のネットワークや決済手段の準備が必要です。最も簡単な方法は、APIYI (apiyi.com) のような統合プラットフォームを経由することです。日本円での支払いが可能で、公式と完全に互換性のあるインターフェースを通じて、Gemini 3.1 Pro シリーズを含む複数のモデルを一括で利用できます。

Q3: Deep Research Max は標準版よりどれくらい高いですか?

Google は具体的な倍率を公表していませんが、「テスト時の計算リソースの拡張、多段階の深度反復」という説明から、Max の単一呼び出しコストは標準版よりも大幅に高く、3〜10倍程度になると推測されます。価値の高いタスク以外は標準版で実行し、高度な深度が必要な場合にのみ Max に切り替えることをお勧めします。

Q4: 自分で MCP サーバーを作成して Deep Research Max に接続できますか?

可能です。MCP はオープンプロトコルであるため、どのチームでも仕様に従って独自の MCP サーバーを実装し、ERP、CRM、社内ナレッジベースなどのデータを標準インターフェースとしてエージェントに公開できます。Google もコミュニティによる MCP サーバーの実装を歓迎しています。

Q5: Deep Research Max の出力をウェブページに直接埋め込めますか?

はい。ネイティブ出力には HTML テーブル、SVG チャート、構造化されたレイアウトが含まれており、これらをウェブページ、ダッシュボード、メールなどに直接埋め込むことができます。これは、従来の LLM 出力と比較した際の Deep Research Max の決定的な強みの一つです。

Q6: Web アクセスを完全に無効にした場合でも、エージェントは機能しますか?

はい。エージェントは、ユーザーが指定した MCP サーバー、ファイル検索用のコーパス、URL コンテキストなどのプライベートデータソース内でのみリサーチを行います。これこそが、データが企業の境界から一切出ないことを求める企業コンプライアンス環境における主要な利用形態です。

Q7: Deep Research Max のコンテキストウィンドウのサイズは?

Gemini 3.1 Pro を継承しており、入力コンテキストは 1,048,576 トークン(約1M)、出力は最大 65,536 トークン(約65K)です。つまり、一度の呼び出しで数十本の長い論文や、製品ドキュメント全体を処理することが可能です。

Q8: ARC-AGI-2 で 77.1% を記録したということは、Gemini 3.1 Pro の汎用能力がすべて最強ということですか?

そう単純に断定することはできません。ARC-AGI-2 は抽象推論を測定するものであり、77.1% というスコアは Gemini 3.1 Pro がその特定の次元で優れていることを示しています。しかし、コード生成、マルチモーダル、日本語理解などの他の次元については、それぞれのベンチマークを確認する必要があります。総合的なパフォーマンスで見ると、Gemini 3.1 Pro は現在第一線で活躍するフラッグシップモデルの一つです。

Q9: Deep Research Max は RAG システムを置き換えますか?

短期的には完全に置き換わることはなく、補完関係になるでしょう。RAG は「特定の企業データを正確に取得する」というシナリオにおいて、コストと遅延の面で依然として代替不可能な強みを持っています。Deep Research Max は「複数ソースの統合、深度推論、可視化出力」を必要とする高価値なタスクに適しています。ベストプラクティスは、日常的な質問には RAG を使い、高度なニーズが発生した際に Deep Research Max にアップグレードすることです。

Q10: 日本語環境での Deep Research Max のパフォーマンスはどうですか?

Gemini 3.1 Pro は日本語を含む多言語能力を備えており、Deep Research Max もその基盤を継承しています。ただし、Google 検索ツールはデフォルトで英語が優先される傾向があるため、日本語でのリサーチタスクを行う際は、Google 検索の日本語ドメイン設定と日本語対応の MCP サーバーを併用することで、情報の網羅性を大幅に向上させることができます。

8. まとめ:Deep Research Max 実装の核心ポイント

本記事の振り返りとして、開発者が Google Deep Research Max について覚えておくべき核心ポイントをまとめます。

第一に、Deep Research Max は 2026 年最も注目すべき自律型リサーチエージェントです。「MCP サポート」「ネイティブ可視化」「クロスソース統合」「パフォーマンスの飛躍」という4つの核心的なブレイクスルーにより、エンタープライズレベルのリサーチエージェントを実用段階へと一気に押し上げました。第二に、2つのバージョンの使い分けです。標準版は速度とレイテンシを最適化しておりリアルタイム対話に適しており、Max 版は深さと包括性を最適化しており非同期の深掘りタスクに適しています。シナリオに応じて選択してください。第三に、ARC-AGI-2 での 77.1% というスコアは単なる数字遊びではありません。これは、基盤となる Gemini 3.1 Pro が「抽象的推論」という核心能力において、すでに人間の平均レベルを明確に超えたことを意味します。Deep Research Max のツール呼び出しフレームワークと組み合わせることで、長期間にわたる複雑なリサーチタスクにおいて、ついに商用利用可能なソリューションが実現しました。

第四に、MCP プロトコルは次世代エージェントの事実上の標準(デファクトスタンダード)になるということです。Google がこれを一等市民としてサポートしたことは明確なシグナルです。Anthropic も MCP の推進役であり、Cursor や Claude Desktop などですでにサポートが進んでいることから、エコシステム全体が MCP を中心に形成されつつあります。開発者が今、MCP サーバーの学習と実装に投資することは、非常に ROI(投資対効果)の高い選択です。第五に、国内からの接続経路は明確です。Deep Research / Max は Gemini API の有料プレビュー階層を利用します。APIYI(apiyi.com)のような統一された API 中継サービスを利用すれば、登録から支払い、呼び出しまでの全プロセスを迅速に完了でき、国境を越えたネットワーク環境や海外クレジットカードの問題を自力で解決する必要はありません。

🎯 最終アドバイス:もしあなたがリサーチ、コンサルティング、分析、教育、法律関連の AI プロダクトを構築しているなら、今すぐ Deep Research Max を技術選定の評価対象に加えてください。これは現在の商用 AI エージェントエンジニアリングにおける最高水準を示しており、いち早く取り組んだ者がプロダクトの差別化という最大の恩恵を受けることになります。APIYI(apiyi.com)プラットフォームを通じて迅速に接続テストを行い、Gemini 3.1 Pro の 1M コンテキストウィンドウとマルチモーダル能力を組み合わせることで、従来の RAG やインテリジェントカスタマーサービス、コンテンツ生成といったシナリオを、次世代の自律型エージェント形態へと進化させましょう。

Deep Research Max のリリースは始まりに過ぎません。Google はブログの中で、これを「自律型リサーチエージェントにとっての段階的な変化(a step change for autonomous research agents)」であると明言しています。このツール進化の窓口を掴めるかどうかが、2026 年後半における AI プロダクトの競争力を決定づけるでしょう。

著者:APIYI 技術チーム | AI 大規模言語モデルの実装実戦に注目。その他の技術コンテンツは APIYI(apiyi.com)をご覧ください。