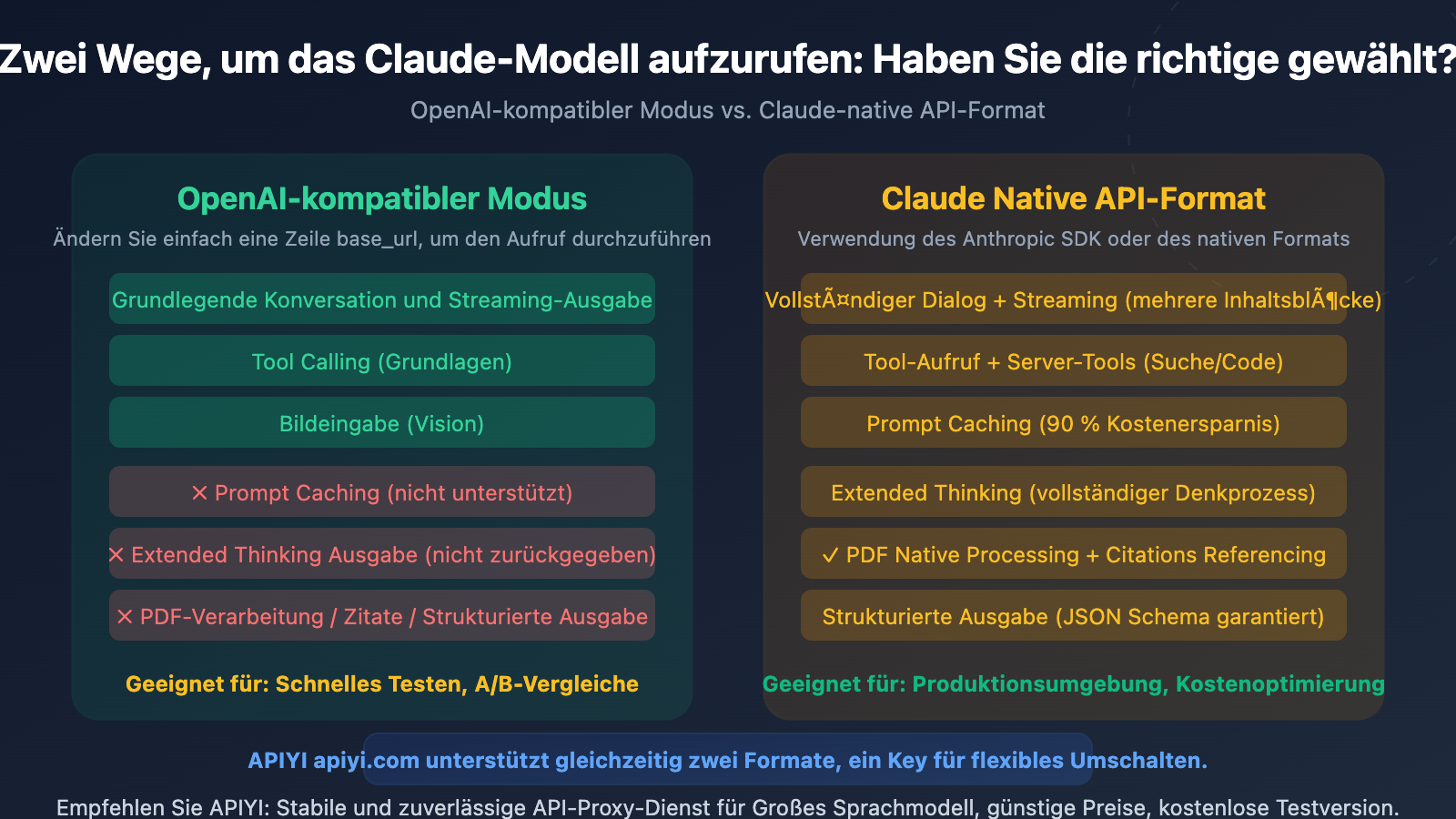

Autorhinweis: Detaillierter Vergleich von 7 wesentlichen Unterschieden zwischen dem OpenAI-kompatiblen Modus und dem nativen Claude-API-Format, einschließlich der Unterstützung für Funktionen wie Prompt Caching, Extended Thinking und Tool Calling, um Ihnen bei der Wahl der optimalen Integrationsmethode zu helfen.

Das Aufrufen von Claude-Modellen mit dem OpenAI SDK scheint praktisch – nur eine Änderung der base_url – doch dabei riskieren Sie, bis zu 90% der Kosteneinsparungen durch Prompt Caching zu verlieren, den Extended Thinking-Denkprozess nicht zu erhalten und die native PDF-Verarbeitungsfähigkeit einzubüßen. Dieser Artikel vergleicht 7 entscheidende Unterschiede zwischen diesen beiden Integrationsansätzen, um Ihnen die richtige Wahl zu erleichtern.

Kernaussage: Nach diesem Artikel wissen Sie genau, ob Sie für Ihren Anwendungsfall den OpenAI-kompatiblen Modus oder das native Claude-Format wählen sollten, und vermeiden so unnötige Kosten oder Funktionsverluste. Die zentrale Erkenntnis ist: Wenn Sie Claude-Modelle nutzen, sollten Sie diese vorrangig im nativen Format aufrufen, nicht im OpenAI-kompatiblen Modus.

Kernunterschiede: OpenAI-kompatibler Modus vs. natives Claude-Format

| Unterschied | OpenAI-kompatibler Modus | Natives Claude-Format | Auswirkung |

|---|---|---|---|

| Prompt Caching | ✗ Nicht unterstützt | ✓ Unterstützt (spart bis zu 90% Kosten) | ⭐⭐⭐⭐⭐ Sehr hoch |

| Extended Thinking | ✗ Kein Rückgabe des Denkprozesses | ✓ Vollständige Rückgabe der Gedankenkette | ⭐⭐⭐⭐⭐ Sehr hoch |

| System-Eingabeaufforderung | Mehrere werden zu einer zusammengeführt | Unabhängiges Top-Level-Feld | ⭐⭐⭐ Mittel |

| Tool Calling | Grundlegende Unterstützung | Vollständige Unterstützung + serverseitige Tools | ⭐⭐⭐⭐ Hoch |

| PDF-Verarbeitung | ✗ Nicht unterstützt | ✓ Native document-Typen |

⭐⭐⭐⭐ Hoch |

| Strukturierte Ausgabe | ✗ strict wird ignoriert |

✓ JSON Schema garantiert | ⭐⭐⭐⭐ Hoch |

| Citations (Zitate) | ✗ Nicht unterstützt | ✓ Präzise Quellenangabe | ⭐⭐⭐ Mittel |

Der wesentliche Unterschied zwischen OpenAI-kompatibler und nativer Claude-API

Vereinfacht gesagt ist der OpenAI-kompatible Modus eine Übersetzungsschicht – sie übersetzt Anfragen im OpenAI-Format in ein für Claude verständliches Format und übersetzt Claudes Antworten zurück ins OpenAI-Format. Dieser Übersetzungsprozess ist verlustbehaftet: Die verschiedenen Inhaltstypen (thinking, text, tool_use, citations), die die native Claude-API unterstützt, werden bei der Rückübersetzung in eine einzelne content-Zeichenkette abgeflacht.

Anthropic stellt klar: Der OpenAI-kompatible Endpunkt dient hauptsächlich zum "Testen und Vergleichen von Modellfähigkeiten" und ist keine langfristige oder produktionsreife Lösung.

Vergleich der Anfragestruktur: OpenAI-kompatibel vs. natives Claude-Format

Der direkteste Unterschied im Code ist die Position der System-Eingabeaufforderung und die Struktur der Antwort:

# ====== OpenAI-kompatibler Modus ======

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://vip.apiyi.com/v1" # Über APIYI integrieren

)

# System-Eingabeaufforderung im messages-Array

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Du bist ein Technikexperte"},

{"role": "user", "content": "Erkläre Tokenizer"}

]

)

# Antwort ist eine einzelne content-Zeichenkette

print(response.choices[0].message.content)

Code für die native Claude-API anzeigen

# ====== Natives Claude-API-Format ======

import anthropic

client = anthropic.Anthropic(

api_key="your-api-key",

base_url="https://vip.apiyi.com" # Über APIYI integrieren

)

# System-Eingabeaufforderung ist ein unabhängiges Top-Level-Feld

response = client.messages.create(

model="claude-sonnet-4-6",

system="Du bist ein Technikexperte", # Unabhängiges Feld, nicht in messages

messages=[

{"role": "user", "content": "Erkläre Tokenizer"}

],

max_tokens=1024

)

# Antwort ist ein Array mit mehreren Inhaltstypen

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"Denkprozess: {block.thinking}")

🎯 Integrationsempfehlung: APIYI (apiyi.com) unterstützt sowohl das OpenAI-kompatible Format als auch das native Claude-Format. Wenn Sie bereits das OpenAI SDK nutzen und nur grundlegende Dialogfunktionen benötigen, ist der kompatible Modus ein schneller Einstieg. Benötigen Sie jedoch Prompt Caching oder Extended Thinking, empfehlen wir den Wechsel zum nativen Format.

Unterschied 1: Prompt Caching (größter Kosteneinfluss)

Dies ist der wichtigste Unterschied zwischen den beiden Formaten. Das Prompt Caching von Claude kann die Eingabekosten für wiederholte Inhalte um 90% senken, aber der OpenAI-kompatible Modus unterstützt diese Funktion überhaupt nicht.

| Details zum Prompt Caching | Claude natives Format | OpenAI-kompatibler Modus |

|---|---|---|

| Cache-Steuerungsmarkierung | cache_control Parameter |

✗ Nicht unterstützt |

| 5-Minuten-Cache (Schreiben 1,25x) | ✓ | ✗ |

| 1-Stunden-Cache (Schreiben 2x) | ✓ | ✗ |

| Cache-Treffer lesen (0,1x) | ✓ Spart 90% | ✗ |

| Cache-Nutzungsstatistik | ✓ Gibt detaillierte Daten zurück | ✗ Feld ist immer leer |

| Mindest-Cache-Schwelle | Opus: 4.096 / Sonnet 4.6: 2.048 | — |

Wie groß ist der tatsächliche Kostenunterschied? Nehmen wir einen typischen Agenten-Workflow als Beispiel: Jede Gesprächsrunde enthält etwa 10.000 Token für System-Eingabeaufforderungen und Werkzeugdefinitionen. In 10 Gesprächsrunden:

- Ohne Caching (OpenAI-kompatibler Modus): 10 Runden × 10.000 Token = 100.000 Input Token zum vollen Preis

- Mit Caching (Claude natives Format): Erste Runde voller Preis + 9 Runden Cache-Treffer (0,1x) = 10.000 + 9.000 = 19.000 äquivalente Token

Kostenreduktion von etwa 81%. Je mehr Gesprächsrunden, desto deutlicher wird der Kostenvorteil durch Prompt Caching.

Unterschied 2: Extended Thinking (Schlussfolgerungsfähigkeit)

Das Extended Thinking von Claude ermöglicht es dem Modell, vor der Antwort eine tiefgehende Schlussfolgerung durchzuführen. Obwohl Extended Thinking im OpenAI-kompatiblen Modus über extra_body aktiviert werden kann, wird der Denkprozess nicht an Sie zurückgegeben – Sie sehen nur die endgültige Antwort.

# OpenAI-kompatibler Modus —— Kann Denken auslösen, aber der Denkprozess ist nicht sichtbar

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "Wie löst man diese Matheaufgabe?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content enthält nur die endgültige Antwort

# Der Denkprozess wird verbraucht, aber nicht zurückgegeben ❌

Im nativen Claude-Format können Sie den vollständigen thinking-Inhaltsblock abrufen, was für Debugging, Auditierung und komplexe Schlussfolgerungsszenarien sehr wichtig ist.

Unterschied 3: Werkzeugaufrufformat

Beide Formate unterstützen Werkzeugaufrufe, aber es gibt einige wichtige Unterschiede:

| Unterschiede bei Werkzeugaufrufen | OpenAI-kompatibler Modus | Claude natives Format |

|---|---|---|

| Werkzeugdefinitionsstruktur | function.parameters |

input_schema |

| Serverseitige Werkzeuge (Suche/Code-Ausführung) | ✗ Nicht unterstützt | ✓ web_search / code_execution |

strict-Modus (Ausgabegarantie) |

✗ Wird ignoriert | ✓ JSON Schema Garantie |

| Werkzeug-Caching | ✗ Nicht unterstützt | ✓ cache_control |

| Parallele Werkzeugaufrufe | ✓ Unterstützt | ✓ Unterstützt |

Unterschied 4-7: Weitere wichtige Unterschiede

Unterschied 4: PDF-Dokumentverarbeitung. Die native Claude-API unterstützt Inhaltsblöcke vom Typ type: "document" und kann PDF-Dateien direkt verarbeiten und strukturierte Inhalte extrahieren. Inhalte vom Typ file werden im OpenAI-kompatiblen Modus einfach ignoriert.

Unterschied 5: Strukturierte Ausgabe. Die Parameter response_format und strict werden im OpenAI-kompatiblen Modus ignoriert, es kann keine Garantie gegeben werden, dass die Ausgabe strikt dem JSON Schema folgt. Das native Claude-Format unterstützt Schema-Garantien über output_config.format.

Unterschied 6: Zitate (Citations). Das native Claude-Format kann genaue Zitatpositionen (Dokumentindex, Zeichenposition) zurückgeben, was sich für die Quellennachverfolgung in RAG-Szenarien eignet. Der OpenAI-kompatible Modus hat kein entsprechendes Feld.

Unterschied 7: Ignorierte Parameter. Die folgenden OpenAI-Parameter werden beim Aufruf von Claude stillschweigend ignoriert: frequency_penalty, presence_penalty, seed, logprobs, logit_bias, n (muss 1 sein). Ein temperature-Wert über 1 wird automatisch auf 1 gekappt.

🎯 Wichtiger Hinweis: Wenn Ihr Code auf

frequency_penaltyoderpresence_penaltyangewiesen ist, um den Ausgabestil zu steuern, müssen Sie beim Wechsel zu Claude beachten, dass diese Parameter nicht wirksam sind. Es wird empfohlen, ähnliche Effekte durch Anpassung der System-Eingabeaufforderung zu erzielen. Bei der Anbindung über APIYI apiyi.com kümmert sich die Plattform um diese Kompatibilitätsdetails.

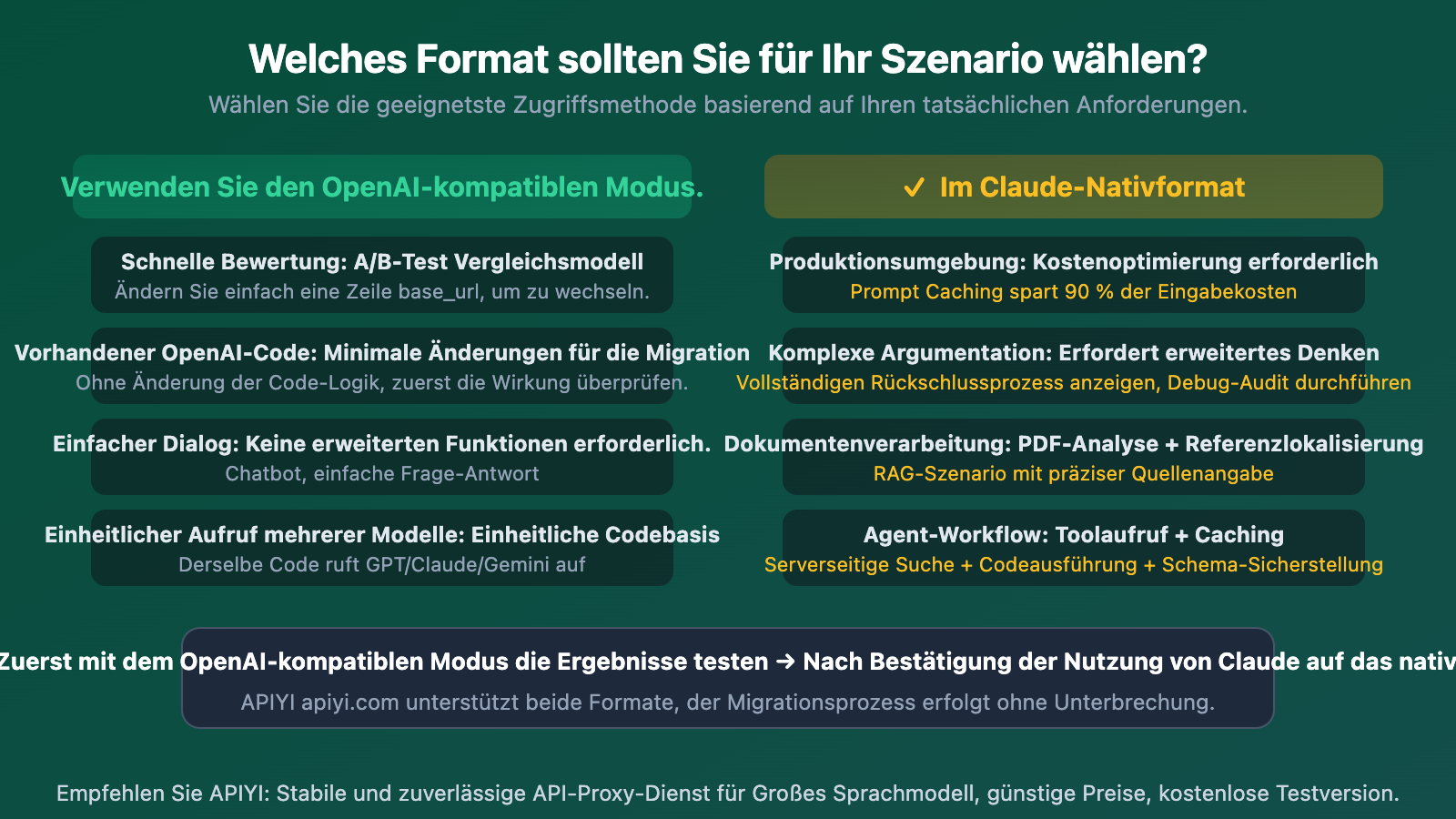

OpenAI-kompatibler Modus vs. Claude-natives Format: Szenarioauswahl

| Anwendungsfall | Empfohlenes Format | Hauptgrund |

|---|---|---|

| Schnelle Evaluierung / A-B-Tests | OpenAI-kompatibel | Nur base_url ändern, keine Code-Anpassungen |

| Migration bestehender OpenAI-Projekte | Zuerst OpenAI-kompatibel → dann natives Format | Zuerst Funktionalität prüfen, dann schrittweise migrieren |

| Produktive Langzeit-Konversationen | Claude-natives Format | Prompt Caching spart 80%+ der Kosten |

| Agenten / Tool-Aufrufe intensiv | Claude-natives Format | Serverseitige Tools + Caching + Schema-Sicherheit |

| PDF / RAG-Szenarien | Claude-natives Format | Native Dokumentenverarbeitung + Zitationsreferenzen |

| Einheitlicher Code für mehrere Modelle | OpenAI-kompatibel | Ein Code für GPT/Claude/Gemini |

🎯 Migrationsempfehlung: Der Wechsel vom OpenAI-kompatiblen Modus zum nativen Claude-Format erfordert hauptsächlich: (1) Extrahieren der Systemnachricht aus dem

messages-Array in ein eigenes Top-Level-Feld; (2) Ändern der Tool-Definition vonparameterszuinput_schema; (3) Verarbeitung der mehrteiligen Inhaltsstruktur in der Antwort. Der Zugang über APIYI (apiyi.com) kann diesen Prozess vereinfachen.

Häufig gestellte Fragen

F1: Werden beim Aufruf von Claude im OpenAI-kompatiblen Modus Funktionen fehlen, die beim Aufruf von GPT verfügbar sind?

Ja, einige. Beim Aufruf von Claude im OpenAI-kompatiblen Modus werden Parameter wie frequency_penalty, presence_penalty, seed, logprobs und response_format stillschweigend ignoriert. Beim Aufruf von GPT sind diese Parameter wirksam. Wenn Ihr Code also von diesen Parametern abhängt, sollten Sie beim Wechsel von GPT zu Claude darauf achten. Kernfunktionen wie Dialoge, Streaming-Ausgaben und einfache Tool-Aufrufe funktionieren jedoch vollständig.

F2: Können das native Claude-Format und das OpenAI-Format gemischt verwendet werden?

Ja. APIYI (apiyi.com) unterstützt beide Formate gleichzeitig. Sie können in einem Projekt für einfache Dialoge das OpenAI-kompatible Format verwenden (spart Entwicklungszeit) und für Agenten-Workflows, die von Prompt Caching profitieren, das native Claude-Format (spart Token-Kosten). Beide Formate verwenden denselben API-Schlüssel.

F3: Ist der Wechsel vom OpenAI-kompatiblen Modus zum nativen Claude-Format schwierig?

Der Aufwand ist überschaubar, es gibt hauptsächlich 3 Änderungen:

- SDK von

openaiaufanthropicwechseln (oder direkt HTTP-Anfragen verwenden) - Die System-Eingabeaufforderung aus dem

messages-Array in ein eigenessystem-Feld extrahieren - Die Antwortverarbeitung von

choices[0].message.contentauf das Durchlaufen descontent-Arrays umstellen

Wenn Sie über APIYI (apiyi.com) zugreifen, bietet die Plattform einheitliche Dokumentation und Codebeispiele für beide Formate, was die Migration erleichtert.

Zusammenfassung

Die Kernkriterien für die Wahl zwischen OpenAI-kompatibler Mode und Claude-nativem Format:

- Prompt Caching ist der größte Unterschied: In Produktionsumgebungen mit langen Dialogen und Agenten-Szenarien kann die Verwendung des nativen Claude-Formats die Kosten für Eingabe-Token um 80-90% senken. Diese Differenz ist weitaus größer als alle anderen Funktionsunterschiede.

- OpenAI-kompatible Mode eignet sich für schnelle Validierung: Wenn Sie nur die Claude-Leistung testen oder A/B-Vergleiche durchführen möchten, reicht es, die

base_urlin einer Zeile zu ändern – ohne Code umschreiben zu müssen. - Für Produktionsumgebungen wird das native Format empfohlen: Funktionen wie Extended Thinking, PDF-Verarbeitung, Citations und strukturierte Ausgaben sind nur im nativen Format vollständig nutzbar.

Die richtige Wahl der Integrationsmethode ermöglicht es, die volle Leistungsfähigkeit von Claude auszuschöpfen und gleichzeitig die Kosteneffizienz zu maximieren.

Empfohlen wird der Zugang über APIYI apiyi.com. Die Plattform unterstützt sowohl das OpenAI-kompatible Format als auch das native Claude-Format. Mit einem einzigen Schlüssel können Sie flexibel zwischen den Formaten wechseln und so mühelos verschiedene Anforderungen bewältigen.

📚 Referenzen

-

Anthropic OpenAI SDK Kompatibilitätsdokumentation: Vollständige Liste der offiziell unterstützten und nicht unterstützten Parameter

- Link:

platform.claude.com/docs/en/api/openai-sdk - Beschreibung: Enthält detaillierte Erläuterungen zu allen ignorierten Parametern und Antwortfeldern.

- Link:

-

Claude Prompt Caching Dokumentation: Prompt-Caching-Mechanismus und Abrechnungsregeln

- Link:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Beschreibung: Preise und Mindestschwellenwerte für die beiden Cache-Level (5 Minuten und 1 Stunde).

- Link:

-

Claude Messages API Referenz: Vollständiges Anfrage- und Antwortformat der nativen Claude-API

- Link:

platform.claude.com/docs/en/api/messages - Beschreibung: Detaillierte Spezifikationen für Content-Blöcke, Tool-Aufrufe und Streaming-Ausgaben.

- Link:

-

Claude Extended Thinking Dokumentation: Anleitung zur Verwendung der Extended-Thinking-Funktion

- Link:

platform.claude.com/docs/en/build-with-claude/extended-thinking - Beschreibung: Wie man den erweiterten Denkprozess aktiviert und die vollständige Ausgabe erhält.

- Link:

Autor: APIYI Technikteam

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren. Weitere Informationen finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.