{

"description": "Comparação técnica entre Gemini 3.1 Pro e Claude Opus 4.6 (fev/2026). Analisamos raciocínio, multimodalidade e preços para ajudar você a escolher o melhor modelo para seu projeto."

}

Nota do autor: Comparação profunda entre Gemini 3.1 Pro e Claude Opus 4.6 em 13 dimensões, incluindo raciocínio, codificação, multimodalidade e preço, com sugestões de cenários e guia de acesso à API.

Em fevereiro de 2026, o cenário competitivo dos modelos de IA passou por uma verdadeira "fragmentação" — não há mais um único modelo que domine completamente todos os outros competidores. O Gemini 3.1 Pro, lançado pelo Google em 19 de fevereiro, quebrou recordes em raciocínio e multimodalidade, enquanto o Claude Opus 4.6, lançado pela Anthropic em 5 de fevereiro, mantém a liderança em tarefas de nível especialista e chamadas de ferramentas.

Valor central: Ao terminar de ler este artigo, você saberá exatamente em quais cenários cada um desses modelos de ponta se destaca e qual deles escolher de acordo com suas necessidades específicas.

Comparação de Capacidade de Raciocínio

| Teste de Raciocínio | Gemini 3.1 Pro | Claude Opus 4.6 | Vencedor |

|---|---|---|---|

| ARC-AGI-2 (Raciocínio Abstrato) | 77,1% | 68,8% | ✅ Gemini (+8,3 pts) |

| GPQA Diamond (Conhecimento Científico) | 94,3% | 91,3% | ✅ Gemini (+3,0 pts) |

| HLE sem ferramentas (Raciocínio de Ponta) | 44,4% | 40,0% | ✅ Gemini (+4,4 pts) |

| HLE com ferramentas (Raciocínio Assistido) | 51,4% | 53,1% | ✅ Opus (+1,7 pts) |

Análise: O Gemini 3.1 Pro lidera de forma abrangente em tarefas de raciocínio puro, especialmente no ARC-AGI-2, onde seus 77,1% são quase 2,5 vezes superiores aos do seu antecessor, Gemini 3.0 Pro (31,1%). No entanto, quando o uso de ferramentas é permitido, o Opus 4.6 vira o jogo — o que sugere que o Opus é mais habilidoso em utilizar ferramentas como uma extensão do seu raciocínio.

Comparação de Capacidade de Codificação

| Teste de Codificação | Gemini 3.1 Pro | Claude Opus 4.6 | Vencedor |

|---|---|---|---|

| SWE-Bench Verified | 80,6% | 80,8% | ✅ Opus (Liderança mínima) |

| Terminal-Bench 2.0 | 68,5% | 65,4% | ✅ Gemini (+3,1 pts) |

Análise: Na área de codificação, ambos estão equilibrados. No SWE-Bench Verified, o resultado é praticamente um empate (diferença de apenas 0,2%), mas o Gemini 3.1 Pro leva a melhor no Terminal-Bench 2.0 (codificação em ambiente de terminal) com 3,1 pontos de vantagem. Vale notar que o GPT-5.3-Codex da OpenAI superou ambos no Terminal-Bench com 77,3%.

Comparação de Capacidade de Agente e Chamada de Ferramentas

| Teste de Agente | Gemini 3.1 Pro | Claude Opus 4.6 | Vencedor |

|---|---|---|---|

| MCP Atlas (Fluxo Multietapa) | 69,2% | 59,5% | ✅ Gemini (+9,7 pts) |

| BrowseComp (Pesquisa na Web) | 85,9% | 84,0% | ✅ Gemini (+1,9 pts) |

| tau2-bench Retail (Chamada de Ferramentas) | – | 91,9% | Opus em destaque |

| OSWorld (Controle de SO) | – | 72,7% | Opus em destaque |

Análise: No MCP Atlas (fluxos de trabalho de Agente multietapa), o Gemini 3.1 Pro lidera com uma margem de 9,7 pontos, um sinal importante para desenvolvedores que utilizam o Model Context Protocol. Por outro lado, o Opus 4.6 apresenta dados mais impressionantes na chamada de ferramentas do tau2-bench e no controle de sistema operacional do OSWorld.

Comparação de Capacidade de Trabalho de Conhecimento

| Teste de Conhecimento | Gemini 3.1 Pro | Claude Opus 4.6 | Vencedor |

|---|---|---|---|

| GDPval-AA Elo | 1317 | 1606 | ✅ Opus (+289 pts) |

Análise: No GDPval-AA (que simula tarefas reais de trabalho de conhecimento de nível especialista), o Opus 4.6 supera o Gemini 3.1 Pro com uma vantagem massiva de 1606 contra 1317 Elo. Uma diferença de 289 pontos é comparável à distância entre um jogador profissional e um amador. Isso significa que em cenários de alto valor, como análise de pesquisa, redação de relatórios e análise financeira, o Opus 4.6 possui uma vantagem qualitativa superior.

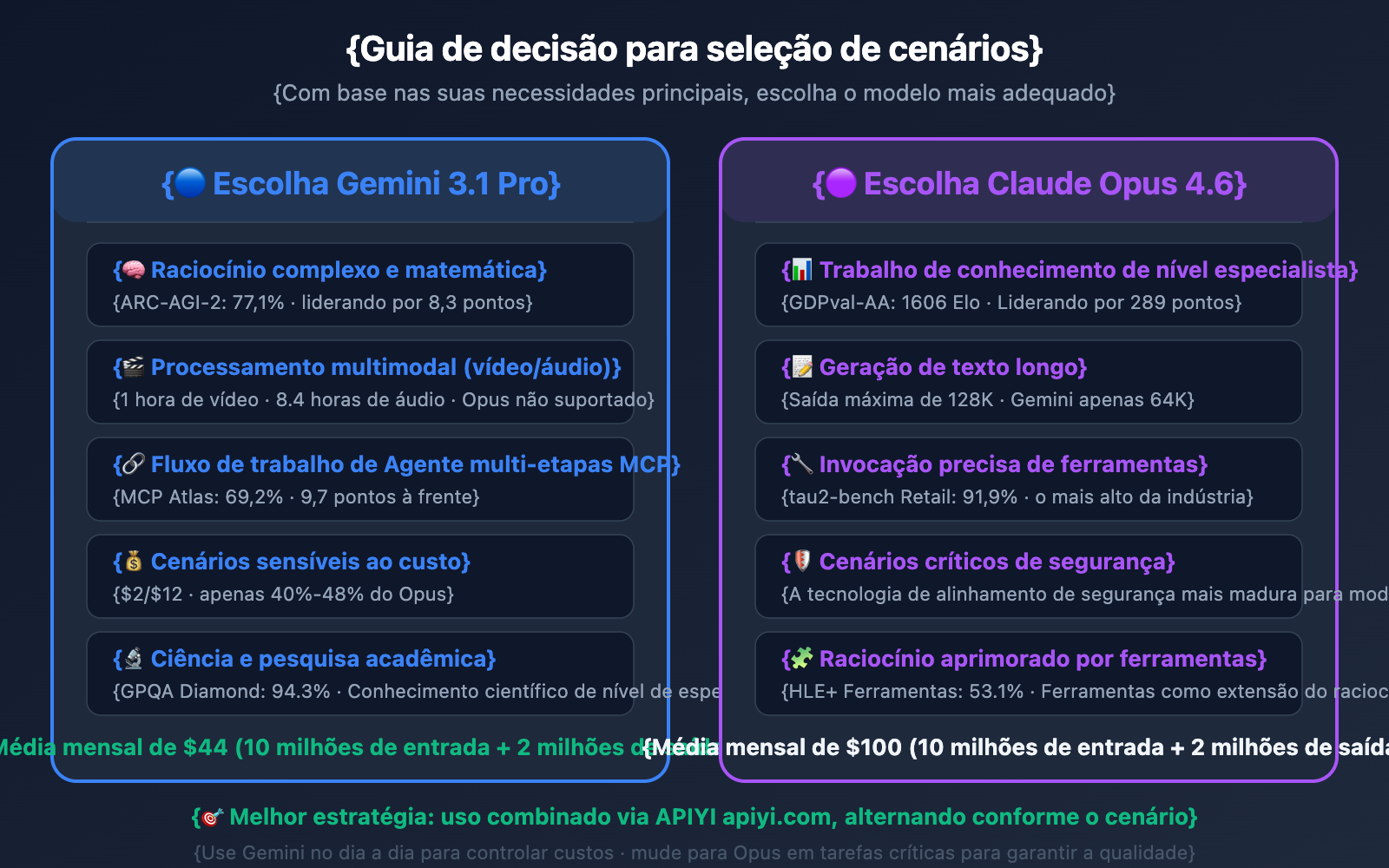

Gemini 3.1 Pro vs. Opus 4.6: Sugestões de Escolha por Cenário

Com base nos dados acima, os cenários de aplicação para os dois modelos são bem claros.

5 cenários para escolher o Gemini 3.1 Pro

- Raciocínio complexo e matemática: Pontuação ARC-AGI-2 de 77,1% (8,3 pontos à frente), com um sistema de pensamento em três níveis que permite ajustar a profundidade do raciocínio conforme a necessidade.

- Processamento multimodal: Suporte nativo para vídeo (1 hora) e áudio (8,4 horas). Se o seu negócio envolve análise de vídeo ou transcrição de voz, o Gemini é a única escolha.

- Fluxos de trabalho MCP de várias etapas: MCP Atlas 69,2% (9,7 pontos à frente). Se você está construindo sistemas de Agentes baseados no Model Context Protocol, o Gemini é mais confiável.

- Cenários sensíveis ao custo: Preço de entrada $2 vs $5, preço de saída $12 vs $25. Com qualidade equivalente, o custo do Gemini é de apenas 40%-48% do Opus.

- Pesquisa científica e acadêmica: GPQA Diamond 94,3%, apresentando o melhor desempenho em perguntas e respostas de conhecimento científico de nível especializado.

5 cenários para escolher o Claude Opus 4.6

- Trabalho de conhecimento especializado: GDPval-AA 1606 Elo, liderando com folga. Ideal para relatórios de pesquisa, análise financeira, documentos jurídicos e outras saídas de alto valor.

- Geração de textos longos: Saída máxima de 128K tokens (contra 64K do Gemini). O Opus é mais adequado quando você precisa gerar documentos completos ou códigos extensos.

- Raciocínio aprimorado por ferramentas: HLE com teste de ferramentas em 53,1% (1,7 ponto à frente). Excelente em usar ferramentas externas como uma extensão da cadeia de raciocínio.

- Chamada de ferramentas precisa: tau2-bench Retail 91,9%. Mais estável em cenários de Agentes que exigem chamadas de função de alta precisão (como OpenClaw).

- Cenários críticos de segurança: A tecnologia de alinhamento de segurança da Anthropic é a mais madura entre os modelos de ponta, oferecendo mais controle ao lidar com conteúdo sensível.

Acesso Rápido às APIs do Gemini 3.1 Pro e Opus 4.6

Exemplo Minimalista

Através da plataforma APIYI, os dois modelos utilizam uma interface unificada, bastando apenas trocar o parâmetro model:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Usando Gemini 3.1 Pro (mais forte em raciocínio e multimodalidade)

response = client.chat.completions.create(

model="gemini-3.1-pro",

messages=[{"role": "user", "content": "Explique os princípios físicos do emaranhamento quântico"}]

)

print(response.choices[0].message.content)

Ver exemplo de invocação do Claude Opus 4.6 e código de alternância entre modelos

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Usando Claude Opus 4.6 (mais forte em trabalho de conhecimento e chamadas de ferramentas)

response = client.chat.completions.create(

model="claude-opus-4-6",

messages=[{"role": "user", "content": "Escreva um relatório de análise sobre a receita do primeiro trimestre (Q1)"}]

)

print(response.choices[0].message.content)

# Função encapsulada para seleção dinâmica de modelo

def smart_call(prompt, task_type="general"):

model_map = {

"reasoning": "gemini-3.1-pro",

"multimodal": "gemini-3.1-pro",

"knowledge": "claude-opus-4-6",

"coding": "claude-opus-4-6",

"general": "gemini-3.1-pro", # Padrão: usa o mais barato

}

return client.chat.completions.create(

model=model_map.get(task_type, "gemini-3.1-pro"),

messages=[{"role": "user", "content": prompt}]

)

Sugestão: Através da plataforma APIYI (apiyi.com), você pode acessar simultaneamente o Gemini 3.1 Pro e o Claude Opus 4.6, alternando conforme a necessidade usando a mesma chave API. A plataforma oferece créditos de teste gratuitos; recomendamos comparar o desempenho dos dois modelos no seu cenário real antes de decidir.

Análise Comparativa de Custos: Gemini 3.1 Pro vs. Opus 4.6

A diferença de preço é um fator decisivo para muitos desenvolvedores. Tomando como exemplo uma média mensal de 10 milhões de tokens de entrada + 2 milhões de tokens de saída:

| Item de Custo | Gemini 3.1 Pro | Claude Opus 4.6 | Diferença |

|---|---|---|---|

| Custo de Entrada | $20 | $50 | Gemini economiza $30 |

| Custo de Saída | $24 | $50 | Gemini economiza $26 |

| Custo Total Mensal | $44 | $100 | Gemini economiza 56% |

| Custo Total Anual | $528 | $1.200 | Gemini economiza $672 |

Se o seu cenário for focado principalmente em raciocínio e multimodalidade, o Gemini 3.1 Pro pode economizar mais da metade dos custos sem quase nenhuma perda de qualidade. No entanto, se o seu cenário principal envolver trabalho de conhecimento especializado (diferença de 289 pontos no GDPval-AA), o aumento de qualidade que o Opus 4.6 oferece por US$ 56 extras por mês vale o investimento.

🎯 Dica para economizar: Ao utilizar a plataforma APIYI (apiyi.com), você pode desfrutar de preços promocionais. A estratégia recomendada é definir o Gemini 3.1 Pro como modelo padrão para processar solicitações rotineiras e alternar para o Opus 4.6 apenas em cenários de trabalho de conhecimento complexo e chamadas de ferramentas precisas.

Perguntas Frequentes

Q1: Qual é a diferença entre o “Pensamento em Três Níveis” do Gemini 3.1 Pro e o “Pensamento Adaptativo” do Opus 4.6?

O Gemini 3.1 Pro permite que os desenvolvedores definam manualmente três níveis de raciocínio: Low, Medium e High, controlando a quantidade de processamento que o modelo dedica à tarefa. O nível Medium é uma novidade que a Google chama de "pensamento profundo moderado". Já o pensamento adaptativo do Claude Opus 4.6 faz com que o modelo decida automaticamente a profundidade de raciocínio necessária, embora os desenvolvedores também possam intervir manualmente via parâmetro effort. A lógica de ambos é parecida, mas a execução muda: o Gemini funciona como um carro manual, enquanto o Opus é como um automático.

Q2: Posso usar os dois modelos ao mesmo tempo?

Sim. A recomendação é acessar através da plataforma APIYI (apiyi.com), onde uma única chave API permite a invocação do modelo de ambos os provedores. Você pode configurar um roteamento dinâmico baseada no tipo de tarefa: use o Gemini 3.1 Pro para raciocínio e tarefas multimodais (é mais barato) e o Claude Opus 4.6 para trabalhos de conhecimento e chamadas de ferramentas precisas (é mais potente). A função smart_call no exemplo de código deste artigo já demonstra esse padrão de uso.

Q3: Qual escolher para cenários de programação (coding)?

Os dois modelos estão praticamente empatados em codificação (a diferença no SWE-Bench é de apenas 0.2%). Se o seu foco for ambiente de terminal (como scripts de CI/CD ou ferramentas de linha de comando), o Gemini 3.1 Pro lidera no Terminal-Bench por 3.1 pontos. Se precisar gerar arquivos de código muito longos (acima de 64K tokens), a saída de 128K do Claude Opus 4.6 é mais adequada. Se o orçamento estiver apertado, a capacidade de codificação do Gemini 3.1 Pro é totalmente suficiente e custa metade do preço. Através da APIYI (apiyi.com), você pode testar e comparar os dois a qualquer momento.

Resumo

Conclusões principais da comparação entre Gemini 3.1 Pro e Claude Opus 4.6:

- Para raciocínio e multimodalidade, escolha o Gemini 3.1 Pro: Liderança de 8.3 pontos no ARC-AGI-2, suporte nativo para vídeo e áudio, e preço que representa apenas 40%-48% do custo do Opus.

- Para trabalho de conhecimento e chamadas de ferramentas, escolha o Claude Opus 4.6: Vantagem de 289 pontos no GDPval-AA, 91.9% de precisão em chamadas de ferramentas (tau2-bench) e saída máxima de 128K.

- Capacidade de programação equivalente: A diferença no SWE-Bench é de apenas 0.2%. Se o orçamento for limitado, o Gemini é a escolha lógica.

O cenário dos modelos de IA em fevereiro de 2026 mostra que cada um tem seus pontos fortes. A melhor estratégia não é escolher apenas um, mas sim utilizá-los de forma híbrida de acordo com o cenário. Recomendamos conectar-se a ambos via APIYI (apiyi.com) para alternar conforme a necessidade e obter a melhor relação entre qualidade e custo.

📚 Referências

-

Blog Oficial do Gemini 3.1 Pro: Anúncio do Google e detalhes técnicos

- Link:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/ - Descrição: Confira a introdução completa dos recursos do Gemini 3.1 Pro e o sistema de raciocínio em três níveis

- Link:

-

Anúncio de Lançamento do Claude Opus 4.6: Blog técnico oficial da Anthropic

- Link:

anthropic.com/news/claude-opus-4-6 - Descrição: Confira os dados completos de benchmark e a função de raciocínio adaptativo do Opus 4.6

- Link:

-

Comparação de Modelos da Artificial Analysis: Plataforma independente de avaliação de terceiros

- Link:

artificialanalysis.ai/models/comparisons/gemini-3-1-pro-preview-vs-claude-opus-4-6-adaptive - Descrição: Dados objetivos de comparação horizontal de desempenho, velocidade e preço

- Link:

-

Documentação para Desenvolvedores do Google AI: Guia de preços e integração da API do Gemini

- Link:

ai.google.dev/gemini-api/docs/pricing - Descrição: Confira os preços mais recentes da API e as cotas gratuitas do Gemini 3.1 Pro

- Link:

Autor: Equipe Técnica

Troca de Conhecimento: Sinta-se à vontade para compartilhar sua experiência com esses dois modelos nos comentários. Para mais notícias sobre modelos de IA, visite o APIYI apiyi.com