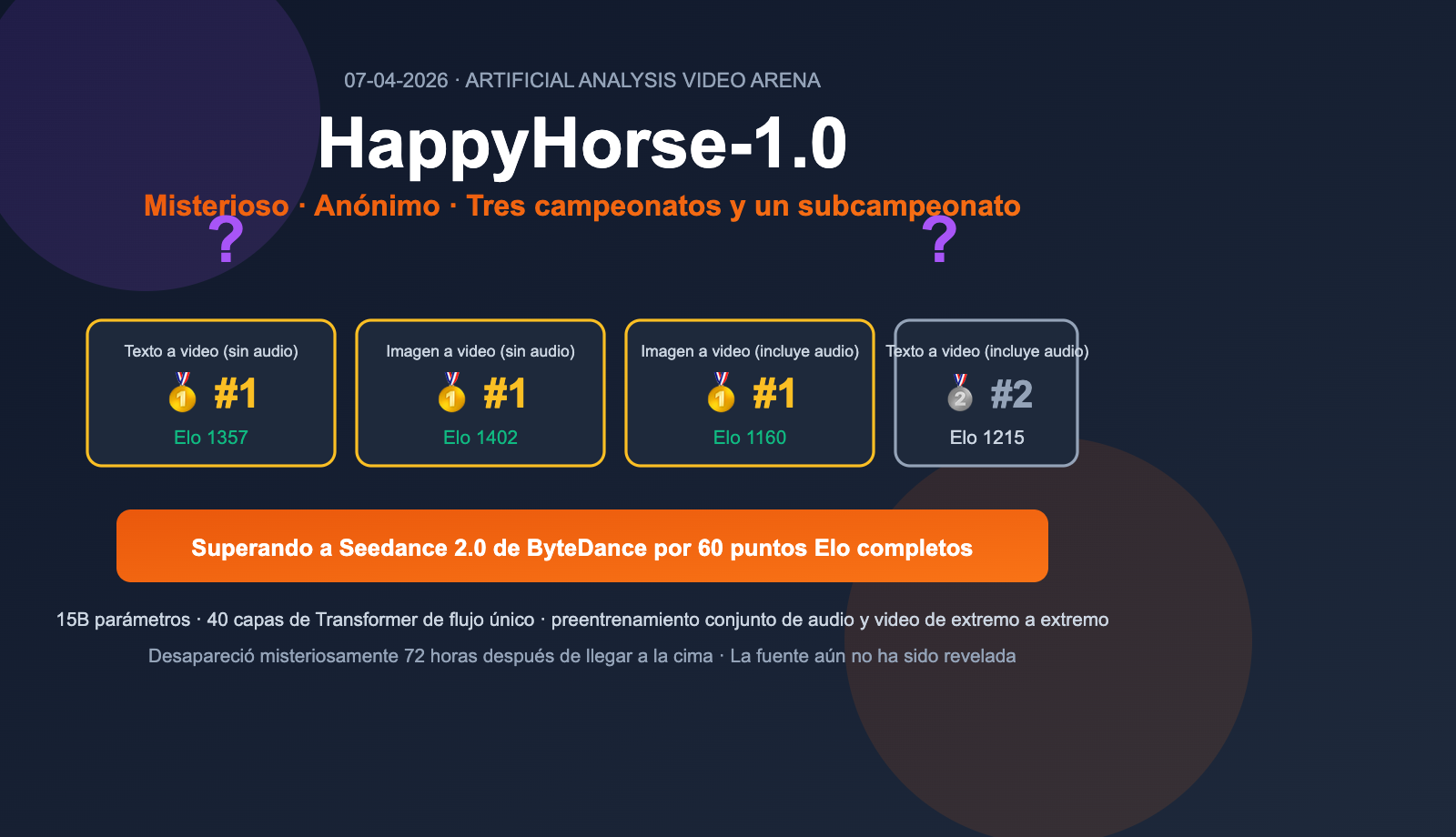

En la madrugada del 7 de abril de 2026, el ranking Video Arena de Artificial Analysis recibió una sorpresa inesperada: un nombre del que nadie había oído hablar apareció de repente: HappyHorse-1.0. Se llevó el primer puesto en tres de los cuatro rankings principales y el segundo en el restante, superando por 60 puntos Elo al anterior "líder", Seedance 2.0 de ByteDance. Sin embargo, en menos de 72 horas, el modelo desapareció del ranking y, hasta el día de hoy, ningún equipo ha reclamado su autoría. En este artículo, analizamos rápidamente qué significa este evento para el campo de la generación de vídeo mediante IA.

Valor clave: 3 minutos para conocer la información esencial, los avances en capacidades y las teorías sobre el origen de HappyHorse-1.0, además de lo que esto implica para el sector actual de la generación de vídeo con IA.

Resumen de información clave sobre HappyHorse-1.0

HappyHorse-1.0 es un modelo de generación de vídeo que llegó al Video Arena de Artificial Analysis mediante una "presentación anónima". No tiene un repositorio de GitHub público, ni pesos oficiales en HuggingFace, ni una API accesible, pero su rendimiento en los cuatro rankings principales dejó atrás a todos los modelos públicos, incluidos Seedance 2.0 de ByteDance, Veo de Google y Sora de OpenAI.

| Elemento de información | Detalles |

|---|---|

| Nombre del modelo | HappyHorse-1.0 (incluye variante V2) |

| Fecha de aparición | Madrugada del 7 de abril de 2026 |

| Plataforma de ranking | Artificial Analysis Video Arena |

| Método de envío | Anónimo (pseudónimo) |

| Escala del modelo | Aprox. 15B de parámetros |

| Arquitectura | Transformer de atención propia (Self-Attention) de flujo único de 40 capas |

| Modalidad conjunta | Preentrenamiento conjunto de texto / vídeo / audio |

| Estado público | ❌ Sin código fuente · Sin pesos · Sin API |

| Origen sospechado | Alibaba Tongyi Lab (¿Wan 2.7?) |

| Estado actual | Desaparecido del ranking |

💡 Comprensión rápida: HappyHorse-1.0 no es un "producto", sino una "prueba de capacidad pública anónima". Este paradigma de lanzamiento, que consiste en "posicionarse en el ranking de forma anónima y luego revelarse", ha aparecido varias veces durante el último año en LMArena, Image Arena y Code Arena, y casi siempre hay una empresa líder en modelos detrás. Si deseas comparar y experimentar con los modelos de generación de vídeo disponibles actualmente, puedes acceder rápidamente a los principales candidatos a través de la plataforma APIYI (apiyi.com).

title: "Resultados de HappyHorse-1.0 en el ranking de Arena"

description: "Análisis del rendimiento de HappyHorse-1.0 en el ranking de Artificial Analysis y su innovadora arquitectura de generación de video."

Resultados de HappyHorse-1.0 en el ranking de Arena

Artificial Analysis es actualmente uno de los rankings de pruebas ciegas más autorizados en el campo de la generación de video por IA. Utiliza un sistema de puntuación Elo + votación ciega de usuarios, lo que evita los sesgos de las propias empresas. Los resultados de HappyHorse-1.0 al entrar en la lista el 7 de abril son los siguientes:

| Categoría del ranking | Elo de HappyHorse-1.0 | Puesto | Anterior líder |

|---|---|---|---|

| Texto a video (sin audio) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| Imagen a video (sin audio) | 1392-1402 | 🥇 #1 | — |

| Texto a video (con audio) | 1205-1215 | 🥈 #2 | — |

| Imagen a video (con audio) | 1160 | 🥇 #1 | — |

Lo más impactante es la categoría de Texto a video sin audio: HappyHorse-1.0 superó al anterior líder, Seedance 2.0 de ByteDance, por 60 puntos Elo desde su llegada. En el sistema de puntuación Elo, 60 puntos representan una ventaja de victoria de aproximadamente el 58%, lo cual es una diferencia generacional considerable.

Hipótesis sobre la arquitectura técnica de HappyHorse-1.0

Aunque no existe un documento oficial, la página de lanzamiento de HappyHorse-1.0 y análisis de terceros como WaveSpeedAI han revelado bastantes detalles arquitectónicos. Si se confirman, sería la primera vez que la comunidad de código abierto logra un "preentrenamiento conjunto de audio y video de extremo a extremo".

Transformer unificado de flujo único

HappyHorse-1.0 utiliza un Transformer de autoatención (Self-Attention) de 40 capas, que agrupa tokens de texto, latentes de imagen de referencia, tokens de video con ruido y tokens de audio con ruido en una misma secuencia para la eliminación de ruido conjunta. Esto es muy diferente a la ruta predominante de "doble torre + atención cruzada" (como Sora o Seedance):

- 4 capas al inicio y al final: utilizan proyecciones específicas de modalidad para procesar las entradas y salidas.

- 32 capas intermedias: los parámetros se comparten completamente, tratando a todas las modalidades por igual.

- Sin atención cruzada (Cross-Attention): todas las modalidades interactúan dentro del mismo mecanismo de atención.

Esta ruta de "flujo único con autoatención total" es el paradigma que GPT-4o y Gemini 2.x han estado explorando en el ámbito multimodal, pero es la primera vez que aparece en el campo de la generación de video bajo un formato de "código abierto + rendimiento de primer nivel".

Generación conjunta de audio y video

HappyHorse-1.0 afirma ser capaz de generar simultáneamente video + diálogos + sonido ambiental + efectos de sonido Foley en una sola inferencia, cubriendo 6 idiomas (chino, inglés, japonés, coreano, alemán y francés). Sitios secundarios también aseguran incluir cantonés y una "sincronización labial con una tasa de error de palabras (WER) extremadamente baja".

Si todos estos indicadores son ciertos, la ventaja de HappyHorse-1.0 en la dimensión de "preentrenamiento de audio-video de extremo a extremo" podría ser incluso mayor de lo que muestra el ranking.

Velocidad de inferencia

| Configuración | Tiempo |

|---|---|

| Video de 5 segundos a 256p | ~2 segundos |

| Video de 5 segundos a 1080p (H100) | ~38 segundos |

De ser cierto, esta velocidad es bastante agresiva para un modelo de video de 15B de parámetros, acercándose al límite de la generación en tiempo real.

Hipótesis sobre el origen de HappyHorse-1.0

El envío anónimo significa que Artificial Analysis solo pudo describir este modelo como "pseudónimo" al publicarlo. Sin embargo, la comunidad logró extraer algunas hipótesis principales a partir de las pistas encontradas.

Hipótesis 1: Alibaba Tongyi Lab (Wan 2.7)

Esta es la teoría con más fuerza en la comunidad actualmente, y se basa en cuatro razones:

- Coincidencia temporal: Después de que HappyHorse-1.0 alcanzara la cima el 7 de abril, Alibaba Tongyi Lab lanzó Wan 2.6 a principios de mes, y la industria esperaba ampliamente que la próxima generación, Wan 2.7, estuviera por llegar.

- Reacción del mercado de capitales: Las acciones de Alibaba en la bolsa de Hong Kong subieron casi un 8% después de que HappyHorse apareciera en la lista; el mercado claramente lo asoció con Alibaba.

- Capacidad multilingüe CJK: El modelo tiene un soporte extremadamente fuerte para los idiomas chino, japonés y coreano, una característica típica de los equipos chinos o del este de Asia.

- Estilo de lanzamiento anónimo: Alibaba ha utilizado anteriormente la estrategia de "publicación limitada primero / lanzamiento oficial después" con las series Qwen / Wan.

Sin embargo, la empresa no ha admitido nada hasta la fecha, y el Wan 2.7 lanzado oficialmente por Alibaba Tongyi Lab en abril no coincide exactamente con el rendimiento de HappyHorse en algunas demostraciones públicas, por lo que esta hipótesis sigue sin confirmarse.

Hipótesis 2: ByteDance / Otros grandes fabricantes

Algunas voces sugieren que HappyHorse podría ser una variante de próxima generación de la serie Seedance de ByteDance, ya que Seedance 2.0 fue el modelo superado por este, y ByteDance tendría motivos para probar Seedance 3.0 de forma anónima. Pero, por ahora, no hay pruebas que respalden esto.

Hipótesis 3: Un nuevo equipo independiente chino

Otros especulan que HappyHorse proviene de un equipo de startups chino nuevo y poco conocido, ya que la pila tecnológica que muestra el modelo ("15B + Self-Attention completo + unión de audio y video") es muy agresiva, lo que parece más el trabajo de un equipo pequeño "sin ataduras".

🎯 Una visión racional: Hasta que no haya una confirmación oficial, todas las afirmaciones de que "es Alibaba", "es ByteDance" o "es algún unicornio" son solo conjeturas. Lo que debería interesarnos no es "quién es", sino "dónde ha llegado el límite de sus capacidades" y qué modelos de video abiertos podemos usar hoy para construir aplicaciones reales. Si necesitas integrar modelos de video convencionales para validar tus productos, puedes usar el servicio proxy de API APIYI (apiyi.com) para acceder a múltiples modelos disponibles en un solo lugar.

Las 72 horas de desaparición misteriosa de HappyHorse-1.0

Lo más dramático fue la "desaparición" de HappyHorse-1.0. Menos de 72 horas después de alcanzar el primer puesto en la lista de Artificial Analysis el 7 de abril, la serie de modelos HappyHorse fue retirada repentinamente, dejando solo:

- Algunas capturas de pantalla circulando en redes sociales.

- Una página de aterrizaje oficial cifrada (que afirmaba que "GitHub / HuggingFace abriría pronto", pero los enlaces no funcionaban).

- Una declaración oficial de Artificial Analysis confirmando que el modelo había sido "retirado".

Este guion de "aparecer en la lista → desaparecer" ya ha ocurrido varias veces en LMArena: las versiones anónimas tempranas de GPT-4 Turbo, la vista previa de Claude 3.5 Sonnet y las variantes tempranas de Gemini 2.0 Flash siguieron procesos similares. Casi siempre, tras la desaparición de un modelo anónimo, se produce un lanzamiento oficial en un plazo de 3 a 8 semanas.

La interpretación de la industria sobre HappyHorse es prácticamente unánime: se trata de un equipo líder recopilando datos de preferencia de usuarios reales para prepararse para un lanzamiento oficial.

title: "El impacto de HappyHorse-1.0 en la industria de generación de video por IA"

description: "Analizamos cómo HappyHorse-1.0, a pesar de su breve aparición, ha sacudido el panorama de la generación de video por IA y qué significa para el futuro."

El impacto de HappyHorse-1.0 en la industria de generación de video por IA

HappyHorse-1.0, incluso sin haber sido lanzado oficialmente al público, ya ha tenido un impacto sustancial en todo el sector de la generación de video por IA.

Impacto en los principales fabricantes

- La "zona de confort" de Seedance 2.0, Veo 3 y Sora 2 ha sido desafiada: La brecha de 60 puntos en el Elo demuestra que el límite de capacidad en la generación de video está lejos de alcanzarse.

- La generación conjunta de audio y video es el nuevo campo de batalla: HappyHorse obtuvo el primer lugar en 3 de las 4 categorías, destacando especialmente en la generación conjunta de audio, lo que obligará a todos los líderes del sector a acelerar sus rutas de preentrenamiento audio-video.

- Presión sobre el código abierto/semicódigo abierto: HappyHorse afirma que "todo es abierto" (aunque aún no se ha liberado realmente), lo que aumentará la presión sobre productos de código cerrado como Sora.

Impacto en desarrolladores y creadores

- Se han redefinido las expectativas de capacidad: Con 1080p / H100 / 38 segundos, esta relación costo-rendimiento hace que la "generación de video en tiempo real" deje de ser ciencia ficción.

- Multilingüismo + sincronización labial: La generación de audio y video de extremo a extremo en 6 idiomas (chino, inglés, japonés, coreano, alemán y francés) es una gran ventaja para cortometrajes, publicidad y videos educativos.

- La ruta pragmática sigue siendo la misma: Antes de que HappyHorse esté realmente disponible, dominar los modelos ya accesibles como Veo 3, Sora 2, Kling 2 o Wan 2.6 sigue siendo la mejor ruta para construir productos reales, los cuales se pueden integrar fácilmente a través de APIYI (apiyi.com).

Impacto en los equipos de IA de China

Si se confirma que HappyHorse es obra de Alibaba o de otro equipo de origen chino, sería la primera vez que la generación de video por IA de China obtiene tres primeros lugares en una lista de pruebas ciegas en inglés como Artificial Analysis, que no tiene sesgos regionales. Este significado trasciende al modelo en sí.

Preguntas frecuentes sobre HappyHorse-1.0

Q1: ¿Se puede usar HappyHorse-1.0 ahora mismo?

No. Solo apareció brevemente durante unas 72 horas en el Arena de pruebas ciegas de Artificial Analysis; no tiene API pública, no hay pesos descargables ni acceso a GitHub. Si necesitas invocar modelos de generación de video de primer nivel de inmediato, puedes acceder a modelos líderes como Veo 3, Sora 2, Kling 2 y Wan 2.6 a través de APIYI (apiyi.com).

Q2: ¿Es HappyHorse-1.0 realmente el modelo Wan 2.7 de Alibaba?

Actualmente no hay una confirmación oficial. La comunidad tiene cuatro razones para especular (coincidencia de tiempo, fuerte subida de las acciones de Alibaba en Hong Kong, capacidades multilingües CJK, estilo histórico de lanzamientos de Alibaba), pero las demostraciones de Wan 2.7 tras su lanzamiento oficial en abril no coinciden exactamente con HappyHorse. Por lo tanto, lo más preciso es decir: es muy probable, pero no está confirmado.

Q3: ¿Qué significa realmente su ventaja de 60 puntos en Elo?

En el sistema de puntuación Elo, una ventaja de 60 puntos corresponde aproximadamente a una tasa de victoria del 58% en pruebas ciegas. Es una brecha muy significativa pero superable. Como referencia, en el último año, las variaciones entre Sora, Veo, Kling y Seedance solían estar dentro de un rango de 20 a 40 puntos. Que HappyHorse aparezca directamente con 60 puntos es, sin duda, un salto generacional.

Q4: ¿Qué tan radical es su arquitectura de «15B parámetros + Self-Attention de flujo único»?

Es extremadamente radical. Los modelos de video actuales suelen adoptar rutas híbridas como "doble torre + Cross-Attention" o "DiT + proyección multimodal". HappyHorse integra audio, video y texto en un Transformer de 40 capas con parámetros compartidos. Es la misma ruta técnica que GPT-4o y Gemini 2.x están explorando en el ámbito multimodal, pero es la primera vez que se valida con un rendimiento de primer nivel en el campo de la generación de video.

Q5: ¿Por qué desapareció después de 72 horas en la lista?

Este es un "patrón de recolección de datos" común para modelos anónimos. Las primeras versiones de GPT-4 Turbo en LMArena, la vista previa de Claude 3.5 Sonnet y las variantes tempranas de Gemini 2.0 Flash siguieron el mismo proceso: lanzamiento → recolección de datos de preferencia reales → retirada → lanzamiento oficial semanas después. Se espera que HappyHorse regrese con un nombre oficial en un plazo de 3 a 8 semanas.

Q6: ¿Qué modelos de video puedo usar ahora para reemplazar a HappyHorse?

Los candidatos más fuertes y disponibles actualmente incluyen: Google Veo 3 (calidad general de primer nivel), OpenAI Sora 2 (fuerte lenguaje cinematográfico), Kling 2 (excelente en retratos y movimiento), ByteDance Seedance 2.0 (fuerte en escenas chinas) y Alibaba Wan 2.6 (código abierto y fácil de desplegar). Si necesitas usar una interfaz unificada para comparar estos modelos, puedes integrarlos todos a través de la plataforma APIYI (apiyi.com), evitando tener que cambiar entre múltiples cuentas.

Resumen

HappyHorse-1.0 ha sido el "aterrizaje anónimo" más dramático en el campo de la generación de video por IA en abril de 2026. Representa tres puntos clave:

- El límite superior de la generación de video se ha elevado nuevamente: Una ventaja de 60 puntos Elo y 3 victorias y 1 segundo puesto en 4 categorías demuestran que los "modelos de video más potentes" que vemos hoy están lejos de alcanzar su techo.

- La generación conjunta de audio y video se convierte en el nuevo campo de batalla: El sólido desempeño de HappyHorse en categorías que incluyen audio impulsará a toda la industria a priorizar el preentrenamiento de extremo a extremo de audio-video.

- "Anónimo → Retirada → Lanzamiento oficial" se convierte en el estándar para modelos insignia: Se espera que en un plazo de 3 a 8 semanas, un fabricante conocido reclame oficialmente su autoría.

🚀 Sugerencia de acción: Antes de que HappyHorse esté realmente disponible, lo más pragmático no es adivinar su origen, sino dominar los modelos de video de primer nivel que ya están disponibles. Modelos como Veo 3, Sora 2, Kling 2, Seedance 2.0 y Wan 2.6 pueden cubrir perfectamente el 90% de los escenarios de producción real. Recomendamos acceder a los principales modelos de video a través de APIYI (apiyi.com) con pago por uso y capacidad de cambio inmediato, para que, cuando HappyHorse o Wan 2.7 se abran oficialmente, puedas migrar sin problemas.

Autor: Equipo de APIYI — Enfocados en proporcionar a los desarrolladores un acceso estable a los principales Modelos de Lenguaje Grande de IA. Visita apiyi.com para más información.

Referencias

-

Blog de WaveSpeedAI – Qué es HappyHorse-1.0

- Enlace:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - Descripción: Análisis profundo de terceros sobre arquitectura, parámetros y velocidad de inferencia.

- Enlace:

-

Artificial Analysis – Tabla de clasificación de Video Arena

- Enlace:

artificialanalysis.ai/video/leaderboard/text-to-video - Descripción: Clasificación original en las categorías de texto a imagen y imagen a imagen.

- Enlace:

-

Phemex News – HappyHorse encabeza las clasificaciones

- Enlace:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - Descripción: Datos comparativos entre HappyHorse y Seedance 2.0.

- Enlace:

-

36Kr – El misterioso modelo HappyHorse

- Enlace:

eu.36kr.com/en/p/3757826958635781 - Descripción: Interpretación de la industria sobre la aparición de este modelo anónimo.

- Enlace:

-

Futunn – Las acciones de Alibaba en Hong Kong suben debido a HappyHorse

- Enlace:

news.futunn.com/en/post/71208943 - Descripción: Reacción del mercado de capitales ante las especulaciones sobre su origen.

- Enlace:

-

DEV Community – Quién desarrolló HappyHorse

- Enlace:

dev.to/calvin_claire_451169e1b82 - Descripción: Diversas especulaciones de la comunidad sobre el equipo de desarrollo.

- Enlace: