Ранним утром 7 апреля 2026 года в рейтинге Video Arena от Artificial Analysis внезапно появилось имя, о котором никто раньше не слышал — HappyHorse-1.0. Модель заняла три первых места и одно второе в четырех ключевых категориях, оторвавшись на 60 баллов Elo от предыдущего «лидера» — Seedance 2.0 от ByteDance. Однако в течение 72 часов модель исчезла из рейтинга, и до сих пор ни одна команда не взяла на себя авторство. В этой статье мы кратко разберем, как это событие влияет на сферу генерации видео с помощью ИИ.

Ключевая ценность: за 3 минуты вы узнаете основную информацию о HappyHorse-1.0, её прорывных возможностях, версиях о происхождении и о том, что это значит для текущего рынка генерации видео.

Краткий обзор HappyHorse-1.0

HappyHorse-1.0 — это модель генерации видео, которая появилась в Video Arena от Artificial Analysis под «псевдонимом». У неё нет публичного репозитория на GitHub, официальных весов на HuggingFace или доступного API, но её показатели в четырех основных рейтингах буквально «разгромили» все открытые модели, включая Seedance 2.0 от ByteDance, Veo от Google и Sora от OpenAI.

| Параметр | Детали |

|---|---|

| Название модели | HappyHorse-1.0 (включая вариант V2) |

| Время появления | Раннее утро 7 апреля 2026 г. |

| Платформа рейтинга | Artificial Analysis Video Arena |

| Способ подачи | Анонимно (pseudonymous) |

| Размер модели | Около 15 млрд параметров |

| Архитектура | 40-слойный однопоточный Self-Attention Transformer |

| Мультимодальность | Совместное предварительное обучение (текст / видео / аудио) |

| Статус доступа | ❌ Нет исходного кода · Нет весов · Нет API |

| Предполагаемый источник | Alibaba Tongyi Lab (Wan 2.7?) |

| Текущий статус | Удалена из рейтинга |

💡 Суть в двух словах: HappyHorse-1.0 — это не «продукт», а «анонимное тестирование возможностей». Такая модель выпуска, когда сначала проводится анонимное тестирование, а затем происходит официальный анонс, уже не раз встречалась за последний год в LMArena, Image Arena и Code Arena. Почти всегда за этим стоят ведущие разработчики моделей. Если вы хотите сравнить возможности текущих открытых моделей для генерации видео, вы можете быстро подключиться к основным кандидатам через платформу APIYI (apiyi.com).

Результаты HappyHorse-1.0 в рейтинге Arena

Artificial Analysis — это один из самых авторитетных рейтингов «слепого» тестирования в сфере генерации видео с помощью ИИ. Здесь используется система Elo-рейтинга и слепого голосования пользователей, что исключает предвзятость со стороны разработчиков. Вот результаты HappyHorse-1.0 на момент появления в рейтинге 7 апреля:

| Категория рейтинга | Elo HappyHorse-1.0 | Место | Предыдущий лидер |

|---|---|---|---|

| Текст-в-видео (без звука) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| Изображение-в-видео (без звука) | 1392-1402 | 🥇 #1 | — |

| Текст-в-видео (со звуком) | 1205-1215 | 🥈 #2 | — |

| Изображение-в-видео (со звуком) | 1160 | 🥇 #1 | — |

Самый впечатляющий результат — в категории Текст-в-видео без звука: HappyHorse-1.0 сразу же обошел предыдущего лидера, Seedance 2.0 от ByteDance, на 60 баллов Elo. В системе Elo это означает преимущество в победах примерно на 58%, что является огромным технологическим отрывом.

Предполагаемая техническая архитектура HappyHorse-1.0

Хотя официальной научной статьи нет, на странице релиза HappyHorse-1.0 и в отчетах сторонних аналитиков (например, WaveSpeedAI) раскрыто немало деталей архитектуры. Если информация подтвердится, это станет первым случаем в open-source сообществе, когда реализовано «сквозное (end-to-end) совместное предварительное обучение аудио и видео».

Однопоточный унифицированный Transformer

HappyHorse-1.0 использует 40-слойный Self-Attention Transformer, который объединяет текстовые токены, латентное представление эталонного изображения, зашумленные видеотокены и зашумленные аудиотокены в одну последовательность для совместного шумоподавления. Это кардинально отличается от текущего мейнстримного подхода «двух башен + Cross-Attention» (как у Sora или Seedance):

- По 4 слоя в начале и конце: используются проекции для конкретных модальностей для обработки ввода и вывода.

- 32 промежуточных слоя: параметры полностью общие, модель одинаково обрабатывает все модальности.

- Отсутствие Cross-Attention: все модальности взаимодействуют в рамках одного механизма внимания.

Такой подход «полного Self-Attention в одном потоке» — это парадигма, которую GPT-4o и Gemini 2.x активно развивают в мультимодальности, но в сфере генерации видео это впервые представлено в виде «открытого кода с топовой производительностью».

Совместная генерация аудио и видео

HappyHorse-1.0 заявляет о поддержке генерации видео + диалогов + фонового шума + звуковых эффектов Foley за один проход, с поддержкой 6 языков (китайский, английский, японский, корейский, немецкий, французский). На дополнительных ресурсах также упоминается поддержка кантонского диалекта и «синхронизация губ с ультранизким WER».

Если эти показатели верны, то лидерство HappyHorse-1.0 в области «сквозного аудио-видео обучения» может быть даже более значительным, чем показывают цифры в рейтинге.

Скорость инференса

| Конфигурация | Время |

|---|---|

| Видео 5 сек, 256p | ~2 сек |

| Видео 5 сек, 1080p (H100) | ~38 сек |

Если это правда, то для видеомодели с 15 миллиардами параметров такая скорость выглядит крайне амбициозно, вплотную приближаясь к границе генерации в реальном времени.

Гипотезы о происхождении HappyHorse-1.0

Анонимная подача заявки означает, что Artificial Analysis при публикации может описывать эту модель только как "pseudonymous" (псевдоним). Однако сообщество все же выделило несколько основных версий, основываясь на косвенных уликах.

Гипотеза 1: Alibaba Tongyi Lab (Wan 2.7)

Это самая популярная версия в сообществе на данный момент, и вот почему:

- Совпадение по времени: HappyHorse-1.0 возглавила рейтинг 7 апреля, а в начале апреля Alibaba Tongyi Lab выпустила Wan 2.6. В индустрии все ожидали выхода следующего поколения — Wan 2.7.

- Реакция фондового рынка: Акции Alibaba на Гонконгской бирже выросли почти на 8% после появления HappyHorse в рейтинге — рынок явно связал эти события.

- CJK-мультиязычность: Модель демонстрирует отличную поддержку китайского, японского и корейского языков, что является характерной чертой команд из Восточной Азии.

- Стиль анонимного тестирования: Alibaba ранее уже практиковала стратегию "сначала ограниченный публичный доступ, затем официальный релиз" для серий Qwen и Wan.

Тем не менее официального подтверждения до сих пор нет, а Wan 2.7, официально выпущенная Alibaba в апреле, в некоторых демо-роликах ведет себя не совсем так, как HappyHorse. Поэтому эта гипотеза остается лишь предположением.

Гипотеза 2: ByteDance / Другие крупные корпорации

Некоторые считают, что HappyHorse может быть вариацией следующего поколения серии Seedance от ByteDance, так как именно Seedance 2.0 была смещена с лидерской позиции. У ByteDance есть мотивация анонимно протестировать Seedance 3.0. Но пока никаких доказательств этому нет.

Гипотеза 3: Новый независимый китайский стартап

Есть также мнение, что HappyHorse — это детище совершенно новой, ранее неизвестной китайской команды стартаперов. Стек технологий, который демонстрирует модель (15B + полный Self-Attention + интеграция аудио и видео), выглядит очень дерзко, что больше похоже на работу небольшой команды, не обремененной корпоративными ограничениями.

🎯 Смотрим трезво: Пока нет официального заявления, все разговоры о том, что "это Alibaba", "это ByteDance" или "это какой-то единорог", — лишь догадки. Нам важно не "кто это", а "какого предела возможностей они достигли", и какие из доступных видеомоделей мы можем использовать для создания реальных продуктов уже сейчас. Если вам нужно оперативно подключиться к популярным видеомоделям для проверки гипотез, вы можете воспользоваться сервисом-прокси API APIYI (apiyi.com) для вызова различных моделей в одном месте.

Загадочные 72 часа HappyHorse-1.0

Самым драматичным моментом стало «исчезновение» HappyHorse-1.0. Менее чем через 72 часа после того, как модель возглавила рейтинг Artificial Analysis ранним утром 7 апреля, серия HappyHorse была внезапно удалена из списка. Остались лишь:

- Несколько скриншотов, разлетевшихся по соцсетям.

- Зашифрованная официальная посадочная страница (с обещанием, что «GitHub / HuggingFace скоро откроются», но ссылки не работают).

- Официальное подтверждение от самой Artificial Analysis об «отзыве» модели.

Такой сценарий «взлет в рейтинге — исчезновение» уже не раз наблюдался на LMArena: ранние анонимные версии GPT-4 Turbo, превью Claude 3.5 Sonnet, ранние варианты Gemini 2.0 Flash — все они проходили через подобный процесс. Практически каждый раз после исчезновения анонимной модели в течение 3–8 недель происходит официальный релиз продукта.

В индустрии сложилось единое мнение насчет HappyHorse: это один из топовых коллективов собирает данные о предпочтениях реальных пользователей, готовясь к полноценному запуску.

Влияние HappyHorse-1.0 на индустрию генерации видео с помощью ИИ

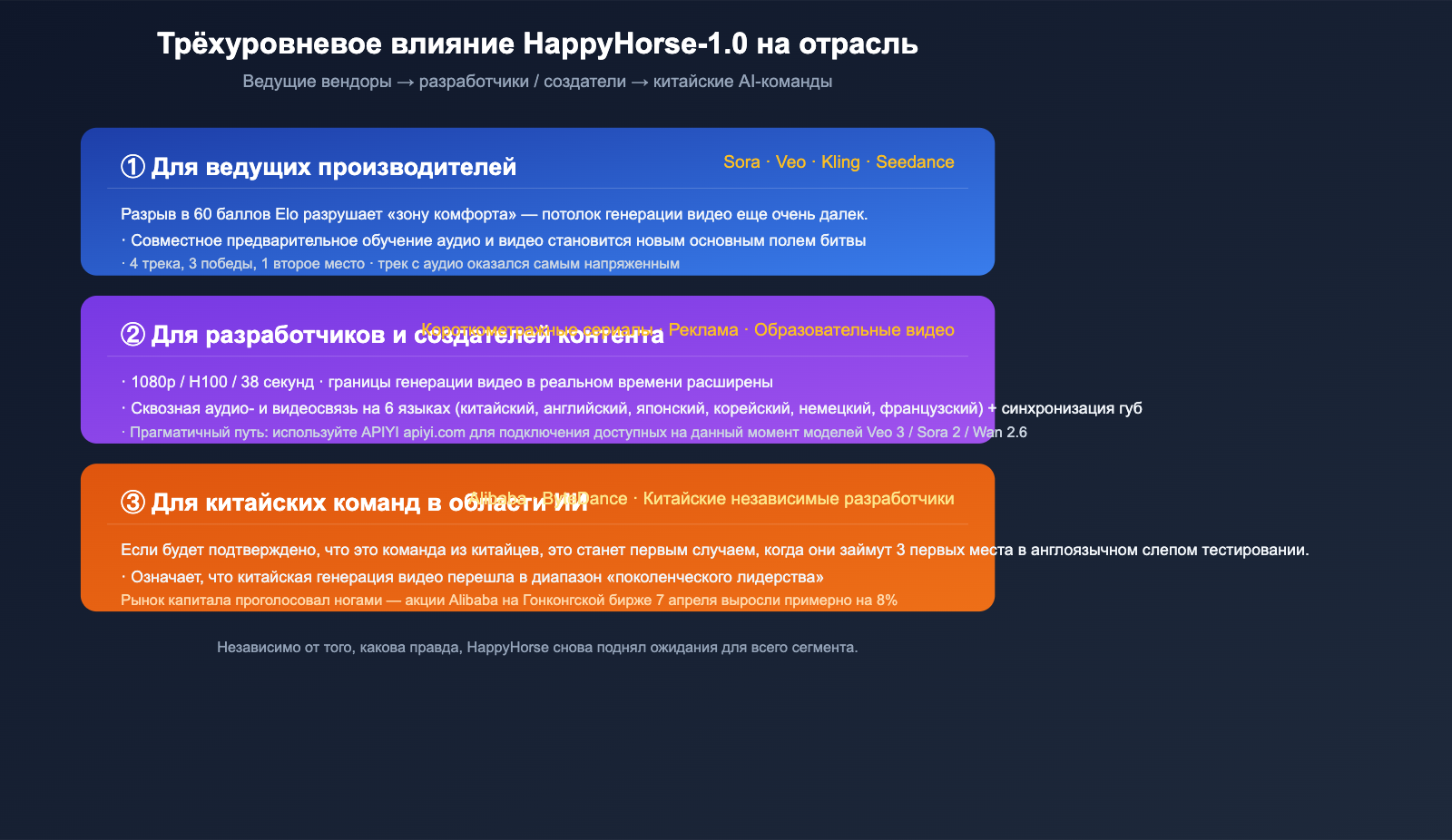

Даже если HappyHorse-1.0 так и не выйдет в публичный доступ, она уже оказала существенное влияние на весь сегмент генерации видео с помощью ИИ.

Влияние на лидеров рынка

- «Зона комфорта» Seedance 2.0, Veo 3 и Sora 2 нарушена: разрыв в 60 баллов Elo показывает, что предел возможностей генерации видео еще очень далек.

- Синхронная генерация аудио и видео — новое поле битвы: HappyHorse заняла первые места в 3 из 4 категорий, причем наибольшее давление ощущается в сегменте аудиовизуальной интеграции. Это заставит всех лидеров ускорить внедрение стратегий audio-video pretraining.

- Давление на open-source/semi-open-source: HappyHorse заявляет «Everything is open» (хотя по факту еще не открылась), что усиливает давление на закрытые продукты вроде Sora.

Влияние на разработчиков и создателей контента

- Пересмотр ожиданий: 1080p / H100 / 38 секунд — такое соотношение цены и производительности делает «генерацию видео в реальном времени» вполне достижимой реальностью, а не фантастикой.

- Мультиязычность + синхронизация губ: сквозная генерация аудио и видео на 6 языках (китайский, английский, японский, корейский, немецкий, французский) — это огромный плюс для короткометражек, рекламы и образовательного контента.

- Прагматичный подход: пока HappyHorse не стала общедоступной, лучшим способом создания реальных продуктов остается использование уже доступных моделей, таких как Veo 3, Sora 2, Kling 2 или Wan 2.6. Их можно удобно подключить через сервис-прокси API APIYI (apiyi.com).

Влияние на китайские ИИ-команды

Если в итоге подтвердится, что HappyHorse — это разработка Alibaba или другой китайской команды, это станет первым случаем, когда китайская ИИ-модель для генерации видео заняла три первых места в англоязычном «слепом» рейтинге Artificial Analysis, где нет региональных предпочтений. Значение этого факта выходит далеко за рамки самой модели.

Часто задаваемые вопросы о HappyHorse-1.0

Q1: Можно ли сейчас воспользоваться HappyHorse-1.0?

Нет. Модель появилась в слепом тестировании на платформе Artificial Analysis всего на 72 часа. У неё нет публичного API, доступных для скачивания весов или репозитория на GitHub. Если вам нужно прямо сейчас поработать с топовыми моделями генерации видео, вы можете получить доступ к актуальным решениям, таким как Veo 3, Sora 2, Kling 2, Wan 2.6 и другим, через сервис-прокси API APIYI (apiyi.com).

Q2: Действительно ли HappyHorse-1.0 — это Wan 2.7 от Alibaba?

Официального подтверждения пока нет. В сообществе выделяют четыре косвенных признака (совпадение по времени, резкий рост акций Alibaba на бирже, поддержка нескольких языков CJK, исторический стиль релизов компании). Однако демонстрации Wan 2.7 после его официального выхода в апреле не полностью совпадают с результатами HappyHorse. Поэтому корректнее сказать так: вероятность высока, но официально не подтверждено.

Q3: Что на самом деле означает отрыв в 60 баллов Elo?

В системе рейтинга Elo отрыв в 60 баллов примерно соответствует 58% побед в слепом тестировании. Это весьма существенный разрыв, который, тем не менее, можно преодолеть. Для сравнения: за последний год колебания рейтинга между Sora, Veo, Kling и Seedance обычно укладывались в 20–40 баллов. То, что HappyHorse сразу показала отрыв в 60 баллов, действительно говорит о качественном скачке.

Q4: Насколько радикальна архитектура «15B параметров + единый поток Self-Attention»?

Очень радикальна. Современные популярные видеомодели обычно используют гибридные подходы вроде "двухбашенной архитектуры + Cross-Attention" или "DiT + кросс-модальная проекция". HappyHorse же объединяет аудио, видео и текст в рамках одного 40-слойного трансформера с общими параметрами. Это тот же технический путь, который GPT-4o и Gemini 2.x пробуют в мультимодальном направлении, но в сфере генерации видео это первый случай, когда такой подход показал топовую производительность.

Q5: Почему она исчезла из рейтинга через 72 часа?

Это стандартная "модель сбора данных" для анонимных моделей. Ранние версии GPT-4 Turbo, превью Claude 3.5 Sonnet и ранние варианты Gemini 2.0 Flash на LMArena проходили тот же путь: запуск → сбор реальных данных о предпочтениях пользователей → отзыв → официальный релиз через несколько недель. Ожидается, что HappyHorse вернется под официальным названием в течение 3–8 недель.

Q6: Какими видеомоделями я могу заменить HappyHorse сейчас?

На данный момент среди доступных моделей с лучшими комплексными показателями можно выделить: Google Veo 3 (топ-уровень по качеству), OpenAI Sora 2 (отличная работа с планами), Kling 2 (хорошая работа с лицами и движениями), ByteDance Seedance 2.0 (сильна в китайских сценариях), Alibaba Wan 2.6 (открытый исходный код + легкость развертывания). Если вам нужно использовать единый интерфейс для вызова этих моделей и их сравнения, вы можете подключиться через платформу APIYI (apiyi.com), чтобы не переключаться между десятками разных аккаунтов.

Итоги

HappyHorse-1.0 — это самый драматичный "анонимный десант" в сфере генерации видео за апрель 2026 года. Этот кейс доказывает три вещи:

- Верхняя планка возможностей генерации видео снова поднята: отрыв в 60 баллов Elo и победы в 3 из 4 категорий показывают, что "лучшие видеомодели", которые мы видим сегодня, еще далеки от своего потолка.

- Совместная генерация аудио и видео становится новым полем битвы: сильные результаты HappyHorse в категориях с аудио заставят индустрию ускорить внедрение сквозного (end-to-end) аудио-видео претрейнинга.

- Схема "анонимный запуск → отзыв → официальный релиз" становится стандартом для флагманских моделей: ожидаем, что в ближайшие 3–8 недель кто-то из известных нам гигантов официально представит эту модель.

🚀 Совет: Пока HappyHorse официально не доступна, самое разумное — освоить текущие топовые видеомодели. Veo 3, Sora 2, Kling 2, Seedance 2.0 и Wan 2.6 покрывают 90% реальных задач. Мы рекомендуем использовать APIYI (apiyi.com) для доступа к основным видеомоделям через единый API с оплатой по факту использования. Это позволит вам легко переключиться на HappyHorse или Wan 2.7 сразу после их официального релиза.

Автор: Команда APIYI — специализируемся на предоставлении стабильного доступа к ведущим AI-моделям для разработчиков. Узнайте больше на apiyi.com.

Справочные материалы

-

Блог WaveSpeedAI — Что такое HappyHorse-1.0

- Ссылка:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - Описание: Сторонний глубокий анализ архитектуры, параметров и скорости инференса.

- Ссылка:

-

Artificial Analysis — Таблица лидеров Video Arena

- Ссылка:

artificialanalysis.ai/video/leaderboard/text-to-video - Описание: Исходные рейтинги в категориях «текст-в-видео» и «изображение-в-видео».

- Ссылка:

-

Phemex News — HappyHorse возглавляет рейтинги

- Ссылка:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - Описание: Сравнительные данные между HappyHorse и Seedance 2.0.

- Ссылка:

-

36Kr — Загадочная модель HappyHorse

- Ссылка:

eu.36kr.com/en/p/3757826958635781 - Описание: Отраслевой разбор появления анонимной модели.

- Ссылка:

-

Futunn — Акции Alibaba на гонконгской бирже выросли благодаря HappyHorse

- Ссылка:

news.futunn.com/en/post/71208943 - Описание: Реакция рынка капитала на догадки о происхождении модели.

- Ссылка:

-

DEV Community — Кто разработал HappyHorse

- Ссылка:

dev.to/calvin_claire_451169e1b82 - Описание: Различные версии сообщества о команде разработчиков.

- Ссылка: