2026 年 4 月 7 日凌晨,Artificial Analysis 的 Video Arena 榜单突然空降一个谁都没听说过的名字 —— HappyHorse-1.0。它在四个核心榜单中拿下三个第一、一个第二,把此前的"统治者"字节 Seedance 2.0 直接甩开 60 分 Elo。然而 72 小时之内,这个模型从榜单上消失了,至今没有任何团队公开认领。本文快速解读这一动态对 AI 视频生成领域的影响。

核心价值: 3 分钟了解 HappyHorse-1.0 的核心信息、能力突破、来历猜想,以及它对当前 AI 视频生成赛道意味着什么。

HappyHorse-1.0 核心信息速览

HappyHorse-1.0 是一个采用"匿名提交(pseudonymous)"方式登陆 Artificial Analysis Video Arena 的视频生成模型。它没有公开的 GitHub、没有官方 HuggingFace 权重、没有可访问的 API,但其在四个核心榜单上的表现却把所有公开模型 —— 包括字节 Seedance 2.0、Google Veo、OpenAI Sora —— 全部按在地上摩擦。

| 信息项 | 详情 |

|---|---|

| 模型名称 | HappyHorse-1.0 (含 V2 变体) |

| 出现时间 | 2026 年 4 月 7 日凌晨 |

| 上榜平台 | Artificial Analysis Video Arena |

| 提交方式 | 匿名 (pseudonymous) |

| 模型规模 | 约 15B 参数 |

| 架构 | 40 层单流 Self-Attention Transformer |

| 联合模态 | 文本 / 视频 / 音频 联合预训练 |

| 公开状态 | ❌ 无源码 · 无权重 · 无 API |

| 来源猜测 | 阿里巴巴通义实验室 (Wan 2.7?) |

| 当前状态 | 已从榜单消失 |

💡 快速理解: HappyHorse-1.0 不是一个"产品",而是一次"匿名能力公开测试"。这种"先匿名打榜、再公开认领"的发布范式过去一年在 LMArena、Image Arena、Code Arena 上多次出现,几乎每次背后都站着一家头部模型厂商。如果你希望对比体验当前已开放的视频生成模型,可以通过 API易 apiyi.com 平台快速接入主流候选。

HappyHorse-1.0 的 Arena 排名战绩

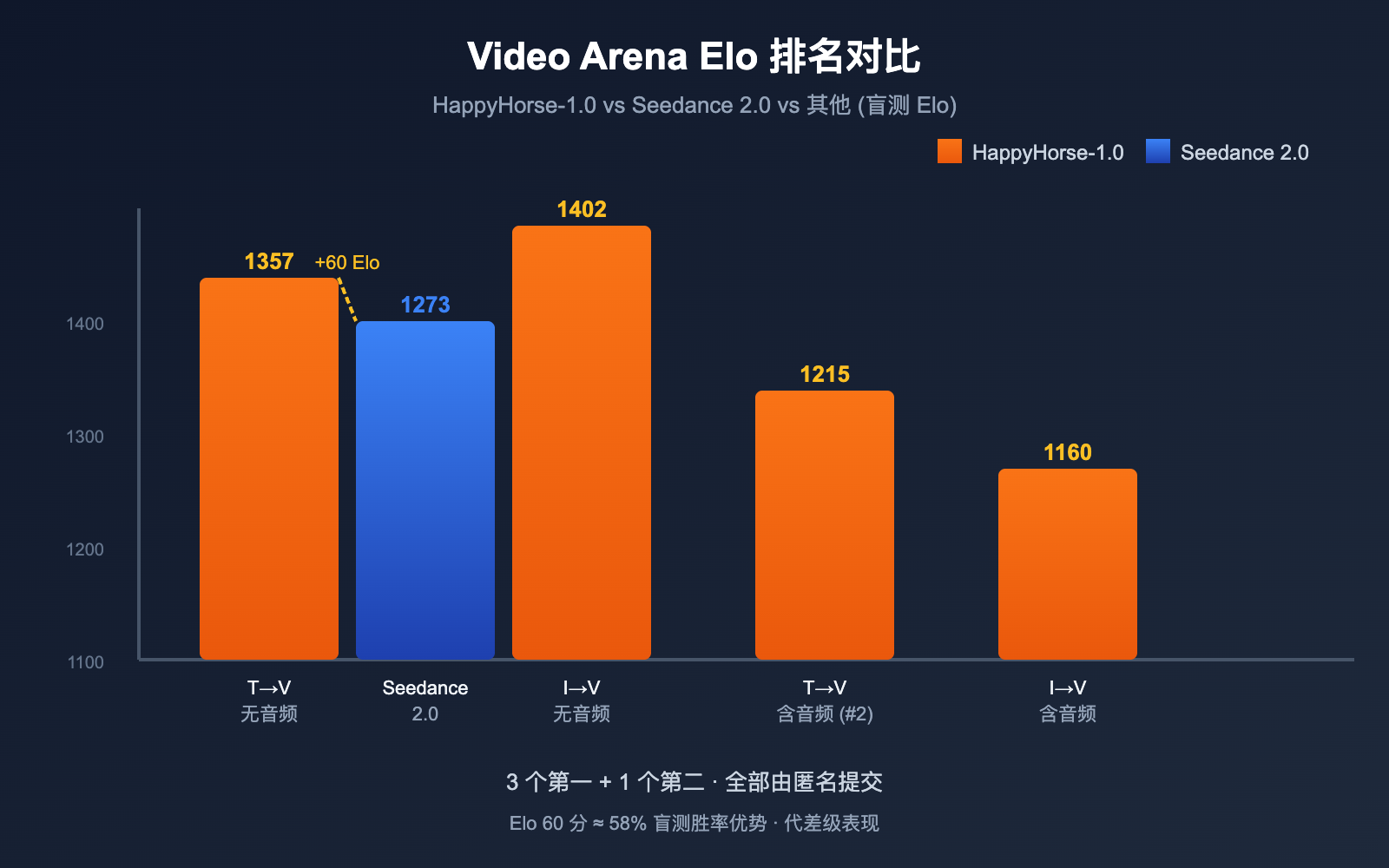

Artificial Analysis 是目前 AI 视频生成领域最权威的盲测榜单之一,采用 Elo 评分 + 用户盲投的方式,避免了厂商自说自话。HappyHorse-1.0 在 4 月 7 日上榜时的成绩如下:

| 榜单类别 | HappyHorse-1.0 Elo | 排名 | 此前第一 |

|---|---|---|---|

| Text-to-Video (无音频) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| Image-to-Video (无音频) | 1392-1402 | 🥇 #1 | — |

| Text-to-Video (含音频) | 1205-1215 | 🥈 #2 | — |

| Image-to-Video (含音频) | 1160 | 🥇 #1 | — |

最具冲击力的是 Text-to-Video 无音频赛道:HappyHorse-1.0 一上来就比此前的统治者字节 Seedance 2.0 高出 60 分 Elo。在 Elo 评分体系下,60 分意味着 约 58% 的胜率优势,这是一个相当大的代差。

HappyHorse-1.0 的技术架构猜想

虽然没有官方论文,但 HappyHorse-1.0 的发布页面和 WaveSpeedAI 等第三方分析披露了不少架构细节,如果属实,将是开源社区第一次完成"端到端音视频联合预训练"。

单流统一 Transformer

HappyHorse-1.0 采用一个 40 层 Self-Attention Transformer,将文本 token、参考图 latent、加噪视频 token、加噪音频 token 打包到同一个序列中联合去噪。这与目前主流的"双塔 + Cross-Attention"路线(如 Sora、Seedance)截然不同:

- 首尾各 4 层:使用模态特定投影,处理输入输出

- 中间 32 层:参数完全共享,对所有模态一视同仁

- 没有 Cross-Attention:所有模态在同一注意力机制内交互

这种"全 Self-Attention 单流"路线,是 GPT-4o、Gemini 2.x 在多模态方向上一直在尝试的范式,但在视频生成领域第一次以"开源 + 顶级性能"的形式出现。

音视频联合生成

HappyHorse-1.0 声称支持单次推理同时生成视频 + 对白 + 环境音 + Foley 音效,并覆盖 6 种语言(中、英、日、韩、德、法)。次级站点还宣称包括粤语和"超低 WER 唇形同步"。

如果这些指标全部属实,HappyHorse-1.0 在"端到端 audio-video pretraining"维度上的领先幅度可能比榜单显示的更大。

推理速度

| 配置 | 时间 |

|---|---|

| 5 秒 256p 视频 | ~2 秒 |

| 5 秒 1080p 视频 (H100) | ~38 秒 |

如果属实,这个速度在 15B 参数级别的视频模型里相当激进,逼近实时生成的边界。

HappyHorse-1.0 的来历猜想

匿名提交意味着 Artificial Analysis 在公示时只能用 "pseudonymous"(化名)来描述这个模型。但社区还是从蛛丝马迹中提炼出了几条主流猜想。

猜想 1: 阿里巴巴通义实验室(Wan 2.7)

这是当前社区呼声最高的猜想,理由有四:

- 时间巧合: 4 月 7 日 HappyHorse-1.0 登顶后,4 月初阿里通义实验室发布了 Wan 2.6,业界普遍预期下一代 Wan 2.7 即将到来

- 资本市场反应: 港股阿里巴巴在 HappyHorse 上榜后一度上涨近 8%,市场显然把它和阿里联系在了一起

- CJK 多语言能力: 模型对中、日、韩三语支持极强,这是华人/东亚团队的典型特征

- 匿名打榜风格: 阿里此前在 Qwen / Wan 系列上多次采用过"先小范围公开 / 再正式发布"的节奏

但官方至今没有承认,且阿里通义实验室在 4 月正式发布的 Wan 2.7 与 HappyHorse 在某些公开演示中表现并不完全一致,因此这条猜想仍未被证实。

猜想 2: 字节跳动 / 其他大厂

部分声音认为 HappyHorse 可能是字节 Seedance 系列的下一代变体,因为 Seedance 2.0 是被它超越的对象,字节有动机用匿名方式提前测试 Seedance 3.0。但目前没有任何证据支持。

猜想 3: 一个全新的华人独立团队

也有人猜测 HappyHorse 来自一个全新的、未被外界关注的华人初创团队,因为模型展示的"15B + 全 Self-Attention + 音视频联合"这套技术栈非常激进,更像是一个"无包袱"的小团队作品。

🎯 理性看待: 在官方公开认领之前,所有"是阿里"、"是字节"、"是某独角兽"的说法都只是猜测。值得我们关注的不是"它是谁",而是"它代表的能力上限已经到了哪里",以及当下我们能用哪些已经开放的视频模型构建实际应用。如果你需要立即接入主流视频模型做产品验证,可以通过 API易 apiyi.com 一站式调用多家可用模型。

HappyHorse-1.0 神秘消失的 72 小时

最戏剧化的是 HappyHorse-1.0 的"消失"。4 月 7 日凌晨登顶 Artificial Analysis 榜单后不到 72 小时,HappyHorse 系列模型从榜单上突然撤下,仅留下:

- 几张在社交媒体上流传的截图

- 一个加密的官方落地页(声称"GitHub / HuggingFace 即将开放",但链接均不可用)

- Artificial Analysis 自己确认"已撤回"的官方说明

这种"打榜 → 消失"的剧本之前在 LMArena 上多次出现过:GPT-4 Turbo 的早期匿名版本、Claude 3.5 Sonnet 的预览、Gemini 2.0 Flash 的早期变体,都走过类似流程。几乎每一次匿名模型消失后,3-8 周内都会有正式产品发布。

业内对 HappyHorse 的解读基本一致:这是某个头部团队在收集真实用户偏好数据,为正式发布做准备。

HappyHorse-1.0 对 AI 视频生成行业的影响

HappyHorse-1.0 即使最终没有公开发布,也已经对整个 AI 视频生成赛道产生了实质影响。

对头部厂商的影响

- Seedance 2.0、Veo 3、Sora 2 的"舒适区"被打破: 60 分 Elo 的差距说明视频生成的能力上限远未到达

- 音视频联合生成成为新战场: HappyHorse 在 4 个赛道中拿下 3 个第一,且音频联合赛道压力最大,这会逼迫所有头部厂商加速 audio-video pretraining 路线

- 开源/半开源压力: HappyHorse 自称"Everything is open"(虽然还没真的开源),这会增加 Sora 等闭源产品的压力

对开发者和创作者的影响

- 能力预期被刷新: 1080p / H100 / 38 秒,这个 cost-performance 比让"实时视频生成"变得不再科幻

- 多语言 + 唇形同步: 中、英、日、韩、德、法 6 种语言的端到端音视频生成,对短剧、广告、教育视频是巨大利好

- 务实路径不变: 在 HappyHorse 真正开放前,把 Veo 3 / Sora 2 / Kling 2 / Wan 2.6 等已经可用的模型用熟,依然是构建实际产品的最佳路径,可以通过 API易 apiyi.com 一站接入

对中国 AI 团队的影响

如果 HappyHorse 最终被证实是阿里 / 其他华人团队作品,这将是中国 AI 视频生成第一次在 Artificial Analysis 这种"无地区偏好"的英文盲测榜单上拿下 3 个第一。这个意义远超模型本身。

HappyHorse-1.0 常见问题

Q1: HappyHorse-1.0 现在能用吗?

不能。它只在 Artificial Analysis 的盲测 Arena 中短暂出现过约 72 小时,没有公开 API、没有可下载的权重、没有可访问的 GitHub。如果你需要立即调用顶级视频生成模型,可以通过 API易 apiyi.com 接入当前已开放的 Veo 3、Sora 2、Kling 2、Wan 2.6 等主流模型。

Q2: HappyHorse-1.0 真的是阿里巴巴的 Wan 2.7 吗?

目前没有官方承认。社区有四条推测理由(时间巧合、阿里港股大涨、CJK 多语能力、阿里历史发布风格),但 Wan 2.7 在 4 月正式发布后的演示与 HappyHorse 并不完全一致,因此严谨的说法是: 可能性较高,但未被证实。

Q3: 它的 60 分 Elo 领先到底意味着什么?

在 Elo 评分体系下,60 分领先大致对应 58% 的盲测胜率。这是一个非常显著但仍可被超越的差距。作为参考,过去一年内 Sora、Veo、Kling、Seedance 之间的换位通常都在 20-40 分以内。HappyHorse 一上来就 60 分,确实属于代差级表现。

Q4: 它的”15B 参数 + 全 Self-Attention 单流”架构有多激进?

非常激进。当前主流视频模型普遍采用"双塔 + Cross-Attention"或"DiT + 跨模态投影"的混合路线,HappyHorse 把音频、视频、文本统统放进一个 40 层 Transformer 共享参数。这是 GPT-4o / Gemini 2.x 在多模态方向尝试的同一条技术路线,但在视频生成领域是第一次以顶级性能验证。

Q5: 为什么它打榜 72 小时就消失了?

这是匿名模型常见的"数据收集模式"。LMArena 上的 GPT-4 Turbo 早期版本、Claude 3.5 Sonnet 的预览、Gemini 2.0 Flash 的早期变体都走过相同流程:上线 → 收集真实偏好数据 → 撤回 → 几周后正式发布。预计 HappyHorse 在 3-8 周内会以某个正式名字回归。

Q6: 我现在能用什么视频模型替代 HappyHorse?

目前已开放且综合表现最强的几个候选包括: Google Veo 3 (通用质量第一梯队)、OpenAI Sora 2 (镜头语言强)、Kling 2 (人像/动作好)、字节 Seedance 2.0 (中文场景强)、阿里 Wan 2.6 (开源 + 易部署)。如果你需要用一个统一接口同时调用这几家模型做对比测试,可以通过 API易 apiyi.com 平台一站接入,避免在多个账号体系之间切换。

总结

HappyHorse-1.0 是 2026 年 4 月 AI 视频生成领域最具戏剧性的一次"匿名空降"。它代表了三件事:

- 视频生成的能力上限被再次抬高: 60 分 Elo 领先 + 4 个赛道 3 冠 1 亚,说明今天我们看到的"最强视频模型"远未到天花板

- 音视频联合生成成为新主战场: HappyHorse 在含音频赛道的强势表现,会推动整个行业把端到端 audio-video pretraining 提上日程

- 匿名 → 撤回 → 正式发布"成为旗舰模型的标准发布范式: 预计 3-8 周内会有一个我们熟悉的厂商正式认领它

🚀 行动建议: 在 HappyHorse 真正开放之前,最务实的事情不是猜它的来历,而是先把当前已经可用的顶级视频模型用熟。Veo 3、Sora 2、Kling 2、Seedance 2.0、Wan 2.6 这几个模型完全可以覆盖 90% 的实际生产场景。我们建议通过 API易 apiyi.com 一站接入主流视频模型,按量计费、随时切换,等 HappyHorse / Wan 2.7 正式开放后第一时间无缝迁移即可。

作者: APIYI Team — 专注于为开发者提供主流 AI 大模型的稳定接入,访问 apiyi.com 了解更多。

参考资料

-

WaveSpeedAI 博客 – What Is HappyHorse-1.0

- 链接:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - 说明: 架构、参数与推理速度的第三方深度分析

- 链接:

-

Artificial Analysis – Video Arena Leaderboard

- 链接:

artificialanalysis.ai/video/leaderboard/text-to-video - 说明: Text-to-Video 与 Image-to-Video 双榜原始排名

- 链接:

-

Phemex News – HappyHorse Tops Rankings

- 链接:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - 说明: HappyHorse 与 Seedance 2.0 的对比数据

- 链接:

-

36Kr – Mysterious Model HappyHorse

- 链接:

eu.36kr.com/en/p/3757826958635781 - 说明: 匿名模型登场的行业解读

- 链接:

-

Futunn – 阿里港股因 HappyHorse 大涨

- 链接:

news.futunn.com/en/post/71208943 - 说明: 资本市场对来源猜想的反应

- 链接:

-

DEV Community – Who Developed HappyHorse

- 链接:

dev.to/calvin_claire_451169e1b82 - 说明: 社区对开发团队的多种猜想

- 链接: