Nota del autor: Análisis profundo de las capacidades de programación de GPT-5.4 frente a GPT-5.3 Codex, con datos de 6 pruebas de referencia como SWE-Bench y Terminal-Bench, para ayudarte a elegir el modelo de programación más adecuado.

GPT-5.4 acaba de lanzarse, y la primera pregunta de muchos desarrolladores es: ¿Todavía necesito GPT-5.3 Codex? Después de todo, GPT-5.4 se presenta como el "primer modelo unificado que fusiona capacidades de programación, razonamiento y control informático", mientras que GPT-5.3 Codex es la oferta insignia de OpenAI diseñada específicamente para programación.

Valor central: Este artículo, a través de datos duros de 6 pruebas de referencia y una comparación integral que incluye precios, contexto y escenarios de uso, te ayudará a tomar la decisión más clara.

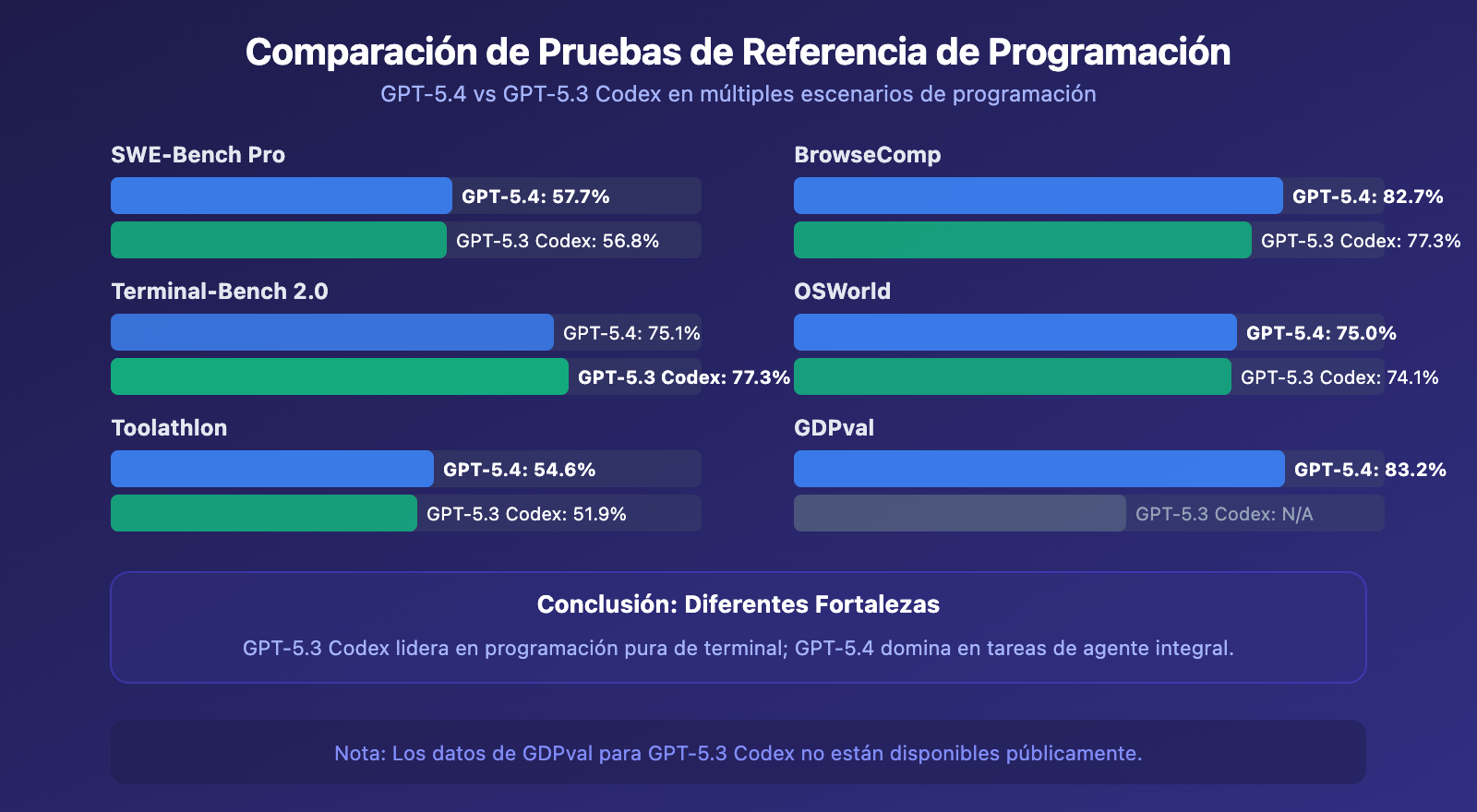

Puntos clave de las capacidades de programación: GPT-5.4 vs GPT-5.3 Codex

| Dimensión de Comparación | GPT-5.4 | GPT-5.3 Codex | Ganador |

|---|---|---|---|

| SWE-Bench Pro | 57.7% | 56.8% | GPT-5.4 |

| Terminal-Bench 2.0 | 75.1% | 77.3% | GPT-5.3 Codex |

| Toolathlon | 54.6% | 51.9% | GPT-5.4 |

| BrowseComp | 82.7% | 77.3% | GPT-5.4 |

| OSWorld | 75.0% | 74.0% | GPT-5.4 |

| Precio de Entrada | $2.50/M | $1.75/M | GPT-5.3 Codex |

Conclusión en una frase de la comparación GPT-5.4 vs GPT-5.3 Codex

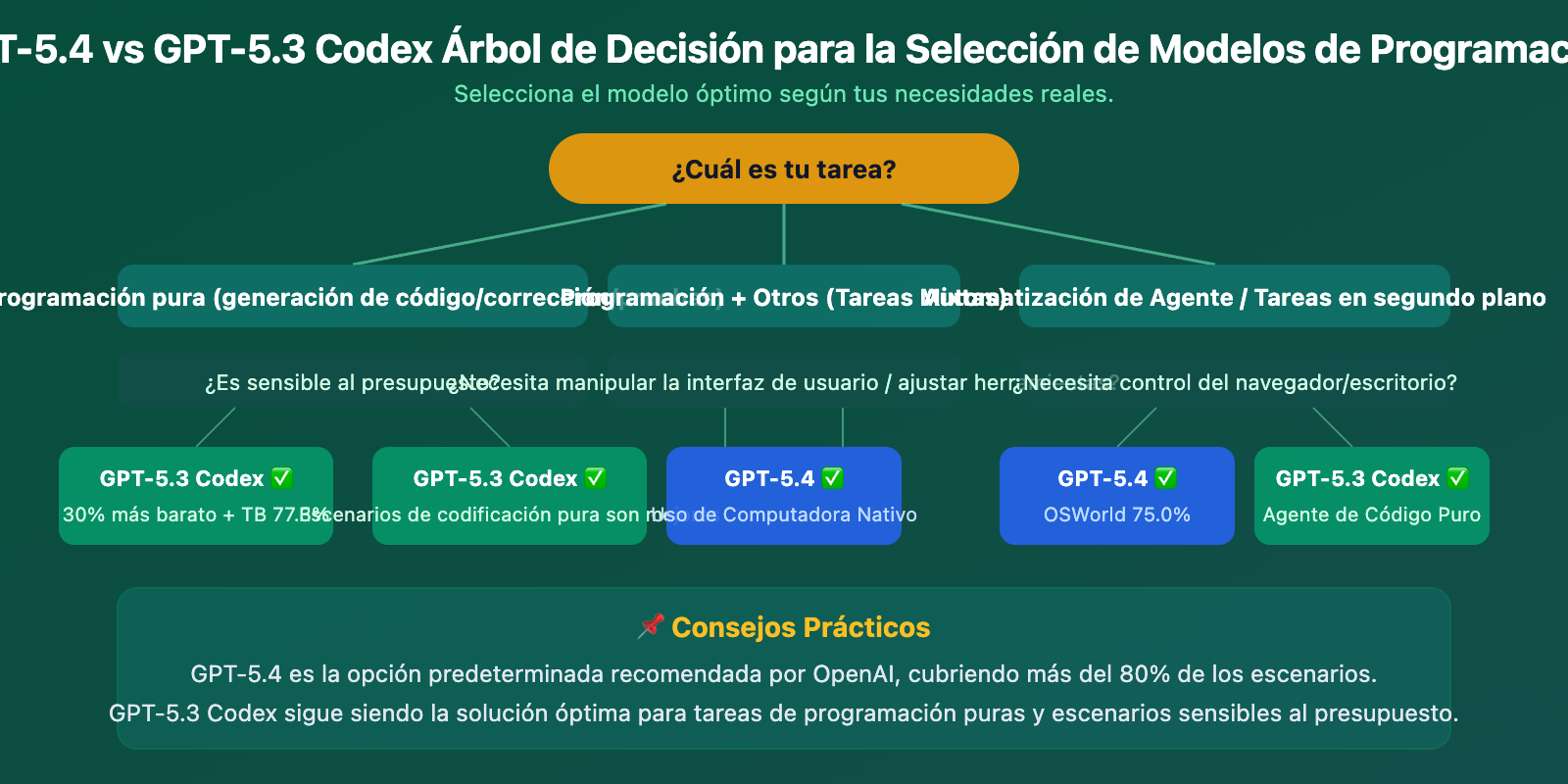

GPT-5.4 lidera en los puntos de referencia generales, pero GPT-5.3 Codex sigue siendo más fuerte y más barato en tareas de programación pura. La elección depende de tu escenario de uso: ¿solo escribir código o un flujo de trabajo mixto de programación + otras tareas?

La recomendación oficial de OpenAI también es clara: comienza con GPT-5.4 para la mayoría de las tareas, usa GPT-5.3 Codex para tareas intensivas de programación pura.

SWE-Bench Pro: GPT-5.4 con una ligera ventaja

SWE-Bench Pro es una variante más difícil y privada de repositorios de código, diseñada específicamente para resistir la contaminación de datos en pruebas comparativas. GPT-5.4 lidera con un 57.7% frente al 56.8% de GPT-5.3 Codex, una ventaja de aproximadamente 1 punto porcentual.

Esta diferencia no es grande, pero considerando que GPT-5.4 es un modelo generalista y no especializado en programación, el hecho de que supere a un modelo experto en SWE-Bench Pro habla por sí solo de la profundidad integrada de sus capacidades de codificación.

Terminal-Bench 2.0: GPT-5.3 Codex lidera claramente

Terminal-Bench 2.0 es una prueba dura de capacidad de programación pura en terminal. GPT-5.3 Codex lidera con un 77.3% frente al 75.1% de GPT-5.4, una ventaja de 2.2 puntos porcentuales. Esta es la prueba comparativa donde GPT-5.3 Codex gana de manera más clara.

Este resultado es lógico: GPT-5.3 Codex está optimizado específicamente para la "programación por agentes" (Agentic Coding), lo que le da una ventaja natural en escenarios verticales como generación de código puro, autocompletado de código y operaciones de terminal.

Toolathlon y BrowseComp: GPT-5.4 lidera de forma integral

En las pruebas que involucran llamadas a herramientas (Toolathlon, 54.6% vs 51.9%) e interacción con navegador (BrowseComp, 82.7% vs 77.3%), GPT-5.4 gana de manera integral. Esto refleja la ventaja de GPT-5.4 en las capacidades de agente integral "más allá de la programación": llamar a herramientas, operar navegadores y colaborar entre aplicaciones.

Comparación de Precios y Especificaciones de Programación: GPT-5.4 vs GPT-5.3 Codex

La diferencia de precio es un factor central que preocupa a muchos desarrolladores. A continuación, una comparación completa de las especificaciones de ambos modelos:

| Dimensión de Especificación | GPT-5.4 | GPT-5.3 Codex | Diferencia |

|---|---|---|---|

| Precio de Entrada | $2.50/M tokens | $1.75/M tokens | Codex es 30% más barato |

| Precio de Salida | $15.00/M tokens | $14.00/M tokens | Codex es 7% más barato |

| Caché de Entrada | $0.25/M tokens | No publicado | GPT-5.4 lo soporta |

| Ventana de Contexto | 1,050K tokens | 400K-1M tokens | GPT-5.4 es mayor |

| Salida Máxima | 128K tokens | No publicado explícitamente | — |

| Uso de Computadora | ✅ Soporte nativo | ❌ No soportado | Exclusivo de GPT-5.4 |

| Búsqueda de Herramientas | ✅ Ahorra 47% de Tokens | ❌ No soportado | Exclusivo de GPT-5.4 |

| Posicionamiento | Generalista bandera | Especializado en programación | Enfoques diferentes |

Cálculo Práctico de Costos de Programación: GPT-5.4 vs GPT-5.3 Codex

Aunque GPT-5.3 Codex tiene un precio unitario más barato, GPT-5.4 tiene dos factores compensatorios:

- Menos Tokens de Razonamiento: OpenAI señala oficialmente que GPT-5.4 "resuelve problemas similares con significativamente menos tokens de razonamiento", por lo que el costo real podría ser similar o incluso menor.

- Búsqueda de Herramientas ahorra 47%: Para flujos de trabajo de agente que llaman frecuentemente a herramientas, el consumo de tokens de GPT-5.4 se reduce drásticamente.

Conclusión: Si tu tarea es principalmente generación de código puro o autocompletado, GPT-5.3 Codex tiene un costo menor. Si involucra un flujo de trabajo mixto de programación + llamadas a herramientas + operaciones de navegador, el costo real de GPT-5.4 podría ser más óptimo.

Referencia de Precios: Ambos modelos se pueden invocar a través de APIYI apiyi.com, con precios sincronizados con los oficiales. Regístrate y úsalo al instante, recarga desde 100 USD y obtén un bono del 10%+.

Diferencias en filosofía de diseño de programación entre GPT-5.4 y GPT-5.3 Codex

Para tomar la decisión correcta, es fundamental entender el propósito de diseño original de cada modelo.

GPT-5.3 Codex: Nacido para la "programación por agente"

Cuando GPT-5.3 Codex se lanzó en febrero de 2026, el posicionamiento de OpenAI fue muy claro: es un compañero de programación a nivel de "pasante altamente productivo". Sus características principales son:

- Completar tareas de ingeniería de forma autónoma: No necesita instrucciones paso a paso. Puedes asignarle una tarea y él la ejecutará por sí mismo.

- Ciclo de autocorrección: Escribir código → ejecutar pruebas → detectar errores → corregir → volver a probar. Todo este ciclo se realiza automáticamente.

- Interrumpible y redirigible: Puedes interrumpirlo en cualquier momento, ajustar la dirección, y no perderá el contexto.

- 25% más rápido que GPT-5.2 Codex: La optimización de velocidad fue uno de sus principales atractivos.

GPT-5.4: Unificador de programación, razonamiento y control

GPT-5.4 no es una simple actualización de un modelo de programación. Es el intento de "gran unificación" de OpenAI: integrar capacidades de programación, razonamiento profundo, control del ordenador y conocimiento especializado en un solo modelo. Sus características principales son:

- Fusión de las capacidades de Codex: OpenAI afirma explícitamente que GPT-5.4 "integra las capacidades de codificación de vanguardia de GPT-5.3 Codex".

- Computer Use nativo: Puede controlar directamente la interfaz del ordenador, no solo generar código.

- Trabajo con conocimiento especializado: GDPval 83.0%, precisión del 87.3% en tareas de banca de inversión.

- Simplificación de la elección de modelo: OpenAI espera que GPT-5.4 reemplace múltiples modelos especializados, reduciendo la dificultad de elección.

Guía de selección de escenarios de programación: GPT-5.4 vs GPT-5.3 Codex

La documentación oficial de OpenAI ofrece recomendaciones claras para elegir el modelo:

| Escenario de uso | Modelo recomendado | Razón |

|---|---|---|

| La mayoría de las tareas de Codex (por defecto) | GPT-5.4 | Capacidad integral más fuerte, recomendación por defecto de OpenAI |

| Flujos de trabajo mixtos: programación + planificación + escritura | GPT-5.4 | Su capacidad multidisciplinaria supera con creces a Codex |

| Tareas de programación pura e intensiva | GPT-5.3 Codex | Terminal-Bench 77.3% más alto, optimizado específicamente para codificación |

| Programación en pareja en tiempo real | GPT-5.3 Codex Spark | Respuesta ultrarrápida de 1000+ tokens/s (exclusivo para Pro) |

| Tareas de programación sensibles al presupuesto | GPT-5.3 Codex | Precio de entrada un 30% más barato |

| Análisis de grandes bases de código | GPT-5.4 | Ventana de contexto máxima de 1.05M |

| Desarrollo de UI frontend | GPT-5.4 | La comunidad reporta que su código de UI es más elegante y funcionalmente más completo |

| Agente de automatización backend | GPT-5.4 | Computer Use nativo + Tool Search |

Retroalimentación de la comunidad de desarrolladores: GPT-5.4 vs GPT-5.3 Codex

Opiniones reales de uso de la comunidad de desarrolladores:

- Equipo de Cursor (Lee Robinson): "GPT-5.4 lidera actualmente en nuestros puntos de referencia internos. Los ingenieros sienten que es más natural, más decisivo, y no duda ante problemas ambiguos".

- Consenso de desarrolladores en Reddit: GPT-5.3 Codex es más fuerte en iteración rápida y ciclos de implementación; para el diseño de sistemas complejos y planificación de arquitectura, la tendencia es elegir otros modelos.

- Escenario de desarrollo frontend: GPT-5.4 es considerado "claramente mejor en tareas de codificación frontend complejas, generando resultados más estéticos y funcionalmente más completos".

GPT-5.4 vs GPT-5.3 Codex: Inicio Rápido en Programación

Ejemplo Mínimo: Cambiar Modelos en Codex CLI

# Método 1: Cambio por línea de comandos de Codex CLI

# Usar GPT-5.4 (recomendado por defecto)

codex --model gpt-5.4 "Refactoriza esta función a una versión asíncrona"

# Usar GPT-5.3 Codex (tareas de programación puras)

codex --model gpt-5.3-codex "Arregla todos los fallos en las pruebas unitarias"

# Método 2: Comparación de llamadas API

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4: Ideal para flujos de trabajo mixtos

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "Analiza este código y genera pruebas unitarias"}]

)

# GPT-5.3 Codex: Ideal para tareas de programación puras

response = client.chat.completions.create(

model="gpt-5.3-codex",

messages=[{"role": "user", "content": "Implementa una caché LRU de alto rendimiento"}]

)

Recomendación: Usa la interfaz unificada de APIYI (apiyi.com) para invocar ambos modelos. No necesitas cambiar la clave API ni la Base URL, lo que facilita comparar resultados en proyectos reales y elegir según la necesidad.

Preguntas Frecuentes

P1: ¿Reemplazará GPT-5.4 completamente a GPT-5.3 Codex?

No lo reemplazará completamente. La documentación oficial de OpenAI aún los enumera a ambos como modelos Codex disponibles. GPT-5.4 reemplaza a GPT-5.3 Codex Spark como el "modelo predeterminado recomendado", pero GPT-5.3 Codex mantiene su ventaja en relación costo-rendimiento para escenarios de programación pura. Para tareas de codificación puras con presupuesto limitado, GPT-5.3 Codex sigue siendo la mejor opción.

P2: ¿Cómo cambio entre estos dos modelos en Codex CLI?

Es muy sencillo. En Codex CLI, usa el comando /model para cambiar en caliente: escribe /model gpt-5.4 o /model gpt-5.3-codex. También puedes configurar el modelo predeterminado en ~/.codex/config.toml, o especificarlo al iniciar con el parámetro --model. La clave API de APIYI (apiyi.com) también es compatible.

P3: ¿Cómo puedo probar rápidamente la comparación de rendimiento en programación de ambos modelos?

Pasos recomendados:

- Visita APIYI (apiyi.com) para registrarte y obtener una clave API unificada.

- Prepara una tarea de programación típica (como "implementar una caché LRU" o "refactorizar una función asíncrona").

- Realiza las llamadas usando

model="gpt-5.4"ymodel="gpt-5.3-codex"respectivamente. - Compara la calidad del código generado, la velocidad y el consumo de tokens.

Resumen

Conclusiones clave sobre las capacidades de programación de GPT-5.4 vs GPT-5.3 Codex:

- GPT-5.4 es más completo: Gana 4 de 6 benchmarks (SWE-Bench Pro, Toolathlon, BrowseComp, OSWorld) y es la opción predeterminada recomendada por OpenAI.

- GPT-5.3 Codex es más especializado en programación pura: Lidera en Terminal-Bench con un 77.3%, superando por 2.2 puntos porcentuales, siendo aún el mejor en generación de código puro y programación de terminal.

- Brecha de precio significativa: GPT-5.3 Codex es un 30% más barato en entrada ($1.75 vs $2.50), ofreciendo una gran ventaja en escenarios sensibles al presupuesto.

- Capacidades exclusivas de GPT-5.4: Uso Nativo de Computadora y Búsqueda de Herramientas (-47% de Tokens) son funcionalidades que GPT-5.3 Codex no posee.

En pocas palabras: La mayoría de los desarrolladores deberían usar GPT-5.4; para escribir código puro y cuidar el costo, usa GPT-5.3 Codex. Ambos modelos ya están disponibles en APIYI apiyi.com, con una interfaz unificada para cambiar según necesidad, listos para usar al registrarse.

📚 Referencias

-

Anuncio de lanzamiento de OpenAI GPT-5.4: Capacidades principales y datos de pruebas comparativas de GPT-5.4

- Enlace:

openai.com/index/introducing-gpt-5-4/ - Descripción: Blog oficial de lanzamiento, incluye comparativas en benchmarks como SWE-Bench Pro y Terminal-Bench.

- Enlace:

-

Anuncio de lanzamiento de OpenAI GPT-5.3 Codex: Filosofía de diseño del modelo de programación por agente

- Enlace:

openai.com/index/introducing-gpt-5-3-codex/ - Descripción: Explicación del posicionamiento, capacidades y casos de uso de GPT-5.3 Codex.

- Enlace:

-

Documentación de modelos OpenAI Codex: Guía oficial para elegir modelo

- Enlace:

developers.openai.com/codex/models/ - Descripción: Incluye recomendaciones oficiales de uso para GPT-5.4 y GPT-5.3 Codex.

- Enlace:

-

Página de precios de la API de OpenAI: Información de precios más reciente de los modelos

- Enlace:

openai.com/api/pricing/ - Descripción: Comparativa de precios oficiales entre GPT-5.4 y GPT-5.3 Codex.

- Enlace:

Autor: Equipo Técnico de APIYI

Intercambio técnico: Bienvenidos a discutir sus experiencias de uso con GPT-5.4 y GPT-5.3 Codex en los comentarios. Para más recursos, visiten el centro de documentación de APIYI en docs.apiyi.com.