Autorhinweis: Tiefgehender Vergleich der Programmierfähigkeiten von GPT-5.4 und GPT-5.3 Codex, mit Daten aus 6 Benchmark-Tests wie SWE-Bench und Terminal-Bench, um Ihnen bei der Wahl des besten Programmiermodells zu helfen.

GPT-5.4 ist gerade erschienen, und die erste Frage vieler Entwickler lautet: Brauche ich GPT-5.3 Codex überhaupt noch? Schließlich wird GPT-5.4 als "erstes einheitliches Modell, das Programmieren, logisches Denken und Computersteuerung vereint" angepriesen, während GPT-5.3 Codex OpenAIs Flaggschiff für die Programmierung ist.

Kernaussage: Dieser Artikel hilft Ihnen mit harten Daten aus 6 Benchmark-Tests und einem umfassenden Vergleich von Preis, Kontextlänge und Anwendungsfällen, die klarste Entscheidung zu treffen.

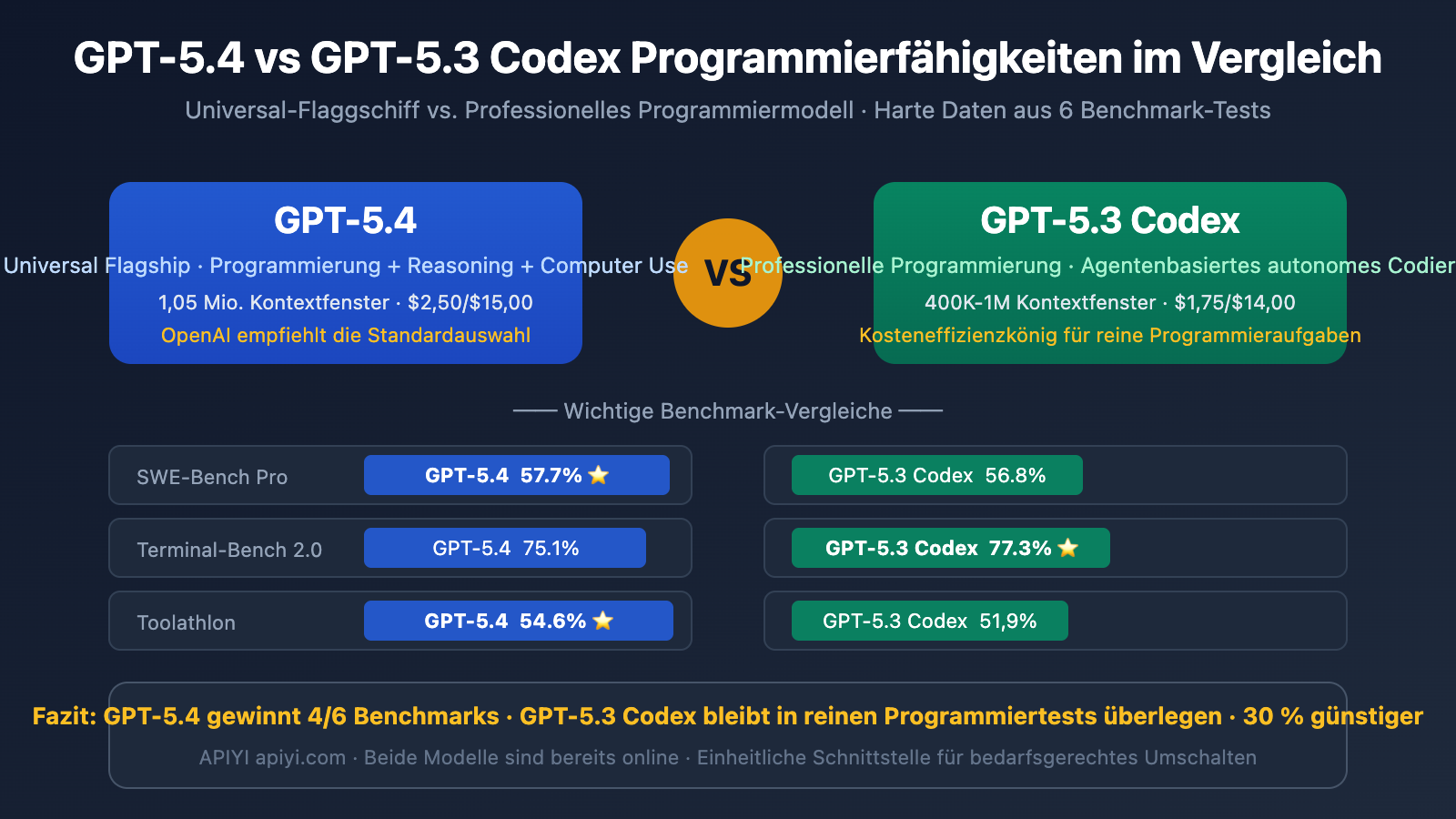

GPT-5.4 vs GPT-5.3 Codex: Kernpunkte der Programmierfähigkeiten

| Vergleichsdimension | GPT-5.4 | GPT-5.3 Codex | Gewinner |

|---|---|---|---|

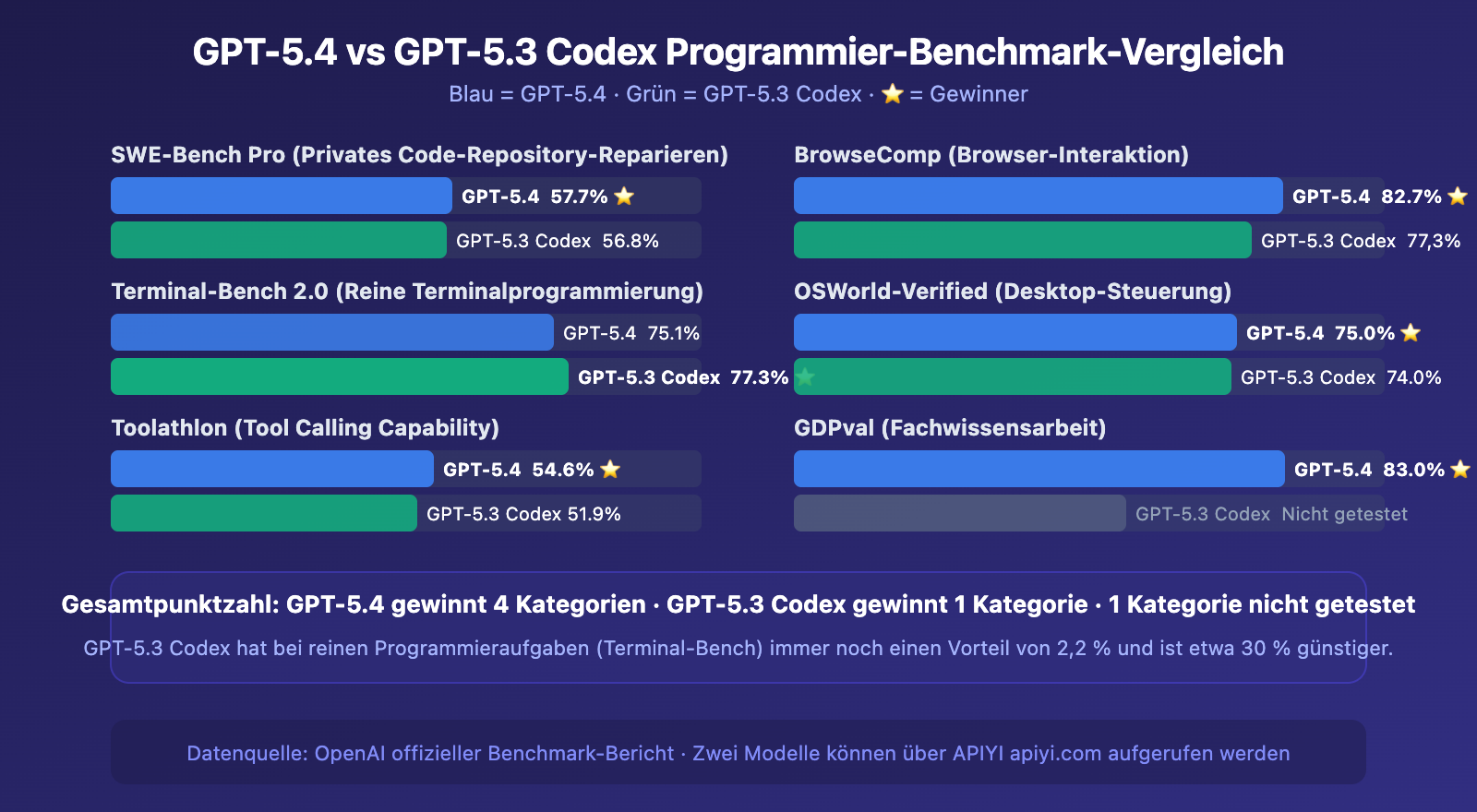

| SWE-Bench Pro | 57,7 % | 56,8 % | GPT-5.4 |

| Terminal-Bench 2.0 | 75,1 % | 77,3 % | GPT-5.3 Codex |

| Toolathlon | 54,6 % | 51,9 % | GPT-5.4 |

| BrowseComp | 82,7 % | 77,3 % | GPT-5.4 |

| OSWorld | 75,0 % | 74,0 % | GPT-5.4 |

| Eingabepreis | 2,50 $/M | 1,75 $/M | GPT-5.3 Codex |

GPT-5.4 vs GPT-5.3 Codex: Das Fazit in einem Satz

GPT-5.4 führt in den kombinierten Benchmarks, aber GPT-5.3 Codex ist bei reinen Programmieraufgaben immer noch stärker und günstiger. Die Wahl hängt von Ihrem Anwendungsfall ab – schreiben Sie nur Code oder mischen Sie Programmieren mit anderen Arbeitsabläufen?

OpenAI selbst empfiehlt klar: Für die meisten Aufgaben mit GPT-5.4 beginnen, für reine Programmier-Intensivaufgaben GPT-5.3 Codex verwenden.

SWE-Bench Pro: GPT-5.4 mit knappem Vorsprung

SWE-Bench Pro ist eine schwierigere, private Variante eines Code-Repositories, die speziell entwickelt wurde, um eine Kontamination der Benchmark-Daten zu verhindern. GPT-5.4 liegt mit 57,7 % zu 56,8 % knapp vor GPT-5.3 Codex, ein Vorsprung von etwa einem Prozentpunkt.

Diese Differenz ist nicht groß, aber wenn man bedenkt, dass GPT-5.4 ein generisches Modell und kein speziell für die Programmierung entwickeltes Modell ist, zeigt seine Überlegenheit gegenüber einem Programmierexpertenmodell auf SWE-Bench Pro bereits die integrierte Tiefe seiner Codierfähigkeiten.

Terminal-Bench 2.0: GPT-5.3 Codex deutlich vorne

Terminal-Bench 2.0 ist ein anspruchsvoller Test für reine Terminal-Programmierfähigkeiten. GPT-5.3 Codex liegt mit 77,3 % zu 75,1 % um 2,2 Prozentpunkte vorne – dies ist der Benchmark, bei dem GPT-5.3 Codex den deutlichsten Vorsprung erzielt.

Dieses Ergebnis ist sinnvoll: GPT-5.3 Codex ist speziell für "agentenbasiertes Programmieren" (Agentic Coding) optimiert und hat in vertikalen Szenarien wie reiner Codegenerierung, Code-Vervollständigung und Terminal-Operationen natürliche Vorteile.

Toolathlon und BrowseComp: GPT-5.4 führt umfassend

In Tests, die Werkzeugaufrufe (Toolathlon 54,6 % vs. 51,9 %) und Browser-Interaktionen (BrowseComp 82,7 % vs. 77,3 %) betreffen, setzt sich GPT-5.4 durchgängig durch. Dies spiegelt den Vorteil von GPT-5.4 in Bezug auf umfassende Agenten-Fähigkeiten "jenseits der Programmierung" wider – Werkzeuge aufrufen, Browser bedienen, anwendungsübergreifend zusammenarbeiten.

GPT-5.4 vs GPT-5.3 Codex: Vergleich von Preisen und Spezifikationen für die Programmierung

Preisunterschiede sind ein zentrales Anliegen vieler Entwickler. Hier ist der vollständige Spezifikationsvergleich der beiden Modelle:

| Spezifikationsdimension | GPT-5.4 | GPT-5.3 Codex | Unterschied |

|---|---|---|---|

| Eingabepreis | 2,50 $/M Tokens | 1,75 $/M Tokens | Codex ist 30 % günstiger |

| Ausgabepreis | 15,00 $/M Tokens | 14,00 $/M Tokens | Codex ist 7 % günstiger |

| Cache-Eingabe | 0,25 $/M Tokens | Nicht öffentlich | GPT-5.4 unterstützt dies |

| Kontextfenster | 1.050K Tokens | 400K-1M Tokens | GPT-5.4 ist größer |

| Maximale Ausgabe | 128K Tokens | Nicht klar öffentlich | — |

| Computer Use | ✅ Nativ unterstützt | ❌ Nicht unterstützt | Nur GPT-5.4 |

| Tool Search | ✅ Spart 47 % Token | ❌ Nicht unterstützt | Nur GPT-5.4 |

| Positionierung | Allgemeines Flaggschiff | Programmier-spezifisch | Unterschiedliche Schwerpunkte |

Praktische Kostenberechnung für die Programmierung: GPT-5.4 vs GPT-5.3 Codex

Obwohl GPT-5.3 Codex einen niedrigeren Stückpreis hat, gibt es bei GPT-5.4 zwei ausgleichende Faktoren:

- Weniger Reasoning-Tokens: OpenAI weist offiziell darauf hin, dass GPT-5.4 "die gleichen Probleme mit deutlich weniger Reasoning-Tokens löst". Die tatsächlichen Kosten könnten ähnlich oder sogar niedriger sein.

- Tool Search spart 47 %: Für Agenten-Workflows, die häufig Tools aufrufen, ist der Token-Verbrauch von GPT-5.4 deutlich reduziert.

Fazit: Wenn Ihre Aufgabe hauptsächlich reine Codegenerierung und Code-Vervollständigung ist, ist GPT-5.3 Codex kostengünstiger. Wenn es sich um gemischte Workflows aus Programmierung + Tool-Aufrufen + Browser-Operationen handelt, könnten die tatsächlichen Kosten von GPT-5.4 besser sein.

Preisreferenz: Beide Modelle können über APIYI (apiyi.com) aufgerufen werden. Die Preise entsprechen den offiziellen Angaben. Sofort nach der Registrierung nutzbar, ab einem Aufladebetrag von 100 USD gibt es 10 %+ Guthaben dazu.

GPT-5.4 vs GPT-5.3 Codex: Unterschiede in der Designphilosophie für die Programmierung

Um die richtige Wahl zu treffen, muss man die ursprüngliche Ausrichtung der beiden Modelle verstehen.

GPT-5.3 Codex: Geboren für "agentenbasiertes Programmieren"

Bei der Veröffentlichung im Februar 2026 war die Positionierung von OpenAI für GPT-5.3 Codex sehr klar – es ist ein Programmierpartner auf dem Niveau eines "hochproduktiven Praktikanten". Kernmerkmale:

- Autonome Erledigung von Engineering-Aufgaben: Benötigt keine schrittweise menschliche Anleitung. Geben Sie ihm eine Aufgabe und er führt sie selbstständig aus.

- Selbstkorrektur-Schleife: Code schreiben → Tests ausführen → Fehler finden → beheben → erneut testen. Dieser gesamte Zyklus läuft automatisch ab.

- Unterbrechbar und umlenkbar: Sie können es jederzeit unterbrechen und die Richtung anpassen, ohne den Kontext zu verlieren.

- 25 % schneller als GPT-5.2 Codex: Geschwindigkeitsoptimierung ist einer der Kernverkaufspunkte.

GPT-5.4: Einheitliches Ganzes aus Programmierung, Reasoning und Steuerung

GPT-5.4 ist kein einfaches Upgrade eines Programmiermodells, sondern OpenAIs Versuch einer "großen Vereinheitlichung" – die Fähigkeiten zur Programmierung, zum tiefen Reasoning, zur Computersteuerung und das Fachwissen werden alle in ein einziges Modell gepackt. Kernmerkmale:

- Integriert Codex-Programmierfähigkeiten: OpenAI sagt ausdrücklich, dass GPT-5.4 "die fortschrittlichen Codierungsfähigkeiten von GPT-5.3 Codex integriert".

- Natives Computer Use: Kann direkt Computeroberflächen steuern, anstatt nur Code zu generieren.

- Fachwissensarbeit: GDPval 83,0 %, Genauigkeit bei Investmentbanking-Aufgaben 87,3 %.

- Vereinfachte Modellauswahl: OpenAI möchte mit GPT-5.4 mehrere spezialisierte Modelle ersetzen, um die Auswahl zu erleichtern.

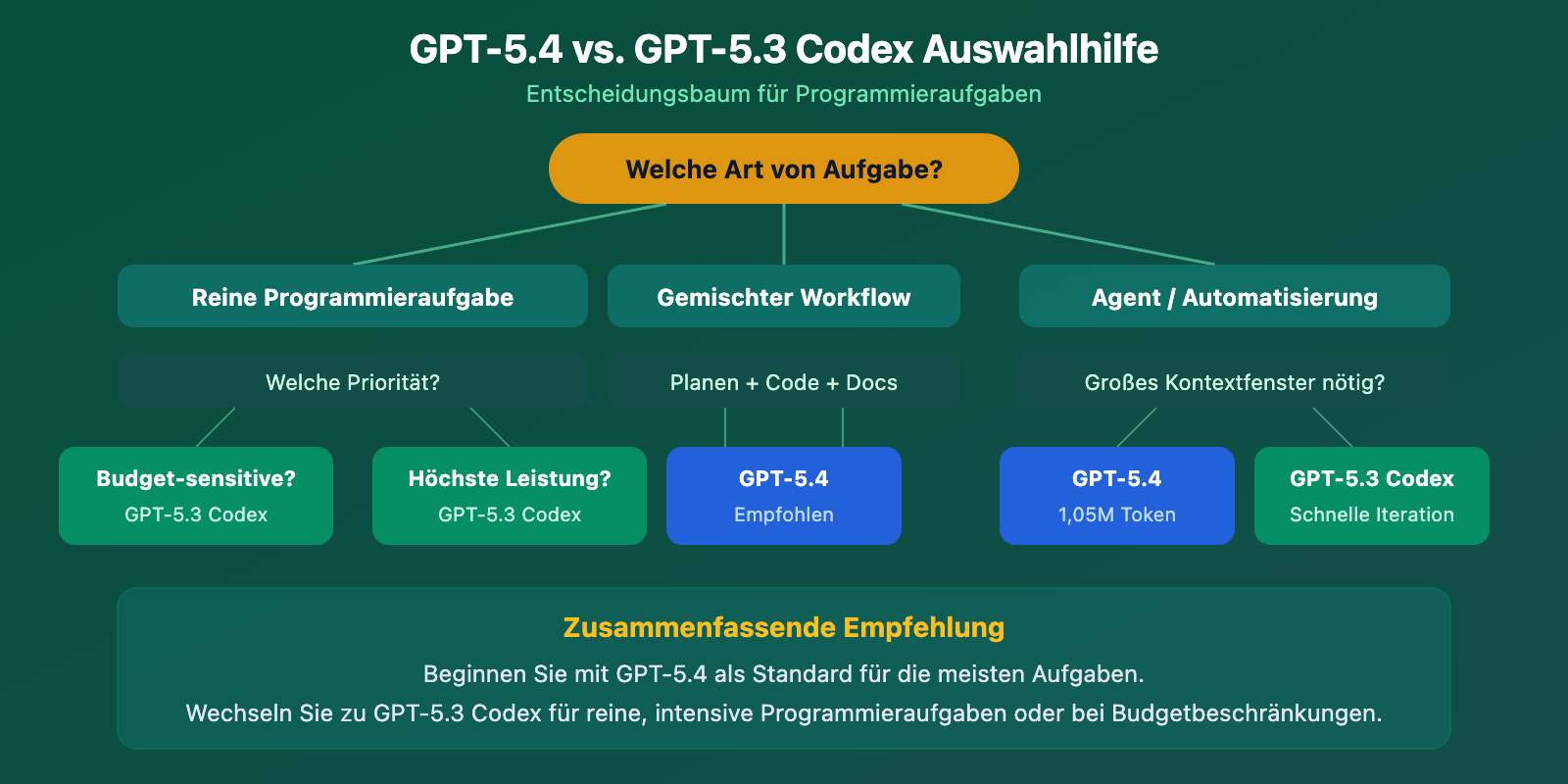

GPT-5.4 vs. GPT-5.3 Codex – Leitfaden zur Modellauswahl für Programmieraufgaben

Die offizielle OpenAI-Dokumentation gibt klare Empfehlungen zur Modellauswahl:

| Anwendungsfall | Empfohlenes Modell | Begründung |

|---|---|---|

| Die meisten Codex-Aufgaben (Standard) | GPT-5.4 | Stärkste Gesamtleistung, von OpenAI als Standard empfohlen |

| Gemischte Workflows (Programmieren + Planen + Schreiben) | GPT-5.4 | Überragende Fähigkeiten über Domänengrenzen hinweg |

| Reine, programmierintensive Aufgaben | GPT-5.3 Codex | Terminal-Bench 77.3% höher, speziell für Code optimiert |

| Echtzeit-Pair-Programming | GPT-5.3 Codex Spark | Extrem schnelle Antworten (1000+ tokens/s, exklusiv für Pro) |

| Budget-sensitive Programmieraufgaben | GPT-5.3 Codex | Eingabepreis ist 30% günstiger |

| Analyse großer Codebasen | GPT-5.4 | Größtes Kontextfenster (1,05 Mio. Token) |

| Frontend-UI-Entwicklung | GPT-5.4 | Community-Feedback: UI-Code ist ästhetischer und funktional vollständiger |

| Backend-Automatisierung / Agenten | GPT-5.4 | Native Computer Use + Tool Search |

Feedback aus der Entwickler-Community zu GPT-5.4 vs. GPT-5.3 Codex

Praktische Erfahrungsberichte von Entwicklern:

- Cursor-Team (Lee Robinson): "GPT-5.4 führt derzeit in unseren internen Benchmarks. Ingenieure finden es natürlicher und entschlossener, es zögert nicht bei unklaren Fragen."

- Konsens unter Reddit-Entwicklern: GPT-5.3 Codex ist stärker bei schnellen Iterationen und Implementierungsschleifen; für komplexes Systemdesign und Architekturplanung tendiert man zu anderen Modellen.

- Frontend-Entwicklung: GPT-5.4 wird als "deutlich besser bei komplexen Frontend-Coding-Aufgaben" angesehen, die Ergebnisse seien "ansprechender und funktional vollständiger".

GPT-5.4 vs. GPT-5.3 Codex – Schnelleinstieg

Minimalbeispiel: Modellwechsel in der Codex CLI

# Methode 1: Wechsel über die Codex CLI-Kommandozeile

# GPT-5.4 verwenden (empfohlener Standard)

codex --model gpt-5.4 "Refaktorisiere diese Funktion zu einer asynchronen Version"

# GPT-5.3 Codex verwenden (für reine Programmieraufgaben)

codex --model gpt-5.3-codex "Behebe alle fehlgeschlagenen Unit-Tests"

# Methode 2: Vergleich über API-Aufrufe

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4: Geeignet für gemischte Workflows

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "Analysiere diesen Code und generiere Unit-Tests"}]

)

# GPT-5.3 Codex: Geeignet für reine Programmieraufgaben

response = client.chat.completions.create(

model="gpt-5.3-codex",

messages=[{"role": "user", "content": "Implementiere einen hochperformanten LRU-Cache"}]

)

Empfehlung: Nutzen Sie APIYI (apiyi.com) für einen einheitlichen API-Zugriff auf beide Modelle. So müssen Sie weder API-Schlüssel noch Base-URL wechseln und können die Modelle in Ihren Projekten leicht vergleichen und je nach Bedarf auswählen.

Häufig gestellte Fragen

Q1: Wird GPT-5.4 GPT-5.3 Codex vollständig ersetzen?

Nein, es wird nicht vollständig ersetzt. Die offizielle OpenAI-Dokumentation führt beide weiterhin als verfügbare Codex-Modelle auf. GPT-5.4 ersetzt GPT-5.3 Codex Spark als "empfohlenes Standardmodell", aber GPT-5.3 Codex bleibt aufgrund seines Preis-Leistungs-Verhältnisses in reinen Programmier-Szenarien erhalten. Für rein kodierungsbezogene Aufgaben mit begrenztem Budget ist GPT-5.3 Codex nach wie vor die bessere Wahl.

Q2: Wie wechsle ich zwischen diesen beiden Modellen in der Codex CLI?

Ganz einfach. Verwenden Sie in der Codex CLI den Befehl /model für einen Hot-Switch: Geben Sie /model gpt-5.4 oder /model gpt-5.3-codex ein. Sie können das Standardmodell auch in ~/.codex/config.toml festlegen oder beim Start mit dem Parameter --model angeben. Dies funktioniert auch mit dem API-Schlüssel von APIYI apiyi.com.

Q3: Wie kann ich die Programmierleistung der beiden Modelle schnell vergleichen?

Empfohlene Schritte:

- Besuchen Sie APIYI apiyi.com, registrieren Sie ein Konto und holen Sie sich einen einheitlichen API-Schlüssel.

- Bereiten Sie eine typische Programmieraufgabe vor (z. B. "Implementiere einen LRU Cache" oder "Refaktorisiere eine asynchrone Funktion").

- Rufen Sie die Modelle jeweils mit

model="gpt-5.4"undmodel="gpt-5.3-codex"auf. - Vergleichen Sie die Qualität, Geschwindigkeit und den Token-Verbrauch des generierten Codes.

Zusammenfassung

Die Kernaussagen zum Vergleich der Programmierfähigkeiten von GPT-5.4 und GPT-5.3 Codex:

- GPT-5.4 ist insgesamt stärker: Es gewinnt 4 von 6 Benchmarks (SWE-Bench Pro, Toolathlon, BrowseComp, OSWorld) und ist die von OpenAI empfohlene Standardwahl.

- GPT-5.3 Codex ist spezialisierter für reines Programmieren: Mit 77,3 % auf Terminal-Bench liegt es 2,2 Prozentpunkte vorne und bleibt bei reiner Codegenerierung und Terminal-Programmierung optimal.

- Deutlicher Preisunterschied: GPT-5.3 Codex ist 30 % günstiger für die Eingabe ($1,75 vs. $2,50) und hat einen großen Vorteil in budgetkritischen Szenarien.

- Einzigartige Fähigkeiten von GPT-5.4: Native Computer Use und Tool Search (-47 % Token) sind Fähigkeiten, die GPT-5.3 Codex nicht besitzt.

Einfach gesagt: Die meisten Entwickler sollten GPT-5.4 verwenden, für reines Code-Schreiben bei Kostenbewusstsein ist GPT-5.3 Codex die Wahl. Beide Modelle sind bereits auf APIYI apiyi.com verfügbar, mit einheitlicher Schnittstelle für bedarfsgerechten Wechsel – registrieren und sofort loslegen.

📚 Referenzen

-

OpenAI GPT-5.4 Veröffentlichungsankündigung: Kernfähigkeiten und Benchmark-Daten von GPT-5.4

- Link:

openai.com/index/introducing-gpt-5-4/ - Beschreibung: Offizieller Blogpost mit Benchmark-Vergleichen wie SWE-Bench Pro, Terminal-Bench

- Link:

-

OpenAI GPT-5.3 Codex Veröffentlichungsankündigung: Designphilosophie des agentenbasierten Programmiermodells

- Link:

openai.com/index/introducing-gpt-5-3-codex/ - Beschreibung: Erläuterung zu Positionierung, Fähigkeiten und Anwendungsfällen von GPT-5.3 Codex

- Link:

-

OpenAI Codex Modelldokumentation: Offizieller Leitfaden zur Modellauswahl

- Link:

developers.openai.com/codex/models/ - Beschreibung: Enthält offizielle Nutzungsempfehlungen für GPT-5.4 und GPT-5.3 Codex

- Link:

-

OpenAI API Preisgestaltungsseite: Aktuelle Modellpreisinformationen

- Link:

openai.com/api/pricing/ - Beschreibung: Offizieller Preisvergleich zwischen GPT-5.4 und GPT-5.3 Codex

- Link:

Autor: APIYI Technikteam

Technischer Austausch: Diskutieren Sie gerne Ihre Erfahrungen mit GPT-5.4 und GPT-5.3 Codex in den Kommentaren. Weitere Ressourcen finden Sie im APIYI Docs Center unter docs.apiyi.com.