Das im April 2026 von OpenAI veröffentlichte gpt-image-2 hat sich zum gefragtesten Modell im Bereich der Bilderzeugung entwickelt – mit 99 % Genauigkeit bei der zeichengenauen Textdarstellung, 4K-HD-Ausgabe, nativer Unterstützung für Chinesisch/CJK und der Integration der O-Serie-Schlussfolgerungsfähigkeiten. Doch die erste Frage vieler Entwickler nach Erhalt des Modells lautet: Wie binde ich gpt-image-2 über die offizielle API an? Welche Parameter sind erforderlich? Wie konfiguriere ich die base_url? Und wie verwende ich das b64_json in der Antwort?

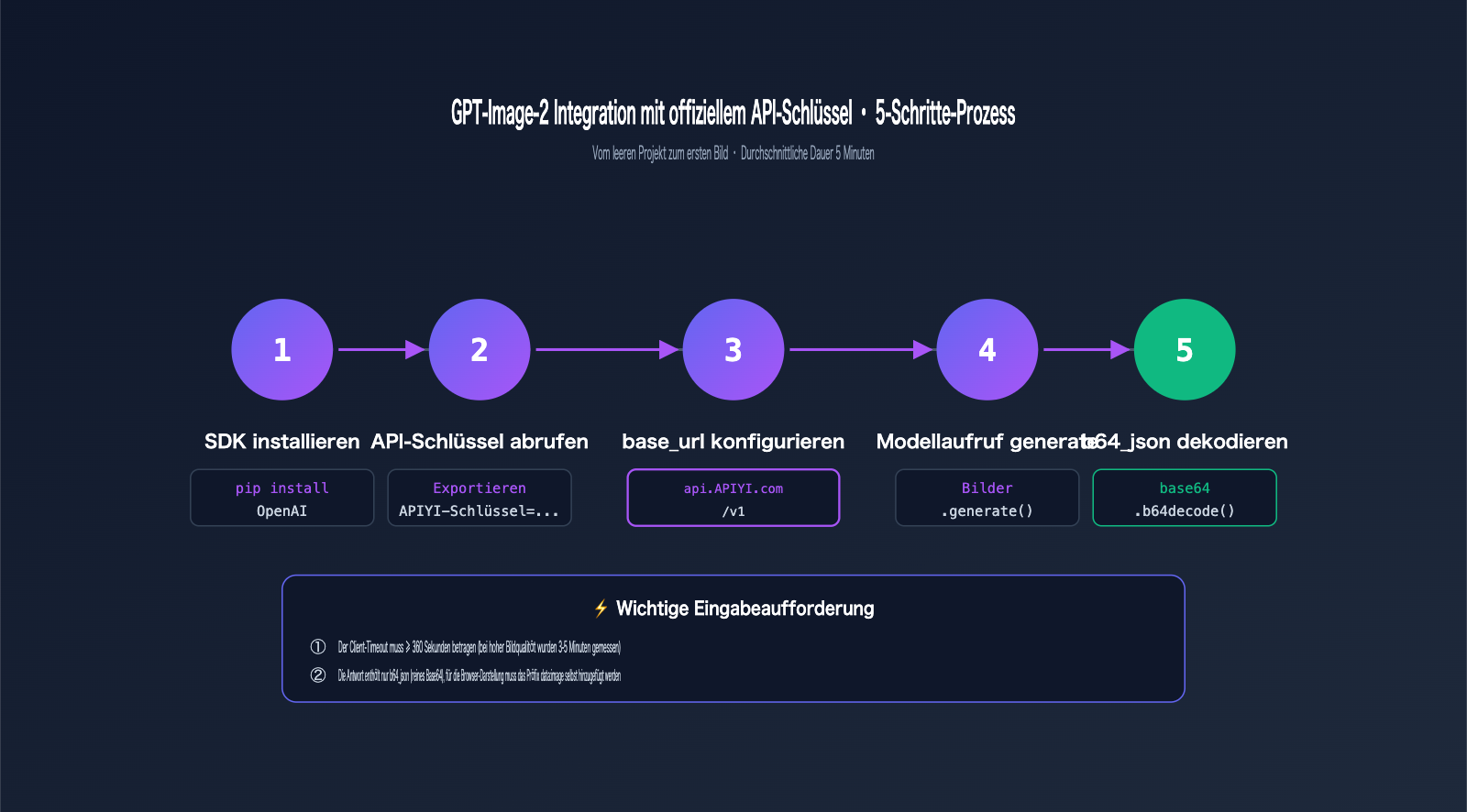

Dieser Artikel ist ein End-to-End-Praxisleitfaden für die Anbindung von gpt-image-2 an die offizielle API. Er deckt alle technischen Details ab, von der SDK-Installation und der Konfiguration der base_url bis hin zu Text-zu-Bild, Bildbearbeitung, Inpainting und Fehlerbehandlung. Der gesamte Code basiert auf dem offiziellen OpenAI-SDK und dem API-Proxy-Dienst von APIYI (100 % kompatibel mit offiziellen Feldern). Nach dem Durcharbeiten dieses Artikels wird Ihr Projekt bereit sein, gpt-image-2 in der Produktionsumgebung einzusetzen.

<rect x="0" y="60" width="360" height="50" rx="8" fill="url(#coverAccent2)" opacity="0.15" stroke="#6366f1" stroke-width="1.5"/>

<text x="20" y="82" fill="#a855f7" font-size="11" font-weight="700" font-family="Menlo, monospace">POST</text>

<text x="180" y="92" text-anchor="middle" fill="#ffffff" font-size="13" font-family="Menlo, monospace">/v1/images/edits</text>

<text x="340" y="102" text-anchor="end" fill="#94a3b8" font-size="10" font-family="'Hiragino Sans GB', 'STHeiti', sans-serif">Bearbeiten / Inpainting</text>

Checkliste für die Vorbereitung der gpt-image-2 API-Anbindung

Bevor Sie die erste Zeile Code schreiben, müssen Sie die Umgebung vorbereiten. Die folgende Liste deckt die vier Voraussetzungen ab, die für die Anbindung von gpt-image-2 an die offizielle API erforderlich sind.

Umgebungs-Checkliste für die gpt-image-2 API-Anbindung

| Vorbereitung | Anforderung | Hinweis |

|---|---|---|

| API-Schlüssel | Gültiges Bearer Token | Über das APIYI-Dashboard beantragen; nach der Registrierung erhalten Sie Testguthaben |

| Python SDK | openai >= 1.50.0 |

Ältere Versionen unterstützen die neuen Parameter von images.generate() nicht |

| Node.js SDK | openai >= 4.50.0 |

TypeScript-Typen sind mit der offiziellen Version synchronisiert |

| HTTP-Timeout | ≥ 360 Sekunden | High-Qualität + 2K/4K dauert in der Praxis 3-5 Minuten |

| Netzwerkanforderungen | Direktzugriff möglich | api.apiyi.com ist von überall aus erreichbar |

SDK-Installation für die gpt-image-2 API-Anbindung

Unabhängig von der gewählten Sprache installieren Sie einfach das offizielle OpenAI-SDK – der APIYI-Proxy-Dienst ist zu 100 % mit den offiziellen Feldern kompatibel, es sind keine zusätzlichen Client-Bibliotheken erforderlich.

# Python

pip install --upgrade openai

# Node.js

npm install openai@latest

# Falls Sie yarn / pnpm verwenden

yarn add openai

pnpm add openai

Prozess zum Erhalt des API-Schlüssels für gpt-image-2

Die Schritte zum Erhalt des API-Schlüssels sind denkbar einfach:

- Besuchen Sie das APIYI-Dashboard unter

api.apiyi.com - Melden Sie sich an und navigieren Sie zur Seite „API-Token“

- Erstellen Sie ein neues Token (es wird empfohlen, für verschiedene Projekte separate Token zur besseren Nachvollziehbarkeit zu verwenden)

- Speichern Sie das Token in einer Umgebungsvariablen (es wird dringend davon abgeraten, es fest im Code zu hinterlegen)

🚀 Empfehlung für den schnellen Einstieg: Bei der ersten Anbindung der gpt-image-2 API empfiehlt es sich, zunächst mit niedriger Qualität und 1024×1024 zu testen, bevor Sie auf High-Qualität und große Formate umstellen. Wir empfehlen, Testguthaben über die Plattform APIYI (apiyi.com) zu beziehen; das kostenlose Guthaben reicht aus, um den gesamten PoC-Prozess zu validieren.

# Fügen Sie dies in Ihre ~/.zshrc oder ~/.bashrc ein

export APIYI_KEY="sk-your-token-here"

Konfiguration der base_url für die Anbindung von gpt-image-2 an die offizielle API

Der einzige Unterschied bei der Anbindung von gpt-image-2 an die offizielle API im Vergleich zum nativen OpenAI SDK ist die base_url. Ersetzen Sie diese einfach durch api.apiyi.com, der restliche Code bleibt identisch.

Die zwei Endpunkte für die Anbindung von gpt-image-2 an die offizielle API

APIYI bietet zwei Endpunkte für die Bilderzeugung, die vollständig mit OpenAI kompatibel sind:

| Endpunkt | Verwendung | Erforderliche Parameter |

|---|---|---|

POST /v1/images/generations |

Text-zu-Bild (Generierung nur per Eingabeaufforderung) | model, prompt |

POST /v1/images/edits |

Bildbearbeitung, Bildfusion, Masken-Inpainting | model, prompt, image |

Client-Initialisierung für gpt-image-2

Hier finden Sie den Code zur Client-Initialisierung für Python und Node.js. Achten Sie darauf, das Timeout auf mindestens 360 Sekunden einzustellen.

# Python

import os

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1", # Wechsel zum APIYI-Proxy-Dienst

timeout=600.0, # Bei hoher Bildqualität zwingend erforderlich

max_retries=2

)

// Node.js

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1", # Beachten Sie die Schreibweise (CamelCase)

timeout: 600 * 1000, # In Millisekunden

maxRetries: 2

});

💡 Hinweis zum Timeout: Das Standard-Timeout von 60 Sekunden führt bei hoher Bildqualität (High Quality) in 2K/4K-Szenarien zwangsläufig zu Fehlern. Wir empfehlen, bei der Anbindung über APIYI (apiyi.com) das Request-Timeout in allen Produktionsumgebungen auf 360 bis 600 Sekunden zu setzen, um zu verhindern, dass langwierige Anfragen vorzeitig abgebrochen werden.

Hier ist die Übersetzung des technischen Leitfadens für die Integration von gpt-image-2.

gpt-image-2: Bilderzeugung über die offizielle API

Kommen wir zur Praxis. Im Folgenden zeigen wir Ihnen anhand von drei Programmiersprachen, wie Sie Ihren ersten Aufruf zur Bilderzeugung mit der offiziellen gpt-image-2 API durchführen.

gpt-image-2: Bilderzeugung mit Python

import base64

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1",

timeout=600.0

)

response = client.images.generate(

model="gpt-image-2",

prompt="A modern minimalist office desk with a vintage typewriter, soft morning light from the window, photorealistic, 8K",

size="1536x1024",

quality="high",

output_format="jpeg",

output_compression=92,

n=1

)

# Wichtig: APIYI gibt einen reinen base64-String ohne data:image/... Präfix zurück

b64 = response.data[0].b64_json

with open("output.jpg", "wb") as f:

f.write(base64.b64decode(b64))

print("✓ Bild wurde unter output.jpg gespeichert")

gpt-image-2: Bilderzeugung mit Node.js

import fs from "node:fs/promises";

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

timeout: 600_000

});

const response = await client.images.generate({

model: "gpt-image-2",

prompt: "An e-commerce product photo of a leather backpack on a marble desk, studio lighting",

size: "1024x1024",

quality: "high",

output_format: "png",

n: 1

});

const b64 = response.data[0].b64_json;

await fs.writeFile("output.png", Buffer.from(b64, "base64"));

console.log("✓ Bild wurde gespeichert");

gpt-image-2: Bilderzeugung mit cURL

cURL eignet sich hervorragend zur schnellen Überprüfung der API-Schlüssel-Gültigkeit und zum Testen neuer Parameterkombinationen.

curl https://api.apiyi.com/v1/images/generations \

-H "Authorization: Bearer $APIYI_KEY" \

-H "Content-Type: application/json" \

--max-time 600 \

-d '{

"model": "gpt-image-2",

"prompt": "A futuristic cyberpunk city at night, neon signs in mixed Chinese and English",

"size": "2048x1152",

"quality": "high",

"output_format": "jpeg",

"output_compression": 90,

"n": 1

}' | jq -r '.data[0].b64_json' | base64 -d > output.jpg

Hinweis: --max-time 600 ist zwingend erforderlich – cURL hat standardmäßig kein Timeout, aber viele Shell-Wrapper erzwingen einen Abbruch nach 60 Sekunden.

Wichtige Punkte zur Antwortverarbeitung

Viele Entwickler stolpern bei der ersten Integration über die base64-Dekodierung. Hier sind die häufigsten Fehlerquellen:

# ✗ Fehler: APIYI gibt kein url-Feld zurück

url = response.data[0].url # AttributeError

# ✓ Korrekt: b64_json verwenden

b64 = response.data[0].b64_json

# ✗ Fehler: Browser rendert den reinen b64-String nicht direkt

<img src="{b64}"> # Wird nicht angezeigt

# ✓ Korrekt: Präfix für die Browser-Darstellung manuell hinzufügen

data_uri = f"data:image/jpeg;base64,{b64}"

# <img src="{{ data_uri }}">

# ✓ Korrekt: Speichern auf dem Server

with open("output.jpg", "wb") as f:

f.write(base64.b64decode(b64))

Vollständige Parameterübersicht für gpt-image-2

Die Beherrschung der Wertebereiche und Einsatzszenarien ist entscheidend für den produktiven Einsatz von gpt-image-2.

Kernparameter-Tabelle für gpt-image-2

| Parameter | Wert | Standardwert | Beschreibung |

|---|---|---|---|

model |

"gpt-image-2" |

Erforderlich | Modell-ID |

prompt |

String | Erforderlich | Eingabeaufforderung, unterstützt gemischt Deutsch/Englisch |

size |

8 Voreinstellungen + Benutzerdefiniert | auto |

Siehe Tabelle unten |

quality |

auto / low / medium / high |

auto |

Beeinflusst Kosten und Dauer |

output_format |

png / jpeg / webp |

png |

Empfehlung: jpeg + 90 Kompression |

output_compression |

1-100 | 100 | Nur für jpeg/webp wirksam |

moderation |

auto / low |

auto |

low reduziert die Empfindlichkeit der Prüfung |

n |

1-10 | 1 | Anzahl der Bilder pro Aufruf |

Vollständige Optionen für den size-Parameter

# 8 offizielle Voreinstellungen

size = "1024x1024" # 1:1 Standard-Quadrat

size = "1536x1024" # 3:2 Querformat

size = "1024x1536" # 2:3 Hochformat

size = "2048x2048" # 2K Quadrat

size = "2048x1152" # 16:9 Querformat (ideal für Desktop-Hintergründe/Poster)

size = "3840x2160" # 4K Querformat

size = "2160x3840" # 4K Hochformat (ideal für Handy-Hintergründe)

size = "auto" # Automatische Wahl durch das Modell

Für benutzerdefinierte Größen müssen folgende Bedingungen erfüllt sein:

✓ Seitenlängen müssen ein Vielfaches von 16 sein

✓ Maximale Seitenlänge ≤ 3840px

✓ Seitenverhältnis ≤ 3:1

✓ Gesamtpixel zwischen 655.360 und 8.294.400

Beispiel: 1280x720 (720P) ist zulässig, 3840x1080 (Ultra-Wide) wird aufgrund eines Verhältnisses > 3:1 abgelehnt.

Qualitätsstufen und Kostenvergleich

quality ist der Parameter mit dem größten Einfluss auf die Kosten. Hier ist die vollständige Preisübersicht (pro Bild):

| Qualität | 1024×1024 | 1024×1536 | 1536×1024 | Einsatzszenario |

|---|---|---|---|---|

low |

$0.006 | $0.005 | $0.005 | Skizzen, Thumbnails, schnelle Iterationen |

medium |

$0.053 | $0.041 | $0.041 | Content-Websites, Social-Media-Bilder |

high |

$0.211 | $0.165 | $0.165 | Produktbilder, Poster, Werbematerial |

💰 Kostenoptimierung: Content-Teams, die täglich 100 Bilder generieren, sparen mit der

medium-Qualität 75 % gegenüberhigh. Wir empfehlen, über die Plattform APIYI (apiyi.com) zunächst mitlowdie Eingabeaufforderung zu optimieren und erst nach der finalen Abnahme aufmedium/highfür das Endresultat zu wechseln. Dies kann das monatliche Budget um 30–50 % senken.

Wahl des output_format

Das Ausgabeformat beeinflusst direkt die Speicherkosten und die Ladegeschwindigkeit:

# Transparenter Hintergrund gewünscht? gpt-image-2 unterstützt dies nicht (400er Fehler)

# ✗ output_format="png", background="transparent" → 400 Bad Request

# Web/Mini-Programme: jpeg + Kompression 90

output_format="jpeg", output_compression=90

# Hochwertige Archivierung: png (verlustfrei)

output_format="png"

# Moderne Web-Apps: webp (geringste Dateigröße)

output_format="webp", output_compression=85

Bildbearbeitung und Inpainting mit der offiziellen API von gpt-image-2

Neben der reinen Bilderzeugung unterstützt gpt-image-2 drei weitere wichtige Bearbeitungsszenarien: Bildbearbeitung, Fusion mehrerer Bilder sowie lokales Neuzeichnen (Inpainting/Outpainting).

Bildbearbeitung mit gpt-image-2 über die offizielle API (Referenzbild-Modus)

Die Bearbeitung mit einem Referenzbild aktiviert automatisch den High-Fidelity-Modus – übergeben Sie daher keinen input_fidelity-Parameter (dieser wird abgelehnt).

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1"

)

# Bearbeitung mit einem einzelnen Referenzbild

with open("source.jpg", "rb") as img:

response = client.images.edit(

model="gpt-image-2",

image=img,

prompt="Ändere den Hintergrund in einen Strand bei Sonnenuntergang, behalte die Pose und Kleidung der Person im Vordergrund bei",

size="1024x1024",

quality="high"

)

Fusion mehrerer Bilder mit gpt-image-2 über die offizielle API (bis zu 16 Bilder)

Der Endpunkt /images/edits unterstützt die gleichzeitige Eingabe von bis zu 16 Referenzbildern. Im Prompt können diese als „Bild1/Bild2/Bild3“ referenziert werden.

images = [

open("character.jpg", "rb"), # Bild 1: Charakter

open("background.jpg", "rb"), # Bild 2: Hintergrund

open("outfit.jpg", "rb"), # Bild 3: Referenz für Kleidung

]

response = client.images.edit(

model="gpt-image-2",

image=images,

prompt="Platziere den Charakter aus Bild 1 vor den Hintergrund aus Bild 2 und kleide ihn im Stil von Bild 3 ein, behalte dabei den filmischen Look bei",

size="2048x1152",

quality="high"

)

Diese Funktion ist extrem leistungsstark für Szenarien wie den Austausch von Hintergründen bei E-Commerce-Produkten, virtuelle Anproben oder die Erstellung von Comic-Storyboards.

Inpainting (lokales Neuzeichnen) mit gpt-image-2 über die offizielle API

Beim Inpainting wird der zu bearbeitende Bereich über den mask-Parameter definiert. Wichtige Regeln:

- Die Maske muss dieselbe Größe wie das erste Referenzbild haben.

- Die Maske muss ein PNG mit Alpha-Kanal sein.

- Transparente Bereiche = Bereiche, die neu gezeichnet werden sollen.

- Undurchsichtige Bereiche = Bereiche, die beibehalten werden.

with open("photo.png", "rb") as img, open("mask.png", "rb") as msk:

response = client.images.edit(

model="gpt-image-2",

image=img,

mask=msk,

prompt="Ersetze den Bereich im roten Rahmen durch eine orangefarbene Katze",

size="1024x1024",

quality="high"

)

Wenn Sie die Maske programmgesteuert in Python erstellen müssen, können Sie PIL verwenden:

from PIL import Image

# Erstelle eine Maske in der gleichen Größe wie das Originalbild, standardmäßig komplett schwarz (undurchsichtig = beibehalten)

mask = Image.new("RGBA", (1024, 1024), (0, 0, 0, 255))

# Ändere den zu bearbeitenden Bereich in transparent (alpha=0)

for x in range(400, 700):

for y in range(300, 600):

mask.putpixel((x, y), (0, 0, 0, 0))

mask.save("mask.png")

Fehlerbehandlung und Produktionspraxis bei der Anbindung von gpt-image-2 an die offizielle API

Um gpt-image-2 erfolgreich in die Produktion zu überführen, müssen Sie drei kritische Aspekte beherrschen: Fehlercodes, Nebenläufigkeit (Concurrency) und Timeouts.

Vollständige Fehlercodetabelle für die Anbindung von gpt-image-2

| HTTP-Statuscode | Bedeutung | Empfohlene Maßnahme |

|---|---|---|

400 |

Ungültige Parameter (Größe außerhalb des Bereichs, nicht unterstützte Felder) | Eingabe validieren; input_fidelity oder background:transparent nicht senden |

401 |

Token ungültig | Bearer-Token prüfen, Ablaufdatum bestätigen |

403 |

Inhaltsfilterung (Moderation) | Prompt anpassen oder moderation: "low" hinzufügen |

429 |

Ratenbegrenzung / Guthaben erschöpft | Exponential Backoff (Wiederholung) + Guthaben prüfen |

5xx |

Gateway- oder Backend-Fehler | 1-2 Mal wiederholen, bei anhaltendem Fehler Alarm auslösen |

| Timeout | Request-Zeitüberschreitung | Client-Timeout auf ≥ 360 Sekunden setzen |

Exponential Backoff bei der Anbindung von gpt-image-2

Hier ist eine produktionsreife Implementierung für Wiederholungsversuche bei 429- und 5xx-Fehlern:

import time

import random

from openai import OpenAI, RateLimitError, APIStatusError

client = OpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1",

timeout=600.0

)

def generate_with_retry(prompt: str, max_retries: int = 5):

delay = 1.0

for attempt in range(max_retries):

try:

return client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="high"

)

except RateLimitError:

sleep = delay + random.uniform(0, 0.5)

print(f"429 Ratenbegrenzung, erneuter Versuch in {sleep:.1f}s ({attempt+1}/{max_retries})")

time.sleep(sleep)

delay *= 2

except APIStatusError as e:

if 500 <= e.status_code < 600 and attempt < max_retries - 1:

time.sleep(delay)

delay *= 2

continue

raise

raise RuntimeError("Maximale Anzahl an Wiederholungsversuchen überschritten")

Steuerung der Nebenläufigkeit bei gpt-image-2

Verwenden Sie bei Batch-Aufgaben asyncio.Semaphore, um die Anzahl der gleichzeitigen Anfragen zu begrenzen und eine Überlastung des Downstreams zu vermeiden:

import asyncio

from openai import AsyncOpenAI

aclient = AsyncOpenAI(

api_key=os.getenv("APIYI_KEY"),

base_url="https://api.apiyi.com/v1",

timeout=600.0

)

async def gen_one(prompt: str, sem: asyncio.Semaphore):

async with sem:

return await aclient.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="medium"

)

async def batch(prompts: list[str], concurrency: int = 30):

sem = asyncio.Semaphore(concurrency)

return await asyncio.gather(*[gen_one(p, sem) for p in prompts])

# 200 Bilder generieren, 30 Anfragen gleichzeitig

prompts = [f"Produktbild-Variante #{i}" for i in range(200)]

results = asyncio.run(batch(prompts))

Kostenschätzung für gpt-image-2

Führen Sie vor dem Produktivgang eine Kostenschätzung durch. Hier sind monatliche Schätzungen für typische Szenarien:

| Geschäftsszenario | Durchschnitt pro Tag | Bildqualität | Monatliche Kosten (geschätzt) |

|---|---|---|---|

| Social Media Content | 30 Bilder | medium | ~$48 |

| E-Commerce Produktbilder | 200 Bilder | high | ~$1266 |

| SaaS-Bilderzeugung | 1000 Anfragen | medium | ~$1590 |

| Game-Keyframes | 500 Bilder | high | ~$3165 |

🎯 Empfehlung für die Produktion: Wir empfehlen, für verschiedene Geschäftsbereiche separate API-Schlüssel zu beantragen, um Kosten besser zuordnen und Ratenbegrenzungen isolieren zu können. Nutzen Sie das APIYI-Dashboard (apiyi.com), um Rechnungsalarme zu aktivieren, damit Sie bei Erreichen vordefinierter Schwellenwerte benachrichtigt werden und Ihr Budget nicht überschreiten.

Beobachtbarkeit (Observability) bei gpt-image-2

Protokollieren Sie in der Produktionsumgebung unbedingt die wichtigsten Metriken für jeden Request:

import time

import logging

logger = logging.getLogger("gpt-image-2")

def call_with_metrics(prompt: str, **params):

start = time.perf_counter()

try:

resp = client.images.generate(model="gpt-image-2", prompt=prompt, **params)

latency = time.perf_counter() - start

logger.info(

"gpt-image-2 erfolgreich",

extra={

"latency_ms": int(latency * 1000),

"size": params.get("size"),

"quality": params.get("quality"),

"n": params.get("n", 1)

}

)

return resp

except Exception as e:

logger.error(f"gpt-image-2 fehlgeschlagen: {type(e).__name__}: {e}")

raise

FAQ: Häufige Fragen zur Anbindung von gpt-image-2

F1: Warum erhalte ich bei input_fidelity einen 400-Fehler?

gpt-image-2 aktiviert in allen Bearbeitungsszenarien automatisch die High-Fidelity-Funktion, weshalb der Parameter input_fidelity abgelehnt wird. Entfernen Sie diesen Parameter einfach. Falls Sie von gpt-image-1 migrieren, sollten Sie Ihren Code global danach durchsuchen. Vergleichen Sie die Parameterunterschiede zwischen alten und neuen Modellen in der APIYI-Dokumentation: docs.apiyi.com.

F2: Warum kommt es bei Aufrufen von gpt-image-2 häufig zu Timeouts?

Die Generierung eines Bildes in hoher Qualität (2K/4K) dauert in der Praxis 3-5 Minuten. Wenn der Standard-Timeout des Clients bei 60 Sekunden liegt, schlägt der Aufruf zwangsläufig fehl. Lösung: Setzen Sie den timeout auf 360-600 Sekunden. Im Python SDK nutzen Sie OpenAI(timeout=600), in Node.js timeout: 600_000 und bei cURL --max-time 600.

F3: Wie zeige ich das von der API zurückgegebene b64_json direkt im Web an?

Die API liefert einen reinen Base64-String ohne Präfix, den Browser nicht direkt rendern können. Sie müssen ihn wie folgt ergänzen:

const dataUri = `data:image/${format};base64,${b64}`;

imgElement.src = dataUri;

Für Backend-Dienste empfehlen wir, den Base64-String zu dekodieren und in einem OSS/CDN zu speichern. Das Frontend sollte nur die URL erhalten, um die HTML-Größe nicht unnötig aufzublähen. Testen Sie die Kette zunächst mit cURL und lokalem Dekodieren, bevor Sie die Speicherinfrastruktur implementieren.

F4: Unterstützt gpt-image-2 transparente Hintergründe?

Derzeit unterstützt gpt-image-2 keine transparenten Hintergründe. Die Übergabe von background: "transparent" führt zu einem 400-Fehler. Workaround: Generieren Sie ein Bild mit rein weißem oder grünem Hintergrund und nutzen Sie Client-Bibliotheken (wie rembg), um den Hintergrund nachträglich zu entfernen.

F5: Wie verwende ich den thinking-Parameter?

thinking ist ein neuer Inferenz-Parameter (off / low / medium / high). Bei Aktivierung plant das Modell das Layout vor der Generierung, was die Qualität steigert, aber die Kosten deutlich erhöht (High-Modus kostet etwa das 4- bis 5-fache). Empfehlung: Nutzen Sie medium nur für textlastige Poster oder komplexe Kompositionen; für Standardaufgaben sollte off gewählt werden. Führen Sie A/B-Tests über die APIYI-Schnittstelle durch, bevor Sie eine dauerhafte Einstellung wählen.

F6: Was tun bei 403-Fehlern durch die Inhaltsmoderation?

Versuchen Sie zunächst, moderation: "low" in den Request aufzunehmen, um die Empfindlichkeit zu senken. Wenn der Request weiterhin blockiert wird, verstößt der Prompt gegen grundlegende Sicherheitsrichtlinien (Gewalt, unangemessene Inhalte, Porträts bekannter Personen etc.) und muss umgeschrieben werden. Hinweis: moderation: "low" schaltet die Prüfung nicht ab, sondern lockert sie nur; hochriskante Inhalte werden weiterhin blockiert.

F7: Was passiert, wenn die base_url falsch geschrieben ist?

Wenn Sie https://api.apiyi.com (ohne /v1) angeben, hängt das SDK images/generations an, was zu einem 404-Fehler führt. Die korrekte URL lautet https://api.apiyi.com/v1. Achten Sie auf die korrekte Schreibweise (Python: base_url, Node.js: baseURL).

F8: Was sind Best Practices für die Bildfusion (Multi-Image)?

Sie können bis zu 16 Referenzbilder verwenden und diese im Prompt als „Bild 1“, „Bild 2“ usw. bezeichnen. Wichtige Tipps:

- Das erste Referenzbild dient meist als „Hauptobjekt“, dessen Struktur bevorzugt beibehalten wird.

- Komplexe Anweisungen können schrittweise erfolgen: „Verwende Bild 1 als Hauptobjekt“ gefolgt von „integriere die Farbgebung von Bild 2“.

- Die Bearbeitung mehrerer Bilder kostet 1,5- bis 2-mal so viel wie eine einfache Text-zu-Bild-Generierung.

- Testen Sie die Logik erst mit 2-3 Bildern, bevor Sie auf mehr Referenzbilder skalieren.

Zusammenfassung: Rückblick auf den vollständigen Pfad zur Anbindung von gpt-image-2 an die offizielle API

Nachdem Sie die 9 Kapitel dieses Artikels durchgearbeitet haben, sollten Sie die vollständige technische Methode zur Anbindung von gpt-image-2 an die offizielle API beherrschen:

- ✅ Vorbereitung – SDK auf die neueste Version aktualisieren, Timeout auf ≥ 360 Sekunden setzen.

- ✅ base_url-Konfiguration – Ersetzen durch

https://api.apiyi.com/v1, der restliche Code bleibt identisch mit dem offiziellen Standard. - ✅ Text-zu-Bild-Aufruf – Vorlagen für Python, Node.js und cURL.

- ✅ Parameter im Detail – 8 voreingestellte Größen + benutzerdefinierte Optionen, 3 Qualitätsstufen, 3 Ausgabeformate.

- ✅ Bildbearbeitung – Bis zu 16 Referenzbilder, wobei die Eingabeaufforderung auf „Bild1/Bild2“ verweist.

- ✅ Inpainting (Übermalen) – Nutzung des Alpha-Kanals für Masken, um transparente Bereiche neu zu generieren.

- ✅ Fehlerbehandlung – Umfassende Lösungsansätze für 400/401/403/429/5xx-Fehler.

- ✅ Produktionspraxis – Exponentielles Backoff, Nebenläufigkeitskontrolle, Kostenschätzung und Beobachtbarkeit (Observability).

Ein abschließender Rat für die Implementierung: Führen Sie zuerst ein „Hello World“ mit low-Qualität und 1024×1024 aus, bevor Sie die Komplexität schrittweise erhöhen. So lassen sich grundlegende Probleme mit der SDK-Version, Timeouts oder dem API-Schlüssel schnell identifizieren, ohne Zeit mit der Fehlersuche bei langwierigen high-Qualitäts- und 4K-Anfragen zu verschwenden.

Falls Ihr Team gerade die Anbindung von gpt-image-2 evaluiert oder bereits bei der ersten Code-Version auf Parameterfehler oder Timeouts stößt, empfehlen wir, direkt über APIYI (apiyi.com) einen Testschlüssel zu beantragen und die Code-Vorlagen aus diesem Artikel auszuprobieren. Alle Beispiele basieren auf dem offiziellen SDK und dem API-Proxy-Dienst von APIYI (Felder sind zu 100 % identisch), was eine hohe Kompatibilität gewährleistet und eine direkte Übernahme in Ihre eigenen Projekte ermöglicht.

Referenzmaterialien

-

OpenAI gpt-image-2 Modelldokumentation: Maßgebliche Informationen zu Modellfähigkeiten, Parametern und Preisen.

- Link:

developers.openai.com/api/docs/models/gpt-image-2 - Hinweis: Enthält Kernfunktionen wie 4K-Rendering, zeichengenaue Textdarstellung und logische Integration.

- Link:

-

OpenAI Leitfaden zur Bilderzeugung: Vollständiger Workflow für Text-zu-Bild, Bearbeitung und Inpainting.

- Link:

developers.openai.com/api/docs/guides/image-generation - Hinweis: Deckt alle Parameter wie Größe, Qualität und Format ab.

- Link:

-

OpenAI Create Image API-Referenz: Vollständige Felder für den Endpunkt

/v1/images/generations.- Link:

developers.openai.com/api/reference/resources/images/methods/generate - Hinweis: Maßgebliche Referenz für Anfrage- und Antwortfelder.

- Link:

-

APIYI Offizielle Dokumentation: Vollständiger Leitfaden zur Anbindung von gpt-image-2.

- Link:

docs.apiyi.com/api-capabilities/gpt-image-2/overview - Hinweis: Enthält cURL/Python/Node.js-Beispiele und Erklärungen zu Fehlercodes.

- Link:

-

OpenAI Cookbook · Rate Limits: Strategien für exponentielles Backoff bei 429-Fehlern.

- Link:

developers.openai.com/cookbook/examples/how_to_handle_rate_limits - Hinweis: Offizielle Vorlage für den Umgang mit Ratenbegrenzungen.

- Link:

Autor: APIYI Technik-Team

Veröffentlichungsdatum: 27. April 2026

Schlüsselwörter: gpt-image-2 Anbindung offizielle API, base_url, Text-zu-Bild, Bildbearbeitung, Inpainting, APIYI, OpenAI SDK