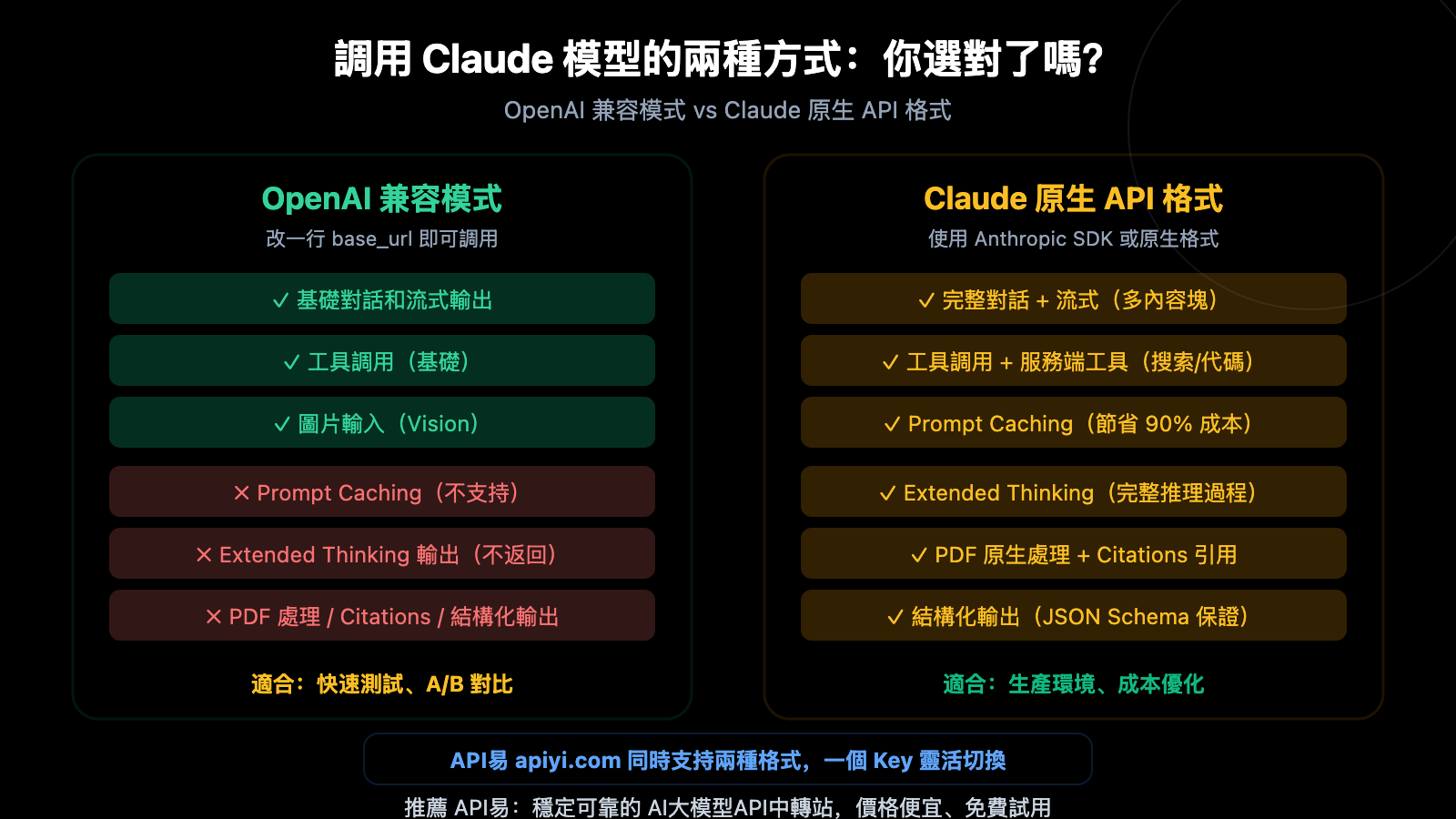

作者注:詳細對比 OpenAI 兼容模式和 Claude 原生 API 格式的 7 個關鍵差異,包括 Prompt Caching、Extended Thinking、工具調用等功能支持情況,幫你選擇最適合的接入方式

用 OpenAI SDK 調用 Claude 模型只需改一行 base_url,看起來很方便——但你可能因此 損失 90% 的 Prompt Caching 成本節省、無法獲取 Extended Thinking 推理過程、丟失 PDF 原生處理能力。本文將對比這兩種接入方式的 7 個關鍵差異,幫你做出正確選擇。

核心價值: 看完本文,你將明確在你的使用場景下,該選擇 OpenAI 兼容模式還是 Claude 原生格式,避免因格式選錯而多花錢或丟功能。核心點在於,如果你用 Claude 模型,優先用 Claude 原先格式調用,而非 OpenAI 兼容模式。

OpenAI 兼容模式 vs Claude 原生格式 核心差異

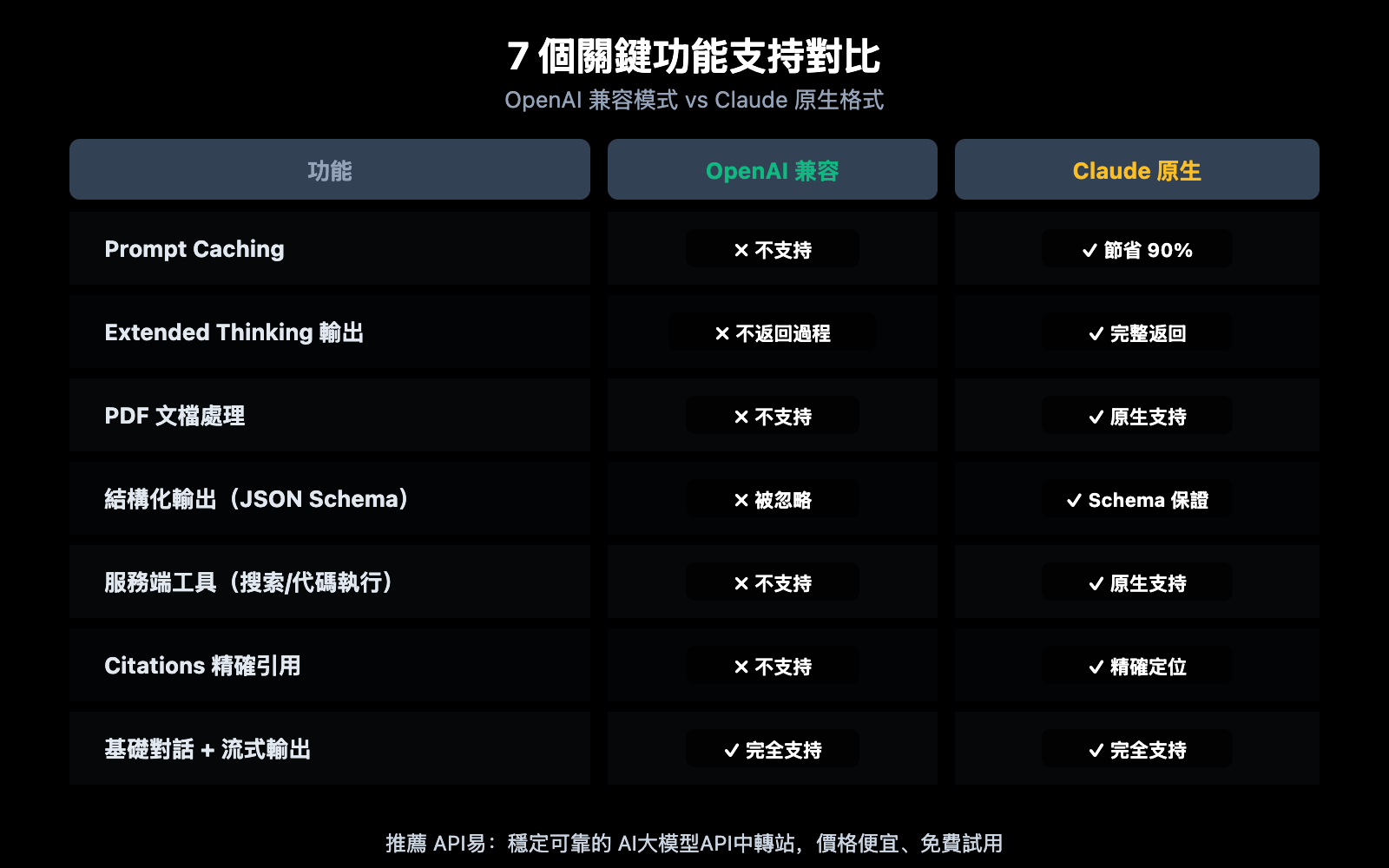

| 差異維度 | OpenAI 兼容模式 | Claude 原生格式 | 影響程度 |

|---|---|---|---|

| Prompt Caching | ✗ 不支持 | ✓ 支持(節省 90% 成本) | ⭐⭐⭐⭐⭐ 極高 |

| Extended Thinking | ✗ 不返回推理過程 | ✓ 完整返回思考鏈 | ⭐⭐⭐⭐⭐ 極高 |

| 系統提示詞處理 | 多個合併爲一個 | 獨立頂層字段 | ⭐⭐⭐ 中 |

| 工具調用 | 基礎支持 | 完整支持 + 服務端工具 | ⭐⭐⭐⭐ 高 |

| PDF 處理 | ✗ 不支持 | ✓ 原生 document 類型 | ⭐⭐⭐⭐ 高 |

| 結構化輸出 | ✗ strict 被忽略 | ✓ JSON Schema 保證 | ⭐⭐⭐⭐ 高 |

| Citations 引用 | ✗ 不支持 | ✓ 精確引用定位 | ⭐⭐⭐ 中 |

OpenAI 兼容模式 vs Claude 原生格式的本質區別

簡單來說,OpenAI 兼容模式是一個翻譯層——它將 OpenAI 格式的請求翻譯成 Claude 能理解的格式,再將 Claude 的響應翻譯回 OpenAI 格式。這個翻譯過程是有損的:Claude 原生 API 支持的多種內容塊類型(thinking、text、tool_use、citations)在翻譯回 OpenAI 格式時被扁平化爲一個 content 字符串。

Anthropic 官方明確表示:OpenAI 兼容端點主要用於"測試和對比模型能力",並非長期或生產就緒的解決方案。

OpenAI 兼容模式 vs Claude 原生格式的請求結構對比

兩種格式在代碼層面的最直觀差異是系統提示詞的位置和響應的結構:

# ====== OpenAI 兼容模式 ======

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://vip.apiyi.com/v1" # 通過 API易 接入

)

# 系統提示詞放在 messages 數組中

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "你是技術專家"},

{"role": "user", "content": "解釋 Tokenizer"}

]

)

# 響應是單一 content 字符串

print(response.choices[0].message.content)

查看 Claude 原生格式的請求代碼

# ====== Claude 原生 API 格式 ======

import anthropic

client = anthropic.Anthropic(

api_key="your-api-key",

base_url="https://vip.apiyi.com" # 通過 API易 接入

)

# 系統提示詞是獨立的頂層字段

response = client.messages.create(

model="claude-sonnet-4-6",

system="你是技術專家", # 獨立字段,不在 messages 中

messages=[

{"role": "user", "content": "解釋 Tokenizer"}

],

max_tokens=1024

)

# 響應是多內容塊數組

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"思考過程: {block.thinking}")

🎯 接入建議: API易 apiyi.com 同時支持 OpenAI 兼容格式和 Claude 原生格式。如果你當前使用 OpenAI SDK 且只需基礎對話功能,兼容模式可以快速上手;如果需要 Prompt Caching 或 Extended Thinking,建議切換到原生格式。

OpenAI 兼容模式 vs Claude 原生格式 功能詳解

差異 1:Prompt Caching(成本影響最大)

這是兩種格式最重要的差異。Claude 的 Prompt Caching 可以將重複內容的輸入成本降低 90%,但 OpenAI 兼容模式完全不支持這一功能。

| Prompt Caching 細節 | Claude 原生格式 | OpenAI 兼容模式 |

|---|---|---|

| 緩存控制標記 | cache_control 參數 |

✗ 不支持 |

| 5 分鐘緩存(寫入 1.25x) | ✓ | ✗ |

| 1 小時緩存(寫入 2x) | ✓ | ✗ |

| 緩存命中讀取(0.1x) | ✓ 節省 90% | ✗ |

| 緩存使用量統計 | ✓ 返回詳細數據 | ✗ 字段始終爲空 |

| 最小緩存閾值 | Opus: 4,096 / Sonnet 4.6: 2,048 | — |

實際成本差距有多大? 以一個典型的 Agent 工作流爲例:每輪對話包含約 10,000 Token 的系統提示詞和工具定義。在 10 輪對話中:

- 無緩存(OpenAI 兼容模式): 10 輪 × 10,000 Token = 100,000 Input Token 全價計費

- 有緩存(Claude 原生格式): 首輪全價 + 9 輪緩存命中(0.1x)= 10,000 + 9,000 = 19,000 等效 Token

成本降低約 81%。對話輪次越多,Prompt Caching 的成本優勢越顯著。

差異 2:Extended Thinking(推理能力)

Claude 的 Extended Thinking 讓模型在回答前先進行深度推理。雖然可以通過 extra_body 在 OpenAI 兼容模式中啓用 Extended Thinking,但 推理過程不會返回給你——你只能看到最終答案。

# OpenAI 兼容模式 —— 可以觸發思考,但看不到思考過程

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "這個數學題怎麼解?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content 只有最終答案

# 思考過程被消費但不返回 ❌

在 Claude 原生格式中,你可以獲取完整的 thinking 內容塊,這對於調試、審計和複雜推理場景非常重要。

差異 3:工具調用格式

兩種格式都支持工具調用,但有幾個關鍵差異:

| 工具調用差異 | OpenAI 兼容模式 | Claude 原生格式 |

|---|---|---|

| 工具定義結構 | function.parameters |

input_schema |

| 服務端工具(搜索/代碼執行) | ✗ 不支持 | ✓ web_search / code_execution |

strict 模式(輸出保證) |

✗ 被忽略 | ✓ JSON Schema 保證 |

| 工具緩存 | ✗ 不支持 | ✓ cache_control |

| 並行工具調用 | ✓ 支持 | ✓ 支持 |

差異 4-7:其他重要區別

差異 4:PDF 文檔處理。Claude 原生 API 支持 type: "document" 內容塊,可以直接處理 PDF 文件並提取結構化內容。OpenAI 兼容模式中 file 類型內容會被直接忽略。

差異 5:結構化輸出。OpenAI 兼容模式中 response_format 和 strict 參數均被忽略,無法保證輸出嚴格遵循 JSON Schema。Claude 原生格式通過 output_config.format 支持 Schema 保證。

差異 6:Citations 引用。Claude 原生格式可以返回精確的引用定位(文檔索引、字符位置),適合 RAG 場景中的來源追溯。OpenAI 兼容模式沒有對應字段。

差異 7:被忽略的參數。以下 OpenAI 參數在調用 Claude 時會被靜默忽略:frequency_penalty、presence_penalty、seed、logprobs、logit_bias、n(必須爲 1)。temperature 超過 1 會被自動截斷爲 1。

🎯 重要提醒: 如果你的代碼依賴

frequency_penalty或presence_penalty來控制輸出風格,切換到 Claude 時需要注意這些參數不生效。建議通過調整系統提示詞來達到類似效果。通過 API易 apiyi.com 接入時,平臺會處理這些兼容性細節。

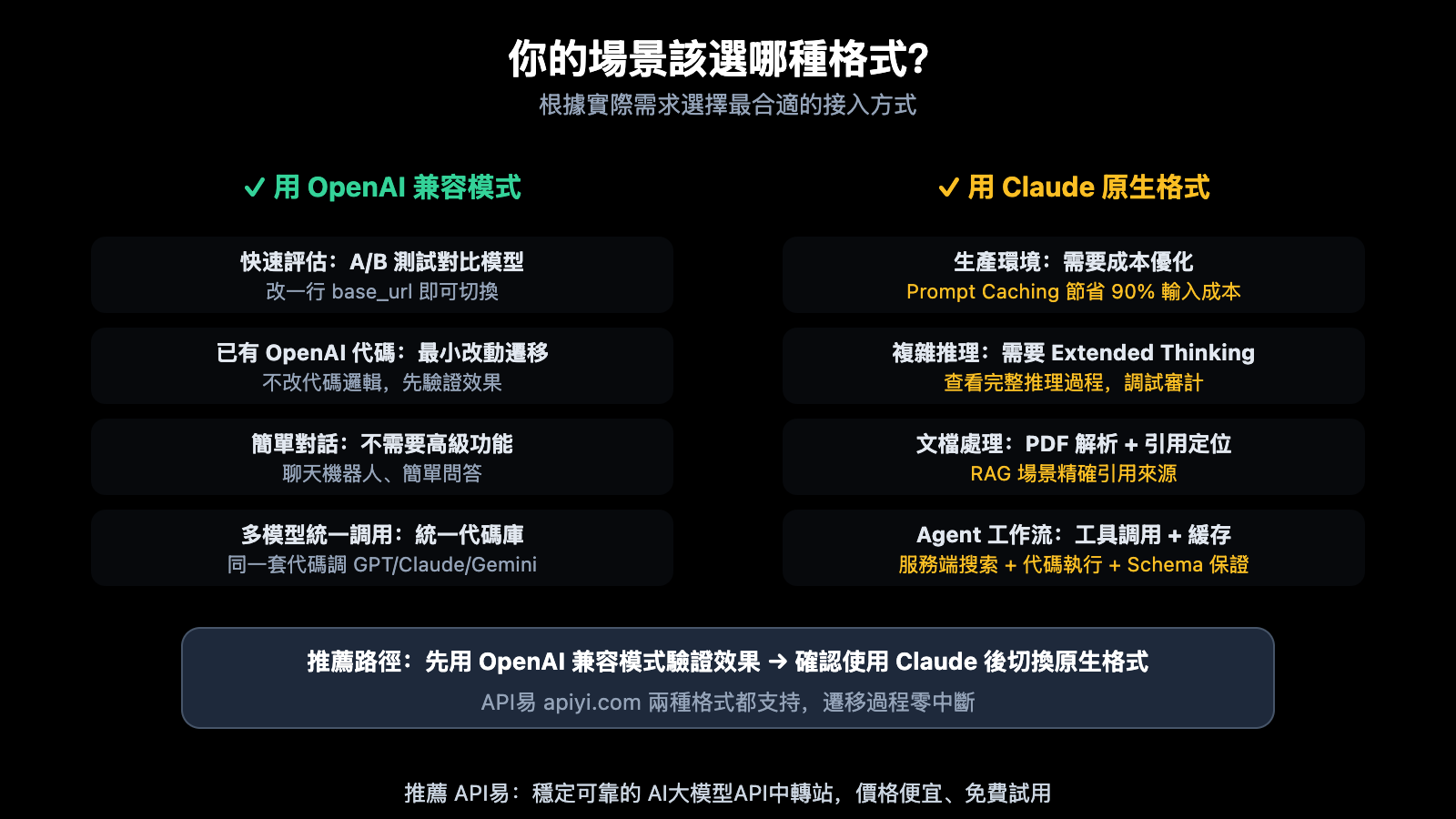

OpenAI 兼容模式 vs Claude 原生格式 場景選擇

| 使用場景 | 推薦格式 | 核心原因 |

|---|---|---|

| 快速評估 / A-B 測試 | OpenAI 兼容 | 改 base_url 即可,零代碼改動 |

| 已有 OpenAI 項目遷移 | 先 OpenAI 兼容 → 後原生 | 先驗證效果,再逐步遷移 |

| 生產環境長對話 | Claude 原生 | Prompt Caching 節省 80%+ 成本 |

| Agent / 工具調用密集 | Claude 原生 | 服務端工具 + 緩存 + Schema 保證 |

| PDF / RAG 場景 | Claude 原生 | 原生文檔處理 + Citations 引用 |

| 多模型統一代碼 | OpenAI 兼容 | 一套代碼調用 GPT/Claude/Gemini |

🎯 遷移建議: 從 OpenAI 兼容模式遷移到 Claude 原生格式,主要工作量在於:(1)將 system 消息從 messages 中提取到頂層字段;(2)將工具定義的

parameters改爲input_schema;(3)處理響應中的多內容塊結構。通過 API易 apiyi.com 接入可以簡化這個過程。

常見問題

Q1: 用 OpenAI 兼容模式調用 Claude,功能會不會比調 GPT 少?

會少一些。OpenAI 兼容模式調用 Claude 時,frequency_penalty、presence_penalty、seed、logprobs、response_format 等參數都會被靜默忽略。而調用 GPT 時這些參數是生效的。所以如果你的代碼依賴這些參數,從 GPT 切換到 Claude 時需要注意。不過核心的對話、流式輸出、基礎工具調用都完全正常。

Q2: Claude 原生格式和 OpenAI 格式可以混用嗎?

可以。API易 apiyi.com 同時支持兩種格式。你可以在同一個項目中,對簡單對話使用 OpenAI 兼容格式(省開發時間),對需要 Prompt Caching 的 Agent 工作流使用 Claude 原生格式(省 Token 成本)。兩種格式使用同一個 API Key。

Q3: 從 OpenAI 兼容模式切換到 Claude 原生格式難嗎?

改動量不大,主要有 3 處:

- SDK 從

openai換爲anthropic(或直接使用 HTTP 請求) - 系統提示詞從 messages 數組中提取爲獨立的

system字段 - 響應處理從

choices[0].message.content改爲遍歷content數組

如果通過 API易 apiyi.com 接入,平臺提供兩種格式的統一文檔和代碼示例,遷移更加順暢。

總結

OpenAI 兼容模式 vs Claude 原生格式的核心選擇依據:

- Prompt Caching 是最大差異: 生產環境中長對話和 Agent 場景,使用 Claude 原生格式可節省 80-90% 的輸入 Token 成本,這個差距遠大於其他功能差異

- OpenAI 兼容模式適合快速驗證: 如果只是測試 Claude 效果或進行 A/B 對比,改一行

base_url就夠了,不需要重寫代碼 - 生產環境建議使用原生格式: Extended Thinking、PDF 處理、Citations、結構化輸出等功能只有原生格式才能完整使用

選對接入方式,既能發揮 Claude 的全部能力,又能最大化成本效率。

推薦通過 API易 apiyi.com 接入,平臺同時支持 OpenAI 兼容格式和 Claude 原生格式,一個 Key 即可靈活切換,輕鬆應對不同場景需求。

📚 參考資料

-

Anthropic OpenAI SDK 兼容性文檔: 官方支持和不支持的參數完整列表

- 鏈接:

platform.claude.com/docs/en/api/openai-sdk - 說明: 包含所有被忽略參數和響應字段的詳細說明

- 鏈接:

-

Claude Prompt Caching 文檔: Prompt 緩存機制和計費規則

- 鏈接:

platform.claude.com/docs/en/build-with-claude/prompt-caching - 說明: 5 分鐘和 1 小時兩種緩存級別的定價和最小閾值

- 鏈接:

-

Claude Messages API 參考: Claude 原生 API 的完整請求和響應格式

- 鏈接:

platform.claude.com/docs/en/api/messages - 說明: content blocks、工具調用、流式輸出的詳細格式規範

- 鏈接:

-

Claude Extended Thinking 文檔: 擴展思考功能的使用方法

- 鏈接:

platform.claude.com/docs/en/build-with-claude/extended-thinking - 說明: 如何啓用和獲取完整的推理過程輸出

- 鏈接:

作者: APIYI 技術團隊

技術交流: 歡迎在評論區討論,更多資料可訪問 API易 docs.apiyi.com 文檔中心