想讓 MoltBot 接入 Claude Opus 4.5 或其他大模型,卻不知道如何配置 API 代理? 本文將手把手教你完成 MoltBot 多 Provider 配置,讓你的 AI 助手同時接入多個模型服務,實現智能切換和容災備份。

核心價值: 讀完本文,你將掌握 MoltBot 的 models.providers 配置方法,學會設置主模型、備用模型和模型別名,打造穩定可靠的 AI 助手。

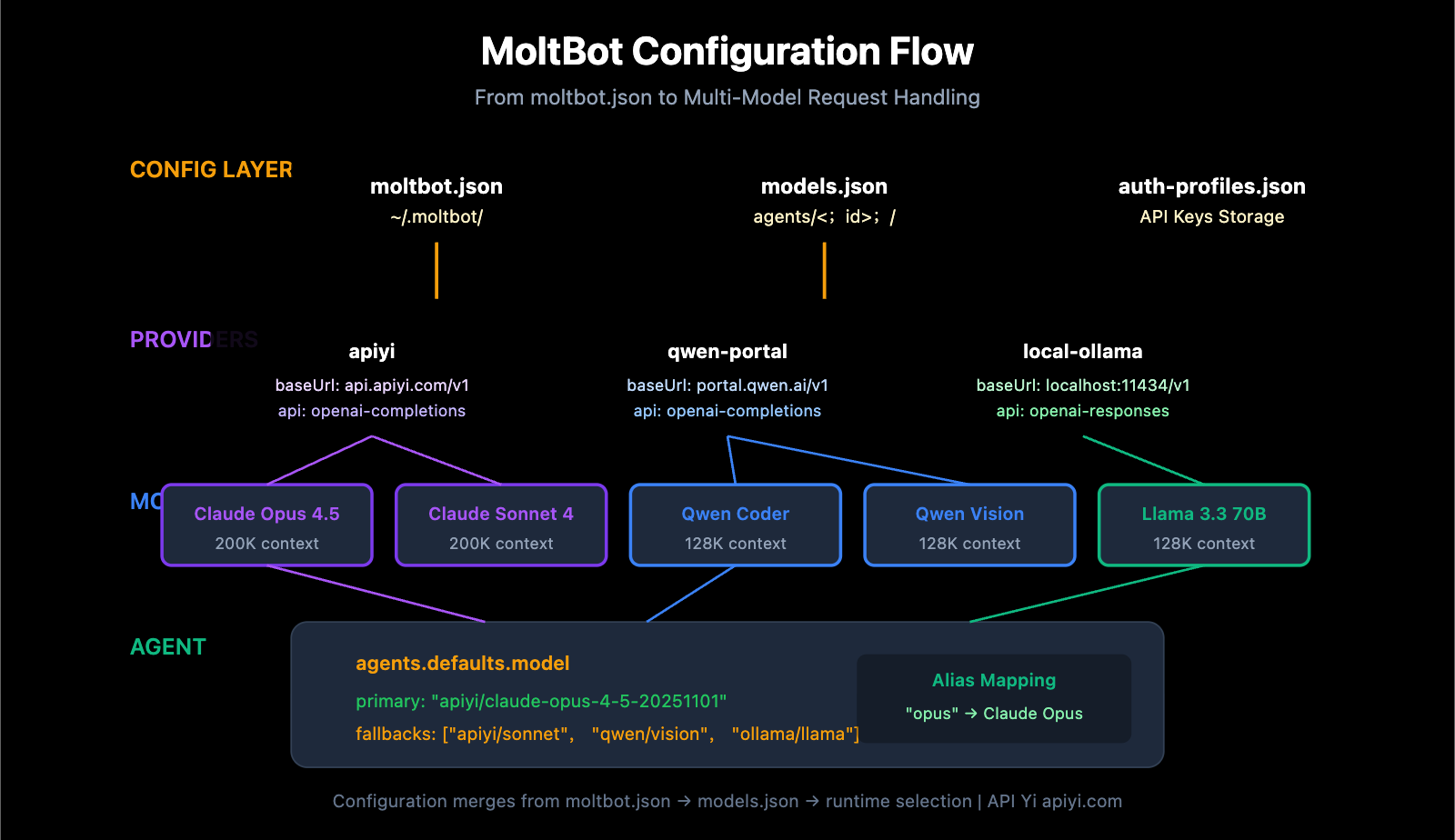

MoltBot API 代理配置: 核心概念解析

MoltBot 支持通過 OpenAI Compatible API 接入幾乎所有主流大模型服務。理解以下核心概念,是配置成功的關鍵。

MoltBot 配置文件體系

| 配置文件 | 位置 | 用途 |

|---|---|---|

| moltbot.json | ~/.moltbot/ |

全局配置入口 |

| models.json | ~/.moltbot/agents/<agentId>/ |

Agent 級模型配置 |

| auth-profiles.json | ~/.moltbot/agents/<agentId>/ |

認證信息存儲 |

MoltBot Provider 配置核心字段

每個 Provider 配置包含以下關鍵字段:

| 字段 | 類型 | 說明 | 必填 |

|---|---|---|---|

baseUrl |

string | API 端點地址 | 是 |

apiKey |

string | API 密鑰 (支持環境變量) | 是 |

api |

string | API 協議類型 | 是 |

models |

array | 可用模型列表 | 是 |

API 協議類型說明

MoltBot 支持兩種主流的 OpenAI 兼容協議:

| 協議類型 | 說明 | 適用場景 |

|---|---|---|

openai-completions |

標準 Chat Completions API | 大多數代理服務 |

openai-responses |

Responses API (含工具調用) | 本地模型、高級場景 |

🎯 配置建議: 大多數 API 代理服務 (如 API易 apiyi.com) 使用

openai-completions協議。如果你使用的是本地部署的 LM Studio 或 Ollama,則需要使用openai-responses。

MoltBot 多 Provider 配置: 完整示例

下面是一個實際可用的多 Provider 配置示例,同時接入 API易 和 Qwen Portal 兩個服務:

完整配置文件示例

{

"models": {

"providers": {

"qwen-portal": {

"baseUrl": "https://portal.qwen.ai/v1",

"apiKey": "${QWEN_API_KEY}",

"api": "openai-completions",

"models": [

{ "id": "coder-model", "name": "Qwen Coder", "contextWindow": 128000 },

{ "id": "vision-model", "name": "Qwen Vision", "contextWindow": 128000 }

]

},

"apiyi": {

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "${APIYI_API_KEY}",

"api": "openai-completions",

"models": [

{ "id": "claude-opus-4-5-20251101", "name": "Claude Opus 4.5", "contextWindow": 200000 },

{ "id": "claude-sonnet-4-20250514", "name": "Claude Sonnet 4", "contextWindow": 200000 },

{ "id": "gpt-4o", "name": "GPT-4o", "contextWindow": 128000 }

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-opus-4-5-20251101",

"fallbacks": ["qwen-portal/vision-model"]

},

"models": {

"apiyi/claude-opus-4-5-20251101": { "alias": "opus" },

"apiyi/claude-sonnet-4-20250514": { "alias": "sonnet" },

"qwen-portal/coder-model": { "alias": "qwen" }

}

}

},

"channels": {

"telegram": {

"enabled": true,

"botToken": "${TELEGRAM_BOT_TOKEN}"

}

}

}

配置結構詳解

1. models.providers 部分

這是定義 API 代理服務的核心部分:

"providers": {

"apiyi": {

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "${APIYI_API_KEY}",

"api": "openai-completions",

"models": [...]

}

}

- Provider ID (

apiyi): 自定義的服務標識,後續引用時使用 - baseUrl: API 端點,必須以

/v1結尾 - apiKey: 支持直接填寫或使用

${ENV_VAR}環境變量 - models: 該 Provider 支持的模型列表

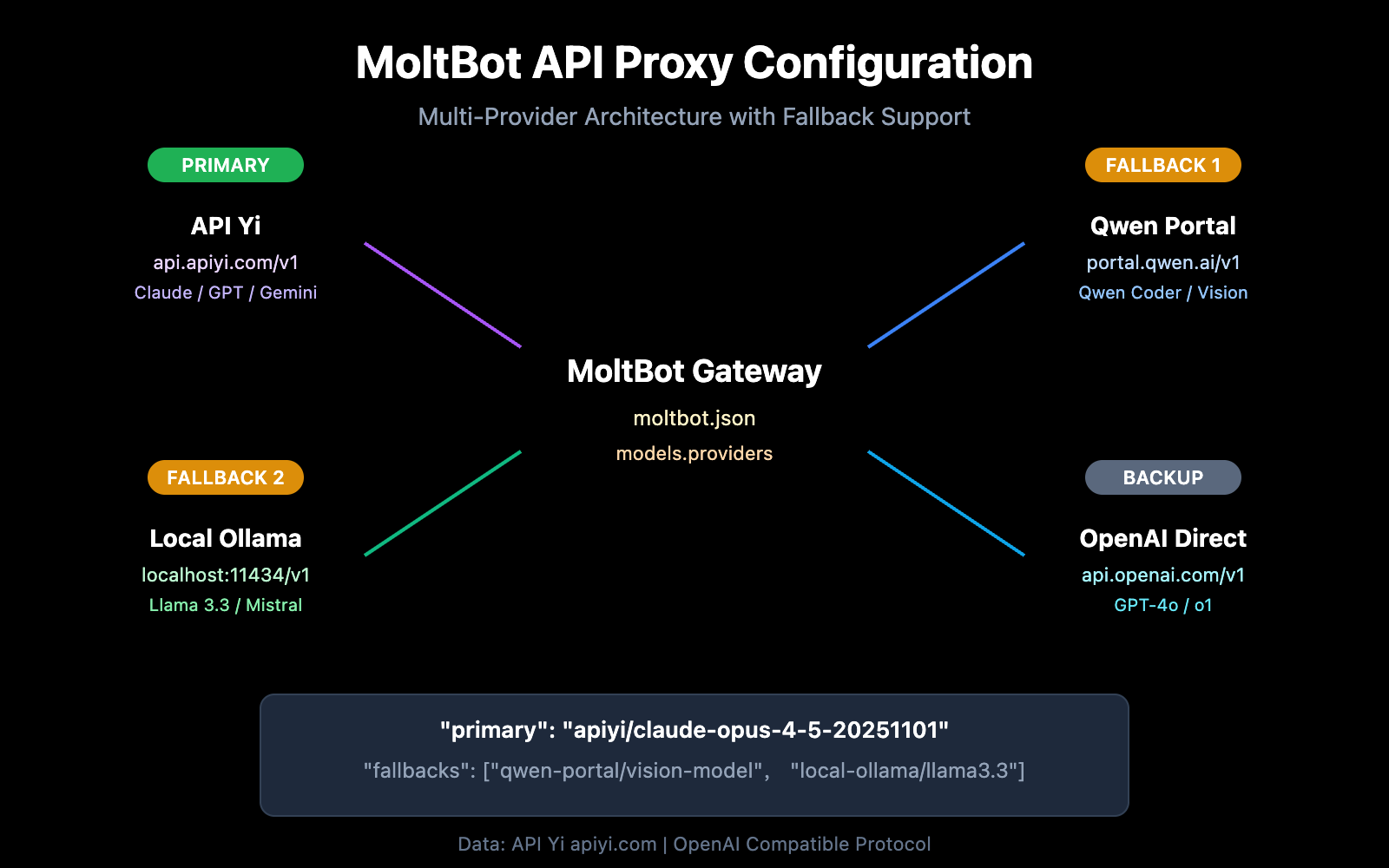

2. agents.defaults.model 部分

定義默認使用的模型和容災策略:

"model": {

"primary": "apiyi/claude-opus-4-5-20251101",

"fallbacks": ["qwen-portal/vision-model"]

}

- primary: 主模型,格式爲

provider-id/model-id - fallbacks: 備用模型數組,主模型失敗時自動切換

3. agents.defaults.models 部分

定義模型別名,方便快速切換:

"models": {

"apiyi/claude-opus-4-5-20251101": { "alias": "opus" },

"qwen-portal/coder-model": { "alias": "qwen" }

}

配置別名後,可以在對話中使用 /model opus 快速切換模型。

MoltBot API 代理配置: 分步教程

第一步: 獲取 API Key

在配置之前,你需要準備好 API Key:

| 服務商 | 獲取方式 | 支持模型 |

|---|---|---|

| API易 | 訪問 apiyi.com 註冊獲取 | Claude 全系列、GPT 全系列、Gemini 等 |

| Qwen Portal | 訪問 portal.qwen.ai | Qwen 系列模型 |

| OpenAI | 訪問 platform.openai.com | GPT 系列 |

| Anthropic | 訪問 console.anthropic.com | Claude 系列 |

🚀 快速開始: 推薦使用 API易 apiyi.com 作爲主要 Provider,一個 API Key 即可調用 Claude、GPT、Gemini 等主流模型,無需分別註冊多個平臺。

第二步: 設置環境變量

爲了安全起見,建議使用環境變量存儲 API Key:

# Linux/macOS - 添加到 ~/.bashrc 或 ~/.zshrc

export APIYI_API_KEY="sk-your-apiyi-key"

export QWEN_API_KEY="your-qwen-key"

export TELEGRAM_BOT_TOKEN="your-telegram-token"

# 使配置生效

source ~/.bashrc

# Windows PowerShell

$env:APIYI_API_KEY = "sk-your-apiyi-key"

$env:QWEN_API_KEY = "your-qwen-key"

$env:TELEGRAM_BOT_TOKEN = "your-telegram-token"

第三步: 編輯配置文件

打開或創建 MoltBot 配置文件:

# 打開配置文件

nano ~/.moltbot/moltbot.json

# 或使用 VS Code

code ~/.moltbot/moltbot.json

將以下配置粘貼到文件中:

{

"models": {

"providers": {

"apiyi": {

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "${APIYI_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "claude-opus-4-5-20251101",

"name": "Claude Opus 4.5",

"contextWindow": 200000

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-opus-4-5-20251101"

}

}

}

}

第四步: 驗證配置

重啓 MoltBot 並驗證配置是否生效:

# 重啓 MoltBot

moltbot restart

# 檢查當前模型配置

moltbot models list

# 測試模型調用

moltbot chat "你好,請告訴我你是什麼模型"

查看完整的多 Provider 配置示例

{

"models": {

"mode": "merge",

"providers": {

"apiyi": {

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "${APIYI_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "claude-opus-4-5-20251101",

"name": "Claude Opus 4.5",

"contextWindow": 200000,

"maxTokens": 32000

},

{

"id": "claude-sonnet-4-20250514",

"name": "Claude Sonnet 4",

"contextWindow": 200000,

"maxTokens": 64000

},

{

"id": "gpt-4o",

"name": "GPT-4o",

"contextWindow": 128000,

"maxTokens": 16384

},

{

"id": "gemini-2.5-pro",

"name": "Gemini 2.5 Pro",

"contextWindow": 1000000,

"maxTokens": 65536

}

]

},

"qwen-portal": {

"baseUrl": "https://portal.qwen.ai/v1",

"apiKey": "${QWEN_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "coder-model",

"name": "Qwen Coder",

"contextWindow": 128000

},

{

"id": "vision-model",

"name": "Qwen Vision",

"contextWindow": 128000

}

]

},

"local-ollama": {

"baseUrl": "http://localhost:11434/v1",

"apiKey": "ollama-local",

"api": "openai-responses",

"models": [

{

"id": "llama3.3:70b",

"name": "Llama 3.3 70B",

"contextWindow": 128000

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-opus-4-5-20251101",

"fallbacks": [

"apiyi/claude-sonnet-4-20250514",

"qwen-portal/vision-model",

"local-ollama/llama3.3:70b"

]

},

"models": {

"apiyi/claude-opus-4-5-20251101": {

"alias": "opus",

"params": { "temperature": 0.7 }

},

"apiyi/claude-sonnet-4-20250514": {

"alias": "sonnet",

"params": { "temperature": 0.5 }

},

"apiyi/gpt-4o": {

"alias": "gpt"

},

"qwen-portal/coder-model": {

"alias": "qwen"

},

"local-ollama/llama3.3:70b": {

"alias": "llama"

}

},

"imageModel": "apiyi/gpt-4o"

}

},

"channels": {

"telegram": {

"enabled": true,

"botToken": "${TELEGRAM_BOT_TOKEN}"

},

"discord": {

"enabled": false,

"token": "${DISCORD_BOT_TOKEN}"

}

}

}

💡 配置技巧: 使用

"mode": "merge"可以保留 MoltBot 內置的模型配置,同時添加你的自定義 Provider。這樣即使自定義服務不可用,也能回退到默認配置。

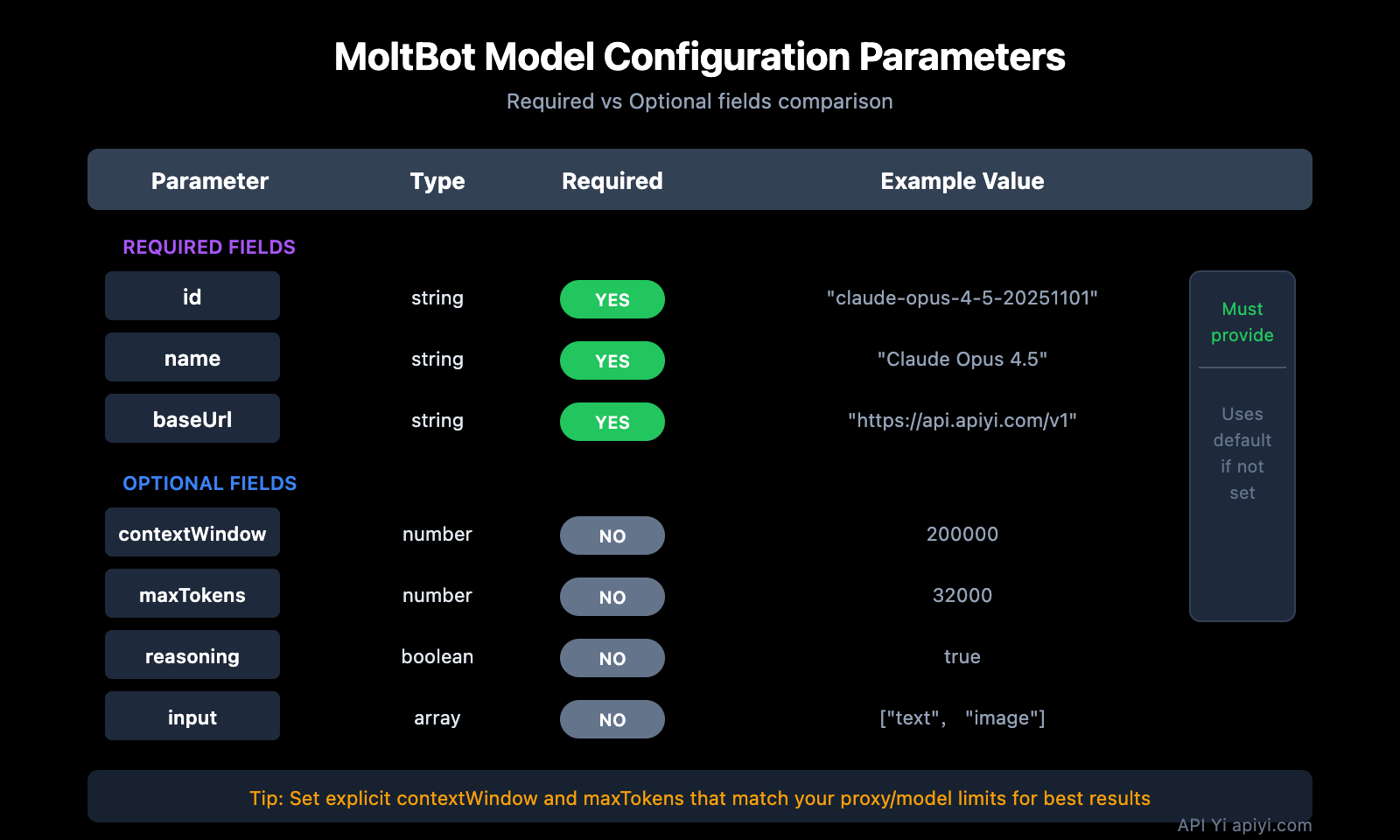

MoltBot 模型配置: 高級參數詳解

模型條目完整字段

| 參數 | 類型 | 必填 | 說明 | 示例 |

|---|---|---|---|---|

id |

string | 是 | 模型 ID,調用時使用 | claude-opus-4-5-20251101 |

name |

string | 是 | 顯示名稱 | Claude Opus 4.5 |

contextWindow |

number | 否 | 上下文窗口大小 | 200000 |

maxTokens |

number | 否 | 最大輸出 Token | 32000 |

reasoning |

boolean | 否 | 是否支持推理模式 | true |

input |

array | 否 | 支持的輸入類型 | ["text", "image"] |

cost |

object | 否 | 費用信息 | {"input": 15, "output": 75} |

模型參數配置 (params)

在 agents.defaults.models 中可以爲每個模型設置默認參數:

"models": {

"apiyi/claude-opus-4-5-20251101": {

"alias": "opus",

"params": {

"temperature": 0.7,

"maxTokens": 16000

}

}

}

| 參數 | 範圍 | 說明 |

|---|---|---|

temperature |

0-2 | 控制輸出隨機性,越低越確定 |

maxTokens |

1-模型上限 | 單次最大輸出長度 |

⚠️ 注意:

temperature是高級參數,除非你瞭解模型的默認設置並確實需要調整,否則建議不要設置。

MoltBot Fallback 容災配置

Fallback 機制是 MoltBot 的重要特性,確保 AI 助手始終可用。

Fallback 工作原理

用戶請求

↓

主模型 (primary)

↓ (失敗)

備用模型 1 (fallbacks[0])

↓ (失敗)

備用模型 2 (fallbacks[1])

↓ (失敗)

...繼續嘗試

推薦的 Fallback 配置策略

| 策略 | 配置示例 | 適用場景 |

|---|---|---|

| 同系列降級 | Opus → Sonnet → Haiku | 保持風格一致 |

| 跨平臺備份 | Claude → GPT → Gemini | 最大可用性 |

| 成本優化 | Opus → 本地模型 | 控制費用 |

| 混合策略 | 雲端 → 本地 → 雲端備用 | 綜合考慮 |

推薦配置:

"model": {

"primary": "apiyi/claude-opus-4-5-20251101",

"fallbacks": [

"apiyi/claude-sonnet-4-20250514",

"apiyi/gpt-4o",

"qwen-portal/vision-model"

]

}

💰 成本優化: 通過 API易 apiyi.com 配置 Fallback,可以在多個模型間自動切換,同時享受統一的計費方式,便於成本管控。

MoltBot 模型切換: 實戰技巧

使用別名快速切換

配置別名後,可以在對話中隨時切換模型:

你: /model opus

MoltBot: 已切換到 Claude Opus 4.5

你: /model sonnet

MoltBot: 已切換到 Claude Sonnet 4

你: /model qwen

MoltBot: 已切換到 Qwen Coder

爲特定任務指定模型

你: /model gpt 幫我分析這張圖片

MoltBot: [使用 GPT-4o 分析圖片...]

你: /model opus 寫一篇深度技術文章

MoltBot: [使用 Claude Opus 寫作...]

查看當前模型狀態

# 命令行查看

moltbot models list

# 對話中查看

你: /model

MoltBot: 當前模型: apiyi/claude-opus-4-5-20251101 (alias: opus)

MoltBot API 代理配置: 常見問題

Q1: 配置後提示 “API Key invalid” 怎麼辦?

這通常是 API Key 配置問題。檢查以下幾點:

- 確認環境變量已正確設置:

echo $APIYI_API_KEY - 檢查 API Key 格式是否正確 (通常以

sk-開頭) - 確認 API Key 有足夠的餘額和權限

- 如果直接寫在配置文件,檢查是否有多餘的空格或換行

通過 API易 apiyi.com 獲取的 API Key 格式爲 sk-xxx,請確保完整複製。

Q2: 如何同時使用本地模型和雲端模型?

使用 "mode": "merge" 配置可以同時使用本地和雲端模型:

{

"models": {

"mode": "merge",

"providers": {

"local-ollama": {

"baseUrl": "http://localhost:11434/v1",

"apiKey": "ollama-local",

"api": "openai-responses",

"models": [...]

},

"apiyi": {

"baseUrl": "https://api.apiyi.com/v1",

"apiKey": "${APIYI_API_KEY}",

"api": "openai-completions",

"models": [...]

}

}

}

}

這樣當本地模型不可用時,可以自動 Fallback 到雲端服務。

Q3: 環境變量 ${VAR} 不生效怎麼辦?

MoltBot 的環境變量替換規則:

- 只匹配大寫字母和下劃線:

[A-Z_][A-Z0-9_]* - 變量名必須全大寫,如

${APIYI_API_KEY} - 小寫變量名

${apiKey}不會被替換 - 未設置的環境變量會導致配置加載報錯

建議使用標準命名: APIYI_API_KEY、QWEN_API_KEY、TELEGRAM_BOT_TOKEN

Q4: 如何爲不同任務使用不同模型?

可以通過 imageModel 和別名實現:

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-opus-4-5-20251101"

},

"imageModel": "apiyi/gpt-4o",

"models": {

"apiyi/claude-opus-4-5-20251101": { "alias": "opus" },

"apiyi/gpt-4o": { "alias": "vision" }

}

}

}

- 文本任務自動使用 primary 模型 (Claude Opus)

- 圖像任務自動使用 imageModel (GPT-4o)

- 也可以用

/model vision手動切換

Q5: 支持哪些 OpenAI Compatible 服務?

MoltBot 支持所有遵循 OpenAI API 規範的服務:

| 服務類型 | 示例 | 推薦程度 |

|---|---|---|

| API 代理 | API易 apiyi.com | 推薦 (多模型統一接入) |

| 官方 API | OpenAI, Anthropic, Google | 官方穩定 |

| 本地部署 | Ollama, LM Studio, vLLM | 隱私優先 |

| 其他代理 | Groq, Together AI | 按需選擇 |

API易 apiyi.com 的優勢是一個 Key 即可調用多家模型,無需分別註冊。

MoltBot API 代理配置: 總結與建議

通過本文,你已經掌握了 MoltBot 配置 API 代理的完整方法:

- 理解配置結構:

models.providers定義服務,agents.defaults定義使用策略 - 設置多 Provider: 同時接入多個 API 服務,提高可用性

- 配置 Fallback: 主模型失敗時自動切換到備用模型

- 使用別名: 通過

/model alias快速切換模型

最佳實踐建議

| 建議 | 說明 |

|---|---|

| 使用環境變量 | 不要在配置文件中明文存儲 API Key |

| 配置 Fallback | 至少設置 1-2 個備用模型 |

| 設置 mode: merge | 保留默認配置,增強兼容性 |

| 統一 API 入口 | 使用 API易 簡化多模型管理 |

推薦通過 API易 apiyi.com 作爲主要的 API 代理服務,該平臺提供 Claude、GPT、Gemini 等主流模型的統一接入,配置簡單且支持靈活的計費方式,特別適合 MoltBot 的多模型切換場景。

參考資料

-

MoltBot 官方文檔 – Models: 模型配置詳解

- 鏈接:

docs.molt.bot/concepts/models - 說明: 官方模型配置指南

- 鏈接:

-

MoltBot 官方文檔 – Configuration: 完整配置參考

- 鏈接:

docs.molt.bot/gateway/configuration - 說明: 所有配置項詳解

- 鏈接:

-

MoltBot 官方文檔 – Model Providers: Provider 配置

- 鏈接:

docs.molt.bot/concepts/model-providers - 說明: 自定義 Provider 配置方法

- 鏈接:

-

MoltBot GitHub: 源碼和 Issue 討論

- 鏈接:

github.com/moltbot/moltbot - 說明: 最新版本和問題反饋

- 鏈接:

本文作者: APIYI Team | 更多 AI 技術分享歡迎訪問 API易 apiyi.com

更新日期: 2026 年 1 月