Когда 20 ноября 2025 года Google DeepMind представила Nano Banana Pro, они сделали акцент на одной фразе: «untouched areas remain pixel-perfect — no generation drift, no quality loss across iterative edits» (нетронутые области остаются пиксельно-идеальными — никакого дрейфа генерации и потери качества при итеративном редактировании). Если понимать это буквально, можно решить, что ИИ наконец-то научился «честному» локальному редактированию в стиле Photoshop. Однако, если вы знакомы с архитектурой Gemini 3 Pro Image, то знаете: по своей сути это авторегрессионный трансформер, который перерисовывает всё изображение целиком — по тому же принципу, по которому текстовые модели предсказывают следующий токен.

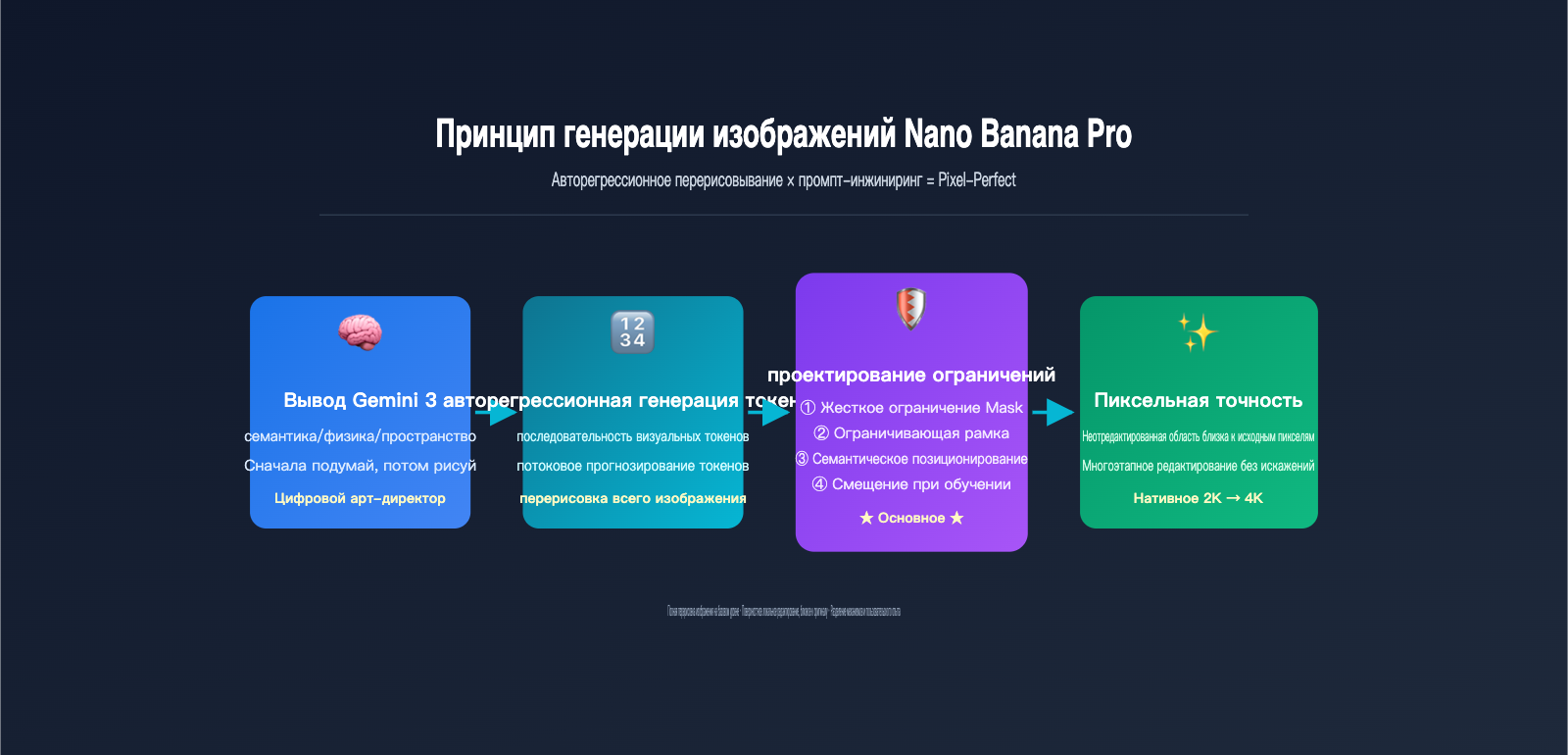

Как эти два факта уживаются вместе? Является ли принцип генерации изображений Nano Banana Pro полной перерисовкой или это настоящее локальное редактирование? В этой статье мы разберем всё «по винтикам»: от логики вывода Gemini 3 и авторегрессии визуальных токенов до жестких ограничений масок (Mask) и семантического позиционирования через Bounding Box. Вы получите знания, которые действительно пригодятся в работе.

| Ключевой вопрос | Интуитивный ответ | Реальность |

|---|---|---|

| Это локальное редактирование как в PS? | Да | Нет, в основе всё еще перерисовка токенов всего изображения |

| Почему тогда pixel-perfect? | Модель очень умная | Три уровня жестких ограничений: маска + семантика + BBox |

| Это то же самое, что GPT-Image-2? | Похоже | Оба авторегрессионные, но в Gemini 3 есть явный логический вывод |

| Будет ли дрейф при многократном редактировании? | Будет | Почти нет, это главная фишка Pro-версии |

Понимая эту логику, вы сможете составлять промпты, которые действительно активируют возможности Gemini 3, правильно выбирать режимы масок и избегать ловушек «псевдо-локального» редактирования. Рекомендуем тестировать Nano Banana Pro через API-ключ на платформе APIYI (apiyi.com), сопоставляя теорию с результатами в реальном времени.

Принцип генерации Nano Banana Pro: полная перерисовка или настоящее локальное редактирование?

Прежде чем ответить, нужно разделить две вещи: механизм генерации и пользовательский опыт.

С точки зрения механизма, Nano Banana Pro идет по тому же пути, что и его предшественники и GPT-Image-2 от OpenAI — это авторегрессионная перерисовка визуальных токенов всего изображения. Проще говоря, даже если вы просите ИИ изменить только цвет галстука, модель всё равно сжимает всё изображение в токены и заново предсказывает всю последовательность от начала до конца, декодируя результат в пиксели. Физического пути «изменить только кусочек, не трогая остальное» здесь не существует.

Но с точки зрения пользователя, Nano Banana Pro дает ощущение «почти настоящего» локального редактирования. Google официально заявляет: при использовании масок или семантического позиционирования нетронутые области сохраняются практически на уровне пикселей, без дрейфа и потери качества. Как этот опыт удалось выжать из архитектуры «полной перерисовки»?

Ответ: инженерия ограничений (constraint engineering). Google наложила на процесс авторегрессионной генерации три уровня жестких ограничений: блокировка токенов маски, указание области через Bounding Box и «список сохранения» на основе семантики Gemini 3. Эти ограничения заставляют модель при перерисовке «активно выбирать» воспроизведение токенов исходного изображения в нетронутых областях. Именно в этом заключается мастерство команды Nano Banana Pro.

Связь логики перерисовки и опыта локального редактирования

| Аспект | Реальное положение дел | Восприятие пользователя |

|---|---|---|

| Базовая архитектура | Перерисовка всех токенов | Выглядит как локальное редактирование |

| Нетронутые области | Перегенерированные токены | Почти идентичны исходным пикселям |

| Границы редактирования | Непрерывная авторегрессия | Естественный переход без артефактов |

| Инструкции редактирования | Передаются через ограничения | Автоматическая подстройка света/ракурса |

Понимая это разделение «механика — опыт», вы сможете объяснить, почему иногда в нередактируемых областях Nano Banana Pro могут возникать микроскопические изменения — это неизбежная цена перерисовки токенов, но Google удалось свести эти изменения к уровню, почти невидимому для глаза. Советуем использовать Nano Banana Pro через APIYI (apiyi.com), чтобы многократно редактировать одно и то же изображение и наблюдать за степенью дрейфа деталей — такой сравнительный анализ лучше всего помогает усвоить теорию.

Принцип работы Nano Banana Pro: авторегрессионный бэкенд Gemini 3 Pro Image

Чтобы глубоко понять принцип работы Nano Banana Pro, нужно начать с его официального названия — Gemini 3 Pro Image. Оно раскрывает два ключевых компонента: инференс-бэкенд Gemini 3 и декодер генерации изображений.

Gemini 3 — это флагманская мультимодальная языковая модель, представленная Google всего за пару дней до анонса Nano Banana Pro и известная своими выдающимися способностями к логическому выводу. Nano Banana Pro напрямую использует Transformer-бэкенд Gemini 3 Pro, лишь расширяя словарь визуальными токенами и подключая на выходе декодер изображений. Иными словами, это не отдельная модель для генерации изображений, а специализированная ипостась семейства мультимодальных моделей Gemini 3.

Это привносит фундаментальное изменение: прежде чем нарисовать первый пиксель, Nano Banana Pro использует логику Gemini 3, чтобы «понять, что именно нужно рисовать». Как выразились в Google, модель «функционирует не как традиционная диффузионная модель, а скорее как цифровой арт-директор» — она сначала анализирует семантическую логику промпта, физические причинно-следственные связи и пространственные отношения, и только потом переходит к генерации визуальных токенов.

Рабочий процесс можно разделить на пять этапов:

- Анализ мультимодального ввода: инференс-бэкенд Gemini 3 одновременно обрабатывает текстовый промпт пользователя и до 14 эталонных изображений, формируя контекст задачи.

- Структурированный вывод (внутренний чертеж): модель сначала «продумывает» пространственную компоновку, личности персонажей, освещение и области, требующие изменений, создавая невидимый «чертеж для творчества».

- Кодирование визуальных токенов исходного изображения: эталонные изображения сжимаются в последовательность визуальных токенов с помощью механизма дискретизации, похожего на VQ-VAE.

- Авторегрессионное предсказание токенов: благодаря механизму внимания (attention) в бэкенде Gemini 3, модель пошагово предсказывает каждый визуальный токен выходного изображения, «видя» на каждом шаге полный промпт и токены исходного изображения.

- Декодирование и апскейлинг: выходные токены восстанавливаются в исходное 2K-изображение с помощью 16-битного декодера, после чего выполняется интеллектуальный апскейлинг до 4K.

Две уникальные способности инференс-бэкенда Gemini 3

Во-первых, это «сначала думай, потом рисуй». Это не просто маркетинговый ход — способности Gemini 3 к логическому выводу в текстовых задачах напрямую переносятся на генерацию изображений. Если дать сложную инструкцию вроде «переодень этого человека в одежду, соответствующую его профессии», обычная модель может растеряться, а Nano Banana Pro сначала рассудит: «этот человек выглядит как врач → значит, нужен белый халат», и только потом приступит к рисованию.

Во-вторых, это Grounding с помощью Google Search. Nano Banana Pro может обращаться к инструментам поиска Google в процессе генерации для проверки фактов. Например, если попросить его нарисовать «последний продукт определенного бренда», он сможет получить данные о реальном внешнем виде из сети. Это единственная на данный момент модель генерации изображений с поддержкой нативного поиска (grounding), что является одним из ключевых отличий Nano Banana Pro от GPT-Image-2. Если вам нужно протестировать возможности Grounding в продакшене, вы можете подключиться к Nano Banana Pro через сервис-прокси API APIYI (apiyi.com), который предоставляет интерфейс, полностью соответствующий официальным спецификациям Google.

Стоит отметить, что Nano Banana Pro не поддерживает параметр seed. Поскольку это авторегрессионная генерация, каждый шаг выборки происходит из вероятностного распределения (под управлением temperature и top-k), в отличие от диффузионных моделей, где можно полностью воспроизвести результат, зафиксировав начальный шум. Эта особенность является одновременно и ограничением, и дизайнерским решением, позволяющим модели сохранять креативность.

4 механизма ограничений при локальном редактировании изображений AI: как достигается Pixel-Perfect

Поскольку в основе лежит перерисовка всего изображения, за счет чего Nano Banana Pro удается гарантировать, что нередактируемые области остаются практически в качестве pixel-perfect? Ответ кроется в четырех уровнях механизмов ограничений, которые Google добавила в сценарии локального редактирования изображений AI. Это инженерное новшество — самое важное отличие версии Pro от базовой Nano Banana.

Первый уровень: жесткое ограничение Mask (маски). Это самый прямой способ: пользователь предоставляет черно-белую маску того же размера, где белые области позволяют AI генерировать новые токены, а черные — принудительно требуют копирования токенов из исходного изображения. Это эквивалентно добавлению «правила жесткого копирования» для модели во время авторегрессионной генерации. Именно здесь берет начало технология Google, обеспечивающая «pixel-perfect untouched areas» (нетронутые области с точностью до пикселя).

Второй уровень: позиционирование через Bounding Box (ограничивающую рамку). Nano Banana Pro поддерживает параметры ограничивающей рамки с координатами, нормализованными в диапазоне 0-1000. Вы можете указать модели: «редактируй только в прямоугольнике от (200, 300) до (600, 500)». Система автоматически преобразует BBox во внутреннее ограничение маски, что гораздо проще, чем рисовать её вручную.

Третий уровень: семантическое позиционирование Gemini 3. Это самый «магический» уровень. Вам достаточно просто сказать на естественном языке: «замени фон на пляж», и ядро рассуждений Gemini 3 автоматически определит, какие токены на изображении соответствуют «фону», создав неявную маску. Этот режим редактирования без маски (mask-free) покрывает «большинство сценариев редактирования», о которых заявляет Google.

Четвертый уровень: смещение в обучающих данных «не упомянуто — значит сохранено». Google использовала огромный массив парных данных «исходное изображение — отредактированное изображение», обучив модель неявному правилу: если промпт прямо не требует изменений, остальные области должны по возможности копироваться токен в токен из оригинала. Это смещение заложено в веса модели и автоматически активируется при инференсе.

Сравнение 4 механизмов ограничений

| Механизм ограничения | Уровень контроля | Затраты пользователя | Сценарии использования |

|---|---|---|---|

| Жесткая маска | Пиксельный | Нужно рисовать маску | Точное восстановление/замена |

| Bounding Box | Прямоугольная область | Только передача координат | Редактирование в заданной области |

| Семантическое позиционирование | Семантический объект | Только текстовый промпт | Большинство повседневных задач |

| Обучающее смещение | Глобальный | Не требует настройки | Работает по умолчанию везде |

Эти четыре уровня ограничений не исключают друг друга, а работают в связке. Самая строгая комбинация — «Маска + Bounding Box + семантическая инструкция», что позволяет довести опыт pixel-perfect в Nano Banana Pro до предела. Мы протестировали это на APIYI (apiyi.com) и обнаружили, что даже при использовании только семантического позиционирования и обучающего смещения большинство повседневных правок достигают согласованности, практически неотличимой для человеческого глаза.

Инженерные причины отсутствия «дрейфа» при многократном редактировании

Одним из маркетинговых преимуществ Nano Banana Pro является «отсутствие накопленной потери качества при многократном редактировании». Причин две. Во-первых, сама авторегрессионная архитектура, в отличие от диффузионных моделей, не требует многократного кодирования/декодирования VAE — преобразование токен-пиксель происходит лишь единожды, что не накапливает ошибки перекодирования. Во-вторых, жесткое ограничение маски заставляет нередактируемые области копировать исходные токены, поэтому даже при многократных итерациях практически не вносится новая случайность.

Это резко контрастирует с традиционным Stable Diffusion, который становится «мыльным» после нескольких итераций inpainting. Если ваш рабочий процесс требует 5-10 итераций редактирования одного и того же базового изображения, Nano Banana Pro — практически единственная модель, способная с этим справиться.

Gemini 3 Pro Image против GPT-Image-2: различия в подходах

Многие команды сегодня внимательно следят за развитием Gemini 3 Pro Image (Nano Banana Pro) и OpenAI GPT-Image-2. Несмотря на то что в основе обеих моделей лежит авторегрессионная архитектура, их позиционирование и возможности существенно различаются.

GPT-Image-2 делает ставку на режим «мышления» (Thinking mode) и точность рендеринга текста (официально около 99%), что делает её отличным выбором для сложных макетов с множеством объектов и длинными текстовыми вставками. В свою очередь, Nano Banana Pro опирается на мощный движок логического вывода Gemini 3, поддержку вывода в 4K, возможность объединения до 14 изображений, сохранение согласованности лиц для 5 человек и уникальную функцию Grounding with Google Search.

Ключевые различия в принципах генерации изображений Nano Banana Pro и GPT-Image-2 наглядно представлены в таблице:

| Параметр | Nano Banana Pro | GPT-Image-2 |

|---|---|---|

| Базовая модель | Gemini 3 Pro | GPT-4o (мультимодальная) |

| Улучшение вывода | Неявный логический вывод Gemini 3 | Явный режим «мышления» |

| Макс. разрешение | 4K (апскейл с 2K) | 4K (нативное) |

| Лимит входных изображений | 14 шт. | Несколько (лимит не раскрыт) |

| Согласованность лиц | До 5 человек | Высокая, лимит не раскрыт |

| Рендеринг текста | Лидер отрасли, поддержка языков | Точность 99% |

| Информация в реальном времени | ✅ Google Search Grounding | ❌ |

| Параметр Seed | ❌ Не поддерживается | Частично контролируется |

| Редактирование областей | Pixel-perfect для нетронутых зон | Многошаговое, без дрейфа |

| Цена за изображение | 2K $0.139 / 4K $0.24 | 1024 $0.211 |

Рекомендации по выбору: всё зависит от ваших задач. Если вам нужно создавать брендовые материалы, изображения товаров или сцены с несколькими персонажами, то возможности Nano Banana Pro по объединению изображений и сохранению согласованности лиц будут предпочтительнее. Если же ваш основной сценарий — это постеры с длинным текстом, сложная верстка или макеты с более чем 100 объектами, режим «мышления» в GPT-Image-2 обеспечит более стабильный результат. Мы рекомендуем использовать платформу APIYI (apiyi.com) для подключения обеих моделей и проведения A/B-тестирования на реальных задачах, чтобы принять окончательное решение.

Практическое применение Nano Banana Pro API: от масок до ограничивающих рамок

Разобравшись с принципами работы, давайте перейдем к практике — как использовать возможности локального редактирования изображений с помощью ИИ в Nano Banana Pro. Ниже приведен минимальный рабочий пример на Python для вызова Gemini 3 Pro Image через сервис-прокси APIYI:

from google import genai

from PIL import Image

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com/v1"}

)

original = Image.open("portrait.png")

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents=[

"Сохрани личность персонажа и фон без изменений, замени только белую футболку на темно-синий пиджак, сохранив направление света и тени",

original

]

)

for part in response.candidates[0].content.parts:

if part.inline_data:

with open("edited.png", "wb") as f:

f.write(part.inline_data.data)

Обратите внимание на составление промпта: явно укажите, что нужно «сохранить», что «изменить» и «оставить прежнее освещение». Это активирует семантическое позиционирование ядра логического вывода Gemini 3. Если требуется более точный контроль области, можно добавить промпт с ограничивающей рамкой (bounding box):

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents=[

"В пределах ограничивающей рамки [200, 150, 600, 700] замени одежду на темно-синий пиджак. Остальные области изображения должны остаться без изменений.",

original

]

)

Координаты задаются в нормализованном диапазоне от 0 до 1000 и масштабируются в соответствии с размером изображения. Для более строгого контроля можно передать изображение маски в качестве дополнительного входа.

5 советов по оптимизации на практике

Основываясь на принципах работы Nano Banana Pro, мы подготовили 5 рекомендаций для внедрения в рабочие процессы:

- Всегда прописывайте список того, что нужно сохранить: фразы вроде «сохранить личность, фон и освещение» — это ключ к активации четырех уровней ограничений.

- Отдавайте приоритет семантическому позиционированию: если не требуется пиксельная точность границ редактирования, режим без маски (mask-free) работает эффективнее.

- Не более 14 изображений для слияния: превышение официального лимита приведет к обрезке, что негативно скажется на согласованности лиц.

- Выбор между 2K и 4K зависит от целей: для веб-сайтов и мобильных приложений достаточно 2K ($0.139), для печати или больших экранов лучше использовать 4K ($0.24).

- Не пытайтесь использовать seed для воспроизведения: Nano Banana Pro не поддерживает seed. Для стабильного результата используйте взвешенные промпты и фиксацию эталонного изображения.

Соотношение цены и сценариев использования

| Конфигурация | Стоимость за изображение | Рекомендуемый сценарий |

|---|---|---|

| 2K (одно изображение) | $0.139 | Соцсети / веб-контент |

| 4K (одно изображение) | $0.24 | Печатная продукция / большие экраны / маркетинг |

| 4K + слияние 14 изображений | $0.24 + токены входа | Создание брендового контента с несколькими персонажами |

| 4K + Grounding | $0.24 + токены поиска | Реалистичные изображения продуктов / событий |

Для производственных задач мы рекомендуем использовать Batch API на платформе APIYI (apiyi.com). Это позволяет значительно снизить затраты при сохранении высокого качества, что идеально подходит для пакетной обработки библиотек медиафайлов.

FAQ по принципам генерации Nano Banana Pro и советы по выбору

Q1: Nano Banana Pro — это рисование или локальное редактирование?

О: На низком уровне это «авторегрессионная перерисовка всего изображения», то есть «рисование». Однако за счет четырех уровней ограничений (жесткие маски, ограничивающие рамки, семантическое позиционирование Gemini 3 и смещение при обучении) достигается эффект, максимально приближенный к «настоящему локальному редактированию». Архитектурно это перерисовка, а инженерно — фиксация областей.

Q2: Почему официально заявляется, что нередактируемые области остаются pixel-perfect?

О: В режиме маски выходные токены для черных областей принудительно приравниваются к токенам исходного изображения, поэтому после декодирования пиксели практически идентичны. Строго говоря, кодирование/декодирование VQ-VAE вносит минимальные потери, поэтому это «почти» идеально, а не математически идентично. В повседневном использовании это незаметно глазу.

Q3: Почему Nano Banana Pro не поддерживает seed?

О: Авторегрессионная генерация делает выборку из вероятностного распределения на каждом шаге, что принципиально отличается от диффузионных моделей с фиксированным начальным шумом. Google не предоставляет доступ к параметру seed, чтобы сохранить творческое разнообразие модели. Если вам нужна стабильность, используйте детальные промпты в сочетании с эталонными изображениями. Мы рекомендуем тестировать стабильность вывода разных шаблонов промптов на APIYI (apiyi.com), чтобы найти «почти детерминированные» комбинации.

Q4: Как выбрать между Nano Banana Pro и GPT-Image-2?

О: Сценарии с несколькими персонажами, брендовые материалы, необходимость актуальной информации (Grounding) — выбирайте Nano Banana Pro. Сложная верстка, постеры с длинным текстом, компоновка из 100+ объектов — выбирайте GPT-Image-2. Оба решения авторегрессионные, разница в опыте обусловлена разными подходами Google и OpenAI к инженерии ограничений.

Q5: Можно ли точно определить область редактирования без маски?

О: Да, двумя способами. Первый — использование параметра Bounding Box (нормализованные координаты 0-1000). Второй — семантическое позиционирование ядра Gemini 3: просто укажите в промпте «измени красный объект в правом нижнем углу». Второй вариант покрывает большинство сценариев, первый удобен для четко заданных прямоугольных областей.

Q6: Как на практике использовать Grounding with Google Search?

О: Четко укажите в промпте элемент, требующий проверки фактов, например: «Нарисуй новейший Tesla Cybertruck 2025 года на поверхности Луны». Модель автоматически обратится к поиску Google для получения эталонного внешнего вида, а затем перейдет к генерации. Это уникальная возможность Nano Banana Pro, которой пока нет у GPT-Image-2.

Итог: понимание инженерии ограничений — ключ к успеху с Nano Banana Pro

Nano Banana Pro — это инженерно изящный продукт. Он не изобретает новую парадигму генерации, а использует авторегрессионное ядро Gemini 3 и четыре уровня ограничений, превращая «перерисовку всего изображения» в опыт «локального редактирования».

Понимание этого разделения между «механизмом» и «пользовательским опытом» позволит вам составлять промпты, активирующие все уровни ограничений, выбирать оптимальные режимы и планировать итеративные рабочие процессы. Суть принципов генерации Nano Banana Pro заключается не в «черной магии», а в комплексном подходе к инженерии ограничений.

Мы рекомендуем проводить практическое тестирование и сравнение на платформе APIYI (apiyi.com). Платформа поддерживает единый интерфейс для вызова Nano Banana Pro, GPT-Image-2, Stable Diffusion и других популярных моделей, что позволяет быстро проверять описанные принципы и оптимизации для поиска лучшего решения под ваши задачи.

Статья подготовлена командой APIYI на основе официальных материалов Google DeepMind, Vertex AI и результатов практических тестов. Для использования Gemini 3 Pro Image (Nano Banana Pro) в продакшене посетите официальный сайт APIYI: apiyi.com для получения документации.