Google DeepMind 在 2025 年 11 月 20 日发布 Nano Banana Pro 时,反复强调一句话:"untouched areas remain pixel-perfect — no generation drift, no quality loss across iterative edits"。如果你按字面理解,这意味着 AI 已经实现了"Photoshop 式真局部修改"。但如果你了解 Gemini 3 Pro Image 的架构,又会发现它本质上是自回归 Transformer 整图重绘——和文字模型预测下一个 token 是同一套机制。

这两件事是怎么同时成立的?Nano Banana Pro 图片生成原理 到底是在重绘整张图,还是在做真正的局部修改?本文将从 Gemini 3 推理骨干、视觉 token 自回归、Mask 硬约束、Bounding Box 语义定位四个层面深入拆解,给出工程师真正能用得上的原理认知。

| 核心问题 | 直觉答案 | 真相 |

|---|---|---|

| 是 PS 局部修改吗? | 是 | 否,底层仍是整图 token 重绘 |

| 那为何 pixel-perfect? | 模型很聪明 | Mask + 语义定位 + BBox 三层硬约束 |

| 与 GPT-Image-2 同源吗? | 类似 | 都是自回归,但 Gemini 3 多了显式推理 |

| 多轮编辑会漂移吗? | 会 | 几乎不会,这是 Pro 的核心卖点 |

理解了这套底层逻辑,你才能写出真正激活 Gemini 3 推理的 prompt、合理选择 mask 模式、避开"看似局部其实重绘"陷阱。我们建议读者结合 API易 apiyi.com 平台上的 Nano Banana Pro 接口边读边测,把每一条原理映射到实际效果。

Nano Banana Pro 图片生成原理:整图重绘还是真局部修改?

回答这个问题之前,先要分清两件容易混淆的事:生成机制 和 使用体验。

从生成机制看,Nano Banana Pro 和它的前辈 Nano Banana、以及 OpenAI 的 GPT-Image-2 走的是同一条路线——自回归 Transformer 整图 token 重绘。换句话说,即便你只让 AI 改一个人的领带颜色,模型内部仍然要把整张图压缩成视觉 token,然后从头到尾重新预测一遍输出 token 序列,最后解码回像素。没有"只动一小块像素、其余不动"的物理路径。

但从使用体验看,Nano Banana Pro 给到用户的是一种"近真局部修改"的感觉。Google 官方明确宣称:在 mask 模式或语义化定位下,未编辑区域几乎保留到像素级别,无生成漂移,多轮编辑无质量损失。这种体验是怎么从"整图重绘"的底层架构里挤出来的?

答案是:约束工程 (constraint engineering)。Google 在自回归生成流程上叠加了三层硬约束:Mask token 锁定、Bounding Box 区域指定、Gemini 3 语义级"保留清单"。这三层约束让模型在重绘时"主动选择"复现原图未编辑区域的 token。这就是 Nano Banana Pro 工程团队真正的功夫所在。

重绘逻辑与局部修改体验的关系

| 视角 | 真实情况 | 用户感受 |

|---|---|---|

| 底层架构 | 整图 token 重绘 | 看起来像局部修改 |

| 未编辑区域 | 重新生成的 token | 几乎等于原图像素 |

| 编辑边界 | 自回归连续生成 | 自然过渡无 artifact |

| 编辑指令 | 通过约束传入 | 自动匹配光影/视角 |

理解这层"机制-体验"分离,你就能解释为什么有时 Nano Banana Pro 编辑后图片的非编辑区域会出现极轻微变化——那是 token 重绘的必然代价,但 Google 通过约束让这种变化压到了肉眼几乎不可察觉的程度。我们建议在 API易 apiyi.com 上调用 Nano Banana Pro 反复编辑同一张图,观察细节漂移幅度,这种对比能让原理认知落地。

Nano Banana Pro 实现原理:Gemini 3 Pro Image 的自回归骨干

要深入理解 Nano Banana Pro 实现原理,绕不开它的官方名称——Gemini 3 Pro Image。这个名字暴露了它的两个核心血统:Gemini 3 推理骨干 和 图像生成解码器。

Gemini 3 是 Google 在 Nano Banana Pro 发布前两天才推出的旗舰多模态语言模型,以"推理能力"著称。Nano Banana Pro 直接复用了 Gemini 3 Pro 的 Transformer 主干,只是在词表里增加了视觉 token,在输出侧接了图像解码器。换句话说,它不是一个独立的图像模型,而是 Gemini 3 多模态家族中专门生成图像的形态。

这带来一个根本性变化:Nano Banana Pro 在真正画第一个像素之前,会先用 Gemini 3 推理出"该画什么"。Google 官方原话是"functions less like a traditional diffusion model and more like a digital art director"——它先分析 prompt 的语义逻辑、物理因果、空间关系,然后才进入视觉 token 生成阶段。

具体的工作流程可以拆成五个阶段:

- 多模态输入解析:Gemini 3 推理骨干同时摄入用户的文本 prompt 和最多 14 张参考图,理解整个任务上下文。

- 结构化推理 (内部蓝图):模型先在内部"想清楚"画面的空间布局、人物身份、光照设置、需要保留与修改的部分,生成一份不可见的"创作蓝图"。

- 原图视觉 token 编码:参考图通过类似 VQ-VAE 的离散化机制压缩成视觉 token 序列。

- 自回归 Token 预测:在 Gemini 3 主干的注意力机制下,模型从左到右逐一预测输出图的每个视觉 token,每步都能"看到"完整的 prompt token 和原图 token。

- 解码与升采样:输出 token 通过 16 位色深解码器还原成原生 2K 图像,再智能升采样至 4K。

Gemini 3 推理骨干的两大独特能力

第一是 "先思考再绘制"。这不是一个噱头——Gemini 3 在文本任务上的推理能力会直接迁移到图像生成。给它一个复杂指令"把这个人的衣服换成符合他职业身份的着装",普通图像模型会蒙圈,Nano Banana Pro 会先推理"这个人看起来是医生 → 应该是白大褂",再去画。

第二是 Grounding with Google Search。Nano Banana Pro 可以在生成过程中调用 Google 搜索工具验证事实——比如让它画一张"某品牌最新发布的产品",它能联网获取真实外观参考。这是目前唯一支持原生搜索 grounding 的图像生成模型,也是 Nano Banana Pro 和 GPT-Image-2 最大的差异化能力之一。如果你需要在生产环境测试 Grounding 能力,可以通过 API易 apiyi.com 接入 Nano Banana Pro,该平台提供与 Google 官方一致的接口规范。

值得一提的是,Nano Banana Pro 不支持 seed 参数。因为它是自回归生成,每一步采样都从概率分布中取样 (受 temperature 和 top-k 控制),不像扩散模型那样可以通过固定初始噪声完全复现结果。这个特性既是约束也是设计选择,让模型保持创造性。

AI 图片局部编辑的 4 大约束机制:Pixel-Perfect 如何炼成

既然底层是整图重绘,Nano Banana Pro 凭什么保证未编辑区域接近 pixel-perfect?答案是 Google 在 AI 图片局部编辑 场景叠加了四层约束机制。这是 Pro 版本相比基础版 Nano Banana 最值得拆解的工程创新。

第一层:Mask 硬约束。这是最直接的方式——用户提供一张同尺寸的黑白 mask 图,白色区域允许 AI 生成新 token,黑色区域强制要求输出 token 必须复制原图对应位置的 token。这相当于在自回归生成时给模型加了一个"硬复制规则"。这就是 Google 所谓 "pixel-perfect untouched areas" 的核心技术来源。

第二层:Bounding Box 区域定位。Nano Banana Pro 支持坐标归一化到 0-1000 范围的 bounding box 参数,你可以告诉模型"只在 (200, 300) 到 (600, 500) 这个矩形区域内修改"。系统会自动把 BBox 转换成内部 mask 约束,但比手动绘制 mask 更轻便。

第三层:Gemini 3 语义化定位。这是最"魔法"的一层。你只需要用自然语言说"把背景换成沙滩",Gemini 3 推理骨干就能自动识别"背景"是图中哪些 token,生成隐式 mask。这种 mask-free 编辑模式覆盖了 Google 官方所说的"大多数编辑场景"。

第四层:训练数据的"未提及即保留"偏置。Google 用了海量"原图-编辑图"配对数据,在训练中让模型学到一条隐性规则:除非 prompt 明确要求改,否则其他区域要尽量逐 token 复制原图。这条偏置固化在权重中,推理时自动生效。

4 大约束机制对比

| 约束机制 | 控制粒度 | 用户成本 | 适用场景 |

|---|---|---|---|

| Mask 硬约束 | 像素级 | 需绘制 mask | 精准修复/抠图替换 |

| Bounding Box | 矩形区域 | 仅传坐标 | 已知矩形区域的编辑 |

| 语义化定位 | 语义对象 | 仅文本指令 | 大多数日常编辑 |

| 训练偏置 | 全局 | 无需配置 | 所有场景默认生效 |

四层约束不是互斥关系,而是叠加生效。最严格的组合是"Mask + Bounding Box + 语义指令",这能把 Nano Banana Pro 的 pixel-perfect 体验逼到极致。我们在 API易 apiyi.com 上测试发现,即使只用语义定位 + 训练偏置,也能让大多数日常编辑达到肉眼几乎不可分辨的一致性。

多轮编辑不漂移的工程原因

Nano Banana Pro 营销重点之一是"多轮编辑无累积质量损失"。原因有两个。一是自回归架构本身不像扩散模型那样需要 VAE 反复编解码,只有一次 token-pixel 的转换,不会累积重编码误差。二是 mask 硬约束让未编辑区域逐 token 复制原图,即便多次迭代也几乎不引入新的随机性。

这与传统 Stable Diffusion 反复 inpainting 几次就会"糊"形成鲜明对比。如果你的工作流需要在同一张基础图上做 5-10 轮迭代编辑,Nano Banana Pro 几乎是目前唯一能扛住的模型。

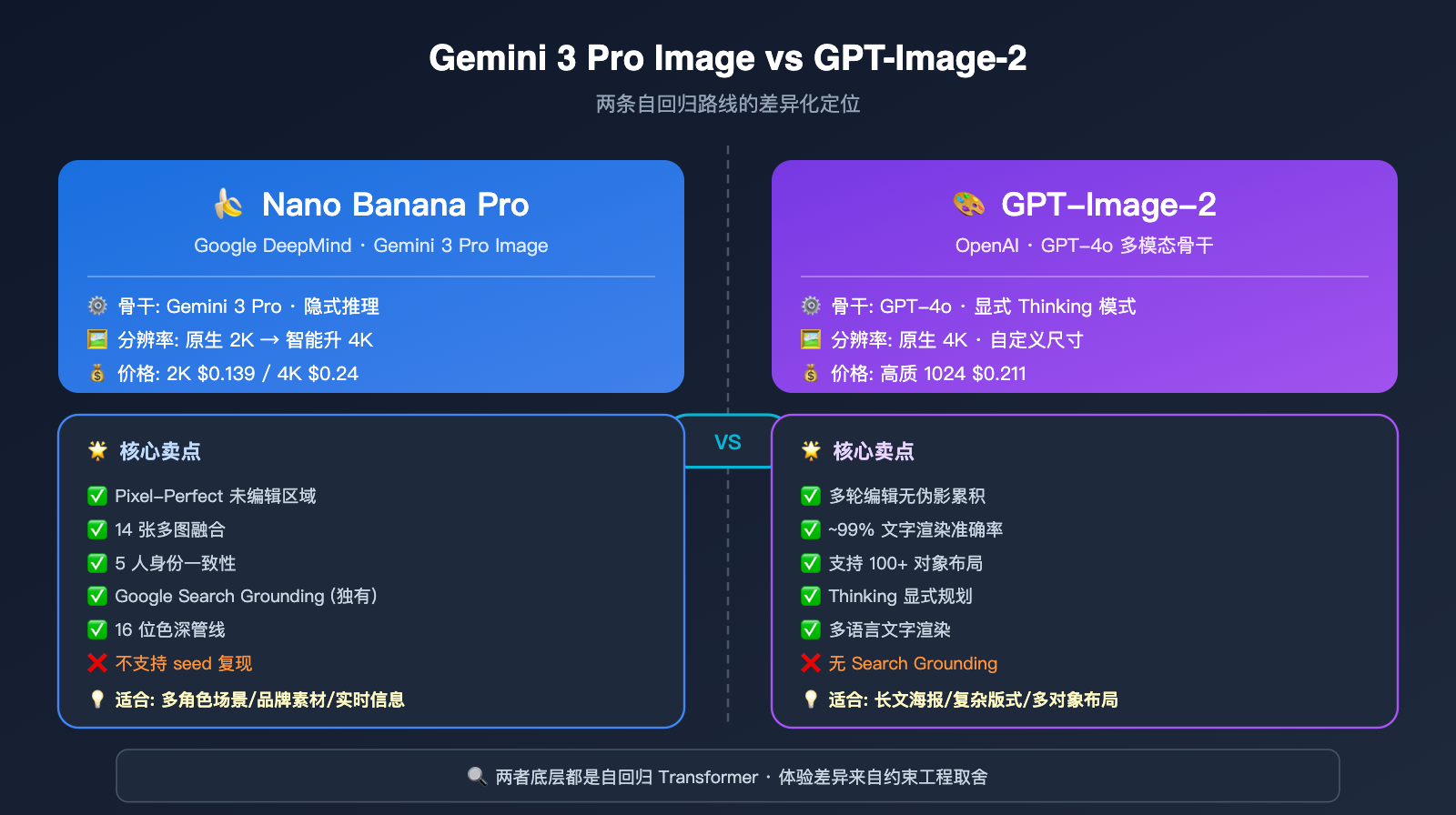

Gemini 3 Pro Image vs GPT-Image-2:两条路线的差异化

很多团队会同时关注 Gemini 3 Pro Image (Nano Banana Pro) 和 OpenAI 的 GPT-Image-2,两者底层都是自回归,但定位和能力上各有侧重。

GPT-Image-2 强调"Thinking 模式"和文字渲染准确率 (官方约 99%),擅长多对象布局和大文本场景。Nano Banana Pro 则把宝压在 Gemini 3 推理骨干、4K 输出、14 张多图融合、5 人身份保持,以及独有的 Grounding with Google Search。

两者在 Nano Banana Pro 图片生成原理 与 GPT-Image-2 实现路径上的关键差异,可以一张表看清:

| 维度 | Nano Banana Pro | GPT-Image-2 |

|---|---|---|

| 底层模型 | Gemini 3 Pro | GPT-4o 多模态 |

| 推理增强 | Gemini 3 隐式推理 | 显式 Thinking 模式 |

| 最高分辨率 | 4K (从 2K 升采样) | 4K 原生 |

| 多图输入上限 | 14 张 | 多张 (未公开上限) |

| 人物一致性 | 最多 5 人同时 | 强,未公开人数上限 |

| 文字渲染 | 行业领先,多语言 | 99% 准确率 |

| 实时信息 | ✅ Google Search Grounding | ❌ |

| Seed 参数 | ❌ 不支持 | 部分受控 |

| 局部编辑卖点 | Pixel-perfect 未编辑区域 | 多轮无漂移 |

| 单图定价 | 2K $0.139 / 4K $0.24 | 高质 1024 $0.211 |

选型建议 主要看两点:如果你需要做品牌素材、产品图、多角色场景合成,Nano Banana Pro 的多图融合和人物一致性更适合;如果你的核心场景是长文本海报、复杂版式、100+ 对象布局,GPT-Image-2 的 Thinking 模式可能更稳。我们建议通过 API易 apiyi.com 平台同时接入两个模型,基于实际场景小批量 A/B 测试再决定主用模型。

Nano Banana Pro API 实战:从 mask 到 bounding box 全场景

理解原理后,我们来看怎么把 Nano Banana Pro 的 AI 图片局部编辑 能力用到实战。下面是最小可运行的 Python 示例,通过 API易兼容端点调用 Gemini 3 Pro Image:

from google import genai

from PIL import Image

client = genai.Client(

api_key="your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com/v1"}

)

original = Image.open("portrait.png")

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents=[

"保持人物身份与背景不变,仅将上衣由白色 T 恤换成深蓝色西装外套,保持原有光照与阴影方向",

original

]

)

for part in response.candidates[0].content.parts:

if part.inline_data:

with open("edited.png", "wb") as f:

f.write(part.inline_data.data)

注意 prompt 写法:显式声明"保持什么不变"、"修改什么"、"保留原有光照",这能直接激活 Gemini 3 推理骨干的语义化定位能力。如果需要更精准的区域控制,可以加入 bounding box 提示:

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents=[

"在图像的 bounding box [200, 150, 600, 700] 范围内,将服装替换为深蓝色西装外套。其余区域保持原图像素不变。",

original

]

)

坐标采用 0-1000 归一化范围,实际处理时按图像尺寸映射。需要更严格控制时可以追加 mask 图像作为输入。

实战优化的 5 条经验

针对 Nano Banana Pro 实现原理 在工程中的落地,我们总结 5 条建议:

- prompt 永远写明保留清单:"保持人物身份、背景、光照不变" 是激活四层约束的钥匙。

- 优先使用语义化定位:除非编辑边界要求像素级精准,否则 mask-free 模式效率更高。

- 多图融合不超过 14 张:超出官方上限会被截断,影响多图一致性。

- 2K 与 4K 选型按用途:网页/移动展示用 2K ($0.139) 足够,印刷或大屏展示再用 4K ($0.24)。

- 不要尝试用 seed 复现:Nano Banana Pro 不支持 seed,需要稳定复现请改用 prompt 加权和参考图固定。

价格与场景匹配

| 配置 | 单图成本 | 推荐场景 |

|---|---|---|

| 2K 单图 | $0.139 | 社交媒体/网页配图 |

| 4K 单图 | $0.24 | 印刷品/大屏展示/营销主视觉 |

| 4K + 14 图融合 | $0.24 + 多输入 token | 品牌多角色场景合成 |

| 4K + Grounding | $0.24 + 搜索 token | 真实产品/事件配图 |

我们建议在生产环境用 API易 apiyi.com 的 Batch API 处理批量任务,可在保持质量的前提下显著降低成本,适合素材库批量制作场景。

Nano Banana Pro 图片生成原理 FAQ 与决策建议

Q1: Nano Banana Pro 到底是绘制还是局部修改?

A: 底层是【自回归整图 token 重绘】,即"绘制"。但通过 Mask 硬约束、Bounding Box、Gemini 3 语义定位、训练偏置四层约束,实现了使用体验上接近"真局部修改"的效果。两件事并不矛盾——架构在重绘,工程在锁定。

Q2: 为什么官方说未编辑区域 pixel-perfect?

A: 在 mask 模式下,黑色区域的输出 token 被强制要求等于原图对应位置的 token,解码后像素几乎相同。但严格来说,VQ-VAE 编解码有微小损失,所以是"接近"像素完美,而非数学意义上的完全相同。日常使用肉眼不可分辨。

Q3: 为什么 Nano Banana Pro 不支持 seed?

A: 自回归生成每一步从概率分布采样,与扩散模型固定初始噪声的机制完全不同。Google 选择不暴露 seed 参数,让模型保持创造性多样性。如果你需要稳定复现结果,请使用详细的 prompt + 参考图组合。我们建议在 API易 apiyi.com 上测试不同 prompt 模板的输出稳定性,找到适合自己工作流的"近确定性"组合。

Q4: Nano Banana Pro 和 GPT-Image-2 该怎么选?

A: 多角色场景、品牌素材、需要实时信息 (Grounding) → 选 Nano Banana Pro;复杂版式、长文本海报、100+ 对象布局 → 选 GPT-Image-2。两者底层都是自回归,体验差异主要来自 Google 与 OpenAI 不同的约束工程取舍。

Q5: 我能在没有 mask 的情况下精准定位编辑区域吗?

A: 可以,有两种方式。一是用 Bounding Box 参数 (0-1000 归一化坐标);二是依赖 Gemini 3 推理骨干的语义化定位,只需在 prompt 里说"修改图中右下角的红色物体即可"。后者覆盖大多数场景,前者用于明确矩形区域。

Q6: Grounding with Google Search 实际怎么用?

A: 在 prompt 中明确需要事实查证的元素,如"画一张特斯拉 2025 年最新 Cybertruck 在月球表面的图",模型会自动调用 Google 搜索获取真实外观参考,再进入生成阶段。这是 Nano Banana Pro 独有能力,GPT-Image-2 暂无对应功能。

总结:理解约束工程,才能用好 Nano Banana Pro

Nano Banana Pro 是一个工程上极其精巧的产品。它没有发明新的图像生成范式,而是在 Gemini 3 自回归骨干之上,通过 Mask 硬约束、Bounding Box、语义化定位、训练偏置四层约束工程,把"整图重绘"的底层架构包装成了"接近真局部修改"的产品体验。

理解这层"机制与体验分离"的认知,才能精准写出激活四层约束的 prompt、合理选择编辑模式、规划多轮迭代工作流。Nano Banana Pro 图片生成原理 的核心不是某项黑科技,而是约束工程的全栈协同。

我们建议通过 API易 apiyi.com 平台进行实际测试与对比,该平台支持 Nano Banana Pro、GPT-Image-2、Stable Diffusion 等多种主流模型的统一接口调用,便于快速验证本文提到的所有原理与优化技巧,从而为生产场景找到最优选型。

本文由 APIYI Team 撰写,基于 Google DeepMind、Vertex AI 等官方资料与一线实测整理。如需在生产环境调用 Gemini 3 Pro Image (Nano Banana Pro),可访问 API易官网: apiyi.com 获取接入文档。