Na madrugada de 7 de abril de 2026, o ranking Video Arena da Artificial Analysis foi surpreendido por um nome que ninguém conhecia: HappyHorse-1.0. Ele conquistou o primeiro lugar em três dos quatro rankings principais e o segundo lugar no outro, deixando o antigo "líder", Seedance 2.0 da ByteDance, para trás com uma diferença de 60 pontos no Elo. No entanto, em menos de 72 horas, o modelo desapareceu do ranking e, até hoje, nenhuma equipe assumiu a autoria. Este artigo analisa rapidamente o impacto desse evento no campo da geração de vídeos por IA.

Valor central: Entenda em 3 minutos as informações principais, os avanços de capacidade, as especulações sobre a origem do HappyHorse-1.0 e o que ele significa para o cenário atual de geração de vídeo por IA.

Visão geral do HappyHorse-1.0

O HappyHorse-1.0 é um modelo de geração de vídeo que surgiu no Video Arena da Artificial Analysis via "submissão anônima". Ele não possui GitHub público, pesos oficiais no HuggingFace ou API acessível, mas seu desempenho nos quatro rankings principais superou todos os modelos públicos — incluindo o Seedance 2.0 da ByteDance, o Veo do Google e o Sora da OpenAI.

| Item | Detalhes |

|---|---|

| Nome do modelo | HappyHorse-1.0 (inclui variante V2) |

| Data de surgimento | Madrugada de 7 de abril de 2026 |

| Plataforma de ranking | Artificial Analysis Video Arena |

| Método de submissão | Anônimo (pseudonymous) |

| Escala do modelo | Aprox. 15B de parâmetros |

| Arquitetura | Transformer de fluxo único com 40 camadas (Self-Attention) |

| Modalidades combinadas | Pré-treinamento conjunto de texto / vídeo / áudio |

| Status público | ❌ Sem código-fonte · Sem pesos · Sem API |

| Especulação de origem | Alibaba Tongyi Lab (Wan 2.7?) |

| Status atual | Removido do ranking |

💡 Entendimento rápido: O HappyHorse-1.0 não é um "produto", mas sim um "teste de capacidade anônimo". Esse paradigma de lançamento, que consiste em "submeter anonimamente para ranquear e depois revelar a autoria", tem aparecido frequentemente no último ano no LMArena, Image Arena e Code Arena, quase sempre com uma grande empresa de modelos por trás. Se você deseja comparar e experimentar os modelos de geração de vídeo já disponíveis, pode acessar rapidamente os principais candidatos através da plataforma APIYI (apiyi.com).

Desempenho do HappyHorse-1.0 no Ranking Arena

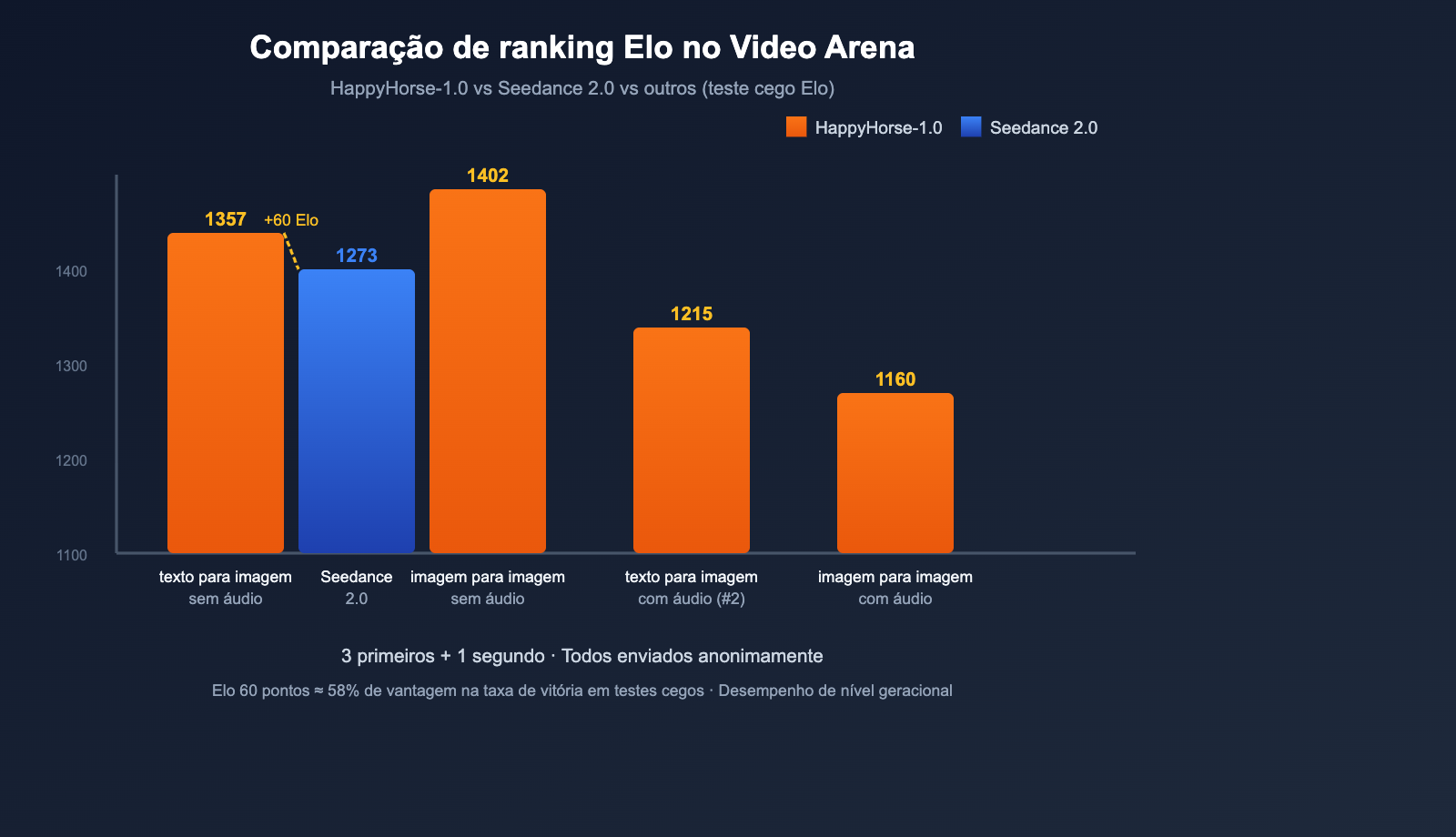

O Artificial Analysis é atualmente um dos rankings de teste cego mais respeitados no campo da geração de vídeo por IA. Ele utiliza pontuação Elo + votos cegos de usuários, evitando o viés de autoavaliação dos fabricantes. Os resultados do HappyHorse-1.0 quando entrou no ranking em 7 de abril foram:

| Categoria do Ranking | Elo do HappyHorse-1.0 | Posição | Anteriormente em 1º |

|---|---|---|---|

| Texto para vídeo (sem áudio) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| Imagem para vídeo (sem áudio) | 1392-1402 | 🥇 #1 | — |

| Texto para vídeo (com áudio) | 1205-1215 | 🥈 #2 | — |

| Imagem para vídeo (com áudio) | 1160 | 🥇 #1 | — |

O impacto mais significativo está na categoria Texto para vídeo sem áudio: o HappyHorse-1.0 estreou superando o antigo líder, o Seedance 2.0 da ByteDance, por 60 pontos Elo. No sistema de pontuação Elo, 60 pontos representam uma vantagem de vitória de aproximadamente 58%, o que é uma diferença técnica considerável.

Especulações sobre a arquitetura técnica do HappyHorse-1.0

Embora não haja um artigo oficial, a página de lançamento do HappyHorse-1.0 e análises de terceiros, como a WaveSpeedAI, revelaram muitos detalhes arquiteturais. Se confirmados, seria a primeira vez que a comunidade open-source completa um "pré-treinamento conjunto de áudio e vídeo de ponta a ponta".

Transformer de fluxo único unificado

O HappyHorse-1.0 utiliza um Transformer de Self-Attention de 40 camadas, que agrupa tokens de texto, latentes de imagem de referência, tokens de vídeo com ruído e tokens de áudio com ruído em uma única sequência para desruído conjunto. Isso é bem diferente da abordagem atual de "torre dupla + Cross-Attention" (como no Sora ou Seedance):

- 4 camadas no início e no fim: utilizam projeções específicas de modalidade para processar entradas e saídas.

- 32 camadas centrais: parâmetros totalmente compartilhados, tratando todas as modalidades de forma igualitária.

- Sem Cross-Attention: todas as modalidades interagem dentro do mesmo mecanismo de atenção.

Essa abordagem de "fluxo único com Self-Attention total" é o paradigma que o GPT-4o e o Gemini 2.x têm explorado no campo multimodal, mas é a primeira vez que aparece no domínio de geração de vídeo com a proposta de "código aberto + desempenho de elite".

Geração conjunta de áudio e vídeo

O HappyHorse-1.0 afirma suportar a geração simultânea de vídeo + diálogo + som ambiente + efeitos sonoros Foley em uma única inferência, cobrindo 6 idiomas (chinês, inglês, japonês, coreano, alemão e francês). Sites secundários também alegam incluir cantonês e "sincronia labial com baixíssima taxa de erro de palavras (WER)".

Se todos esses indicadores forem verdadeiros, a liderança do HappyHorse-1.0 na dimensão de "pré-treinamento de áudio e vídeo de ponta a ponta" pode ser ainda maior do que o ranking sugere.

Velocidade de inferência

| Configuração | Tempo |

|---|---|

| Vídeo de 5s 256p | ~2 segundos |

| Vídeo de 5s 1080p (H100) | ~38 segundos |

Se confirmado, essa velocidade é bastante agressiva para um modelo de vídeo na casa dos 15B de parâmetros, aproximando-se do limite da geração em tempo real.

Especulações sobre a origem do HappyHorse-1.0

O envio anônimo significa que a Artificial Analysis só pôde descrever este modelo como "pseudônimo" ao publicá-lo. No entanto, a comunidade conseguiu extrair algumas teorias principais a partir de pistas sutis.

Hipótese 1: Alibaba Tongyi Lab (Wan 2.7)

Esta é a teoria com maior força na comunidade atualmente, por quatro motivos:

- Coincidência temporal: Após o HappyHorse-1.0 alcançar o topo em 7 de abril, o Alibaba Tongyi Lab lançou o Wan 2.6 no início de abril, e a indústria esperava amplamente que a próxima geração, Wan 2.7, estivesse a caminho.

- Reação do mercado de capitais: As ações do Alibaba na bolsa de Hong Kong subiram quase 8% após o HappyHorse aparecer no ranking; o mercado claramente o associou à empresa.

- Capacidade multilíngue CJK: O modelo possui um suporte extremamente forte para chinês, japonês e coreano, uma característica típica de equipes chinesas/do Leste Asiático.

- Estilo de lançamento anônimo: O Alibaba já adotou anteriormente o ritmo de "lançamento restrito seguido de anúncio oficial" com as séries Qwen / Wan.

No entanto, a empresa ainda não confirmou nada, e o Wan 2.7 lançado oficialmente pelo Alibaba Tongyi Lab em abril não apresenta exatamente o mesmo desempenho que o HappyHorse em algumas demonstrações públicas, portanto, esta teoria ainda não foi comprovada.

Hipótese 2: ByteDance / Outras grandes empresas

Algumas vozes sugerem que o HappyHorse poderia ser uma variante da próxima geração da série Seedance da ByteDance, já que o Seedance 2.0 foi o modelo superado por ele, e a ByteDance teria motivos para testar o Seedance 3.0 anonimamente. Mas, até agora, não há nenhuma evidência que sustente isso.

Hipótese 3: Uma nova equipe independente chinesa

Há também quem especule que o HappyHorse venha de uma startup chinesa nova e ainda não notada pelo mercado, já que a pilha tecnológica exibida pelo modelo — "15B + Self-Attention total + união de áudio e vídeo" — é muito agressiva, parecendo mais o trabalho de uma pequena equipe "sem amarras".

🎯 Olhar crítico: Até que haja um anúncio oficial, todas as afirmações de que "é o Alibaba", "é a ByteDance" ou "é algum unicórnio" são apenas especulações. O que vale a pena observarmos não é "quem ele é", mas sim "onde o limite de capacidade chegou" e quais modelos de vídeo abertos podemos usar hoje para construir aplicações reais. Se você precisa integrar modelos de vídeo populares para validar seu produto, pode usar o APIYI (apiyi.com) para invocar diversos modelos disponíveis em um só lugar.

As 72 horas de desaparecimento misterioso do HappyHorse-1.0

O mais dramático foi o "desaparecimento" do HappyHorse-1.0. Menos de 72 horas após atingir o topo do ranking da Artificial Analysis na madrugada de 7 de abril, a série de modelos HappyHorse foi subitamente removida da lista, deixando apenas:

- Algumas capturas de tela circulando nas redes sociais.

- Uma página de destino oficial criptografada (alegando que "GitHub / HuggingFace abrirão em breve", mas os links não funcionam).

- Uma nota oficial da própria Artificial Analysis confirmando a "retirada".

Esse roteiro de "aparecer no ranking → desaparecer" já aconteceu várias vezes no LMArena: versões anônimas iniciais do GPT-4 Turbo, a prévia do Claude 3.5 Sonnet e variantes iniciais do Gemini 2.0 Flash seguiram fluxos semelhantes. Quase sempre, após o desaparecimento de um modelo anônimo, um lançamento oficial ocorre em um período de 3 a 8 semanas.

A interpretação da indústria sobre o HappyHorse é praticamente unânime: trata-se de uma equipe de ponta coletando dados reais de preferência dos usuários para preparar o lançamento oficial.

title: "O impacto do HappyHorse-1.0 na indústria de geração de vídeo por IA"

O impacto do HappyHorse-1.0 na indústria de geração de vídeo por IA

Mesmo que o HappyHorse-1.0 não tenha sido lançado publicamente, ele já causou um impacto real em todo o setor de geração de vídeo por IA.

Impacto nos principais players

- A "zona de conforto" do Seedance 2.0, Veo 3 e Sora 2 foi quebrada: A diferença de 60 pontos no Elo mostra que o limite de capacidade da geração de vídeo ainda está longe de ser atingido.

- A geração conjunta de áudio e vídeo tornou-se o novo campo de batalha: O HappyHorse conquistou o primeiro lugar em 3 das 4 categorias, com destaque para a categoria de áudio, o que forçará todos os grandes players a acelerar a rota de pré-treinamento de áudio e vídeo.

- Pressão por código aberto/semiaberto: O HappyHorse afirma que "tudo é aberto" (embora ainda não tenha sido liberado), o que aumenta a pressão sobre produtos de código fechado como o Sora.

Impacto em desenvolvedores e criadores

- Expectativas de capacidade renovadas: Com 1080p / H100 / 38 segundos, essa relação custo-benefício faz com que a "geração de vídeo em tempo real" deixe de ser ficção científica.

- Multilinguismo + sincronia labial: A geração de áudio e vídeo ponta a ponta em 6 idiomas (chinês, inglês, japonês, coreano, alemão e francês) é uma grande vantagem para curtas-metragens, publicidade e vídeos educacionais.

- Caminho pragmático inalterado: Até que o HappyHorse seja realmente aberto, dominar modelos já disponíveis como Veo 3, Sora 2, Kling 2 e Wan 2.6 continua sendo o melhor caminho para construir produtos reais, podendo ser acessados via APIYI (apiyi.com).

Impacto nas equipes de IA chinesas

Se for confirmado que o HappyHorse é um projeto da Alibaba ou de outra equipe chinesa, esta será a primeira vez que a geração de vídeo por IA da China conquista três primeiros lugares em um ranking de testes cegos em inglês sem viés regional, como o Artificial Analysis. Esse significado vai muito além do modelo em si.

Perguntas frequentes sobre o HappyHorse-1.0

Q1: O HappyHorse-1.0 já pode ser usado?

Não. Ele apareceu brevemente por cerca de 72 horas na Arena de testes cegos do Artificial Analysis, sem API pública, sem pesos para download e sem GitHub acessível. Se você precisa invocar modelos de geração de vídeo de ponta agora, pode acessar modelos como Veo 3, Sora 2, Kling 2 e Wan 2.6 via APIYI (apiyi.com).

Q2: O HappyHorse-1.0 é realmente o Wan 2.7 da Alibaba?

Atualmente, não há confirmação oficial. A comunidade tem quatro motivos para especular (coincidência de tempo, alta das ações da Alibaba, capacidade multilíngue CJK, estilo histórico de lançamento da Alibaba), mas as demonstrações do Wan 2.7 após seu lançamento oficial em abril não são totalmente consistentes com o HappyHorse. Portanto, o mais preciso é dizer: a probabilidade é alta, mas não foi confirmada.

Q3: O que significa a liderança de 60 pontos no Elo?

No sistema de pontuação Elo, uma liderança de 60 pontos corresponde aproximadamente a uma taxa de vitória de 58% em testes cegos. É uma diferença muito significativa, mas ainda superável. Como referência, no último ano, as trocas de posição entre Sora, Veo, Kling e Seedance geralmente ficaram dentro de 20 a 40 pontos. O HappyHorse chegar com 60 pontos de vantagem é, de fato, um desempenho de nível geracional.

Q4: Quão agressiva é a arquitetura de “15B de parâmetros + Self-Attention de fluxo único”?

Muito agressiva. Os modelos de vídeo atuais geralmente adotam rotas híbridas como "torre dupla + Cross-Attention" ou "DiT + projeção multimodal". O HappyHorse coloca áudio, vídeo e texto em um Transformer de 40 camadas com parâmetros compartilhados. Esta é a mesma rota técnica que o GPT-4o e o Gemini 2.x estão tentando na direção multimodal, mas é a primeira vez que é validada com desempenho de elite no campo da geração de vídeo.

Q5: Por que ele desapareceu após 72 horas no ranking?

Este é um "padrão de coleta de dados" comum para modelos anônimos. Versões iniciais do GPT-4 Turbo, a prévia do Claude 3.5 Sonnet e variantes iniciais do Gemini 2.0 Flash no LMArena seguiram o mesmo processo: lançamento → coleta de dados de preferência real → retirada → lançamento oficial algumas semanas depois. Espera-se que o HappyHorse retorne com um nome oficial dentro de 3 a 8 semanas.

Q6: Que modelos de vídeo posso usar para substituir o HappyHorse agora?

Atualmente, os candidatos mais fortes e já disponíveis incluem: Google Veo 3 (primeiro escalão em qualidade geral), OpenAI Sora 2 (forte em linguagem cinematográfica), Kling 2 (bom em retratos/ações), ByteDance Seedance 2.0 (forte em cenários chineses) e Alibaba Wan 2.6 (código aberto + fácil implantação). Se você precisa usar uma interface unificada para invocar esses modelos e realizar testes comparativos, pode acessar a plataforma APIYI (apiyi.com) para evitar alternar entre várias contas.

Resumo

O HappyHorse-1.0 foi a "chegada surpresa" mais dramática no campo da geração de vídeo por IA em abril de 2026. Ele representa três pontos fundamentais:

- O limite superior da capacidade de geração de vídeo foi elevado novamente: Uma liderança de 60 pontos no Elo e 3 vitórias e 1 segundo lugar em 4 categorias mostram que os "modelos de vídeo mais fortes" que vemos hoje ainda estão longe do seu teto.

- A geração conjunta de áudio e vídeo torna-se o novo campo de batalha: O desempenho robusto do HappyHorse em categorias que incluem áudio impulsionará toda a indústria a colocar o pré-treinamento de áudio-vídeo de ponta a ponta na agenda.

- Anônimo → Retirada → Lançamento oficial torna-se o padrão de lançamento para modelos emblemáticos: Espera-se que, dentro de 3 a 8 semanas, um fabricante que conhecemos bem assuma a autoria do modelo.

🚀 Sugestão de ação: Antes que o HappyHorse seja realmente aberto, a coisa mais pragmática a se fazer não é adivinhar sua origem, mas dominar os modelos de vídeo de ponta que já estão disponíveis. Veo 3, Sora 2, Kling 2, Seedance 2.0 e Wan 2.6 podem cobrir 90% dos cenários de produção reais. Recomendamos acessar os principais modelos de vídeo através do APIYI (apiyi.com) com uma única integração, pagando pelo uso e alternando entre eles conforme necessário, para que você possa migrar perfeitamente assim que o HappyHorse / Wan 2.7 for lançado oficialmente.

Autor: Equipe APIYI — Focada em fornecer acesso estável aos principais Modelos de Linguagem Grande de IA para desenvolvedores. Acesse apiyi.com para saber mais.

Referências

-

Blog da WaveSpeedAI – O que é o HappyHorse-1.0

- Link:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - Descrição: Análise profunda de terceiros sobre arquitetura, parâmetros e velocidade de inferência.

- Link:

-

Artificial Analysis – Ranking da Arena de Vídeo

- Link:

artificialanalysis.ai/video/leaderboard/text-to-video - Descrição: Ranking original das categorias de texto para imagem e imagem para imagem.

- Link:

-

Phemex News – HappyHorse lidera os rankings

- Link:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - Descrição: Dados comparativos entre o HappyHorse e o Seedance 2.0.

- Link:

-

36Kr – O misterioso modelo HappyHorse

- Link:

eu.36kr.com/en/p/3757826958635781 - Descrição: Interpretação da indústria sobre o surgimento do modelo anônimo.

- Link:

-

Futunn – Ações da Alibaba sobem devido ao HappyHorse

- Link:

news.futunn.com/en/post/71208943 - Descrição: Reação do mercado de capitais às especulações sobre a origem do modelo.

- Link:

-

Comunidade DEV – Quem desenvolveu o HappyHorse

- Link:

dev.to/calvin_claire_451169e1b82 - Descrição: Diversas especulações da comunidade sobre a equipe de desenvolvimento.

- Link: