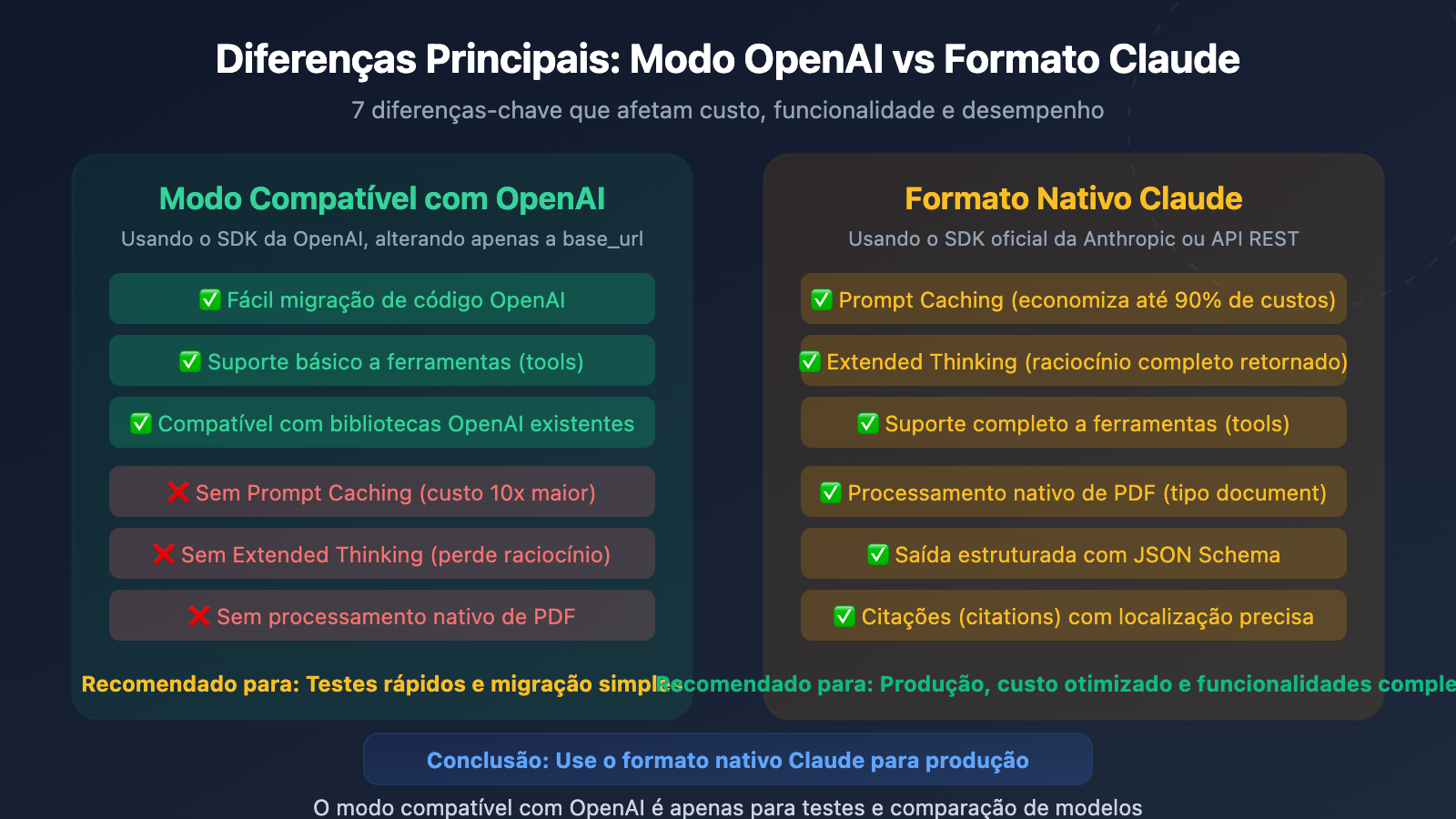

Nota do autor: Comparação detalhada de 7 diferenças-chave entre o modo compatível com OpenAI e o formato nativo da API Claude, incluindo suporte a funcionalidades como Prompt Caching, Extended Thinking e chamada de ferramentas, para ajudá-lo a escolher o melhor método de integração.

Usar o SDK da OpenAI para chamar o modelo Claude parece muito conveniente, bastando alterar a base_url — mas você pode acabar perdendo 90% da economia de custos do Prompt Caching, não conseguir acessar o processo de raciocínio do Extended Thinking e perder a capacidade de processamento nativo de PDFs. Este artigo compara essas 7 diferenças cruciais entre os dois métodos de integração para ajudá-lo a tomar a decisão certa.

Valor principal: Após ler este artigo, você saberá claramente, para o seu caso de uso, se deve escolher o modo compatível com OpenAI ou o formato nativo Claude, evitando gastar mais dinheiro ou perder funcionalidades por escolher o formato errado. O ponto principal é: se você usa o modelo Claude, priorize chamá-lo no formato nativo Claude, não no modo compatível com OpenAI.

Diferenças Principais: Modo Compatível com OpenAI vs Formato Nativo Claude

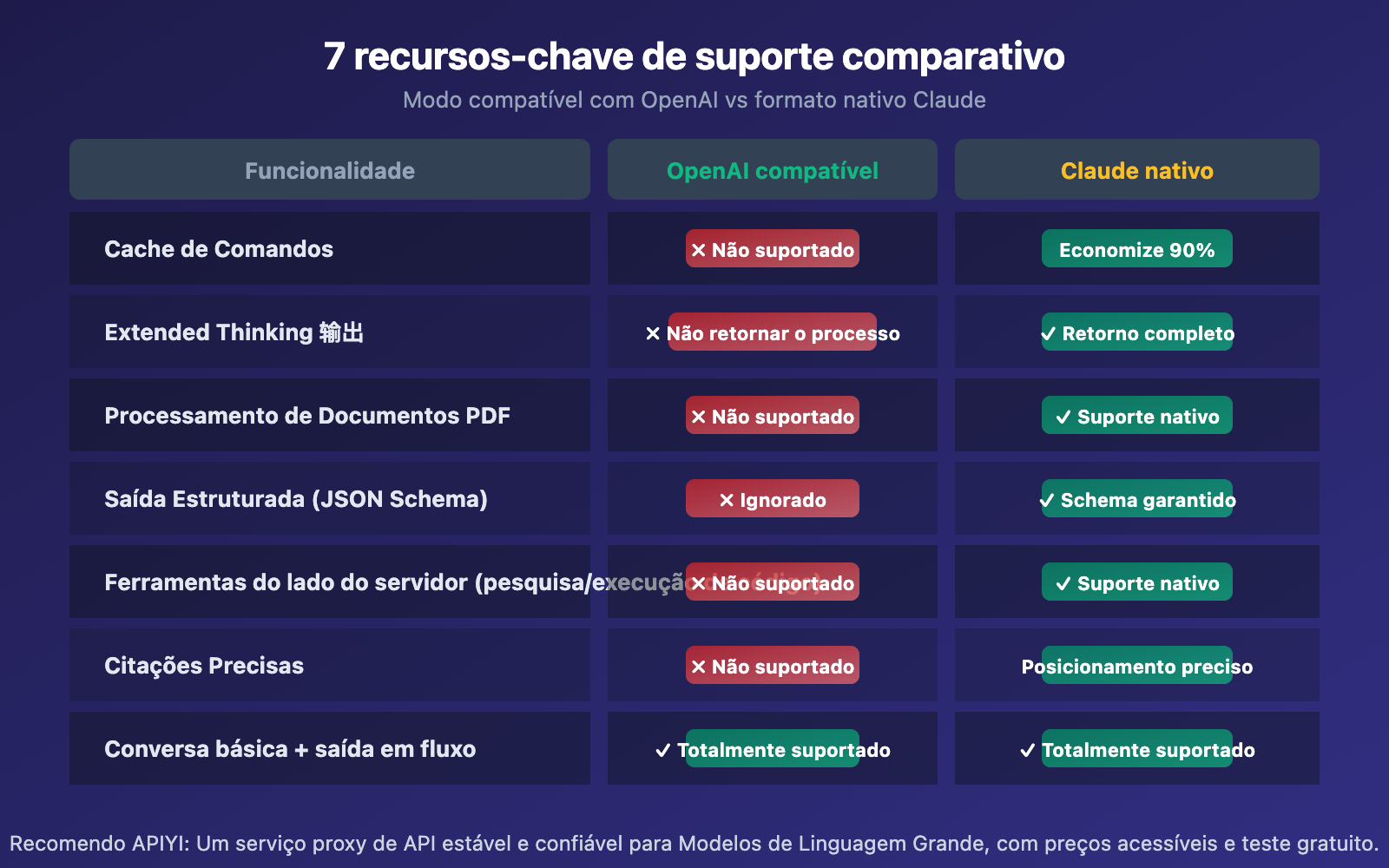

| Dimensão da Diferença | Modo Compatível com OpenAI | Formato Nativo Claude | Grau de Impacto |

|---|---|---|---|

| Prompt Caching | ✗ Não suportado | ✓ Suportado (economiza 90% do custo) | ⭐⭐⭐⭐⭐ Extremamente Alto |

| Extended Thinking | ✗ Não retorna o processo de raciocínio | ✓ Retorna a cadeia de pensamento completa | ⭐⭐⭐⭐⭐ Extremamente Alto |

| Processamento do comando do sistema | Vários são mesclados em um | Campo de nível superior independente | ⭐⭐⭐ Médio |

| Chamada de ferramentas | Suporte básico | Suporte completo + ferramentas do lado do servidor | ⭐⭐⭐⭐ Alto |

| Processamento de PDF | ✗ Não suportado | ✓ Tipo document nativo | ⭐⭐⭐⭐ Alto |

| Saída estruturada | ✗ strict é ignorado | ✓ Garantido por JSON Schema | ⭐⭐⭐⭐ Alto |

| Citações (Citations) | ✗ Não suportado | ✓ Localização precisa de referências | ⭐⭐⭐ Médio |

A diferença essencial entre o Modo Compatível com OpenAI e o Formato Nativo Claude

Simplificando, o modo compatível com OpenAI é uma camada de tradução — ele traduz a requisição no formato OpenAI para um formato que o Claude entende, e então traduz a resposta do Claude de volta para o formato OpenAI. Esse processo de tradução é com perdas: os vários tipos de blocos de conteúdo suportados pela API nativa do Claude (thinking, text, tool_use, citations) são achatados em uma única string content quando traduzidos de volta para o formato OpenAI.

A Anthropic declara explicitamente: o endpoint compatível com OpenAI destina-se principalmente a "testar e comparar a capacidade dos modelos", não sendo uma solução de longo prazo ou pronta para produção.

Comparação da estrutura de requisição: Modo Compatível com OpenAI vs Formato Nativo Claude

A diferença mais visível no nível do código entre os dois formatos é a posição do comando do sistema e a estrutura da resposta:

# ====== Modo Compatível com OpenAI ======

from openai import OpenAI

client = OpenAI(

api_key="sua-chave-api",

base_url="https://vip.apiyi.com/v1" # Acesso via APIYI

)

# O comando do sistema fica no array messages

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Você é um especialista técnico"},

{"role": "user", "content": "Explique o que é um Tokenizer"}

]

)

# A resposta é uma única string content

print(response.choices[0].message.content)

Ver código de requisição no formato nativo Claude

# ====== Formato Nativo da API Claude ======

import anthropic

client = anthropic.Anthropic(

api_key="sua-chave-api",

base_url="https://vip.apiyi.com" # Acesso via APIYI

)

# O comando do sistema é um campo de nível superior independente

response = client.messages.create(

model="claude-sonnet-4-6",

system="Você é um especialista técnico", # Campo independente, não está em messages

messages=[

{"role": "user", "content": "Explique o que é um Tokenizer"}

],

max_tokens=1024

)

# A resposta é um array de múltiplos blocos de conteúdo

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "thinking":

print(f"Processo de pensamento: {block.thinking}")

🎯 Recomendação de integração: A APIYI apiyi.com suporta simultaneamente o formato compatível com OpenAI e o formato nativo Claude. Se você atualmente usa o SDK da OpenAI e precisa apenas de funcionalidades básicas de conversa, o modo compatível permite um início rápido; se precisa de Prompt Caching ou Extended Thinking, recomenda-se mudar para o formato nativo.

Diferença 1: Prompt Caching (maior impacto no custo)

Esta é a diferença mais significativa entre os dois formatos. O Prompt Caching do Claude pode reduzir o custo de entrada de conteúdo repetido em 90%, mas o modo compatível com OpenAI não suporta essa funcionalidade.

| Detalhes do Prompt Caching | Formato Nativo Claude | Modo Compatível OpenAI |

|---|---|---|

| Marcador de controle de cache | Parâmetro cache_control |

✗ Não suportado |

| Cache de 5 minutos (escrita 1.25x) | ✓ | ✗ |

| Cache de 1 hora (escrita 2x) | ✓ | ✗ |

| Leitura por acerto de cache (0.1x) | ✓ Economia de 90% | ✗ |

| Estatísticas de uso de cache | ✓ Retorna dados detalhados | ✗ Campos sempre vazios |

| Limite mínimo de cache | Opus: 4.096 / Sonnet 4.6: 2.048 | — |

Qual é a diferença real de custo? Tomemos um fluxo de trabalho típico de Agente como exemplo: cada rodada de conversa contém cerca de 10.000 tokens de comandos do sistema e definições de ferramentas. Em 10 rodadas de conversa:

- Sem cache (Modo Compatível OpenAI): 10 rodadas × 10.000 tokens = 100.000 tokens de entrada cobrados pelo preço total

- Com cache (Formato Nativo Claude): Primeira rodada a preço total + 9 rodadas com acerto de cache (0.1x) = 10.000 + 9.000 = 19.000 tokens equivalentes

Redução de custo de aproximadamente 81%. Quanto mais rodadas de conversa, mais significativa é a vantagem de custo do Prompt Caching.

Diferença 2: Extended Thinking (capacidade de raciocínio)

O Extended Thinking do Claude permite que o modelo realize um raciocínio profundo antes de responder. Embora seja possível ativar o Extended Thinking no modo compatível com OpenAI através de extra_body, o processo de raciocínio não é retornado para você – você só vê a resposta final.

# Modo Compatível OpenAI —— Pode acionar o pensamento, mas não vê o processo

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "Como resolver este problema de matemática?"}],

extra_body={"thinking": {"type": "enabled", "budget_tokens": 5000}}

)

# response.choices[0].message.content contém apenas a resposta final

# O processo de pensamento é consumido mas não retornado ❌

No formato nativo Claude, você pode obter o bloco de conteúdo completo do thinking, o que é importante para depuração, auditoria e cenários de raciocínio complexo.

Diferença 3: Formato de chamada de ferramentas

Ambos os formatos suportam chamadas de ferramentas, mas existem algumas diferenças-chave:

| Diferenças na chamada de ferramentas | Modo Compatível OpenAI | Formato Nativo Claude |

|---|---|---|

| Estrutura de definição da ferramenta | function.parameters |

input_schema |

| Ferramentas do lado do servidor (busca/execução de código) | ✗ Não suportado | ✓ web_search / code_execution |

Modo strict (garantia de saída) |

✗ Ignorado | ✓ Garantia JSON Schema |

| Cache de ferramentas | ✗ Não suportado | ✓ cache_control |

| Chamadas paralelas de ferramentas | ✓ Suportado | ✓ Suportado |

Diferenças 4-7: Outras distinções importantes

Diferença 4: Processamento de documentos PDF. A API nativa Claude suporta blocos de conteúdo type: "document", podendo processar arquivos PDF diretamente e extrair conteúdo estruturado. No modo compatível com OpenAI, o conteúdo do tipo file é simplesmente ignorado.

Diferença 5: Saída estruturada. No modo compatível com OpenAI, os parâmetros response_format e strict são ignorados, não sendo possível garantir que a saída siga estritamente o JSON Schema. O formato nativo Claude suporta garantia de Schema através de output_config.format.

Diferença 6: Citações (Citations). O formato nativo Claude pode retornar localização precisa de citações (índice do documento, posição do caractere), adequado para rastreamento de fontes em cenários RAG. O modo compatível com OpenAI não possui campos correspondentes.

Diferença 7: Parâmetros ignorados. Os seguintes parâmetros OpenAI são silenciosamente ignorados ao chamar o Claude: frequency_penalty, presence_penalty, seed, logprobs, logit_bias, n (deve ser 1). Valores de temperature acima de 1 são automaticamente truncados para 1.

🎯 Aviso importante: Se seu código depende de

frequency_penaltyoupresence_penaltypara controlar o estilo de saída, observe que esses parâmetros não funcionam ao mudar para o Claude. Recomenda-se ajustar os comandos do sistema para obter efeitos semelhantes. Ao acessar via APIYI apiyi.com, a plataforma lida com esses detalhes de compatibilidade.

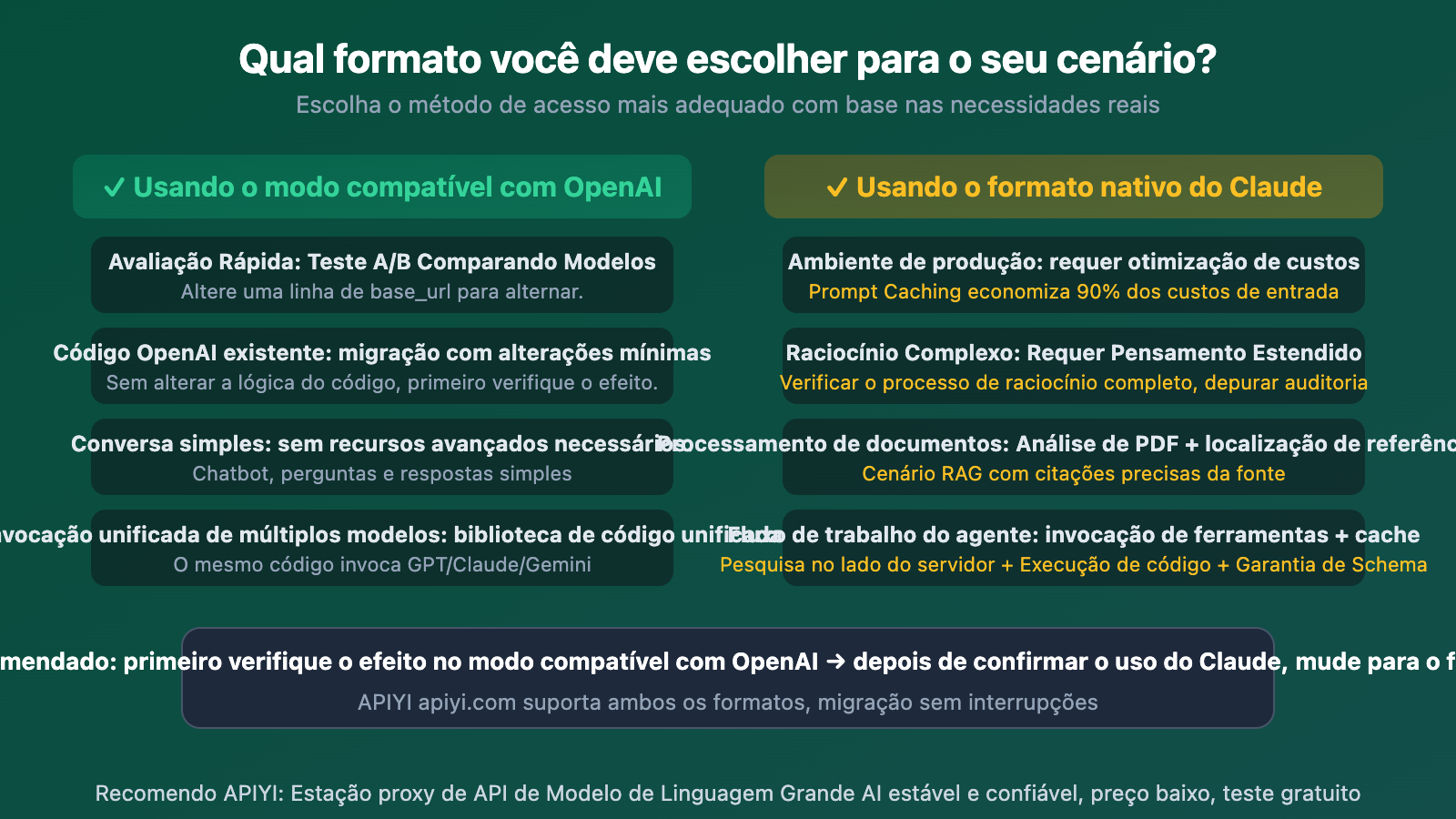

Modo Compatível com OpenAI vs Formato Nativo Claude: Escolha de Cenário

| Cenário de Uso | Formato Recomendado | Razão Principal |

|---|---|---|

| Avaliação Rápida / Teste A-B | Compatível com OpenAI | Basta mudar o base_url, zero alterações de código |

| Migração de Projeto OpenAI Existente | Primeiro Compatível OpenAI → Depois Nativo | Validar eficácia primeiro, migrar gradualmente depois |

| Diálogos Longos em Ambiente de Produção | Nativo Claude | Prompt Caching economiza 80%+ do custo |

| Agente / Chamadas de Ferramentas Intensivas | Nativo Claude | Ferramentas no servidor + Cache + Garantia de Schema |

| Cenários com PDF / RAG | Nativo Claude | Processamento nativo de documentos + Citações |

| Código Unificado para Múltiplos Modelos | Compatível com OpenAI | Um único código para chamar GPT/Claude/Gemini |

🎯 Sugestão de Migração: Migrar do modo compatível com OpenAI para o formato nativo Claude envolve principalmente: (1) extrair a mensagem

systemdo arraymessagespara um campo de nível superior; (2) alterarparametersna definição de ferramentas parainput_schema; (3) lidar com a estrutura de múltiplos blocos de conteúdo na resposta. Usar o serviço proxy de API da APIYI (apiyi.com) pode simplificar esse processo.

Perguntas Frequentes

P1: Ao usar o modo compatível com OpenAI para chamar o Claude, haverá menos funcionalidades comparado a chamar o GPT?

Sim, algumas a menos. Ao chamar o Claude no modo compatível com OpenAI, parâmetros como frequency_penalty, presence_penalty, seed, logprobs, response_format são silenciosamente ignorados. Ao chamar o GPT, esses parâmetros funcionam. Portanto, se seu código depende desses parâmetros, é preciso atenção ao mudar de GPT para Claude. No entanto, o núcleo da conversa, saída em fluxo (streaming) e chamadas básicas de ferramentas funcionam perfeitamente.

P2: Os formatos nativo Claude e OpenAI podem ser usados juntos?

Sim. A APIYI (apiyi.com) suporta ambos os formatos simultaneamente. Você pode usar o formato compatível com OpenAI para diálogos simples (economiza tempo de desenvolvimento) e o formato nativo Claude para fluxos de trabalho de Agente que precisam de Prompt Caching (economiza custo de Tokens) no mesmo projeto. Ambos os formatos usam a mesma chave API.

P3: É difícil mudar do modo compatível com OpenAI para o formato nativo Claude?

As alterações não são grandes, são basicamente 3 pontos:

- Trocar o SDK de

openaiparaanthropic(ou usar requisições HTTP diretamente) - Extrair o comando do sistema do array

messagespara um camposystemindependente - Processar a resposta, mudando de

choices[0].message.contentpara percorrer o arraycontent

Se você acessar através da APIYI (apiyi.com), a plataforma fornece documentação unificada e exemplos de código para ambos os formatos, tornando a migração mais suave.

Resumo

Critérios fundamentais para escolher entre o modo compatível com OpenAI e o formato nativo do Claude:

- O Prompt Caching é a maior diferença: Em ambientes de produção com conversas longas e cenários de Agent, usar o formato nativo do Claude pode economizar 80-90% no custo de Tokens de entrada. Essa diferença é muito maior do que outras funcionalidades.

- O modo compatível com OpenAI é ideal para validação rápida: Se você só quer testar o Claude ou fazer uma comparação A/B, basta alterar a

base_urlem uma linha de código, sem precisar reescrever. - Para ambientes de produção, recomenda-se o formato nativo: Funcionalidades como Extended Thinking, processamento de PDF, Citations e saída estruturada só estão disponíveis no formato nativo.

Escolher o método de integração correto permite aproveitar todo o potencial do Claude e maximizar a eficiência de custos.

Recomendamos acessar através da APIYI apiyi.com. A plataforma suporta tanto o formato compatível com OpenAI quanto o formato nativo do Claude. Com uma única chave, você pode alternar entre eles facilmente, atendendo a diferentes necessidades de cenário.

📚 Referências

-

Documentação de Compatibilidade do SDK OpenAI da Anthropic: Lista completa de parâmetros suportados e não suportados oficialmente

- Link:

platform.claude.com/docs/en/api/openai-sdk - Descrição: Contém explicações detalhadas sobre todos os parâmetros ignorados e campos de resposta.

- Link:

-

Documentação do Prompt Caching do Claude: Mecanismo de cache de prompt e regras de cobrança

- Link:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Descrição: Preços e limites mínimos para os dois níveis de cache (5 minutos e 1 hora).

- Link:

-

Referência da API Messages do Claude: Formato completo de requisição e resposta da API nativa do Claude

- Link:

platform.claude.com/docs/en/api/messages - Descrição: Especificações detalhadas para content blocks, chamadas de ferramentas e saída em fluxo (streaming).

- Link:

-

Documentação do Extended Thinking do Claude: Como usar a funcionalidade de pensamento estendido

- Link:

platform.claude.com/docs/en/build-with-claude/extended-thinking - Descrição: Como habilitar e obter a saída completa do processo de raciocínio.

- Link:

Autor: Equipe Técnica da APIYI

Discussões Técnicas: Convidamos você a comentar abaixo. Para mais materiais, visite o centro de documentação da APIYI em docs.apiyi.com