gpt-image-2를 프로덕션 환경에 막 도입한 분들이라면 아마 **속도 제한(Rate Limit)**과 안정성이라는 두 가지 큰 벽에 부딪혔을 겁니다. OpenAI 공식 gpt-image-2 API의 속도 제한은 매우 엄격해서, Tier 1 계정 기준으로 분당 5회 호출만 가능합니다. 조금만 대량으로 요청해도 바로 429 에러가 발생하죠. 게다가 5xx 오류가 발생하면 연달아 실패하는 경우도 허다합니다. 그래서 많은 팀이 "공식 역방향(官逆) 채널"을 찾게 됩니다. 이는 ChatGPT Pro나 Codex CLI에 내장된 gpt-image-2 백엔드를 역으로 활용해, 더 높은 RPM 할당량과 안정적인 경로를 공유하는 방식입니다.

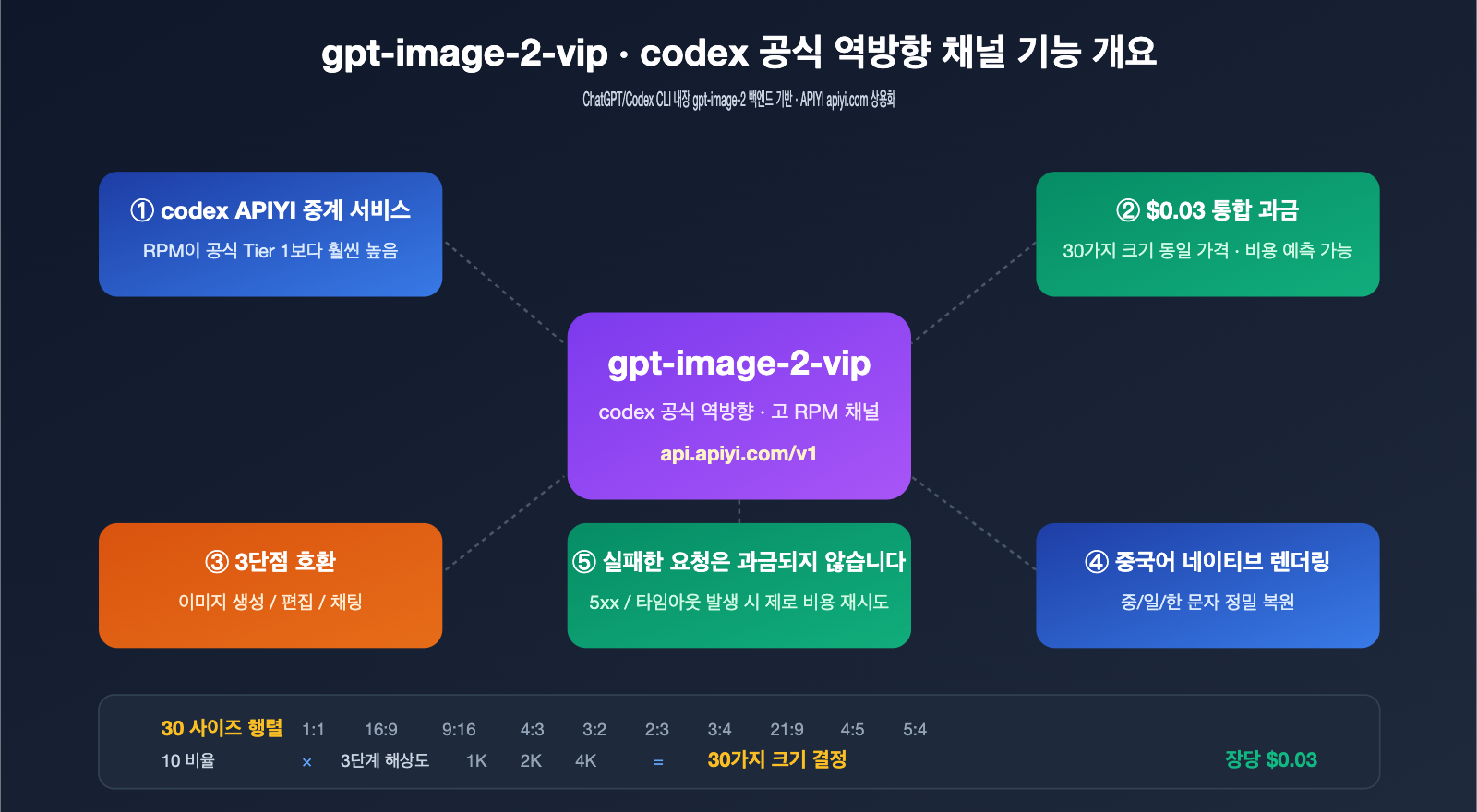

APIYI(apiyi.com)에서 출시한 gpt-image-2-vip 모델이 바로 이 Codex 공식 역방향 경로를 활용합니다. 본 글에서는 5가지 핵심 기능, 30가지 사이즈 옵션, 3개의 호환 엔드포인트 및 실전 코드를 통해 이 인터페이스를 완벽하게 파헤쳐 보겠습니다. 이 글만 읽어도 바로 프로덕션에 적용하실 수 있을 거예요.

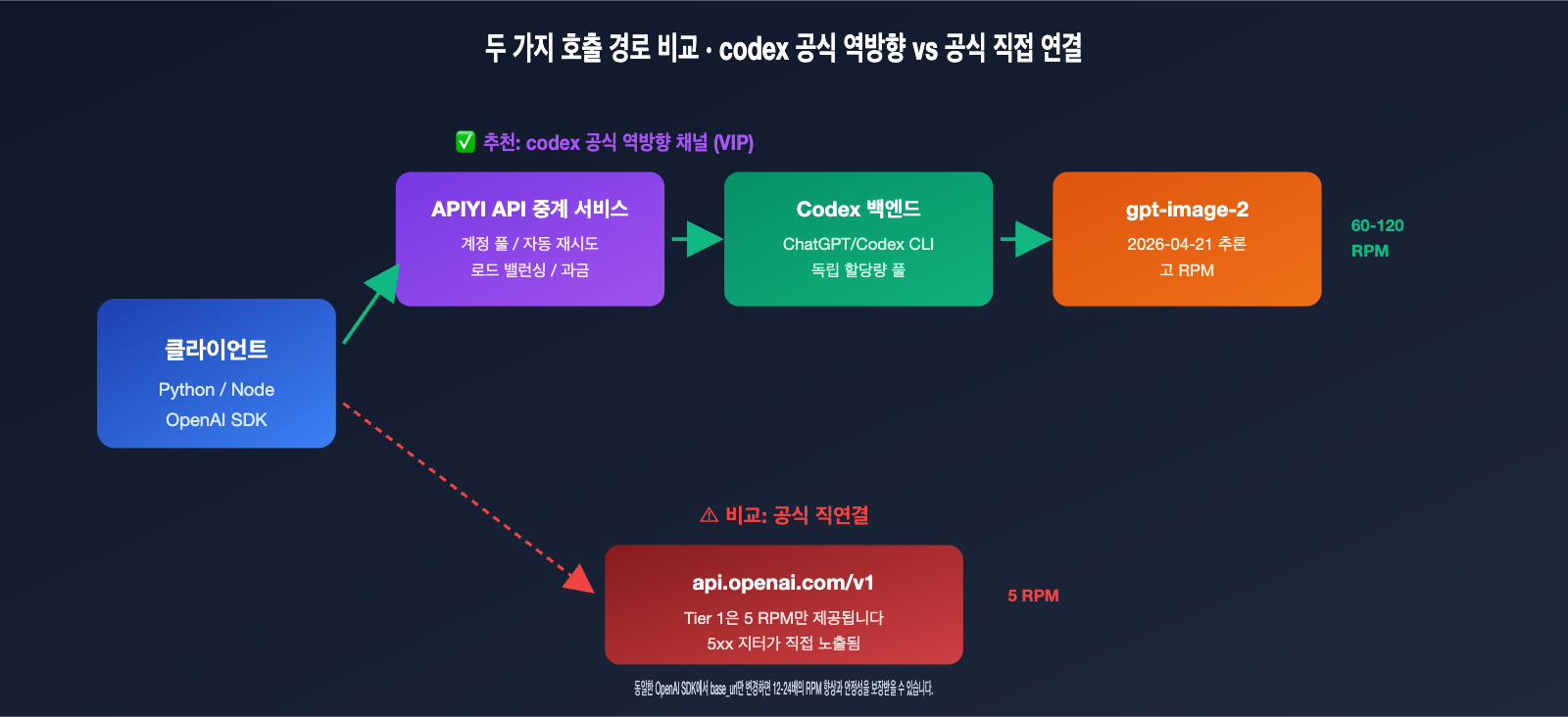

Codex 공식 역방향 API란 무엇인가: 공식 직결 방식과의 3가지 본질적 차이

많은 개발자가 "Codex 공식 역방향"이라는 말을 처음 들으면 불법 인터페이스가 아닌가 생각하곤 합니다. 하지만 이는 OpenAI의 Codex CLI나 ChatGPT Pro에 내장된 gpt-image-2 호출 경로를 역으로 활용하는 것을 의미합니다. OpenAI가 2026년 4월 gpt-image-2를 출시할 때, 이를 Codex CLI($imagegen 스킬)와 ChatGPT 클라이언트에 동시에 내장했습니다. 이 두 입구는 공개 API의 제한 정책과는 다른, 별도의 독립적인 속도 제한 풀을 공유합니다.

Codex 공식 역방향 채널은 Codex 내부의 데이터 흐름을 REST 인터페이스로 노출하여, 일반 OpenAI API를 호출하듯 gpt-image-2를 사용할 수 있게 합니다. 실제로는 ChatGPT 측의 백엔드를 거치는 것이죠. gpt-image-2-vip 모델이 바로 이러한 구현체이며, 공식 직결 방식과는 다음과 같은 3가지 본질적인 차이가 있습니다.

| 구분 | OpenAI 공식 직결 | Codex 공식 역방향 (gpt-image-2-vip) |

|---|---|---|

| 속도 제한 | Tier 1: 5 RPM, 충전 필요 | Codex 공유 풀 사용, Tier 1보다 훨씬 높음 |

| 과금 모델 | 이미지 사이즈/품질별 차등 과금 | $0.03/장 고정, 30종 사이즈 동일가 |

| 안정성 | 공식 5xx 변동에 직접적인 영향 | 다중 계정 풀 + 자동 재시도, 하단 변동성 차단 |

quality 파라미터 |

low/medium/high/auto 지원 | 미지원 (Codex 내장 정책 사용) |

n 파라미터 배치 |

1-4장 지원 | 미지원, 1회당 1장 반환 |

| URL 유효기간 | 60분 | 약 24시간 |

🎯 핵심 인지: 공식 역방향은 "해킹"이 아니라, OpenAI 자체 제품(Codex CLI)의 내부 호출 경로를 REST 인터페이스로 노출한 것입니다. APIYI(apiyi.com)는 이 경로를 상용화된 제품으로 제공하며, 핵심 가치는 OpenAI를 우회하는 것이 아니라 Codex 측의 더 안정적인 속도 할당량을 API 사용자에게 제공하는 데 있습니다.

gpt-image-2-vip의 5가지 핵심 특징

채널 간의 차이를 이해하고 나면 구체적인 특징이 더 명확하게 보일 겁니다. 아래 5가지 포인트는 gpt-image-2-vip가 같은 시리즈 모델인 gpt-image-2-all이나 공식 gpt-image-2와 차별화되는 가장 중요한 부분으로, 문서에서 다소 파편화되어 있어 꼭 짚고 넘어가야 할 내용입니다.

특징 1: 30가지 사이즈 자유 설정, $0.03 단일 요금제

gpt-image-2-vip의 가장 큰 엔지니어링 가치는 '사이즈'를 일급 파라미터로 만든 점입니다. 이 모델은 10가지 가로세로 비율 × 3단계 해상도 = 30가지 확정 사이즈를 지원하며, size 파라미터에서 바로 지정할 수 있어 프롬프트를 복잡하게 조정할 필요가 없습니다. 요금 체계도 매우 직관적입니다. 30가지 모든 사이즈가 $0.03/장으로 동일하며, '큰 사이즈는 더 비싸다'는 숨겨진 비용 부담이 없습니다. 이는 템플릿 기반 생성이나 대량의 썸네일 제작이 필요한 팀에게 예측 가능한 비용 관리라는 큰 이점을 제공합니다.

| 해상도 단계 | 단변 픽셀 | 장변 픽셀(상한) | 적용 사례 |

|---|---|---|---|

| 1K | ~1024 | ~1820 | 썸네일, 피드 커버, 소셜 미디어 |

| 2K | ~2048 | ~3640 | 포스터, 이커머스 메인 이미지, 카드 뉴스 |

| 4K | ~2880 | ~3840 | 고화질 인쇄, 영상 소스, 인쇄물 |

10가지 비율은 1:1 정사각형, 16:9 가로형, 9:16 세로형, 4:3, 3:2, 21:9 등 주요 구도를 모두 커버하므로 별도의 후반 작업(크롭)이 거의 필요 없습니다. 단일 요금제의 또 다른 숨은 가치는 비즈니스 상황에 따라 해상도를 자유롭게 변경해도 재무 모델에 영향을 주지 않는다는 점입니다. 예를 들어 A/B 테스트 시 동일한 프롬프트로 1K와 4K 이미지를 각각 생성해 비교해도 비용이 완전히 예측 가능하므로, 특정 분기에서 큰 사이즈를 사용했다고 해서 월말 청구서가 예산을 초과할 걱정이 없습니다.

특징 2: 3개 엔드포인트 완벽 호환

gpt-image-2-vip는 OpenAI 표준 이미지 엔드포인트 3종을 모두 지원합니다: /v1/images/generations(텍스트-이미지 변환), /v1/images/edits(이미지-이미지 변환 및 편집), /v1/chat/completions(채팅 인터페이스 이미지 생성). 이는 매우 중요한 포인트로, 기존 SDK 코드를 수정할 필요 없이 model만 gpt-image-2에서 gpt-image-2-vip로 바꾸고 base_url만 중계 서비스 주소로 변경하면 바로 사용할 수 있습니다.

특징 3: 다중 이미지 합성 및 이미지-이미지 변환

/v1/images/edits 엔드포인트를 통해 1~N개의 이미지를 업로드하고 프롬프트로 합성 의도를 설명하면, 모델이 스타일 변환, 콘텐츠 융합, 레이아웃 재배치를 수행합니다. 예를 들어 '제품 이미지 + 모델 이미지 + 배경 이미지'를 합쳐 하나의 이커머스 메인 이미지를 만드는 식이죠. 각 이미지는 1.5MB 이내로 압축하는 것을 권장하며, 그렇지 않으면 입력 토큰 소모량이 크게 증가할 수 있습니다.

특징 4: 네이티브 수준의 한국어 이해도

gpt-image-2-vip는 공식 gpt-image-2와 동일한 추론 백엔드를 공유하며, 한국어, 일본어, 중국어, 힌디어, 벵골어 등 다국어 텍스트 렌더링 능력을 그대로 물려받았습니다. 한국어 프롬프트를 굳이 영어로 번역할 필요가 없으며, 포스터 속의 한국어 제목이나 버튼 텍스트도 정확하게 구현합니다. 이는 Midjourney나 Stable Diffusion이 따라올 수 없는 강점입니다.

특징 5: 실패한 요청은 과금 제외

이는 비용 측면의 디테일이지만 대규모 운영 시 비용 절감 효과가 매우 큽니다. 5xx 에러, 타임아웃, 보안 정책 차단 등으로 실패한 요청은 비용이 청구되지 않으며, 이미지가 성공적으로 반환된 호출에 대해서만 비용이 차감됩니다. 덕분에 안심하고 지수 백오프(Exponential Backoff) 재시도 로직을 구현할 수 있으며, 재시도 자체가 청구서를 폭탄으로 만들 걱정이 없습니다. '장당 $0.03'이라는 단일 요금제와 결합하면 비용 예측이 매우 간단해집니다. 10,000장을 생성할 계획이라면 대략 $300 정도가 소요될 것이라고 바로 판단할 수 있어 재무 및 기획 부서와 즉시 의사결정이 가능합니다.

호출 프로세스 및 코드 예시: 파이썬 5줄로 시작하기

연동 로직은 매우 간단하며, 공식 OpenAI SDK와 완전히 동일합니다. base_url과 model만 변경하면 됩니다. 아래는 텍스트-이미지 변환을 위한 최소 실행 예시이며, base_url은 APIYI(apiyi.com)의 통합 중계 서비스 주소를 가리킵니다.

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

resp = client.images.generate(

model="gpt-image-2-vip",

prompt="어두운 분위기의 테크 컨퍼런스 메인 비주얼, 중앙에 네온 사인 스타일로 『APIYI · gpt-image-2 출시』라고 적고, 좌측 하단에 2026이라는 작은 글씨 추가",

size="2048x1152"

)

img_b64 = resp.data[0].b64_json

with open("poster_2k.png", "wb") as f:

f.write(base64.b64decode(img_b64))

이미지-이미지 변환이나 다중 이미지 합성을 원하신다면 client.images.generate를 client.images.edit으로 바꾸고 image=[open("a.png","rb"), open("b.png","rb")]를 추가하기만 하면 됩니다. 세 가지 엔드포인트 모두 OpenAI 공식 규격을 따릅니다.

🎯 빠른 시작 가이드: 30초 만에 이 프로세스를 경험해보고 싶다면, APIYI(apiyi.com)에서 API 키를 생성한 후

gpt-image-2-vip모델과 원하는 사이즈를 설정해 테스트 이미지를 생성해보세요. 실패한 요청은 과금되지 않으니 안심하고 파라미터를 조정하며 테스트할 수 있습니다.

30가지 사이즈 선택 가이드: 상황별 빠른 확인

30가지나 되는 사이즈 옵션을 마주하면 "도대체 뭘 골라야 하지?"라는 생각이 먼저 들죠. 업무 상황별로 분류해 정리해 드립니다. 꼭 기억하세요: 모든 사이즈의 가격은 동일합니다. 따라서 비용을 아끼려고 화질을 희생할 필요 없이, 오직 업무 요구 사항에 맞춰 선택하시면 됩니다.

| 업무 상황 | 권장 비율 | 권장 해상도 | 대표 사이즈 |

|---|---|---|---|

| 공식 계정 커버 / 지후 메인 이미지 | 16:9 / 3:2 | 2K | 2048×1152 |

| 샤오홍슈 / 더우인 세로형 | 9:16 / 4:5 | 2K | 1152×2048 |

| 이커머스 메인 / 상세 페이지 | 1:1 | 2K 또는 4K | 2048×2048 또는 2880×2880 |

| 웹사이트 히어로 대형 이미지 | 21:9 / 16:9 | 4K | 3840×1640 또는 3840×2160 |

| PPT 내지 삽입 이미지 | 16:9 | 1K 또는 2K | 1820×1024 |

| 인쇄물 / 포스터 | 3:4 / 2:3 | 4K | 2880×3840 |

| 피드 썸네일 | 1:1 | 1K | 1024×1024 |

| 배너 가로형 | 21:9 | 1K | 1820×780 |

🎯 사이즈 선택 제안: 프로덕션 환경에서는 2K를 우선 권장합니다. 이미지당 용량이 약 1-3MB로 로딩 속도와 시각적 효과 사이의 균형이 가장 좋습니다. 4K는 인쇄나 대형 스크린 전시가 필요할 때만 사용하고, 1K는 피드 썸네일 같은 작은 이미지 용도로 활용하세요.

gpt-image-2 시리즈 3종 채널 비교: vip / all / 공식

APIYI(apiyi.com)에는 gpt-image-2 관련 모델이 세 가지나 있어 잘못 선택하면 고생하기 쉽습니다. 연동 후 재작업하는 일이 없도록 차이점을 명확히 짚어드릴게요.

gpt-image-2(공식 직결)는 OpenAI 공개 API를 사용하며 quality 및 n 파라미터를 지원하지만, 5 RPM의 낮은 속도 제한을 직접 처리해야 합니다. gpt-image-2-all은 통합 채널로 모든 파라미터를 지원하지만 사이즈를 프롬프트로 제어해야 해서 정밀도가 떨어집니다. 이번 글의 주인공인 gpt-image-2-vip는 codex 공식 역방향 엔지니어링 채널로, size 정밀 고정 + 통합 요금제 + 높은 RPM이 강점입니다.

| 모델 ID | 채널 유형 | 속도 | 사이즈 제어 | quality 파라미터 | 1회 생성 수 | 권장 상황 |

|---|---|---|---|---|---|---|

gpt-image-2 |

공식 직결 | Tier 제한 | 사이즈 정밀 | ✅ | 1-4 | 품질 등급에 민감, 저빈도 호출 |

gpt-image-2-all |

통합 채널 | 보통 | 프롬프트 의존 | ✅ | 1-4 | 기존 코드 마이그레이션, quality 필요 |

gpt-image-2-vip |

codex 역방향 | 고 RPM | 사이즈 정밀 | ❌ | 1 | 대량 생산, 고정 사이즈, 안정성 우선 |

간단한 결정 방법: 안정적인 대량 생산, 고정 사이즈, 예측 가능한 비용이 필요하다면 gpt-image-2-vip를 선택하세요. 고품질의 quality=high가 반드시 필요하다면 gpt-image-2-all을, 아주 가끔 호출하면서 모든 파라미터를 사용하고 싶을 때만 gpt-image-2를 고려하세요.

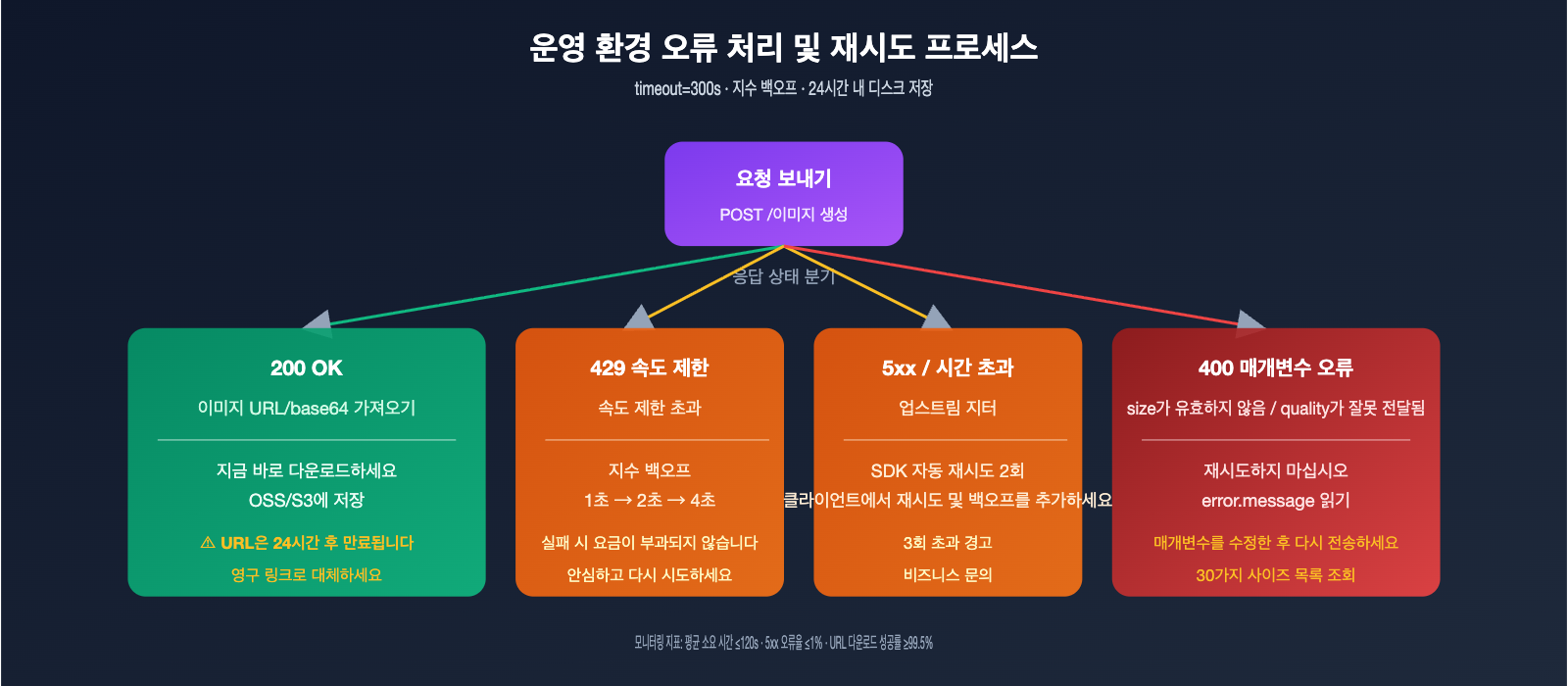

안정성 모범 사례: 타임아웃, 재시도, URL 유효 기간

gpt-image-2-vip는 공식 모델보다 속도는 빠르지만, 이미지 생성 시간은 더 깁니다. 공식 추론은 약 3060초가 소요되지만, VIP 채널은 API 중계 서비스와 재시도 로직이 추가되어 보통 90150초 정도 걸립니다. 프로덕션 코드에서는 반드시 이 시간을 고려해 설정해야 하며, 그렇지 않으면 대규모 타임아웃 오류가 발생할 수 있습니다.

실천 1: 타임아웃을 300초로 설정

OpenAI SDK의 기본 타임아웃은 60초인데, gpt-image-2-vip를 사용하기에는 턱없이 부족합니다. 클라이언트에 timeout=300을 명시적으로 전달하는 것을 권장합니다. 아주 드물게 복잡한 프롬프트의 경우 200초에 육박할 수 있으니 300초로 여유를 두는 것이 안전합니다.

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=300,

max_retries=2

)

실천 2: 5xx 오류에 대한 지수 백오프(Exponential Backoff) 적용

이미 중계 서비스 단에서 재시도를 수행하지만, 클라이언트 측에서 지수 백오프(1초 → 2초 → 4초)를 한 번 더 추가하면 성공률을 더욱 높일 수 있습니다. 실패한 요청은 과금되지 않으므로 재시도에 따른 비용 부담은 없습니다.

실천 3: 반환된 URL은 24시간 내 다운로드 및 저장

gpt-image-2-vip가 반환하는 이미지 URL의 유효 기간은 약 24시간이며, 만료 시 404 오류가 발생합니다. 따라서 URL을 받으면 즉시 자신의 OSS/S3에 다운로드해야 합니다. 데이터베이스에 이 URL을 직접 저장해 장기간 참조하는 것은 피하세요. 대량 작업 시 생성 후 5분 이내에 다운로드를 완료하는 것이 좋습니다.

실천 4: 입력 이미지를 1.5MB 이하로 압축

/v1/images/edits 인터페이스의 참조 이미지는 고충실도로 처리되며, 입력 토큰은 이미지 픽셀 수와 직접적으로 연관됩니다. 4K 참조 이미지와 1024px 참조 이미지의 토큰 소모량은 4배까지 차이 날 수 있습니다. 클라이언트에서 먼저 긴 변을 1024~2048px로 리사이즈한 후 업로드하면 비용도 절감하고 추론 속도도 빨라집니다.

실천 5: 단일 차단 방식 대신 비동기 큐 사용

이미지 한 장당 90150초가 소요되므로, 절대로 동기식 루프로 직렬 호출하지 마세요. 100장의 이미지를 처리하는 데 23시간이 걸릴 수 있습니다. 대신 이미지 생성 요청을 비동기 작업 큐(Celery/asyncio)에 넣고, 비즈니스 스레드는 즉시 작업 ID를 반환하도록 하세요. 프론트엔드는 폴링이나 WebSocket을 통해 최종 결과를 확인하면 됩니다. 이렇게 하면 60 RPM의 처리량을 최대한 활용하여 VIP 채널의 고성능 이점을 누릴 수 있습니다.

3가지 실전 적용 시나리오

이론적인 내용을 마쳤으니, 실제 비즈니스에서 gpt-image-2-vip를 어떻게 활용하는지 살펴보겠습니다. 고객 문의가 가장 많은 세 가지 시나리오를 소개합니다.

시나리오 1: 이더커머스 상품 메인 이미지 대량 생성

입력: 흰색 배경의 제품 사진 + 중국어 문구. 출력: 다양한 스타일의 메인 이미지 30장. 고정된 프롬프트 템플릿을 사용하고 "스타일" 자리표시자만 교체하여 /v1/images/edits를 30번 배치 실행합니다. 이미지 크기는 2048x2048(이더커머스 표준)으로 고정합니다. 30장 생성 비용은 $0.9이며, 총 소요 시간은 약 2분(60 RPM 동시성)입니다.

시나리오 2: 다국어 포스터 현지화

입력: 영어 포스터 원본 + 대상 언어 문구. 출력: 중국어, 일본어, 한국어 버전 포스터. gpt-image-2-vip의 다국어 렌더링 기능을 활용합니다. 프롬프트에 "제목을 '신제품 출시'로 바꾸고, 폰트는 본고딕을 사용하며 원본 레이아웃을 유지해줘"라고 직접 입력하면 PSD 편집 없이도 한 번의 호출로 현지화된 버전을 얻을 수 있습니다.

시나리오 3: PPT 내지 삽화 파이프라인

입력: 대규모 언어 모델이 생성한 챕터 설명. 출력: 페이지당 삽화 1장. '원클릭 PPT' 도구의 핵심 단계입니다. 모든 삽화를 1820x1024(16:9 PPT 표준 비율)로 통일하고, 품질은 VIP 채널 기본값으로 고정합니다. 페이지당 비용은 $0.03이며, 20페이지 분량의 PPT 삽화 비용은 총 $0.6입니다. 여기에 LLM 문구 비용을 더해도 $1 미만으로 완벽한 PPT를 완성할 수 있습니다.

이 세 가지 시나리오의 공통적인 엔지니어링 구조는 다음과 같습니다: 외부는 작업 큐로 스케줄링하고, 내부는 gpt-image-2-vip를 호출하며, 이미지 생성 후 즉시 OSS에 저장합니다. 프론트엔드에는 OSS의 영구 링크를 표시하며, 모델이 반환한 24시간 임시 URL은 직접 사용하지 않습니다.

일반적인 오류 및 문제 해결

아래 표는 고객 지원 채널에서 가장 자주 문의되는 오류 유형을 정리한 것입니다. 이 내용을 확인하시면 대부분의 연동 문제를 90% 이상 해결하실 수 있습니다.

| 오류 현상 | 근본 원인 | 해결 방법 |

|---|---|---|

| 408 / 504 타임아웃 | 타임아웃 설정이 너무 짧음 | 타임아웃을 300초로 조정 |

| 400 invalid size | 지원하지 않는 size 값 | 문서에 명시된 표준 size 사용 |

| 400 unsupported_parameter | quality 또는 n>1 전달 |

VIP 채널은 지원하지 않으므로 해당 필드 삭제 |

| 이미지 URL 404 | URL 생성 후 24시간 경과 | 생성 즉시 자체 저장소로 다운로드 |

| 한글 깨짐 또는 사각형 표시 | 프롬프트에 매우 희귀한 문자 사용 | 일반적인 문자로 변경하거나 프롬프트에 "思源黑体(본고딕) 사용" 명시 |

| input_tokens 초과 | 참조 이미지가 너무 큼 | 클라이언트 측에서 1.5MB 이내로 압축 |

자주 묻는 질문 (FAQ)

Q1: gpt-image-2-vip의 이미지 품질이 공식 버전과 다른가요?

기반 모델은 gpt-image-2-2026-04-21 스냅샷으로 완전히 동일합니다. 차이점은 오직 스케줄링 경로뿐입니다. 공식 버전은 API 할당량 풀을 사용하고, VIP 채널은 Codex 할당량 풀을 사용합니다. 이미지의 시각적 품질에는 차이가 없으며, 대규모 블라인드 테스트에서도 구분하기 어렵습니다.

Q2: 왜 quality 파라미터를 지원하지 않나요?

Codex CLI 내부 호출은 고정된 quality=high 전략을 따릅니다. VIP 채널은 이 경로를 재사용하므로 상위 계층에 quality 옵션을 노출할 수 없습니다. 비용 절감을 위해 low/medium 등급이 꼭 필요한 경우 gpt-image-2-all을 사용하세요.

Q3: 실패한 요청은 정말 과금되지 않나요?

네, APIYI(apiyi.com)의 과금 정책은 "성공적인 응답에 대해서만 과금"하는 방식입니다. 4xx 파라미터 오류, 5xx 서비스 오류, 타임아웃 등은 모두 소모량에 포함되지 않습니다. 이는 청구서에서 항목별로 직접 확인하실 수 있습니다.

Q4: 국내 서버에서 직접 호출할 수 있나요?

네, 가능합니다. api.apiyi.com 도메인은 국내 규정을 준수하는 경로를 통하므로 별도의 우회 접속(VPN 등)이 필요 없습니다. 이것이 많은 팀이 API 중계 서비스를 선택하는 핵심 이유 중 하나입니다.

Q5: VIP 채널의 RPM 제한은 얼마인가요?

공개된 하드 제한은 없으며, 실제로는 계정 풀의 상태에 따라 달라집니다. 일반적인 비즈니스 환경에서는 공식 Tier 1의 5 RPM보다 훨씬 높은 60~120 RPM까지 안정적으로 사용할 수 있습니다. 더 높은 동시성이 필요하시면 영업 담당자에게 문의하여 화이트리스트 등록을 요청하세요.

Q6: 한 번에 이미지 한 장만 반환되는데, 대량 처리는 어떻게 하나요?

외부에서 동시성 루프를 사용하여 호출하면 됩니다. Python의 asyncio.gather나 concurrent.futures.ThreadPoolExecutor를 사용하면 60 RPM까지 쉽게 도달할 수 있습니다. VIP 채널은 비동기 추론 방식이므로 동시 제출이 CPU 제한을 받지 않으며, 병목 현상은 오직 중계 계층의 RPM에서만 발생합니다.

Q7: 동일한 프롬프트로 여러 번 호출하면 결과가 똑같나요?

완전히 같지는 않습니다. gpt-image-2-vip는 Codex 내부 전략을 따르며 seed 파라미터를 노출하지 않기 때문에 매번 생성 시 무작위성이 존재합니다. 재현 가능한 결과가 필요하다면 프롬프트를 매우 구체적으로 작성(예: 고정된 색상 코드, 고정된 구도 묘사)하거나, 처음 만족스러운 이미지를 참조 이미지로 하여 /v1/images/edits 엔드포인트로 미세 조정(Fine-tuning)을 진행하세요.

Q8: 운영 환경의 안정성은 어떻게 모니터링하나요?

클라이언트 측에서 평균 이미지 생성 시간, 5xx 오류율, URL 다운로드 성공률 세 가지 지표를 통계 내는 것을 권장합니다. 정상적인 상태라면 평균 생성 시간은 120초 이내, 5xx 오류율은 1% 미만, URL 다운로드 성공률은 99.5% 이상이어야 합니다. 어느 하나라도 이상이 있다면 계정 풀의 상태가 낮다는 의미이므로 영업 담당자에게 리소스 조정을 요청해야 합니다.

요약

gpt-image-2-vip는 Codex 공식 역방향 채널(reverse proxy)을 기반으로 구축된 이미지 생성 상용화 제품입니다. 공식 API 직결 시 겪는 불편함을 해결하는 5가지 핵심 기능인 30가지 크기 지원 + $0.03 단일 요금제 + 3개 엔드포인트 호환 + 한국어 네이티브 지원 + 실패 시 과금 제외를 제공합니다. 콘텐츠 제작, 이커머스 자료, PPT 자동화, 포스터 대량 생성 팀에게 현재 가장 가성비 좋은 gpt-image-2 연동 솔루션 중 하나입니다.

연동 방법은 base_url과 model 두 곳만 변경하면 되며, SDK 코드는 OpenAI 공식 작성 방식을 그대로 재사용할 수 있습니다. 운영 환경에서는 타임아웃을 300초로 설정하고, 5xx 에러 발생 시 지수 백오프(exponential backoff)를 적용하며, 이미지 URL은 24시간 이내에 로컬에 저장하는 것을 권장합니다. 이 세 가지만 주의하면 안정적인 대량 처리가 가능합니다. gpt-image-2 운영 환경 도입을 검토 중이라면, 지금 바로 APIYI(apiyi.com)에서 계정을 생성하고 VIP 채널을 통해 실제 비즈니스 데이터로 먼저 테스트해 보세요.

저자 소개: APIYI 팀은 멀티모달 모델 통합 연동 및 고동시성 추론 인프라에 집중하고 있으며, 매일 방대한 양의 이미지 생성 API 연동 문의를 처리하고 있습니다. 본 글은 실제 운영 데이터를 바탕으로 정리되었으며, gpt-image-2-vip의 상세 파라미터가 궁금하시다면 docs.apiyi.com을 방문해 주세요.