剛把 gpt-image-2 接到生產環境的同學,大概率會被兩件事卡住:速率限制和穩定性。OpenAI 官方直連 gpt-image-2 的速率限制非常苛刻,Tier 1 賬號每分鐘僅 5 次,稍微一批量就觸發 429;遇到 5xx 抖動還會一連幾次失敗。這時候很多團隊會去找"官逆通道"——逆向 ChatGPT Pro/Codex CLI 內置的 gpt-image-2 後端,共享更高的 RPM 配額和更穩的鏈路。

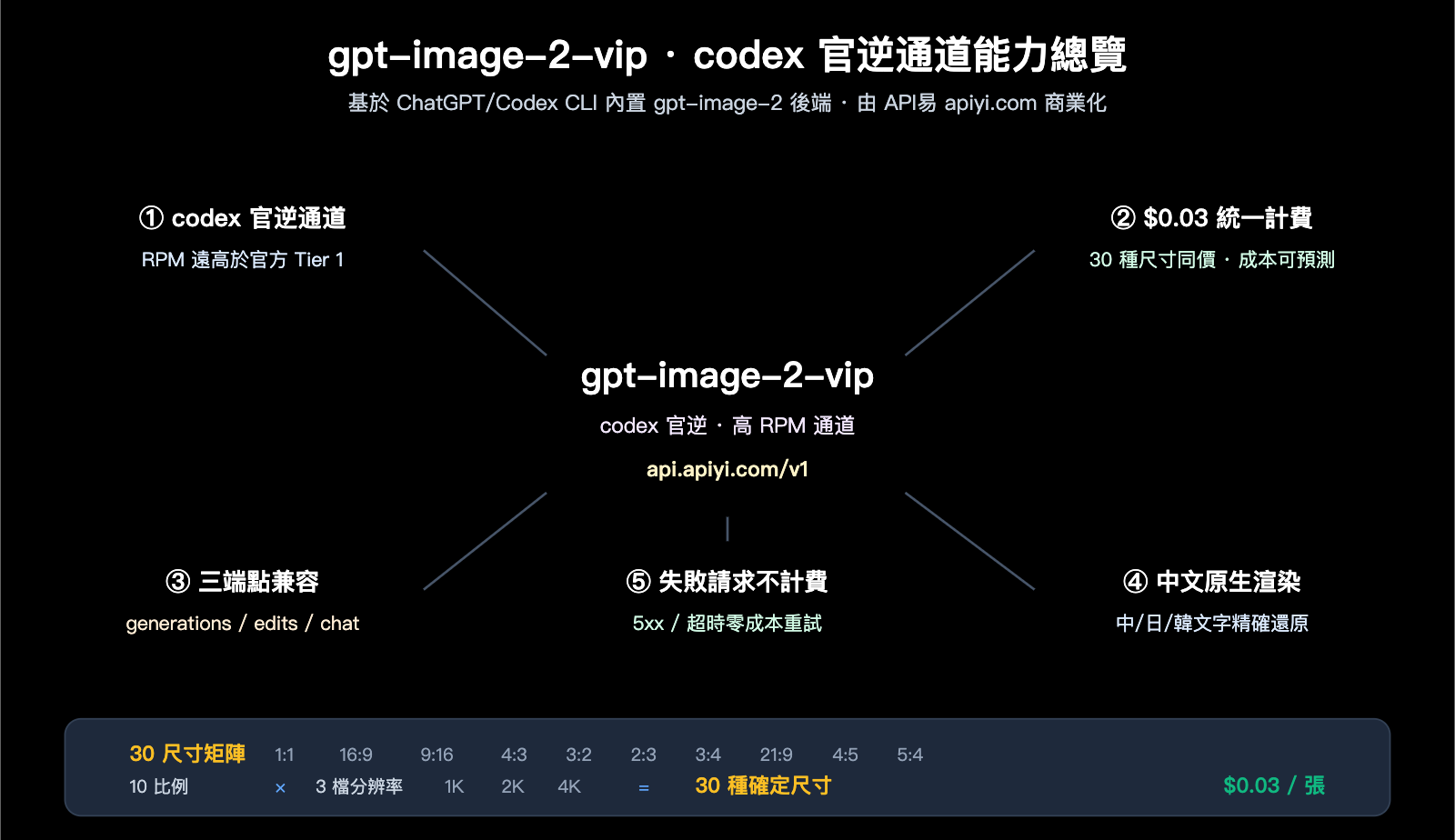

API易 apiyi.com 上線的 gpt-image-2-vip 模型,走的正是這條 codex 官逆線路。本文圍繞 5 個核心特性、30 種尺寸選項、3 個兼容端點和實戰代碼,把這個接口講透,看完就能直接接入生產。

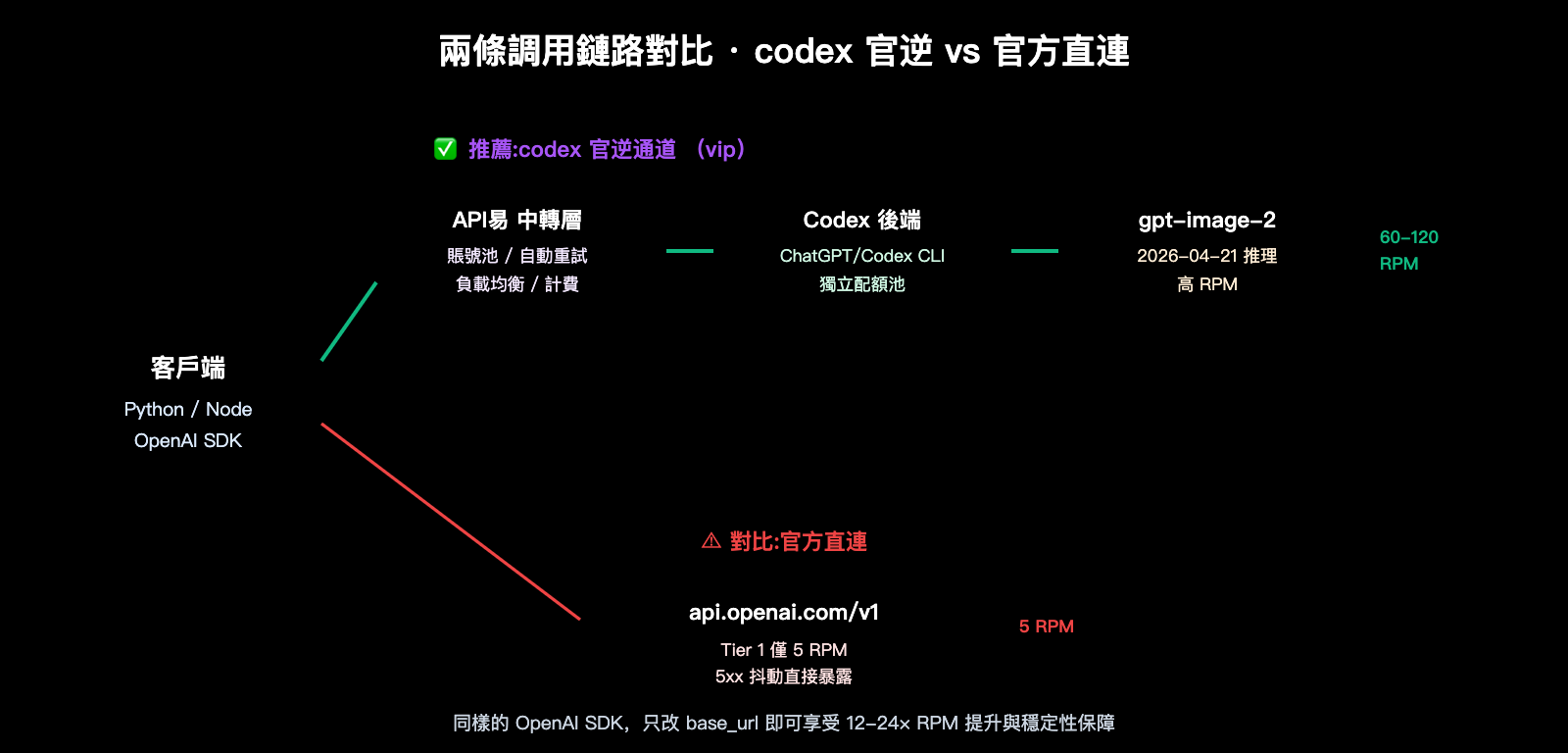

codex 官逆 API 是什麼:與官方直連有 3 個本質區別

很多開發者第一次聽到"codex 官逆"會以爲是非法接口,其實它指的是逆向 OpenAI 自家 Codex CLI/ChatGPT Pro 內嵌的 gpt-image-2 調用鏈。OpenAI 在 2026 年 4 月發佈 gpt-image-2 時,同時把它內置進了 Codex CLI($imagegen 技能)和 ChatGPT 客戶端,這兩個入口共享一套獨立的速率配額池,且與公開 API 的限流策略不同。

codex 官逆通道做的事情是:把 Codex 內部那條數據流暴露成 REST 接口,讓你能像調用普通 OpenAI API 一樣用 gpt-image-2,但實際走的是 ChatGPT 一側的後端。gpt-image-2-vip 模型就是這種實現,它和官方直連相比有 3 個本質差異。

| 維度 | OpenAI 官方直連 | codex 官逆通道 (gpt-image-2-vip) |

|---|---|---|

| 速率限制 | Tier 1: 5 RPM,需充值才能解鎖 | 走 Codex 共享池,遠高於 Tier 1 |

| 計費模型 | 按圖片尺寸/質量階梯計費 | 統一 $0.03/張,30 種尺寸同價 |

| 穩定性 | 受官方 5xx 波動直接影響 | 多賬號池 + 自動重試,屏蔽底層抖動 |

quality 參數 |

支持 low/medium/high/auto | 不支持(走 Codex 內置策略) |

n 參數批量 |

支持 1-4 張 | 不支持,單次返回 1 張 |

| URL 有效期 | 60 分鐘 | ~24 小時 |

🎯 首要認知: 官逆不是"破解",它是把 OpenAI 自家產品(Codex CLI)的內部調用鏈暴露成 REST 接口。API易 apiyi.com 把這條通道做成商業化產品,核心價值不是繞過 OpenAI,而是把 Codex 一側更穩的速率配額給到 API 用戶。

gpt-image-2-vip 的 5 大核心特性

理解了通道差異之後,看具體特性就更清晰。下面 5 點是 gpt-image-2-vip 與同系列模型 gpt-image-2-all、官方 gpt-image-2 最關鍵的區別,也是文檔裏寫得相對零散、需要重點畫出來的內容。

特性一:30 種尺寸自由鎖定,$0.03 統一計費

gpt-image-2-vip 最大的工程價值,是把"尺寸"做成了一等參數。模型支持 10 種寬高比 × 3 檔分辨率 = 30 種確定尺寸,在 size 參數裏指定即可,不需要繞彎路調 prompt。計費層面更直接:所有 30 種尺寸統一 $0.03/張,不再有"大尺寸更貴"的隱性成本。這對做模板化生成、批量縮略圖的團隊來說是巨大的成本可預測性提升。

| 分辨率檔位 | 短邊像素 | 長邊像素(上限) | 適用場景 |

|---|---|---|---|

| 1K | ~1024 | ~1820 | 縮略圖、信息流封面、社交媒體 |

| 2K | ~2048 | ~3640 | 海報、電商主圖、內容卡片 |

| 4K | ~2880 | ~3840 | 高清打印、視頻素材、印刷物料 |

10 種比例覆蓋了 1:1 方圖、16:9 橫版、9:16 豎版、4:3、3:2、21:9 等主流構圖需求,基本不用再做後期裁剪。統一定價的另一個隱性價值是,你可以在生產管線裏隨業務需要切換分辨率而不影響財務模型——比如 A/B 測試時把同一 prompt 跑 1K 和 4K 各一張做對比,成本完全可預測,不會因爲某個分支用了大尺寸而導致月底賬單失控。

特性二:三個端點全部兼容

gpt-image-2-vip 同時支持 OpenAI 標準的三個圖像端點:/v1/images/generations(純文生圖)、/v1/images/edits(圖生圖與編輯)、/v1/chat/completions(聊天接口出圖)。這一點很關鍵,意味着你不用重寫已有的 SDK 代碼,只需要把 model 從 gpt-image-2 換成 gpt-image-2-vip,把 base_url 切到中轉入口即可。

特性三:多圖融合與圖生圖

通過 /v1/images/edits 端點上傳 1-N 張圖,再配合 prompt 描述合成意圖,模型會做風格遷移、內容融合、版式重排。比如把"產品圖 + 模特圖 + 背景圖"三張圖合成一張電商主圖。每張圖建議壓縮到 1.5MB 以內,否則 input token 消耗會顯著上漲。

特性四:中文原生理解

gpt-image-2-vip 與官方 gpt-image-2 共享同一個推理後端,繼承了中、日、韓、印地、孟加拉多語言文字渲染能力。中文 prompt 不需要英譯,海報裏的中文標題、按鈕文字都能精確還原,這是 Midjourney、Stable Diffusion 都做不到的。

特性五:失敗請求不計費

這是計費層面的細節,但對大規模生產來說省錢意義巨大。任何返回 5xx、超時、被安全策略攔截的請求都不會扣費,只有成功返回圖片的調用才計入消耗。這讓你可以放心做指數退避重試,不用擔心重試本身把賬單打爆。配合"統一 $0.03/張"的定價,成本預估變得極其簡單:計劃生成 10000 張圖,就是 $300 上下,不需要再按尺寸/質量分檔建模,財務和產品都能直接拍板。

調用流程與代碼示例:從 5 行 Python 開始

接入邏輯非常直接,與官方 OpenAI SDK 完全一致,只需切換 base_url 和 model。下面是文生圖最小可運行示例,base_url 指向 API易 apiyi.com 的統一中轉入口。

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

resp = client.images.generate(

model="gpt-image-2-vip",

prompt="深色科技感發佈會主視覺,中央霓虹標題『API易 · gpt-image-2 上線』,左下角小字 2026",

size="2048x1152"

)

img_b64 = resp.data[0].b64_json

with open("poster_2k.png", "wb") as f:

f.write(base64.b64decode(img_b64))

如果你要做圖生圖或多圖融合,把 client.images.generate 換成 client.images.edit,再加 image=[open("a.png","rb"), open("b.png","rb")] 即可。三個端點的請求體格式都遵循 OpenAI 官方規範。

🎯 快速上手建議: 想要 30 秒跑通這條流程,我們推薦先在 API易 apiyi.com 創建一個 API key,然後用

gpt-image-2-vip+ 任意 size 跑一張測試圖。失敗請求不計費,可以放心調試參數。

30 種尺寸怎麼選:按場景速查

很多人面對 30 種 size 選項第一反應是"選哪個",我們按業務場景歸類。重要的認知是:所有尺寸價格相同,所以選尺寸完全按業務需求來,不用爲了省錢犧牲清晰度。

| 業務場景 | 推薦比例 | 推薦分辨率 | 典型 size |

|---|---|---|---|

| 公衆號封面 / 知乎首圖 | 16:9 / 3:2 | 2K | 2048×1152 |

| 小紅書 / 抖音豎版 | 9:16 / 4:5 | 2K | 1152×2048 |

| 電商主圖 / 詳情頁 | 1:1 | 2K 或 4K | 2048×2048 或 2880×2880 |

| 網站 Hero 大圖 | 21:9 / 16:9 | 4K | 3840×1640 或 3840×2160 |

| PPT 內頁插圖 | 16:9 | 1K 或 2K | 1820×1024 |

| 印刷品 / 海報 | 3:4 / 2:3 | 4K | 2880×3840 |

| 信息流縮略圖 | 1:1 | 1K | 1024×1024 |

| Banner 長條 | 21:9 | 1K | 1820×780 |

🎯 尺寸選擇建議: 我們推薦生產環境優先用 2K 檔,單圖體積約 1-3MB,加載速度和視覺效果平衡最好;只在需要印刷或大屏展示時才上 4K,1K 留給信息流縮略圖等小圖場景。

gpt-image-2 系列三種通道對比:vip / all / 官方

API易 apiyi.com 上其實有三個 gpt-image-2 相關模型,選錯很容易踩坑,下面把它們的差異講清楚,避免接入後還要返工。

gpt-image-2(官方直連)走 OpenAI 公開 API,支持 quality 和 n 參數,但要自己處理 5 RPM 的低速率限制。gpt-image-2-all 是聚合通道,支持所有參數但尺寸由 prompt 控制、不夠精準。gpt-image-2-vip 就是本文主角,走 codex 官逆,強項是 size 精準鎖定 + 統一定價 + 高 RPM。

| 模型 ID | 通道類型 | 速率 | 尺寸控制 | quality 參數 | 單次張數 | 推薦場景 |

|---|---|---|---|---|---|---|

gpt-image-2 |

官方直連 | Tier 限制 | size 精準 | ✅ | 1-4 | 對質量分檔敏感、低頻調用 |

gpt-image-2-all |

聚合通道 | 中等 | 靠 prompt 描述 | ✅ | 1-4 | 老代碼遷移、需要 quality 參數 |

gpt-image-2-vip |

codex 官逆 | 高 RPM | size 精準 | ❌ | 1 | 批量生產、固定尺寸、穩定優先 |

簡單決策:如果你要的是穩定大批量、固定尺寸、可預測計費,選 gpt-image-2-vip;如果你必須用 quality=high 做高保真,選 gpt-image-2-all;只有少量低頻調用且想要全套參數,才考慮 gpt-image-2。

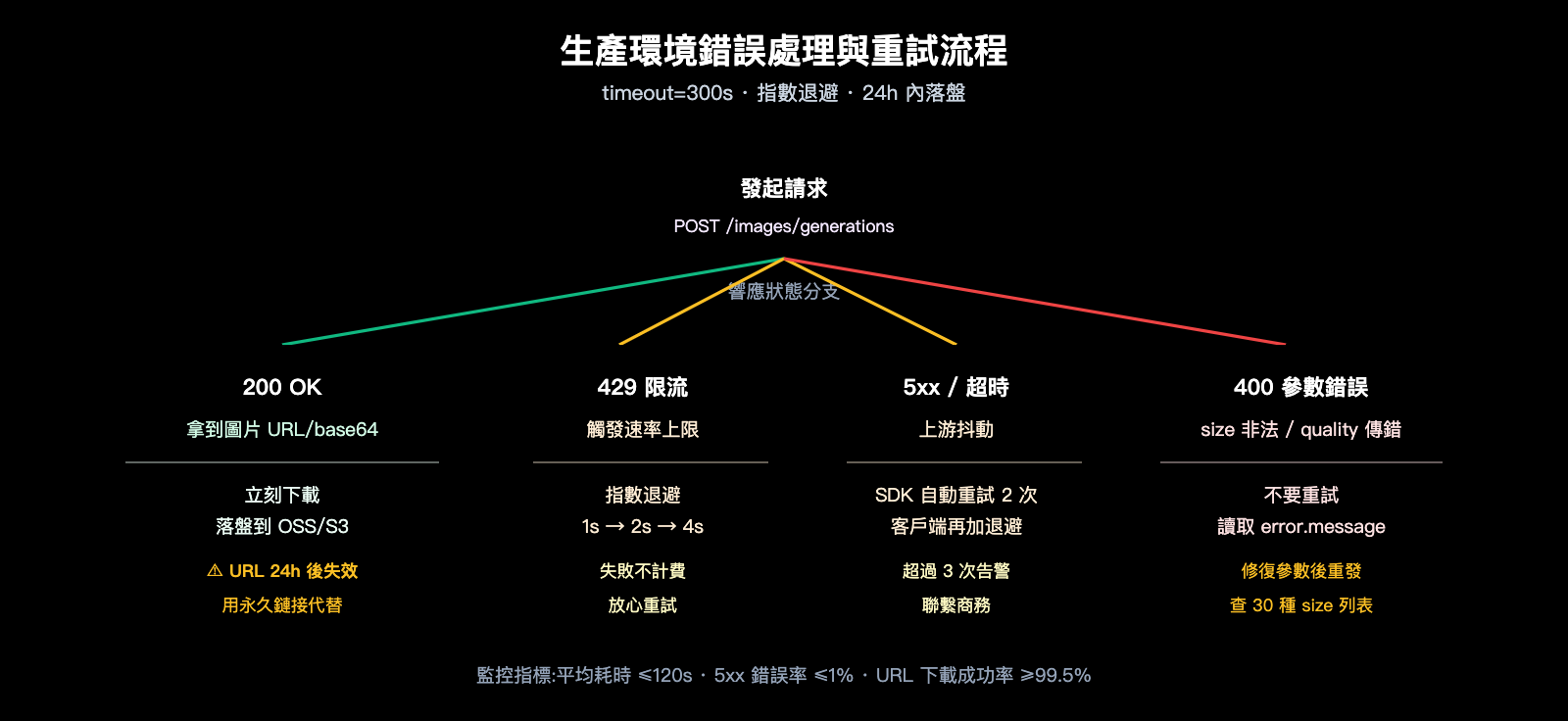

穩定性最佳實踐:超時、重試、URL 時效

gpt-image-2-vip 的速率比官方高,但出圖時長長:官方推理大約 30-60 秒,vip 通道因爲多了一層中轉和重試,通常 90-150 秒。生產代碼必須按這個時長配置,否則會大面積超時失敗。

實踐一:超時時間設置爲 300 秒

OpenAI SDK 默認超時 60 秒,這對 gpt-image-2-vip 遠遠不夠。建議把 timeout=300 顯式傳給 client。極少數複雜提示詞會接近 200 秒,留 300 秒餘量更保險。

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=300,

max_retries=2

)

實踐二:對 5xx 錯誤做指數退避

雖然中轉層已經做了一道重試,但客戶端再加一層指數退避(1s → 2s → 4s)能進一步提升成功率。失敗請求不計費,這一點讓重試零成本。

實踐三:返回 URL 24 小時內下載落盤

gpt-image-2-vip 返回的圖片 URL 有效期約 24 小時,過期會 404。所以拿到 URL 後立刻下載到自己的 OSS/S3,不要直接把這個 URL 塞進數據庫長期引用。批量任務建議在生成 5 分鐘內完成下載。

實踐四:輸入圖壓縮到 1.5MB 以內

/v1/images/edits 接口的輸入圖按高保真度處理,input token 直接與圖片像素數掛鉤。一張 4K 參考圖和一張 1024px 參考圖的 token 消耗可能差 4 倍。在客戶端先 resize 到 1024-2048 長邊再上傳,既省錢又能加快推理。

實踐五:併發不要單條阻塞,用異步隊列

由於單次出圖 90-150 秒,絕對不能用同步循環串行調用,否則 100 張圖就要跑兩到三小時。推薦做法是把生圖請求扔進異步任務隊列(Celery/asyncio),業務線程立刻返回任務 ID,前端通過輪詢或 WebSocket 拿最終結果。這樣能把 60 RPM 的吞吐利用滿,真正發揮 vip 通道的高併發優勢。

三個實戰接入場景

理論講完看一下真實業務怎麼把 gpt-image-2-vip 用起來。下面三個場景是客服羣裏被問得最多的,代碼框架都很短。

場景一:電商商品主圖批量生成

輸入:一張白底產品圖 + 一段中文文案。輸出:30 張不同風格的主圖。流程是用一個固定 prompt 模板,只替換"風格"佔位符,batch 跑 30 次 /v1/images/edits,每張圖 size 鎖定 2048x2048(電商主圖標準尺寸)。30 張圖成本 $0.9,總耗時約 2 分鐘(60 RPM 併發)。

場景二:多語言海報本地化

輸入:一張英文海報底圖 + 目標語言文案。輸出:中文、日文、韓文三個版本的海報。利用 gpt-image-2-vip 的多語言文字渲染能力,prompt 直接寫"把標題改成『新品上市』,字體使用思源黑體,保持原版式不變",一次調用就能拿到本地化版本,不需要 PSD 編輯。

場景三:PPT 內頁插圖流水線

輸入:LLM 生成的章節描述。輸出:每頁一張插圖。這是抖音上"一鍵 PPT"工具的核心環節,把所有插圖統一用 1820x1024(16:9 PPT 標準比例),quality 由 vip 通道默認鎖高,單頁成本 $0.03,20 頁 PPT 總插圖成本僅 $0.6,加上 LLM 文案不到 $1 就能產出一份完整 PPT。

這三個場景共同的工程結構是:外層用任務隊列調度,內層調 gpt-image-2-vip,出圖後立刻落盤到 OSS,前端展示用 OSS 的永久鏈接,不直接使用模型返回的 24 小時臨時 URL。

常見錯誤與排查

下面這張表覆蓋了客服羣裏被問到最多的報錯類型,直接對照排查就能解決 90% 的接入問題。

| 錯誤現象 | 根因 | 解決方法 |

|---|---|---|

| 408 / 504 超時 | timeout 設置太短 | 把 timeout 調到 300 秒 |

| 400 invalid size | size 不在 30 種裏 | 改用文檔列出的標準 size |

| 400 unsupported_parameter | 傳了 quality 或 n>1 |

vip 通道不支持,刪掉這兩個字段 |

| 圖片 URL 404 | URL 已過期 24 小時 | 改成生成後立刻下載到自己存儲 |

| 中文渲染成亂碼或方框 | prompt 用了非常生僻字 | 改用常見字符,或在 prompt 裏描述"使用思源黑體" |

| input_tokens 超預期 | 參考圖太大 | 客戶端壓縮到 1.5MB 以內 |

常見問題 FAQ

Q1: gpt-image-2-vip 的圖片質量和官方有差異嗎?

底層模型完全相同,都是 gpt-image-2-2026-04-21 快照。差異只在調度鏈路:官方走 API 配額池,vip 走 Codex 配額池。出圖視覺質量沒有差別,大批量盲測無法分辨。

Q2: 爲什麼不支持 quality 參數?

Codex CLI 內置調用走的是固定 quality=high 策略,vip 通道複用這條鏈路,所以沒法暴露 quality 選項給上層。如果業務確實需要 low/medium 檔降本,改用 gpt-image-2-all。

Q3: 失敗請求真的不扣費嗎?

是的,API易 apiyi.com 的計費策略是"按成功響應計費"。返回 4xx 參數錯誤、5xx 服務錯誤、超時,統統不計入消耗。這一點在賬單裏可以逐條覈對。

Q4: 能不能在國內服務器直接調用?

可以。api.apiyi.com 域名走國內合規鏈路,不需要科學上網。這也是很多團隊選擇中轉的核心原因之一。

Q5: vip 通道的 RPM 上限是多少?

沒有公開的硬上限,實際取決於賬號池水位。一般業務實測可穩定到 60-120 RPM,遠高於官方 Tier 1 的 5 RPM。需要更高併發請聯繫商務開白。

Q6: 單次只返回一張圖,批量怎麼辦?

外層併發循環調用即可,Python 的 asyncio.gather 或 concurrent.futures.ThreadPoolExecutor 都能輕鬆跑到 60 RPM。因爲 vip 通道是異步推理,併發提交不會被 CPU 限制,瓶頸只在中轉層 RPM。

Q7: 同一 prompt 多次調用結果會一樣嗎?

不會完全相同。gpt-image-2-vip 走 Codex 內置策略,未暴露 seed 參數,所以每次出圖都有隨機性。如果業務需要可復現結果,可以把 prompt 寫得非常具體(比如固定顏色碼、固定構圖描述),或者把第一次滿意的圖作爲參考圖傳入 /v1/images/edits 端點做微調。

Q8: 如何監控生產環境的穩定性?

建議在客戶端埋點統計三個指標:平均出圖耗時、5xx 錯誤率、URL 下載成功率。正常水位下平均耗時應在 120 秒內,5xx 錯誤率 <1%,URL 下載成功率 >99.5%。任意一項異常都說明賬號池水位偏低,需要聯繫商務側調度資源。

總結

gpt-image-2-vip 是基於 codex 官逆通道做的圖像生成商業化產品,5 個核心特性把官方直連的痛點逐一解決:30 種尺寸 + $0.03 統一計費 + 三端點兼容 + 中文原生 + 失敗不計費。對於做內容生產、電商物料、PPT 自動化、海報批量生成的團隊,這是目前性價比最好的 gpt-image-2 接入方案之一。

接入只需要切 base_url 和 model 兩處,SDK 代碼完全複用 OpenAI 官方寫法。生產環境建議把 timeout 設到 300 秒、對 5xx 做指數退避、圖片 URL 24 小時內落盤,踩過這三個坑就能穩定跑量。如果你正在評估 gpt-image-2 的生產接入方案,可以直接到 API易 apiyi.com 創建賬號,先用 vip 通道跑幾輪真實業務數據再做決策。

關於作者: APIYI 團隊專注多模型聚合接入和高併發推理基礎設施,日常處理大量圖像生成 API 接入諮詢。本文基於真實生產數據整理,如需瞭解 gpt-image-2-vip 詳細參數,可訪問 docs.apiyi.com。