2026年4月7日未明、Artificial AnalysisのVideo Arenaランキングに、誰も聞いたことのない名前が突如として現れました。その名は「HappyHorse-1.0」です。このモデルは4つの主要ランキングのうち3つで1位、1つで2位を獲得し、それまでの「王者」であったByteDanceのSeedance 2.0を60ポイントものEloレーティング差で突き放しました。しかし、72時間以内にこのモデルはランキングから姿を消し、現在に至るまで開発チームからの公式発表は一切ありません。本記事では、この動向がAI動画生成分野に与える影響について速報でお届けします。

核心的価値: HappyHorse-1.0の基本情報、能力のブレイクスルー、出自の推測、そして現在のAI動画生成市場における意味を3分で把握できます。

HappyHorse-1.0 核心情報まとめ

HappyHorse-1.0は、Artificial AnalysisのVideo Arenaに「匿名(pseudonymous)」で投稿された動画生成モデルです。公開されたGitHubリポジトリも、公式のHuggingFace上の重みも、アクセス可能なAPIも存在しません。しかし、4つの主要ランキングにおけるパフォーマンスは、ByteDanceのSeedance 2.0、Google Veo、OpenAI Soraといった公開済みの全モデルを圧倒するものでした。

| 項目 | 詳細 |

|---|---|

| モデル名 | HappyHorse-1.0 (V2バリアントを含む) |

| 出現日時 | 2026年4月7日未明 |

| 掲載プラットフォーム | Artificial Analysis Video Arena |

| 投稿方法 | 匿名 (pseudonymous) |

| モデル規模 | 約15Bパラメータ |

| アーキテクチャ | 40層シングルストリーム Self-Attention Transformer |

| マルチモーダル | テキスト / 動画 / 音声 統合事前学習 |

| 公開状況 | ❌ ソースコードなし・重みなし・APIなし |

| 出自の推測 | アリババ 通義実験室 (Wan 2.7?) |

| 現在の状況 | ランキングから削除済み |

💡 クイック理解: HappyHorse-1.0は「製品」ではなく、「匿名の能力公開テスト」でした。このような「まず匿名でランキングに参加し、後に正式発表する」というリリース手法は、過去1年間にLMArena、Image Arena、Code Arenaなどで何度も見られており、その背後にはほぼ毎回、大手モデル開発企業が存在しています。現在利用可能な動画生成モデルを比較・体験したい場合は、APIYI (apiyi.com) プラットフォームを通じて主要なモデルを迅速に呼び出すことができます。

title: "HappyHorse-1.0:AIビデオ生成の新たな王者?技術アーキテクチャとランキング分析"

description: "AIビデオ生成の最新モデル「HappyHorse-1.0」を徹底解説。Artificial Analysisのランキングでの圧倒的な成績と、革新的な「単流Transformer」アーキテクチャの秘密に迫ります。"

HappyHorse-1.0 のアリーナランキング戦績

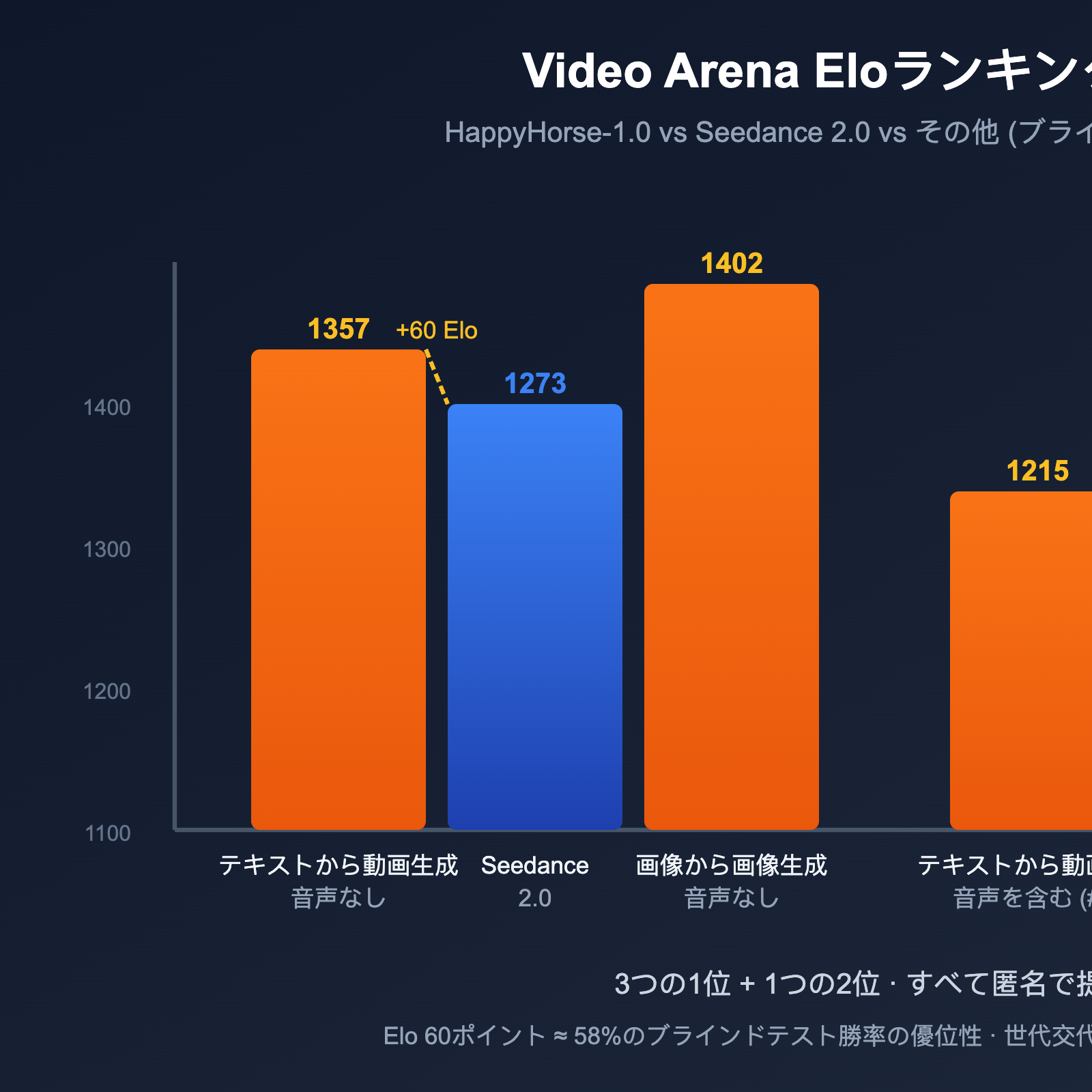

「Artificial Analysis」は、AIビデオ生成分野において最も信頼性の高いブラインドテストランキングの一つです。Eloレーティングとユーザーによるブラインド投票を採用しており、メーカー側の主観を排除した評価を行っています。4月7日にランクインした際のHappyHorse-1.0の成績は以下の通りです。

| カテゴリ | HappyHorse-1.0 Elo | 順位 | 前回の1位 |

|---|---|---|---|

| テキストから画像生成 (音声なし) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| 画像から画像生成 (音声なし) | 1392-1402 | 🥇 #1 | — |

| テキストから画像生成 (音声あり) | 1205-1215 | 🥈 #2 | — |

| 画像から画像生成 (音声あり) | 1160 | 🥇 #1 | — |

特に衝撃的なのは**「テキストから画像生成(音声なし)」部門です。HappyHorse-1.0は登場直後から、それまでの王者であったByteDanceの「Seedance 2.0」を60 Eloポイント**も上回りました。Eloレーティングにおいて60ポイントの差は、約58%の勝率の優位性を意味し、これは非常に大きな技術的隔たりと言えます。

HappyHorse-1.0 の技術アーキテクチャ考察

公式論文はまだ公開されていませんが、HappyHorse-1.0のリリースページやWaveSpeedAIなどの第三者分析により、多くのアーキテクチャ詳細が明らかになりました。もしこれが事実であれば、オープンソースコミュニティとして初めて「エンドツーエンドの音動画統合事前学習」を実現したことになります。

単流(Single-stream)統合Transformer

HappyHorse-1.0は、40層のSelf-Attention Transformerを採用しています。テキストトークン、参照画像latent、ノイズ付加された動画トークン、ノイズ付加された音声トークンを同一のシーケンスにパッケージ化し、一括でノイズ除去を行います。これは、SoraやSeedanceなどが採用している主流の「デュアルタワー+Cross-Attention」方式とは大きく異なります。

- 最初と最後の4層:モダリティ固有のプロジェクションを使用し、入出力を処理

- 中間の32層:パラメータを完全に共有し、すべてのモダリティを平等に処理

- Cross-Attentionなし:すべてのモダリティが同一の注意機構内で相互作用

この「フルSelf-Attention単流」方式は、GPT-4oやGemini 2.xがマルチモーダル分野で追求しているパラダイムですが、ビデオ生成分野において「オープンソースかつ最高性能」という形で登場したのは今回が初めてです。

音動画の統合生成

HappyHorse-1.0は、動画、セリフ、環境音、フォーリー効果音を一度の推論で同時に生成できると謳っており、6言語(中、英、日、韓、独、仏)に対応しています。また、サブサイトでは広東語への対応や「極めて低いWER(単語誤り率)のリップシンク」もアピールされています。

これらの指標がすべて事実であれば、HappyHorse-1.0の「エンドツーエンドの音動画事前学習」における優位性は、ランキングが示す以上に大きい可能性があります。

推論速度

| 設定 | 時間 |

|---|---|

| 5秒 256p 動画 | 約2秒 |

| 5秒 1080p 動画 (H100) | 約38秒 |

もしこの速度が事実であれば、15Bパラメータ規模のビデオモデルとしては極めて野心的であり、リアルタイム生成の境界線に迫る性能と言えます。

HappyHorse-1.0 の出自に関する推測

匿名での提出だったため、Artificial Analysis は公開時にこのモデルを「pseudonymous(仮名)」としか記述できませんでした。しかし、コミュニティはわずかな手がかりからいくつかの有力な推測を導き出しています。

推測 1: アリババ通義実験室(Wan 2.7)

現在、コミュニティで最も支持されている推測です。理由は以下の4点です。

- タイミングの一致: 4月7日に HappyHorse-1.0 が首位に立った後、4月初旬にアリババ通義実験室が Wan 2.6 を発表しており、業界では次世代の Wan 2.7 の登場が期待されていました。

- 株式市場の反応: 香港市場のアリババ株が HappyHorse のランクイン後に一時 8% 近く上昇しており、市場がこのモデルをアリババと関連付けていたことは明らかです。

- CJK 多言語能力: モデルの中日韓三言語に対するサポートが極めて強力であり、これは中華圏や東アジアのチームに典型的な特徴です。

- 匿名でのランキング参加スタイル: アリババは以前、Qwen や Wan シリーズにおいて「まず小規模に公開し、その後正式発表する」という手法を何度も採用しています。

ただし、公式からの発表は一切なく、アリババ通義実験室が4月に正式リリースした Wan 2.7 と HappyHorse が一部の公開デモで見せたパフォーマンスには不一致が見られるため、この推測はまだ確定していません。

推測 2: ByteDance / その他の大手企業

HappyHorse は ByteDance の Seedance シリーズの次世代バリエーションではないかという声もあります。Seedance 2.0 が HappyHorse に追い抜かれた対象であるため、ByteDance が Seedance 3.0 を匿名で先行テストする動機があるという見方です。しかし、これを裏付ける証拠は今のところありません。

推測 3: 新興の華人独立チーム

HappyHorse は、これまで注目されていなかった新しい華人スタートアップチームによるものではないかという推測もあります。モデルが示した「15B + 全 Self-Attention + 音声・動画統合」という技術スタックは非常に野心的で、しがらみのない小規模チームの作品のように見えるからです。

🎯 冷静な見方: 公式が名乗り出るまで、「アリババだ」「ByteDance だ」「どこかのユニコーン企業だ」といった説はすべて推測に過ぎません。私たちが注目すべきは「それが誰か」ではなく、「それが到達した能力の限界はどこか」、そして「現在利用可能な動画モデルを使ってどのような実用的なアプリケーションを構築できるか」です。もし主流の動画モデルを即座に導入して製品検証を行いたい場合は、APIYI (apiyi.com) を通じて、複数の利用可能なモデルを一括で呼び出すことができます。

HappyHorse-1.0 が謎の消滅を遂げた 72 時間

最もドラマチックだったのは HappyHorse-1.0 の「消滅」です。4月7日未明に Artificial Analysis のランキングで首位を獲得してから 72 時間も経たないうちに、HappyHorse シリーズのモデルはランキングから突然姿を消しました。後に残されたのは以下のものだけです。

- SNS 上で拡散された数枚のスクリーンショット

- 暗号化された公式ランディングページ(「GitHub / HuggingFace で近日公開」と記載されているが、リンクはすべて機能せず)

- Artificial Analysis 自身が確認した「撤回済み」という公式説明

このような「ランキング登場 → 消滅」というシナリオは、LMArena でも過去に何度も見られました。GPT-4 Turbo の初期匿名バージョン、Claude 3.5 Sonnet のプレビュー版、Gemini 2.0 Flash の初期バリエーションなども同様のプロセスを辿っています。匿名モデルが消滅した後、ほぼ毎回 3〜8 週間以内に正式な製品リリースが行われています。

業界内での HappyHorse に対する解釈は一致しています。これは、トップチームが正式リリースに向けて、実際のユーザーの好みに関するデータを収集するための動きであるという見方です。

HappyHorse-1.0 が AI 動画生成業界に与える影響

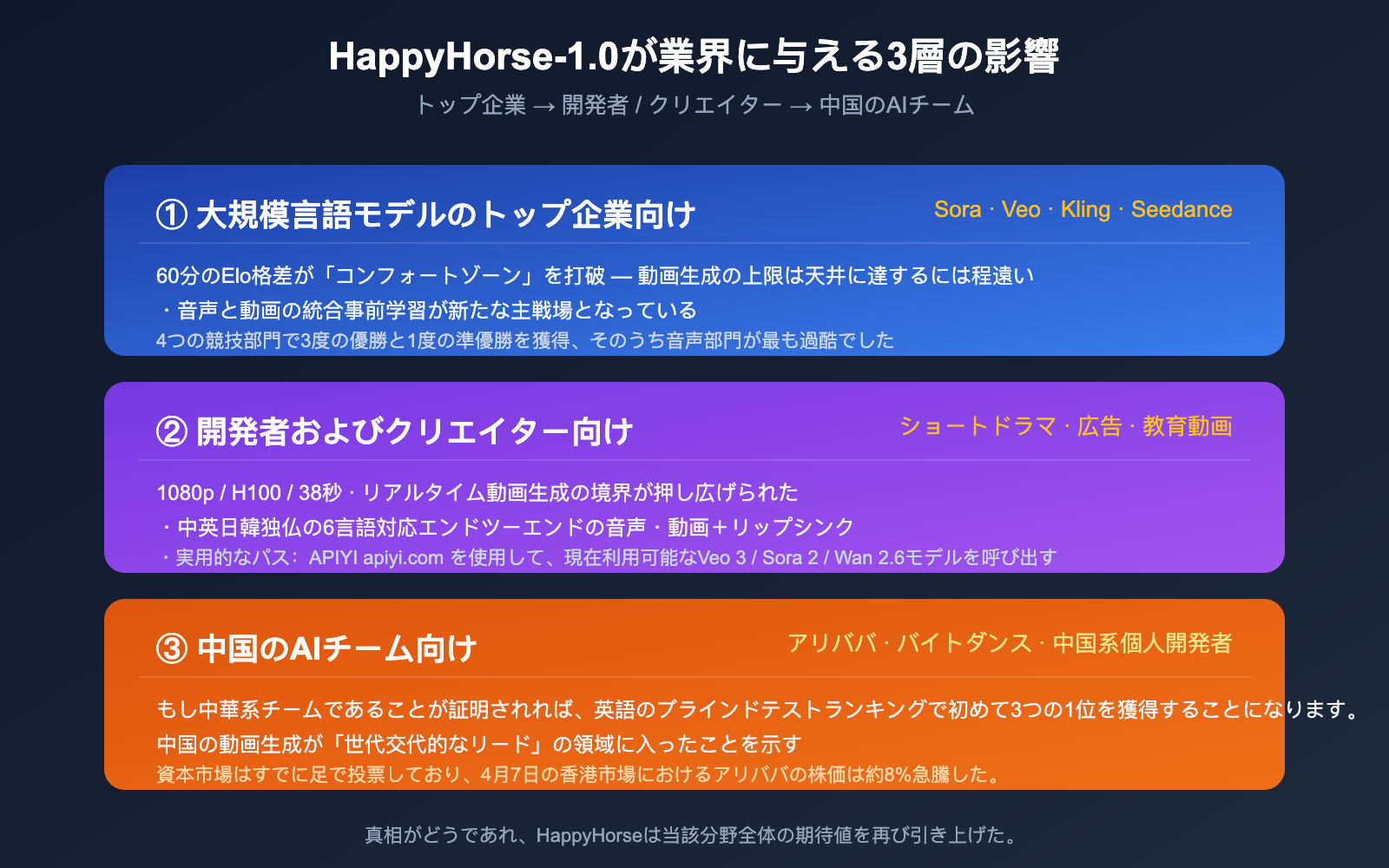

HappyHorse-1.0 は、最終的に一般公開されなかったとしても、AI動画生成業界全体に実質的な影響を与えています。

大手ベンダーへの影響

- Seedance 2.0、Veo 3、Sora 2の「安住の地」が崩壊: Eloスコアで60ポイントの差がついたことは、動画生成の能力上限がまだ遥か先にあることを示しています。

- 音と動画の統合生成が新たな戦場に: HappyHorseは4つの部門のうち3つで1位を獲得しました。特に音声統合部門でのプレッシャーが大きく、これによりすべての大手ベンダーは、オーディオと動画の事前学習(audio-video pretraining)への取り組みを加速させるでしょう。

- オープンソース/セミオープンソースへの圧力: HappyHorseは「Everything is open(すべてオープン)」と謳っており(実際にはまだ公開されていませんが)、Soraのようなクローズドな製品に対するプレッシャーを強めています。

開発者とクリエイターへの影響

- 能力への期待値が更新: 1080p / H100 / 38秒というコストパフォーマンスにより、「リアルタイム動画生成」はもはやSFではなくなりました。

- 多言語対応 + リップシンク: 中・英・日・韓・独・仏の6言語に対応したエンドツーエンドの音動画生成は、ショートドラマ、広告、教育用動画にとって大きな追い風となります。

- 現実的なアプローチは不変: HappyHorseが実際に公開されるまでは、Veo 3 / Sora 2 / Kling 2 / Wan 2.6 など、すでに利用可能なモデルを使いこなすことが、実用的な製品を構築するための最善の道です。これらは APIYI (apiyi.com) を通じて一括で呼び出すことができます。

中国のAIチームへの影響

もしHappyHorseがアリババやその他の中国系チームによる作品であることが証明されれば、これは中国のAI動画生成が、Artificial Analysisのような「地域バイアスのない」英語圏のブラインドテストランキングで3つの1位を獲得した初めての事例となります。その意義はモデルそのものを遥かに超えるものです。

HappyHorse-1.0 に関するよくある質問

Q1: HappyHorse-1.0 は今使えますか?

いいえ。Artificial AnalysisのブラインドテストArenaに約72時間だけ登場したのみで、公開APIも、ダウンロード可能な重みデータも、アクセス可能なGitHubもありません。今すぐ最高峰の動画生成モデルを利用したい場合は、APIYI (apiyi.com) を通じて、現在公開されているVeo 3、Sora 2、Kling 2、Wan 2.6などの主要モデルをご利用ください。

Q2: HappyHorse-1.0 は本当にアリババの Wan 2.7 ですか?

現時点で公式の発表はありません。コミュニティでは4つの推測理由(タイミングの一致、アリババの株価急騰、CJK多言語能力、アリババの過去のリリーススタイル)が挙げられていますが、4月に正式リリースされたWan 2.7のデモとHappyHorseは完全には一致していません。そのため、厳密には「可能性は高いが、未確認」という状況です。

Q3: 60ポイントのEloスコアの差は何を意味しますか?

Eloレーティングシステムにおいて、60ポイントの差は概ね 58%のブラインドテスト勝率 に相当します。これは非常に顕著ですが、追い越すことが不可能な差ではありません。参考までに、過去1年間でSora、Veo、Kling、Seedanceの間で順位が入れ替わる際の差は通常20〜40ポイント以内でした。HappyHorseがいきなり60ポイント差をつけたことは、まさに世代交代レベルのパフォーマンスと言えます。

Q4: 「15Bパラメータ + 全Self-Attention単流」アーキテクチャはどれほど革新的ですか?

非常に革新的です。現在の主要な動画モデルは「デュアルタワー + Cross-Attention」や「DiT + クロスモーダル投影」といった混合路線が一般的ですが、HappyHorseは音声、動画、テキストをすべて40層のTransformerでパラメータ共有させています。これはGPT-4oやGemini 2.xがマルチモーダル分野で試みている技術路線と同じですが、動画生成の分野で最高峰の性能を実証したのは今回が初めてです。

Q5: なぜランキングに72時間だけ表示されて消えたのですか?

これは匿名モデルによくある「データ収集モード」です。LMArena上のGPT-4 Turboの初期バージョン、Claude 3.5 Sonnetのプレビュー、Gemini 2.0 Flashの初期バリエーションも同様のプロセスを辿りました。公開 → 実際のユーザーの好みを収集 → 一時取り下げ → 数週間後に正式リリースという流れです。HappyHorseも3〜8週間以内に正式名称で戻ってくることが予想されます。

Q6: HappyHorseの代わりに今使える動画モデルは何ですか?

現在公開されており、総合的なパフォーマンスが高い候補としては、Google Veo 3(汎用品質でトップクラス)、OpenAI Sora 2(カメラワークが強力)、Kling 2(人物・動作が良い)、ByteDance Seedance 2.0(中国語シーンに強い)、アリババ Wan 2.6(オープンソースで導入が容易)などが挙げられます。これらを統一インターフェースで呼び出し、比較テストを行いたい場合は、APIYI (apiyi.com) プラットフォームを通じて一括接続することで、複数のアカウントを切り替える手間を省くことができます。

まとめ

HappyHorse-1.0 は、2026年4月のAI動画生成分野において最も劇的な「匿名での突然の登場」となりました。これは以下の3つのことを示唆しています。

- 動画生成能力の上限が再び引き上げられた: Eloスコアで60ポイントのリードに加え、4つの部門で3度の優勝と1度の準優勝を獲得しました。これは、私たちが現在「最強」と見ている動画モデルが、まだまだ天井には程遠いことを証明しています。

- 音と動画の統合生成が新たな主戦場に: 音声を含む部門でのHappyHorseの圧倒的なパフォーマンスは、業界全体がエンドツーエンドのオーディオ・ビデオ事前学習を本格的に検討するきっかけとなるでしょう。

- 「匿名公開 → 一時撤回 → 正式リリース」がフラッグシップモデルの標準的なリリース形態に: 今後3〜8週間以内に、おなじみのメーカーが正式に開発元を名乗り出ると予想されます。

🚀 アクションアドバイス: HappyHorseが正式に公開されるまで、最も現実的な対応は「その正体を推測すること」ではなく、現在利用可能なトップクラスの動画モデルを使いこなすことです。Veo 3、Sora 2、Kling 2、Seedance 2.0、Wan 2.6といったモデルは、実務上の90%のニーズを十分にカバーできます。APIYI(apiyi.com)を通じて主要な動画モデルを一括接続し、従量課金で柔軟に切り替えながら、HappyHorseやWan 2.7が正式公開された際に即座に移行できるよう準備しておくことをお勧めします。

著者: APIYI Team — 開発者の皆様へ主要なAI大規模言語モデルへの安定したアクセスを提供しています。詳細は apiyi.com をご覧ください。

参考資料

-

WaveSpeedAI ブログ – What Is HappyHorse-1.0

- リンク:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - 説明: アーキテクチャ、パラメータ、および推論速度に関する第三者による詳細分析

- リンク:

-

Artificial Analysis – Video Arena Leaderboard

- リンク:

artificialanalysis.ai/video/leaderboard/text-to-video - 説明: テキストから画像生成および画像から画像生成のランキング元データ

- リンク:

-

Phemex News – HappyHorse Tops Rankings

- リンク:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - 説明: HappyHorseとSeedance 2.0の比較データ

- リンク:

-

36Kr – Mysterious Model HappyHorse

- リンク:

eu.36kr.com/en/p/3757826958635781 - 説明: 匿名モデル登場に関する業界の解釈

- リンク:

-

Futunn – 阿里港股因 HappyHorse 大涨

- リンク:

news.futunn.com/en/post/71208943 - 説明: 開発元に関する推測に対する資本市場の反応

- リンク:

-

DEV Community – Who Developed HappyHorse

- リンク:

dev.to/calvin_claire_451169e1b82 - 説明: 開発チームに関するコミュニティ内での様々な推測

- リンク: