Am frühen Morgen des 7. April 2026 tauchte plötzlich ein Name in der Video Arena von Artificial Analysis auf, den bisher niemand auf dem Schirm hatte: HappyHorse-1.0. Das Modell sicherte sich auf Anhieb drei erste und einen zweiten Platz in den vier wichtigsten Bestenlisten und ließ den bisherigen „Dominator“, ByteDance Seedance 2.0, mit einem Vorsprung von 60 Elo-Punkten weit hinter sich. Doch innerhalb von 72 Stunden verschwand das Modell spurlos von der Liste; bis heute hat sich kein Team dazu bekannt. Dieser Artikel analysiert kurz und knapp, was dieser Vorfall für den Bereich der KI-Bilderzeugung bedeutet.

Kernbotschaft: In 3 Minuten erfahren Sie alles über HappyHorse-1.0, seine Leistungssprünge, Spekulationen über seine Herkunft und was das für den aktuellen Markt der KI-Bilderzeugung bedeutet.

HappyHorse-1.0: Die wichtigsten Fakten auf einen Blick

HappyHorse-1.0 ist ein Modell zur Bilderzeugung, das unter einem Pseudonym in der Video Arena von Artificial Analysis auftauchte. Es gibt kein öffentliches GitHub-Repository, keine offiziellen HuggingFace-Gewichte und keine zugängliche API. Dennoch stellte es in den vier wichtigsten Bestenlisten alle öffentlich verfügbaren Modelle – einschließlich ByteDance Seedance 2.0, Google Veo und OpenAI Sora – in den Schatten.

| Merkmal | Details |

|---|---|

| Modellname | HappyHorse-1.0 (inkl. V2-Variante) |

| Erscheinungsdatum | 7. April 2026, früher Morgen |

| Plattform | Artificial Analysis Video Arena |

| Einreichungsart | Pseudonym |

| Modellgröße | ca. 15 Mrd. Parameter |

| Architektur | 40-Layer Single-Stream Self-Attention Transformer |

| Multimodalität | Gemeinsames Vortraining für Text / Video / Audio |

| Verfügbarkeit | ❌ Kein Quellcode · Keine Gewichte · Keine API |

| Herkunftsvermutung | Alibaba Tongyi Lab (Wan 2.7?) |

| Aktueller Status | Von der Bestenliste entfernt |

💡 Kurz gefasst: HappyHorse-1.0 ist kein "Produkt", sondern ein "anonymer Leistungstest". Dieses Veröffentlichungsmuster – erst anonymes Testen, dann offizielle Bekanntgabe – ist im letzten Jahr bereits häufiger bei LMArena, Image Arena und Code Arena aufgetreten und steht meist für ein führendes KI-Unternehmen. Wenn Sie die aktuell verfügbaren Modelle zur Bilderzeugung vergleichen möchten, können Sie über die Plattform APIYI (apiyi.com) schnell auf die wichtigsten Kandidaten zugreifen.

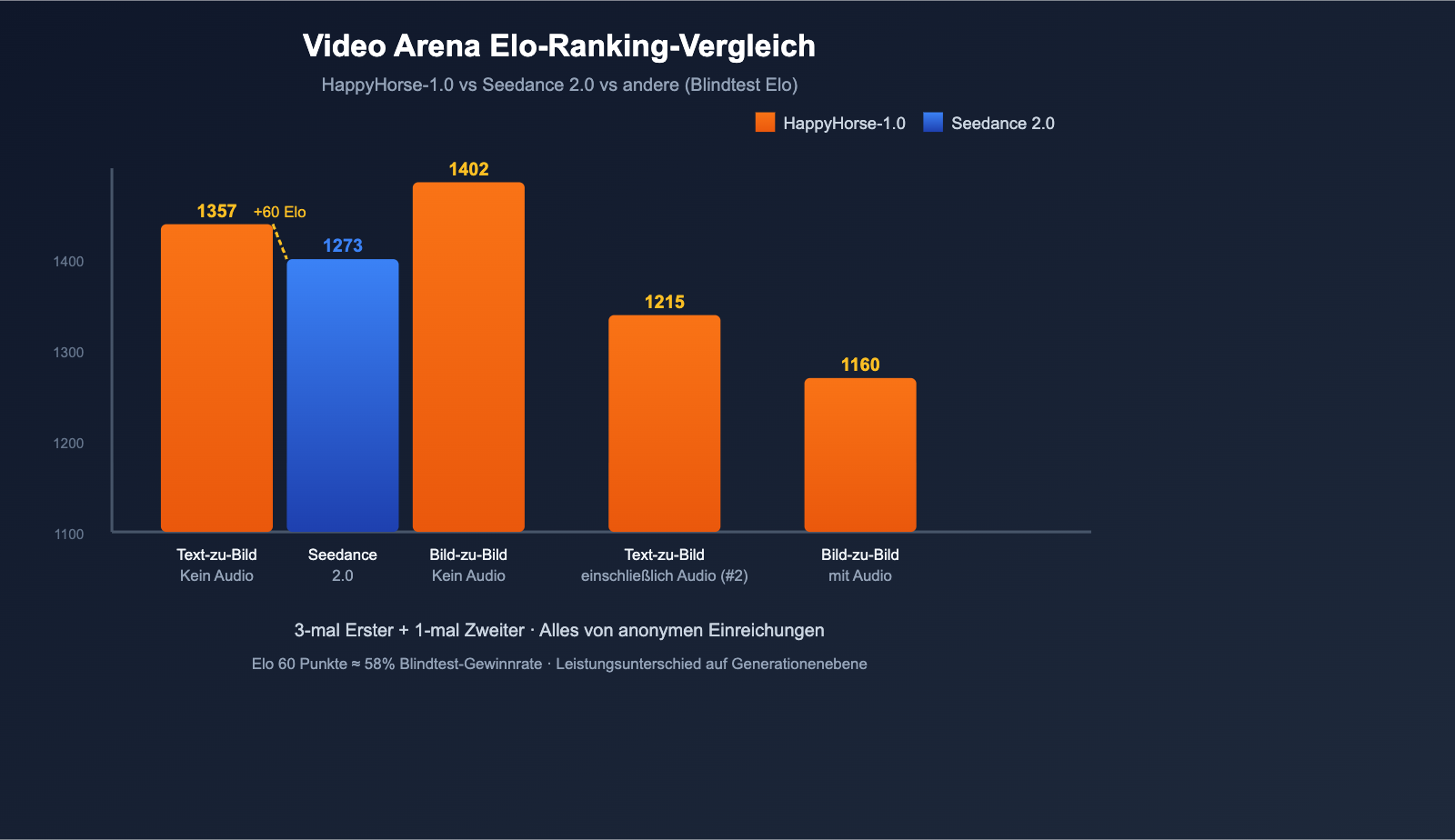

Arena-Ranking von HappyHorse-1.0

Artificial Analysis ist eine der maßgeblichen Blindtest-Ranglisten im Bereich der KI-Videogenerierung. Durch das Verfahren aus Elo-Bewertung und Nutzer-Blindabstimmung werden subjektive Herstellerangaben vermieden. Hier sind die Ergebnisse von HappyHorse-1.0 vom 7. April:

| Kategorie | HappyHorse-1.0 Elo | Rang | Vorheriger Spitzenreiter |

|---|---|---|---|

| Text-zu-Bild (ohne Audio) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| Bild-zu-Bild (ohne Audio) | 1392-1402 | 🥇 #1 | — |

| Text-zu-Bild (mit Audio) | 1205-1215 | 🥈 #2 | — |

| Bild-zu-Bild (mit Audio) | 1160 | 🥇 #1 | — |

Besonders beeindruckend ist die Kategorie Text-zu-Bild ohne Audio: HappyHorse-1.0 übertraf den bisherigen Marktführer Seedance 2.0 von ByteDance auf Anhieb um 60 Elo-Punkte. Im Elo-System entspricht dies einem Gewinnvorteil von etwa 58 %, was einem deutlichen technologischen Vorsprung gleichkommt.

Vermutungen zur technischen Architektur von HappyHorse-1.0

Obwohl es kein offizielles Whitepaper gibt, haben die Veröffentlichungsseite von HappyHorse-1.0 sowie Analysen Dritter (wie WaveSpeedAI) Details zur Architektur enthüllt. Sollten diese zutreffen, wäre dies das erste Mal, dass in der Open-Source-Community ein "End-to-End Audio-Video-Joint-Pretraining" realisiert wurde.

Single-Stream Unified Transformer

HappyHorse-1.0 nutzt einen 40-Layer Self-Attention Transformer, der Text-Token, Referenzbild-Latents sowie verrauschte Video- und Audio-Token in einer einzigen Sequenz gemeinsam entrauscht. Dies unterscheidet sich grundlegend vom gängigen "Dual-Tower + Cross-Attention"-Ansatz (wie bei Sora oder Seedance):

- Erste und letzte 4 Layer: Nutzung modalitätsspezifischer Projektionen für Ein- und Ausgaben.

- Mittlere 32 Layer: Vollständig geteilte Parameter, die alle Modalitäten gleich behandeln.

- Keine Cross-Attention: Alle Modalitäten interagieren innerhalb desselben Aufmerksamkeitsmechanismus.

Dieser "Full Self-Attention Single-Stream"-Ansatz ist ein Paradigma, das GPT-4o und Gemini 2.x im multimodalen Bereich verfolgen, erscheint hier aber erstmals als "Open Source mit Top-Performance" im Bereich der Videogenerierung.

Audio-Video-Joint-Generation

HappyHorse-1.0 unterstützt laut Angaben die gleichzeitige Generierung von Video, Dialogen, Umgebungsgeräuschen und Foley-Effekten in einem einzigen Inferenzschritt und deckt dabei 6 Sprachen ab (Chinesisch, Englisch, Japanisch, Koreanisch, Deutsch, Französisch). Sekundäre Quellen erwähnen zudem Kantonesisch und eine "Lippensynchronisation mit extrem niedriger WER".

Sollten sich diese Werte bestätigen, wäre der Vorsprung von HappyHorse-1.0 beim "End-to-End Audio-Video-Pretraining" noch größer, als es die Rangliste vermuten lässt.

Inferenzgeschwindigkeit

| Konfiguration | Zeit |

|---|---|

| 5 Sek. 256p Video | ~2 Sek. |

| 5 Sek. 1080p Video (H100) | ~38 Sek. |

Sollte dies korrekt sein, wäre die Geschwindigkeit für ein Videomodell mit 15 Mrd. Parametern äußerst ambitioniert und nähert sich der Grenze zur Echtzeitgenerierung.

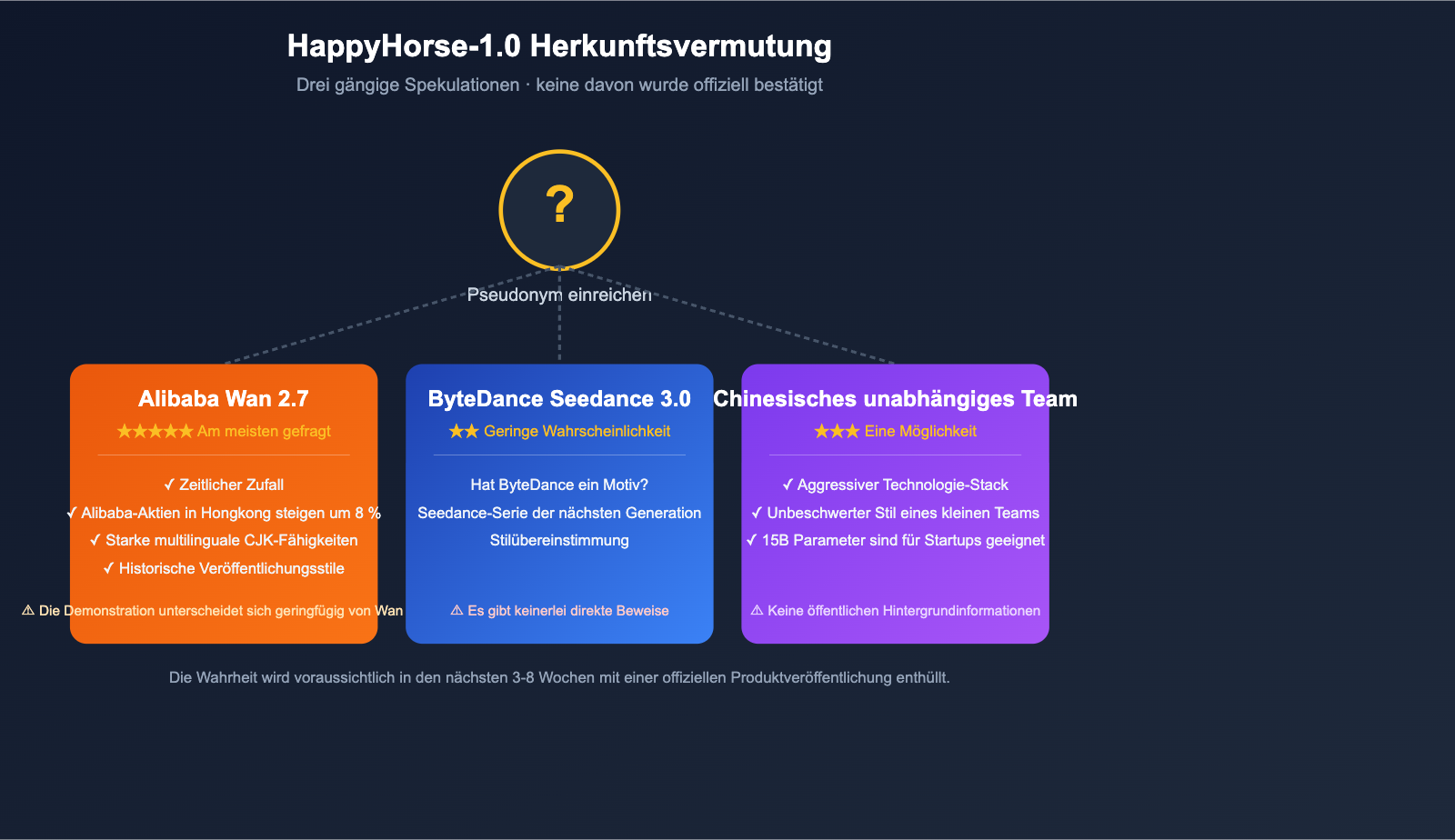

Spekulationen zur Herkunft von HappyHorse-1.0

Da die Einreichung anonym erfolgte, musste Artificial Analysis das Modell bei der Veröffentlichung als "pseudonym" bezeichnen. Dennoch hat die Community anhand einiger Indizien einige gängige Theorien aufgestellt.

Vermutung 1: Alibaba Tongyi Lab (Wan 2.7)

Dies ist derzeit die am häufigsten genannte Vermutung in der Community, und zwar aus vier Gründen:

- Zeitlicher Zufall: Nachdem HappyHorse-1.0 am 7. April die Spitze erreichte, veröffentlichte das Alibaba Tongyi Lab Anfang April Wan 2.6. Die Branche erwartete allgemein, dass die nächste Generation, Wan 2.7, bald folgen würde.

- Reaktion des Kapitalmarktes: Die Alibaba-Aktie an der Hongkonger Börse stieg nach dem Erscheinen von HappyHorse um fast 8 %; der Markt brachte es offensichtlich mit Alibaba in Verbindung.

- CJK-Mehrsprachigkeit: Das Modell verfügt über eine extrem starke Unterstützung für Chinesisch, Japanisch und Koreanisch – ein typisches Merkmal für Teams aus dem chinesischsprachigen Raum bzw. Ostasien.

- Anonymer Veröffentlichungsstil: Alibaba hat bereits bei der Qwen- bzw. Wan-Serie mehrfach den Rhythmus "erst kleine, begrenzte Veröffentlichung / dann offizielle Bekanntgabe" gewählt.

Allerdings hat das Unternehmen dies bisher nicht bestätigt, und das im April offiziell veröffentlichte Wan 2.7 des Alibaba Tongyi Labs zeigt in einigen öffentlichen Demos nicht exakt dieselbe Leistung wie HappyHorse, weshalb diese Theorie noch nicht bewiesen ist.

Vermutung 2: ByteDance / andere große Tech-Konzerne

Einige Stimmen vermuten, dass HappyHorse eine Variante der nächsten Generation der Seedance-Serie von ByteDance sein könnte, da es das Modell Seedance 2.0 übertroffen hat. ByteDance hätte ein Motiv, die Seedance 3.0-Technologie anonym vorab zu testen. Bisher gibt es jedoch keinerlei Beweise dafür.

Vermutung 3: Ein völlig neues, unabhängiges Team aus dem chinesischsprachigen Raum

Andere vermuten, dass HappyHorse von einem völlig neuen, bisher unbeachteten Startup-Team stammt. Der technische Stack des Modells – "15B + vollständige Self-Attention + Audio-Video-Kombination" – ist sehr radikal und wirkt eher wie das Werk eines kleinen Teams "ohne Altlasten".

🎯 Rational betrachtet: Bis zu einer offiziellen Bestätigung sind alle Behauptungen wie "es ist Alibaba", "es ist ByteDance" oder "es ist ein Einhorn-Startup" reine Spekulation. Was uns interessieren sollte, ist nicht "wer es ist", sondern "welche Leistungsgrenze es erreicht hat" und welche bereits verfügbaren Videomodelle wir aktuell für praktische Anwendungen nutzen können. Wenn Sie für Produktvalidierungen sofort auf gängige Videomodelle zugreifen müssen, können Sie diese über den API-Proxy-Dienst APIYI (apiyi.com) zentral aufrufen.

Die mysteriösen 72 Stunden von HappyHorse-1.0

Das Dramatischste an HappyHorse-1.0 war sein „Verschwinden“. Weniger als 72 Stunden nachdem das Modell am frühen Morgen des 7. April die Spitze der Artificial Analysis-Rangliste erklommen hatte, wurde die HappyHorse-Modellreihe plötzlich von der Liste entfernt. Zurück blieben nur:

- Einige Screenshots, die in den sozialen Medien kursierten.

- Eine verschlüsselte offizielle Landingpage (die behauptete, „GitHub / HuggingFace bald verfügbar“, wobei jedoch keine Links funktionierten).

- Eine offizielle Erklärung von Artificial Analysis, die den „Rückzug“ bestätigte.

Dieses Szenario von „Ranking → Verschwinden“ gab es auf LMArena bereits mehrfach: Frühe anonyme Versionen von GPT-4 Turbo, die Vorschau von Claude 3.5 Sonnet und frühe Varianten von Gemini 2.0 Flash durchliefen ähnliche Prozesse. Fast jedes Mal, wenn ein anonymes Modell verschwindet, folgt innerhalb von 3 bis 8 Wochen eine offizielle Produktveröffentlichung.

In der Branche ist man sich über HappyHorse weitgehend einig: Ein führendes Team sammelt hier echte Nutzerpräferenzdaten, um sich auf den offiziellen Launch vorzubereiten.

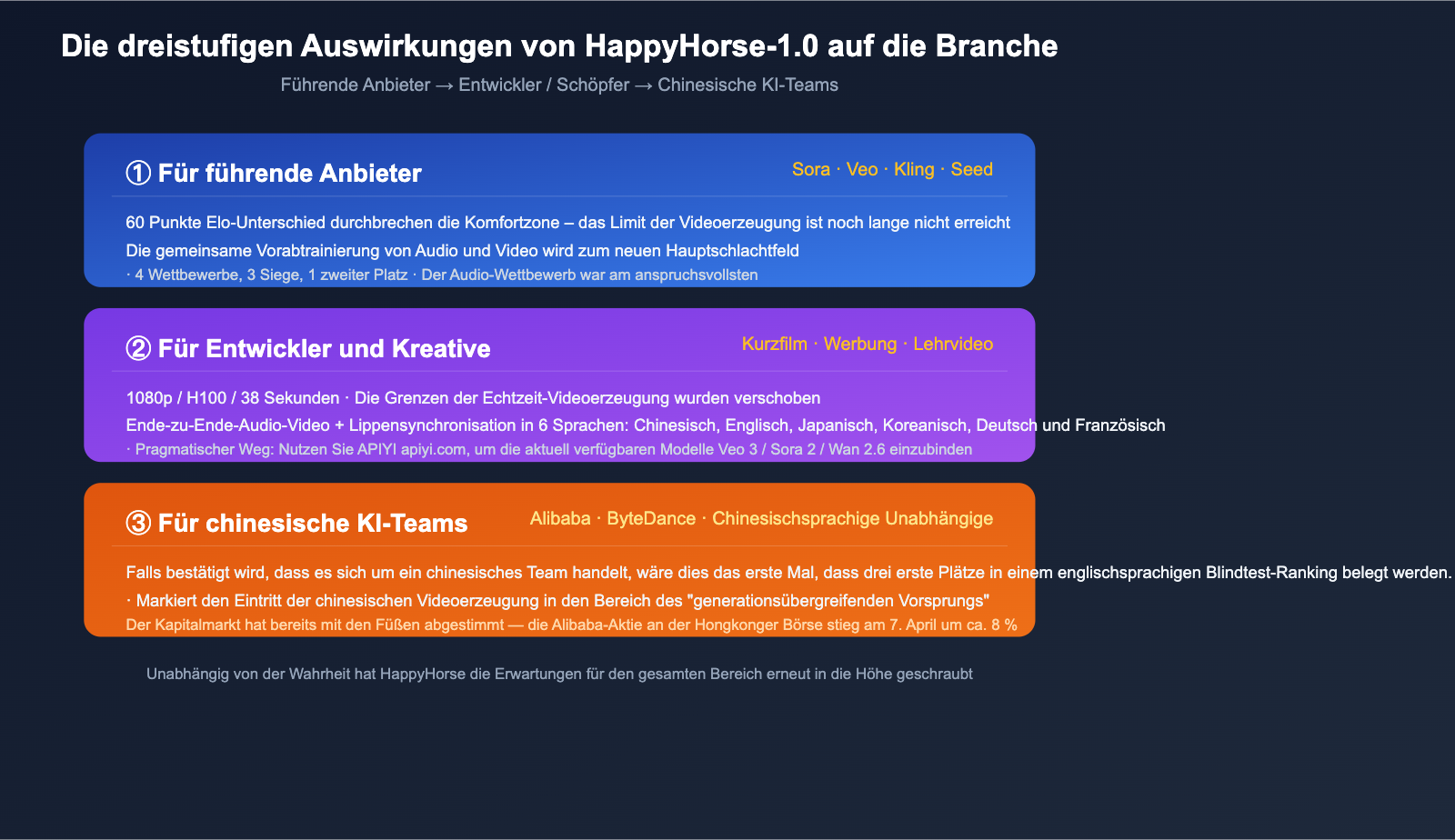

Auswirkungen von HappyHorse-1.0 auf die KI-Videoerzeugungsbranche

Selbst wenn HappyHorse-1.0 nie offiziell veröffentlicht werden sollte, hat es bereits einen substanziellen Einfluss auf den Bereich der KI-Bilderzeugung.

Auswirkungen auf führende Anbieter

- Die „Komfortzone“ von Seedance 2.0, Veo 3 und Sora 2 ist durchbrochen: Der Elo-Abstand von 60 Punkten zeigt, dass das Leistungslimit der Bilderzeugung noch lange nicht erreicht ist.

- Audio-Video-Kombination als neues Schlachtfeld: HappyHorse belegte in 4 Kategorien 3-mal den ersten Platz. Besonders der Druck im Bereich der kombinierten Audio-Video-Generierung wird alle führenden Anbieter dazu zwingen, ihre Audio-Video-Pretraining-Strategien zu beschleunigen.

- Druck auf Open-Source/Semi-Open-Source: HappyHorse bezeichnet sich selbst als „Everything is open“ (auch wenn es noch nicht wirklich quelloffen ist), was den Druck auf geschlossene Produkte wie Sora erhöht.

Auswirkungen auf Entwickler und Kreative

- Neue Erwartungen an die Leistungsfähigkeit: 1080p / H100 / 38 Sekunden – dieses Preis-Leistungs-Verhältnis macht „Echtzeit-Bilderzeugung“ greifbar.

- Mehrsprachigkeit + Lippensynchronisation: Die End-to-End-Audio-Video-Generierung in 6 Sprachen (Chinesisch, Englisch, Japanisch, Koreanisch, Deutsch, Französisch) ist ein riesiger Vorteil für Kurzfilme, Werbung und Bildungsvideos.

- Pragmatischer Ansatz bleibt: Bis HappyHorse tatsächlich verfügbar ist, bleibt die Nutzung bereits verfügbarer Modelle wie Veo 3, Sora 2, Kling 2 oder Wan 2.6 der beste Weg für die Produktentwicklung. Diese lassen sich bequem über APIYI (apiyi.com) zentral anbinden.

Auswirkungen auf chinesische KI-Teams

Sollte sich bestätigen, dass HappyHorse ein Werk von Alibaba oder einem anderen chinesischen Team ist, wäre dies das erste Mal, dass ein chinesisches KI-Video-Team auf der „gebietsneutralen“ englischsprachigen Blindtest-Rangliste von Artificial Analysis drei erste Plätze belegt. Diese Bedeutung geht weit über das Modell selbst hinaus.

HappyHorse-1.0 Häufig gestellte Fragen (FAQ)

Q1: Ist HappyHorse-1.0 aktuell verfügbar?

Nein. Es war lediglich für etwa 72 Stunden in der Blindtest-Arena von Artificial Analysis zu sehen. Es gibt keine öffentliche API, keine herunterladbaren Gewichte und kein zugängliches GitHub-Repository. Wenn Sie sofort auf erstklassige Videogenerierungsmodelle zugreifen möchten, können Sie über APIYI (apiyi.com) aktuelle Modelle wie Veo 3, Sora 2, Kling 2 oder Wan 2.6 nutzen.

Q2: Ist HappyHorse-1.0 wirklich Alibabas Wan 2.7?

Bisher gibt es keine offizielle Bestätigung. In der Community gibt es vier Indizien (zeitliche Übereinstimmung, Kursanstieg der Alibaba-Aktie, CJK-Mehrsprachigkeit, Alibabas Veröffentlichungsstil). Da die Demos von Wan 2.7 nach der offiziellen Veröffentlichung im April jedoch nicht vollständig mit HappyHorse übereinstimmten, lautet die präzise Einschätzung: Hohe Wahrscheinlichkeit, aber nicht bestätigt.

Q3: Was bedeutet der Elo-Vorsprung von 60 Punkten genau?

Im Elo-Bewertungssystem entspricht ein Vorsprung von 60 Punkten in etwa einer Blindtest-Siegquote von 58 %. Das ist ein sehr deutlicher, aber noch überwindbarer Abstand. Zum Vergleich: Die Verschiebungen zwischen Sora, Veo, Kling und Seedance lagen im letzten Jahr meist innerhalb von 20–40 Punkten. Dass HappyHorse direkt mit 60 Punkten einsteigt, deutet auf einen Leistungssprung zwischen den Generationen hin.

Q4: Wie radikal ist die Architektur mit „15B Parametern + Single-Stream Self-Attention“?

Sehr radikal. Während aktuelle Videomodelle meist auf hybride Ansätze wie "Dual-Tower + Cross-Attention" oder "DiT + Cross-Modal Projection" setzen, packt HappyHorse Audio, Video und Text in einen 40-schichtigen Transformer mit geteilten Parametern. Dies ist derselbe technische Weg, den GPT-4o und Gemini 2.x im multimodalen Bereich verfolgen, wurde jedoch im Bereich der Videogenerierung erstmals mit Spitzenleistung validiert.

Q5: Warum verschwand das Modell nach 72 Stunden aus der Bestenliste?

Dies ist ein typisches "Datensammelmuster" für anonyme Modelle. Frühe Versionen von GPT-4 Turbo, die Vorschau von Claude 3.5 Sonnet und frühe Varianten von Gemini 2.0 Flash durchliefen denselben Prozess: Online-Stellung → Sammeln echter Präferenzdaten → Rückzug → offizielle Veröffentlichung nach einigen Wochen. Es ist zu erwarten, dass HappyHorse innerhalb von 3–8 Wochen unter einem offiziellen Namen zurückkehrt.

Q6: Welche Videomodelle kann ich aktuell als Alternative zu HappyHorse nutzen?

Zu den derzeit leistungsstärksten verfügbaren Modellen gehören: Google Veo 3 (Spitzenqualität), OpenAI Sora 2 (starke Kameraführung), Kling 2 (gute Porträts/Bewegungen), ByteDance Seedance 2.0 (stark bei chinesischen Inhalten) und Alibaba Wan 2.6 (Open Source + einfach bereitzustellen). Wenn Sie diese Modelle über eine einheitliche Schnittstelle für Vergleichstests nutzen möchten, können Sie dies über die Plattform APIYI (apiyi.com) tun, ohne zwischen verschiedenen Konten wechseln zu müssen.

Zusammenfassung

HappyHorse-1.0 war der dramatischste "anonyme Auftritt" im Bereich der KI-Videogenerierung im April 2026. Er verdeutlicht drei Dinge:

- Die Leistungsgrenze der Videogenerierung wurde erneut angehoben: Ein Elo-Vorsprung von 60 Punkten sowie 3 Siege und 1 zweiter Platz in vier Kategorien zeigen, dass das Ende der Fahnenstange bei den "stärksten Videomodellen" noch lange nicht erreicht ist.

- Die kombinierte Audio-Video-Generierung wird zum neuen Hauptschlachtfeld: Die starke Performance von HappyHorse in Kategorien mit Audio wird die Branche dazu bewegen, das End-to-End Audio-Video-Pretraining schneller voranzutreiben.

- "Anonym → Rückzug → Offizielle Veröffentlichung" wird zum Standard-Release-Modell für Flaggschiff-Modelle: Wir erwarten, dass ein bekannter Hersteller das Modell innerhalb von 3–8 Wochen offiziell beanspruchen wird.

🚀 Handlungsempfehlung: Bevor HappyHorse offiziell verfügbar ist, ist es am sinnvollsten, sich mit den bereits verfügbaren Top-Videomodellen vertraut zu machen. Veo 3, Sora 2, Kling 2, Seedance 2.0 und Wan 2.6 decken bereits 90 % der praktischen Produktionsszenarien ab. Wir empfehlen, die gängigen Videomodelle über APIYI (apiyi.com) zentral anzubinden. So profitieren Sie von nutzungsbasierter Abrechnung und können bei einer offiziellen Veröffentlichung von HappyHorse / Wan 2.7 sofort nahtlos migrieren.

Autor: APIYI Team — Wir bieten Entwicklern eine stabile Anbindung an führende KI-Großsprachmodelle. Besuchen Sie apiyi.com für weitere Informationen.

Referenzen

-

WaveSpeedAI Blog – Was ist HappyHorse-1.0

- Link:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - Beschreibung: Detaillierte Drittanbieter-Analyse zu Architektur, Parametern und Inferenzgeschwindigkeit

- Link:

-

Artificial Analysis – Video Arena Bestenliste

- Link:

artificialanalysis.ai/video/leaderboard/text-to-video - Beschreibung: Original-Ranking für Text-zu-Bild- und Bild-zu-Bild-Modelle

- Link:

-

Phemex News – HappyHorse führt die Ranglisten an

- Link:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - Beschreibung: Vergleichsdaten zwischen HappyHorse und Seedance 2.0

- Link:

-

36Kr – Das mysteriöse Modell HappyHorse

- Link:

eu.36kr.com/en/p/3757826958635781 - Beschreibung: Branchenanalyse zum Erscheinen des anonymen Modells

- Link:

-

Futunn – Alibaba-Aktien steigen dank HappyHorse

- Link:

news.futunn.com/en/post/71208943 - Beschreibung: Reaktion des Kapitalmarkts auf Spekulationen zur Herkunft

- Link:

-

DEV Community – Wer hat HappyHorse entwickelt

- Link:

dev.to/calvin_claire_451169e1b82 - Beschreibung: Verschiedene Community-Spekulationen zum Entwicklerteam

- Link: