Anmerkung des Autors: Detaillierte Erläuterung des TTL-Mechanismus für Claude Code Prompt-Caching, der Unterschied zwischen den 5-Minuten- und 1-Stunden-Optionen, ein Vergleich der Cache-Abrechnung zwischen Anthropic API und AWS Bedrock sowie Tipps zur Kostenoptimierung.

„Kann man die TTL des Claude Code Prompt-Cachings ändern? Was ist der Unterschied zwischen 5 Minuten und 1 Stunde? Was ist letztendlich kostengünstiger?“ – Das sind die Fragen, die Claude Code-Nutzer bei der Kostenkontrolle am häufigsten stellen.

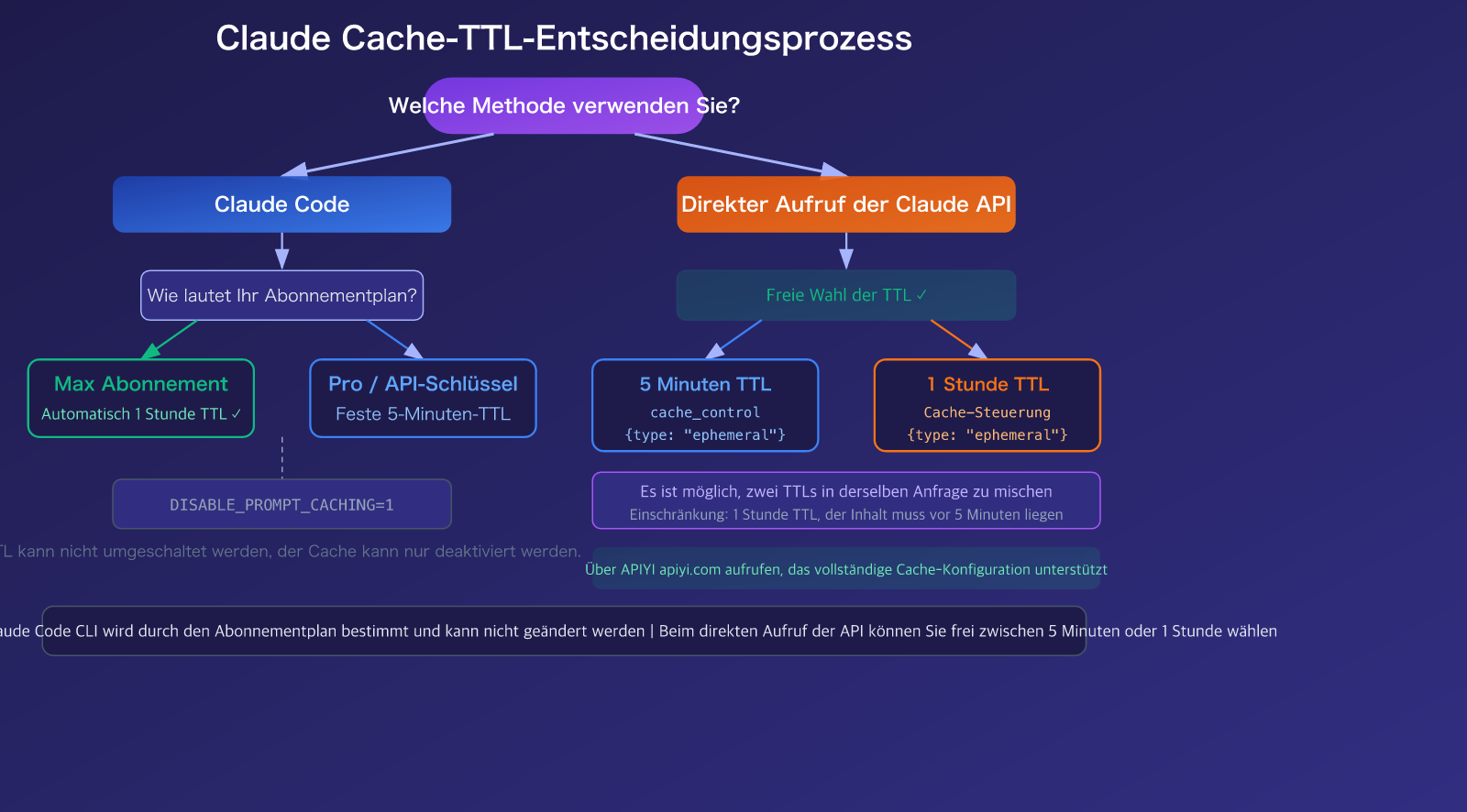

Vorab das Fazit: Die TTL des Claude Code-Cachings kann derzeit nicht direkt vom Nutzer geändert werden – sie wird durch Ihr Abonnement bestimmt. Max-Abonnenten erhalten automatisch eine TTL von 1 Stunde, während Pro-Abonnenten und API-Schlüssel-Nutzer standardmäßig eine TTL von 5 Minuten erhalten. Wenn Sie jedoch die Claude API direkt aufrufen, können Sie über den Parameter cache_control frei zwischen 5 Minuten und 1 Stunde wählen.

Kernnutzen: Nach dem Lesen dieses Artikels werden Sie den TTL-Mechanismus des Claude Prompt-Cachings vollständig verstehen, die Unterschiede in der Cache-Abrechnung zwischen der offiziellen Anthropic API und AWS Bedrock kennen und lernen, wie Sie je nach Anwendungsszenario die kostengünstigste Caching-Strategie wählen.

Kernpunkte zum Claude Prompt-Caching TTL

Prompt-Caching ist einer der wichtigsten Mechanismen zur Kosteneinsparung bei den Claude-Modellen. Dabei werden die von Ihnen zuvor gesendeten Prompt-Präfixe (System-Prompts, Tool-Definitionen, Dialogverlauf usw.) serverseitig gespeichert. Wenn bei der nächsten Anfrage das Präfix identisch ist, wird es direkt aus dem Cache gelesen, und Sie zahlen nur 10 % des regulären Eingabepreises.

| Punkt | Erläuterung | Tatsächliche Auswirkung |

|---|---|---|

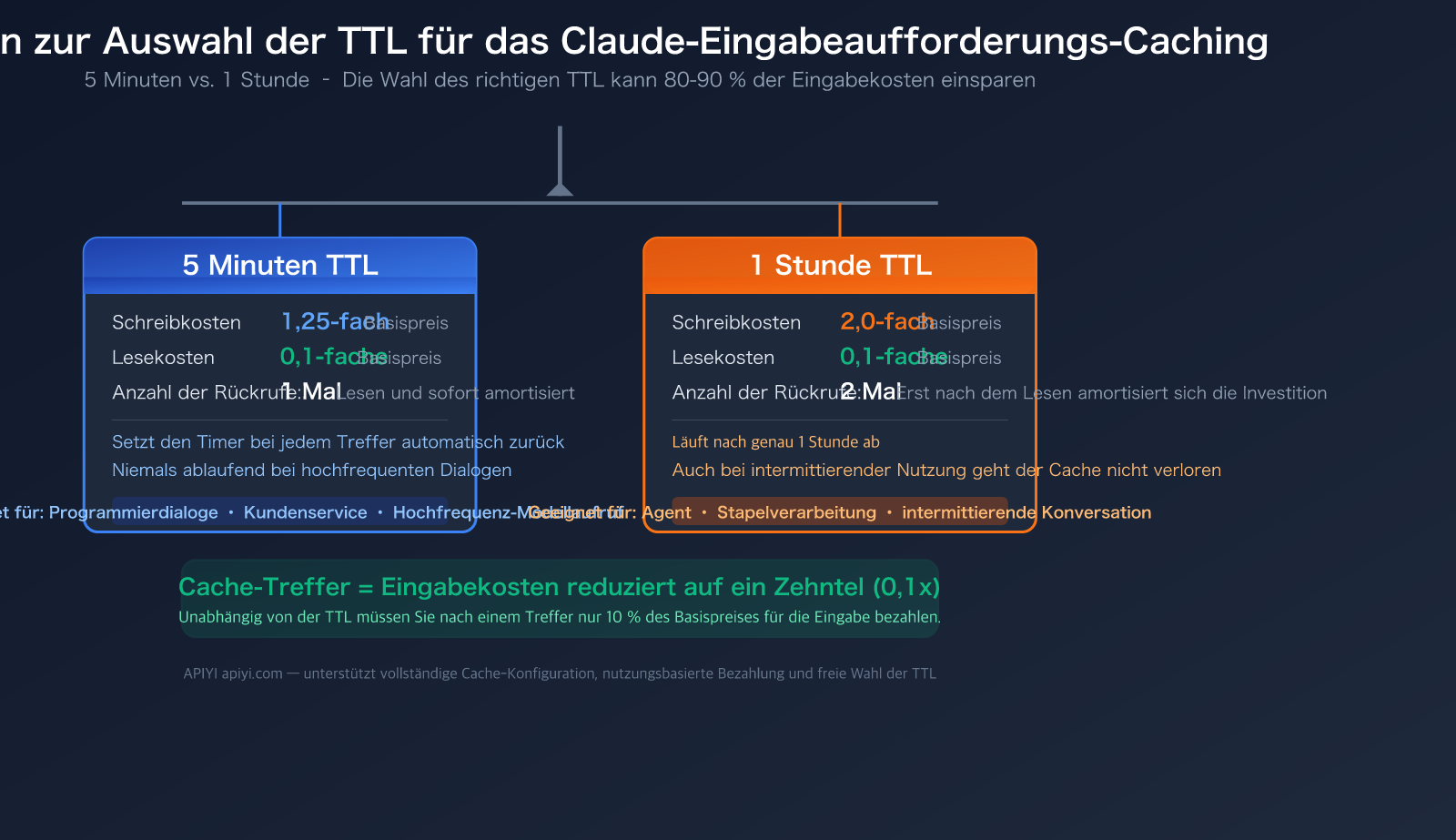

| Zwei TTL-Stufen | 5 Minuten (Standard) und 1 Stunde (optional) | Die richtige Wahl der TTL spart hohe Schreibkosten |

| Cache-Lesen nur 10 % | Nach einem Cache-Treffer kostet dieser Eingabeteil nur das 0,1-fache | Bei langen Dialogen können 80-90 % der Eingabekosten gespart werden |

| 5 Min. Schreiben = 1,25-fach | 25 % Aufschlag beim Schreiben in den Cache | Rentiert sich bereits nach einem Cache-Lesevorgang |

| 1 Std. Schreiben = 2-fach | Doppelte Kosten beim Schreiben in den Cache | Rentiert sich erst nach zwei Cache-Lesevorgängen |

| Claude Code Cache-Verwaltung | System-Prompts, Tools, CLAUDE.md werden automatisch gecacht | Keine manuelle Konfiguration durch den Nutzer erforderlich |

Kann die TTL in Claude Code geändert werden?

Dies ist die Frage, die Nutzer am meisten beschäftigt. Die Antwort hängt von zwei Szenarien ab:

Claude Code (interaktives CLI-Tool): Kann nicht manuell geändert werden. Das Caching von Claude Code wird serverseitig gesteuert – Max-Abonnenten erhalten eine TTL von 1 Stunde (gesteuert über das serverseitige Feature-Flag tengu_prompt_cache_1h_config), während Pro-Abonnenten und API-Schlüssel-Nutzer eine TTL von 5 Minuten erhalten. Sie können das Caching nur vollständig über die Umgebungsvariable DISABLE_PROMPT_CACHING=1 deaktivieren, aber nicht die TTL-Stufe wechseln.

Claude API (direkter Aufruf): Kann frei gewählt werden. Bei API-Aufrufen können Sie die TTL im Parameter cache_control festlegen:

// 5 Minuten Cache (Standard)

{ "cache_control": { "type": "ephemeral" } }

// 1 Stunde Cache

{ "cache_control": { "type": "ephemeral", "ttl": "1h" } }

🎯 Empfehlung: Wenn Sie hauptsächlich das Claude Code CLI verwenden, hängt die TTL von Ihrem Abonnement ab. Wenn Sie die API direkt aufrufen (z. B. über APIYI apiyi.com), können Sie je nach Szenario flexibel zwischen 5 Minuten oder 1 Stunde TTL wählen, um eine präzisere Kostenkontrolle zu erreichen.

Detaillierte Erläuterung der Abrechnungsregeln für Claude Prompt-Caching TTL

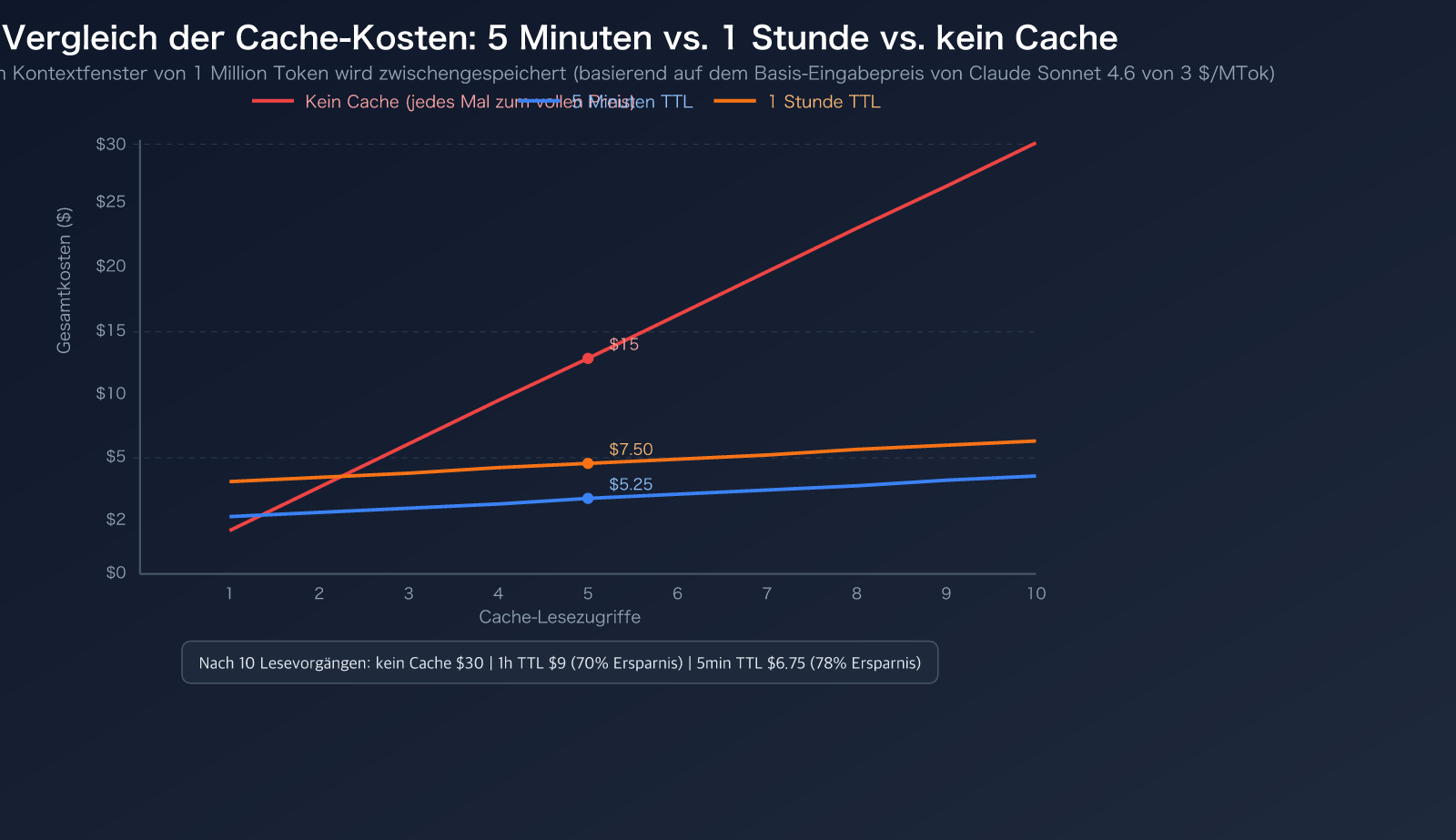

5 Minuten vs. 1 Stunde: Ein Abrechnungsvergleich

Der Hauptunterschied zwischen den beiden TTL-Optionen liegt in den Schreibkosten. Die Lesekosten sind identisch und betragen jeweils das 0,1-fache des Basis-Eingabepreises:

| Aktion | 5 Min. TTL | 1 Std. TTL | Erläuterung |

|---|---|---|---|

| Cache-Schreiben | 1,25-facher Basistarif | 2,0-facher Basistarif | Aufschlag beim ersten Schreiben in den Cache |

| Cache-Lesen | 0,1-facher Basistarif | 0,1-facher Basistarif | Rabattierter Preis bei Cache-Treffer (identisch) |

| Amortisation | Nach 1 Lesezugriff | Nach 2 Lesezugriffen | Die Nutzungshäufigkeit bestimmt, was günstiger ist |

| Automatische Verlängerung | Reset auf 5 Min. bei Treffer | Fixe 1 Std. Ablaufzeit | Bei häufigen Dialogen bleibt 5 Min. dauerhaft aktiv |

Spezifische Preise für Prompt-Caching nach Modell

Hier ist die vollständige Übersicht der Cache-Abrechnung für Anthropic-Modelle über die offizielle API (Stand: März 2026):

| Modell | Basis-Eingabepreis | Schreiben (5 Min.) | Schreiben (1 Std.) | Cache-Lesen | Ausgabepreis |

|---|---|---|---|---|---|

| Claude Opus 4.6 | $5/MTok | $6,25/MTok | $10/MTok | $0,50/MTok | $25/MTok |

| Claude Sonnet 4.6 | $3/MTok | $3,75/MTok | $6/MTok | $0,30/MTok | $15/MTok |

| Claude Haiku 4.5 | $1/MTok | $1,25/MTok | $2/MTok | $0,10/MTok | $5/MTok |

Wichtige Erkenntnis: Der Rabatt beim Cache-Lesen ist enorm. Am Beispiel von Claude Opus 4.6:

- Normaler Input von 1 Mio. Token = $5,00

- Cache-Lesen von 1 Mio. Token = $0,50 (Ersparnis $4,50, entspricht 90 % Rabatt)

- Genau deshalb ist die monatliche Gebühr von $20 für Claude Code Pro wirtschaftlich sinnvoll – 100 Opus-Dialogrunden ohne Cache könnten $50–100 kosten, mit Cache liegen sie bei nur $10–19.

Mindestanforderungen für Cache-Token

Nicht jeder Inhalt kann zwischengespeichert werden. Jedes Modell hat eine Mindestanzahl an Token; ist der Inhalt zu kurz, wird kein Caching ausgelöst:

| Modell | Mindest-Token für Cache |

|---|---|

| Claude Opus 4.6 / 4.5 | 4.096 |

| Claude Sonnet 4.6 | 2.048 |

| Claude Sonnet 4.5 / 4 | 1.024 |

| Claude Haiku 4.5 | 4.096 |

| Claude Haiku 3.5 / 3 | 2.048 |

🎯 Praktischer Tipp: Wenn Ihre System-Eingabeaufforderung kurz ist (z. B. weniger als 2.048 Token), wird bei Claude Sonnet 4.6 kein Caching ausgelöst. Sie können den Schwellenwert erreichen, indem Sie den System-Prompt erweitern oder Tool-Definitionen zusammenfassen. Auch bei Aufrufen über APIYI (apiyi.com) wird Caching unterstützt, zudem zu attraktiveren Konditionen.

Anthropic API vs. AWS Bedrock: Vergleich der Cache-Abrechnung

Vergleich der Cache-Unterstützung auf den drei großen Plattformen

Das Prompt-Caching von Claude wird von der offiziellen Anthropic API, AWS Bedrock und Google Vertex AI unterstützt, wobei es im Detail Unterschiede gibt:

| Vergleichsmerkmal | Anthropic offizielle API | AWS Bedrock | Google Vertex AI |

|---|---|---|---|

| 5 Min. TTL | ✅ Alle Modelle | ✅ Alle Modelle | ✅ Alle Modelle |

| 1 Std. TTL | ✅ Alle Modelle | ✅ Teilweise (Opus 4.5, Sonnet 4.5, Haiku 4.5) | ✅ Unterstützt |

| Schreibaufschlag (5 Min.) | 1,25-fach | ~1,25-fach | 1,25-fach |

| Schreibaufschlag (1 Std.) | 2,0-fach | 2,0-fach | 2,0-fach |

| Leserabatt | 0,1-fach | ~0,1-fach | 0,1-fach |

| Max. Breakpoints | 4 | 4 | 4 |

| Automatisches Caching | ✅ Unterstützt | ✅ Unterstützt | ✅ Unterstützt |

| TTL-Anpassung | ✅ 5 Min./1 Std. wählbar | ✅ Wählbar (teilweise) | ✅ Wählbar |

Erläuterung der wesentlichen Unterschiede zwischen den Plattformen

Anthropic offizielle API: Bietet die vollständigste Cache-Funktionalität; alle Modelle unterstützen sowohl die 5-Minuten- als auch die 1-Stunden-TTL. Seit dem 5. Februar 2026 ist die Cache-Isolierung von der Organisationsebene auf die Arbeitsbereichsebene umgestellt worden, sodass Caches verschiedener Arbeitsbereiche innerhalb derselben Organisation unabhängig voneinander sind.

AWS Bedrock: Kündigte im Januar 2026 die Unterstützung für 1 Std. TTL an, jedoch nur für ausgewählte Modelle wie Claude Opus 4.5, Sonnet 4.5 und Haiku 4.5. Die Unterstützung für 1 Std. TTL bei den neuesten Modellen Claude Sonnet 4.6 und Opus 4.6 auf Bedrock muss noch verifiziert werden. Wenn Sie Claude Code mit Bedrock verbinden, achten Sie auf die Kompatibilitätseinstellung CLAUDE_CODE_DISABLE_EXPERIMENTAL_BETAS=1.

Google Vertex AI: Die Cache-Funktionalität entspricht weitgehend der offiziellen API, erfordert jedoch die Authentifizierung und Abrechnung über ein Google Cloud-Projekt.

🎯 Empfehlung zur Plattformwahl: Wenn Sie sich nicht mit Plattformunterschieden und Konfigurationsaufwand herumschlagen möchten, ist der einheitliche API-Aufruf über APIYI (apiyi.com) die einfachste Lösung – sie unterstützt die volle Cache-Funktionalität, ohne dass eine separate AWS IAM- oder Google Cloud-Authentifizierung erforderlich ist.

Schnelleinstieg: Claude Code Prompt-Caching

Minimalistisches Beispiel: 1 Stunde TTL-Cache einrichten

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1024,

system=[{

"type": "text",

"text": "Du bist ein professioneller Physik-Lehrassistent, der für die Beantwortung von Physikfragen der Oberstufe zuständig ist...(lange System-Eingabeaufforderung)",

"cache_control": {"type": "ephemeral", "ttl": "1h"}

}],

messages=[{"role": "user", "content": "Erkläre das dritte Newtonsche Gesetz"}]

)

print(f"Cache-Lese-Token: {response.usage.cache_read_input_tokens}")

print(f"Cache-Schreib-Token: {response.usage.cache_creation_input_tokens}")

Vollständiger Code: Gemischte Verwendung von 5-Minuten- und 1-Stunden-TTL

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Gemischte TTL: System-Eingabeaufforderung mit 1 Stunde (stabil), Dialog-Kontext mit 5 Minuten (dynamisch)

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=2048,

system=[

{

"type": "text",

"text": "Du bist ein professioneller KI-Technikberater...(lange System-Eingabeaufforderung, 2000+ Token)",

"cache_control": {"type": "ephemeral", "ttl": "1h"} # System-Eingabeaufforderung mit 1 Stunde

},

{

"type": "text",

"text": "Hier ist der bisherige Dialog-Kontext des Benutzers...(Dialogverlauf)",

"cache_control": {"type": "ephemeral"} # Dialog-Kontext mit 5 Minuten (Standard)

}

],

messages=[{"role": "user", "content": "Vergleiche die Schlussfolgerungsfähigkeiten von Claude und GPT"}]

)

# Cache-Nutzung prüfen

usage = response.usage

print(f"Normale Eingabe-Token: {usage.input_tokens}")

print(f"Cache-Lese-Token: {usage.cache_read_input_tokens}")

print(f"Cache-Schreib-Token: {usage.cache_creation_input_tokens}")

# Kostenersparnis berechnen (Beispiel Sonnet 4.6)

base_cost = (usage.input_tokens / 1_000_000) * 3

cache_cost = (usage.cache_read_input_tokens / 1_000_000) * 0.3

saved = (usage.cache_read_input_tokens / 1_000_000) * 2.7

print(f"Ersparnis diesmal: ${saved:.4f}")

Wichtiger Hinweis: Wenn Sie zwei TTL-Typen in einer Anfrage kombinieren, muss der Inhalt mit 1 Stunde Cache vor dem Inhalt mit 5 Minuten Cache stehen, da es sonst zu einem Fehler kommt.

Empfehlung: Bei der Nutzung der Claude API über APIYI (apiyi.com) wird der

cache_control-Parameter vollständig unterstützt, inklusive der freien Wahl zwischen 5-Minuten- und 1-Stunden-TTL.

5 Minuten vs. 1 Stunde TTL: Was ist die richtige Wahl?

Entscheidungstabelle

| Anwendungsszenario | Empfohlene TTL | Grund |

|---|---|---|

| Claude Code High-Frequency Coding (Minütliche Nachrichten) | 5 Minuten | Timer wird bei jedem Treffer zurückgesetzt, läuft nie ab |

| Kundenservice-Bot (Antwortintervall < 5 Min.) | 5 Minuten | Niedrige Schreibkosten (1,25-fach), hohe Trefferquote |

| Dokumentenanalyse-Agent (Intervall 5-60 Min.) | 1 Stunde | Verhindert Cache-Ablauf und erneutes Schreiben |

| Geplante Batch-Jobs (Alle 30 Minuten) | 1 Stunde | 5-Minuten-TTL würde ablaufen, 1 Stunde deckt es ab |

| Seltene API-Aufrufe (Intervall > 1 Stunde) | Kein Cache | Beide TTLs laufen ab, Schreibkosten sind Verschwendung |

| System-Eingabeaufforderung (Nahezu statisch) | 1 Stunde | Einmal schreiben, mehrfach lesen |

| Dialogverlauf (Ändert sich jede Runde) | 5 Minuten | Bei häufigen Änderungen sind niedrigere Schreibkosten effizienter |

Kostenformel

Die Kernformel zur Prüfung der Wirtschaftlichkeit:

Break-even für 5-Minuten-TTL: Cache-Inhalt wird innerhalb von 5 Minuten mindestens 1-mal gelesen

- Schreibkosten: 1,25-fach → zusätzlich 0,25-fach

- Leseersparnis: 0,9-fach pro Vorgang

- 1 Lesezugriff reicht für den Break-even (0,9 > 0,25)

Break-even für 1-Stunden-TTL: Cache-Inhalt wird innerhalb von 1 Stunde mindestens 2-mal gelesen

- Schreibkosten: 2,0-fach → zusätzlich 1,0-fach

- Leseersparnis: 0,9-fach pro Vorgang

- 2 Lesezugriffe für den Break-even erforderlich (0,9 × 2 = 1,8 > 1,0)

Häufig gestellte Fragen

Q1: Kann man das 5-Minuten-TTL in Claude Code auf 1 Stunde ändern?

Das CLI-Tool von Claude Code unterstützt keine manuelle Änderung des TTL durch den Benutzer. Max-Abonnenten erhalten automatisch ein 1-stündiges TTL (gesteuert über ein serverseitiges Feature-Flag), während für Pro- und API-Schlüssel-Benutzer das TTL fest auf 5 Minuten eingestellt ist. Wenn Sie ein 1-stündiges TTL benötigen, ohne auf ein Max-Abonnement umzusteigen, können Sie dies direkt über den Modellaufruf steuern (setzen Sie cache_control.ttl: "1h"), beispielsweise über Plattformen wie APIYI (apiyi.com) mit nutzungsbasierter Abrechnung.

Q2: Läuft das 5-Minuten-TTL nach exakt 5 Minuten ab oder wird es automatisch verlängert?

Das 5-Minuten-TTL setzt den Timer bei jedem Cache-Treffer automatisch zurück. Wenn Sie alle 1–2 Minuten eine Nachricht senden (z. B. bei einer Programmier-Konversation mit Claude Code), wird der Timer kontinuierlich zurückgesetzt und der Cache läuft nie ab. Der Cache verfällt nur, wenn Sie 5 Minuten lang keine Nachricht senden. Für Szenarien mit hoher Frequenz ist das 5-Minuten-TTL daher völlig ausreichend.

Q3: Ist die Cache-Abrechnung bei AWS Bedrock dieselbe wie bei der offiziellen Anthropic API?

Sie ist weitgehend identisch, weist jedoch geringfügige Unterschiede auf:

- Der Schreibaufschlag beträgt in beiden Fällen ~1,25x (5 Minuten) und ~2,0x (1 Stunde).

- Der Leserabatt beträgt jeweils ~0,1x.

- Unterschiede: Das 1-Stunden-TTL bei Bedrock unterstützt derzeit nur bestimmte Modelle wie Opus 4.5, Sonnet 4.5 und Haiku 4.5; für die neuesten Modelle der 4.6-Serie muss dies geprüft werden.

- Über APIYI (apiyi.com) erhalten Sie eine vollständige Cache-Unterstützung, die der offiziellen API entspricht.

Zusammenfassung

Die Kernpunkte zum TTL des Claude-Prompt-Caches:

- Zwei TTL-Optionen verfügbar: 5 Minuten (1,25-fache Schreibkosten, amortisiert nach 1 Lesezugriff) und 1 Stunde (2-fache Schreibkosten, amortisiert nach 2 Lesezugriffen); die Lesekosten betragen jeweils 0,1x.

- Claude Code CLI lässt keine TTL-Änderung zu: Max-Abonnements bieten automatisch 1 Stunde, Pro/API-Schlüssel sind auf 5 Minuten festgelegt und können nicht umgestellt werden.

- Claude API bietet volle Flexibilität: Über den Parameter

cache_control.ttlkonfigurierbar; innerhalb derselben Anfrage können verschiedene TTLs kombiniert werden. - 5 Minuten für hochfrequente Dialoge: Automatische Verlängerung bei jedem Treffer, was die Schreibkosten senkt; 1 Stunde für sporadische Nutzung, um Abläufe zu vermeiden.

Ein Cache-Treffer bedeutet, dass die Eingabekosten auf ein Zehntel sinken – dies ist der wichtigste Mechanismus zur Kostenersparnis bei Claude. Wir empfehlen die Nutzung über die einheitliche Schnittstelle von APIYI (apiyi.com), um die Cache-Konfiguration vollständig zu unterstützen und mit einem einzigen Schlüssel die tatsächlichen Kostenunterschiede verschiedener TTL-Strategien zu testen.

📚 Referenzmaterialien

-

Offizielle Anthropic-Dokumentation – Prompt Caching: Maßgebliche Quelle für TTL-Konfiguration, Abrechnungsregeln und

cache_control-Syntax- Link:

platform.claude.com/docs/en/build-with-claude/prompt-caching - Beschreibung: Vollständige Abrechnungsformeln und Codebeispiele für 5-Minuten-/1-Stunden-TTL.

- Link:

-

Offizielle Anthropic-Dokumentation – Preisgestaltung: Basispreise und Cache-Preise für alle Modelle

- Link:

platform.claude.com/docs/en/about-claude/pricing - Beschreibung: Cache-Schreib- und Leseraten für die Modelle Opus, Sonnet und Haiku.

- Link:

-

Offizielle AWS-Dokumentation – Bedrock Prompt Caching: Details zur Cache-Unterstützung auf der Bedrock-Plattform

- Link:

docs.aws.amazon.com/bedrock/latest/userguide/prompt-caching.html - Beschreibung: TTL-Unterstützungsbereiche und Abrechnungsstandards für verschiedene Modelle auf Bedrock.

- Link:

-

Claude Code Camp – Funktionsweise von Prompt Caching: Tiefgehende Analyse der Cache-Implementierung in Claude Code

- Link:

claudecodecamp.com/p/how-prompt-caching-actually-works-in-claude-code - Beschreibung: Erfahren Sie, wie Claude Code Cache-Breakpoints automatisch verwaltet.

- Link:

-

GitHub Issue #19436 – Funktionsanfrage für mehrschichtiges Cache-TTL: Diskussion der Community über flexiblere TTL-Konfigurationen

- Link:

github.com/anthropics/claude-code/issues/19436 - Beschreibung: Von der Community vorgeschlagene Lösungen für mehrschichtige TTL basierend auf der Häufigkeit von Inhaltsänderungen.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne Ihre Erfahrungen mit der Claude-Cache-Konfiguration in den Kommentaren. Weitere Tutorials zum Modellaufruf finden Sie in der APIYI-Dokumentation unter docs.apiyi.com.