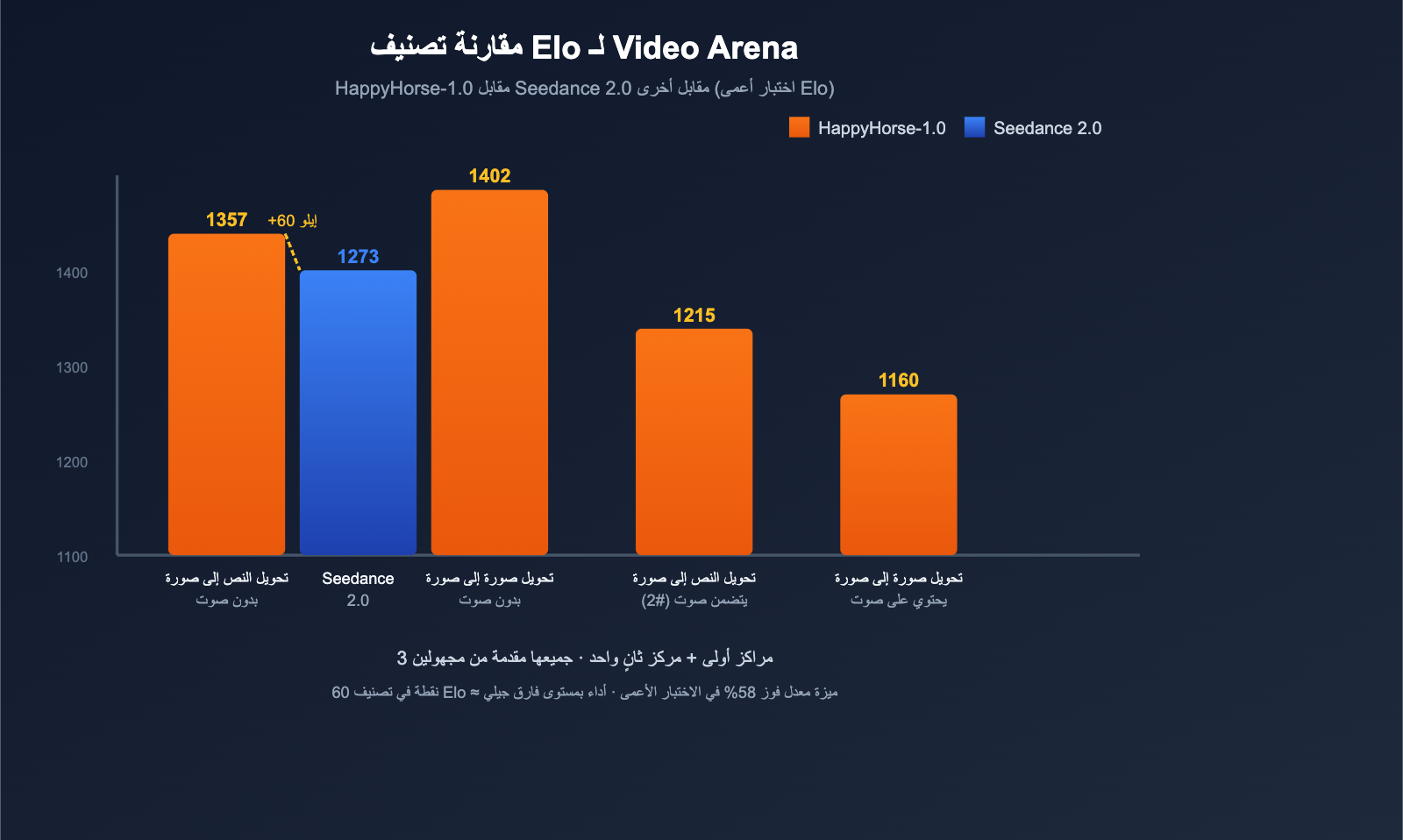

في فجر يوم 7 أبريل 2026، ظهر اسم لم يسمع به أحد من قبل بشكل مفاجئ في قائمة تصنيف Video Arena التابعة لـ Artificial Analysis، وهو HappyHorse-1.0. تمكن هذا النموذج من احتلال المركز الأول في ثلاثة من أصل أربعة تصنيفات رئيسية، والمركز الثاني في الرابع، متفوقاً على "المسيطر" السابق Seedance 2.0 من شركة ByteDance بفارق 60 نقطة في مقياس Elo. ومع ذلك، اختفى النموذج من القائمة في غضون 72 ساعة، ولم تعلن أي جهة مسؤوليتها عنه حتى الآن. يقدم هذا المقال تحليلاً سريعاً لتأثير هذا الحدث على مجال توليد الفيديو بالذكاء الاصطناعي.

القيمة الجوهرية: تعرف في 3 دقائق على المعلومات الأساسية لنموذج HappyHorse-1.0، طفراته في القدرات، التكهنات حول أصله، وما يعنيه ذلك لمجال توليد الفيديو بالذكاء الاصطناعي حالياً.

نظرة سريعة على المعلومات الجوهرية لـ HappyHorse-1.0

HappyHorse-1.0 هو نموذج لتوليد الفيديو دخل إلى ساحة Artificial Analysis Video Arena عبر "تقديم مجهول الهوية (pseudonymous)". لا يملك النموذج مستودع GitHub عاماً، ولا أوزان HuggingFace رسمية، ولا واجهة برمجة تطبيقات (API) يمكن الوصول إليها، ومع ذلك، فإن أداءه في التصنيفات الأربعة الرئيسية تفوق على جميع النماذج المتاحة للجمهور، بما في ذلك Seedance 2.0 من ByteDance، وVeo من Google، وSora من OpenAI.

| عنصر المعلومة | التفاصيل |

|---|---|

| اسم النموذج | HappyHorse-1.0 (يتضمن متغير V2) |

| وقت الظهور | فجر 7 أبريل 2026 |

| منصة التصنيف | Artificial Analysis Video Arena |

| طريقة التقديم | مجهول الهوية (pseudonymous) |

| حجم النموذج | حوالي 15 مليار معلمة |

| البنية | Transformer أحادي التدفق (Single-stream) بـ 40 طبقة |

| الوسائط المتعددة | تدريب مسبق مشترك للنص / الفيديو / الصوت |

| حالة الإتاحة | ❌ لا يوجد كود مصدري · لا توجد أوزان · لا توجد API |

| التكهن بالمصدر | مختبرات Alibaba Tongyi (Wan 2.7؟) |

| الحالة الحالية | اختفى من القائمة |

💡 فهم سريع: HappyHorse-1.0 ليس "منتجاً"، بل هو "اختبار قدرات مجهول". هذا النمط من الإصدار – "التقييم المجهول أولاً، ثم الإعلان الرسمي لاحقاً" – ظهر عدة مرات خلال العام الماضي في منصات مثل LMArena وImage Arena وCode Arena، وغالباً ما تقف خلفه إحدى شركات النماذج الكبرى. إذا كنت ترغب في تجربة ومقارنة نماذج توليد الفيديو المتاحة حالياً، يمكنك الوصول بسرعة إلى النماذج الرئيسية عبر منصة APIYI (apiyi.com).

سجل أداء HappyHorse-1.0 في تصنيفات Arena

تعد Artificial Analysis واحدة من أكثر قوائم التصنيف موثوقية في مجال توليد الفيديو بالذكاء الاصطناعي، حيث تعتمد على تقييم Elo + تصويت المستخدمين الأعمى، مما يضمن حيادية النتائج بعيداً عن ادعاءات الشركات. إليكم نتائج HappyHorse-1.0 عند دخولها القائمة في 7 أبريل:

| فئة التصنيف | HappyHorse-1.0 Elo | الترتيب | المتصدر السابق |

|---|---|---|---|

| تحويل النص إلى صورة (بدون صوت) | 1333-1357 | 🥇 #1 | Seedance 2.0 (1273) |

| تحويل صورة إلى فيديو (بدون صوت) | 1392-1402 | 🥇 #1 | — |

| تحويل النص إلى صورة (مع صوت) | 1205-1215 | 🥈 #2 | — |

| تحويل صورة إلى فيديو (مع صوت) | 1160 | 🥇 #1 | — |

الأكثر إثارة للإعجاب هو فئة تحويل النص إلى فيديو بدون صوت: حيث تفوقت HappyHorse-1.0 فور إطلاقها على المتصدر السابق Seedance 2.0 من شركة ByteDance بفارق 60 نقطة Elo. في نظام تقييم Elo، يعني فارق 60 نقطة أفضلية فوز بنسبة 58% تقريباً، وهو فارق تقني كبير.

نظرة على البنية التقنية لـ HappyHorse-1.0

على الرغم من عدم وجود ورقة بحثية رسمية، إلا أن صفحة إصدار HappyHorse-1.0 وتحليلات أطراف ثالثة مثل WaveSpeedAI كشفت عن تفاصيل معمارية مثيرة؛ وإذا صحت هذه المعلومات، فستكون هذه المرة الأولى التي يحقق فيها مجتمع المصادر المفتوحة "تدريباً مسبقاً مشتركاً للصوت والفيديو من البداية للنهاية" (End-to-End).

محول (Transformer) أحادي المسار وموحد

تستخدم HappyHorse-1.0 نموذج Self-Attention Transformer مكون من 40 طبقة، حيث يتم دمج رموز النص (tokens)، والرموز الكامنة للصورة المرجعية، ورموز الفيديو والصوت المضاف إليها الضجيج في سلسلة واحدة لإزالة الضجيج معاً. يختلف هذا النهج تماماً عن المسار السائد حالياً "البرج المزدوج + Cross-Attention" (كما في Sora أو Seedance):

- 4 طبقات في البداية والنهاية: تستخدم إسقاطات خاصة بكل نمط (modal-specific) لمعالجة المدخلات والمخرجات.

- 32 طبقة وسطى: يتم مشاركة المعلمات بالكامل، حيث يتم التعامل مع جميع الأنماط على قدم المساواة.

- لا وجود لـ Cross-Attention: تتفاعل جميع الأنماط ضمن آلية انتباه واحدة.

هذا المسار "أحادي المسار القائم على Self-Attention بالكامل" هو النموذج الذي تحاول GPT-4o وGemini 2.x استكشافه في الوسائط المتعددة، لكنها المرة الأولى التي يظهر فيها في مجال توليد الفيديو بصيغة "مفتوحة المصدر + أداء فائق".

التوليد المشترك للصوت والفيديو

تدعي HappyHorse-1.0 دعمها للتوليد في استنتاج واحد (Single Inference) للفيديو + الحوار + أصوات الخلفية + المؤثرات الصوتية (Foley)، مع تغطية 6 لغات (الصينية، الإنجليزية، اليابانية، الكورية، الألمانية، والفرنسية). كما تشير مواقع ثانوية إلى دعم اللغة الكانتونية و"مزامنة شفاه بمعدل خطأ (WER) منخفض جداً".

إذا كانت هذه المؤشرات دقيقة، فإن تفوق HappyHorse-1.0 في بُعد "التدريب المسبق للصوت والفيديو" قد يكون أكبر مما تظهره قوائم التصنيف.

سرعة الاستنتاج

| الإعدادات | الوقت |

|---|---|

| فيديو 5 ثوانٍ بدقة 256p | ~2 ثانية |

| فيديو 5 ثوانٍ بدقة 1080p (على H100) | ~38 ثانية |

إذا صحت هذه الأرقام، فإن هذه السرعة تعتبر طموحة جداً بالنسبة لنماذج الفيديو بحجم 15 مليار معلمة، وتقترب من حدود التوليد اللحظي (Real-time).

فرضيات حول أصل نموذج HappyHorse-1.0

يعني التقديم المجهول أن منصة Artificial Analysis اضطرت لاستخدام وصف "اسم مستعار" (pseudonymous) للإشارة إلى هذا النموذج عند إعلانه. ومع ذلك، تمكن المجتمع من استخلاص عدة فرضيات رئيسية من خلال تتبع الأدلة:

الفرضية الأولى: مختبرات "توني" (Tongyi) التابعة لشركة علي بابا (Wan 2.7)

هذا هو التخمين الأكثر شيوعاً في المجتمع حالياً، وذلك لأربعة أسباب:

- تزامن التوقيت: بعد تصدر HappyHorse-1.0 للقائمة في 7 أبريل، أصدر مختبر "توني" التابع لعلي بابا نموذج Wan 2.6 في أوائل أبريل، وكان هناك توقع واسع النطاق في الصناعة بأن الجيل التالي Wan 2.7 سيصدر قريباً.

- رد فعل سوق المال: ارتفعت أسهم شركة علي بابا في بورصة هونغ كونغ بنسبة تقارب 8% بعد إدراج HappyHorse، ومن الواضح أن السوق ربط بينهما.

- قدرات اللغات المتعددة (CJK): يتمتع النموذج بقدرات فائقة في دعم اللغات الصينية واليابانية والكورية، وهي سمة مميزة للفرق الصينية/شرق آسيوية.

- أسلوب الإطلاق المجهول: اتبعت علي بابا سابقاً أسلوب "الإطلاق المحدود أولاً ثم الإصدار الرسمي" مع سلسلة نماذج Qwen و Wan.

لكن لم تعترف الشركة رسمياً بذلك حتى الآن، كما أن أداء نموذج Wan 2.7 الذي أصدرته علي بابا رسمياً في أبريل لا يتطابق تماماً مع أداء HappyHorse في بعض العروض التوضيحية العامة، لذا تظل هذه الفرضية غير مؤكدة.

الفرضية الثانية: شركة بايت دانس (ByteDance) / شركات تقنية كبرى أخرى

يرى البعض أن HappyHorse قد يكون جيلاً تالياً من سلسلة Seedance التابعة لشركة بايت دانس، نظراً لأن Seedance 2.0 هو النموذج الذي تفوق عليه HappyHorse، ولدى بايت دانس دافع لاختبار Seedance 3.0 سراً. ومع ذلك، لا يوجد أي دليل يدعم هذا الادعاء حالياً.

الفرضية الثالثة: فريق صيني مستقل جديد

يتكهن البعض الآخر بأن HappyHorse يأتي من فريق ناشئ صيني جديد لم يحظَ باهتمام خارجي من قبل، لأن حزمة التقنيات التي يعرضها النموذج (15 مليار بارامتر + استخدام كامل لآلية الانتباه الذاتي + دمج الصوت والفيديو) تبدو جريئة للغاية، وتشبه أعمال الفرق الصغيرة التي لا تعاني من "قيود إرثية".

🎯 نظرة عقلانية: حتى يتم الإعلان الرسمي، تظل كل الأقوال بأن النموذج "تابع لعلي بابا" أو "بايت دانس" أو "شركة يونيكورن معينة" مجرد تكهنات. ما يستحق اهتمامنا ليس "من هو"، بل "إلى أين وصلت حدود القدرات التقنية"، وما هي نماذج الفيديو المتاحة حالياً التي يمكننا استخدامها لبناء تطبيقات عملية. إذا كنت بحاجة إلى دمج نماذج الفيديو الرئيسية في تطبيقاتك للتحقق من صحة أفكارك، يمكنك استخدام خدمة APIYI (apiyi.com) للوصول إلى نماذج متعددة من مكان واحد.

الساعات الـ 72 الغامضة لاختفاء HappyHorse-1.0

الأمر الأكثر دراماتيكية هو "اختفاء" نموذج HappyHorse-1.0. فبعد أقل من 72 ساعة على تصدره قائمة Artificial Analysis في فجر يوم 7 أبريل، تمت إزالة سلسلة نماذج HappyHorse فجأة من القائمة، ولم يتبقَّ منها سوى:

- بضع لقطات شاشة متداولة على وسائل التواصل الاجتماعي.

- صفحة هبوط رسمية مشفرة (تدعي أن "GitHub / HuggingFace سيتم فتحهما قريباً"، لكن الروابط لا تعمل).

- بيان رسمي من Artificial Analysis يؤكد فيه "سحب" النموذج.

هذا السيناريو المتمثل في "تصدر القائمة ثم الاختفاء" تكرر عدة مرات سابقاً على منصة LMArena: النسخ المجهولة المبكرة من GPT-4 Turbo، ومعاينة Claude 3.5 Sonnet، والمتغيرات المبكرة من Gemini 2.0 Flash، كلها مرت بمسار مشابه. تقريباً في كل مرة يختفي فيها نموذج مجهول، يتم إطلاق منتج رسمي في غضون 3 إلى 8 أسابيع.

التفسير السائد في الصناعة حول HappyHorse هو: أن فريقاً رائداً يقوم بجمع بيانات تفضيلات المستخدمين الحقيقية استعداداً للإطلاق الرسمي.

تأثير HappyHorse-1.0 على صناعة توليد الفيديو بالذكاء الاصطناعي

حتى لو لم يتم إطلاق HappyHorse-1.0 للجمهور في النهاية، فقد أحدث تأثيراً جوهرياً على قطاع توليد الفيديو بالذكاء الاصطناعي.

التأثير على الشركات الرائدة

- كسر "منطقة الراحة" لـ Seedance 2.0 وVeo 3 وSora 2: فجوة الـ 60 نقطة في تصنيف Elo تشير إلى أن الحد الأقصى لقدرات توليد الفيديو لم يُستكشف بالكامل بعد.

- التوليد المشترك للصوت والفيديو هو ساحة المعركة الجديدة: حقق HappyHorse المركز الأول في 3 من أصل 4 مجالات، وكان الضغط الأكبر في مجال التوليد المشترك للصوت، مما سيجبر جميع الشركات الرائدة على تسريع مسار التدريب المسبق للصوت والفيديو (audio-video pretraining).

- الضغط على النماذج مفتوحة/شبه مفتوحة المصدر: ادعاء HappyHorse بأنه "كل شيء مفتوح" (رغم أنه لم يفتح فعلياً بعد) سيزيد الضغط على المنتجات مغلقة المصدر مثل Sora.

التأثير على المطورين والمبدعين

- تحديث توقعات القدرات: دقة 1080p، معالجة H100، و38 ثانية؛ هذه النسبة بين التكلفة والأداء تجعل "توليد الفيديو الفوري" أمراً واقعياً وليس خيالاً علمياً.

- تعدد اللغات + مزامنة الشفاه: التوليد الشامل للصوت والفيديو بـ 6 لغات (الصينية، الإنجليزية، اليابانية، الكورية، الألمانية، والفرنسية) يمثل ميزة هائلة للمسلسلات القصيرة، والإعلانات، ومقاطع الفيديو التعليمية.

- المسار العملي لا يتغير: قبل أن يتم إطلاق HappyHorse فعلياً، يظل إتقان النماذج المتاحة حالياً مثل Veo 3 / Sora 2 / Kling 2 / Wan 2.6 هو المسار الأفضل لبناء منتجات حقيقية، ويمكنك الوصول إليها جميعاً عبر APIYI apiyi.com.

التأثير على فرق الذكاء الاصطناعي الصينية

إذا ثبت في النهاية أن HappyHorse هو عمل من إنتاج علي بابا أو فريق صيني آخر، فستكون هذه هي المرة الأولى التي يحقق فيها فريق صيني لتوليد الفيديو المراكز الأولى في 3 تصنيفات على منصة Artificial Analysis، وهي منصة اختبار عمياء باللغة الإنجليزية "لا تنحاز لمنطقة جغرافية". وهذا المعنى يتجاوز النموذج نفسه بكثير.

الأسئلة الشائعة حول HappyHorse-1.0

س1: هل يمكن استخدام HappyHorse-1.0 الآن؟

لا. فقد ظهر النموذج لفترة وجيزة دامت حوالي 72 ساعة فقط في ساحة الاختبار الأعمى (Arena) الخاصة بـ Artificial Analysis، ولا يتوفر له API عام، ولا أوزان قابلة للتنزيل، ولا مستودع GitHub يمكن الوصول إليه. إذا كنت بحاجة إلى استدعاء نماذج توليد فيديو رائدة فوراً، يمكنك الوصول إلى النماذج الرئيسية المتاحة حالياً مثل Veo 3 وSora 2 وKling 2 وWan 2.6 عبر خدمة APIYI (apiyi.com).

س2: هل HappyHorse-1.0 هو حقاً نموذج Wan 2.7 من علي بابا؟

لا يوجد اعتراف رسمي بذلك حتى الآن. هناك أربعة أسباب استنتجها المجتمع (تزامن التوقيت، ارتفاع أسهم علي بابا في بورصة هونج كونج، القدرات اللغوية المتعددة CJK، وأسلوب علي بابا التاريخي في الإطلاق)، ولكن العروض التوضيحية لنموذج Wan 2.7 بعد إطلاقه الرسمي في أبريل لم تكن متطابقة تماماً مع HappyHorse، لذا فإن القول الدقيق هو: الاحتمالية عالية، لكن لم يتم تأكيدها.

س3: ماذا يعني تفوقه بـ 60 نقطة في تصنيف Elo؟

في نظام تصنيف Elo، يعادل التفوق بـ 60 نقطة تقريباً معدل فوز بنسبة 58% في الاختبارات العمياء. هذا فارق كبير جداً ولكنه لا يزال قابلاً للتجاوز. كمرجع، كانت التغيرات في الترتيب بين Sora وVeo وKling وSeedance خلال العام الماضي تقع عادةً ضمن نطاق 20-40 نقطة. ظهور HappyHorse بفارق 60 نقطة منذ البداية يضعه فعلياً في فئة أداء متقدمة بجيل كامل.

س4: ما مدى جرأة بنيته التي تعتمد على “15 مليار بارامتر + تدفق أحادي بآلية الانتباه الذاتي الكامل (Full Self-Attention)”؟

إنها بنية جريئة للغاية. تعتمد نماذج الفيديو السائدة حالياً بشكل عام على مسارات هجينة مثل "البرجين + آلية الانتباه المتقاطع (Cross-Attention)" أو "DiT + الإسقاط متعدد الوسائط". أما HappyHorse فقد دمج الصوت والفيديو والنص جميعاً في نموذج Transformer واحد مكون من 40 طبقة يتشارك البارامترات. هذا هو نفس المسار التقني الذي تحاول GPT-4o وGemini 2.x اتباعه في مجال الوسائط المتعددة، لكنها المرة الأولى التي يتم فيها التحقق من هذا المسار بأداء فائق في مجال توليد الفيديو.

س5: لماذا اختفى بعد 72 ساعة من تصدره للقائمة؟

هذا "نمط جمع بيانات" شائع للنماذج المجهولة. فقد مرت الإصدارات المبكرة من GPT-4 Turbo على LMArena، ومعاينات Claude 3.5 Sonnet، والمتغيرات المبكرة لـ Gemini 2.0 Flash بنفس العملية: الإطلاق ← جمع بيانات التفضيلات الحقيقية ← السحب ← الإطلاق الرسمي بعد بضعة أسابيع. من المتوقع أن يعود HappyHorse خلال 3-8 أسابيع باسم رسمي.

س6: ما هي نماذج الفيديو التي يمكنني استخدامها كبديل لـ HappyHorse الآن؟

من بين النماذج المتاحة حالياً والتي تتمتع بأقوى أداء شامل: Google Veo 3 (الجودة العامة في الفئة الأولى)، OpenAI Sora 2 (قوة لغة الكاميرا)، Kling 2 (جودة الوجوه/الحركة)، ByteDance Seedance 2.0 (قوي في المشاهد الصينية)، وAli Wan 2.6 (مفتوح المصدر + سهل النشر). إذا كنت بحاجة إلى استدعاء هذه النماذج في وقت واحد عبر واجهة موحدة لإجراء اختبارات مقارنة، يمكنك الوصول إليها جميعاً عبر منصة APIYI (apiyi.com)، مما يغنيك عن التبديل بين حسابات متعددة.

الخلاصة

يُعد HappyHorse-1.0 أكثر "هبوط اضطراري مجهول" إثارة للدراما في مجال توليد الفيديو بالذكاء الاصطناعي في أبريل 2026. وهو يمثل ثلاثة أمور:

- رفع سقف قدرات توليد الفيديو مجدداً: تفوق بـ 60 نقطة في Elo + الفوز بـ 3 مراكز أولى ومركز ثانٍ واحد في 4 مسارات، مما يثبت أن "أقوى نموذج فيديو" نراه اليوم لا يزال بعيداً جداً عن الوصول إلى ذروته.

- توليد الصوت والفيديو المشترك يصبح ساحة المعركة الجديدة: الأداء القوي لـ HappyHorse في المسارات التي تتضمن صوتاً سيدفع الصناعة بأكملها إلى وضع التدريب المسبق الشامل للصوت والفيديو (end-to-end audio-video pretraining) على جدول الأعمال.

- نموذج "مجهول ← سحب ← إطلاق رسمي" أصبح المعيار للنماذج الرائدة: من المتوقع أن تعلن إحدى الشركات المعروفة رسمياً عن تبنيها لهذا النموذج خلال 3-8 أسابيع.

🚀 نصيحة عملية: قبل أن يتم إطلاق HappyHorse رسمياً، فإن أكثر ما يمكنك فعله واقعية ليس تخمين أصله، بل إتقان استخدام نماذج الفيديو الرائدة المتاحة حالياً. نماذج مثل Veo 3 وSora 2 وKling 2 وSeedance 2.0 وWan 2.6 يمكنها تغطية 90% من سيناريوهات الإنتاج الفعلية. ننصحك بالوصول إلى نماذج الفيديو الرئيسية عبر منصة APIYI (apiyi.com)، حيث يمكنك الدفع حسب الاستخدام والتبديل بينها في أي وقت، لتكون مستعداً للانتقال السلس بمجرد إطلاق HappyHorse / Wan 2.7 رسمياً.

الكاتب: فريق APIYI — نركز على توفير وصول مستقر لمطوري الذكاء الاصطناعي إلى النماذج الكبيرة الرائدة، تفضل بزيارة apiyi.com لمعرفة المزيد.

المراجع

-

مدونة WaveSpeedAI – ما هو HappyHorse-1.0

- الرابط:

wavespeed.ai/blog/posts/what-is-happyhorse-1-0-ai-video-model - الوصف: تحليل معمق من طرف ثالث حول البنية، والمعلمات، وسرعة الاستدلال.

- الرابط:

-

Artificial Analysis – لوحة صدارة الفيديو

- الرابط:

artificialanalysis.ai/video/leaderboard/text-to-video - الوصف: التصنيف الأصلي للنماذج في فئتي تحويل النص إلى فيديو وتحويل الصورة إلى فيديو.

- الرابط:

-

أخبار Phemex – HappyHorse يتصدر التصنيفات

- الرابط:

phemex.com/news/article/happyhorse10-surpasses-seedance-20-in-ai-video-model-rankings-71750 - الوصف: بيانات مقارنة بين HappyHorse و Seedance 2.0.

- الرابط:

-

36Kr – النموذج الغامض HappyHorse

- الرابط:

eu.36kr.com/en/p/3757826958635781 - الوصف: قراءة تحليلية في القطاع حول ظهور هذا النموذج المجهول.

- الرابط:

-

Futunn – ارتفاع أسهم علي بابا في بورصة هونج كونج بسبب HappyHorse

- الرابط:

news.futunn.com/en/post/71208943 - الوصف: رد فعل سوق المال تجاه التكهنات حول مصدر النموذج.

- الرابط:

-

مجتمع DEV – من طور HappyHorse

- الرابط:

dev.to/calvin_claire_451169e1b82 - الوصف: استعراض لتكهنات المجتمع المتنوعة حول الفريق المطور.

- الرابط: