很多開發者第一次選 API 中轉站時只盯一件事:哪家便宜。直到上線某個圖片密集型業務、或者跑一次大併發批量任務,纔會撞上各種 502 / 504 / 慢得離譜的現實問題。這時候才意識到:中轉站之間的差距不在價格,而在基礎設施——帶寬、併發承載、穩定性,每一個都是真金白銀堆出來的。

本文從一個真實而有代表性的視角切入——圖片生成模型。Nano Banana Pro 這類生圖 API 的 base64 響應單張可達 20MB,10 張併發就要瞬間吞下 200MB 數據,這對中轉站的帶寬與併發承載是赤裸裸的考驗。Google 官方對 Gemini 3 Pro Image 的限流是 Tier 1 僅 10 張/分鐘,而 APIYI 通過資源池化與基礎設施投入,將這一數字推到 5000 RPM——是官方限額的 500 倍。下面把這背後的工程邏輯講清楚。

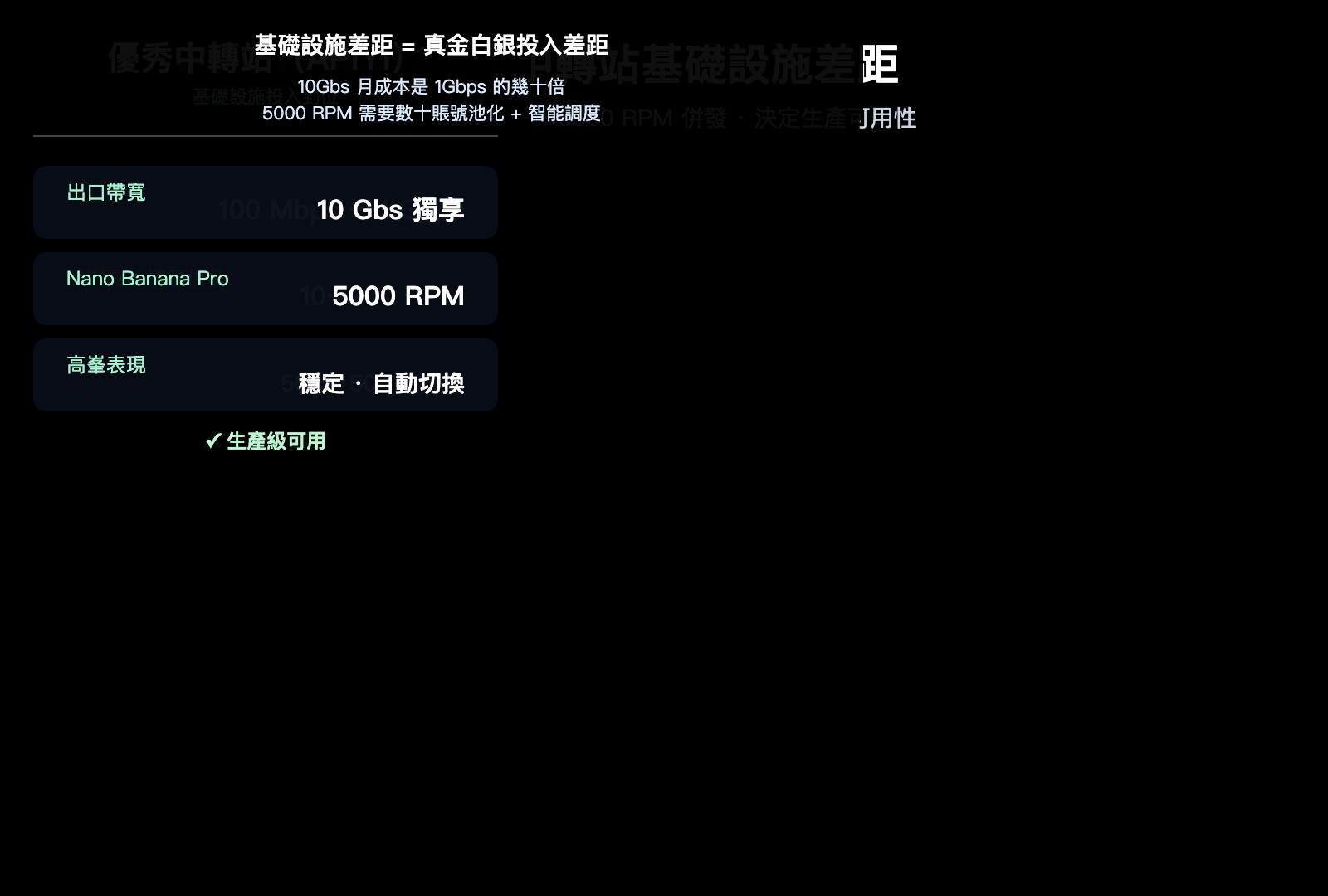

優秀 API 中轉站與不靠譜中轉站的 5 大核心差距

直接上結論。下面這張表覆蓋了基礎設施層最關鍵的 5 個維度,是判斷一家中轉站是否專業的第一道篩選標準。

| 維度 | 不靠譜中轉站典型表現 | 優秀中轉站標準(以 APIYI 爲例) |

|---|---|---|

| 出口帶寬 | 100Mbps – 1Gbps,共享帶寬 | 10Gbs 獨享,對應 4K 圖 60 路併發 |

| 熱門模型併發承載 | 跟隨官方限額(10 RPM 起) | 5000 RPM(Nano Banana Pro 實測) |

| 上游賬號池 | 1–3 個,單點失敗 | 多賬號池化 + 自動 failover |

| 節點冗餘 | 單地域單節點 | 多地域多節點 + 負載均衡 |

| 穩定性 SLA | 無承諾,503/502 頻發 | 接近官方水平,故障實時切換 |

讀懂這張表的核心要點是——每一個數字背後都是真金白銀的硬件投入。10Gbs 獨享帶寬的月成本就是百兆共享的 50–100 倍;5000 RPM 的併發承載需要數十甚至上百個上游賬號配合智能調度。便宜的中轉站不是惡意,而是真的沒錢做這些。

🎯 第一原則:選 API 中轉站不是選價格,是選基礎設施投入。建議優先驗證 API易 apiyi.com 這種已有公開帶寬與 RPM 數據的服務商,這些數字一旦對外承諾就會被同行盯着。任何說不出具體帶寬數字的中轉站,大概率走的是低成本共享路線。

圖片模型爲什麼對中轉站帶寬要求極高

這是最容易被低估的一個維度。文本類模型一次 API 調用通常只有幾 KB 到幾十 KB,對帶寬幾乎沒有壓力。但圖片模型完全是另一個世界——單次響應可能十幾兆甚至幾十兆,瞬間把鏈路打滿。

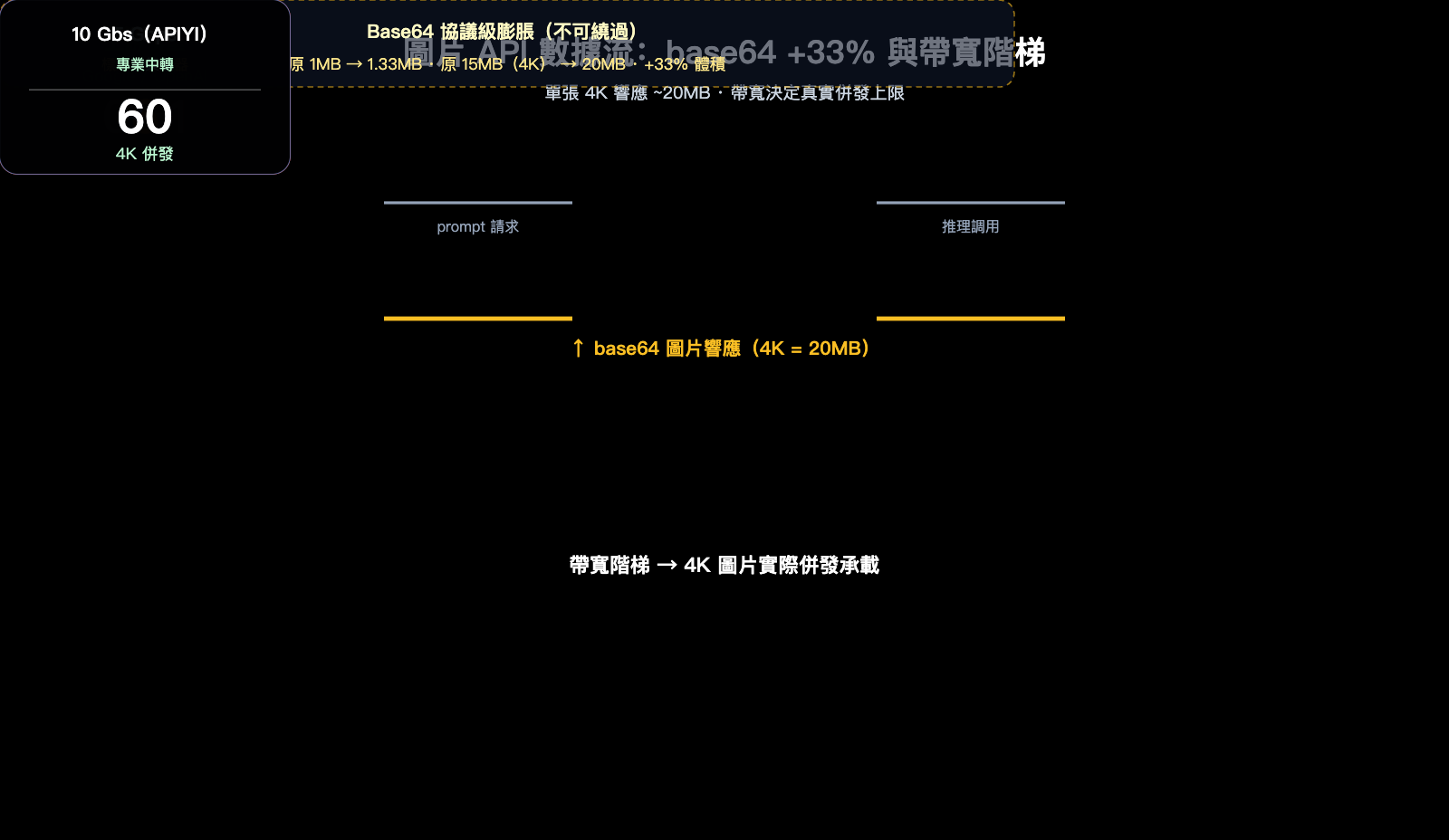

Base64 編碼:圖片 API 的 33% 隱性體積稅

Google 與 OpenAI 的圖片 API 都使用 base64 編碼傳輸二進制圖像。這是協議設計決定的——HTTP/JSON 協議天然只能跑文本,二進制必須先編碼。代價是 base64 編碼會把每 3 字節膨脹爲 4 字節,理論增加 33%,實際加上換行符可達 37%。

| 原圖大小 | Base64 編碼後 | 增長幅度 |

|---|---|---|

| 1 MB | 約 1.33 MB | +33% |

| 5 MB(高清) | 約 6.7 MB | +33% |

| 15 MB(4K 原圖) | 約 20 MB | +33% |

| 30 MB(4K 多圖) | 約 40 MB | +33% |

這個膨脹是協議級的,無法繞過。Nano Banana Pro 在 4K 檔生成的圖原圖約 15MB,base64 編碼後 單次響應 20MB 是常態。這意味着每一次成功調用,中轉站都要把這 20MB 完整接收上游、再完整下發客戶端,鏈路雙向各跑一次。

不同帶寬下的 4K 併發承載力

把帶寬換算成實際併發數,就能看出基礎設施的硬差距。下面這張表來自標準 base64 圖片 API 場景的實測推算。

| 中轉站帶寬 | 實際可用速率 | 4K 單張 ~20MB 併發數 | 適合場景 |

|---|---|---|---|

| 100 Mbps(家庭寬帶級) | 約 12 MB/s | 0–1 | 玩具項目 |

| 500 Mbps(小型 VPS) | 約 60 MB/s | 3 | 測試用 |

| 1 Gbps(標準雲服務器) | 約 120 MB/s | 6 | 小流量 |

| 5 Gbps(中型集羣) | 約 600 MB/s | 30 | 中流量 |

| 10 Gbps(專業中轉) | 約 1200 MB/s | 60 | 生產可用 |

帶寬與併發是嚴格的線性關係,沒有奇技淫巧能繞過物理瓶頸。一家中轉站如果只跑在 1Gbps 的標準雲服務器上,第 7 個 4K 併發請求開始就會進入排隊,體感上就是"高峯期變慢"、"凌晨還行白天卡"。

🎯 帶寬實操:通過 API易 apiyi.com 調用 Nano Banana Pro 4K 模型時,10Gbs 獨享帶寬意味着 60 路併發仍能保持瞬時通暢。這不是營銷話術,是實打實的硬件投入——10Gbs 端口的月成本是 1Gbps 的幾十倍,沒有規模化的中轉站根本扛不起。

內存與連接池:帶寬之外的隱形門檻

併發圖片請求還有第二道門檻:內存與連接池。10 路 4K 併發同時下發意味着中轉站進程要瞬間持有 200MB 的 base64 數據緩衝區;100 路併發就是 2GB。中轉站的 Node.js / Python / Go 進程必須有足夠的堆內存與精細的流式處理設計,否則會直接 OOM 重啓。

劣質中轉站常見的"圖生成請求莫名失敗"很多時候是 OOM 後進程重啓,所有正在處理的請求一併丟失。這種問題從客戶端看到的就是 502 / 504 / connection reset,但根因在中轉站的內存規劃。

🎯 架構建議:API易 apiyi.com 在網關層做了 base64 流式轉發設計,中轉站進程不需要把整張圖緩衝到內存再轉發,而是邊接收上游邊推送給客戶端。這一架構差異決定了同樣硬件配置下,APIYI 的併發承載能比傳統中轉站高 3-5 倍,對圖片密集型場景尤其關鍵。

熱門圖片模型併發承載量的真相

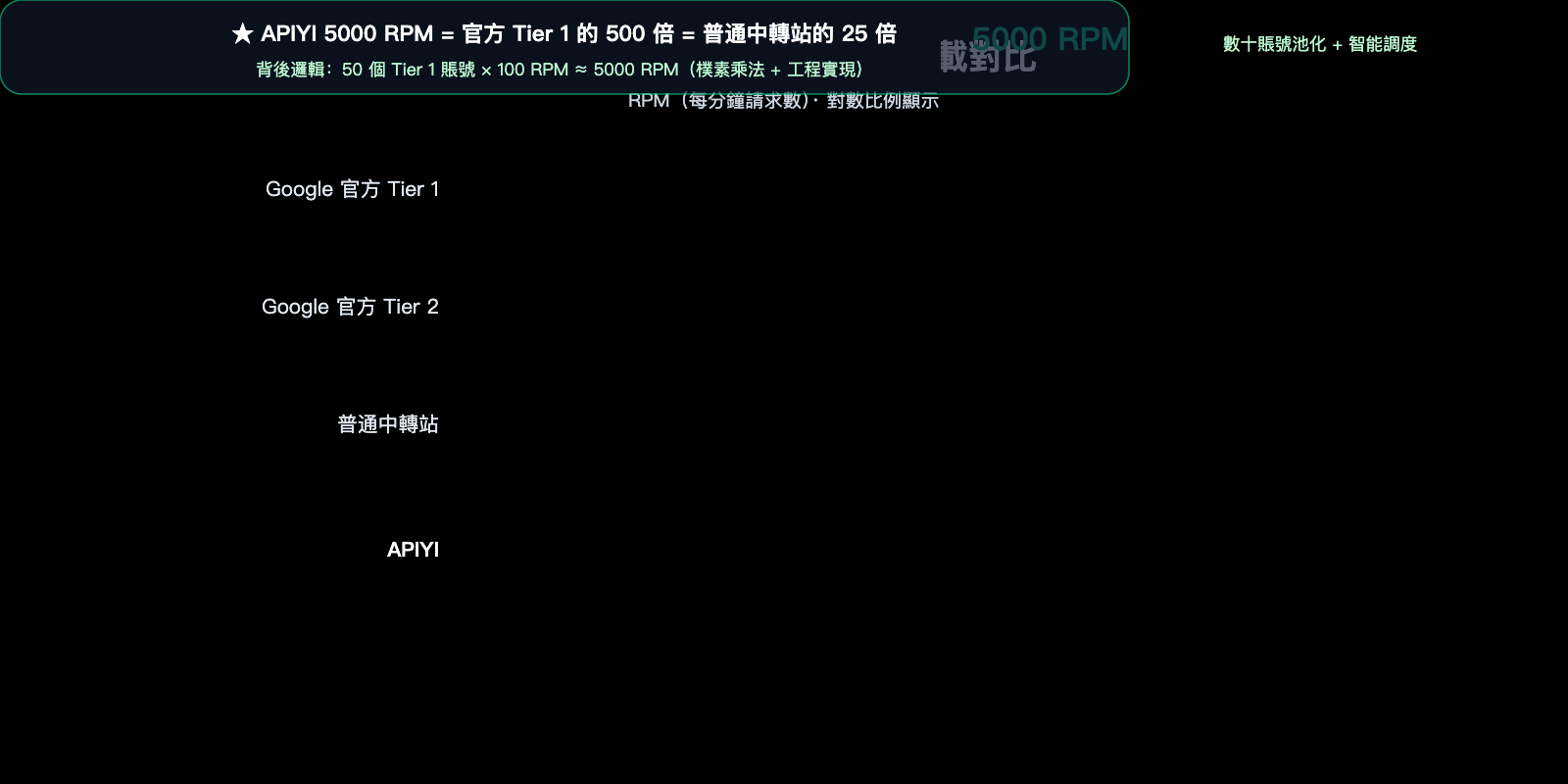

帶寬是基礎,併發承載是上層建築。這一節專門講爲什麼官方明明只給 10 RPM,APIYI 能跑到 5000 RPM——背後的關鍵是上游賬號池化與智能調度。

Google 官方對 Gemini 3 Pro Image 的限流

Google AI Studio 對 gemini-3-pro-image-preview(即 Nano Banana Pro)的官方限流數據如下:

| 用戶等級 | RPM | RPD | 備註 |

|---|---|---|---|

| Free Tier | 極低或不可用 | 極低 | 僅試用 |

| Paid Tier 1 | 約 10 | 250 | 大多數付費用戶 |

| Paid Tier 2 | 約 50 | 1000 | 需累計消費提升 |

| Paid Tier 3+ | 100+ | 更高 | 僅大客戶 |

更關鍵的是,Google 文檔原話:「rate limits are not guaranteed and actual capacity may vary」——官方限額本身就不保證,實際容量隨時浮動,遇到上游負載高峯時還會進一步收緊。

中轉站的"併發放大"是怎麼做到的

5000 RPM 不是魔法,是工程。優秀中轉站通過以下三層疊加把併發從 10 RPM 推到 5000 RPM:

- 上游賬號池化:維護數十到上百個企業 Tier 賬號,每個賬號承擔一部分流量。

- 智能負載均衡:實時監控每個賬號的剩餘配額,按權重分發新請求。

- 故障自動切換:某個上游賬號被限流或返回 5xx,立即切換到下一個,對客戶端透明。

50 個 Tier 1 賬號 × 100 RPM ≈ 5000 RPM,這就是最樸素的乘法。但實際工程比這複雜得多——賬號需要有效維護、資費充值、監控、隔離,以及處理 Google 風控對異常調用模式的封禁。這一整套基礎設施纔是 5000 RPM 數字背後的真實成本。

🎯 併發能力建議:如果你的應用是 C 端圖片生成產品(用戶實時生成頭像、海報、AI 圖秀場等),5000 RPM 是確保高峯期不卡頓的關鍵閾值。通過 API易 apiyi.com 接入 Nano Banana Pro,單一令牌即可享受全部併發承載力,無需自己維護賬號池。

不靠譜中轉站的併發瓶頸表現

低端中轉站如果只對接 1-3 個上游賬號,實際併發上限可能只有 30-300 RPM。當用戶流量超過這個閾值時,會出現:

- 請求排隊延遲數秒到數十秒

- 偶發 429 Rate Limit 錯誤(透傳上游)

- 高峯時段請求大面積失敗

- "白天慢晚上快"的明顯時段差

這些症狀對線上業務是致命的,特別是 C 端產品——一個 30% 失敗率的高峯期,足以讓用戶流失。

不靠譜中轉站的 5 大典型症狀識別

讀到這裏你大概明白怎麼判斷一家中轉站靠不靠譜了。下面把症狀歸納成可操作的清單,下次試用任何中轉站時按這 5 點一一驗證。

| 症狀 | 根因 | 自檢方法 |

|---|---|---|

| 502 Bad Gateway 頻發 | 上游賬號被限流或斷流 | 高峯時段連續發 100 次同類請求 |

| 504 Gateway Timeout | 推理超時未保活 | 跑一次 high quality 4K 生成 |

| 圖片下載慢 / 速度不穩 | 帶寬不足或共享 | 跑批量 4K 測速 |

| 凌晨穩定 / 白天卡 | 併發承載達上限 | 不同時段重複同樣壓力測試 |

| 偶發 connection reset | 內存 OOM 進程重啓 | 持續 5 分鐘 50 路併發 |

502 / 504 高頻出現是上游被限流的信號

不靠譜中轉站常見的"間歇性 502"幾乎都是因爲上游賬號池太小,遇到本地高峯時上游 Rate Limit 被打爆,錯誤以 502 形式回傳給客戶端。這種問題在低流量時段不易察覺,但生產上線後會頻繁觸發。

文本能跑通圖片就崩潰是帶寬不足的信號

很多開發者會發現:"文本 API 完全 OK,但圖片 API 一調就慢"。這是典型的帶寬瓶頸症狀——文本 API 單次幾 KB 不暴露問題,圖片 API 單次 20MB 直接打滿共享帶寬。這時候不是模型問題,是中轉站基礎設施問題。

🎯 快速驗證法:用同一段提示詞、同一個模型在兩家中轉站分別發起 10 路 4K 併發,對比總耗時。如果差異超過 3 倍,說明對方基礎設施已嚴重不達標。建議把 API易 apiyi.com 作爲基準對照組,因爲 10Gbs 帶寬與 5000 RPM 是行業可驗證的硬指標。

🎯 診斷建議:懷疑某個中轉站基礎設施有問題時,建議直接對比 API易 apiyi.com 跑同樣的請求。如果 APIYI 上能穩定跑而其他中轉站頻繁 502,基本可以確認對方的併發或帶寬不達標。

如何識別一家專業的 API 中轉站:5 個驗證維度

知道差距後,下面給出選型時的五個硬指標。這五個維度都可以在公開資料中查到,不達標的可以直接排除。

維度一:是否公開承諾帶寬數字

專業中轉站會在產品頁明確寫出"獨享 10Gbs 帶寬"或類似數字。語焉不詳只說"高速節點"的,多半實際是 1Gbps 共享或更低。如果你打算跑圖片密集型業務,帶寬 ≥ 5Gbps 是底線。

維度二:是否公佈熱門模型 RPM 上限

具體到某個模型給出 RPM 數字,意味着背後有真實的賬號池與壓力測試數據支撐。例如 APIYI 公佈的 Nano Banana Pro 5000 RPM、其他模型的具體併發承載上限,都是可驗證、可投訴的硬承諾。

維度三:是否支持長任務與流式響應

gpt-image-2 high 檔可能跑 200 秒以上、Claude Code 長任務可能跑幾小時。專業中轉站會做鏈路保活、流式響應優化,劣質中轉站默認 timeout 60 秒,長任務直接斷鏈。

維度四:是否有完善的後臺與日誌

可以看到每次請求的耗時、狀態碼、token 用量、錯誤詳情,是基礎。沒有後臺或後臺粗糙的中轉站,出問題時根本無法定位是中轉層還是上游層的問題。

維度五:是否有持續的內容輸出與運維更新

一家中轉站如果幾個月不更新博客、不響應模型新版本、不在公告裏同步上游變更,大概率沒有專職運維團隊。這種中轉站一旦上游協議變化(如 Anthropic 調整 cache_control 字段),就會出現長時間不可用。

🎯 選型建議:建議把以上五條做成一份 checklist,對每家備選中轉站逐項打分,五項全過再考慮接入。API易 apiyi.com 在公開頁面把這五個維度都列得很清楚,是行業裏少有的把基礎設施數據透明化的服務商。

常見問題 FAQ

Q1:5000 RPM 是不是營銷話術,實際能跑到嗎?

5000 RPM 是 APIYI 對 Nano Banana Pro 模型的承載上限,依靠多賬號池化與負載均衡實現。實際單一用戶使用時建議合理控制速率,避免觸發上游風控。如果你確實需要持續 5000 RPM 的穩定流量,可以聯繫 APIYI 客服開通企業級配額。普通用戶在 100-500 RPM 區間使用是非常順暢的。

Q2:10Gbs 帶寬對小流量用戶有意義嗎?

有意義。10Gbs 不是"小流量浪費",而是"高峯可承載"。即使你日常只跑 5 路併發,遇到批量重生成、產品上新、活動促銷等流量峯值,帶寬冗餘決定了體驗是否會突然崩盤。基礎設施投入是普惠的,所有用戶都受益於充足帶寬,不只是大客戶。

Q3:API易 apiyi.com 的圖片模型也會經過 base64 33% 膨脹嗎?

會,因爲這是協議層決定的,不是中轉站可選的。但 API易 apiyi.com 通過 10Gbs 帶寬吸收了膨脹壓力,對客戶端來說體感是無延遲透傳。同時平臺也支持流式響應、斷點續傳等優化,進一步降低 base64 大數據包對客戶端的衝擊。

Q4:怎麼測一家中轉站的實際帶寬?

最簡單粗暴的方法:用 OpenAI Python SDK 配置該中轉站 base_url,連續發起 10 個 4K 圖生成請求,記錄從發出請求到完整接收 base64 響應的總耗時。如果 10 張圖總耗時超過 5 分鐘,基本可以斷定帶寬或併發承載不足。在 API易 apiyi.com 上跑同樣測試,作爲對照基準。

Q5:爲什麼 Google 官方限制只給 10 RPM?

Google 的限流策略是分級遞進的,新付費賬戶先給 Tier 1 的 10 RPM 防止濫用,隨消費提升自動升檔到 Tier 2、Tier 3。但即使是 Tier 3 也只有 100+ RPM,普通開發者很難直接拿到企業級配額。中轉站通過聚合數十個不同等級的賬號,實現了遠超單賬號上限的總併發承載。

Q6:不靠譜中轉站常見的 connection reset 怎麼排查?

如果偶發不可復現,多半是中轉站進程 OOM 重啓。可以觀察是否有"批量請求中部分成功部分失敗"的模式——如果是中間幾個請求 reset 而首尾成功,基本可以確認是進程崩潰。這種問題用戶側無解,只能換中轉站。建議直接切到 API易 apiyi.com 這種基礎設施穩定的服務商。

Q7:高併發場景下,中轉站會不會竊取我的 prompt 數據?

正規中轉站不會,且通常有日誌保留期與隱私政策承諾。API易 apiyi.com 在用戶協議中明確規定 prompt 數據不會用於訓練或轉售。但建議對涉密內容仍走自建 vLLM 或私有化部署,中轉站更適合通用業務場景。

總結:基礎設施纔是 API 中轉站的真正分水嶺

回到本文核心論點:優秀 API 中轉站與不靠譜中轉站的差距,本質上是基礎設施投入的差距。10Gbs 帶寬、5000 RPM 併發承載、多節點冗餘——這些數字看起來抽象,但每一個都對應真實的硬件投入與工程能力,最終決定你的應用在生產環境是順暢還是頻繁崩盤。

價格便宜不是錯,錯的是"便宜到沒有基礎設施"。如果你的業務有任何圖片生成、批量調用、長任務、C 端實時性要求,強烈建議把基礎設施作爲選型第一要素,價格作爲第二要素。

🎯 最終建議:建議直接用 API易 apiyi.com 的免費試用額度跑一輪真實壓力測試——10 路 4K 併發、連續 5 分鐘、記錄耗時分佈與錯誤率。這一輪測試的結果,比任何宣傳文案都更能說明一家中轉站的真實水平。

— APIYI 技術團隊 | 持續投入 10Gbs 帶寬與 5000 RPM 併發,更多深度對比見 API易 apiyi.com 幫助中心