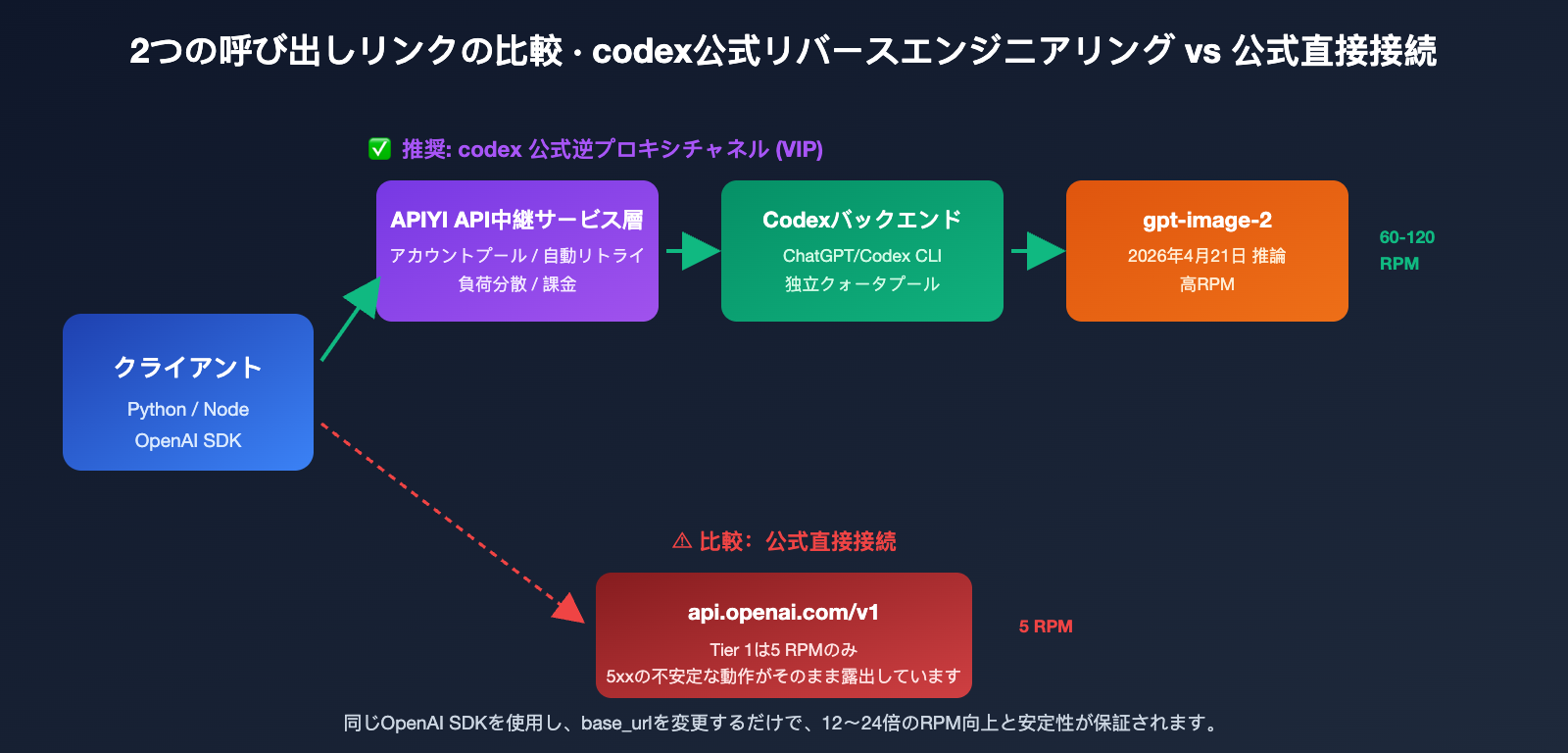

gpt-image-2 を本番環境に導入したばかりのエンジニアの多くが、間違いなく直面する壁がレート制限と安定性です。OpenAI 公式の gpt-image-2 直接接続はレート制限が非常に厳しく、Tier 1 アカウントでは 1 分間にわずか 5 回しかリクエストできず、少しバッチ処理を行うだけで 429 エラーが発生します。また、5xx エラーによる不安定さも頻発します。そのため、多くのチームが「公式リバースエンジニアリング(官逆)チャネル」を探しています。これは、ChatGPT Pro や Codex CLI に組み込まれた gpt-image-2 バックエンドを逆解析し、より高い RPM(1分あたりのリクエスト数)クォータと安定した通信経路を共有する手法です。

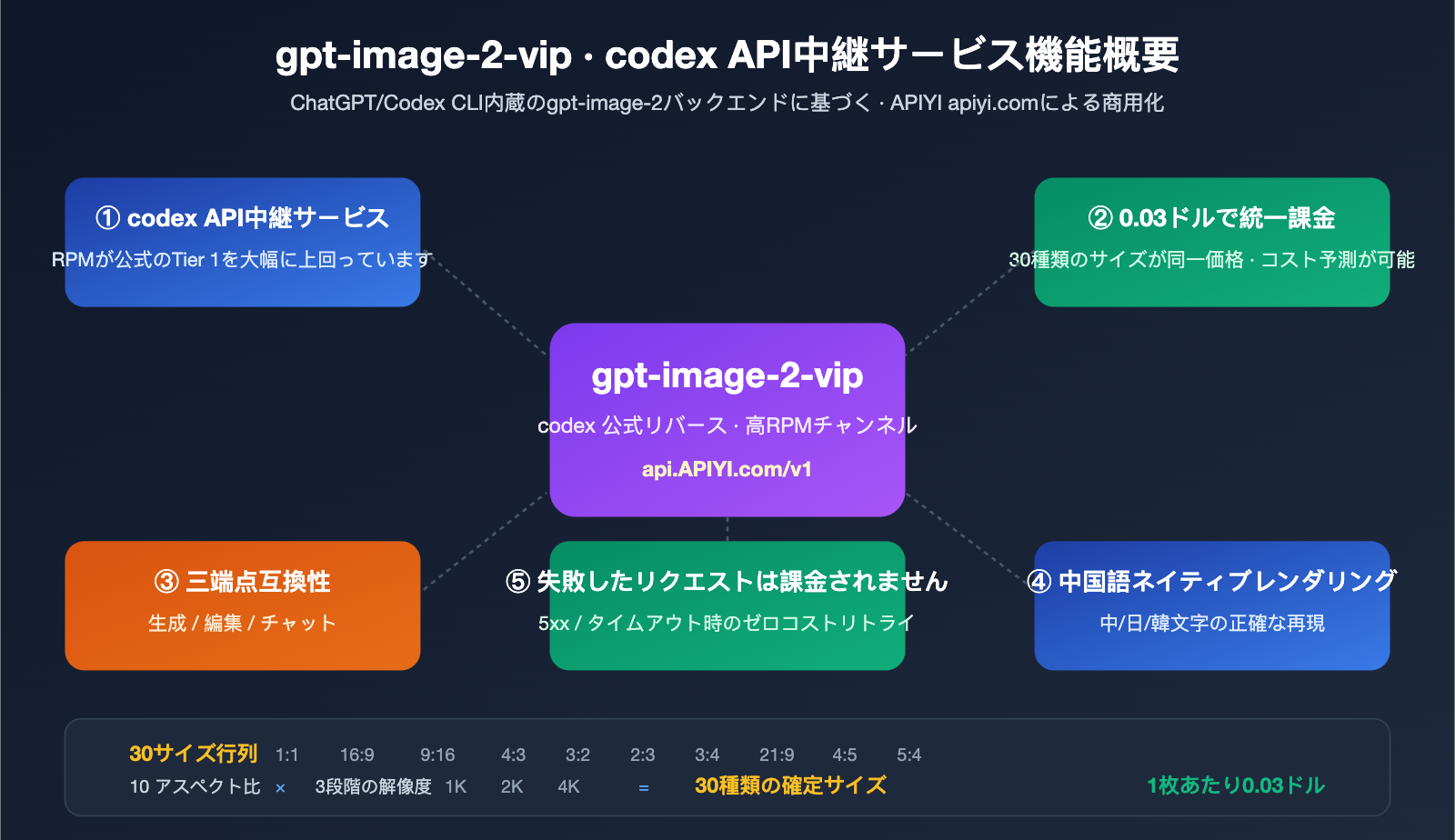

APIYI (apiyi.com) で提供を開始した gpt-image-2-vip モデルは、まさにこの Codex 公式リバースエンジニアリング経路を採用しています。本記事では、5 つのコア機能、30 種類のサイズオプション、3 つの互換エンドポイント、そして実戦的なコードを通じて、このインターフェースを徹底解説します。読み終える頃には、すぐに本番環境へ導入できるようになっているはずです。

Codex 公式リバースエンジニアリング API とは:公式直結との 3 つの本質的な違い

「Codex 公式リバースエンジニアリング」と聞くと、非合法なインターフェースを想像されるかもしれませんが、実際には OpenAI 自体の Codex CLI や ChatGPT Pro に組み込まれた gpt-image-2 の呼び出しチェーンをリバースエンジニアリングしたものです。OpenAI は 2026 年 4 月に gpt-image-2 をリリースした際、Codex CLI ($imagegen スキル) と ChatGPT クライアントにも同時に組み込みました。これら 2 つの入り口は独立したレート制限プールを共有しており、公開 API の制限戦略とは異なります。

Codex 公式リバースエンジニアリングチャネルが行っていることは、Codex 内部のデータフローを REST インターフェースとして公開することです。これにより、通常の OpenAI API を呼び出すのと同じ感覚で gpt-image-2 を利用できますが、実際には ChatGPT 側のバックエンドを経由します。gpt-image-2-vip モデルはこの実装を採用しており、公式直結と比較して 3 つの本質的な違いがあります。

| 項目 | OpenAI 公式直結 | Codex 公式リバースエンジニアリング (gpt-image-2-vip) |

|---|---|---|

| レート制限 | Tier 1: 5 RPM(課金による解除が必要) | Codex 共有プール利用(Tier 1 より遥かに高い) |

| 課金モデル | 画像サイズ/品質に応じた段階的課金 | 一律 $0.03/枚(30 種類のサイズで同価格) |

| 安定性 | 公式の 5xx エラーの影響を直接受ける | 複数アカウントプール + 自動リトライで揺らぎを遮断 |

quality パラメータ |

low/medium/high/auto をサポート | 非サポート(Codex 内部戦略に依存) |

n パラメータ(バッチ) |

1〜4 枚をサポート | 非サポート(単一リクエストにつき 1 枚返却) |

| URL 有効期限 | 60 分間 | 約 24 時間 |

🎯 重要な認識: リバースエンジニアリングは「ハッキング」ではありません。OpenAI 自社の製品(Codex CLI)の内部呼び出しチェーンを REST インターフェースとして公開したものです。APIYI (apiyi.com) がこのチャネルを商用製品化した核心的な価値は、OpenAI を回避することではなく、Codex 側のより安定したレート制限クォータを API ユーザーに提供することにあります。

gpt-image-2-vip の5つの核心特性

チャネル間の違いを理解したところで、具体的な特性を見ていきましょう。以下の5点は、gpt-image-2-vip が同シリーズの gpt-image-2-all や公式の gpt-image-2 と決定的に異なる点であり、ドキュメント上では断片的に記載されているため、特に注目すべき重要ポイントです。

特性1:30種類のサイズを自由に固定、一律0.03ドルで課金

gpt-image-2-vip の最大のエンジニアリング上の価値は、「サイズ」を第一級のパラメータとして扱ったことです。モデルは 10種類の縦横比 × 3段階の解像度 = 30種類の確定サイズ をサポートしており、size パラメータで指定するだけで、プロンプトを複雑に調整する必要はありません。課金体系も非常にシンプルで、30種類すべてのサイズで一律0.03ドル/枚 となっており、「大きなサイズほど高くなる」といった隠れたコストは発生しません。これは、テンプレート化された生成やバッチ処理でサムネイルを作成するチームにとって、コスト予測可能性を大幅に向上させるものです。

| 解像度段階 | 短辺ピクセル | 長辺ピクセル(上限) | 適用シーン |

|---|---|---|---|

| 1K | ~1024 | ~1820 | サムネイル、フィードのカバー画像、SNS |

| 2K | ~2048 | ~3640 | ポスター、ECサイトのメイン画像、コンテンツカード |

| 4K | ~2880 | ~3840 | 高精細印刷、動画素材、印刷物 |

10種類の比率は、1:1の正方形、16:9の横長、9:16の縦長、4:3、3:2、21:9といった主要な構図を網羅しており、基本的に後からトリミングする必要はありません。一律価格設定のもう一つの隠れた価値は、ビジネスのニーズに応じて解像度を切り替えても財務モデルに影響を与えない点です。例えば、A/Bテストで同じプロンプトを使って1Kと4Kを1枚ずつ生成して比較しても、コストは完全に予測可能であり、特定のブランチで大きなサイズを使ったために月末の請求が跳ね上がるような事態を防げます。

特性2:3つのエンドポイントすべてと互換性

gpt-image-2-vip は、OpenAI標準の3つの画像エンドポイントすべてをサポートしています:/v1/images/generations(テキストから画像生成)、/v1/images/edits(画像から画像生成および編集)、/v1/chat/completions(チャットインターフェース経由の生成)。これは非常に重要で、既存のSDKコードを書き直す必要がないことを意味します。model を gpt-image-2 から gpt-image-2-vip に変更し、base_url をAPI中継サービスに向けるだけで利用可能です。

特性3:複数画像の融合と画像から画像生成

/v1/images/edits エンドポイントを通じて1〜N枚の画像をアップロードし、プロンプトで合成の意図を記述することで、モデルがスタイル変換、コンテンツ融合、レイアウトの再構成を行います。例えば、「製品画像 + モデル画像 + 背景画像」の3枚を合成して1枚のECメイン画像を作成するといったことが可能です。各画像は1.5MB以内に圧縮することを推奨します。そうしないと、入力トークンの消費量が大幅に増加する可能性があります。

特性4:ネイティブな中国語理解

gpt-image-2-vip は公式の gpt-image-2 と同じ推論バックエンドを共有しており、中国語、日本語、韓国語、ヒンディー語、ベンガル語の多言語文字レンダリング能力 を継承しています。中国語のプロンプトを英語に翻訳する必要はなく、ポスター内の中国語タイトルやボタンの文字も正確に再現できます。これはMidjourneyやStable Diffusionでは実現できない強みです。

特性5:失敗したリクエストは課金対象外

これは課金面における詳細ですが、大規模な運用においてはコスト削減に大きな意味を持ちます。5xxエラー、タイムアウト、またはセキュリティポリシーによってブロックされたリクエストは一切課金されません。画像が正常に返された呼び出しのみが消費量としてカウントされます。これにより、指数バックオフによる再試行を安心して行うことができ、再試行自体で請求額が膨れ上がる心配はありません。「1枚0.03ドル」という一律価格と合わせることで、コスト予測が非常に簡単になります。1万枚の生成を計画すれば、コストは約300ドルとなり、サイズや品質ごとに複雑な計算をする必要がないため、財務担当者やプロダクトマネージャーも即座に判断を下せます。

呼び出しフローとコード例:Python 5行から始める

接続ロジックは非常にシンプルで、公式のOpenAI SDKと完全に一致しています。base_url と model を切り替えるだけです。以下はテキストから画像生成を行う最小限の実行例で、base_url はAPIYI (apiyi.com) の統一中継入口を指定しています。

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

resp = client.images.generate(

model="gpt-image-2-vip",

prompt="ダークなテクノロジー感のある発表会のメインビジュアル、中央にネオン調のタイトル『APIYI · gpt-image-2 リリース』、左下に小さな文字で 2026",

size="2048x1152"

)

img_b64 = resp.data[0].b64_json

with open("poster_2k.png", "wb") as f:

f.write(base64.b64decode(img_b64))

画像から画像生成や複数画像の融合を行う場合は、client.images.generate を client.images.edit に変更し、image=[open("a.png","rb"), open("b.png","rb")] を追加するだけです。3つのエンドポイントのリクエストボディ形式はすべてOpenAIの公式仕様に従っています。

🎯 クイックスタートのヒント: このフローを30秒で試したい場合は、まずAPIYI (apiyi.com) でAPIキーを作成し、

gpt-image-2-vipと任意のサイズでテスト画像を1枚生成してみることをお勧めします。失敗したリクエストは課金されないため、安心してパラメータを調整できます。

30種類のサイズ選び:シーン別クイックリファレンス

30種類ものサイズオプションを前にして、「どれを選べばいいの?」と迷ってしまう方は少なくありません。ここでは業務シーン別に分類して解説します。まず重要な認識として、すべてのサイズで料金は同一です。コストを気にして画質を犠牲にする必要はありませんので、業務上のニーズに合わせて最適なサイズを選びましょう。

| 業務シーン | 推奨比率 | 推奨解像度 | 代表的なサイズ |

|---|---|---|---|

| 公式アカウントのカバー / 知乎のトップ画像 | 16:9 / 3:2 | 2K | 2048×1152 |

| 小紅書(RED) / TikTok 縦長動画 | 9:16 / 4:5 | 2K | 1152×2048 |

| ECサイトの商品画像 / 詳細ページ | 1:1 | 2K または 4K | 2048×2048 または 2880×2880 |

| Webサイトのヒーロー画像 | 21:9 / 16:9 | 4K | 3840×1640 または 3840×2160 |

| PPT(プレゼン資料)の挿絵 | 16:9 | 1K または 2K | 1820×1024 |

| 印刷物 / ポスター | 3:4 / 2:3 | 4K | 2880×3840 |

| フィードのサムネイル | 1:1 | 1K | 1024×1024 |

| バナー(横長) | 21:9 | 1K | 1820×780 |

🎯 サイズ選択のアドバイス: 本番環境では、**1枚あたり約1〜3MBで、読み込み速度と視覚効果のバランスが最も良い「2K」**を優先的に使用することをおすすめします。印刷や大型ディスプレイでの表示が必要な場合にのみ「4K」を使用し、「1K」はフィードのサムネイルなどの小規模なシーンに限定しましょう。

gpt-image-2 シリーズ3つのチャネル比較:VIP / ALL / 公式

APIYI(apiyi.com)には、gpt-image-2 関連のモデルが3種類存在します。選択を誤るとトラブルの元になるため、導入後に手戻りが発生しないよう、それぞれの違いを明確に解説します。

gpt-image-2(公式直結)はOpenAIの公開APIを経由し、quality や n パラメータをサポートしていますが、5 RPMという厳しいレート制限を自前で処理する必要があります。gpt-image-2-all は集約チャネルであり、すべてのパラメータをサポートしていますが、サイズ指定はプロンプトに依存するため精度がやや劣ります。本記事の主役である gpt-image-2-vip は、Codex官逆(公式リバースエンジニアリング)チャネルを利用しており、サイズ指定の正確さ + 一律料金 + 高RPM が強みです。

| モデルID | チャネルタイプ | レート | サイズ制御 | qualityパラメータ | 一括生成枚数 | 推奨シーン |

|---|---|---|---|---|---|---|

gpt-image-2 |

公式直結 | Tier制限あり | 正確 | ✅ | 1-4 | 品質設定にこだわりたい、低頻度利用 |

gpt-image-2-all |

集約チャネル | 中程度 | プロンプト依存 | ✅ | 1-4 | 既存コードの移行、quality指定が必要 |

gpt-image-2-vip |

Codex官逆 | 高RPM | 正確 | ❌ | 1 | 大量生成、固定サイズ、安定性重視 |

結論:安定した大量生成、固定サイズ、予測可能な課金が必要な場合は gpt-image-2-vip を選んでください。 quality=high を用いた高精細な生成が必須であれば gpt-image-2-all を、すべてのパラメータをフル活用したい低頻度の呼び出しであれば gpt-image-2 を検討してください。

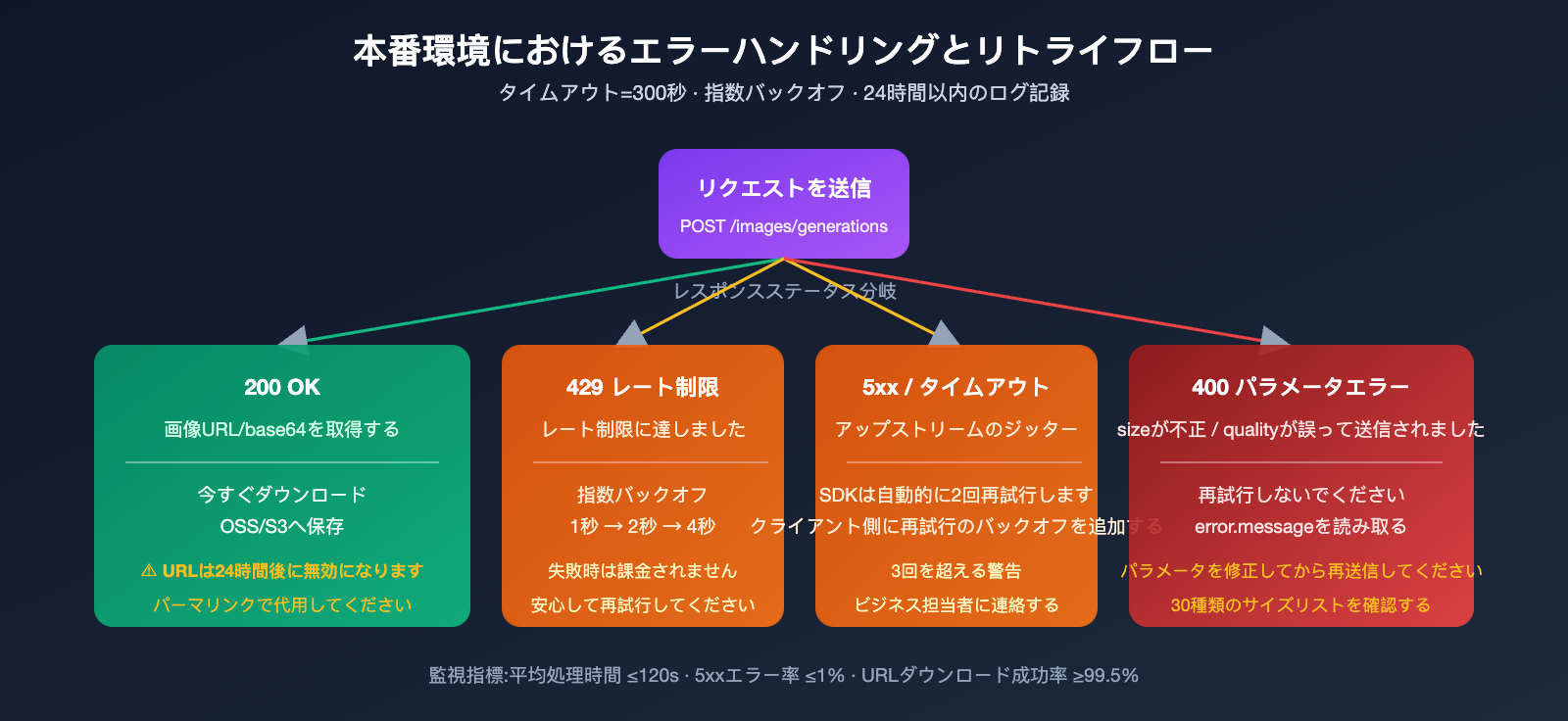

安定性向上のためのベストプラクティス:タイムアウト、リトライ、URLの有効期限

gpt-image-2-vip は公式モデルよりも高いレート制限を誇りますが、画像生成にかかる時間は長めです。公式の推論時間が約30〜60秒であるのに対し、VIPチャンネルは中継とリトライのプロセスが追加されるため、通常90〜150秒を要します。本番環境のコードではこの時間を考慮した設定が必須です。そうしないと、広範囲でタイムアウトエラーが発生してしまいます。

実践1:タイムアウト時間を300秒に設定

OpenAI SDKのデフォルトのタイムアウトは60秒ですが、gpt-image-2-vip には全く足りません。クライアントに対して明示的に timeout=300 を渡すことを強く推奨します。非常に複雑なプロンプトでは200秒近くかかることもあるため、300秒の余裕を持たせるのが最も安全です。

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=300,

max_retries=2

)

実践2:5xxエラーに対する指数バックオフ

中継レイヤーですでにリトライ処理は行われていますが、クライアント側でもう一段階、指数バックオフ(1秒 → 2秒 → 4秒)を追加することで、成功率をさらに高めることができます。失敗したリクエストには課金されないため、リトライは実質コストゼロで行えます。

実践3:返却されたURLは24時間以内にダウンロードして保存

gpt-image-2-vip が返す画像URLの有効期限は約24時間です。期限を過ぎると404エラーになります。そのため、URLを取得したらすぐに自身のOSS/S3へダウンロードしてください。URLをそのままデータベースに長期間保存するのは避けましょう。バッチ処理の場合は、生成から5分以内にダウンロードを完了させることをお勧めします。

実践4:入力画像を1.5MB以内に圧縮

/v1/images/edits インターフェースの入力画像は高忠実度で処理されますが、入力トークン数は画像の画素数に直接依存します。4Kの参照画像と1024pxの参照画像では、トークン消費量が4倍も異なる場合があります。クライアント側で長辺を1024〜2048pxにリサイズしてからアップロードすることで、コスト削減と推論の高速化が可能です。

実践5:単一処理でブロックせず、非同期キューを活用

1枚の生成に90〜150秒かかるため、同期ループで直列に呼び出すことは絶対に避けてください。そうしないと、100枚の生成に2〜3時間もかかってしまいます。推奨される方法は、生成リクエストを非同期タスクキュー(Celeryやasyncioなど)に投げ、ビジネスロジック側は即座にタスクIDを返す形にすることです。フロントエンドからはポーリングやWebSocketで結果を取得します。これにより、60 RPMの吞吐量を最大限に活用し、VIPチャンネルの並列処理能力を真に引き出すことができます。

3つの実戦的な導入シナリオ

理論を理解したところで、実際のビジネスで gpt-image-2-vip をどのように活用するか見ていきましょう。以下の3つのシナリオは、サポートコミュニティで最も多く質問される内容であり、コード構成も非常にシンプルです。

シナリオ1:EC商品メイン画像のバッチ生成

入力:白背景の商品画像1枚 + 中国語のキャッチコピー。出力:異なるスタイルのメイン画像30枚。固定のプロンプトテンプレートを使用し、「スタイル」のプレースホルダーのみを入れ替えて、/v1/images/edits を30回バッチ実行します。サイズは 2048x2048(ECメイン画像の標準サイズ)に固定。30枚のコストは0.9ドル、総所要時間は約2分(60 RPMの並列処理)です。

シナリオ2:多言語ポスターのローカライズ

入力:英語ポスターのベース画像 + ターゲット言語のキャッチコピー。出力:中国語、日本語、韓国語の3バージョン。gpt-image-2-vip の多言語レンダリング能力を活用します。プロンプトに「タイトルを『新品発売』に変更し、フォントは思源黒体を使用、元のレイアウトを維持」と記述するだけで、PSD編集なしでローカライズ版が完成します。

シナリオ3:PPTページ内挿絵のパイプライン

入力:LLMが生成した章の概要。出力:1ページにつき1枚の挿絵。これはTikTokなどで見かける「ワンクリックPPT生成」ツールの核心部分です。すべての挿絵を 1820x1024(16:9のPPT標準比率)に統一し、品質はVIPチャンネルのデフォルト設定で高画質を維持します。1ページあたりのコストは0.03ドル、20ページのPPTなら総コストわずか0.6ドル。LLMのテキスト生成コストを合わせても1ドル以下で完全なPPTが作成できます。

これら3つのシナリオに共通するエンジニアリング構造は、外側でタスクキューによるスケジューリングを行い、内側で gpt-image-2-vip を呼び出し、生成後は即座にOSSへ保存するという点です。フロントエンドにはOSSの永続リンクを表示し、モデルが返す24時間限定のテンポラリURLは直接使用しません。

よくあるエラーとトラブルシューティング

以下の表は、サポートグループで最も多く寄せられるエラータイプをまとめたものです。こちらを確認するだけで、接続に関する問題の 90% は解決できます。

| エラー現象 | 原因 | 解決策 |

|---|---|---|

| 408 / 504 タイムアウト | タイムアウト設定が短すぎる | タイムアウトを 300 秒に設定してください |

| 400 invalid size | サイズが規定の 30 種類に含まれていない | ドキュメント記載の標準サイズに変更してください |

| 400 unsupported_parameter | quality または n>1 を送信している |

VIP チャンネルは非対応です。これらのフィールドを削除してください |

| 画像 URL が 404 | URL の有効期限(24時間)が切れている | 生成後すぐに自社ストレージへダウンロードするように変更してください |

| 中国語が文字化けまたは四角い枠になる | プロンプトに非常に珍しい漢字を使用している | 一般的な文字に変更するか、プロンプト内で「思源黒体(Source Han Sans)を使用」と指定してください |

| input_tokens が想定以上 | 参照画像が大きすぎる | クライアント側で 1.5MB 以内に圧縮してください |

よくある質問 (FAQ)

Q1: gpt-image-2-vip の画像品質は公式と異なりますか?

基盤モデルは完全に同一で、どちらも gpt-image-2-2026-04-21 スナップショットを使用しています。違いはルーティング経路のみです。公式は API クォータプールを、VIP は Codex クォータプールを経由します。生成される画像の視覚的品質に差はなく、大量のブラインドテストでも判別は不可能です。

Q2: なぜ quality パラメータをサポートしていないのですか?

Codex CLI の内部呼び出しは固定の quality=high 戦略を採用しており、VIP チャンネルはこの経路を再利用しているため、上位レイヤーに quality オプションを公開できません。もし業務上の理由で low/medium などの低コスト設定が必要な場合は、gpt-image-2-all を使用してください。

Q3: 失敗したリクエストは本当に課金されませんか?

はい。APIYI (apiyi.com) の課金ポリシーは「成功したレスポンスに対してのみ課金」です。4xx パラメータエラー、5xx サービスエラー、タイムアウトなどは一切消費量にカウントされません。この点は、請求明細で一件ずつ確認可能です。

Q4: 国内サーバーから直接呼び出すことはできますか?

可能です。api.apiyi.com ドメインは国内のコンプライアンスに準拠した経路を通るため、VPN は不要です。これが多くのチームが API 中継サービスを選択する主な理由の一つです。

Q5: VIP チャンネルの RPM 上限はどれくらいですか?

公開されているハードリミットはありませんが、実際にはアカウントプールの負荷状況に依存します。一般的な業務環境では 60~120 RPM で安定して動作し、これは公式 Tier 1 の 5 RPM を大幅に上回ります。さらに高い並行処理が必要な場合は、営業担当までお問い合わせください。

Q6: 1 回につき 1 枚しか画像が返されませんが、バッチ処理はどうすればいいですか?

外側で並行処理ループを実装してください。Python の asyncio.gather や concurrent.futures.ThreadPoolExecutor を使えば、簡単に 60 RPM まで引き上げられます。VIP チャンネルは非同期推論であるため、並行送信が CPU によって制限されることはなく、ボトルネックは中継層の RPM のみとなります。

Q7: 同じプロンプトを複数回呼び出すと、結果は同じになりますか?

完全に同じにはなりません。gpt-image-2-vip は Codex の内部戦略に従っており、seed パラメータが公開されていないため、生成のたびにランダム性が生じます。再現性が必要な場合は、プロンプトを非常に具体的に記述する(例:固定のカラーコードや詳細な構図の記述)、または最初に満足した画像を /v1/images/edits エンドポイントに参照画像として渡して微調整を行ってください。

Q8: 本番環境の安定性を監視するにはどうすればいいですか?

クライアント側で「平均生成時間、5xx エラー率、URL ダウンロード成功率」の 3 つの指標を計測することをお勧めします。正常な状態であれば、平均生成時間は 120 秒以内、5xx エラー率は 1% 未満、URL ダウンロード成功率は 99.5% 以上となります。いずれかの指標に異常がある場合はアカウントプールの負荷が高いことを示しているため、営業担当へリソース調整を依頼してください。

まとめ

gpt-image-2-vip は、Codexの公式逆引きチャネルをベースに構築された画像生成の商用製品です。5つのコア機能により、公式直結の課題を一つずつ解決しました。30種類のサイズ対応 + 0.03ドル均一料金 + 3つのエンドポイント互換性 + 日本語ネイティブ対応 + 生成失敗時の課金なしという特徴を備えています。コンテンツ制作、EC向け素材作成、PPT自動化、ポスターのバッチ生成を行うチームにとって、現在最もコストパフォーマンスに優れた gpt-image-2 接続ソリューションの一つです。

接続方法は base_url と model の2箇所を変更するだけで、SDKコードはOpenAI公式の書き方をそのまま再利用可能です。本番環境では、タイムアウトを300秒に設定し、5xxエラーに対しては指数バックオフを行い、画像URLは24時間以内にローカル保存することを推奨します。これら3つのポイントを押さえることで、安定した運用が可能になります。gpt-image-2 の本番環境への導入を検討されている場合は、APIYI (apiyi.com) でアカウントを作成し、まずはVIPチャネルで実際の業務データを試してから判断することをおすすめします。

著者について: APIYIチームは、マルチモーダルなモデルの集約接続と高並列推論インフラストラクチャに注力しており、日々多くの画像生成API接続に関する相談に対応しています。本記事は実際の運用データに基づいてまとめられています。

gpt-image-2-vipの詳細なパラメータについては、docs.apiyi.com をご覧ください。