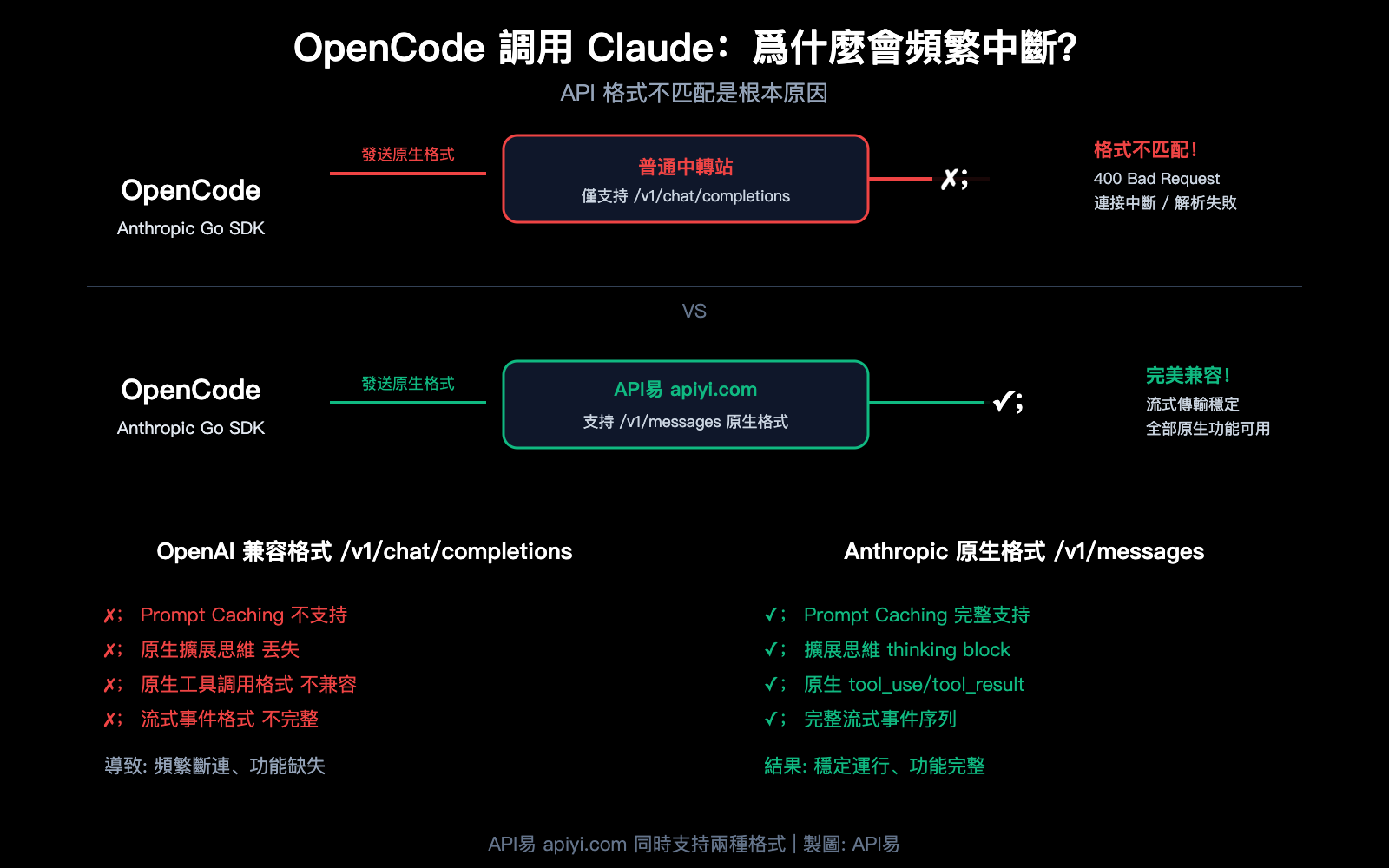

"爲什麼我在 OpenCode 裏用 Claude 模型老是斷?"——這是很多使用 OpenCode(現已更名爲 Crush)接入 Claude 模型的開發者最頭疼的問題。核心原因其實很簡單:OpenCode 使用 Anthropic 原生 SDK 調用 Claude,而很多第三方中轉站只支持 OpenAI 兼容格式,格式不匹配導致頻繁報錯和斷連。

核心價值: 讀完本文,你將理解 OpenCode 調用 Claude 的底層架構、3 個常見中斷原因,以及通過 API易 Anthropic 原生格式接口徹底解決的完整方案。

OpenCode 是什麼:從 OpenCode 到 Crush

OpenCode 是一個基於 Go 語言的終端 AI 編碼助手,使用 Bubble Tea 框架構建了精美的 TUI(終端用戶界面)。項目在 GitHub 上獲得了 11,600+ Star,後被 Charm 團隊收編,更名爲 Crush(charmbracelet/crush,22,200+ Star)。

| 項目信息 | 詳情 |

|---|---|

| 原名 | OpenCode (opencode-ai/opencode) |

| 現名 | Crush (charmbracelet/crush) |

| 開發語言 | Go |

| 界面 | TUI (Bubble Tea) |

| GitHub Stars | 22,200+ (Crush) |

| 支持的 AI 廠商 | Anthropic, OpenAI, Gemini, Groq, OpenRouter, xAI, Bedrock, Azure |

| 工具系統 | 文件操作, Bash, Grep, Glob, LSP, MCP |

| 開源協議 | MIT |

OpenCode 與 Claude Code、Aider 的核心區別

| 特性 | OpenCode/Crush | Claude Code | Aider |

|---|---|---|---|

| 多廠商支持 | 7+ 廠商原生 SDK | 僅 Anthropic | 多廠商 |

| API 格式 | 各廠商原生格式 | Anthropic 原生 | 主要 OpenAI 兼容 |

| Claude 調用方式 | Anthropic SDK 原生 | Anthropic SDK 原生 | OpenAI 兼容格式 |

| 擴展思維 | 條件觸發(含 "think" 關鍵詞) | 內置支持 | 依賴模型 |

| MCP 支持 | 支持 | 支持 | 不支持 |

| UI | TUI 圖形界面 | CLI + TUI | 純 CLI |

關鍵差異: OpenCode 對每個 AI 廠商都使用原生 SDK,不是統一走 OpenAI 兼容格式。這意味着調用 Claude 時用的是 Anthropic 原生 Messages API(/v1/messages),不是 OpenAI 的 Chat Completions API(/v1/chat/completions)。

🎯 核心提示: 這就是問題的根源——如果你的中轉站只提供

/v1/chat/completions接口,

OpenCode 的 Anthropic 原生 SDK 無法正確調用。

API易 apiyi.com 同時支持 OpenAI 兼容格式和 Anthropic 原生格式,可以徹底解決這個問題。

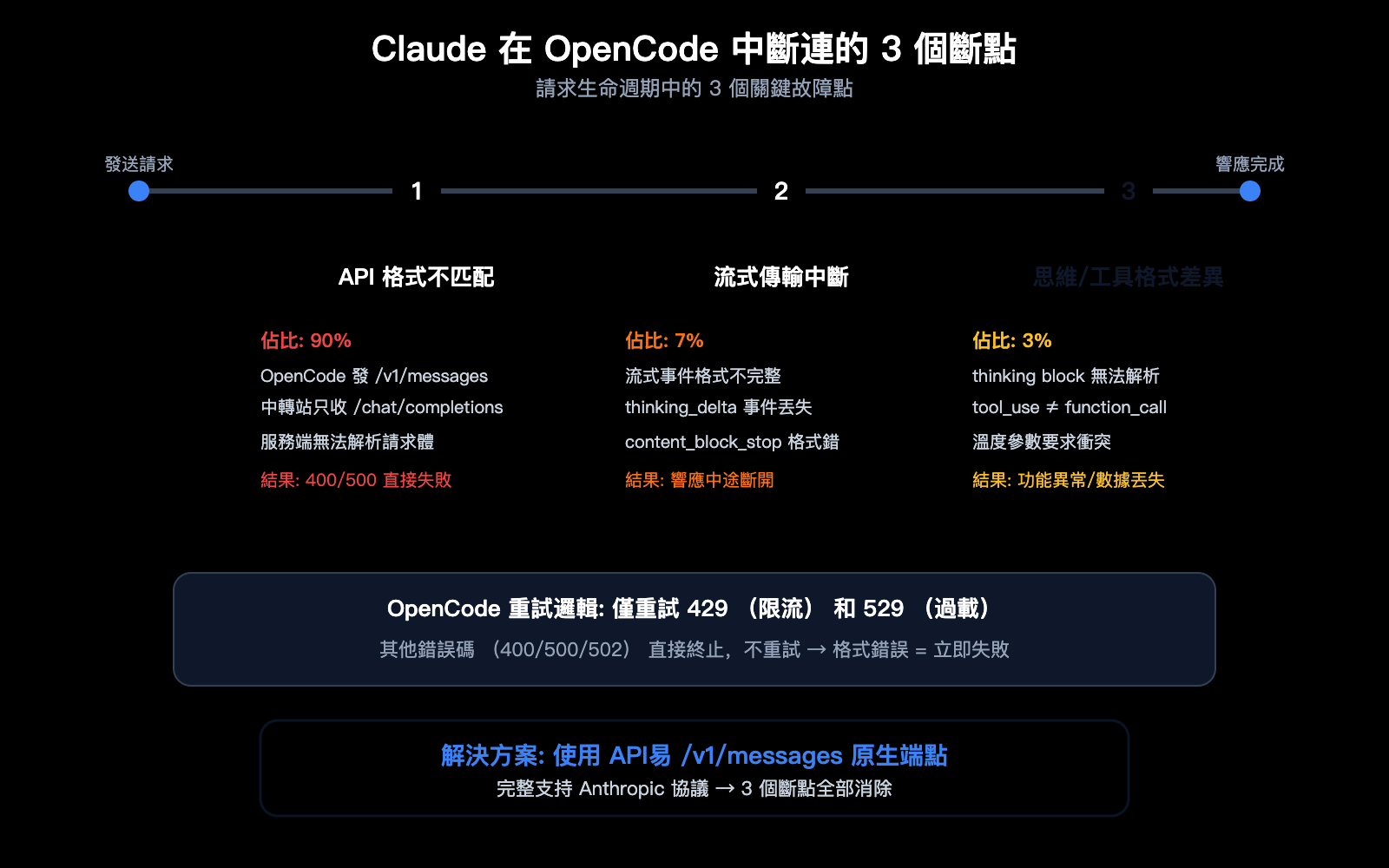

Claude 在 OpenCode 中頻繁中斷的 3 個根本原因

原因一:API 格式不匹配(最常見)

這是 90% 用戶遇到的問題根源。

OpenCode 的 Claude 調用路徑:

OpenCode → Anthropic Go SDK → POST /v1/messages

↑ 使用 Anthropic 原生格式

很多中轉站只提供的接口:

中轉站 → 僅支持 POST /v1/chat/completions

↑ OpenAI 兼容格式

兩種格式的請求結構完全不同:

| 對比項 | Anthropic 原生 (/v1/messages) |

OpenAI 兼容 (/v1/chat/completions) |

|---|---|---|

| 請求端點 | /v1/messages |

/v1/chat/completions |

| 認證頭 | x-api-key: sk-ant-xxx |

Authorization: Bearer sk-xxx |

| 消息格式 | messages: [{role, content: [{type, text}]}] |

messages: [{role, content: "text"}] |

| 系統提示 | system: "..." (頂層字段) |

messages: [{role: "system", content: "..."}] |

| 工具調用 | tool_use / tool_result 類型 |

function_call / tool_calls 格式 |

| 流式響應 | message_start, content_block_delta |

data: {"choices": [...]} |

| 擴展思維 | thinking block 原生支持 |

不支持或需特殊處理 |

當 OpenCode 發送 Anthropic 格式請求到只支持 OpenAI 格式的端點時,服務器無法解析請求,直接返回錯誤或斷連。

原因二:流式傳輸中斷

OpenCode 使用 Anthropic SDK 的 Messages.NewStreaming() 進行流式響應。流式傳輸過程中的事件序列爲:

ContentBlockStartEvent → ContentBlockDeltaEvent (多次) → ContentBlockStopEvent → MessageStopEvent

如果中轉站對 Anthropic 流式格式支持不完整(比如不返回 thinking_delta 事件,或 content_block_stop 格式不正確),OpenCode 的事件解析會失敗並中斷連接。

OpenCode 的重試邏輯只覆蓋 HTTP 429(限流)和 529(過載),其他錯誤碼直接終止,不會重試。這意味着格式錯誤導致的 400/500 響應會立即失敗。

原因三:擴展思維和工具調用的格式差異

OpenCode 對 Claude 的擴展思維有特殊處理邏輯:

- 當用戶消息包含 "think" 關鍵詞時自動啓用

- 啓用後分配 80% 的

maxTokens作爲思維預算 - 溫度強制設爲 1.0

如果中轉站不支持 Anthropic 原生的 thinking block 格式,思維內容會丟失或導致解析錯誤。同樣,Anthropic 原生的 tool_use / tool_result 格式與 OpenAI 的 function_call / tool_calls 格式也完全不同。

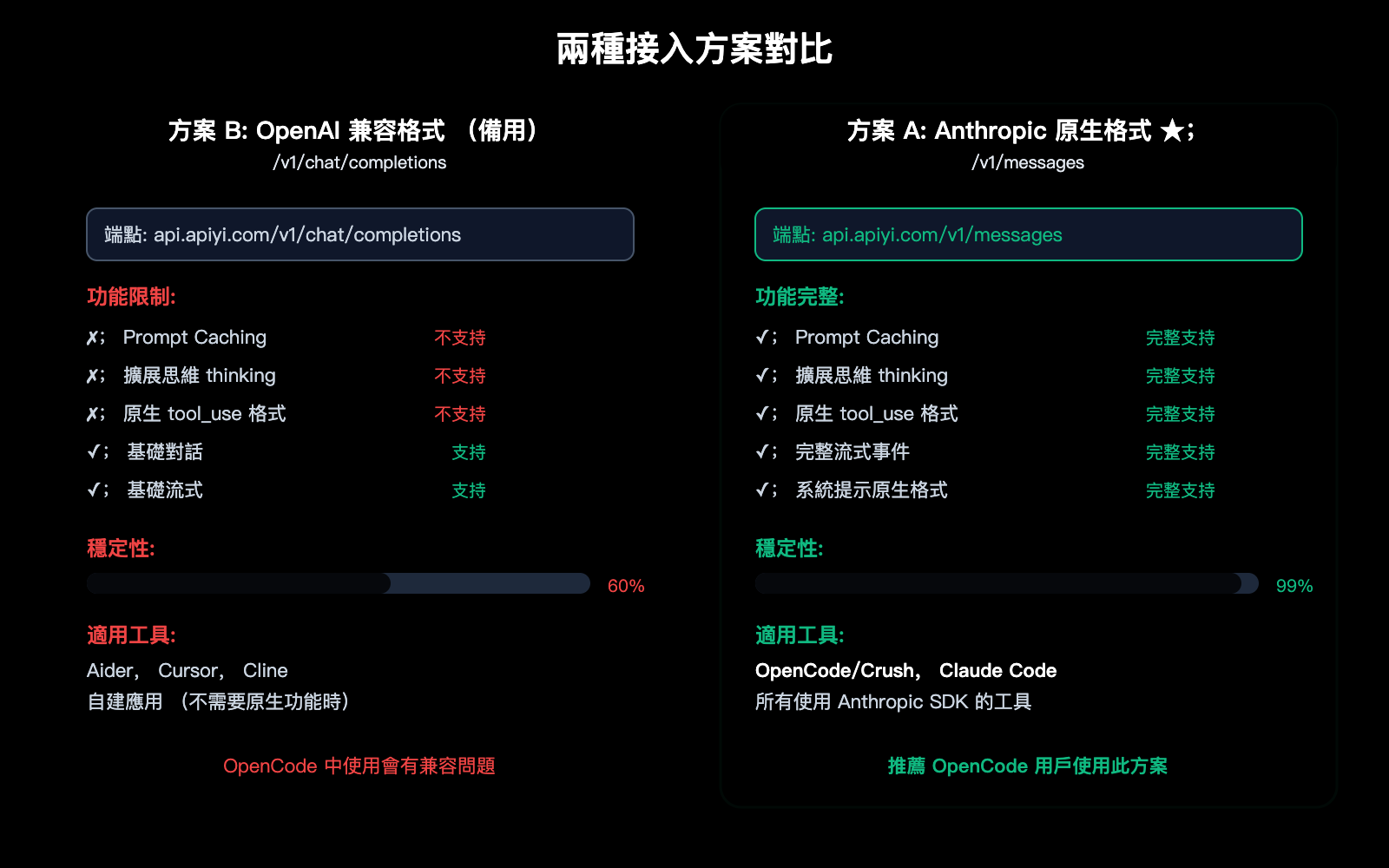

解決方案:使用支持 Anthropic 原生格式的 API 接口

API易 雙格式支持架構

API易 apiyi.com 同時支持兩種 API 格式,開發者可以根據工具的需求選擇:

| 格式 | 請求端點 | 適用工具 | 功能完整性 |

|---|---|---|---|

| Anthropic 原生 | https://api.apiyi.com/v1/messages |

OpenCode/Crush, Claude Code | 100% 完整 |

| OpenAI 兼容 | https://api.apiyi.com/v1/chat/completions |

Aider, Cursor, 自建應用 | 基礎功能完整 |

方案一:OpenCode 中配置 Anthropic 原生格式(推薦)

由於 OpenCode 的 Anthropic 提供商不直接暴露 Base URL 配置項,需要通過環境變量設置:

# 設置 Anthropic API Key(使用 API易 的 Key)

export ANTHROPIC_API_KEY="sk-你的APIYIkey"

# 設置 Anthropic Base URL(指向 API易 原生接口)

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

# 啓動 OpenCode

opencode

或者在 .opencode.json 配置文件中設置:

{

"providers": {

"anthropic": {

"apiKey": "sk-你的APIYIkey"

}

},

"agents": {

"coder": {

"model": "claude-sonnet-4-6",

"maxTokens": 16000

},

"task": {

"model": "claude-haiku-4-5-20251001",

"maxTokens": 8000

}

}

}

配合環境變量使用:

# 在 .bashrc 或 .zshrc 中添加

export ANTHROPIC_API_KEY="sk-你的APIYIkey"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

這樣 OpenCode 會通過 Anthropic 原生 SDK 調用 https://api.apiyi.com/v1/messages,保留全部原生功能:Prompt Caching、擴展思維、原生工具調用。

方案二:通過 Local Provider 使用 OpenAI 兼容格式(備用)

如果方案一不生效,可以將 API易 配置爲 OpenCode 的 Local Provider:

# 設置 Local 端點

export LOCAL_ENDPOINT="https://api.apiyi.com/v1"

export LOCAL_API_KEY="sk-你的APIYIkey"

{

"providers": {

"local": {

"apiKey": "sk-你的APIYIkey"

}

},

"agents": {

"coder": {

"model": "claude-sonnet-4-6",

"maxTokens": 16000

}

}

}

注意: 此方案走 OpenAI 兼容格式(/v1/chat/completions),會丟失以下原生功能:

- Prompt Caching(緩存命中)

- 原生擴展思維(thinking block)

- Anthropic 原生工具調用格式

💡 建議: 優先使用方案一(Anthropic 原生格式),獲得完整功能和最佳穩定性。

在 API易 apiyi.com 後臺獲取 Key 時,選擇【ClaudeCode】分組可享受 88% 折扣。

API易 Claude API 調用完整指南

Key 獲取和配置

| 步驟 | 操作 | 說明 |

|---|---|---|

| 1. 獲取 Key | 訪問 api.apiyi.com/token |

後臺令牌管理頁面 |

| 2. 選擇令牌 | 使用默認令牌或新建 | 新建時選【ClaudeCode】分組享 88 折 |

| 3. 記錄 Base URL | https://api.apiyi.com |

統一入口地址 |

支持的兩種請求格式

格式一:Anthropic 原生格式(OpenCode/Claude Code 推薦)

請求地址: https://api.apiyi.com/v1/messages

import anthropic

client = anthropic.Anthropic(

api_key="sk-你的APIYIkey",

base_url="https://api.apiyi.com"

)

message = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=4096,

messages=[

{"role": "user", "content": "用 Python 寫一個快速排序"}

]

)

print(message.content[0].text)

格式二:OpenAI 兼容格式(Aider/Cursor/自建應用推薦)

請求地址: https://api.apiyi.com/v1/chat/completions

import openai

client = openai.OpenAI(

api_key="sk-你的APIYIkey",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "user", "content": "用 Python 寫一個快速排序"}

]

)

print(response.choices[0].message.content)

支持的 Claude 模型列表

最新主力模型(推薦使用):

| 模型 ID | 系列 | 定位 | 適用場景 |

|---|---|---|---|

claude-opus-4-6 |

Opus | 最強推理 | 複雜架構設計、深度分析 |

claude-sonnet-4-6 |

Sonnet | 性能均衡 | 日常編碼、代碼審查 |

claude-haiku-4-5-20251001 |

Haiku | 快速響應 | 簡單任務、分類、提取 |

推理模型(強制啓用擴展思維):

| 模型 ID | 說明 |

|---|---|

claude-opus-4-6-thinking |

Opus + 強制推理 |

claude-sonnet-4-6-thinking |

Sonnet + 強制推理 |

claude-haiku-4-5-20251001-thinking |

Haiku + 強制推理 |

推理模型與標準模型是同一個底層模型,區別在於推理模型會強制啓用擴展思維(thinking),輸出更詳細的推理過程,適合需要深度分析的場景。

查看 Anthropic 原生格式的擴展思維調用代碼

import anthropic

client = anthropic.Anthropic(

api_key="sk-你的APIYIkey",

base_url="https://api.apiyi.com"

)

# 使用 thinking 模型,強制擴展思維

message = client.messages.create(

model="claude-sonnet-4-6-thinking",

max_tokens=16000,

thinking={

"type": "enabled",

"budget_tokens": 10000 # 思維 Token 預算

},

messages=[

{"role": "user", "content": "分析這段代碼的時間複雜度並優化"}

]

)

for block in message.content:

if block.type == "thinking":

print(f"思維過程:\n{block.thinking}")

elif block.type == "text":

print(f"最終回答:\n{block.text}")

🚀 快速開始: 訪問 API易

api.apiyi.com/token獲取 Key,

選擇【ClaudeCode】分組享 88 折優惠。

一個 Key 同時支持 Anthropic 原生格式和 OpenAI 兼容格式,

適配 OpenCode、Claude Code、Aider、Cursor 等全部主流 AI 編碼工具。

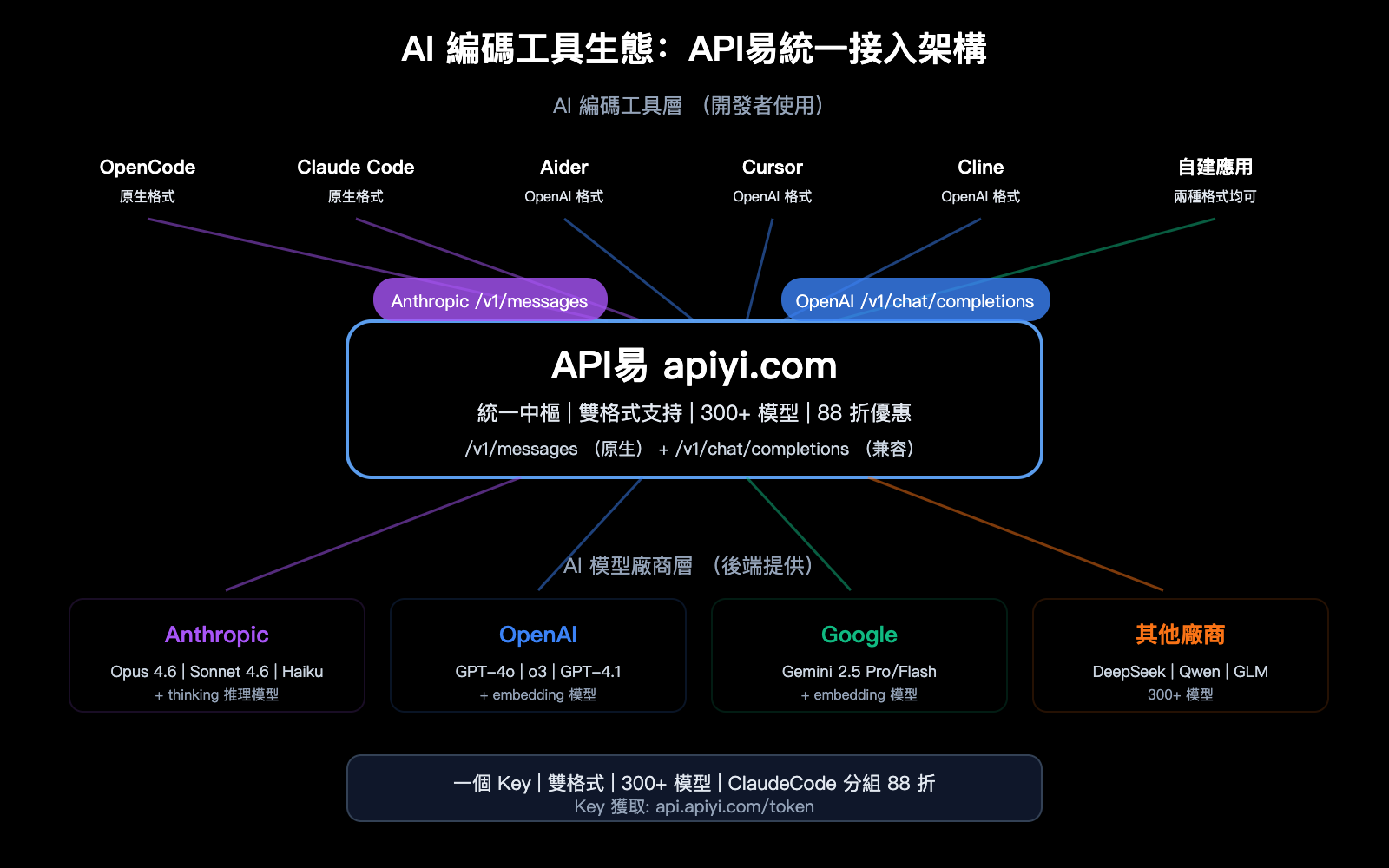

不同 AI 編碼工具的最佳接入方式

| 工具 | 推薦接口格式 | Base URL | 模型推薦 |

|---|---|---|---|

| OpenCode/Crush | Anthropic 原生 | https://api.apiyi.com |

claude-sonnet-4-6 |

| Claude Code | Anthropic 原生 | https://api.apiyi.com |

claude-sonnet-4-6 |

| Aider | OpenAI 兼容 | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| Cursor | OpenAI 兼容 | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| Cline (VS Code) | OpenAI 兼容 | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| 自建應用 (Python) | 兩種均可 | 見上文 | 按需選擇 |

各工具配置速查

OpenCode/Crush:

export ANTHROPIC_API_KEY="sk-你的APIYIkey"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

Claude Code:

export ANTHROPIC_API_KEY="sk-你的APIYIkey"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

claude

Aider:

export OPENAI_API_KEY="sk-你的APIYIkey"

export OPENAI_API_BASE="https://api.apiyi.com/v1"

aider --model claude-sonnet-4-6

🎯 統一管理: 通過 API易 apiyi.com 一個 Key 管理所有 AI 編碼工具的 API 調用,

支持 Claude、GPT、Gemini 等 300+ 模型,統一計費統一管理。

常見問題

Q1: OpenCode 報 “agent coder not found” 怎麼辦?

這是 OpenCode 最常見的錯誤,表示沒有找到有效的 AI 提供商配置。檢查以下幾點:1) ANTHROPIC_API_KEY 環境變量是否設置且有效;2) .opencode.json 中的 providers.anthropic.apiKey 是否正確;3) Key 是否有餘額。通過 API易 apiyi.com/token 獲取的 Key 可以直接使用,無需其他配置。

Q2: 爲什麼 Anthropic 原生格式比 OpenAI 兼容格式更穩定?

因爲 OpenCode 使用 Anthropic 官方 Go SDK 直接調用,SDK 內部處理了 Anthropic 特有的流式事件格式、重試邏輯和錯誤處理。走 OpenAI 兼容格式需要中間層轉換,轉換過程中可能丟失 thinking_delta 事件、tool_use 格式等關鍵信息,導致解析失敗。API易 apiyi.com 的 /v1/messages 端點完整支持 Anthropic 原生協議,不需要格式轉換。

Q3: thinking 模型和普通模型有什麼區別?什麼時候用?

claude-sonnet-4-6 和 claude-sonnet-4-6-thinking 是同一個底層模型。thinking 版本強制啓用擴展思維,會輸出詳細的推理過程。普通版本默認不啓用(在 OpenCode 中,消息包含 "think" 關鍵詞時會自動啓用)。建議:日常編碼用普通版本(更快更省 Token),複雜架構設計或 debug 用 thinking 版本。

Q4: OpenCode 已經改名 Crush 了,配置方式有變化嗎?

核心架構沒有變化,Crush 繼承了 OpenCode 的全部代碼。配置文件從 .opencode.json 可能改爲 .crush.json(取決於版本),環境變量保持不變。ANTHROPIC_API_KEY 和 ANTHROPIC_BASE_URL 的配置方式完全一致。建議使用最新版 Crush 以獲得更好的穩定性和功能。

總結:選對 API 格式,Claude 在 OpenCode 中穩如磐石

OpenCode/Crush 中 Claude 模型頻繁中斷的根本原因是 API 格式不匹配——OpenCode 使用 Anthropic 原生格式,但很多中轉站只支持 OpenAI 兼容格式。

解決方案非常明確:

- 使用支持 Anthropic 原生格式的 API 服務 —— API易 的

/v1/messages端點 - 配置正確的環境變量 ——

ANTHROPIC_BASE_URL=https://api.apiyi.com - 選擇合適的模型 —— 日常用

claude-sonnet-4-6,深度推理用claude-sonnet-4-6-thinking

推薦通過 API易 apiyi.com 統一管理所有 AI 編碼工具的 API 調用。訪問 api.apiyi.com/token 獲取 Key,選擇【ClaudeCode】分組享 88 折優惠。一個 Key 同時兼容 Anthropic 原生格式和 OpenAI 兼容格式,適配市面上全部主流 AI 編碼工具。

📝 本文作者: APIYI 技術團隊 | API易 apiyi.com – 300+ AI 大模型 API 統一接入平臺

參考資料

-

OpenCode GitHub 倉庫(已歸檔): 原始項目代碼和文檔

- 鏈接:

github.com/opencode-ai/opencode - 說明: 已更名爲 Crush

- 鏈接:

-

Crush GitHub 倉庫: 活躍開發中的繼任項目

- 鏈接:

github.com/charmbracelet/crush - 說明: 由 Charm 團隊維護的最新版本

- 鏈接:

-

Anthropic API 文檔: Messages API 原生格式規範

- 鏈接:

docs.anthropic.com/en/api/messages - 說明:

/v1/messages端點的完整請求和響應格式

- 鏈接:

-

API易 文檔: Claude API 接入指南

- 鏈接:

apiyi.com - 說明: 同時支持 Anthropic 原生格式和 OpenAI 兼容格式

- 鏈接: